如何簡單理解視覺語言模型以及它們的架構、訓練過程?

關于視覺語言模型(VLMs),以及它們的架構、訓練過程和如何通過VLM改進圖像搜索和文本處理的多模態神經網絡。可以參考這篇文章:https://towardsdatascience.com/an-introduction-to-vlms-the-future-of-computer-vision-models-5f5aeaafb282

這篇文章介紹了視覺語言模型(VLMs),它們是未來的復合AI系統。文章詳細描述了VLMs的基本原理、訓練過程以及如何開發一個多模態神經網絡,用于圖像搜索。作者通過實例展示了這些模型如何解決各種任務,如圖像描述、圖像解釋和數學問題求解。此外,文章還討論了VLMs的架構、訓練過程以及如何評估其質量。總的來說,文章具有較高的創新性和實用性,為未來計算機視覺模型的發展指明了方向。值得關注的是,VLMs通過融合圖像和文本信息,可以在多種任務中提供卓越的性能,尤其在處理復雜的多模態數據時。

文章全文解讀

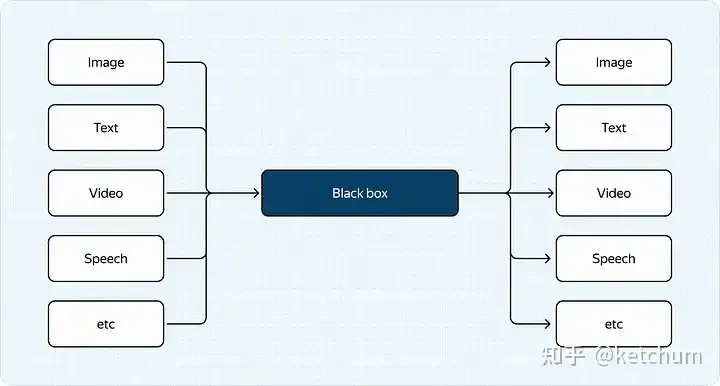

直到最近,AI模型都是專門針對特定類型的數據,比如文本或圖像。然而,隨著通用語言模型(如GPTs)的發展,它們不僅變得更加通用,而且更加強大。然而,即使在語言模型取得了巨大進展的情況下,它們仍然與計算機視覺領域保持獨立。VLMs(視覺語言模型)則是將語言處理和視覺處理結合起來的復合AI系統,它們可以理解和處理多種數據類型,包括文本、圖像、視頻和音頻。

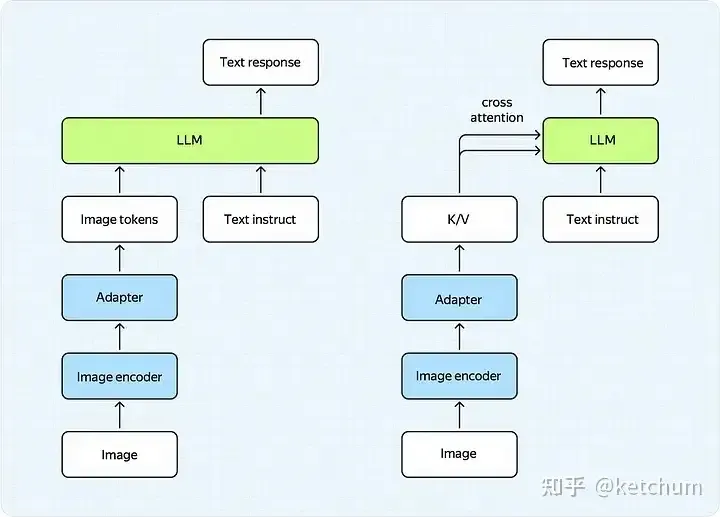

VLMs的核心是三個主要組件:語言模型(LLM)、圖像編碼器和適配器。圖像編碼器負責處理圖像,將其轉換成模型可以理解的形式。適配器作為中介,使圖像編碼器和語言模型能夠協同工作。這種架構通過適配器將圖像信息融入到語言模型中,從而實現多模態的理解和處理。

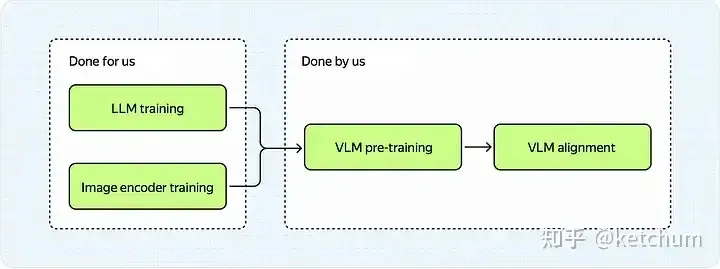

訓練VLMs的過程分為預訓練和對齊兩個階段。預訓練階段的目標是將文本和圖像模態聯系在一起,并加載世界知識。預訓練數據可以來自多種來源,如網頁文檔、圖像-文本對和指令-答案對。對齊階段則專注于高質量的數據,確保模型能夠理解圖像并生成準確的響應。

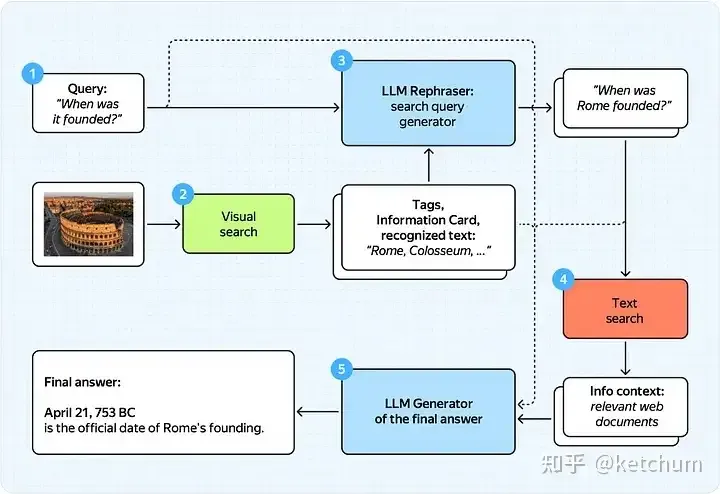

評估VLMs的質量主要通過兩種方法:在公開基準上的度量計算和人機對比評估。這些評估方法可以幫助我們了解模型在不同任務中的表現,并進行改進。此外,文章還討論了如何將VLMs應用于實際場景,如圖像搜索,通過將傳統的單模態處理方式轉變為多模態處理,顯著提高了系統的性能和用戶體驗。

核心要點

- VLMs的基本概念

VLMs是結合了文本和圖像處理能力的復合AI系統,可以處理多種數據類型,包括文本、圖像、視頻和音頻。它們通過融合不同模態的信息來提高處理復雜數據的能力。 - VLMs的架構

VLMs由三個主要組件構成:語言模型(LLM)、圖像編碼器和適配器。圖像編碼器負責處理圖像,適配器將圖像編碼器的輸出轉換為語言模型可以理解的形式,從而實現多模態處理。 - 訓練過程

訓練VLMs分為預訓練和對齊兩個階段。預訓練階段使用多模態數據來加載世界知識,并將文本和圖像模態聯系在一起。對齊階段則專注于高質量的數據,確保模型能夠理解圖像并生成準確的響應。 - 評估方法

VLMs的質量可以通過在公開基準上的度量計算和人機對比評估來評估。這兩種方法可以幫助我們了解模型在不同任務中的表現,并進行改進。 - 應用實例VLMs可以應用于實際場景,如圖像搜索。通過將傳統的單模態處理方式轉變為多模態處理,VLMs顯著提高了系統的性能和用戶體驗。