從未見過現實世界數據,MIT在虛擬環境中訓練出機器狗,照樣能跑酷

如今,機器人學習最大的瓶頸是缺乏數據。與圖片和文字相比,機器人的學習數據非常稀少。目前機器人學科的主流方向是通過擴大真實世界中的數據收集來嘗試實現通用具身智能,但是和其他的基礎模型,比如初版的 StableDiffusion 相比,即使是 pi 的數據都會少七八個數量級。MIT 的這個團隊希望用生成模型來作為機器人學習的新數據源,用工程手段來取代傳統的數據收集,實現一條通過由生成模型加持的物理仿真來訓練機器人視覺的技術路線。

隨著機器人在訓練過程中持續進化,進一步提升技能所需的數據也在增長。因此獲取足夠的數據對于提升機器人的性能至關重要,但在當前實踐中,針對新場景和新任務獲取數據是一個從頭開始不斷重復的手動過程。

另一種替代方法則是在模擬環境中訓練,從中可以對更多樣化的環境條件進行采樣,并且機器人可以安全地探索故障案例并直接從它們自己的行為中學習。盡管業界已經在模擬物理和渲染方面投入了大量資金,但目前為實現真實性所做的最佳實踐仍與現實存在差距。

一方面渲染真實的圖像意味著要制作細致、逼真的場景內容,但大規模手動制作此類內容以獲得機器人 sim-to-real(模擬到現實)遷移所需要的多樣性,成本過高。另一方面,如果缺少多樣化和高質量的場景內容,在模擬環境中訓練的機器人在遷移到真實世界時表現得太脆弱。

因此,如何在無限的虛擬環境中匹配現實世界,并將色彩感知融入到 sim-to-real 學習中,這是一個關鍵挑戰。

近日, MIT CSAIL 的研究者開發出了一套解決方案,他們將生成模型作為機器人學習的新數據源,并使用視覺跑酷(visual parkout)作為試驗場景,讓配備單色相機的機器狗快速攀爬障礙物。

研究者的愿景是完全在生成的虛擬世界中訓練機器人,而核心在于找到精確控制語義組成和場景外觀的方法,以對齊模擬物理世界,同時保持對于實現 sim-to-real 泛化至關重要的隨機性。

- arXiv 地址:https://arxiv.org/pdf/2411.00083

- 項目主頁:https://lucidsim.github.io/

- 論文標題:Learning Visual Parkour from Generated Images

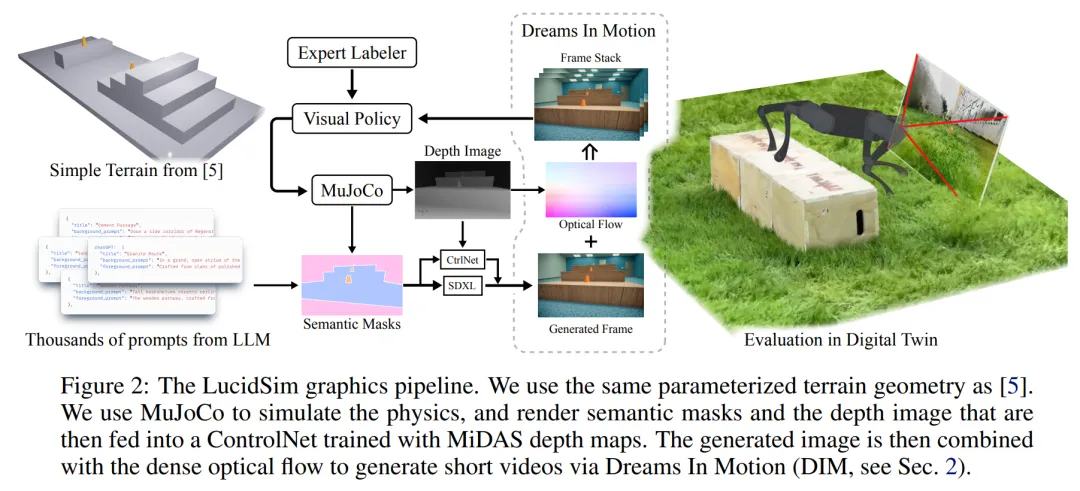

下圖 2 為本文 LucidSim 方法概覽:采用了流行的物理引擎 MuJoCo,并在每一幀上渲染了深度圖像和語義掩碼,這些一起被用作深度條件 ControlNet 的輸入。然后從已知的場景幾何和相機姿態變化中計算真值密集光流,并在接下來的六個時間步中扭曲原始生成幀以生成時間一致的視頻序列。

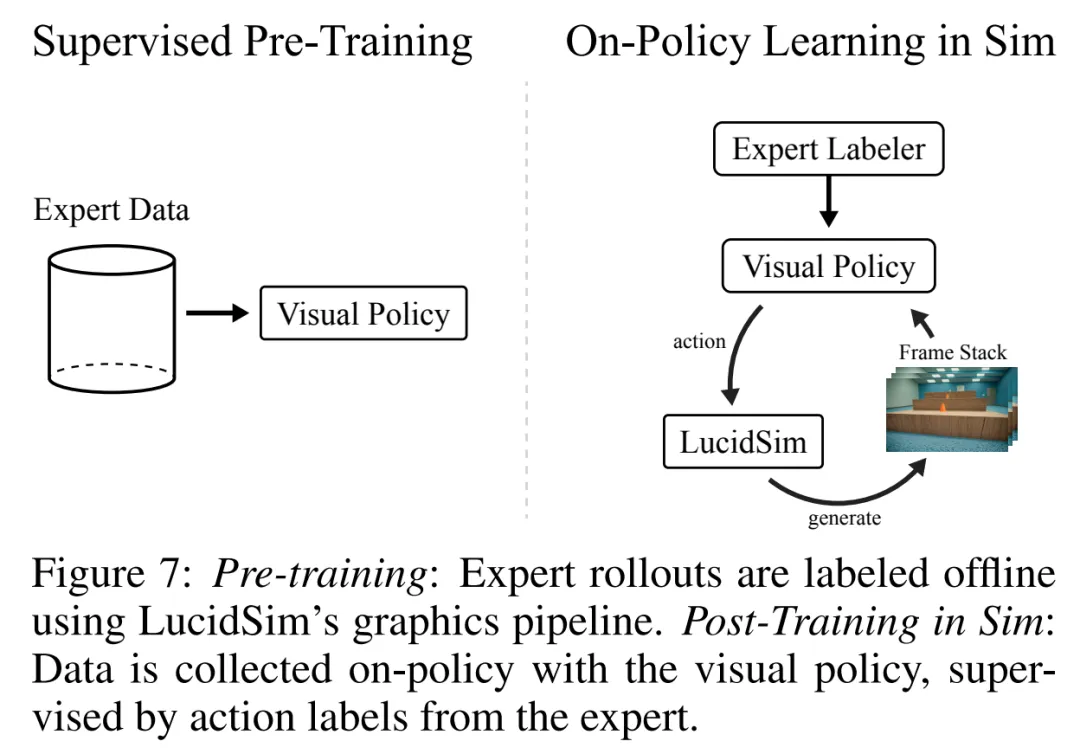

在學習方面,研究者訓練的視覺策略分為兩個階段完成:首先優化策略以模擬從特權教師收集的 rollout 中獲得的專家行為。在經過這一預訓練步驟后,策略表現不佳。因此,后訓練步驟包括從視覺策略本身收集 on-policy 數據,并與當前收集的所有數據的學習交錯進行。重復這一步驟三次使得該視覺策略顯著提升了自身性能。

研究者表示,該策略足夠穩健,在他們的測試場景中可以將零樣本轉換為真實世界的色彩觀察。

下面我們來看一段視頻展示:

LucidSim:利用物理引導生成多樣化視覺數據

研究者考慮了這樣一種 sim-to-real 設置,機器人在模擬環境中接受訓練,并無需進一步調整就能遷移到現實世界。他們對自己打算部署機器人的環境已經有部分了解,可能是粗略的描述或者參考圖像。

由于信息不完整,研究者依賴生成模型內部的先驗知識來填補空白。他們將這一引導過程稱為先驗輔助域生成(Prior -Assisted Domain Generation,PADG),并首先采用對合成不同域至關重要的自動提示技術。

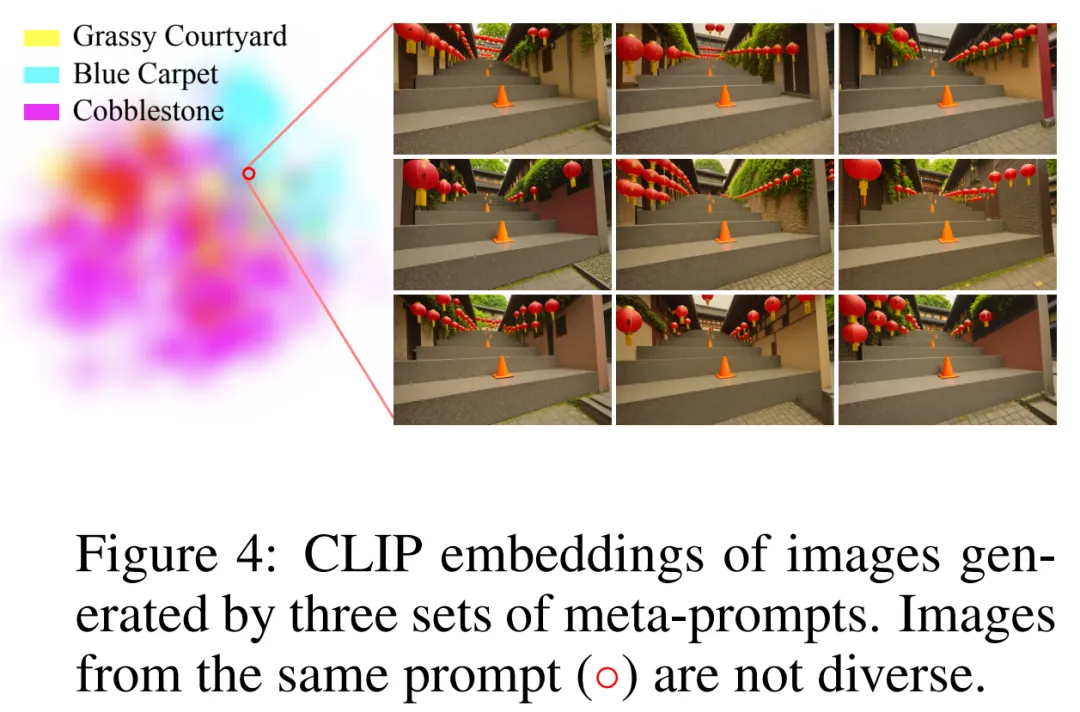

LLM 成為多樣化、結構化的提示來源。研究者很早就觀察到,從同一提示中重復采樣往往會重現類似的圖像。因此,為了獲得多樣化的圖像,他們首先使用了包含標題塊、查詢詳情的「元」提示,以提示 ChatGPT 生成批量結構化的圖像塊,最后以一個要求 JSON 結構化輸出的問題結束。具體如下圖 4 所示。

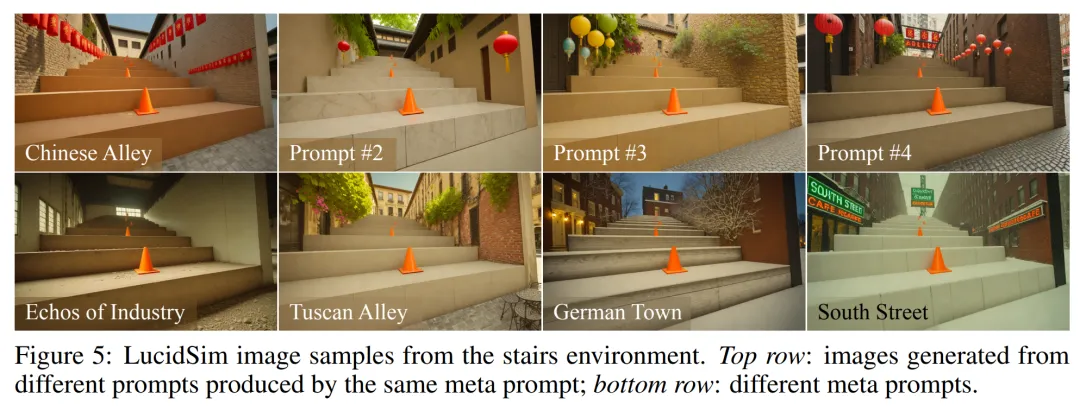

研究者的要求包括特定天氣、一天中的時間、光照條件和文化遺址。手動編輯生成的圖像提示是不切實際的,因而他們通過生成少量圖像來調整元提示,并進行迭代直到它們始終可以生成合理的圖像。下圖 5 下面一行顯示了相同元提示、不同圖像提示的多樣化樣本示例。

在幾何和物理引導下生成圖像。研究者增強了一個原始文本到圖像模型,在增加額外語義和幾何控制的同時,使它與模擬物理保持一致。他們首先將圖像的文本提示替換為提示和語義掩碼對,其中每個對應一種資產類型。比如在爬樓梯場景中,研究者通過文本指定了粗略輪廓內臺階的材質和紋理。

為了使圖像在幾何上保持一致,研究者采用了現成的 ControlNet,該模型使用來自 MiDAS 的單目深度估計進行訓練。條件深度圖像則通過反轉 z 緩沖區并在每一張圖像內進行歸一化處理來計算。此外,調整控制強度以避免丟失圖像細節非常重要。他們采用的場景幾何是以往工作中出現的簡單地形,包括可選的側墻。同時避免隨機化幾何地形以專注視覺多樣性分析。

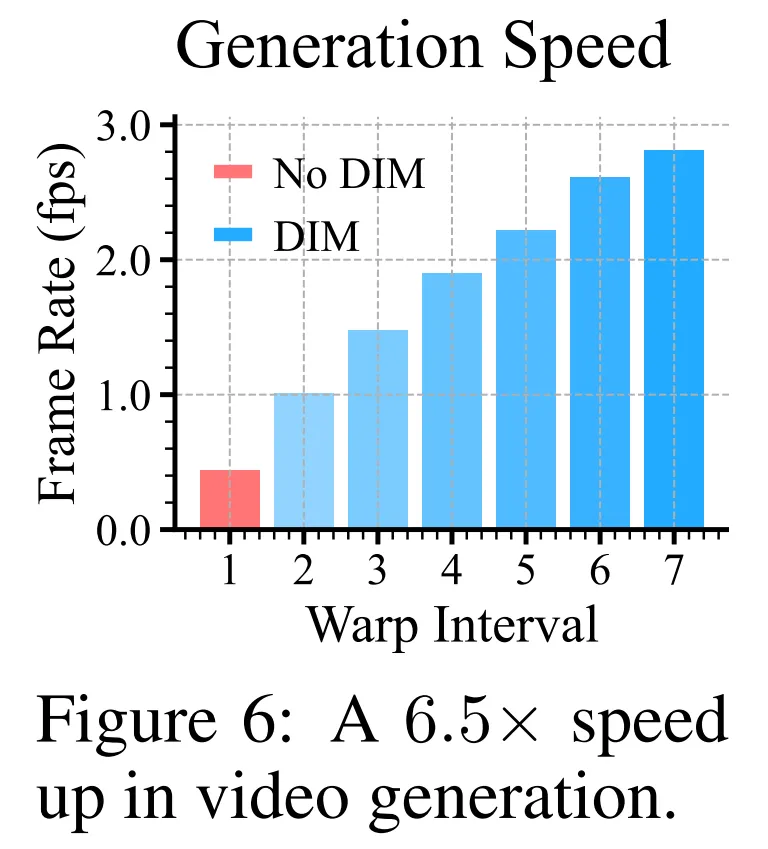

為了制作短視頻,研究者開發了 Dreams In Motion(DIM)技術,它根據場景幾何計算出的真值光流以及兩幀之間機器人相機視角的變化,將生成圖像扭曲成后續幀。生成的圖像堆棧包含對跑酷至關重要的計時信息。生成速度也很重要,DIM 顯著提高了渲染速度,這得益于計算流和應用扭曲要比生成圖像快得多。具體如下圖 6 所示。

通過 on-policy 閉環訓練來學習穩健的真實世界視覺策略

訓練過程分為兩個階段:一是預訓練階段,通過模擬有權直接訪問高度圖的特權專家來引導視覺策略,其中高度圖通過 RL 進行訓練。研究者從專家及其不完美的早期檢查點收集 rollout,并向專家查詢動作標簽以監督視覺策略。該視覺策略在預訓練后表現不佳,但在第二階段即后訓練階段做出了足夠合理的決策來收集 on-policy 數據。具體如下圖 7 所示。

研究者遵循 DAgger,將 on-policy rollout 與上一步中的教師 rollout 相結合。他們從專家教師那里收集了動作標簽,并用余弦學習率計劃下使用 Adam 優化器運行 70 個梯度下降 epoch。研究者在實驗中僅需重復迭代 DAgger 三次就可以實現接近專家表現程度的視覺控制器。實際上第二階段中的閉環訓練過程是機器人出色表現的主要原因。

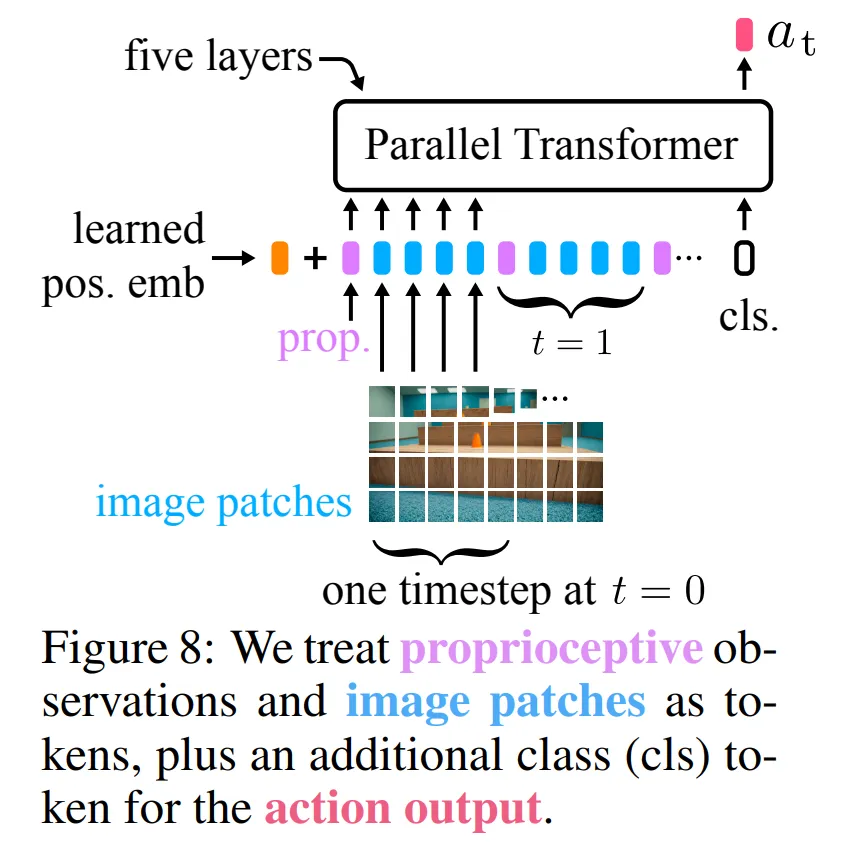

一個簡單的 transformer 控制模型架構。研究者提出了一個簡單的 transformer 架構,與之前 extreme parkour, 使用 transformer 大大減少了處理多模態輸入時控制模型架構的復雜度,如下圖 8 所示。以往四足跑酷的相關工作使用復合架構,首先使用 ConvNet 將深度圖處理成緊湊的潛在向量,然后使用循環骨干網絡。

研究者使用了帶有多查詢注意力的五層 transformer 骨干網絡,輸入的相機視頻被切成小塊,并由一個卷積層并行處理。然后,他們將這些 token 與同一時間步的本體感受觀察的線性嵌入堆疊在一起。研究者對所有時間步重復此操作,并在 token 級添加了可學習的嵌入。他們發現,對于 RGB 圖像,在卷積之前包含批歸一化層也有幫助。

最后,研究者通過堆疊在輸入序列末尾的額外類 token 來計算動作輸出,然后是 ReLU 潛在層和線性映射。

實驗結果

在實驗環節,研究者考慮了以下任務:

- 追蹤足球(chase-soccer);

- 追蹤橙色交通錐(chase-cone);

- 攀爬各種材質的樓梯(stairs)。

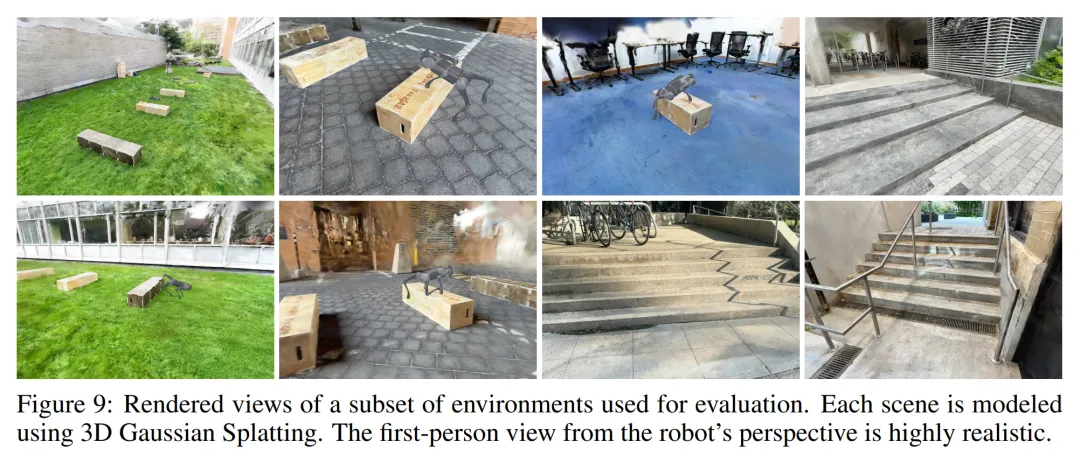

他們分別在現實世界和一小部分使用 3D 高斯潑濺來模擬創建的真實世界場景中評估學習到的控制器性能。這些基準環境的示例如下圖 9 所示。

此外,研究者進行了以下基線比較:

- 需要特權地形數據(障礙)的專家策略;

- 使用相同 pipeline 訓練的深度學生策略;

- 使用紋理上經典域隨機化訓練的 RGB 學生策略;

- 以及本文基于 DIM 生成的幀堆棧進行訓練的 LucidSim。

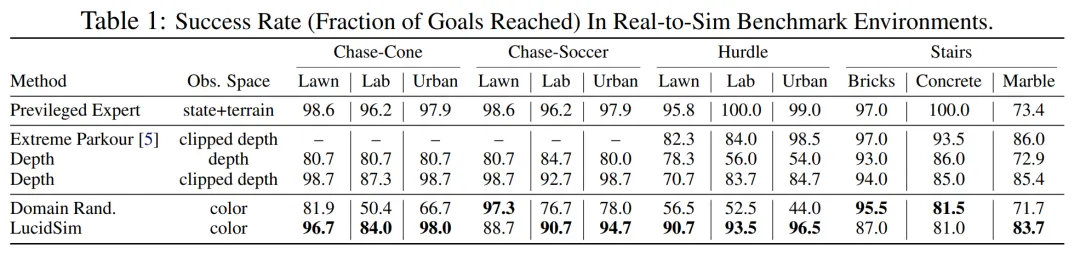

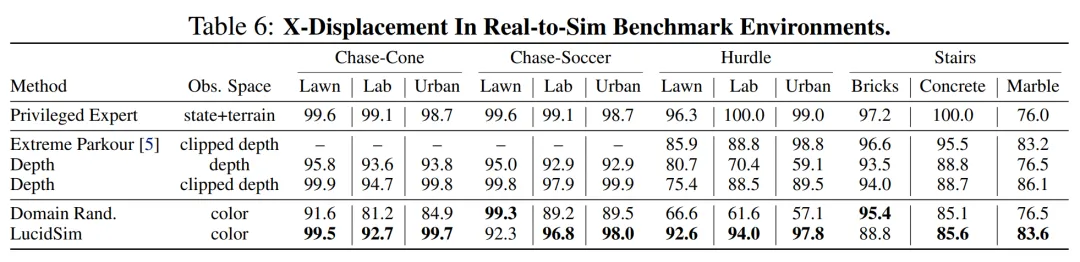

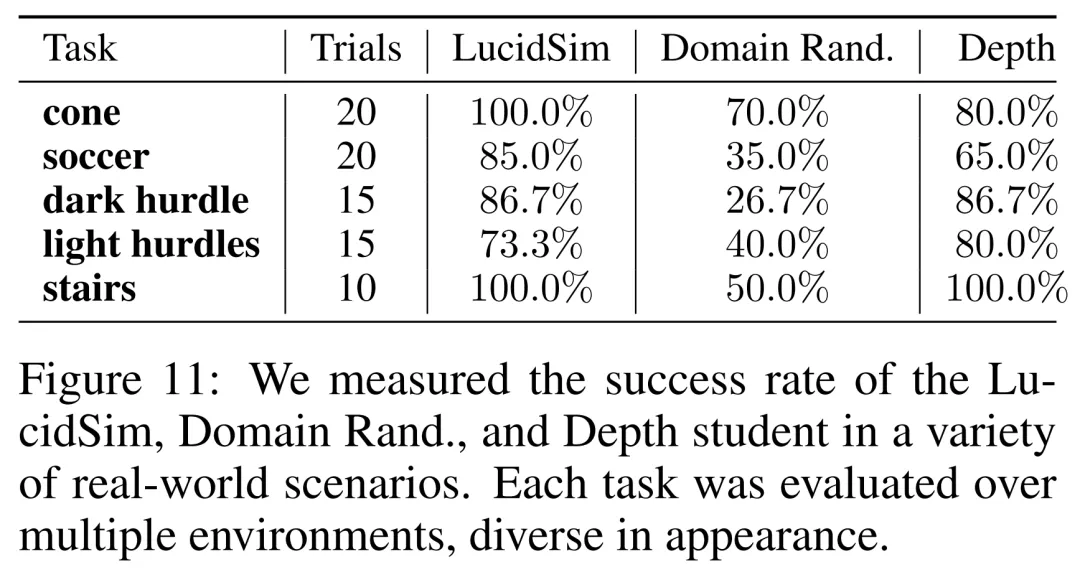

從生成圖像中學習要優于域隨機化

在模擬評估中,研究者觀察到 LucidSim 在幾乎所有評估中都優于經典域隨機化方法,如下表 1 和表 6 所示。其中,域隨機化基線方法能夠在模擬中非常高效地爬樓梯,但在跨越障礙任務中表現不佳。這是因為深度學生網絡在 3D 場景中遭遇了微妙且常見的 sim-to-real 差距。

比如由于受到欄桿的影響,Oracle 策略在其中一個爬樓梯場景(Marble)中表現不佳,因為它在訓練環境中從未見過欄桿。相反,LucidSim 受到的影響較小。

從零樣本遷移到現實世界

研究者在配備廉價 RGB 網絡攝像頭的 Unitree Go1 上部署了 LucidSim,在 Jetson AGX Orin 上運行了推理。每個任務都在多種場景中進行評估,并記錄了機器人是否追到了目標物(追逐)或成功跨越障礙物。

下圖 11 展示了 LucidSim 與域隨機化方法的比較結果,其中 LucidSim 不僅能夠識別經典的黑白足球,而且由于之前看到了具有豐富多樣性的生成數據,因而可以泛化到不同顏色的足球。

對于跨越障礙(hurdle)和爬樓梯(stair)場景,Domain Rand. 無法始終如一地識別前方障礙物,并經常出現正面碰撞,而 LucidSim 能夠始終如一地預測前方的障礙物并成功跨越。

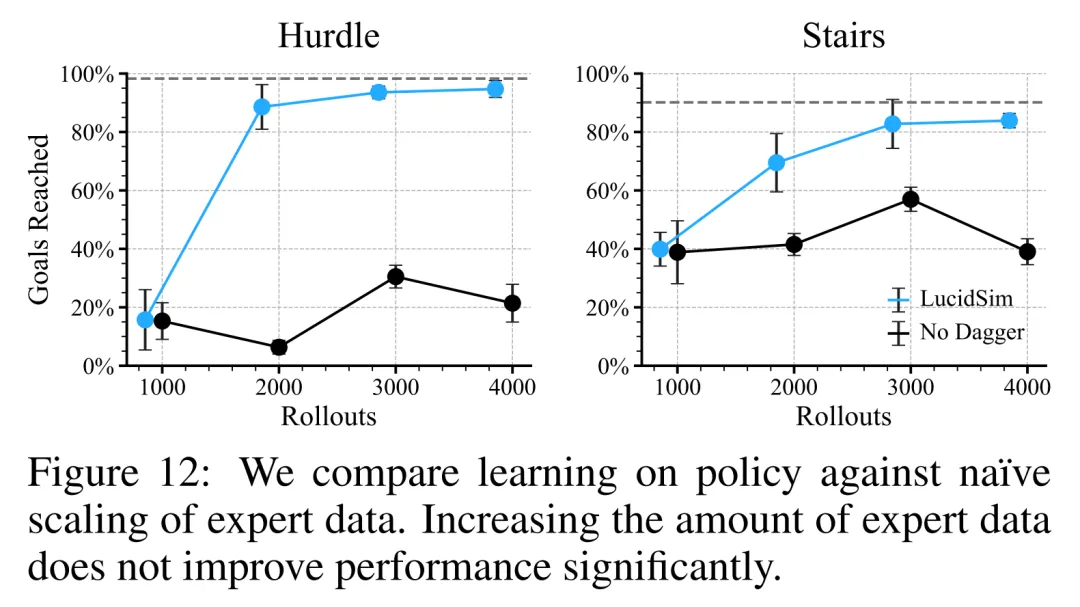

學習 on-policy 要優于原始的專家數據 Scaling

研究者在下圖 12 中,將基于 on-policy 的學習與原始的專家數據收集方法進行了比較。結果顯示,通過額外專家專用數據訓練獲得的性能增益很快達到飽和。在跨越障礙和爬樓梯場景中,通過 DAgger 進行 on-policy 學習對于制定足夠穩健的策略很有必要。

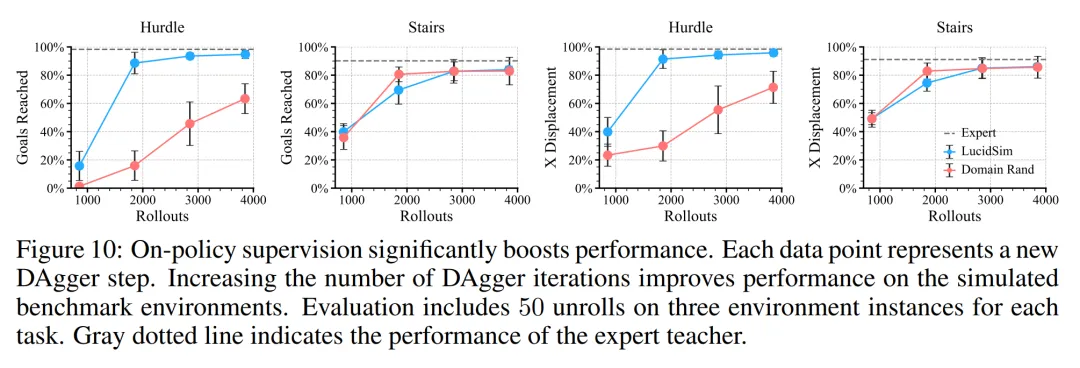

下圖 10 展示了 LucidSim 和域隨機化基線方法下 DAgger 產生的益處,其中前者的整體性能更高。

僅深度的策略過擬合訓練幾何

除了極限跑酷,研究者還考慮了兩種深度策略,它們都接受了與 LucidSim 相同的訓練,但輸入深度不同。第一種(如上表 1 和表 6 第三行)接收遠距剪切至五米的深度,并實現 120° FoV(視場角)。第二種(上表 1 和表 6 第四行)接收剪切至兩米的深度。

在模擬評估中,研究者觀察到,使用未剪切深度的策略會過擬合訓練場景中的最小和簡單幾何,并被評估場景背景中的干擾因素所干擾。而視覺有限的深度策略不太會受到測試場景中多樣性的影響,并且性能可以顯著地提高。

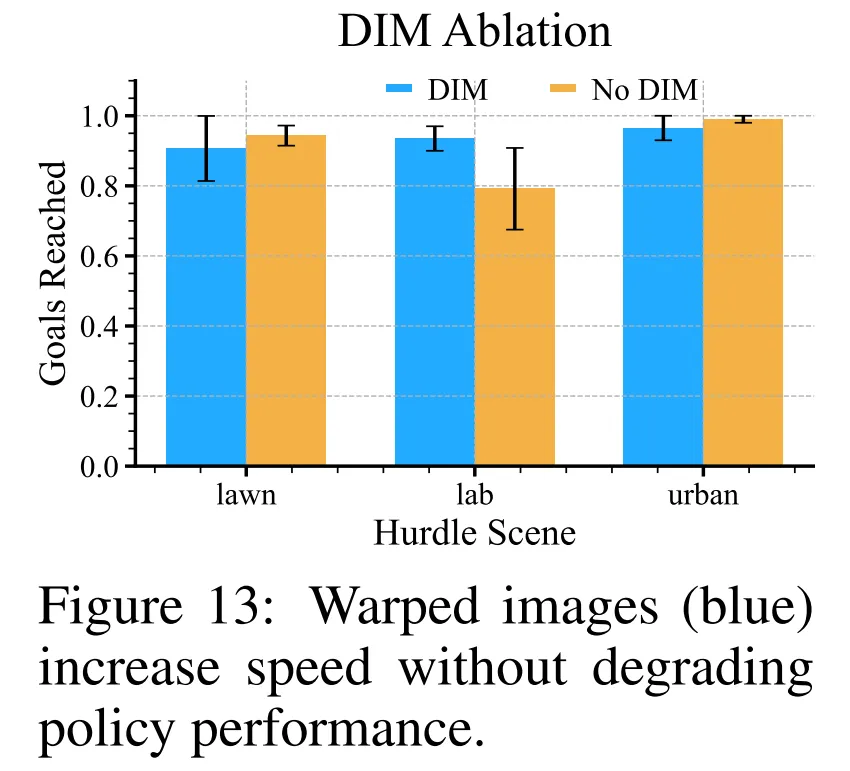

理解 DIM 的速度和性能

圖像生成是本文 pipeline 中的瓶頸。DIM 大大加速了每個策略的展開,同時通過權衡多樣性提供動態一致的幀堆棧。研究者探究了獨立生成每一幀如何影響學生網絡的性能,他們認為跨越障礙場景最具挑戰性。如下圖 13 所示,在性能類似的情況下,DIM 可以在短時間內實現相同結果。

強大的條件降低多樣性和圖像細節

研究者需要權衡幾何準確率與生成圖像細節豐富度。當條件強度過低時,圖像會偏離場景幾何(如下圖 14 左側)。當條件強度過高時,圖像會失去多樣性和豐富細節(圖 14 右側),并且由于過約束而變得失真嚴重。