行人、車輛、動(dòng)物等ReID最新綜述!武大等全面總結(jié)Transformer方法

目標(biāo)重識(shí)別(Object Re-identification,簡(jiǎn)稱Re-ID)旨在跨不同時(shí)間和場(chǎng)景識(shí)別特定對(duì)象。

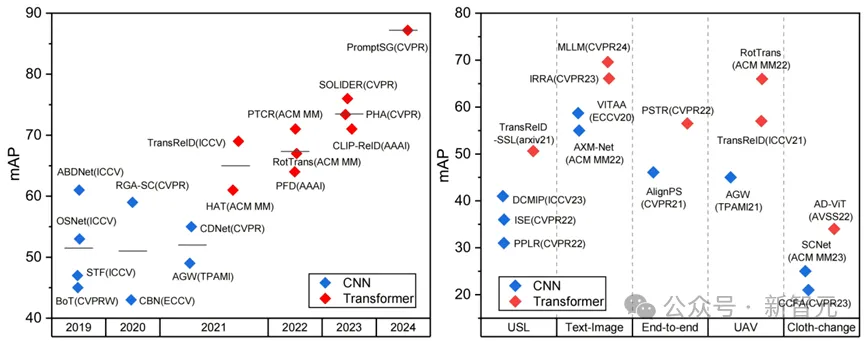

近年來(lái),基于Transformer的Re-ID改變了該領(lǐng)域長(zhǎng)期由卷積神經(jīng)網(wǎng)絡(luò)(CNN)主導(dǎo)的格局,不斷刷新性能記錄,取得重大突破。

與以往基于CNN與有限目標(biāo)類型的Re-ID綜述不同,來(lái)自武漢大學(xué)、中山大學(xué)以及印第安納大學(xué)的研究人員全面回顧了近年來(lái)關(guān)于Transformer在Re-ID中日益增長(zhǎng)的應(yīng)用研究,深入分析Transformer的優(yōu)勢(shì)所在,總結(jié)了Transformer在四個(gè)廣泛研究的Re-ID方向上的應(yīng)用,同時(shí)將動(dòng)物加入Re-ID目標(biāo)類型,揭示Transformer架構(gòu)在動(dòng)物Re-ID應(yīng)用的巨大潛力。

圖片

圖片

論文地址:http://arxiv.org/abs/2401.06960

項(xiàng)目地址:https://github.com/mangye16/ReID-Survey

Transformer架構(gòu)方法打破CNN架構(gòu)性能記錄

Transformer架構(gòu)方法打破CNN架構(gòu)性能記錄

研究背景

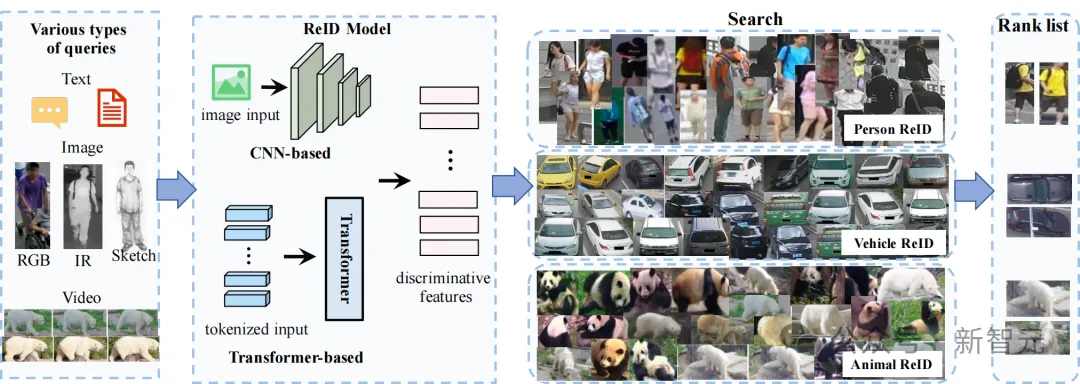

Transformer以優(yōu)異性能滿足各種Re-ID任務(wù)的需求,提供一種強(qiáng)大、靈活且統(tǒng)一的解決方案。

研究人員將現(xiàn)有工作分類為基于圖像/視頻的Re-ID、數(shù)據(jù)/標(biāo)注受限的Re-ID、跨模態(tài)Re-ID及特殊Re-ID場(chǎng)景,詳細(xì)闡述Transformer在應(yīng)對(duì)這些領(lǐng)域中各種挑戰(zhàn)時(shí)所展現(xiàn)的優(yōu)勢(shì)。

考慮到無(wú)監(jiān)督Re-ID的流行趨勢(shì),研究人員提出了新的Transformer基線——UntransReID,在單模態(tài)/跨模態(tài)任務(wù)實(shí)現(xiàn)最先進(jìn)性能。

一般的Re-ID流程

一般的Re-ID流程

針對(duì)尚未被充分探索的動(dòng)物Re-ID領(lǐng)域,研究人員還設(shè)計(jì)了標(biāo)準(zhǔn)化的基準(zhǔn)測(cè)試,進(jìn)行廣泛的實(shí)驗(yàn)以探討Transformer在這一任務(wù)中的適用性,促進(jìn)未來(lái)研究。

最后,討論了一些在大模型時(shí)代中重要但尚未深入研究的開(kāi)放性問(wèn)題。

Transformer在圖片/視頻Re-ID的應(yīng)用

Transformer在backbone層依靠注意力機(jī)制,具有全局、局部和時(shí)空關(guān)系的通用建模能力,有助于在圖像/視頻Re-ID任務(wù)中輕松提取全局、細(xì)粒度和時(shí)空信息。

Transformer在圖像Re-ID的應(yīng)用

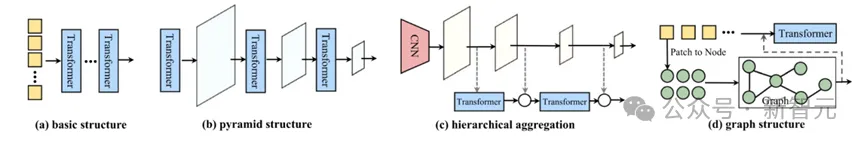

1. 架構(gòu)優(yōu)化:設(shè)計(jì)特殊的Transformer架構(gòu),如金字塔結(jié)構(gòu)、層次聚合等,或改進(jìn)注意力機(jī)制。

2. Re-ID特定設(shè)計(jì):利用視覺(jué)Transformer具備注意力機(jī)制和圖像塊嵌入的特性,捕捉局部區(qū)分性信息。通過(guò)Transformer中的編碼器-解碼器結(jié)構(gòu)實(shí)現(xiàn)某些關(guān)鍵信息的解耦。根據(jù)不同目標(biāo)類型的結(jié)構(gòu)先驗(yàn)和任務(wù)特性進(jìn)行Transformer架構(gòu)設(shè)計(jì)。

圖像Re-ID方法設(shè)計(jì)的不同Transformer架構(gòu)

Transformer在視頻Re-ID的應(yīng)用

1. 應(yīng)用Transformer進(jìn)行后處理:許多應(yīng)用Transformer的視頻Re-ID方法為混合架構(gòu),先利用CNN模型提取特征,再使用Transformer模型進(jìn)一步處理。通過(guò)Transformer的自注意力機(jī)制,捕捉序列中的長(zhǎng)期依賴關(guān)系和上下文信息。

2. 純Transformer架構(gòu):為克服混合架構(gòu)中CNN導(dǎo)致的長(zhǎng)距離信息獲取受限,一些研究嘗試探索純Transformer架構(gòu)在視頻Re-ID中的應(yīng)用。

數(shù)據(jù)/標(biāo)注受限的Re-ID

Transformer為無(wú)監(jiān)督學(xué)習(xí)提供更多可能。Transformer能夠?qū)Ω鼜?qiáng)大、更通用的模型進(jìn)行廣泛自監(jiān)督預(yù)訓(xùn)練,以應(yīng)對(duì)數(shù)據(jù)或標(biāo)注受限的Re-ID任務(wù)。標(biāo)注受限場(chǎng)景通常采取無(wú)監(jiān)督Re-ID,而數(shù)據(jù)受限則主要通過(guò)領(lǐng)域泛化Re-ID解決。

Transformer在無(wú)監(jiān)督Re-ID的應(yīng)用

1. 自監(jiān)督預(yù)訓(xùn)練:一類針對(duì)無(wú)監(jiān)督Re-ID中Transformer應(yīng)用的研究關(guān)注自監(jiān)督預(yù)訓(xùn)練。Transformer模型對(duì)大規(guī)模無(wú)標(biāo)簽數(shù)據(jù)具有強(qiáng)大可擴(kuò)展性,其結(jié)構(gòu)的靈活性提供了更多樣化的自監(jiān)督范式。

2. 無(wú)監(jiān)督領(lǐng)域自適應(yīng):Transformer在無(wú)監(jiān)督領(lǐng)域自適應(yīng)(UDA)問(wèn)題中受到的關(guān)注有限。對(duì)于行人Re-ID,Wang等人借助Transformer實(shí)現(xiàn)不同身體部位之間的細(xì)粒度領(lǐng)域?qū)R。對(duì)于車輛Re-ID,一項(xiàng)工作通過(guò)聯(lián)合訓(xùn)練策略,令Transformer自適應(yīng)地關(guān)注每個(gè)域中車輛的判別部分。

Transformer在跨模態(tài)Re-ID的應(yīng)用

Transformer提供了統(tǒng)一的架構(gòu),有效處理不同模態(tài)的數(shù)據(jù)。多頭注意力機(jī)制可在各種特征空間和全局語(yǔ)境中聚合特征。高度適應(yīng)性的編碼器-解碼器結(jié)構(gòu)可容納不同類型的輸入和輸出。因此Transformer特別適合在跨模態(tài)Re-ID中建立模態(tài)間關(guān)聯(lián),促進(jìn)多模態(tài)信息的融合。

可見(jiàn)光-紅外Re-ID旨在匹配白天的可見(jiàn)光圖像與夜間的紅外圖像。因紅外圖像缺乏顏色與光照條件,視覺(jué)Transformer可更好地捕捉模態(tài)不變特征并具備更強(qiáng)的魯棒性。視覺(jué)Transformer的結(jié)構(gòu)及其注意力機(jī)制可在patch級(jí)別輕松建立局部跨模態(tài)關(guān)聯(lián)。現(xiàn)有可見(jiàn)光-紅外Re-ID方法聚焦于學(xué)習(xí)模態(tài)共享特征,將特征分解為模態(tài)特定特征和共享模態(tài)特征,在特征層面進(jìn)行模態(tài)對(duì)齊。

文本-圖像Re-ID為跨模態(tài)檢索任務(wù),根據(jù)文本描述在圖像庫(kù)中識(shí)別目標(biāo)。作為Transformer架構(gòu)在多模態(tài)應(yīng)用中的里程碑,對(duì)比語(yǔ)言-圖像預(yù)訓(xùn)練(CLIP)等大型多模態(tài)預(yù)訓(xùn)練模型使該領(lǐng)域取得顯著進(jìn)展。近期,CLIP已成為下游文本-圖像Re-ID任務(wù)中的有力工具。

素描-圖像Re-ID與骨架Re-ID均屬于跨模態(tài)匹配任務(wù),前者基于藝術(shù)家或業(yè)余者繪制的素描,后者則基于姿態(tài)估計(jì)生成的骨架圖。Transformer擅長(zhǎng)提取全局特征,在素描-圖像Re-ID中表現(xiàn)突出。對(duì)于骨架Re-ID,可利用Transformer對(duì)骨架點(diǎn)構(gòu)成的圖結(jié)構(gòu)進(jìn)行全關(guān)系建模。

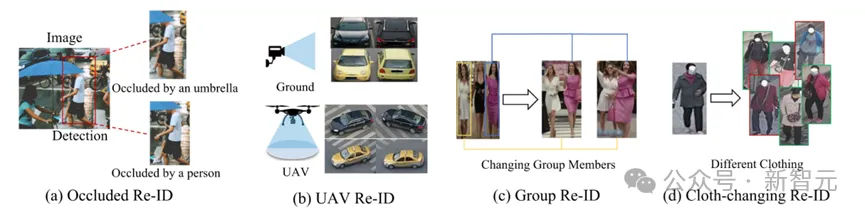

Transformer在特殊Re-ID的應(yīng)用

在實(shí)際應(yīng)用需求的推動(dòng)下,Re-ID領(lǐng)域出現(xiàn)一系列特殊應(yīng)用場(chǎng)景。Transformer被初步應(yīng)用于這些復(fù)雜挑戰(zhàn),體現(xiàn)了卓越的可擴(kuò)展性和適應(yīng)性。

遮擋Re-ID:遮擋Re-ID場(chǎng)景下,圖片中的識(shí)別目標(biāo)被部分遮擋,導(dǎo)致身份信息難以完整提取。近年來(lái)基于Transformer的方法在這一場(chǎng)景取得顯著成效,其核心策略包括提取局部區(qū)域特征。

換衣Re-ID:在長(zhǎng)期Re-ID場(chǎng)景中,行人可能會(huì)以未知方式更換衣物,以服裝外觀為主導(dǎo)的判別性特征表示將失效。Lee等人在換裝Re-ID場(chǎng)景下對(duì)不同的特征提取主干網(wǎng)絡(luò)進(jìn)行評(píng)估,Transformer架構(gòu)相較于CNN表現(xiàn)出顯著性能優(yōu)勢(shì)。

以人為中心的任務(wù):以人為中心的通用模型旨在將包括行人檢測(cè)、姿態(tài)估計(jì)、屬性識(shí)別和人體解析在內(nèi)的多個(gè)人體相關(guān)任務(wù)整合到同一框架中,從而相互促進(jìn),提升如Re-ID這類下游任務(wù)的性能。

行人檢索:行人檢索是一種端到端方法,通過(guò)多任務(wù)學(xué)習(xí)同時(shí)解決行人檢測(cè)與Re-ID這兩個(gè)目標(biāo)沖突的問(wèn)題。將多尺度Transformer架構(gòu)引入行人檢索方案可實(shí)現(xiàn)查詢層面的實(shí)例級(jí)匹配。

群體Re-ID:群體Re-ID利用群體中的上下文信息來(lái)匹配在同一個(gè)群體中的個(gè)體,面臨群體成員變動(dòng)與布局變化等挑戰(zhàn)。傳統(tǒng)方法在位置建模方面存在不足,利用Transformer的位置嵌入機(jī)制可更好地處理群體級(jí)別的布局特性。

無(wú)人機(jī)Re-ID:與固定攝像頭相比,無(wú)人機(jī)在高度與視角上快速變化,導(dǎo)致圖像更為復(fù)雜。在鳥(niǎo)瞰圖像中分析車輛與行人時(shí),顯著的邊界框尺寸差異與物體方向不確定性是關(guān)鍵挑戰(zhàn)。除了純無(wú)人機(jī)視角Re-ID外,還有研究重點(diǎn)關(guān)注空中與地面視角的跨域匹配。

特殊Re-ID場(chǎng)景

特殊Re-ID場(chǎng)景

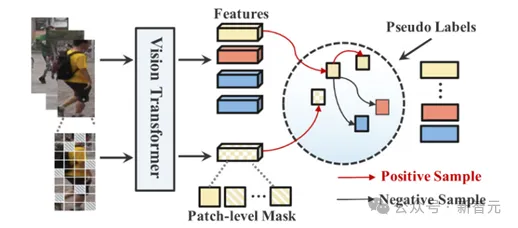

新基線UntransReID

研究人員提出了一個(gè)單模態(tài)/跨模態(tài)的常規(guī)無(wú)監(jiān)督Re-ID基線UntransReID。

圖片

圖片

無(wú)監(jiān)督Re-ID基線UntransReID

單模態(tài)無(wú)監(jiān)督Re-ID:研究人員在無(wú)監(jiān)督訓(xùn)練過(guò)程中設(shè)計(jì)了一種面向patch級(jí)別的mask增強(qiáng)策略。在數(shù)據(jù)增強(qiáng)過(guò)程中采用一系列l(wèi)earnable tokens來(lái)mask部分圖像patch,并在訓(xùn)練過(guò)程中建立原始特征與掩碼特征之間的對(duì)應(yīng)關(guān)系,將此作為監(jiān)督信號(hào)來(lái)引導(dǎo)模型學(xué)習(xí)。

跨模態(tài)無(wú)監(jiān)督Re-ID:針對(duì)可見(jiàn)光-紅外跨模態(tài)行人Re-ID,研究人員設(shè)計(jì)了一種雙流Transformer結(jié)構(gòu),包含兩個(gè)面向特定模態(tài)的patch嵌入層以及一個(gè)模態(tài)共享的Transformer。為進(jìn)一步提升模態(tài)的泛化能力,在可見(jiàn)光通道中引入隨機(jī)通道增強(qiáng)作為額外的輸入,實(shí)現(xiàn)聯(lián)合訓(xùn)練。

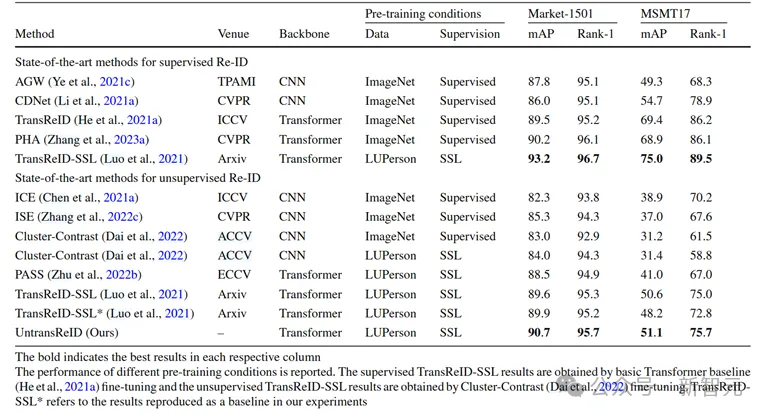

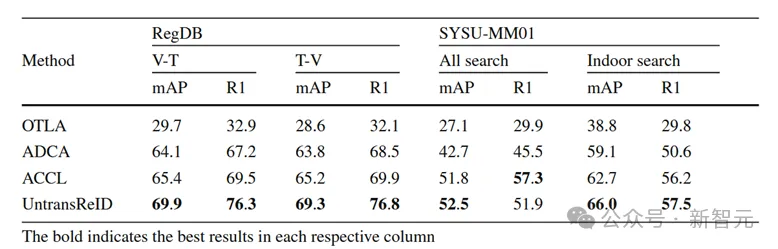

實(shí)驗(yàn)結(jié)果分析:對(duì)于單模態(tài)無(wú)監(jiān)督Re-ID,UntransReID取得了與當(dāng)前最先進(jìn)方法相當(dāng)?shù)男阅堋?缒B(tài)Re-ID現(xiàn)有先進(jìn)方法大多基于CNN且需要復(fù)雜的跨模態(tài)關(guān)聯(lián)設(shè)計(jì),UntransReID在多個(gè)可見(jiàn)光-紅外Re-ID數(shù)據(jù)集上憑借簡(jiǎn)潔的設(shè)計(jì)實(shí)現(xiàn)了最先進(jìn)的性能。

圖片

圖片

表1 基于CNN/Transformer的有監(jiān)督/無(wú)監(jiān)督方法的實(shí)驗(yàn)結(jié)果

表2 可見(jiàn)光-紅外跨模態(tài)基線在RegDB和SYSU-MM01上的實(shí)驗(yàn)結(jié)果

表2 可見(jiàn)光-紅外跨模態(tài)基線在RegDB和SYSU-MM01上的實(shí)驗(yàn)結(jié)果

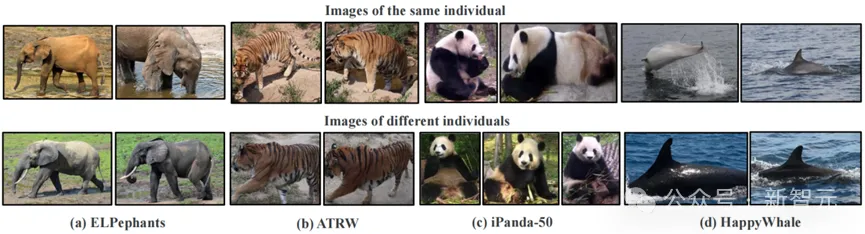

動(dòng)物Re-ID

研究人員特別探討了動(dòng)物Re-ID領(lǐng)域研究現(xiàn)狀,總結(jié)近年來(lái)的動(dòng)物Re-ID數(shù)據(jù)集和基于深度學(xué)習(xí)的動(dòng)物Re-ID方法,為動(dòng)物Re-ID制定統(tǒng)一的實(shí)驗(yàn)標(biāo)準(zhǔn),并評(píng)估在此背景下使用Transformer的可行性,為未來(lái)的研究奠定堅(jiān)實(shí)基礎(chǔ)。

近年來(lái)的動(dòng)物Re-ID數(shù)據(jù)集

近年來(lái)的動(dòng)物Re-ID數(shù)據(jù)集

動(dòng)物Re-ID方法

基于全局圖像的方法:許多現(xiàn)有研究借鑒行人Re-ID的傳統(tǒng)方法,將完整的動(dòng)物圖像輸入深度神經(jīng)網(wǎng)絡(luò)以獲取可靠的特征表示。

基于局部區(qū)域的方法:一些工作在數(shù)據(jù)采集與特征提取階段關(guān)注動(dòng)物的關(guān)鍵部位,例如牛的頭部、大象耳朵、鯨魚(yú)尾巴以及海豚的鰭等。

基于輔助信息的方法:Zhang等人以牦牛頭部左右朝向的簡(jiǎn)化姿態(tài)為輔助監(jiān)督信號(hào),強(qiáng)化特征表示;Li等人借助姿態(tài)關(guān)鍵點(diǎn)估計(jì)將老虎圖像劃分為多個(gè)身體部位進(jìn)行局部特征學(xué)習(xí)。

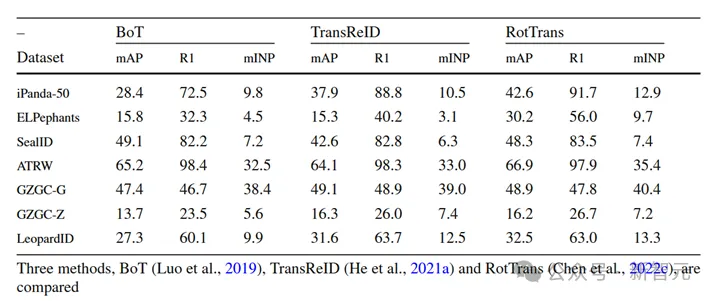

動(dòng)物Re-ID的統(tǒng)一基準(zhǔn)測(cè)試

研究人員使用多種先進(jìn)的通用Re-ID方法進(jìn)行了廣泛動(dòng)物Re-ID實(shí)驗(yàn)。實(shí)驗(yàn)評(píng)估了基于CNN架構(gòu)的BoT方法和基于Transformer架構(gòu)的TransReID、RotTrans方法。基于Transformer架構(gòu)的方法在多數(shù)情形下表現(xiàn)更優(yōu),本實(shí)驗(yàn)證明了Transformer在動(dòng)物Re-ID應(yīng)用的可行性與巨大潛力。

最先進(jìn)的Re-ID方法在多個(gè)動(dòng)物數(shù)據(jù)集上的評(píng)估結(jié)果

最先進(jìn)的Re-ID方法在多個(gè)動(dòng)物數(shù)據(jù)集上的評(píng)估結(jié)果

未來(lái)展望

Re-ID與大語(yǔ)言模型的結(jié)合

將大語(yǔ)言模型(LLM)與Re-ID任務(wù)深度融合正成為熱門研究方向。通過(guò)生成或理解視覺(jué)數(shù)據(jù)的文本描述,LLM可在細(xì)粒度語(yǔ)義提取、無(wú)標(biāo)記數(shù)據(jù)的利用以及模型泛化能力提升等方面為Re-ID提供有力支持。

通用Re-ID大模型構(gòu)建

滿足多模態(tài)、多目標(biāo)的實(shí)際應(yīng)用場(chǎng)景是Re-ID未來(lái)的重要訴求。Transformer在多模態(tài)數(shù)據(jù)融合和大模型訓(xùn)練中表現(xiàn)出突出能力,可用于同時(shí)處理視覺(jué)、文本乃至更多元的信息,從而建立模態(tài)無(wú)關(guān)、任務(wù)統(tǒng)一的通用Re-ID模型。

面向高效部署的Transformer優(yōu)化

視頻監(jiān)控、智能安防等場(chǎng)景要求實(shí)時(shí)性與輕量級(jí)部署,在保持Transformer魯棒性的同時(shí)需要減少計(jì)算開(kāi)銷。有效遷移通用預(yù)訓(xùn)練模型的知識(shí)到特定Re-ID任務(wù),應(yīng)對(duì)大規(guī)模動(dòng)態(tài)更新中的災(zāi)難性遺忘問(wèn)題,這些也是未來(lái)亟待解決的課題。