通義萬相視頻生成重磅升級,成功登頂VBench,運鏡、質感直達專業級

2025 才剛開始,AI 視頻生成就要迎來技術突破了?

今天上午,阿里旗下通義萬相視頻生成模型宣布了 2.1 版重磅升級。

新發布的模型有兩個版本,分別是通義萬相 2.1 極速版和專業版,前者注重高效性能,后者瞄準卓越表現力。

據介紹,通義萬相此次全面升級了模型整體性能,尤其是在處理復雜運動、還原真實物理規律、提升電影質感及優化指令遵循方面取得了顯著進展,為 AI 的藝術創作打開了新的大門。

我們先來一睹視頻生成效果,看看能不能驚艷到你。

先以經典的「切牛排」為例,可以看到,牛排的紋理清晰可見,表面覆蓋著一層薄薄的油脂,閃爍著光澤,刀鋒沿著肌肉纖維緩緩切入,肉質 Q 彈,細節拉滿。

Prompt: 在餐廳里,一個人正在切一塊熱氣騰騰的牛排。在特寫俯拍下,這個人右手拿著一把鋒利的刀,將刀放在牛排上,然后沿著牛排中心切開。這個人穿著黑色衣服,手上涂著白色指甲油,背景是虛化的,有一個白色的盤子,里面放著黃色的食物,還有一張棕色的桌子。

再來看一個人物特寫生成效果,小女孩的面部表情、手部和肢體動作都很自然協調,風掠過頭發也符合運動規律。

Prompt:可愛少女站在花叢中,雙手比心,周圍跳動著各種小愛心。她穿著粉色連衣裙,長發隨風輕揚,笑容甜美。背景是春日花園,鮮花盛開,陽光明媚。高清寫實攝影,近景特寫,自然光線柔和。

模型強不強,再來跑個分。目前,在權威視頻生成評測榜單 VBench Leaderboard 上,升級后的通義萬相以總分 84.7% 的成績登上榜首位置,超越了 Gen3、Pika、CausVid 等國內外視頻生成模型。看起來,視頻生成的競爭格局又迎來了一波新變化。

榜單鏈接:https://huggingface.co/spaces/Vchitect/VBench_Leaderboard

即日起,用戶就可以在通義萬相官網用上最新一代模型了。同樣地,開發者也可以在阿里云百煉調用大模型 API。

官網地址:https://tongyi.aliyun.com/wanxiang/

一手實測,表現力提升,還能玩轉特效字體

最近一段時間,視頻生成大模型的迭代速度很快,新版本的通義萬相有沒有實現代差級別的提升?我們進行了一番實際測試。

AI 視頻會寫字了

首先,AI 生成的視頻終于能告別「鬼畫符」了。

此前,市面上主流 AI 視頻生成模型一直無法準確地生成中英文,只要是該有文字的地方,就是一堆難以辨認的亂碼。如今這一行業難題被通義萬相 2.1 破解了。

它成為了首個具備支持中文文字生成能力、且同時支持中英文文字特效生成的視頻生成模型。

現在,用戶只需輸入簡短的文字描述,即可生成具有電影級效果的文字和動畫。

比如一只小貓正在電腦前打字,畫面依次跳出「不工作就沒飯吃」7 個大字。

通義萬相生成的視頻中,貓咪坐在工位上一本正經地敲鍵盤、按鼠標,模樣像極了當代打工人,彈出的字幕再加上自動生成的配樂,讓整個畫面都更具詼諧感。

再比如從一個橘色的正方體小盒子里跳出英文單詞「Synced」。

無論是生成中文還是英文,通義萬相都能搞定,沒有錯別字,也沒出現「鬼畫符」。

不僅如此,它還支持多種場景下的字體應用,包括特效字體、海報字體以及真實場景中的字體展示等。

比如在塞納河畔的埃菲爾鐵塔附近,絢爛的煙花在空中綻放,隨著鏡頭拉近,粉色數字「2025」逐漸變大,直到充斥整個畫面。

大幅度運動不再「鬼畜」

復雜的人物運動一度是 AI 視頻生成模型的「噩夢」,以往 AI 生成的視頻要么手腳亂飛、大變活人,要么出現「只轉身不轉頭」的詭異動作。

而通義萬相通過先進的算法優化和數據訓練,能夠在多種場景下實現穩定的復雜運動生成,特別是在大幅度肢體運動和精確的肢體旋轉方面,上圖生成的霹靂舞就很絲滑。

再比如下面這則生成視頻中,男子奔跑時動作流暢自然,沒有出現左右腿不分或者扭曲變形的問題。而且它還很注重細節,男子每一次腳尖觸地都會留下印跡,并微微揚起細沙。

Prompt:日落時分,金色的陽光灑在波光粼粼的海面上,一名年輕帥氣的男子沿著沙灘奔跑,穩定跟蹤鏡頭。

難度較大的滑雪視頻它也能生成。

女孩身著滑雪裝備,在阿爾卑斯山的雪坡上滑行。她靈活地控制著滑雪板,時而加速,時而轉彎,高速運動下甩起的馬尾辮、卷起的積雪讓鏡頭更加逼真。

Prompt:一個年輕女孩在阿爾卑斯山滑雪

由此可見,它在物理規律理解方面也有著顯著提升,能夠模擬出真實感十足的視頻,避免出現「一眼假」的情況。

運鏡媲美電影大師

大導演斯皮爾伯格曾說過:一場好電影的秘訣就在于鏡頭語言。為了拍出震撼的電影鏡頭,攝影師們恨不得上天入地、飛檐走壁。

不過在這個 AI 時代,「拍」電影就容易了許多。

我們只需輸入一句簡單的文本指令,比如鏡頭左移、鏡頭拉遠、鏡頭推進等,通義萬相就能自動根據視頻的主體內容和運鏡需求輸出合理的視頻。

我們輸入 Prompt:搖滾樂隊在前院草坪上演出,隨著鏡頭的推進,畫面聚焦到吉他手身上,他身穿皮夾克,一頭凌亂的長發隨節奏擺動。吉他手的手指在琴弦上快速跳躍,背景中其他樂隊成員也在全情投入。

通義萬相 2.1 嚴格遵循了指令。視頻一開始,吉他手、鼓手激情演奏,隨著攝影機緩慢拉近,背景逐漸模糊,畫面放大,突出了吉他手的神態和手部動作。

再來一個拉遠鏡頭的視頻。

一個年輕偵探的眼睛特寫,鏡頭拉遠,男子正站在一條繁華的街上,身后是摩天大樓和靜止的汽車,仿佛時間被定格一般。

長文本指令不會丟三落四

要想 AI 生成的視頻效果達到驚艷水準,必然離不開精準的文本提示。

然而,有時大模型「記性」有限,面對包含各種場景切換、角色互動和復雜動作的文本指令,它就容易丟三落四,不是遺漏細節,就是搞不清邏輯順序。

上新后的通義萬相在長文本指令遵循方面就有了較大的進步。

Prompt: 一位摩托車騎手在狹窄的城市街道上以極快的速度疾馳,避開了附近建筑物發生的大爆炸,火焰猛烈地咆哮著,投射出明亮的橙色光芒,碎片和金屬碎片在空中飛舞,加劇了現場的混亂。身著深色裝備的車手,彎腰緊握車把,神情專注,他以極快的速度向前沖去,絲毫不畏懼身后的火光沖天。爆炸留下的濃濃黑煙彌漫在空中,將背景籠罩在世界末日般的混亂之中。然而,騎手依然不屈不撓,準確無誤地在混亂中穿梭,極富電影感,超精細細節,身臨其境,3D,動作連貫。

在以上這段長篇大論般的文本描述中,狹窄的街道、明亮的火焰、彌漫的黑煙、亂飛的碎片以及身著深色裝備的騎手…… 這些細節都被通義萬相捕捉到。

通義萬相還具備更強大的概念組合能力,能夠準確理解各種不同的想法、元素或者風格,并將其組合在一起,創造出全新的視頻內容。

一位穿著西裝的老人從雞蛋中破殼而出,瞪大雙眼緊盯鏡頭的白發老頭,再配上公雞咯咯叫的聲音,畫面相當搞笑。

擅長卡通油畫等多種風格

新版通義萬相還能生成電影質感的視頻畫面,同時對各類藝術風格也有很好的支持,比如卡通、電影色、3D 風格、油畫、古典等風格。

造型奇特的外星船銹跡斑駁,背著氧氣瓶的宇航員擺動雙腿在水下沉潛,整個鏡頭都很有科幻電影的 feel。

Prompt:電影質感,一名宇航員正在探索一艘水下外星船殘骸。

再來看這個 3D 動畫風格的小怪獸,站在葡萄藤上手舞足蹈,甚是可愛。

Prompt:一只毛茸茸的快樂的青提小怪獸站在葡萄樹樹枝上快樂的歌唱,逆時針旋轉鏡頭。

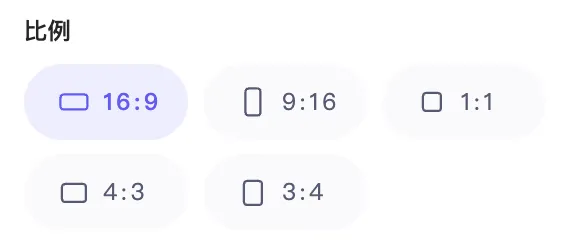

此外,它還支持不同長寬比,涵蓋 1:1、3:4、4:3、16:9 和 9:16 五個比例,能夠更好適配電視、電腦、手機等不同終端設備。

從以上表現來看,我們已經可以使用通義萬相進行一些創作,把靈感轉化為「現實」了。

當然這一系列進步,還得歸功于阿里云在視頻生成基礎模型上的升級。

基礎模型大幅優化,架構、訓練、評估全方位「變身」

去年 9 月 19 日,阿里云在云棲大會上發布了通義萬相視頻生成大模型,帶來了影視級高清視頻的生成能力。作為阿里云全自研的視覺生成大模型,它采用了 Diffusion + Transformer 的架構,支持圖像和視頻生成類任務,在模型框架、訓練數據、標注方式和產品設計上均有諸多創新,提供了業界領先的視覺生成能力。

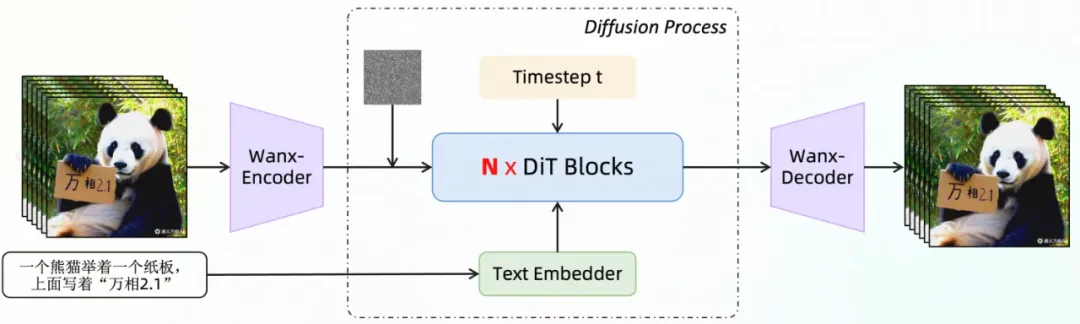

此次升級后的模型中,通義萬相團隊(以下簡稱團隊)進一步自研了高效的 VAE 和 DiT 架構,針對時空上下文關系的建模進行了增強,顯著優化了生成效果。

Flow Matching(流匹配)是近年來新興的一種生成模型訓練框架,其訓練過程更簡單,通過連續正則化流(Continuous Normalizing Flow)可以取得與擴散模型相當甚至更優的生成質量,并且推理速度更快,也因而逐漸開始應用于視頻生成領域,比如 Meta 此前推出的視頻模型 Movie Gen 便使用了 Flow Matching。

在訓練方法選擇上,通義萬相 2.1 采用了基于線性噪聲軌跡的 Flow Matching 方案,并針對該框架進行了深度設計,使得模型收斂性、生成質量和效率均得到提升。

通義萬相 2.1 視頻生成架構圖

針對視頻 VAE,團隊結合緩存機制與因果卷積,設計了一種創新的視頻編解碼方案。其中緩存機制可以在視頻處理中保持必要的信息,從而減少重復計算,并提升計算效率;因果卷積能夠捕獲視頻的時序特征,適應視頻內容的遞進變化。

在具體實現中,通過將視頻拆分為若干塊(Chunk)并緩存中間特征,代替了直接對長視頻的 E2E 解碼過程,使顯卡的使用僅與 Chunk 大小相關,而無需考慮原始視頻長度,讓模型可以對無限長的 1080P 視頻進行高效編解碼。團隊表示,這一關鍵技術為任意時長視頻的訓練提供了一種可行路徑。

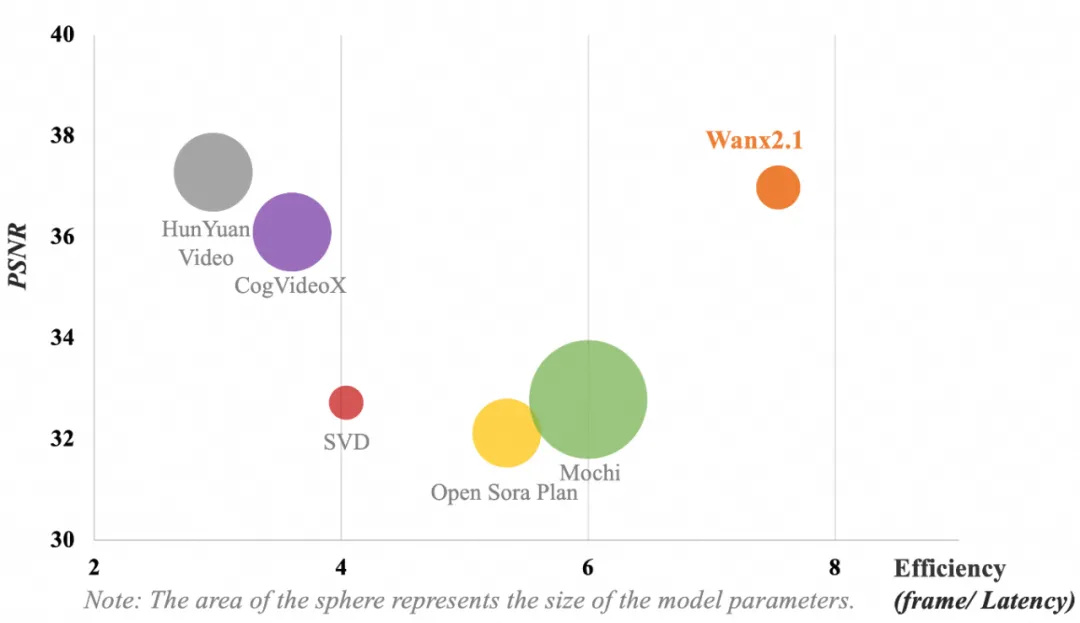

下圖顯示了不同 VAE 模型的結果對比。從模型計算效率(幀 / 延遲)和視頻壓縮重構(峰值信噪比,PSNR)指標來看,通義萬相采用的 VAE 在參數不占優的情況下,依然實現了業內領先的視頻壓縮重構質量。

注:圓圈面積代表了模型參數大小。

團隊在 DiT(Diffusion Transformer)上的核心設計目標是實現強大的時空建模能力,同時保持高效的訓練過程。做到這些需要進行一些創新性改變。

首先,為了提高時空關系的建模能力,團隊采用了時空全注意力機制,使模型能夠更準確地模擬現實世界的復雜動態。其次,參數共享機制的引入,在提升性能的同時有效降低了訓練成本。此外,團隊針對文本嵌入做了性能優化,使用交叉注意力機制來嵌入文本特征,既達成了更優的文本可控性,也降低了計算需求。

得益于這些改進和嘗試,在相同計算成本的情況下,通義萬相的 DiT 結構實現了更明顯的收斂優越性。

除了模型架構上的創新,團隊在超長序列訓練與推理、數據構建管線與模型評估方面同樣進行了一些優化,使模型可以高效處理復雜生成任務,并具備更強的效率優勢。

百萬超長序列的高效訓練如何煉成

在處理超長視覺序列時,大模型往往面臨著計算、內存、訓練穩定性、推理延遲等多個層面的挑戰,因而要有高效的應對方案。

為此,團隊結合了全新模型工作負載的特點和訓練集群的硬件性能,制定出了分布式、顯存優化的訓練策略,在保證模型迭代時間的前提下優化訓練性能,最終達到了業界領先的 MFU,并實現了 100 萬超長序列的高效訓練。

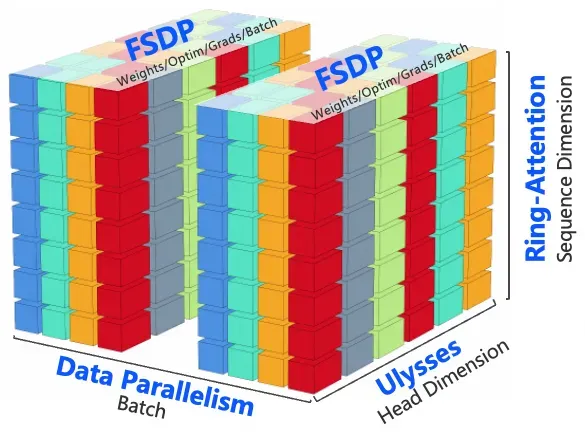

一方面,團隊創新分布式策略,采用了 DP、FSDP、RingAttention、Ulysses 混合的 4D 并行訓練,訓練性能和分布式擴展性雙雙得以增強。另一方面,為了實現顯存優化,團隊基于序列長度帶來的計算量和通信量,采用分層的顯存優化策略來優化 Activation 顯存并解決了顯存碎片問題。

另外,計算優化可以提高模型訓練效率并節省資源,為此團隊采用 FlashAttention3 進行時空全注意力計算,并結合訓練集群在不同尺寸上的計算性能,選擇合適的 CP 策略進行切分。同時針對一些關鍵的模塊去除計算冗余,并通過高效的 Kernel 實現來降低訪存開銷、提升計算效率。在文件系統方面,團隊充分利用阿里云訓練集群中高性能文件系統的讀寫特性,通過分片 Save/Load 方式提升讀寫性能。

4D 并行分布式訓練策略

與此同時,針對訓練中因 Dataloader Prefetch 、CPU Offloading 和 Save Checkpoint 導致的內存溢出(OOM)問題,團隊選擇錯峰內存使用方案。并且,為了保證訓練穩定性,團隊借助了阿里云訓練集群的智能化調度、慢機檢測以及自愈能力,實現了自動識別故障節點并快速重啟任務。

數據構建與模型評估引入自動化

視頻生成大模型的訓練離不開規模化的高質量數據和有效的模型評估,前者可以確保模型學習到多樣化的場景、復雜的時空依賴關系并提高泛化能力,構成模型訓練的基石;后者有助于監督模型表現,使其更好地達到預期效果,成為模型訓練的風向標。

在數據構建上,團隊以高質量為準繩,打造出了一套自動化的數據構建管線,在視覺質量、運動質量等方面與人類偏好分布保持高度一致,從而可以自動構建高質量的視頻數據,并呈現出高多樣性、均衡分布等特征。

在模型評估上,團隊同樣設計了一套全面的自動化度量機制,將美學評分、運動分析和指令遵循等二十幾個維度納入其中,并針對性地訓練出了能夠對齊人類偏好的專業打分器。在這些度量指標的有效反饋下,模型迭代和優化過程顯著加快。

可以說,架構、訓練和評估等多個方面的協同創新,讓升級后的通義萬相視頻生成模型在實際體驗中收獲了顯著的代際提升。

視頻生成的 GPT-3 時刻,還有多久?

自去年 2 月,OpenAI 的 Sora 問世以來,視頻生成模型成為了科技界競爭最為激烈的領域。國內到海外,創業公司到科技大廠都在紛紛推出自家的視頻生成工具。然而相對于文字的生成,AI 視頻想要做到人們可以接受的程度,難度高了不止一個等級。

如果像 OpenAI CEO 山姆?奧特曼說的那樣,Sora 代表了視頻生成大模型的 GPT-1 時刻。那么我們在此基礎上實現文本指令對 AI 的精準化控制、角度和機位的可調整、保證角色的一致性等視頻生成該有的能力,再加上快速變換風格場景這樣 AI 獨有的功能,或許就可以很快迎來新的「GPT-3 時刻」。

從技術發展的路徑來看,視頻生成模型是一個驗證 Scaling Laws 的過程。隨著基礎模型能力的提升,AI 將會越來越懂人類的指令,并能創造出越來越真實合理的環境。

從實踐的角度看,我們其實早就已經迫不及待了:自去年起,不論短視頻、動畫領域,甚至影視行業的人們都已經開始利用視頻生成 AI 進行創作探索。如果我們可以突破現實的限制,用視頻生成 AI 做以前無法想象的事,新一輪行業變革就在眼前。

現在看來,通義萬相已經率先邁出了一步。