Open-Sora:讓所有人都能輕松制作高效視頻,可生成16秒720P視頻,模型代碼全開(kāi)源!

Open-Sora是一項(xiàng)致力于高效制作高質(zhì)量視頻的計(jì)劃。目的是讓所有人都能使用模型、工具和所有細(xì)節(jié)。通過(guò)采用開(kāi)源原則,Open-Sora 不僅使高級(jí)視頻生成技術(shù)的使用變得民主化,而且還提供了一個(gè)簡(jiǎn)化且用戶友好的平臺(tái),簡(jiǎn)化了視頻生成的復(fù)雜性。

Open-Sora的目標(biāo)是在內(nèi)容創(chuàng)作領(lǐng)域促進(jìn)創(chuàng)新、創(chuàng)造力和包容性。目前已經(jīng)支持2s~15s、144p 到 720p、任意比例的文本轉(zhuǎn)圖片、文本轉(zhuǎn)視頻、圖片轉(zhuǎn)視頻、視頻轉(zhuǎn)視頻、無(wú)限時(shí)間生成。

Open-Sora的構(gòu)建方法總結(jié)為以下幾個(gè)方面:

- 數(shù)據(jù)來(lái)源與處理

- 利用多個(gè)開(kāi)放數(shù)據(jù)集(如Webvid-10M、Panda-70M等)生成30M個(gè)視頻剪輯,確保模型訓(xùn)練的可重復(fù)性。

- 數(shù)據(jù)預(yù)處理采用完整的管道,包括場(chǎng)景切割、視頻過(guò)濾和文本生成,以確保高質(zhì)量的視頻文本對(duì)。

- 模型架構(gòu)

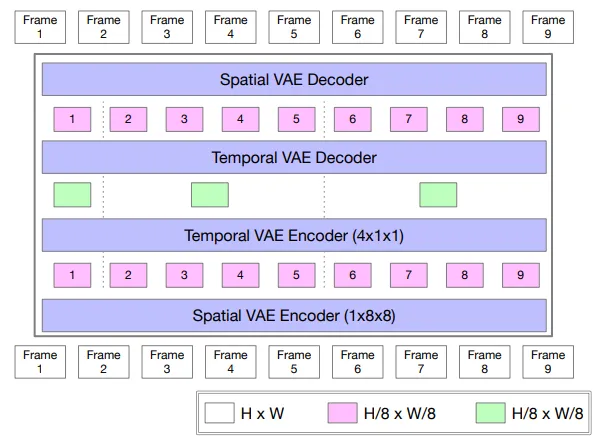

- 使用3D自編碼器對(duì)視頻進(jìn)行壓縮,減少計(jì)算負(fù)擔(dān),并通過(guò)文本編碼器處理文本輸入。

- 采用空間-時(shí)間注意力機(jī)制,使得模型在生成視頻時(shí)能夠同時(shí)考慮空間和時(shí)間信息。

- 訓(xùn)練策略

- 采用多階段訓(xùn)練策略,分為三個(gè)階段以優(yōu)化訓(xùn)練效率。

- 通過(guò)動(dòng)態(tài)分辨率和寬高比的支持,模型能夠適應(yīng)不同的視頻生成任務(wù),提升生成質(zhì)量。

相關(guān)鏈接

- 論文:http://arxiv.org/abs/2412.20404v1

- 代碼:https://github.com/hpcaitech/Open-Sora

論文介紹

視覺(jué)和語(yǔ)言是人類(lèi)的兩種基本感覺(jué),它們構(gòu)成了我們的認(rèn)知能力和智力。雖然人工智能語(yǔ)言能力取得了重大突破,但人工智能視覺(jué)智能,尤其是生成和模擬我們所見(jiàn)世界的能力,卻遠(yuǎn)遠(yuǎn)落后。

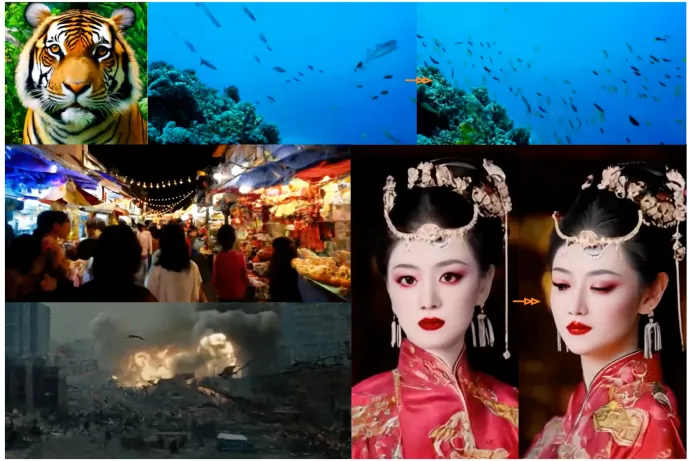

為了促進(jìn)人工智能視覺(jué)智能的發(fā)展和普及,作者創(chuàng)建了 OpenSora,這是一個(gè)旨在生成高保真視頻內(nèi)容的開(kāi)源視頻生成模型。Open-Sora 支持廣泛的視覺(jué)生成任務(wù),包括文本到圖像生成、文本到視頻生成和圖像到視頻生成。該模型利用先進(jìn)的深度學(xué)習(xí)架構(gòu)和訓(xùn)練/推理技術(shù)實(shí)現(xiàn)靈活的視頻合成,可以生成長(zhǎng)達(dá) 15 秒、高達(dá) 720p 分辨率和任意寬高比的視頻內(nèi)容。

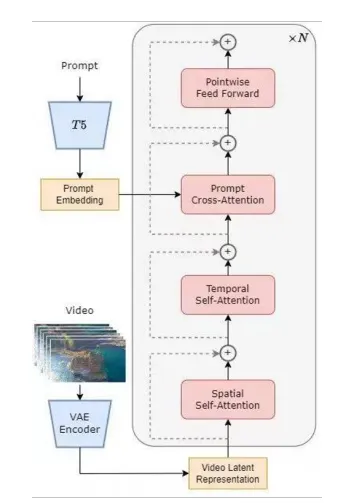

具體來(lái)說(shuō),OpenSora引入了時(shí)空擴(kuò)散變換器 (STDiT),這是一種高效的視頻擴(kuò)散框架,可將空間和時(shí)間注意力分離。我們還引入了高度壓縮的 3D 自動(dòng)編碼器,使表示緊湊,并通過(guò)臨時(shí)訓(xùn)練策略進(jìn)一步加速訓(xùn)練。

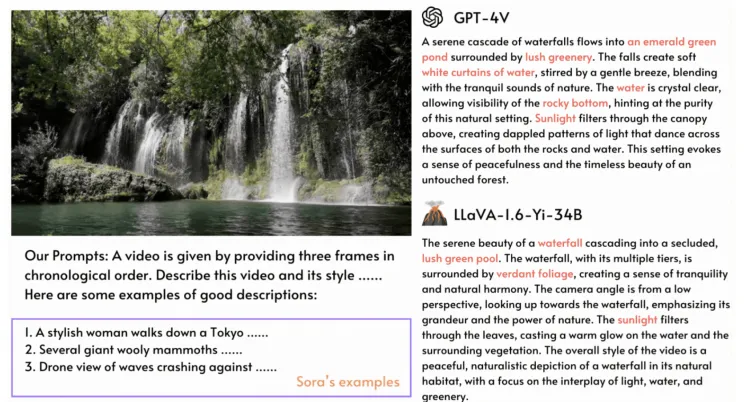

Open-Sora 可以生成高保真視頻。帶有箭頭的圖像表示運(yùn)動(dòng)。

數(shù)據(jù)處理

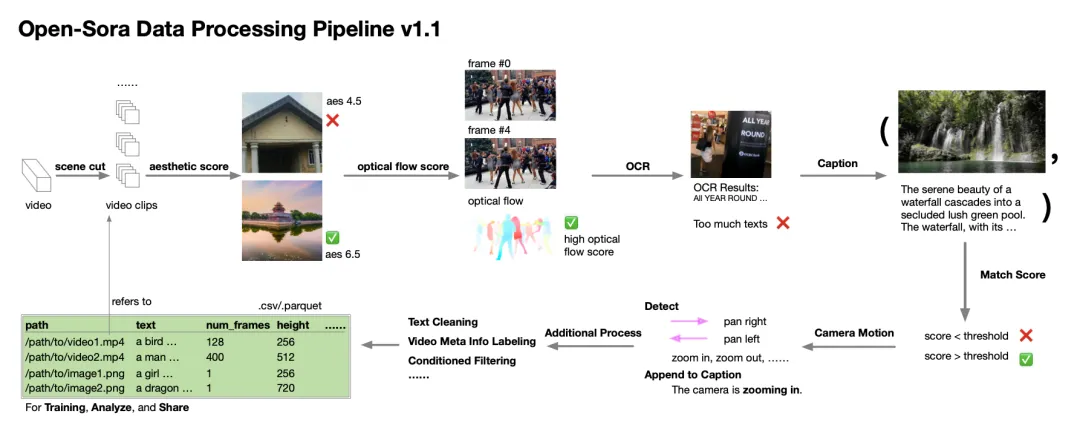

高質(zhì)量的數(shù)據(jù)對(duì)于訓(xùn)練良好的生成模型至關(guān)重要。為此,OpenSora建立了完整的數(shù)據(jù)處理流程,可以將原始視頻無(wú)縫轉(zhuǎn)換為高質(zhì)量的視頻-文本對(duì)。流程如下所示:

視頻描述

數(shù)據(jù)預(yù)處理

利用預(yù)訓(xùn)練的 2D 自動(dòng)編碼器的 3D 自動(dòng)編碼器。

模型結(jié)構(gòu)

模型架構(gòu)基于 PixArt,這是一種圖像擴(kuò)散變換器,其中使用 T5 文本編碼器對(duì)文本進(jìn)行編碼,并在視頻和文本潛在特征之間應(yīng)用交叉注意力。 為了實(shí)現(xiàn)高效的視頻生成,采用了一種時(shí)空注意力機(jī)制,即受Latte啟發(fā)的時(shí)空注意力機(jī)制,即空間時(shí)間擴(kuò)散變換器 (STDiT),取代了對(duì)所有標(biāo)記的完全注意力。具體而言,空間自注意力應(yīng)用于每一幀內(nèi),而時(shí)間注意力應(yīng)用于同一空間位置的跨幀。

為了專(zhuān)注于視頻生成,該模型以構(gòu)建一個(gè)強(qiáng)大的預(yù)訓(xùn)練圖像生成模型。該模型使用 PixArtα 進(jìn)行初始化,PixArtα 是一種經(jīng)過(guò) T5 條件處理的 DiT 結(jié)構(gòu),針對(duì)高質(zhì)量和高效的圖像生成進(jìn)行了優(yōu)化。新引入的時(shí)間注意力的投影層初始化為零,在訓(xùn)練開(kāi)始時(shí)保留了模型的原始圖像生成能力。時(shí)間注意力的加入使參數(shù)數(shù)量從 5.8 億增加到 1.1 億。

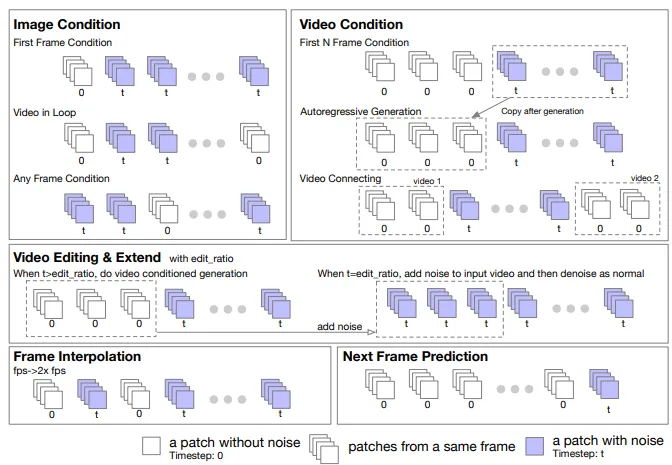

圖像和視頻到視頻生成的通用框架。

結(jié)論

Open-Sora 代表了開(kāi)源視頻生成領(lǐng)域的重大進(jìn)步,它提供了一個(gè)包括數(shù)據(jù)處理、訓(xùn)練代碼和模型權(quán)重的綜合框架。通過(guò)成功復(fù)制 Sora 報(bào)告中的關(guān)鍵技術(shù),并能夠生成長(zhǎng)達(dá) 16 秒的高質(zhì)量視頻,分辨率高達(dá) 720p,運(yùn)動(dòng)動(dòng)態(tài)可控,Open-Sora 使高級(jí)視頻生成技術(shù)的使用變得民主化。這一舉措不僅促進(jìn)了社區(qū)合作,還為該領(lǐng)域的未來(lái)發(fā)展奠定了基礎(chǔ)。