5090跑《黑神話》飆到200+幀,英偉達DLSS也用上Transformer了

現在,打個游戲都用上Transformer了?!

老黃的DLSS進行了一波大升級,換上了基于Transformer的新大腦。

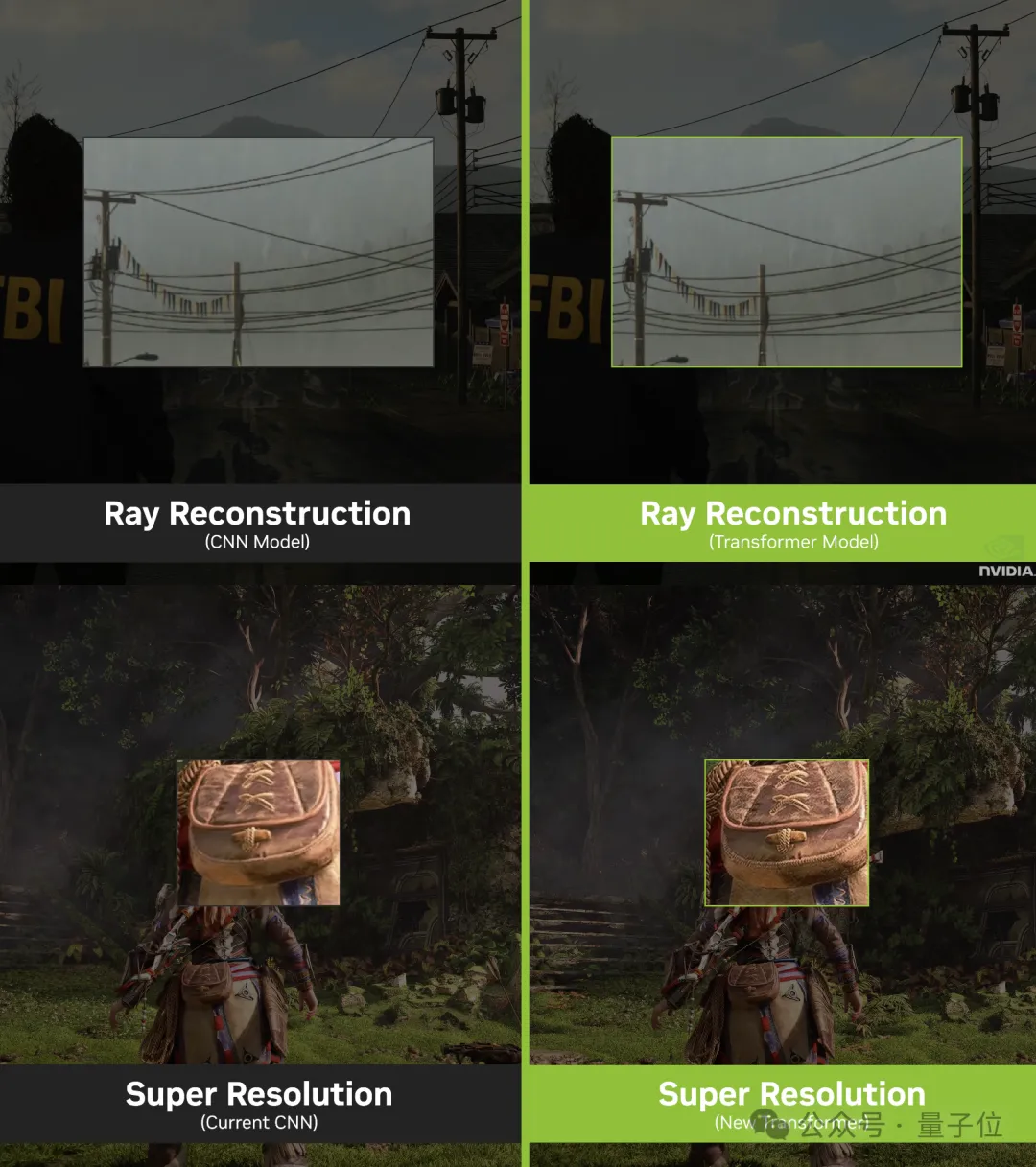

用上新模型之后,光線重建和超分辨率,效果都變得更細膩了。

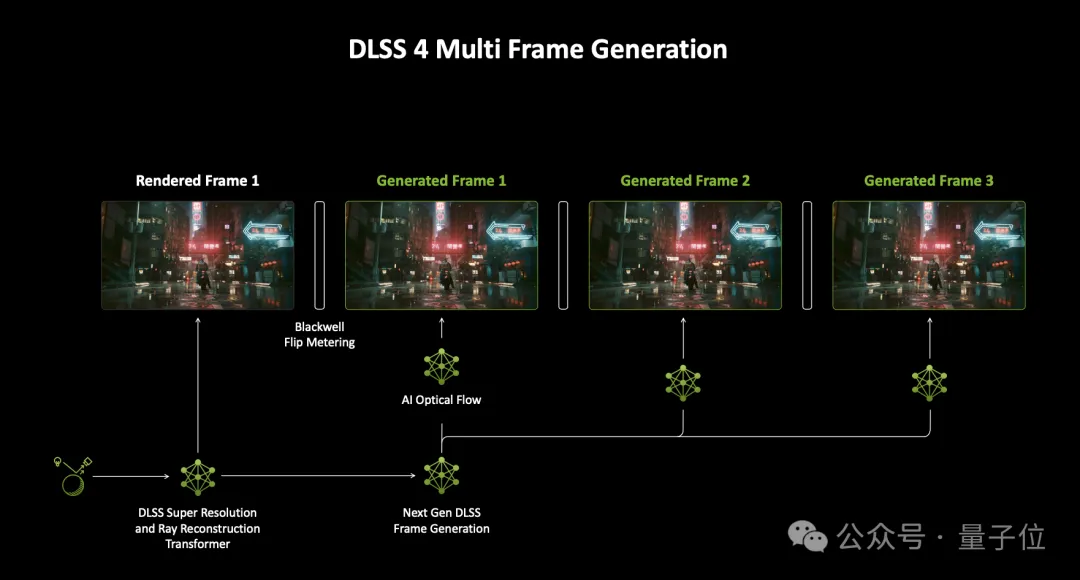

而且DLSS 3中的幀生成功能也升級到了DLSS 4多幀生成,一次性就能生成最多3幀畫面,把《黑神話:悟空》的幀率拉升到200+。

同時,英偉達還上新了一大批AI渲染技術,像畫面渲染中的重要部件——著色器,里面也有了AI的一席之地。

這波也算是給游戲開發者和玩家們送上了一份“新年大禮包”了。

英偉達這樣做的目的,當然有給50系顯卡帶貨的成分,但有了這些黑科技,游戲玩家們的體驗也確實能有所提升。

“大力水手”全面“換腦”

就像開頭說的,被游戲玩家們稱為“大力水手”的DLSS,迎來了一次全面更新。

(注:DLSS全稱Deep Learning Super Sampling,即深度學習超級采樣)

DLSS的核心思想,就是用AI運算來取代一部分的渲染計算,從而在加快畫面產生速度的同時提升畫質。

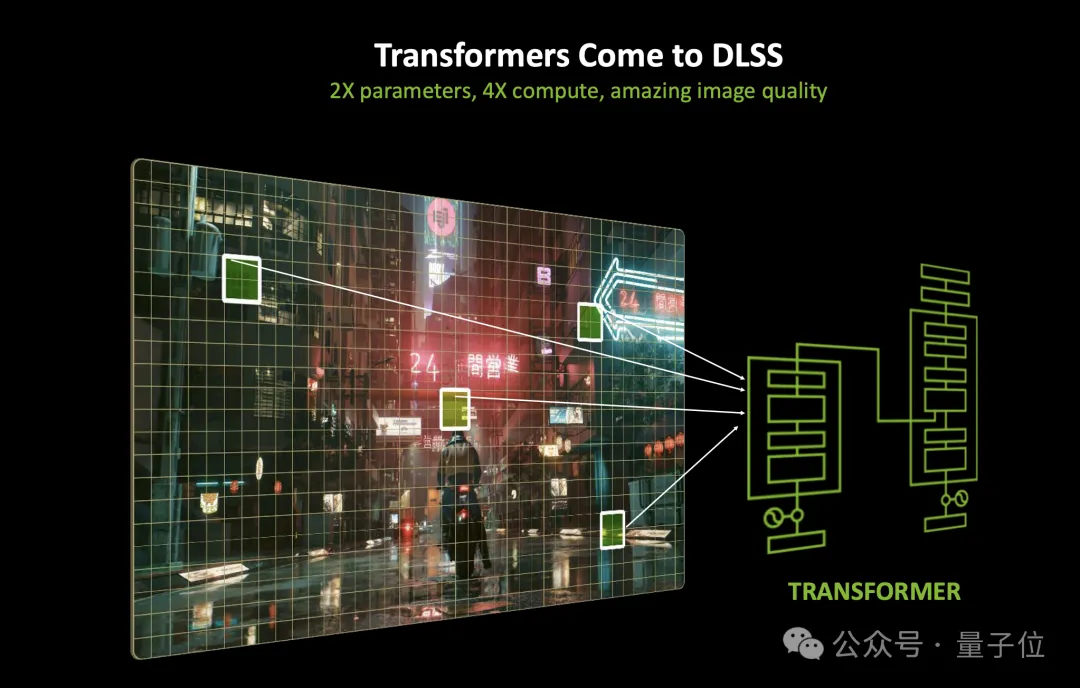

之前的DLSS,主要是通過卷積神經網絡(CNN)來實現,現在隨著50系顯卡的上線,“大力水手”也進行了“換腦”,CNN的工作被Transformer取代了。

據介紹,這是Transformer模型首次在圖形領域的實時應用。

相比于過去的CNN,新的Transformer模型擁有兩倍的參數量,生成的像素穩定性更強、重影更少,還擁有更高的運動細節以及更平滑的邊緣。

DLSS的兩個主要功能——光線重建和超分辨率,都已經用上了Transformer。

比如在《心靈殺手2》的光線重建場景,全新的DLSS4相比于上一代基于CNN的算法,柵欄呈現出的連續性明顯更強,兩個場景下的光線也更加真實了。

如果感覺變化不明顯,可以看下靜態畫面的對比:

在超分辨率功能當中,畫面細節相比之前的CNN也變得更加細膩。

另外新一代的幀生成功能也不再局限于單幀,支持一次生成最多3幀畫面。

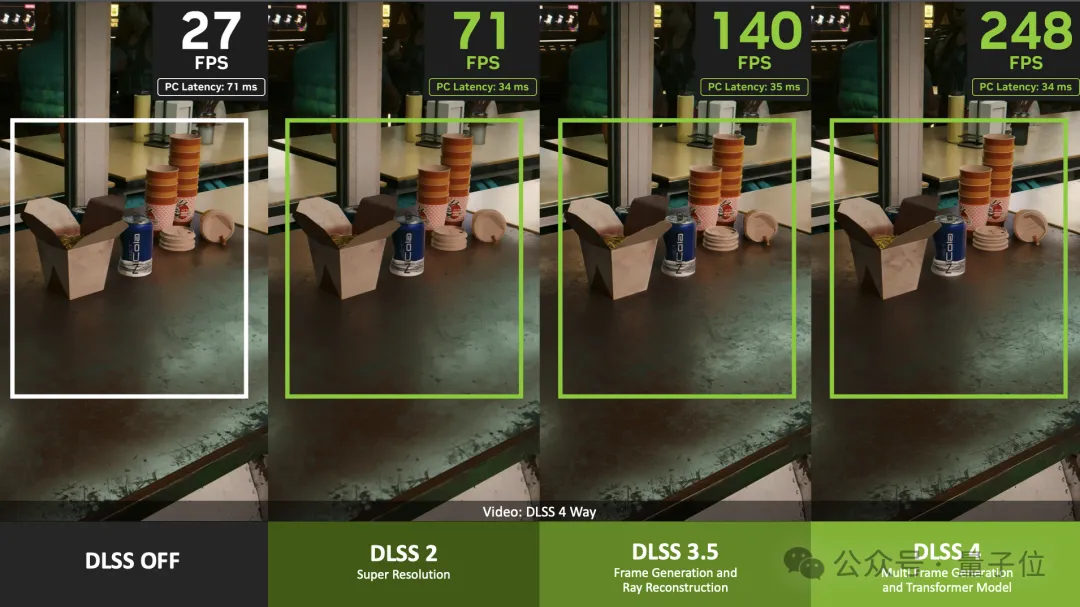

比如在《賽博朋克2077》的場景中,相比于不開啟DLSS,DLSS 4的多幀生成可以在延遲降低超過一半的情況下將幀率從27提升到248,比例將近8倍。

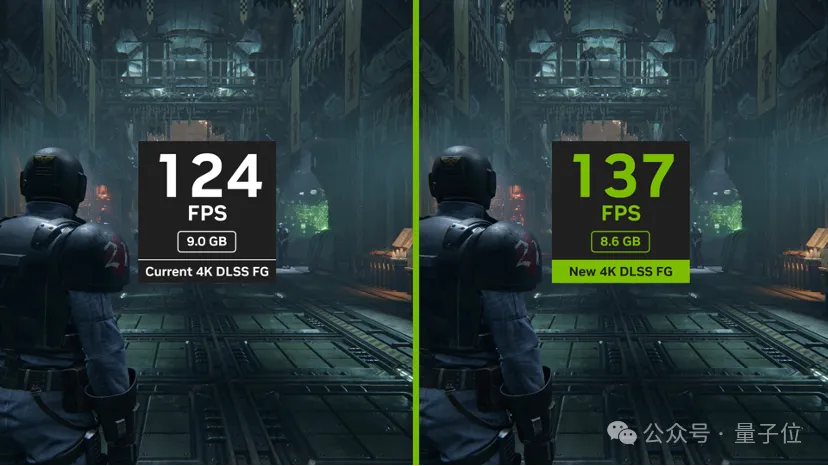

另外,新模型速度提高了40%,使用的VRAM減少了 30%,例如在《戰錘40K:暗潮》中,幀速率提高了10%,同時在4K最大設置下減少了400MB顯存占用。

另外40系顯卡中的幀生成功能也進行了升級,同樣是在提高性能的同時減少了VRAM的使用。

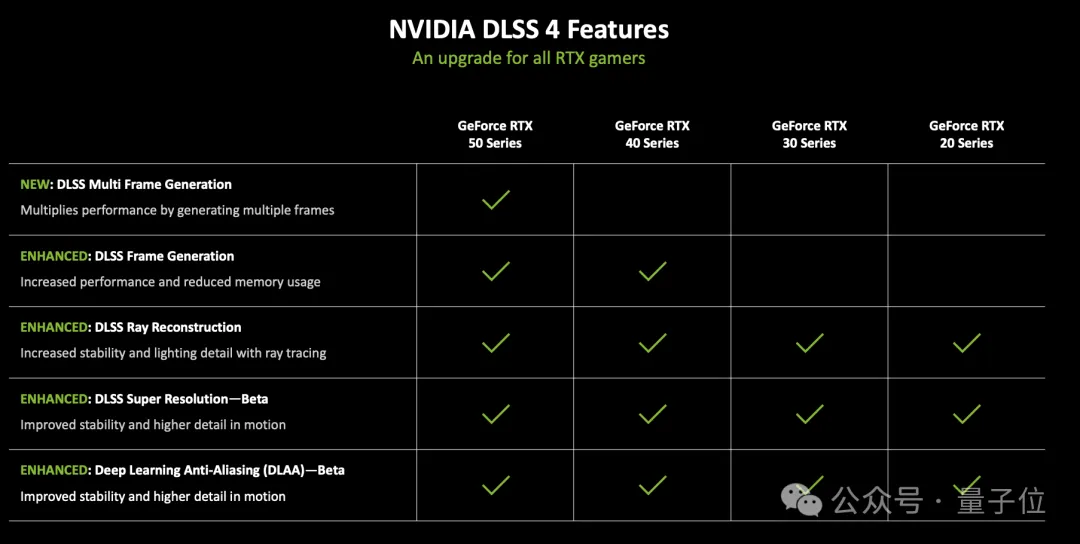

目前DLSS 4已經提供了對75款游戲和應用的Day 0支持,除了多幀生成是50系獨占之外,基于Transformer的光線重建、超分辨率等功能同時還可以給40、30甚至20系顯卡帶來性能提升。

隨便劇透一下,《黑神話:悟空》也將在Day-0支持DLSS 4多幀生成。

圖形渲染也用上AI了

與新版DLSS一起,英偉達還推出了一套神經渲染技術——NVIDIA RTX Kit。

它可利用GPU中的Tensor Core,通過AI完成游戲中的光線追蹤,并渲染具有復雜幾何形狀的場景,可以用高保真度渲染出復雜的開放世界,同時減少偽影、不穩定性并降低VRAM使用。

首先是RTX神經網絡著色器(Neural Shader),它把AI引入到了可編程著色器當中,包含了三大關鍵技術:

- 神經網絡紋理壓縮(Neural Texture Compression ):用AI快速壓縮紋理,在相同視覺質量下消耗的VRAM或系統內存只有1/7;

- 神經網絡材質(Neural Materials):用AI壓縮復雜著色器代碼,材質處理速度提高了5倍,可以以游戲畫面的幀速率渲染電影質量的資源;

- 神經網絡輻射緩存(Neural Radiance Cache):用AI學習多次反射間接照明,利用最初的一到兩次反射即可推斷出無限多次的反射,從而提升了路徑追蹤性能。

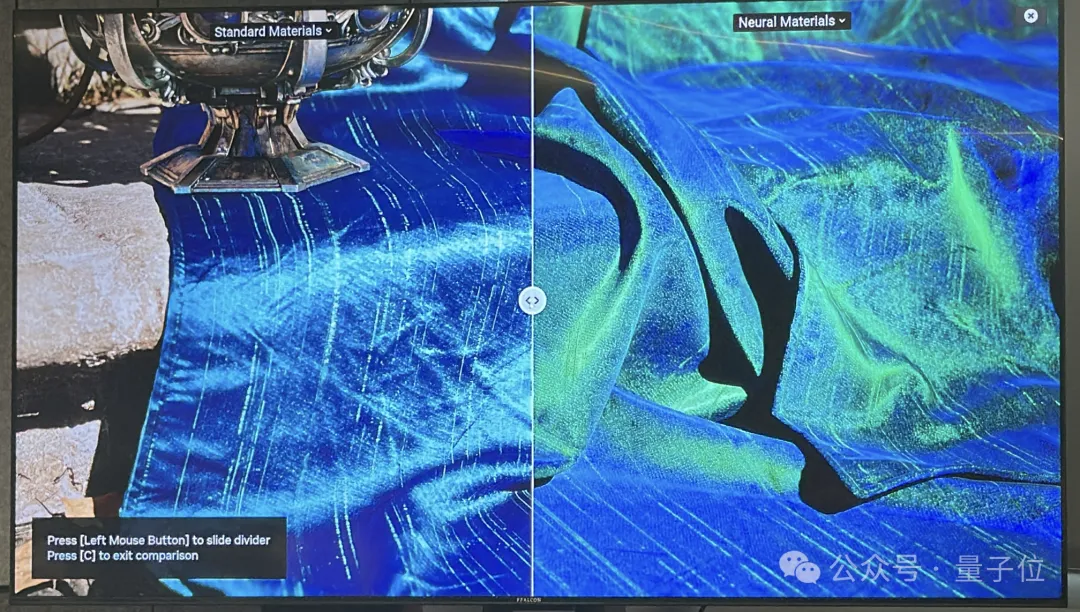

來看一組開啟Neural Materials前后的效果對比,開啟之后(分割線右側)畫面中的材質以及藍寶石的反光效果都變得更加真實。

還有像這樣的絲綢材質,Neural Materials開啟后絲綢的光澤被更好地展現,畫面也更細膩了。

對比確實很明顯,不過對于實時畫面渲染來講,這些還算是灑灑水,真正具有挑戰的,是人臉的渲染。

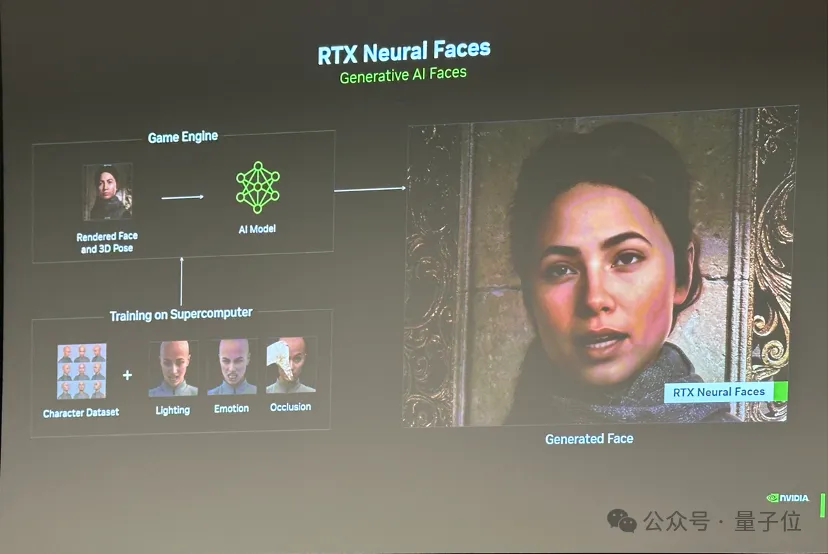

這就涉及到了RTX Kit中的另一個組件——RTX Neural Faces,它利用生成式AI來提高人臉的渲染質量。

Neural Faces采用簡單的光柵化臉部加上3D姿勢數據作為輸入,用AI模型來推斷臉部(而不是蠻力渲染)。

Neural Faces背后的訓練數據包含了不同的角度、光照、情緒和遮擋條件下的數千個臉部圖像,可以創造出更柔和、更自然的外觀。

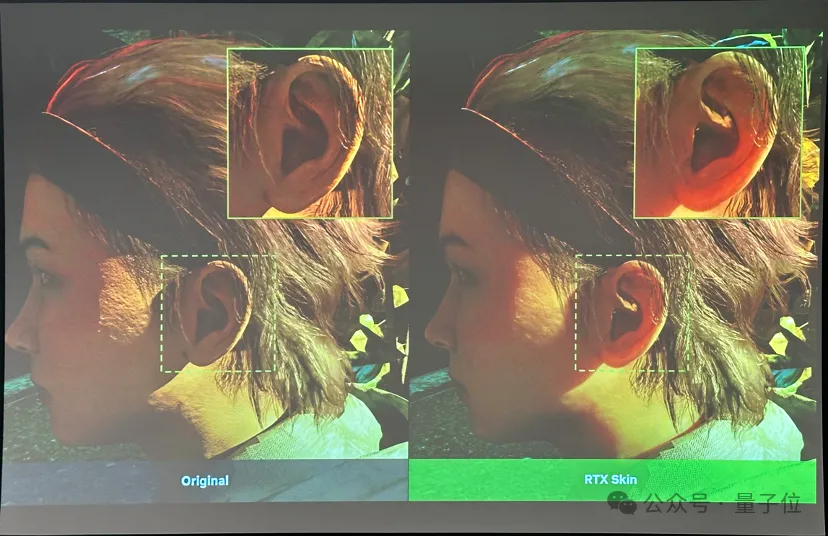

Neural Faces還專門針對皮膚和頭發專門設計了補充SDK。

其中應用了次表面散射(SSS)技術,可以模擬光線穿透半透明材料表面并在內部散射的過程,從而更好地呈現皮膚質感。

還有線性掃描球體(LSS)加速基元,可以減少渲染頭發所需的幾何體數量,并使用球體代替三角形來更準確地適應頭發形狀。

用英偉達的話說,Neural Faces這項技術“跨越了人像渲染的恐怖谷”。

還有針對三角形光線追蹤的RTX Mega Geometry。

在游戲當中,三角形是構成畫面的重要元素,其數量也隨時間呈現出指數級增長,特別是虛幻引擎5推出新的幾何系統以來,游戲中的三角形數量已經數以億計。

這對于幀畫面的構建而言是一大噩夢,想要保持足夠的幀速率更是難上加難。

Mega Geometry可以在GPU上批量智能更新三角形簇,從而減少CPU開銷并提高光線追蹤場景中的性能和圖像質量,可處理的三角形數量是之前的100倍。

據英偉達介紹,Mega Geometry可以“對項目中的每個三角形進行完全光線追蹤”。

眼見為實,一開始分割線左側的藤蔓未開啟Mega Geometry,非常沒有立體感,景深關系不對,光影也不符合物理規律,看上去就是一個字——假。

但開啟之后,藤蔓的立體感一下子就增強了,并且光影也更加真實,“貼圖感”消失了一大半。

Two More Things

除了畫面質量,延遲也是游戲玩家們關心的重要參數,特別是在競技游戲中,幾毫秒的輸入延遲可能就會決定勝負。

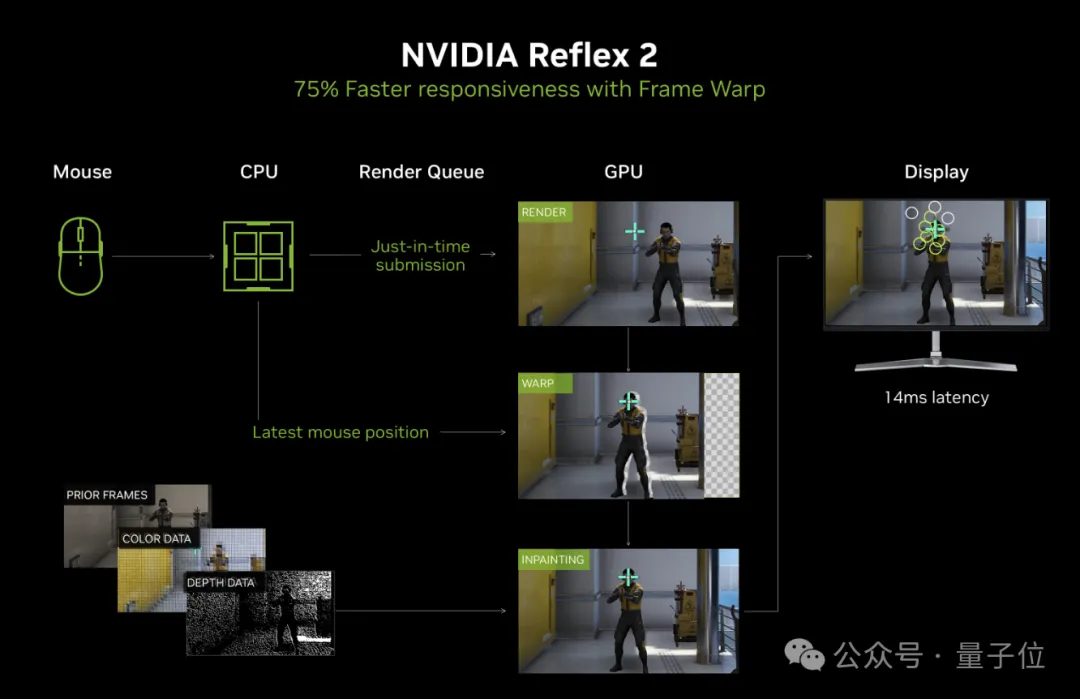

為此英偉達推出了Reflex 2,將上一代Reflex的低延遲模式與全新Frame Warp技術相結合,在將渲染幀發送至顯示器前,根據最新的鼠標輸入信號對其進行更新,可將PC延遲降低高達 75%。

為了解決Frame Warp過程中的圖像撕裂問題,英偉達還開發了一種優化了延遲的預測渲染算法,該算法使用來自先前幀的視角、顏色和深度數據,對這些撕裂進行準確的圖像修復。

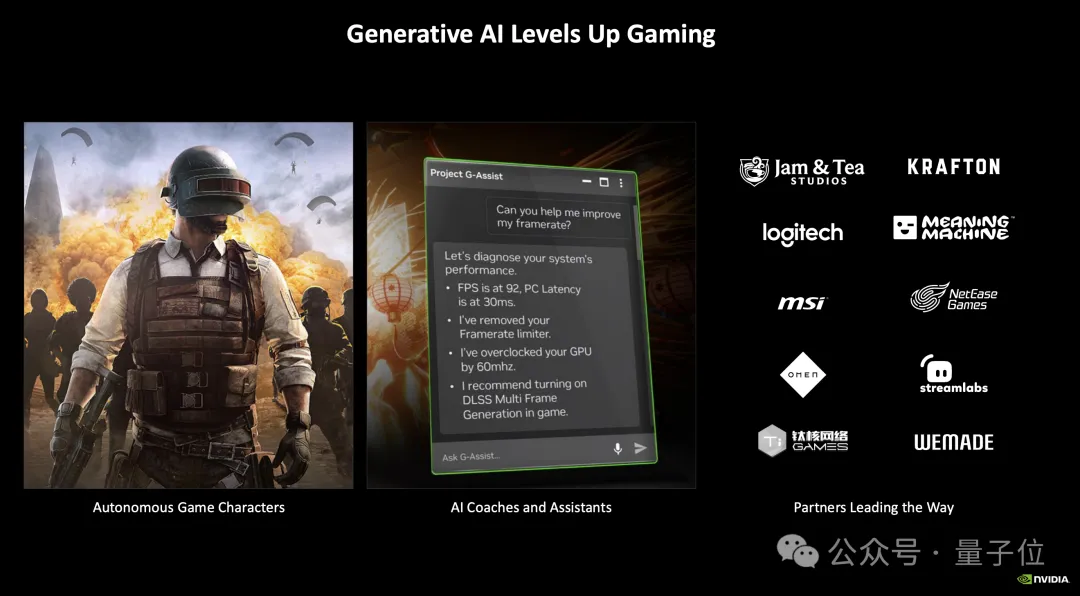

在上一屆CES上,英偉達展示的AI NPC技術(基于NVIDIA ACE實現)也吸引了不少眼球。

通過ACE,不需要事先準備劇本,就能讓游戲中的人物像真人一樣與玩家語音對話。

現在這項技術也迎來了升級,應用范圍擴展到了擁有自主意識的游戲角色,比如AI隊友。

并且能力也更豐富,可以利用AI讓這些角色像真人玩家一樣感知、計劃和行動。

另外,去年的AI NPC的對話內容需要傳輸到云端處理;

現在50系顯卡運算能力大幅提升,同時英偉達還推出了小語言模型,在算法和算力同時升級之后,對話內容的處理在本地也能完成了。

《絕地求生 (PUBG: BATTLEGROUNDS)》中就會通過Ace服務和定制版Mistral小模型,在游戲中提供一個像真人一樣的虛擬隊友。

它可以和你對話并密切配合你的動作,幫助標記出物品,甚至開車過來和你匯合。

國產游戲方面,網易的《永劫無間 (NARAKA: BLADEPOINT)》PC版也將在今年年內發布類似功能。

總之,工具老黃都已經給大家準備好,接下來的壓力給到游戲公司這邊了。