阿里開源R1-Omni,DeepSeek同款RLVR首度結(jié)合全模態(tài)情感識別,網(wǎng)友:可解釋性+多模態(tài)學(xué)習(xí)=下一代AI

首次將DeepSeek同款RLVR應(yīng)用于全模態(tài)LLM,含視頻的那種!

眼睛一閉一睜,阿里通義實驗室薄列峰團(tuán)隊又開卷了,哦是開源,R1-Omni來了。

同樣在杭州,這是在搞什么「開源雙feng」(狗頭保命)?

他們都做了啥?

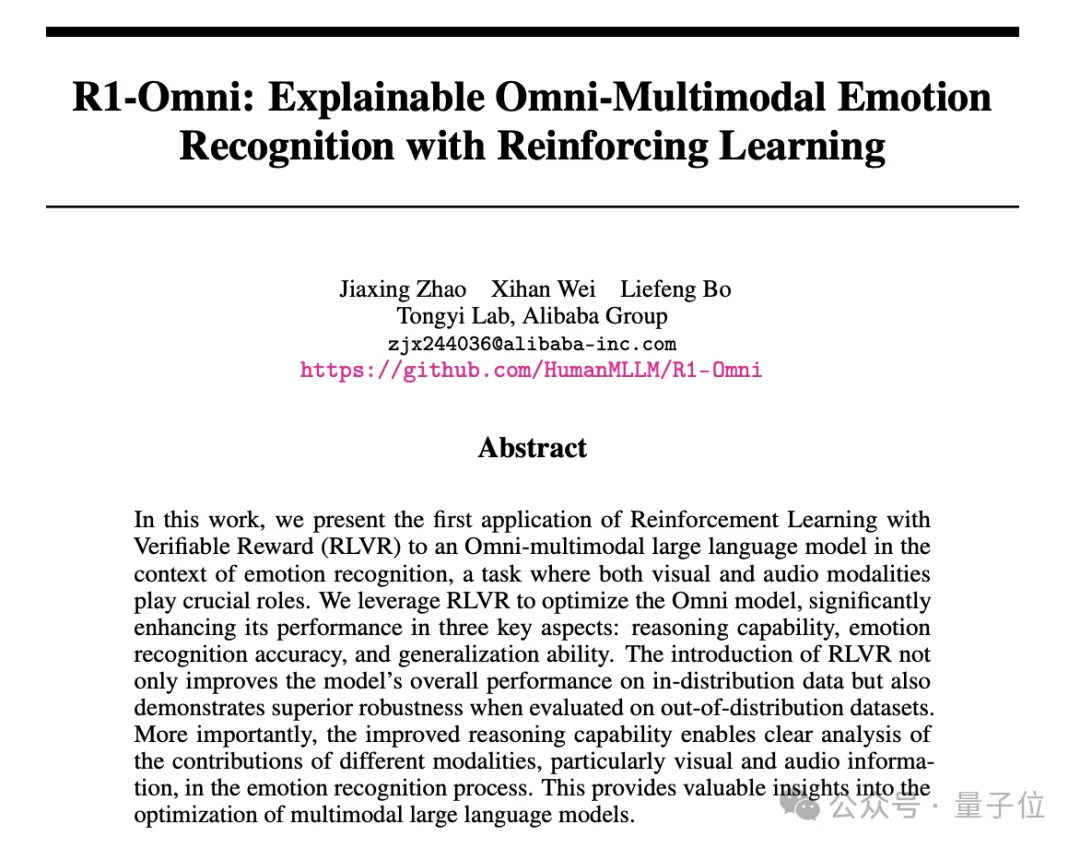

DeepSeek-R1帶火了RLVR(可驗證獎勵強(qiáng)化學(xué)習(xí)),之前已有團(tuán)隊將RLVR應(yīng)用于圖像-文本多模態(tài)LLM,證明其在幾何推理和視覺計數(shù)等任務(wù)上表現(xiàn)優(yōu)異。

然鵝,尚未探索將其與包含音頻、動態(tài)視覺內(nèi)容的全模態(tài)LLM結(jié)合。

薄列峰團(tuán)隊首次將RLVR與全模態(tài)LLM結(jié)合,聚焦的是視覺和音頻模態(tài)都提供關(guān)鍵作用的情感識別任務(wù)。

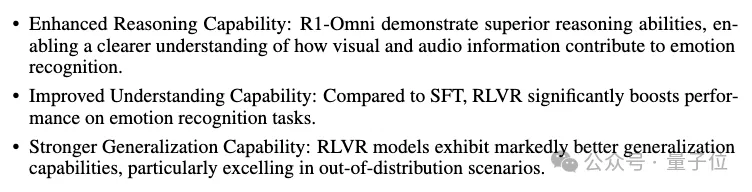

團(tuán)隊實驗發(fā)現(xiàn),模型在三個關(guān)鍵方面有顯著提升:

RLVR的引入不僅提高了模型在分布內(nèi)數(shù)據(jù)上的整體性能,而且在分布外數(shù)據(jù)集上也展現(xiàn)出了更強(qiáng)的魯棒性。

更重要的是,提升后的推理能力使得能夠清晰分析在情感識別過程中不同模態(tài)所起的作用。

R1-Omni在X上也吸引了不少網(wǎng)友關(guān)注:

非常有趣的論文,我立刻就能預(yù)見到它在市場營銷和廣告領(lǐng)域進(jìn)行情感傾向分析的潛力。

還有網(wǎng)友表示可解釋性+多模態(tài)學(xué)習(xí)就是下一代AI的方向。

一起具體來看R1-Omni。

R1-Omni長啥樣?

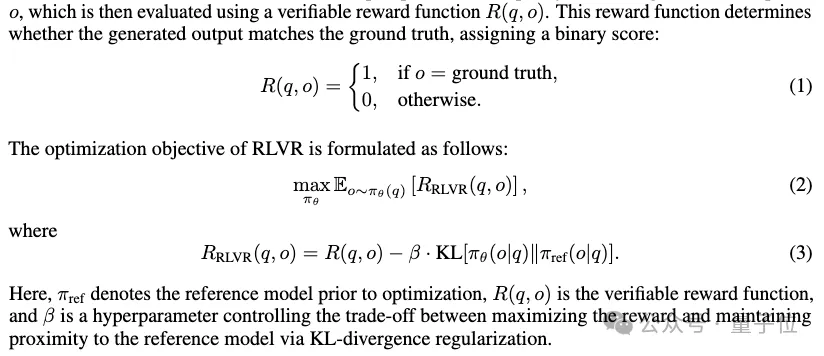

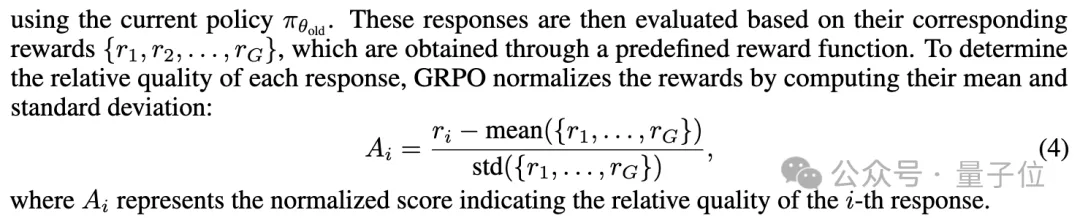

在研究方法上,論文首先介紹了DeepSeek同款RLVR和GRPO。

RLVR是一種新的訓(xùn)練范式,其核心思想是利用驗證函數(shù)直接評估輸出,無需像傳統(tǒng)的人類反饋強(qiáng)化學(xué)習(xí)(RLHF)那樣依賴根據(jù)人類偏好訓(xùn)練的單獨獎勵模型。

給定輸入問題q,策略模型πθ生成響應(yīng)o,接著使用可驗證獎勵函數(shù)R(q,o)對其進(jìn)行評估,其優(yōu)化目標(biāo)為最大化驗證獎勵減去基于KL散度正則化項的結(jié)果。

RLVR在簡化了獎勵機(jī)制的同時,確保了其與任務(wù)內(nèi)在的正確性標(biāo)準(zhǔn)保持一致。

GRPO是一種全新的強(qiáng)化學(xué)習(xí)方法,它與PPO等傳統(tǒng)方法有所不同,PPO依賴于一個評論家模型來評估候選策略的性能,而GRPO直接比較生成的響應(yīng)組,避免了使用額外的評論家模型,簡化了訓(xùn)練過程。

利用歸一化評分機(jī)制,GRPO鼓勵模型在組內(nèi)優(yōu)先選擇獎勵值更高的響應(yīng),增強(qiáng)了模型有效區(qū)分高質(zhì)量和低質(zhì)量輸出的能力。

遵循DeepSeek-R1中提出的方法,團(tuán)隊將GRPO與RLVR相結(jié)合。

R1-Omni模型構(gòu)建方面,團(tuán)隊采用了一種受DeepSeek-R1訓(xùn)練方法啟發(fā)的冷啟動策略。

在包含232個可解釋多模態(tài)(視覺和音頻)情感推理數(shù)據(jù)集(EMER)樣本和348個手動標(biāo)注的HumanOmni數(shù)據(jù)集樣本的組合數(shù)據(jù)集上對HumanOmni-0.5B(一個專為人為場景理解設(shè)計的開源全模態(tài)模型)進(jìn)行微調(diào),使模型具備初步推理能力,了解視覺和音頻線索是如何對情感識別產(chǎn)生作用的。

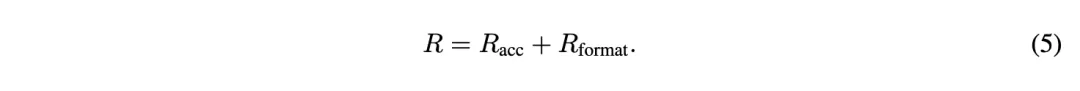

之后,通過RLVR訓(xùn)練優(yōu)化模型,獎勵函數(shù)由準(zhǔn)確率獎勵和格式獎勵組成,準(zhǔn)確性獎勵評估預(yù)測情感與真實情感的匹配度,格式獎勵確保模型輸出符合指定的HTML標(biāo)簽格式。

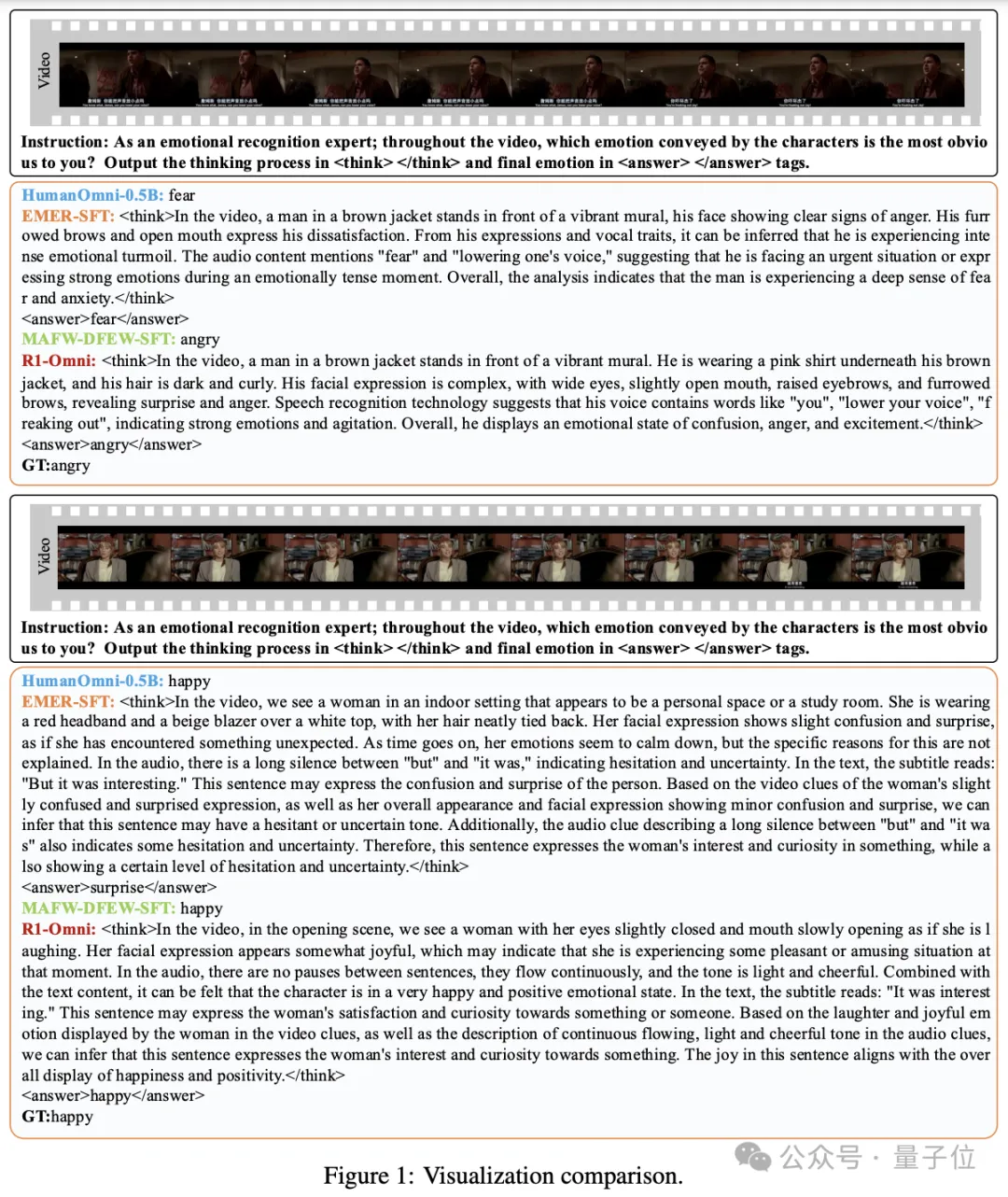

模型輸出預(yù)期包含兩部分:一個推理過程,封裝在"<think></think>"標(biāo)簽內(nèi),解釋模型如何整合視覺和音頻線索得出預(yù)測;一個最終情感標(biāo)簽,封裝在"<answer></answer>"標(biāo)簽內(nèi),表示預(yù)測的情感。

推理/理解/泛化三方面提升

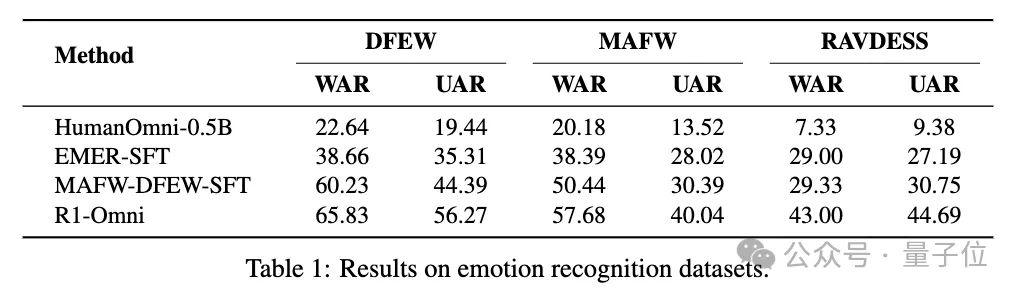

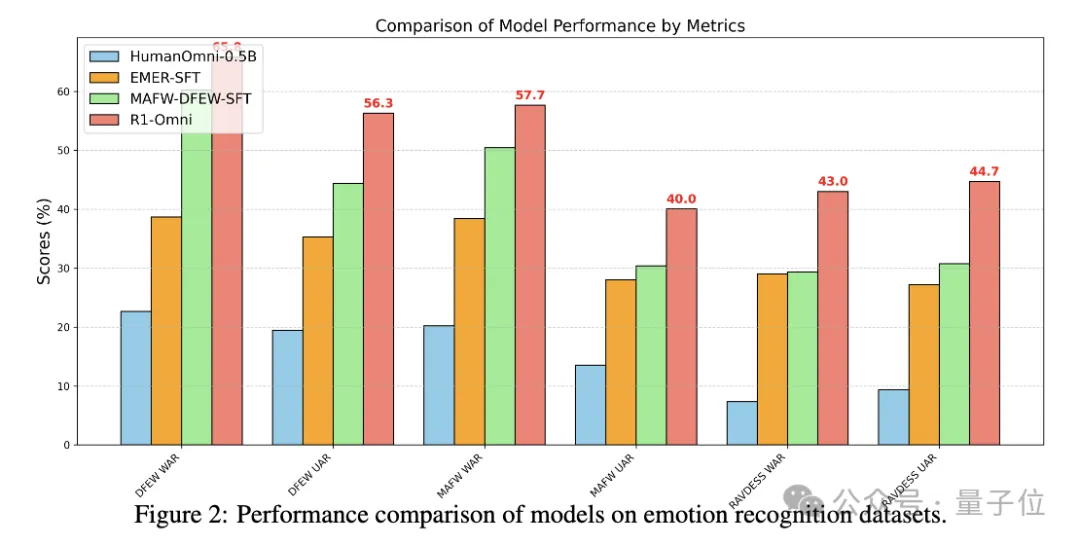

實驗評估中,研究者將R1-Omni與三個基線模型進(jìn)行比較:原始的HumanOmni-0.5B、在EMER數(shù)據(jù)集上進(jìn)行監(jiān)督微調(diào)的模型EMER-SFT、直接在MAFW和DFEW訓(xùn)練集上基于HumanOmni-0.5B進(jìn)行監(jiān)督微調(diào)的模型MAFW-DFEW-SFT。

評估指標(biāo)包括無加權(quán)平均召回率(UAR)和加權(quán)平均召回率(WAR),這些指標(biāo)衡量模型在不同情感類別中準(zhǔn)確分類情感的能力。

重要的是,所有評估都在開放詞匯情感測試(OV-emotion)協(xié)議下進(jìn)行。在這種設(shè)置中,模型不提供預(yù)定義的情感類別,而是直接從輸入數(shù)據(jù)中生成情感標(biāo)簽,這增加了評估的挑戰(zhàn)性和實際應(yīng)用價值。

實驗結(jié)果表明,R1-Omni在三個關(guān)鍵方面優(yōu)于三個對比模型:推理能力增強(qiáng)、理解能力提高、泛化能力更強(qiáng)。

研究者展示了一系列可視化示例,比較R1-Omni與其它三個模型的輸出,R1-Omni提供了更連貫、準(zhǔn)確和可解釋的推理過程。

相比之下原始HumanOmni-0.5B和MAFW-DFEW-SFT模型表現(xiàn)出有限的推理能力,而EMER-SFT雖具備一定推理能力但推理過程連貫性較差且容易產(chǎn)生幻覺。

在MAFW和DFEW數(shù)據(jù)集上,R1-Omni在UAR和WAR指標(biāo)上均優(yōu)于其它模型。

例如在DFEW數(shù)據(jù)集上,R1-Omni實現(xiàn)了65.83%的UAR和56.27%的WAR,明顯優(yōu)于MAFW-DFEW-SFT的60.23%UAR和44.39%WAR。

為了評估模型的泛化能力,研究者在RAVDESS數(shù)據(jù)集上進(jìn)行了實驗,該數(shù)據(jù)集作為分布外(OOD)測試集。

與主要由電影片段組成的MAFW和DFEW數(shù)據(jù)集不同,RAVDESS數(shù)據(jù)集特點是專業(yè)演員以中性北美口音發(fā)表詞匯匹配的陳述,這種數(shù)據(jù)分布的顯著差異使RAVDESS成為評估模型泛化到未見場景能力的理想基準(zhǔn)。

R1-Omni在RAVDESS數(shù)據(jù)集上相較于MAFW-DFEW-SFT模型有顯著提升,實現(xiàn)了43.00%的UAR和44.69%的 WAR。

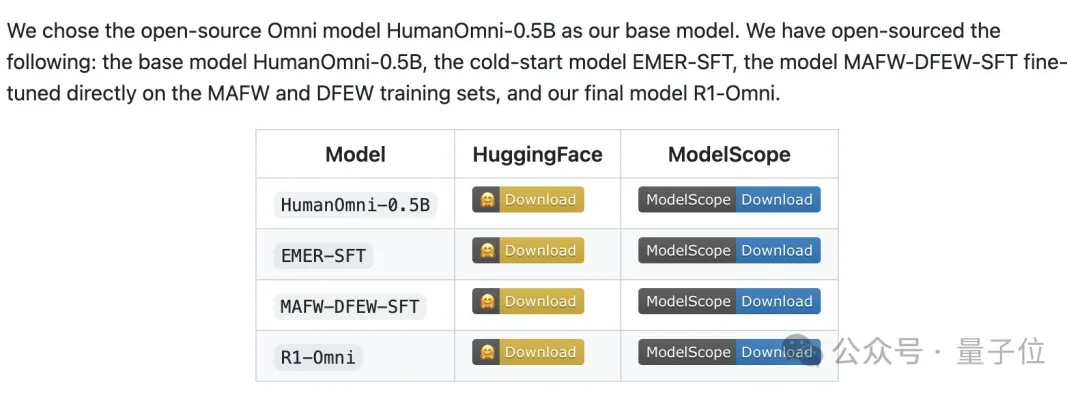

目前,基礎(chǔ)模型HumanOmni-0.5B、冷啟動模型EMER-SFT,還有MAFW-DFEW-SFT以及最終模型R1-Omni已全部開源。