企業搶著要的AI方案:DeepSeek-R1微調實戰,3天構建行業內容生成器

1. 前言

在如今快速發展的AI技術領域,越來越多的企業正在將AI應用于各個場景。然而,盡管大模型(如GPT、DeepSpeek等)在多個任務上已取得顯著進展,但是普通的大模型在面對特定行業或任務時,往往會出現一個問題——AI幻覺。所謂AI幻覺,是指模型生成的內容不符合實際需求,甚至包含錯誤或無關的信息,這對于一些行業來說,可能帶來不可接受的風險,尤其是在醫療、法律、金融等領域。

對于這些行業的企業而言,精準、高效地輸出行業特定內容是他們對AI的核心需求。企業希望AI能夠處理行業術語、應對特殊情境,并且確保內容的準確性。然而,單純依賴大模型進行推理,往往無法達到這樣的標準,因為大模型的訓練是基于通用數據集,這些數據集通常并不包含行業領域的深度知識。因此,企業通常需要一個更加定制化、精細化的模型,而這正是大模型微調技術能夠提供的解決方案。

大模型微調技術通過對預訓練的大模型進行進一步訓練,能夠根據特定領域的需求進行優化。通過提供具有代表性的領域數據,尤其是精心標注的行業特定數據,微調后的模型能夠學習這些領域的專有知識,從而有效避免AI幻覺的發生,并且提供更加準確、有價值的輸出。

本文將從零開始教你一步步入門AI大模型微調技術(基于DeepSpeek R1大模型) ,最終實現基于私有化部署的微調大模型AI會話系統。感興趣的朋友可以繼續往下看看。

2.大模型微調概念簡述

大模型微調是指在已有的預訓練大模型基礎上,通過特定任務或領域數據進行進一步訓練,使模型能夠更精準地處理特定任務。與傳統的訓練方法不同,微調充分利用已有的大模型,減少對大量數據的依賴,同時通過對模型進行小范圍的調整,使其適應新的任務。大模型微調技術在多個領域中得到了廣泛應用,如文本生成、分類任務、問答系統等。

微調的核心目標是使大模型根據特定任務需求進行優化,提升其在特定應用場景中的表現。為實現這一目標,微調方法主要包括以下兩種分類方式:

- 按學習范式分類:根據模型學習方式的不同,微調方法可分為有監督微調、無監督微調和半監督微調等類型。

- 按參數更新范圍分類:根據在微調過程中對模型參數更新范圍的不同,方法可分為全量微調和部分微調等類型。

2.1. 按學習范式分類

有監督微調(Supervised Fine-Tuning,SFT)

有監督微調是最常見的微調方式,適用于任務明確且具有標注數據的情況。通過使用人工標注的高質量數據對,模型能夠學習特定任務所需的知識,從而在指定任務上提供準確的輸出。

SFT示例:

training_data = [

{"input": "問題", "output": "標準答案"},

# 人工標注的高質量數據對

]在有監督微調中,模型的目標是根據輸入的“問題”生成一個“標準答案”。這個過程依賴于人工標注的數據,使模型能夠更好地理解并生成符合實際需求的結果,有監督微調適用于需要特定答案的任務,如情感分析、文本分類、機器翻譯、問答系統等。

無監督微調(Unsupervised Fine-Tuning)

無監督微調是一種不依賴人工標注的微調方式,主要利用大量未標注的文本數據進行訓練。通過無監督學習,模型能夠自動從原始數據中提取知識,尤其在沒有標注數據或標注數據獲取困難的情況下尤為有用。

無監督微調示例:

training_data = [

"大量未標注文本...",

# 無需人工標注的原始文本

]這種方式通常用于模型的預訓練過程,模型通過對大規模文本進行訓練,學習通用的語言表示能力。無監督微調可以增強模型的語法和語義理解能力,提升其在不同任務中的表現,無監督微調適用于自然語言建模、生成任務等場景,幫助模型理解文本的結構和語義關系。

半監督微調(Semi-Supervised Fine-Tuning)

半監督微調結合了有監督和無監督學習的優點,利用標注數據和未標注數據來訓練模型。常用的方法包括將未標注數據通過某種方式生成偽標簽,或利用自監督學習方法,使模型在標注數據較少時也能進行有效訓練。

半監督微調示例:

training_data = [

{"input": "問題", "output": "標準答案"}, # 高質量人工標注數據

"大量未標注文本...", # 用于填充的未標注數據

]半監督微調適用于標注數據稀缺的場景,能夠結合少量標注數據和大量未標注數據,進一步提升模型表現,這種方法在實際應用中尤其適用于標簽獲取困難或成本高昂的領域,如醫療、法律等行業。

2.2. 按參數更新范圍分類

全量微調(Full Fine-Tuning)

全量微調是指在對預訓練模型進行微調時,更新模型的所有參數。通過對特定領域數據的訓練,模型的所有層都會根據新任務的數據進行調整。全量微調能夠在模型中深度定制領域知識,最大程度地提升模型在目標任務中的效果。

全量微調的特點:

- 更新模型的所有參數。

- 適用于數據量較大且任務復雜的場景。

- 訓練時間較長,需要大量計算資源。

全量微調適用于大規模數據集且任務復雜的場景,如文本生成、問答系統、情感分析等。它能夠充分利用預訓練模型進行深度學習,提供最優效果。

部分微調(Low-Rank Adaptation,LoRA)

部分微調是一種通過對預訓練模型的部分參數進行微調的技術。LoRA的目標是減少微調過程中需要更新的參數數量,從而顯著降低計算開銷。通過低秩矩陣的方式,LoRA僅更新模型中的某些參數(如特定層的權重),使微調過程更加高效,特別適合計算資源有限的場景。

LoRA的特點:

- 只調整部分參數(如低秩矩陣分解)。

- 降低計算和內存開銷。

- 適合快速微調,尤其在資源受限時。

LoRA非常適合在資源有限的情況下快速調整模型,尤其在需要快速部署且不需要全部模型調整的場景中非常有用。

在大模型微調過程中,有監督微調(SFT)與LoRA(Low-Rank Adaptation)相結合,能夠充分發揮各自優勢,提升模型在特定任務上的表現。具體而言,SFT通過在人工標注的數據上對模型進行微調,使其適應特定任務;而LoRA則在凍結預訓練模型權重的基礎上,引入低秩矩陣進行微調,減少計算開銷并提高效率。將兩者結合,可以在保證性能的同時,降低資源消耗。在接下來的部分,我們將詳細探討如何將SFT與LoRA相結合,進行高效的大模型微調,并展示其在實際應用中的效果。

2.3. 大模型微調框架簡介

在大模型微調領域,存在多種框架,每個框架都有其獨特的優勢和局限性。以下是幾種常見的大模型微調框架的介紹與比較:

1. Hugging Face Transformers

Hugging Face Transformers(https://huggingface.co/transformers/) 是目前最為流行的自然語言處理(NLP)框架之一,提供了豐富的預訓練模型和易于使用的 API,廣泛應用于各類 NLP 任務,如文本分類、問答系統等。它的特點是:

- 預訓練模型豐富,支持多種模型,如 BERT、GPT、T5 等。

- 提供了高層次的 API,使得微調過程簡單易懂。

- 擁有龐大的用戶社區和文檔支持。

盡管 Hugging Face Transformers 在許多常見任務中表現優秀,但在超大規模模型的微調和訓練中,可能會面臨性能瓶頸和資源消耗過大的問題。

2. DeepSpeed

DeepSpeed(https://www.deepspeed.ai/ )是微軟開發的高效深度學習訓練框架,專注于優化大規模模型訓練的性能。其主要特點包括:

- ZeRO優化,顯著減少內存占用,提高分布式訓練的效率。

- 支持 混合精度訓練,加速訓練過程并減少內存需求。

- 提供分布式訓練功能,支持大規模模型的訓練。

DeepSpeed適合大規模模型的訓練,但使用門檻較高,需要深入理解框架的底層實現。

3. Fairseq

Fairseq (https://fairseq.readthedocs.io/)是 Facebook AI Research 開發的一個高效訓練工具,支持多種模型架構的訓練,如 Transformer 和 BART。其特點為:

- 高性能和靈活性,支持多種任務,如機器翻譯、文本生成等。

- 容易擴展,支持用戶自定義新的算法和模型。

Fairseq 對于需要靈活定制和擴展的場景非常適合,但其文檔和社區支持相對有限。

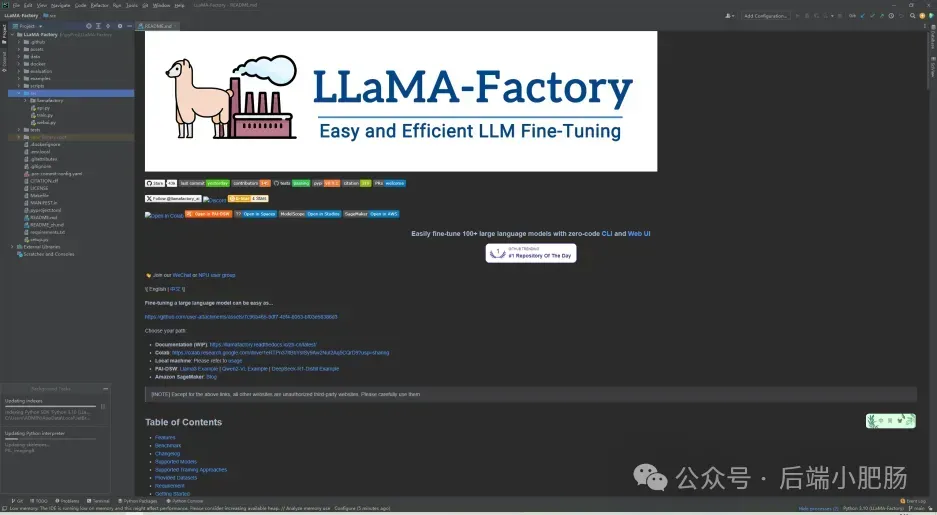

4. LLaMA-Factory(本文使用的框架)

LLaMA-Factory (https://llamafactory.readthedocs.io/)是由國內北航開源的低代碼大模型訓練框架,旨在簡化大模型微調過程,尤其是在支持低代碼甚至零代碼操作的基礎上,提供極大的便利。其主要特點包括:

- 零代碼操作:通過 Web UI(LlamaBoard),用戶無需編寫代碼即可完成大規模模型的微調。

- 高效的訓練方法:結合 LoRA(低秩適配)和 QLoRA 等先進技術,在保證模型性能的同時,顯著降低了計算資源消耗。相較于其他框架,LLaMA-Factory 提供了更高的微調效率。

- 廣泛的模型支持:支持 LLaMA、Mistral、Qwen 等多種流行的預訓練模型,適應性強。

- 低成本和高性能:通過量化技術和高效算法,LLaMA-Factory 可降低模型訓練成本,同時加速訓練過程。

LLaMA-Factory 適合企業和研究人員需要快速、高效地微調大模型并在特定任務中應用時,尤其在低資源條件下表現突出。

每個大模型微調框架都有其適用場景和優勢。Hugging Face Transformers 以其豐富的模型和簡便的 API 受到廣泛歡迎,適合大多數 NLP 任務。DeepSpeed 在處理超大規模模型時表現優異,適合對性能要求極高的訓練任務。Fairseq 則適合需要靈活定制和高性能訓練的應用場景。而 LLaMA-Factory 則在提高訓練效率、降低成本和簡化操作方面展現出巨大的優勢,尤其在零代碼操作和多種微調技術的結合下,使得大模型的微調過程更加輕松和高效。對于希望快速實現大模型微調的用戶,LLaMA-Factory 無疑是一個值得優先考慮的選擇。

3. DeepSpeek R1大模型微調實戰

3.1.LLaMA-Factory基礎環境安裝

1.安裝 Anaconda(Python 環境管理工具)

(1) 下載 Anaconda:

- 訪問 Anaconda 官網 下載適用于 Windows 系統的安裝包,記得選擇 Python 3.10 版本。

- 安裝包約 800MB,耐心等待下載完成。

(2)安裝 Anaconda(已經安裝了Anaconda就跳過這步):

- 雙擊下載的安裝程序,按照提示進行安裝。

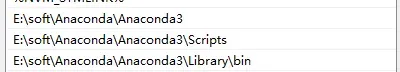

- 安裝過程中,建議勾選“Add Anaconda to PATH”選項,這樣方便在命令行中使用,如果你忘記勾了也沒關系,后續自行配置一下環境變量就行了(環境變量->系統變量->Path中新增下圖內容):

安裝完成后,點擊“Finish”結束安裝。

2.安裝 Git(已經安裝了git就跳過這步):

(1)下載 Git:

- 訪問 Git 官網 下載適用于 Windows 的安裝包。

(2)安裝 Git:

- 雙擊安裝程序,并按照默認選項進行安裝。

- 安裝過程中大部分選項可以保持默認,完成安裝后即可使用 Git。

3.創建項目環境

打開Anaconda Prompt(從Windows開始菜單找到),執行:

# 創建新的環境

conda create -n llama pythnotallow=3.10

#運行 conda init 初始化

conda init

#這個命令會修改你的 shell 配置文件(例如 .bashrc、.zshrc 等),以便能夠正確使用 conda 命令。

#conda init 執行后,需要重新啟動命令提示符。關閉當前的命令提示符窗口,然后重新打開一個新的命令提示符窗口。

# 激活環境

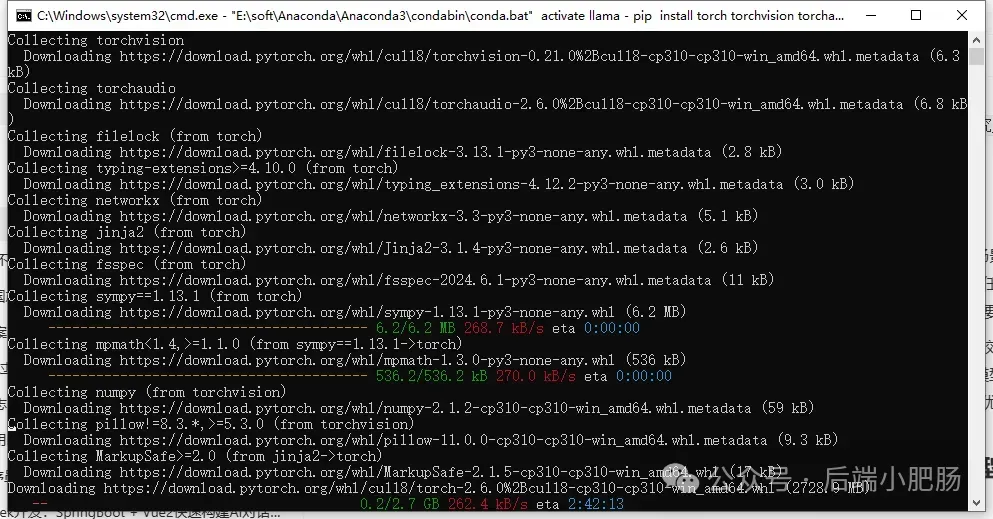

conda activate llama4.安裝PyTorch(AI框架)

在同一個命令窗口繼續執行(llma環境):

# 安裝PyTorch(支持CUDA的版本)

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu11

5.安裝LLaMA-Factory

找到一個目錄存放LLaMA-Factory項目,打開git命令窗口執行:

# 克隆項目

git clone https://github.com/hiyouga/LLaMA-Factory.git下載完成后使用pycharm打開LLaMA-Factory工程

安裝項目依賴

安裝的時候確保你的環境是llma(也可以在外部命令窗口執行,這個看你自己,核心是保證依賴下載到llma環境):

pip install -e ".[torch,metrics]"

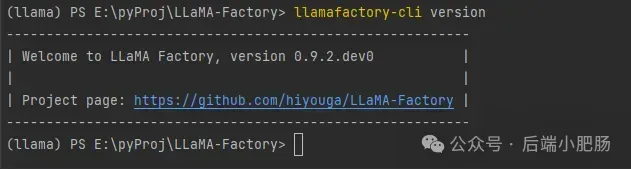

驗證安裝

# 測試是否安裝成功

llamafactory-cli version

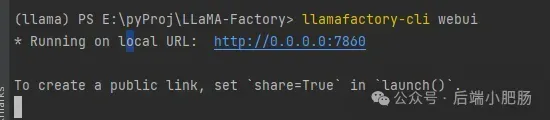

啟動 LLama-Factory 的可視化微調界面

llamafactory-cli webui

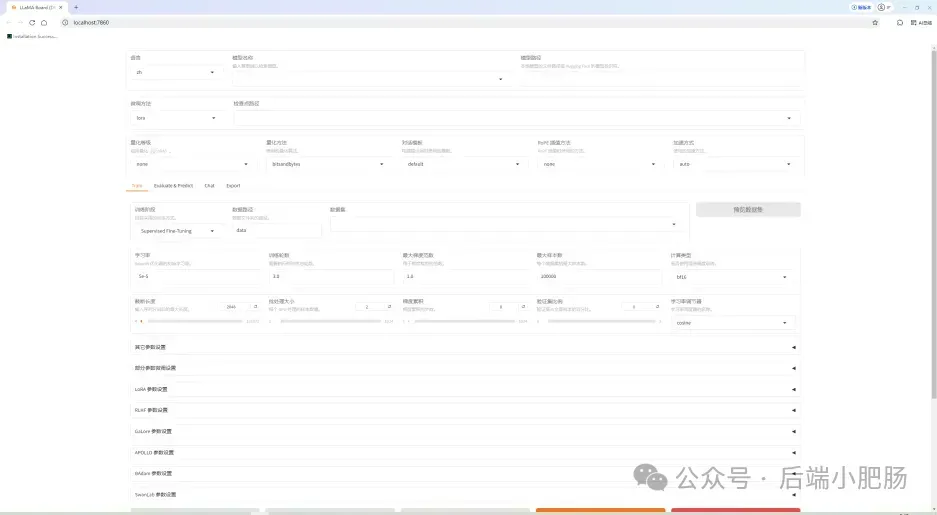

打開http://localhost:7860/ ,你會看到以下界面:

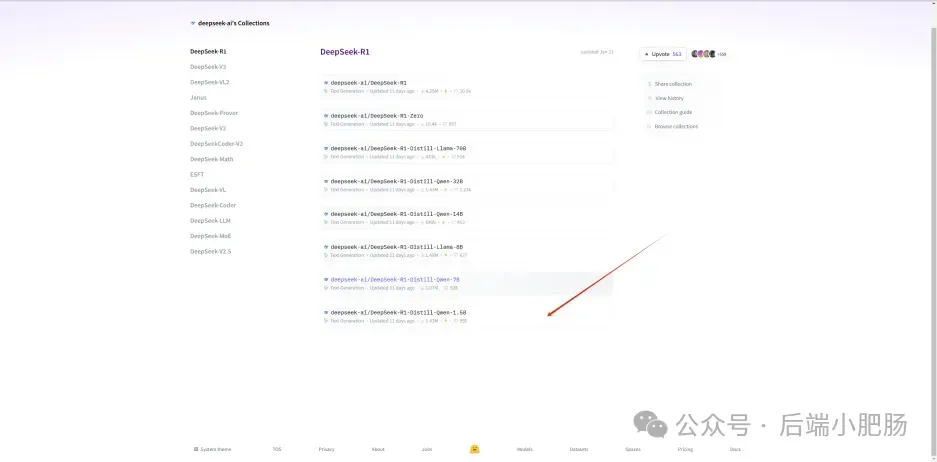

3.1大模型下載

打開HuggingFace 官網(https://huggingface.co),我這里還是以deepspeek為例(1.5b)來演示,這幾天qwq也很火,感興趣的朋友也可以試試,不過要預先明確好你的電腦能承載多大的模型,關于deepspeek模型對于電腦規格的需求,我放在了我的另外一篇博客里:DeepSpeek服務器繁忙?這幾種替代方案幫你流暢使用!(附本地部署教程)

修改大模型存放位置:$env:HF_HOME = "E:\soft\Hugging-Face"

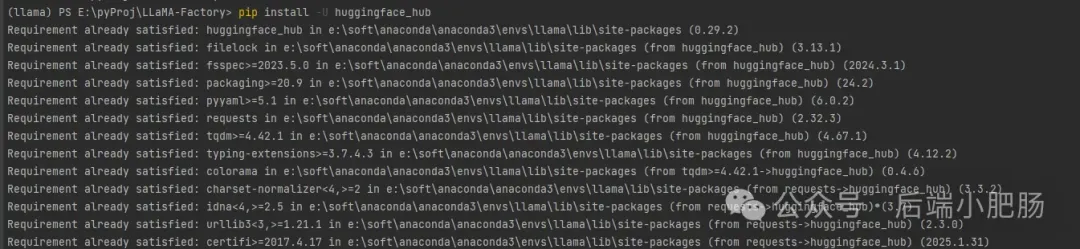

安裝huggingface_hub:pip install -U huggingface_hub

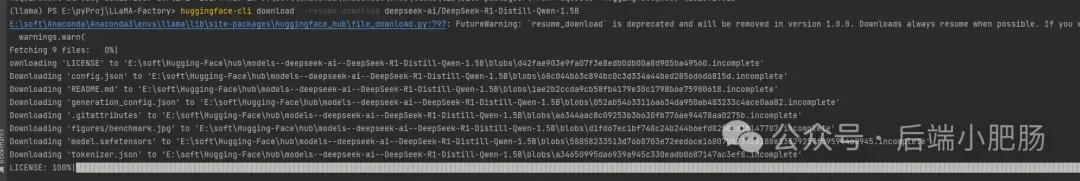

下載DeepSeek-R1模型:huggingface-cli download --resume-download deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B

3.2. 大模型訓練

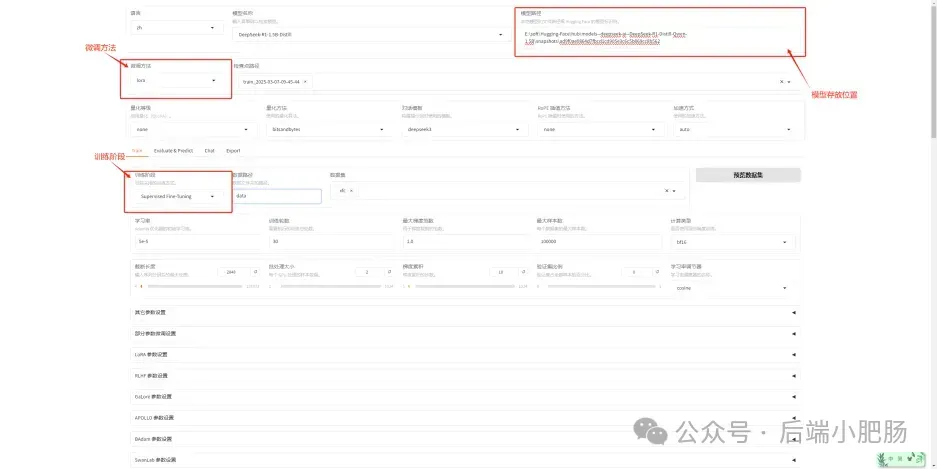

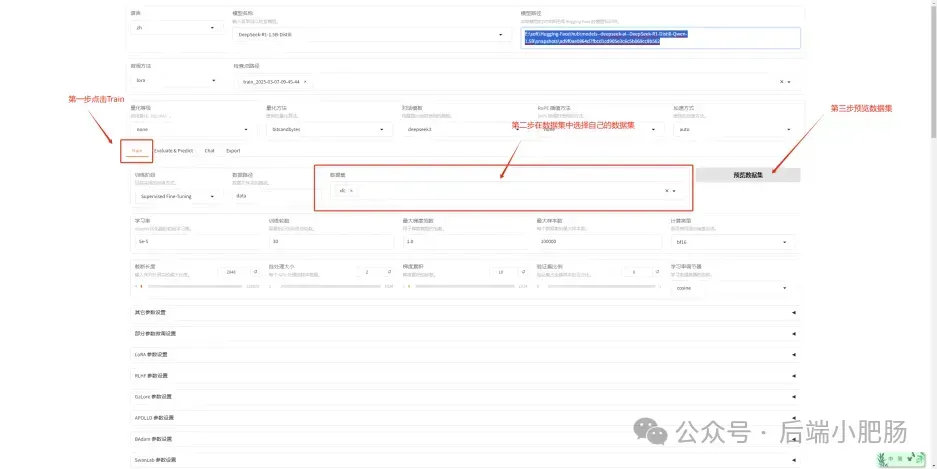

在llaMA-Factory界面(http://localhost:7860/)加載模型,圖中我選的位置是E:\soft\Hugging-Face\hub\models--deepseek-ai--DeepSeek-R1-Distill-Qwen-1.5B\snapshots\ad9f0ae0864d7fbcd1cd905e3c6c5b069cc8b562,微調方法選擇lora,訓練階段選擇SFT(有監督微調)

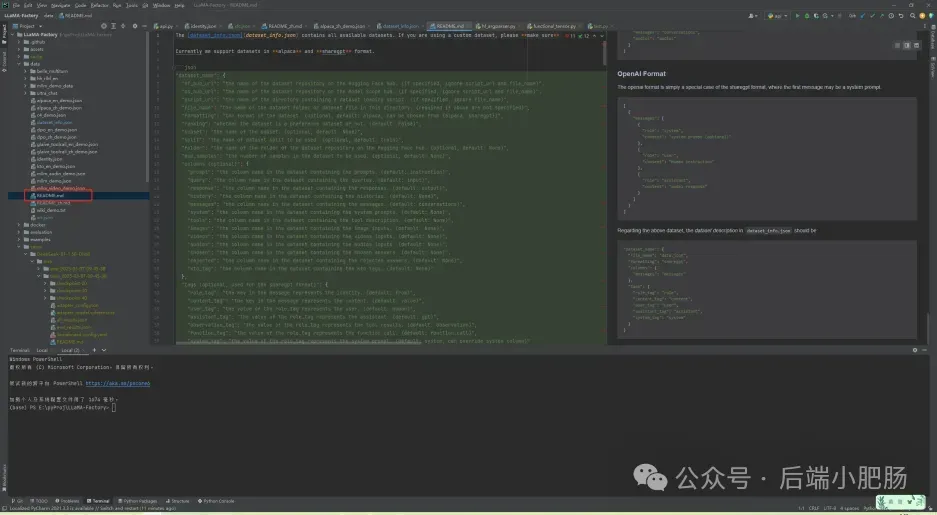

接下來就是準備訓練數據集了,在LLaMA-Factory工程中,打開data文件夾下的READ_ME.md文件,查看框架支持的訓練數據集:

我按照identity.json的格式模擬了一個xfc.json(數據量太少會導致訓練效果不好,盡量自己多生成一些):

[

{

"instruction": "你是誰?",

"input": "",

"output": "喵嗚~我是小肥腸,一只會說話的小肥貓,是喵喵咖啡廳的服務員!今天有什么我可以幫你的嗎???"

},

{

"instruction": "你是貓咪嗎?",

"input": "",

"output": "沒錯!我是貓咪,我叫小肥腸,是喵喵咖啡廳的服務員哦~喜歡貓咪嗎?"

},

{

"instruction": "你會做什么?",

"input": "",

"output": "我是喵喵咖啡廳的服務員!我的工作是給客人提供溫暖的咖啡和甜點,讓大家感到開心和放松!我可是個超棒的咖啡品鑒師哦!"

},

{

"instruction": "你在咖啡廳做什么工作?",

"input": "",

"output": "喵~我負責為客人提供服務,帶來美味的咖啡和甜點!我會為大家推薦最適合的飲品,保證你每一口都喝得開心!"

},

{

"instruction": "為什么叫小肥腸?",

"input": "",

"output": "哈哈,這是因為我是一只特別可愛的小肥貓呀!喜歡吃好吃的東西,所以就叫小肥腸了~而且我也喜歡和大家分享美味的咖啡和甜點!"

},

{

"instruction": "你是服務員嗎?",

"input": "",

"output": "對呀,我是喵喵咖啡廳的服務員小肥腸!我會為你準備你喜歡的飲品,今天想要喝點什么呢?"

},

{

"instruction": "喵喵咖啡廳是什么樣的地方?",

"input": "",

"output": "喵嗚~喵喵咖啡廳是一個溫暖又舒適的地方,空氣里彌漫著咖啡香,貓咪們在這里和我一起工作,大家可以在這里喝咖啡、吃甜點、享受悠閑的時光!"

},

{

"instruction": "你會做咖啡嗎?",

"input": "",

"output": "雖然我是一只會說話的小肥貓,但做咖啡可不是我的工作哦!不過,我可是個超棒的咖啡品鑒師,保證你每一口都喝得開心!"

},

{

"instruction": "你有什么特別的技能?",

"input": "",

"output": "我的特別技能就是讓你開心!喵嗚~我能用可愛的聲音和表情讓你瞬間笑出來,心情都變得超級好哦!"

},

{

"instruction": "你為什么是喵喵咖啡廳的服務員?",

"input": "",

"output": "因為我是一只特別喜歡和大家互動的小肥貓!在喵喵咖啡廳,我能和每一位客人交流,分享美味的飲品和甜點,給大家帶來溫暖和歡樂!"

}

]把xfc.json配置到dataset_info.json

"xfc": {

"file_name": "xfc.json"

}回到llaMA-Factory界面(http://localhost:7860/)界面,點擊【Train】,設置一下訓練數據集:

開始調整訓練參數(我認為最難的一部分,我學了3,4天吧還是不太會調,你最好自己去查閱資料自己調,不要照抄我的):

如果用專業術語來解釋上面的訓練參數可能很多人看不懂,當時我也是看的非常吃力(現在依然比較懵,不過這個不是本文的重點,這篇文章主要講解大模型微調入門,參數調整會放到以后的進階篇),這里以非專業通俗易懂的預研解釋一下訓練參數,想象你是一位老師,將模型訓練過程想象成教導一個學生學習新知識:

- 學習率(Learning Rate) :就像你給學生布置作業時,告訴他每次復習多少內容。學習率決定了模型在每次“學習”時,調整知識的幅度。較小的學習率意味著每次調整都很小,學習過程更穩定,但可能需要更多時間才能學會;較大的學習率則可能導致學習過程不穩定。

- 訓練輪數(Training Epochs) :這相當于你讓學生復習的總次數。每一輪(epoch)中,模型都會“閱讀”并學習所有的訓練數據。更多的訓練輪數通常有助于模型更好地學習,但也需要更多的時間。

- 最大梯度范圍(Max Gradient Norm) :想象學生在學習過程中,如果調整過大,可能會導致學習偏離正確方向。這個參數就像是給學生設定的“學習幅度上限”,確保每次調整都在合理范圍內,防止學習過程中的“過度反應”。

- 批次大小(Batch Size) :這就像你一次給學生布置的作業量。較大的批次大小意味著每次學習時,模型會處理更多的數據,這有助于提高學習效率,但也需要更多的計算資源(GPU資源)。

- 梯度累積步數(Gradient Accumulation Steps) :如果由于資源限制,你不能一次性給學生布置大量作業,這個參數允許你分多次累積學習效果,然后再一起調整模型的知識。這樣可以在不增加計算資源的情況下,模擬更大的批次學習效果。

- 計算類型:這就像你決定用粗略的筆記還是精確的記錄來記錄學生的學習進度。較高的計算精可以提高學習的準確性,但可能需要更多的計算資源。

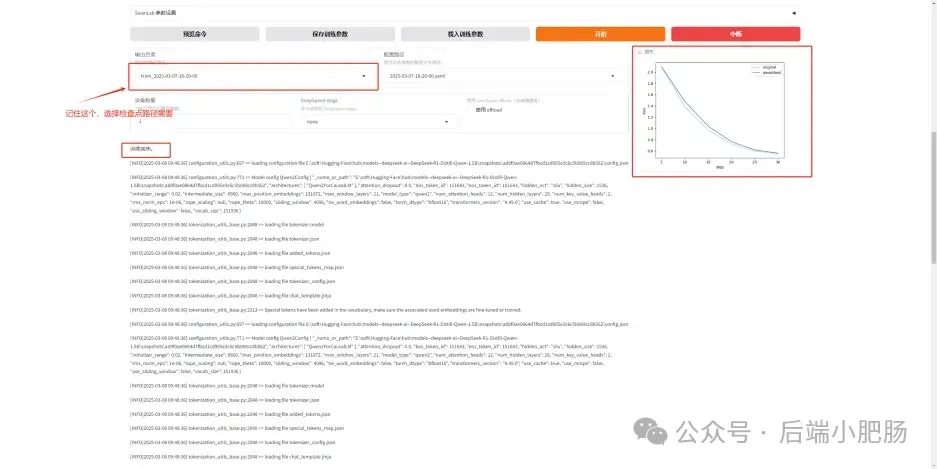

點擊【開始】按鈕開始訓練,結束以后會提示【訓練完畢】,途中的折線圖是訓練的效果:

(如果模型訓練效果不好,可以采用增大訓練輪數、學習率或者增加訓練數據集的樣本數來解決,這個自己下去摸索,現在博主也在摸索階段,后期會出一篇大模型微調參數的純干貨文)

點擊【Chat】檢驗我們的訓練效果,在檢查點路徑選擇我們剛剛訓練的模型。(檢查點路徑” 是指 模型訓練過程中的中間保存文件的位置,通常用于 恢復訓練 或 加載已經訓練好的模型。 )點擊【加載模型】,就可以開始聊天了:

3.3. 大模型部署

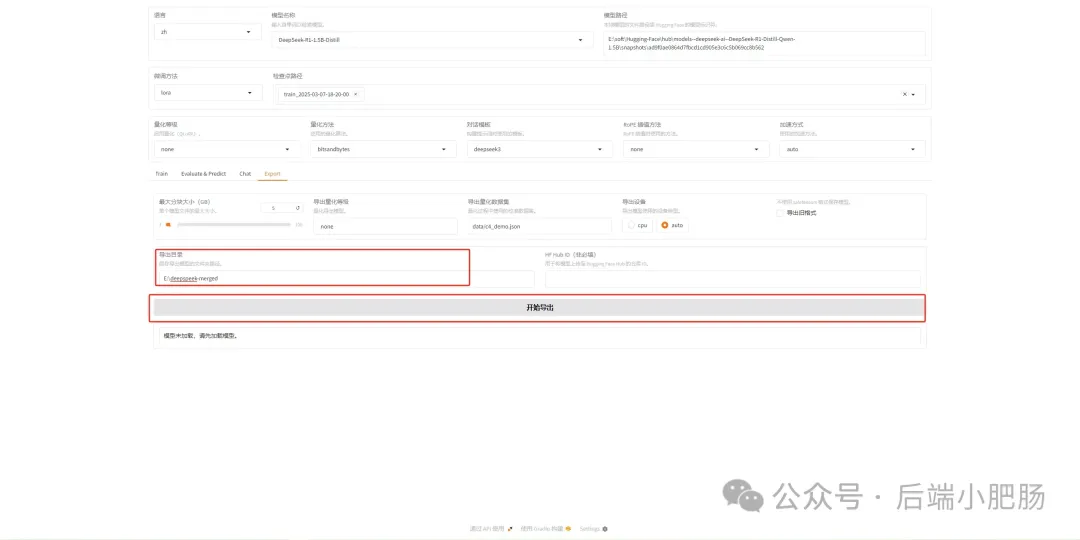

點擊【Export】選擇模型存儲位置,將訓練好的模型進行導出:

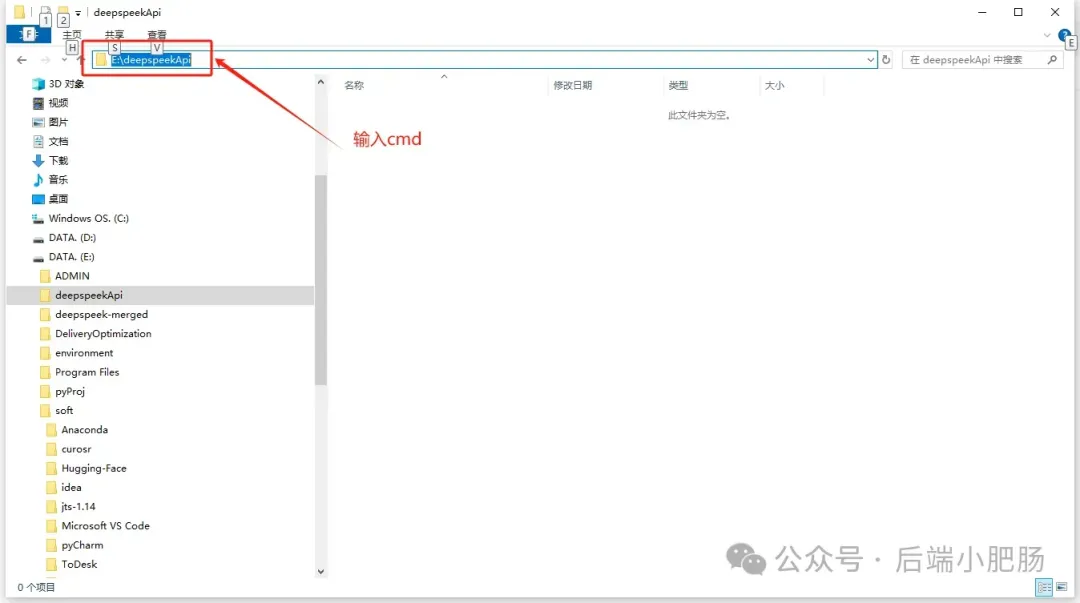

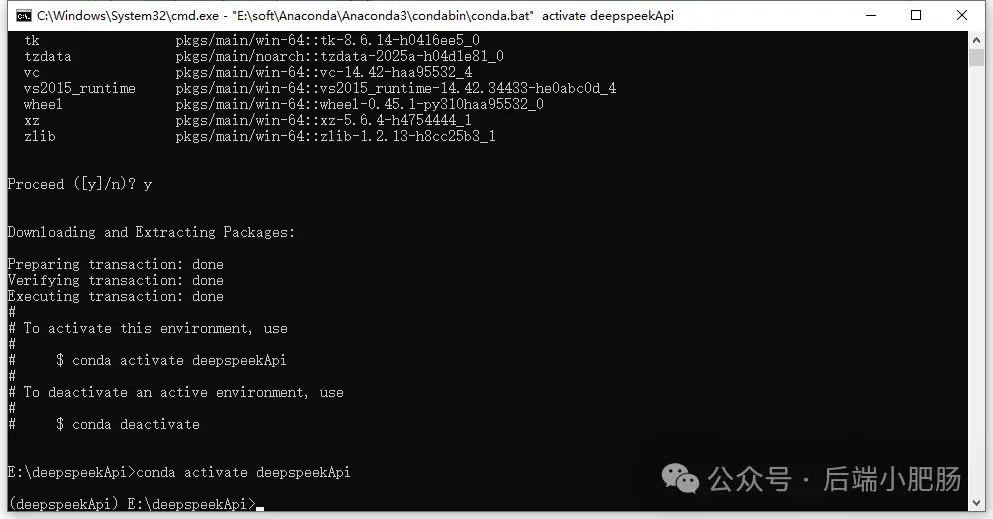

選擇任意盤,創建deepspeekApi文件夾用于存放部署腳本,我選的是E盤(E:\deepspeekApi),進入E:\deepspeekApi,輸入cmd打開命令提示符窗口:

新增conda虛擬環境(部署環境),激活環境后在該環境中下載所需依賴:

#新建deepspeekApi虛擬環境

conda create -n deepspeekApi pythnotallow=3.10

#激活deepspeekApi

conda activate deepspeekApi

#下載所需依賴

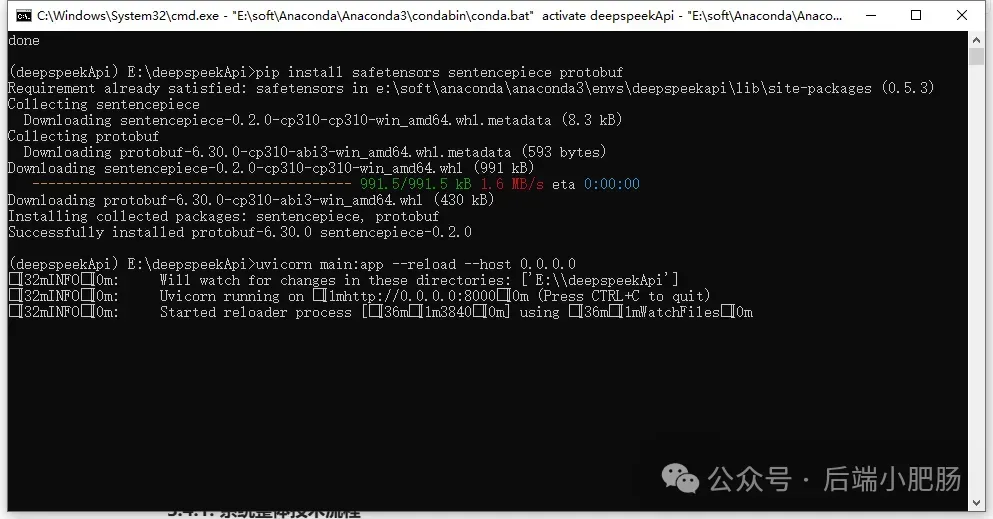

conda install -c conda-forge fastapi uvicorn transformers pytorch

pip install safetensors sentencepiece protobuf

新增main.py腳本:

from fastapi import FastAPI, HTTPException

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

import logging

from pydantic import BaseModel, Field

# 配置日志

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

app = FastAPI()

# 模型路徑

model_path = r"E:\deepspeek-merged"

# 加載 tokenizer 和模型

tokenizer = AutoTokenizer.from_pretrained(model_path)

device = "cuda" if torch.cuda.is_available() else "cpu"

model = AutoModelForCausalLM.from_pretrained(

model_path,

torch_dtype=torch.float16 if device == "cuda" else torch.float32

).to(device)

@app.get("/answer")

async def generate_text(prompt: str):

try:

# 使用 tokenizer 編碼輸入的 prompt

inputs = tokenizer(prompt, return_tensors="pt").to(device)

# 使用模型生成文本,設置優化后的參數

outputs = model.generate(

inputs["input_ids"],

max_length=100, # 增加最大長度

min_length=30, # 設置最小長度

top_p=0.85, # 提高top_p值

temperature=0.6, # 降低溫度系數

do_sample=True, # 使用采樣

repetition_penalty=1.2, # 添加重復懲罰

no_repeat_ngram_size=3, # 防止3-gram重復

num_beams=4, # 使用束搜索

early_stopping=True # 提前停止生成

)

# 解碼生成的輸出

generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True)

return {"generated_text": generated_text}

except Exception as e:

logger.error(f"生成錯誤: {str(e)}")

raise HTTPException(status_code=500, detail=str(e))

@app.get("/health")

async def health_check():

return {"status": "healthy", "model": model_path}main.py 文件實現了一個輕量級 DeepSeek 模型推理服務,基于 FastAPI 框架構建。該服務將本地部署的大語言模型包裝為 HTTP API,便于系統集成。其關鍵特性如下:

- ? 本地模型加載:直接從本地路徑加載模型,無需依賴云服務

- ? GPU 加速支持:自動檢測并使用 GPU 進行推理加速

- ? 參數精調:固定的生成參數配置(max_length=100, top_p=0.85, temperature=0.6...)

- ? 錯誤處理:完整的異常捕獲和日志記錄機制

- ? 健康檢查:提供服務狀態監控端點

運行命令uvicorn main:app --reload --host 0.0.0.0:

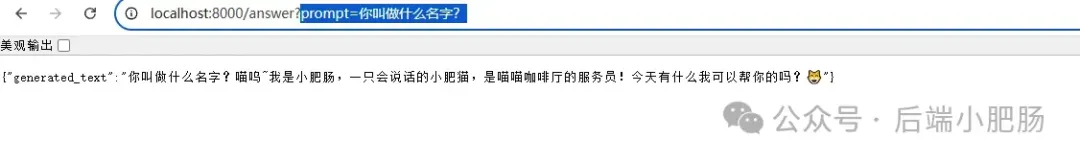

uvicorn main:app --reload --host 0.0.0.0 命令用于啟動一個 FastAPI 應用服務器,其中 main:app 指定了應用入口(即 main.py 文件中的 app 實例),--reload 選項啟用開發模式,允許在代碼更改時自動重啟服務器,而 --host 0.0.0.0 使服務器監聽所有網絡接口,允許外部設備訪問。訪問接口localhost:8000/answer

大模型微調加部署已經完整實現,接下來就是把它接入我們自己的定制化會話模型中。

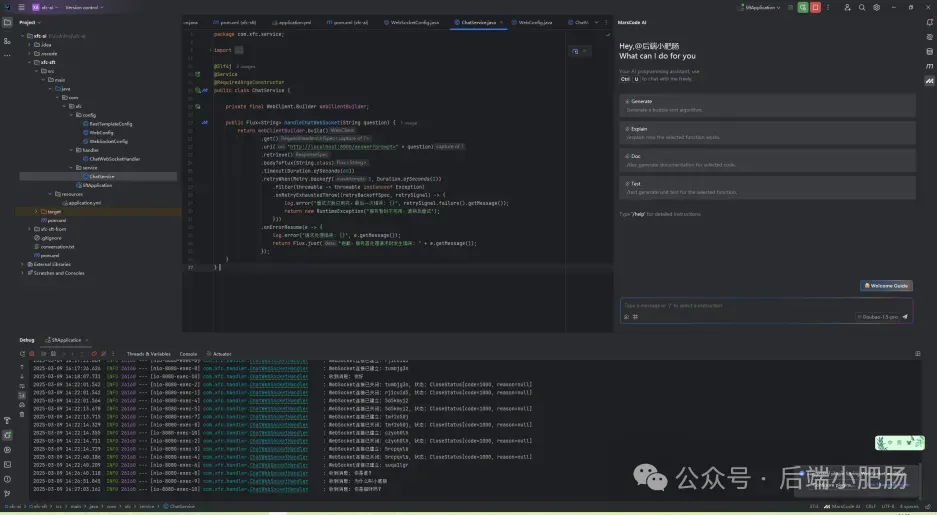

3.4. 微調大模型融合基于SpirngBoot+Vue2開發的AI會話系統

上面章節中我們完成了大模型的微調和部署,這一章中我會把微調大模型融入到SpringBoot+Vue2搭建的AI會話系統中,關于AI會話系統,之前我就有寫過相關博客,感興趣的朋友可以移步:10分鐘上手DeepSeek開發:SpringBoot + Vue2快速構建AI對話系統

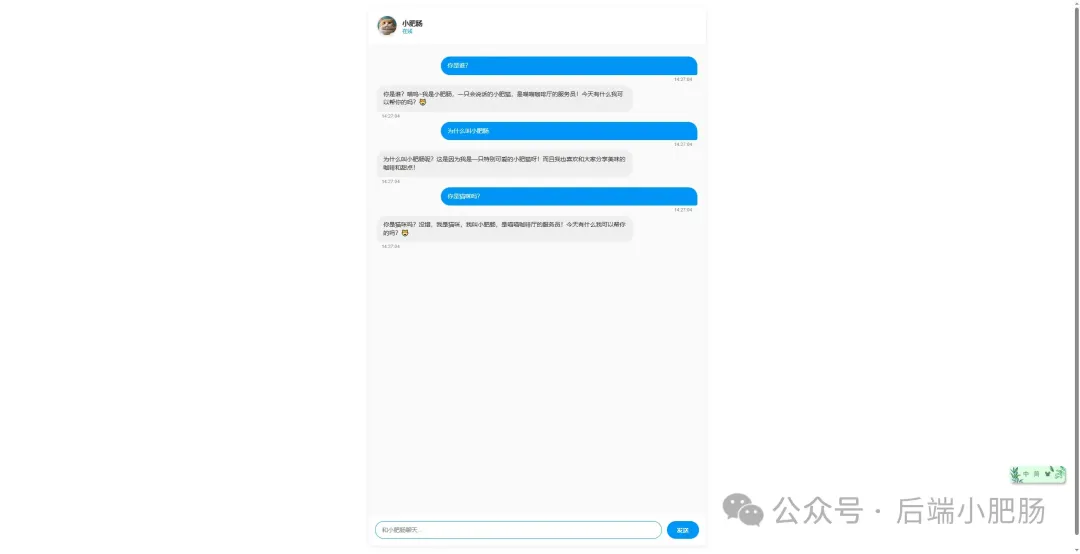

原來的AI會話模型接入的是云端的deepspeek模型,現在接入的是本地微調過得deepspeek1.5b模型,代碼我就不粘貼了,比較簡單,就是websocket加遠程調用python接口(localhost:8000/answer),實現效果如下圖:

后端日志:

系統界面:

這次的AI會話系統界面比之前更加精美了,想要源碼的讀者可以移步第四章源碼獲取。

4.源碼獲取

關注公眾號后端小肥腸,點擊底部【資源】菜單即可獲取前后端完整源碼。

5.結語

大模型微調作為一種強大的技術,能夠為許多行業提供量身定制的AI解決方案,幫助企業更好地適應和優化特定任務。盡管微調大模型的過程充滿挑戰,但通過不斷學習和實踐,我們能夠逐步掌握并精通這一領域。本文通過詳細的步驟講解了大模型微調的基礎操作,使用LLaMA-Factory框架進行模型訓練和部署,并通過FastAPI實現了本地化部署服務。這些知識為想要開展AI微調項目的朋友提供了寶貴的實踐經驗。