LLM 評估匯總:真的吊打 LLaMA-3,媲美 GPT-4 嗎?

一、背景

在過去的一年多里,國內在大模型領域的發展異常迅速,涌現出上百個大模型,許多模型已經迭代了多個版本,并且各種指標不斷刷新。與此同時,我們也經常在國內的一些文章中看到聲稱“吊打 LLaMA 3”或“媲美 GPT-4”的說法。那么,國內的大模型真的已經達到對標 OpenAI 的水平了嗎?

實際上,由于大模型的評估指標種類繁多,各種文章中所對比的模型也不盡相同,甚至有時會出現一些誤導信息。因此,我們決定系統性梳理一下公認性能較強的大模型的相關指標,以全面了解各種模型的能力。

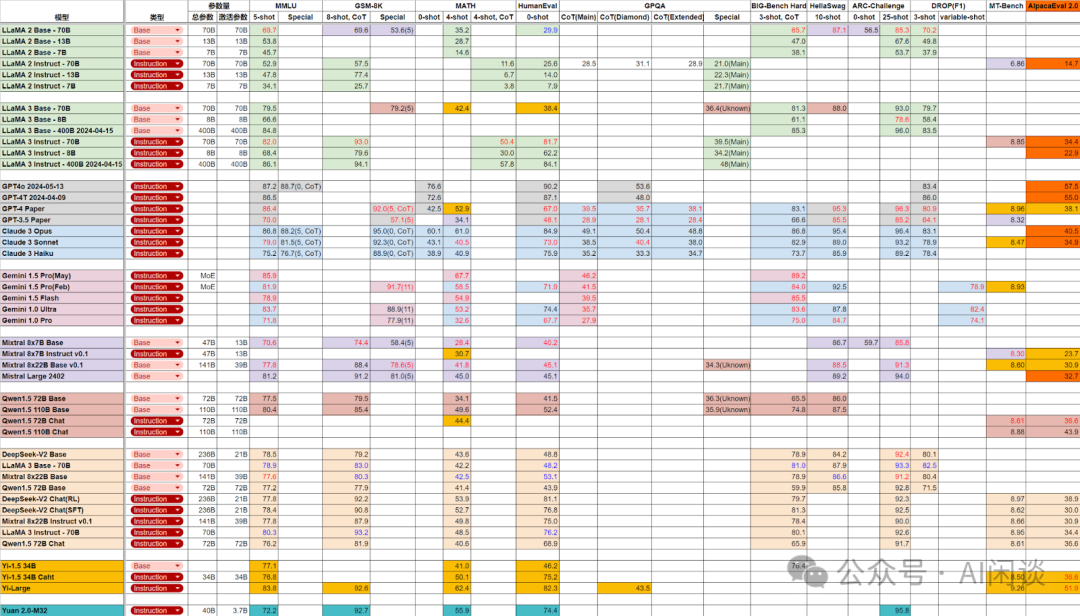

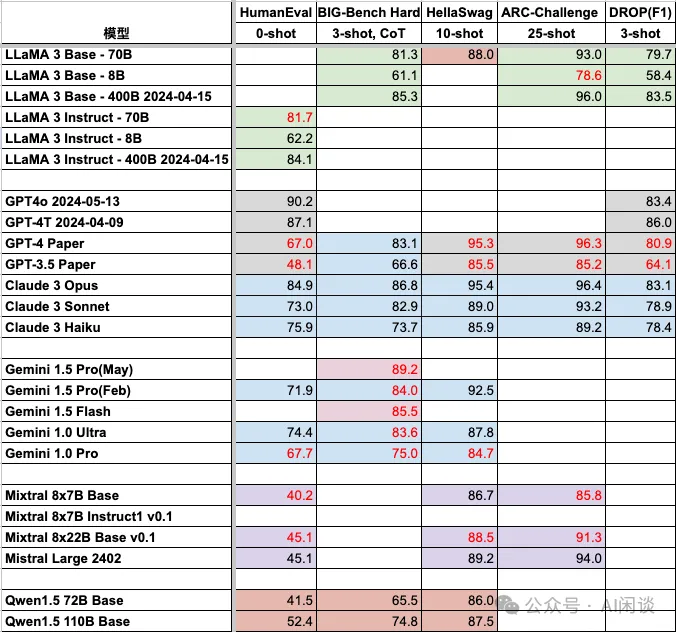

如下圖展示了我們梳理的一部分常見文本類基準評估指標(圖中的不同底色表示數據來源,比如淡綠色表示數據來自 LLaMA 3 官方,淡藍色表示數據來自 Claude 3 Paper,灰色表示來自 OpenAI 官方,淡紫色表示來自 Mixtral 官方等)。需要說明的是,這僅僅是部分常見指標,也并未涉及多模態基準評估。此外,由于數據比較多,且來源繁雜,難免會有遺漏或錯誤的地方,歡迎指出和糾正。本文中,我們也會簡單介紹在收集這些數據時發現的一些問題,遇到的困惑,以及具體數據的來源,以便大家也能更準確的分辨各種大模型的能力。

二、引言

2.1 評估指標

常見的文本任務評估指標包括如下幾個:

- MMLU:通用知識和推理能力。

- MATH:數學解決問題能力。

- GSM8K:小學數學。

- HumanEval:Python 編碼任務。

- GPQA:大學生物、物理和化學問答。

- DROP:閱讀理解和算術。

- Big-Bench-Hard:綜合評估。

- ARC-Challenge:常識推理。

- HellaSwag:常識推理。

- AGIEval:大學入學考試和資格考試。

- MT-Bench:多輪對話基準測試。

- AlpacaEval 2.0:指令跟隨能力。

2.2 評估框架

Harness 是 EleutherAI 開源的 LLM 評估框架,對應的代碼庫為:GitHub - EleutherAI/lm-evaluation-harness: A framework for few-shot evaluation of language models.。也是 Huggingface 官方 Open-LLM-Leaderboard (a Hugging Face Space by open-llm-leaderboard)后端使用的評估框架,在很多論文中被使用。

Helm 是斯坦福大學開發的 LLM 評估框架,對應的論文為:[2211.09110] Holistic Evaluation of Language Models,對應的代碼庫為:??https://github.com/stanford-crfm/helm??。其可以評估模型在 12 個方面的能力。

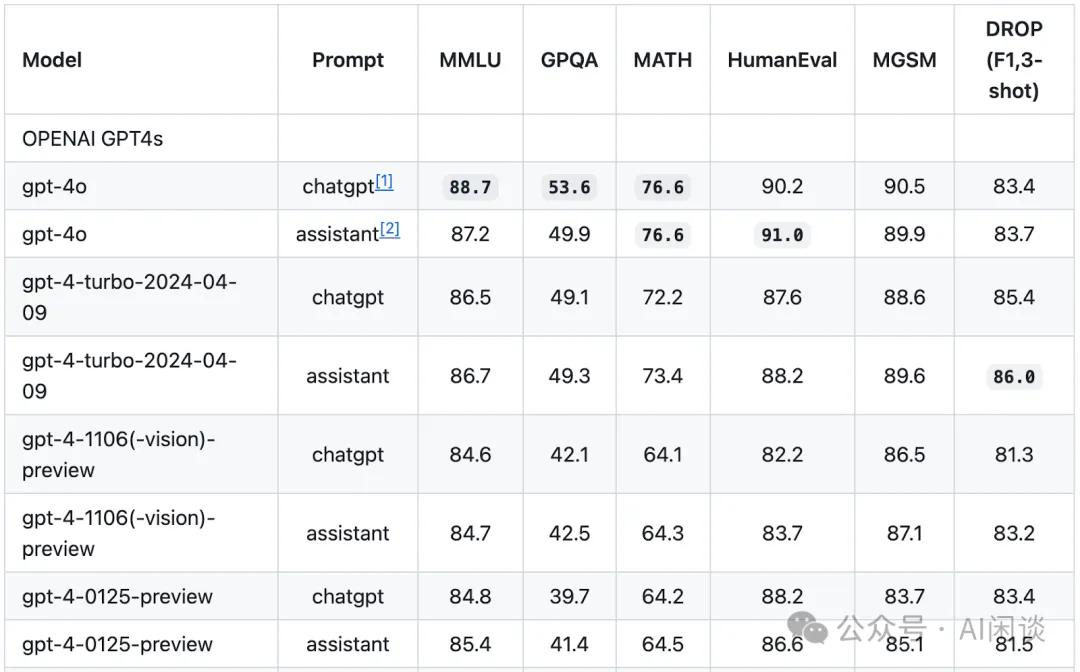

simple-evals 是 OpenAI 最近開源的針對幾個常見指標的評估工具 (GitHub - openai/simple-evals),也是其 GPT-4o 使用的評估工具。如下圖所示為其對應的評估結果:

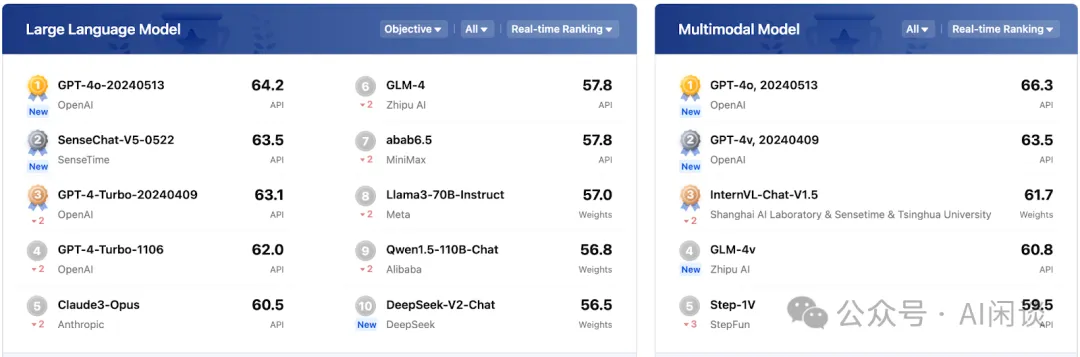

OpenCompass 是一個國內常用的評估框架,對應的代碼庫為:OpenCompass is an LLM evaluation platform, supporting a wide range of models (Llama3, Mistral, InternLM2,GPT-4,LLaMa2, Qwen,GLM, Claude, etc) over 100+ datasets.。其也提供詳細的 Leaderboard:OpenCompass司南。如下圖所示:

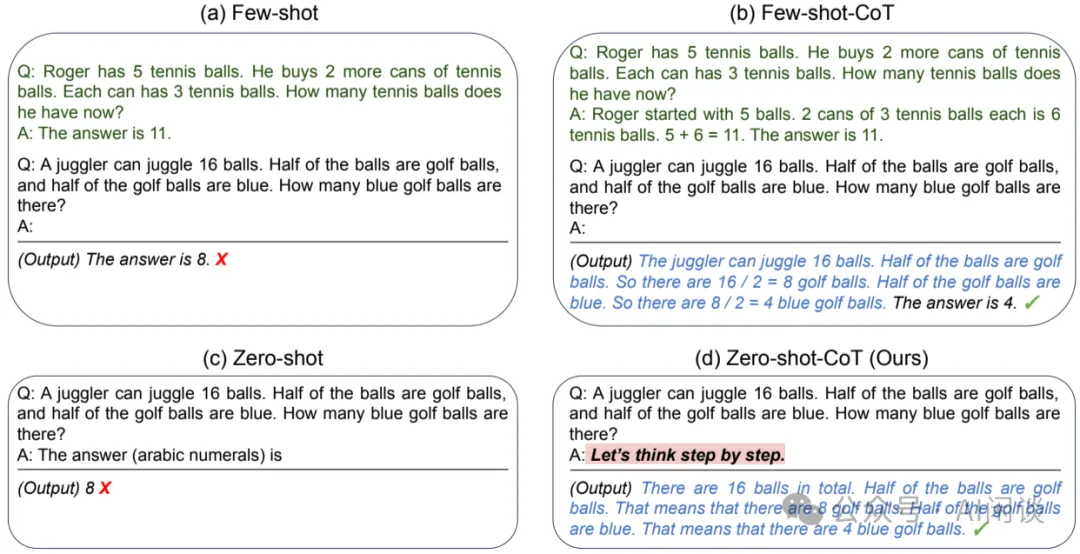

2.3 Few-shot & CoT

在評估中經常會使用 few-shot 和 CoT 方法,如下圖所示(圖片來自 [2205.11916] Large Language Models are Zero-Shot Reasoners)為 0-shot,few-shot 以及是否包含 CoT 的區別,簡單來說:

- few-shot就是表示 Prompt 中會提供一些示例,沒有示例表示為 0-shot,5 個示例為 5-shot。

- CoT就是在 Prompt 中會提供 CoT(Chain of Thought,[2201.11903] Chain-of-Thought Prompting Elicits Reasoning in Large Language Models),也就是推理過程。其中最經典的 CoT 為 “Let’s think step by step.”。?

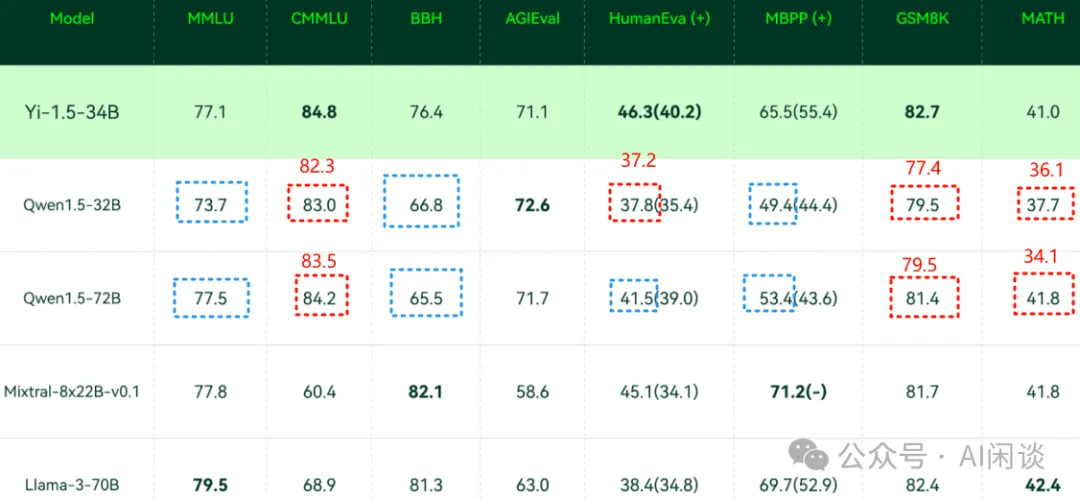

在基準評估中,為了公平對比,使用相同的配置才有參考價值。然而部分評估中并未清晰的列出對應的配置,如下圖所示分別為 Introducing Qwen1.5 | Qwen 官網上關于 Qwen1.5 和 零一萬物 上關于 Yi-1.5 模型的各種指標,很多都沒有明確指出對應的配置,導致部分指標無法對齊:

2.4 Base 模型 & Instruction 模型

現在有很多開源的 LLM 都會提供 Base 模型和 Instruction 模型,其中:

- Base 模型:是在大量未標注的通用文本數據上進行無監督訓練,比如網頁、書籍、代碼、新聞文章等。Base 模型適用于需要廣泛自然語言理解和生成的場景,但對具體的任務可能不如專用模型。

- Instruction 模型:通常是在 Base 模型基礎上,使用經過人工標注或篩選的指令數據通過有監督微調訓練而來。這些數據的質量通常很高,而且有些時候會針對特定場景。這類模型更適合需要特定指令進行操作的場景。

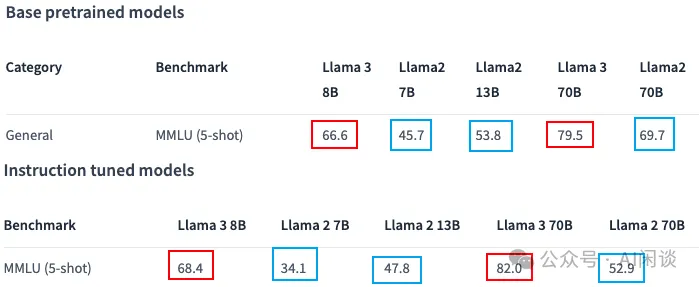

雖然 Instruction 模型也是基于 Base 模型微調,但是他們的評估指標可能會有比較大的區別,如下圖所示(meta-llama/Meta-Llama-3-70B · Hugging Face),對于 MMLU 指標:

- LLaMA 2模型的 Base 模型都比 Instruction 模型高,甚至差了 10 分以上。

- LLaMA 3模型的 Base 模型都比 Instruction 模型低。?

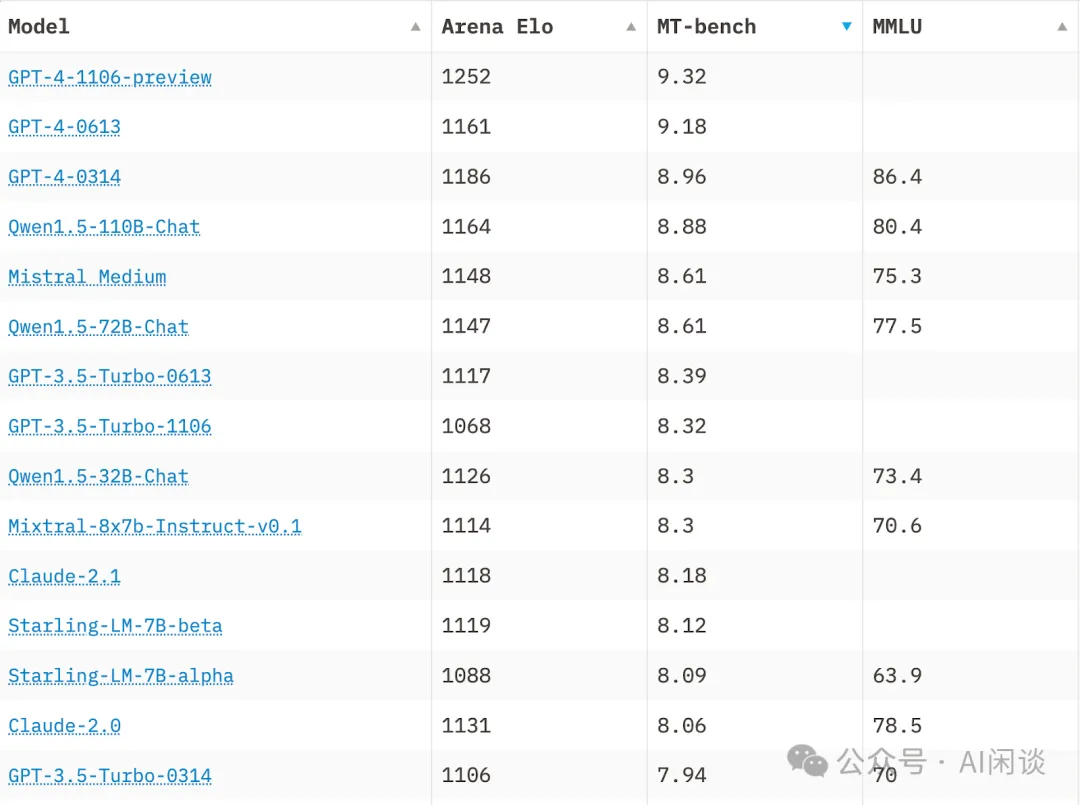

我們在收集數據的時候發現很多地方會混淆兩個模型的指標,比如經常看的 LMSys Chatbot Arena Leaderboard - a Hugging Face Space by lmsys 中就混淆了 Qwen1.5-110B 以及 Qwen1.5-72B 的 Base 模型和 Instruction 模型。參考 Qwen-1.5 的官方博客 Qwen1.5-110B:Qwen1.5系列的首個千億參數開源模型| Qwen,下圖中的 MT-bench 指標確實是 Qwen1.5-110B-Chat(Instruction)和 Qwen1.5-72B-Chat(Instruction)模型,但 MMLU 對應的是 Qwen1.5-110B(Base)和 Qwen1.5-72B(Base)模型:

2.5 不同模型版本

早期的 LLM 通常都會發布詳細的技術報告,包括具體版本和性能指標的說明。然而,最近的很多 LLM 僅以簡單的博客頁面形式發布,甚至缺乏對模型及其評估指標的詳細介紹,特別是一些閉源模型。這種變化為不同模型之間的橫向對比帶來了很大的挑戰。如下圖所示為 LMSys Chatbot Arena Leaderboard - a Hugging Face Space by lmsys 榜單,可以看出,排名前 12 的模型中,GPT-4 就有 4 個版本,Gemini-1.5 也有三個版本:

2.6 評估工具差異

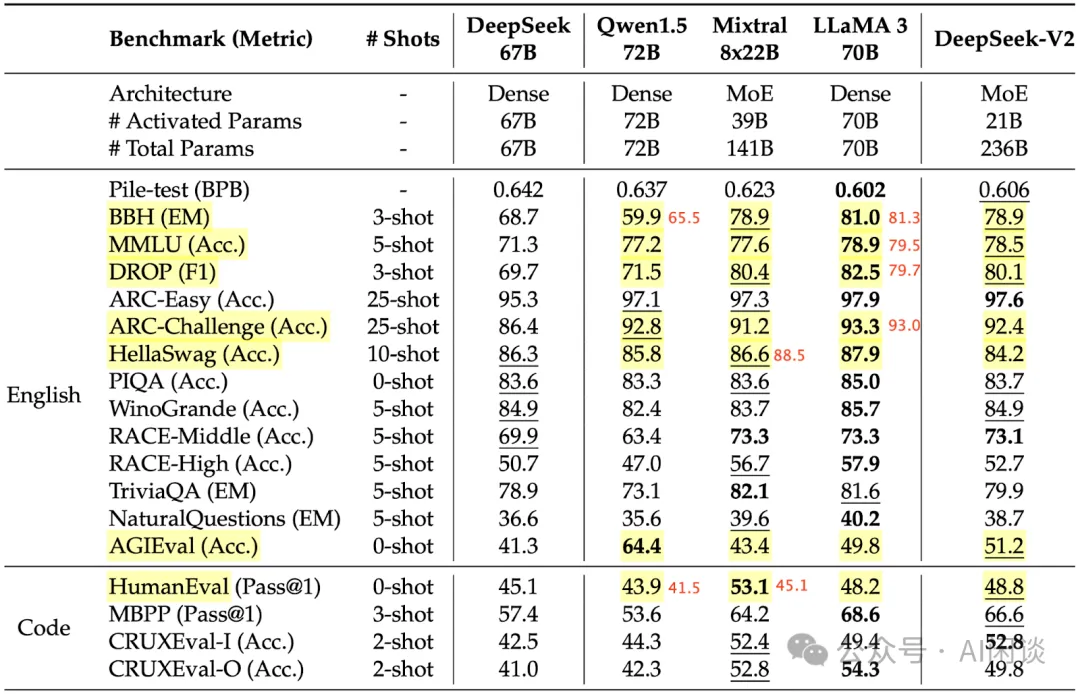

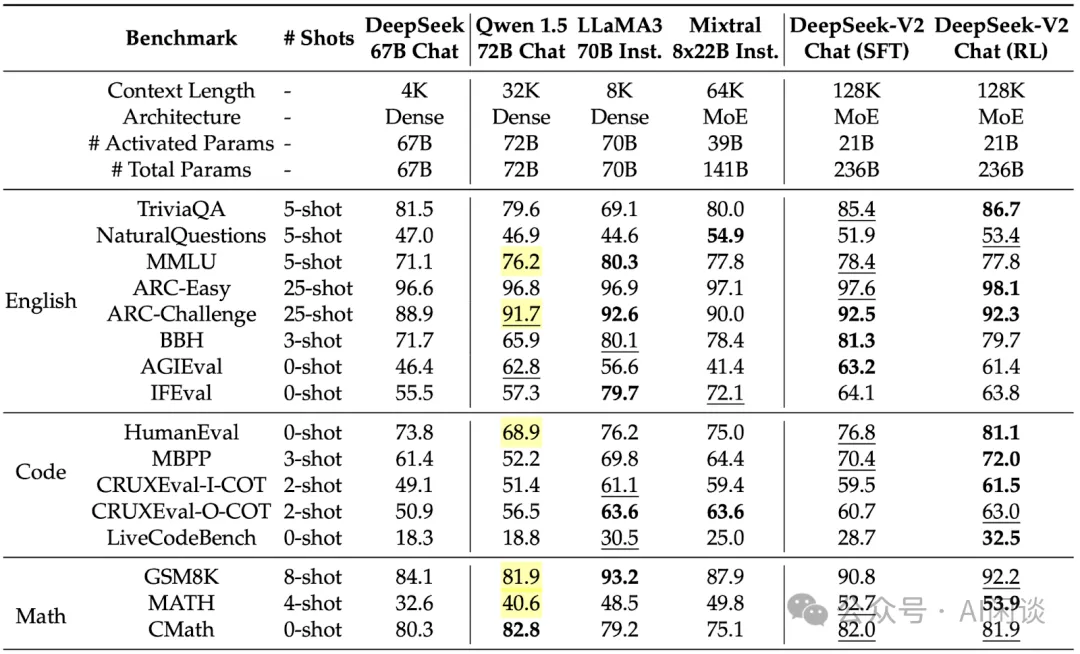

很多公司都有自己的評估工具,其有些時候不會和開源社區的評估方式完全對齊,導致評估指標的差異。比如在 DeepSeek-V2([2405.04434] DeepSeek-V2: A Strong, Economical, and Efficient Mixture-of-Experts Language Model)中,作者使用了內部評估工具,導致有些結果和我們從 Qwen1.5 72B、Mixtral 8x22B 和 LLaMA3 70B 官方報告中看到的結果不太一致,圖中紅色部分為相應的官方數據:

在浪潮的源 2.0-M32 [2405.17976] Yuan 2.0-M32: Mixture of Experts with Attention Router 中,作者也提供了 Qwen1.5-72B Chat 的結果,但是看著是直接引用了下圖所示 DeepSeek-V2-Chat 的結果。但是源 2.0-M32 中并沒有說明自己使用的評估工具。

2.7 數據污染

數據污染問題在大模型訓練中非常常見,沒有經過仔細的數據清理過程,很可能會在訓練集中混入部分基準評估數據。比如,OpenAI 的 GPT-4 Paper 中提到,其發現訓練集中不小心混入了 BIG-Bench 數據,所以 GPT-4 Paper 中并未提供 BIG-Bench Hard 的評估結果。

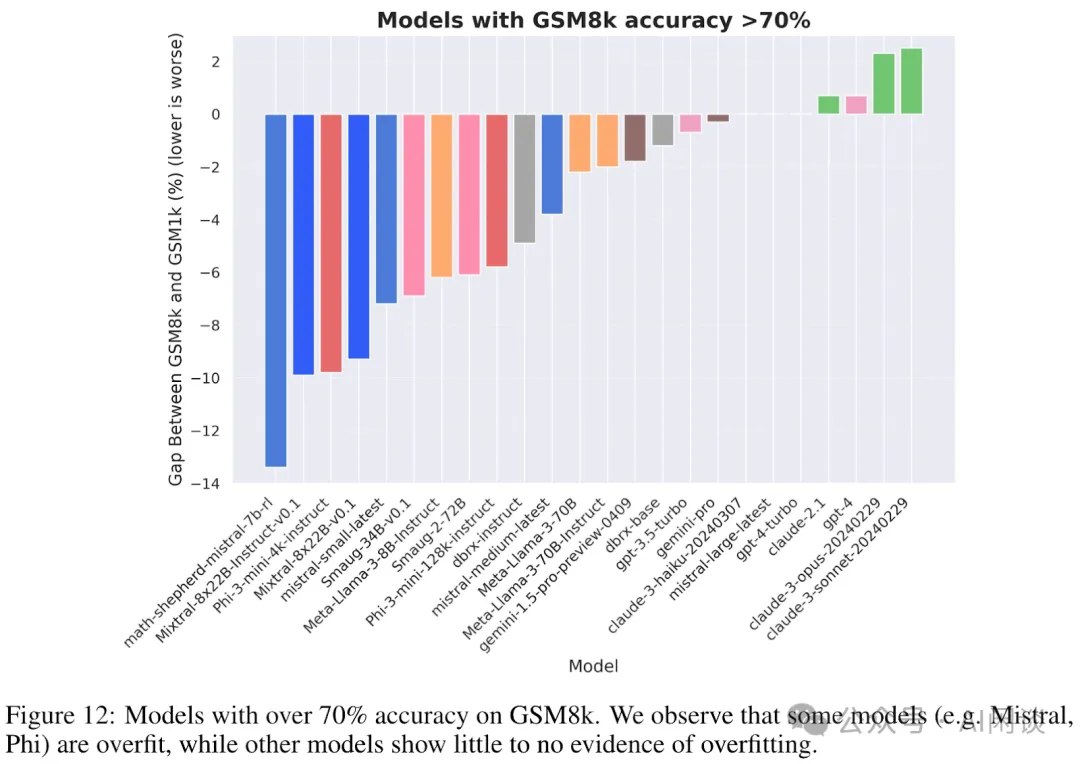

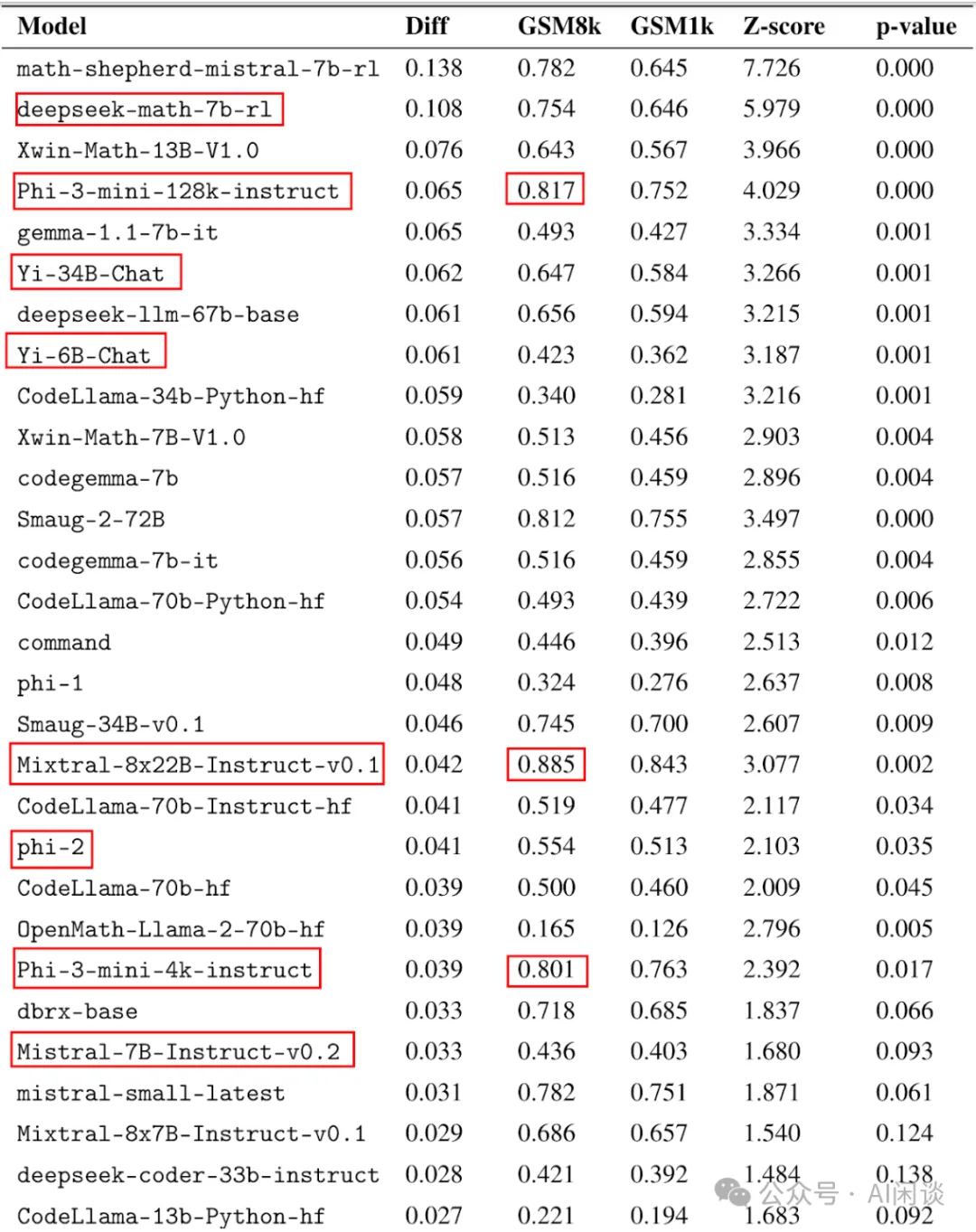

最近 Scale AI 的研究員研究了 GSM-8K 數據泄漏問題,對應的 Paper 為:[2405.00332] A Careful Examination of Large Language Model Performance on Grade School Arithmetic。作者通過人工標注方式構建了 GSM-1K 數據集,其難度與 GSM-8K 類似,包含 1250 道小學數學題。作者使用該數據集對一些開源和閉源 LLM 進行了基準測試,發現部分模型在 GSM-1K 上的性能甚至比 GSM-8K 低 10% 以上,比如 math-shepherd-mistral-7b-rl 指標低了將近 13%;而 Claude 3 和 GPT-4 模型指標沒有下降:

如下圖所示為部分詳細數據,可以看出其包含了多個我們常見的模型,甚至是微軟最近發布的非常強大的小模型 Phi-3:

三、MMLU

[2009.03300] Measuring Massive Multitask Language Understanding 評估集是為了衡量文本模型的多任務準確性,其涵蓋涵蓋人文科學(humanitities)、社會科學(social science)、自然科學(hard sciences)等領域的 57 個子任務,比如小學數學、美國歷史、計算機科學、法律等。題目都是多項選擇題,通過測試語言模型在不同領域的知識和推理能力來評估其綜合性能。

與其他語言理解評估集(如 GLUE、SuperGLUE 等)相比,MMLU 的任務種類更多,覆蓋面更廣,能夠更加全面地評估大規模語言模型的能力。這使得 MMLU 成為當前評估大規模預訓練語言模型的一個重要工具。幾乎每個 LLM 都會評估并對比其在 MMLU 基準上的能力,而且絕大部分都是評估 5-shot 能力,少量模型會評估 5-shot+CoT 能力,比如 The Claude 3 Model Family: Opus, Sonnet, Haiku。

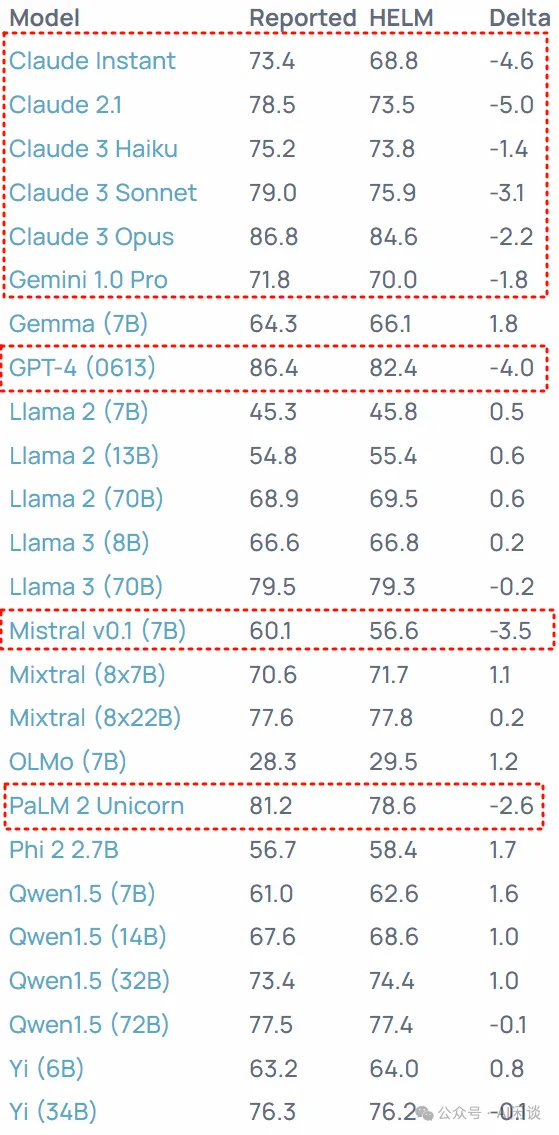

MMLU 指標相對比較統一,基本不會有太多歧義。然而,在 Massive Multitask Language Understanding (MMLU) on HELM 中,作者發現很多模型聲稱的 MMLU 指標和 Helm 中評估出來的有較大差距,如下圖所示:

四、GSM-8K

各種模型基本都會提供 GSM-8K 評估結果,但對應的評估結果比較混亂。比如,有些是 0-shot+CoT 結果,有些是 8-shot+CoT,有些是 5-shot+CoT,甚至有些是 11-shot。Google Gemini([2403.05530] Gemini 1.5: Unlocking multimodal understanding across millions of tokens of context) 之前被吐槽的一個點就是拿 GSM-8K 11-shot 的結果和其他模型 8-shot,5-shot 的結果對比。

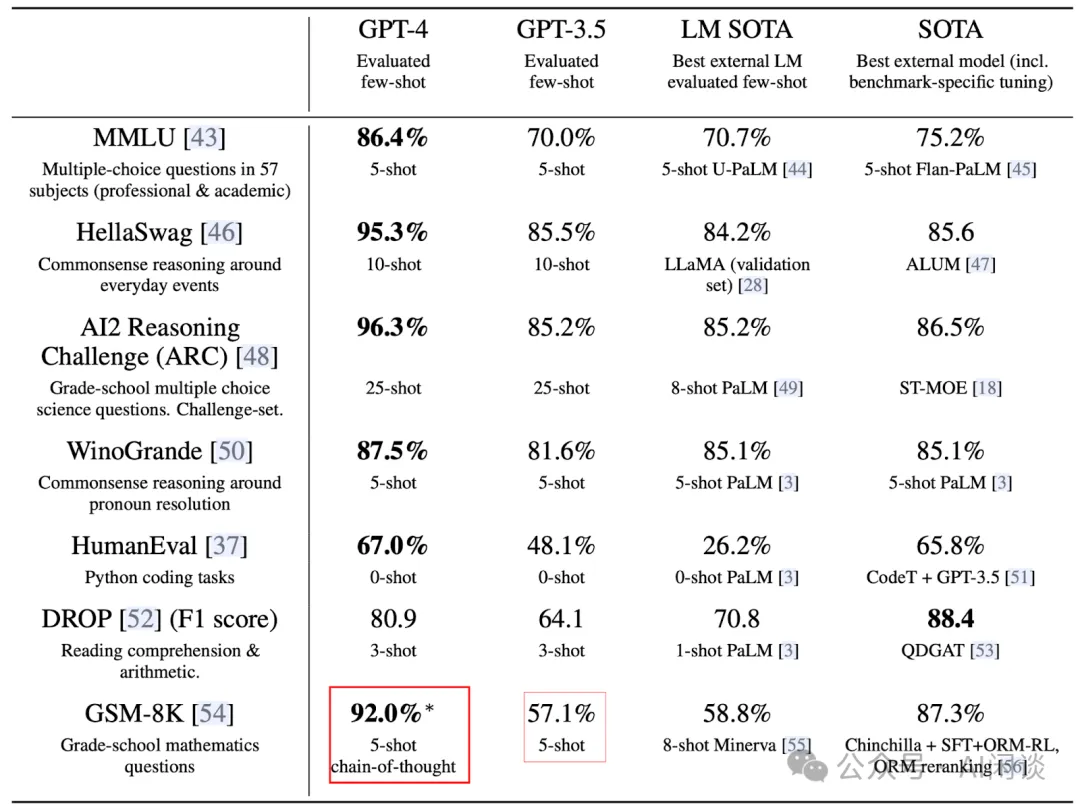

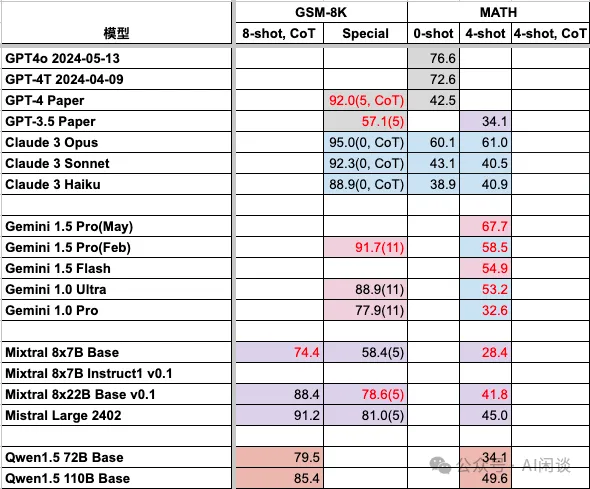

如下圖所示為 GPT-4([2303.08774] GPT-4 Technical Report)中的關鍵結果,可以看出其 GSM-8K 的 92.0 為 5-shot+CoT 的結果,而 GPT-3.5 的 57.1 為 5-shot 的結果:

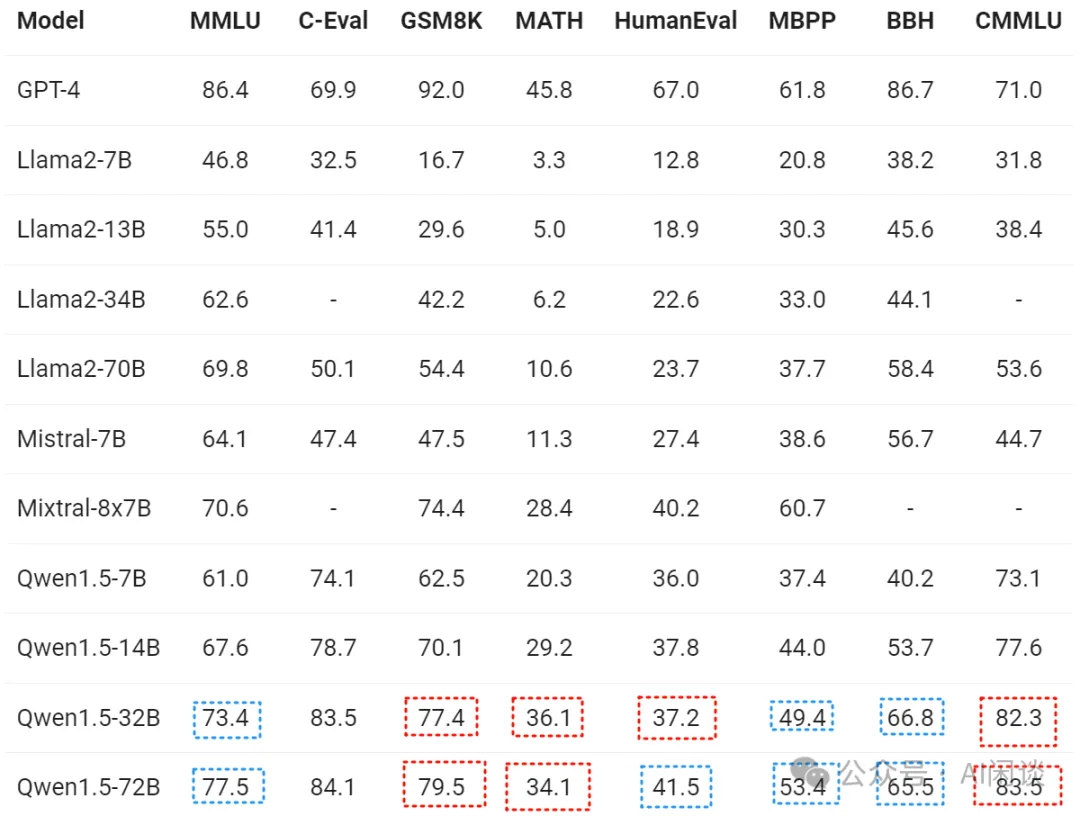

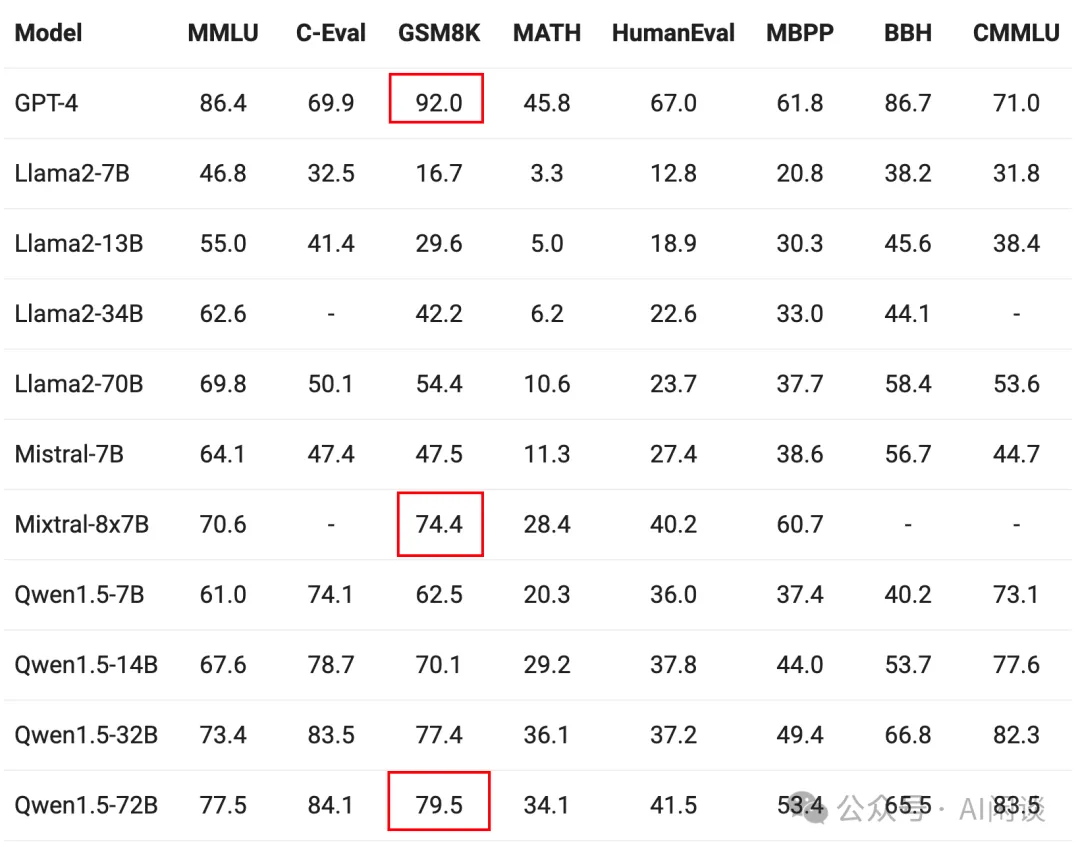

如下圖所示為阿里的通義千問 Qwen1.5 介紹 | Qwen 中的官方評估結果,其并沒有具體介紹 GSM8K 是 5-shot 還是 8-shot(不過從其開源的評估工具可以看出是 8-shot+CoT 的結果,具體可以參考 ??https://github.com/QwenLM/Qwen/blob/main/eval/gsm8k_prompt.txt??),但是對應的結果中 GPT-4 的 92.0 為 5-shot+CoT 結果,Mixtral-8x7B 的 74.4 確實為 8-shot+CoT 結果。

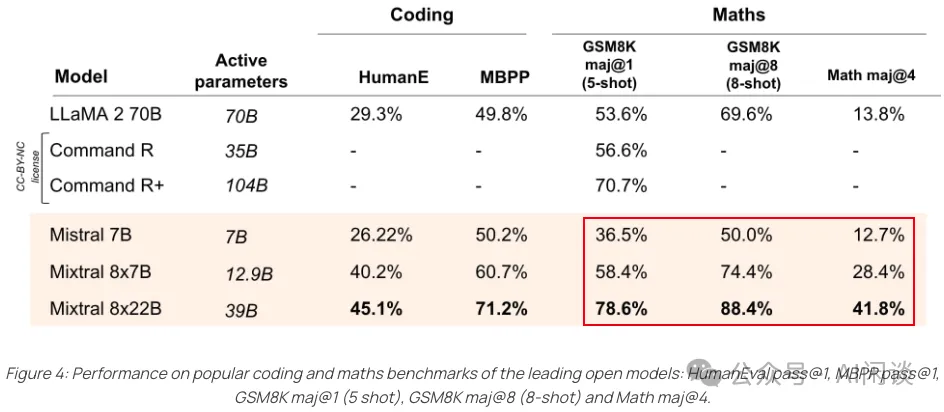

實際上 Mixtral 官方提供了相應 5-shot 和 8-shot 的結果,如下圖 Figure 4 所示(Cheaper, Better, Faster, Stronger | Mistral AI | Frontier AI in your hands)其 Mixtral 8x7B 的 5-shot 結果只有 58.4:

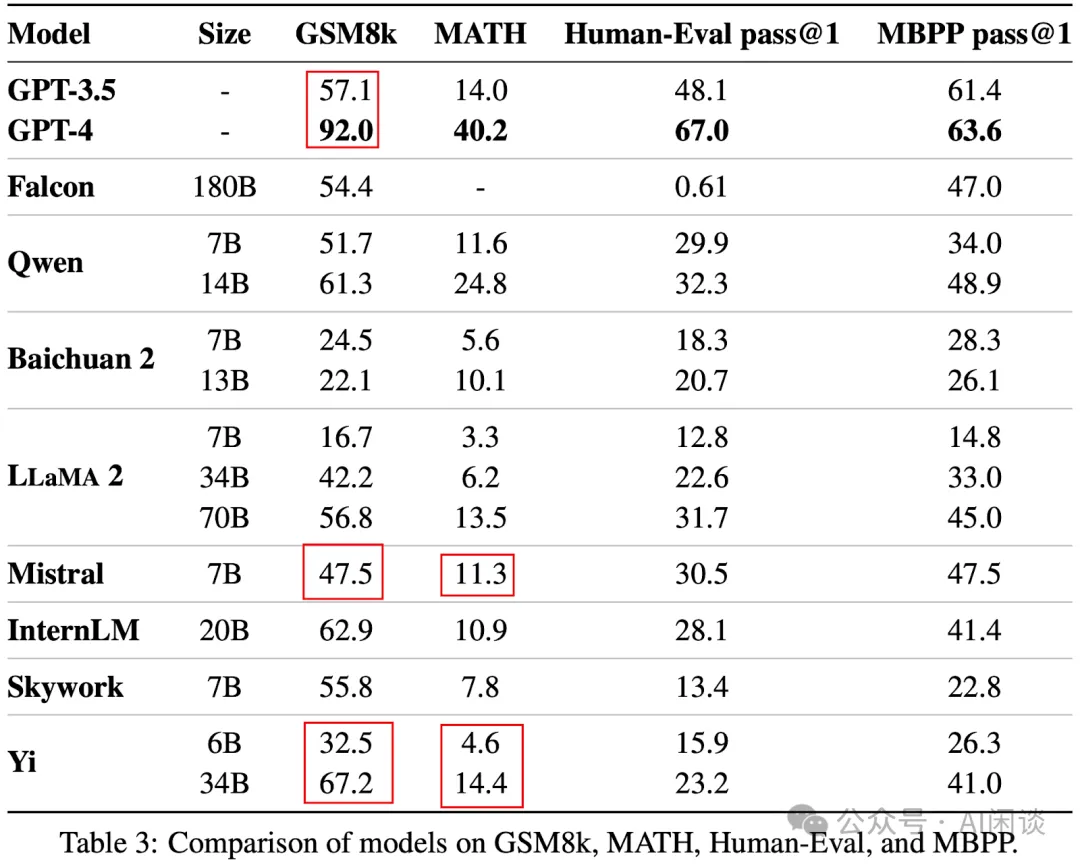

如下圖 Table 3 所示,零一萬物的 Yi 模型([2403.04652] Yi: Open Foundation Models by 01.AI)也存在同樣的情況,論文中介紹的是 GSM-8K 的 8-shot 結果,但是 GPT-3.5 和 GPT-4 的是 5-shot 的結果。此外 Mistral 7B 的 GSM-8K 和 MATH 結果也比上圖中 Mistral 的官方結果或者 [2310.06825] Mistral 7B 論文中的結果要低。

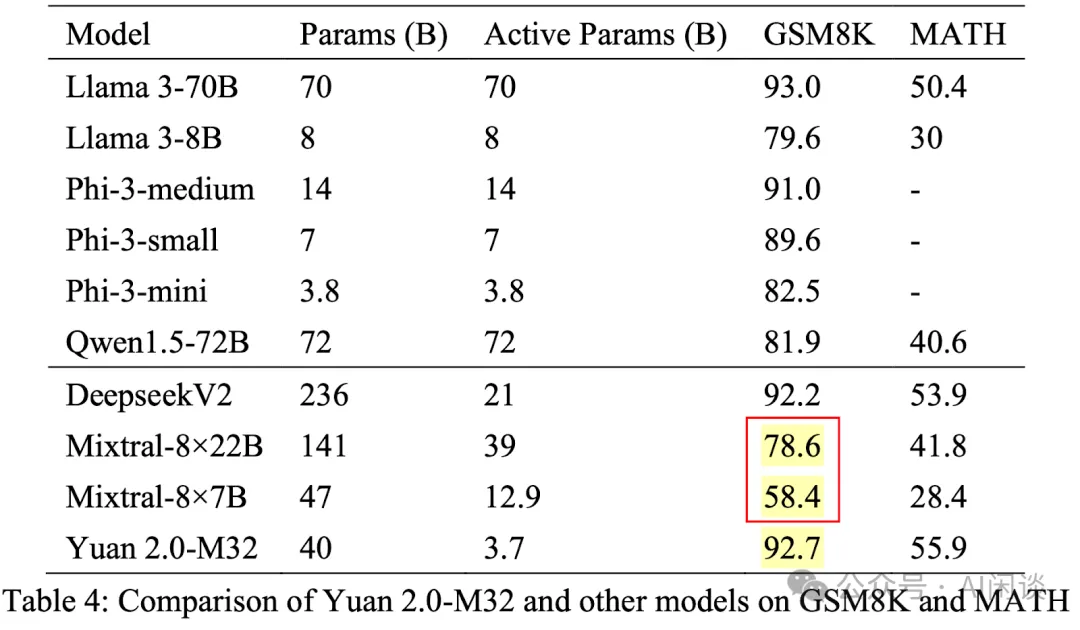

在浪潮的源 2.0-M32 [2405.17976] Yuan 2.0-M32: Mixture of Experts with Attention Router 中作者同樣將 8-shot 的 GSM-8K 結果與 5-shot 的 Mixtral-8x7B,Mixtral-8x22B 進行比較,實際上兩個模型對應的 8-shot 應該為 74.4 和 88.4:

五、MATH

MATH 的評估相對比較統一,基本上都是 4-shot 的結果,但是 GPT-4o,GPT-4T 相關結果都是 0-shot 的,具體也可以參考 OpenAI 的評估腳本 GitHub - openai/simple-evals,此外 Claude 3 同時提供了 0-shot 和 4-shot 結果,如下圖所示:

六、GPQA

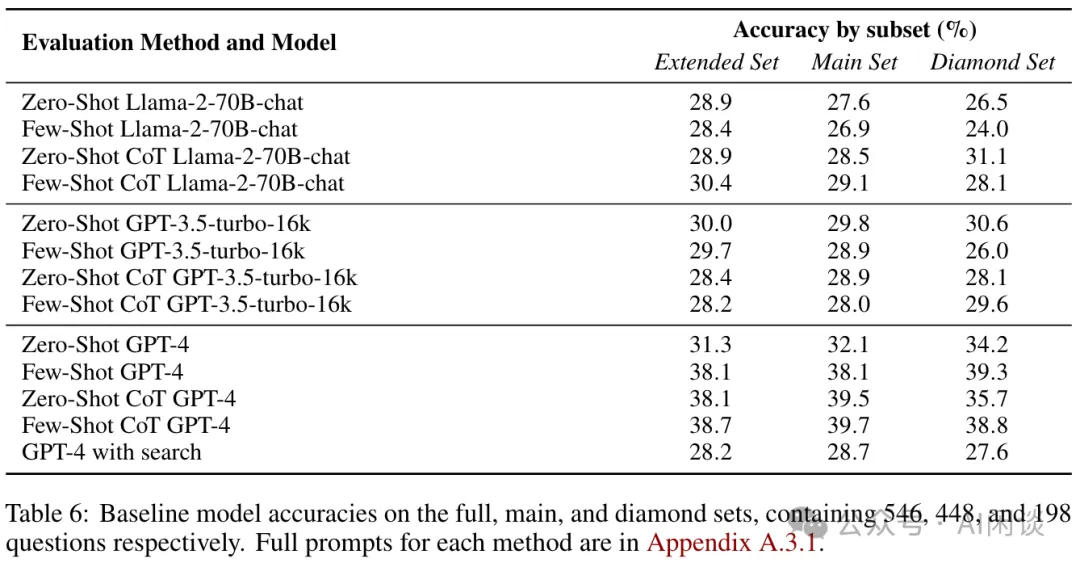

[2311.12022] GPQA: A Graduate-Level Google-Proof Q&A Benchmark 是一個比較新的評估集,是由生物、物理和化學領域的專家編寫的多項選擇題,問題的質量高且難度大。其全集 full(extended) 包含 546 個問題,main 和 diamond 是對應的兩個子集,分別包含 448 和 198 個問題。如下圖 Table 6 所示為作者針對 LLaMA-2-70B-Chat、GPT-3.5 和 GPT-4 的評估結果,可以看出,其也包含了 0-shot,0-shot+CoT,以及 few-shot+CoT 的配置:

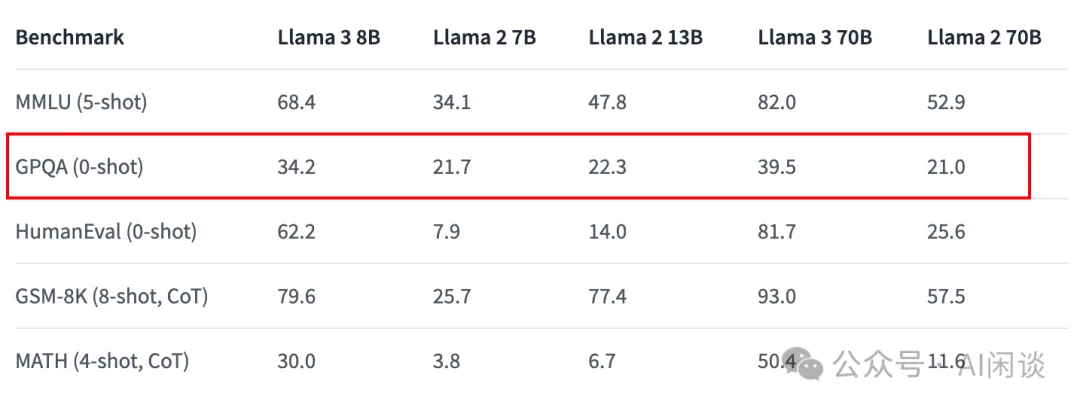

在 Meta 的 LLaMA-3 meta-llama/Meta-Llama-3-70B · Hugging Face 中,作者并未特別說明使用的哪個集合,只介紹其為 GPQA(0-shot),不過在 llama3/eval_details.md at main 中提到是 Main 集合,并且沒有說明使用 CoT,如下圖所示:

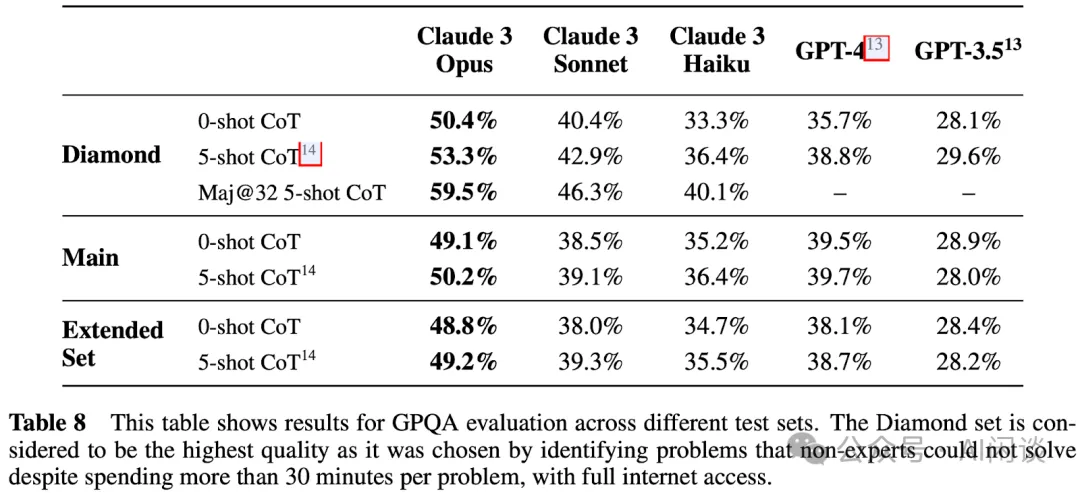

在 The Claude 3 Model Family: Opus, Sonnet, Haiku 中,作者給出了 Claude 3 在 3 個集合上詳細的評估結果:

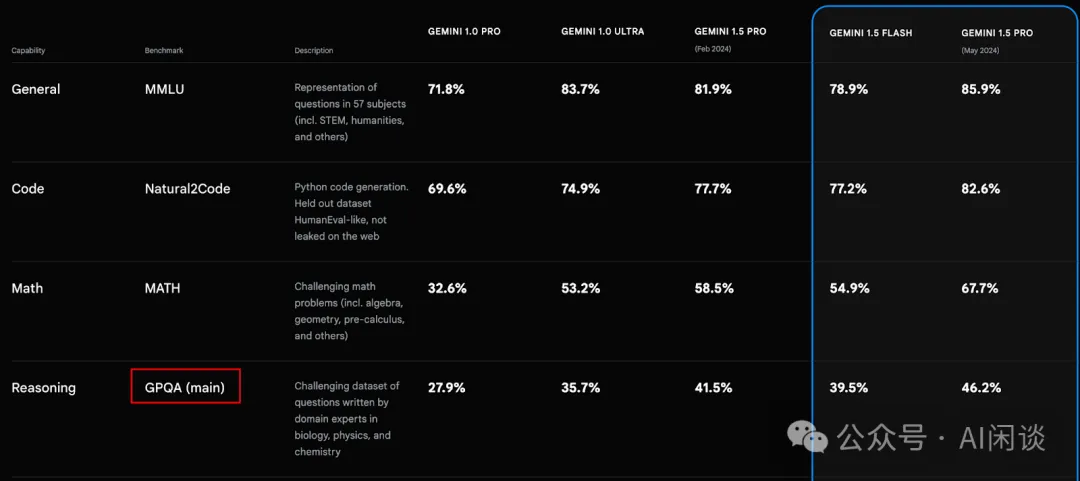

在 Gemini Pro - Google DeepMind 中,Google Gemini 提供了 main 集合下的評估結果:

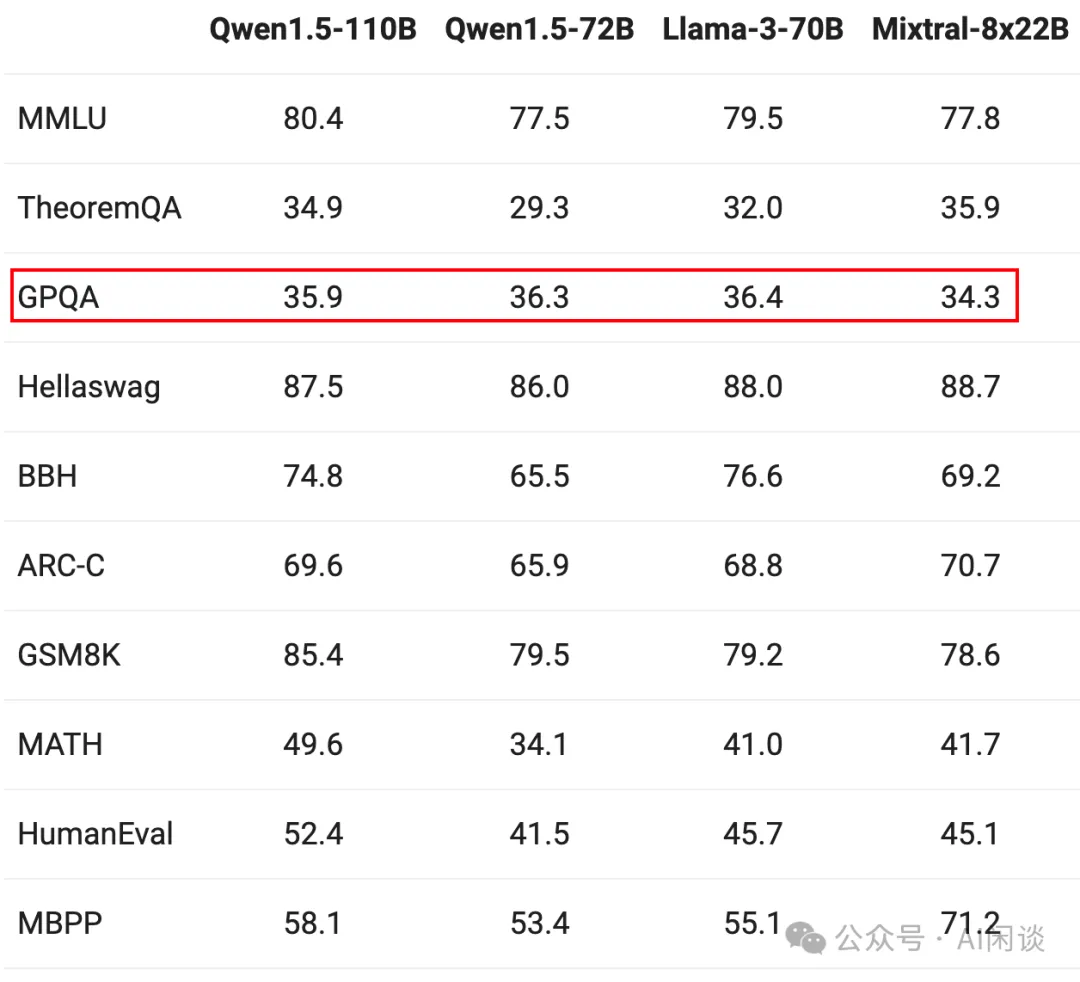

在阿里的通義千問 Qwen1.5-110B:Qwen1.5系列的首個千億參數開源模型| Qwen 中同樣沒有介紹 GPQA 對應的集合,甚至未介紹是否是 0-shot:

七、HumanEval&BBH&HellaSwag&ARC-C&DROP

如下的幾個指標相對比較統一,各個模型基本也都有相應的結果,如下圖所示:

- HumanEval通常都是采用0-shot評估

- BIG-Bench Hard(BBH)通常采用3-shot+CoT評估

- HellaSwag通常采用10-shot評估

- ARC-C通常采用25-shot評估

- DROP通常采用3-shot評估?

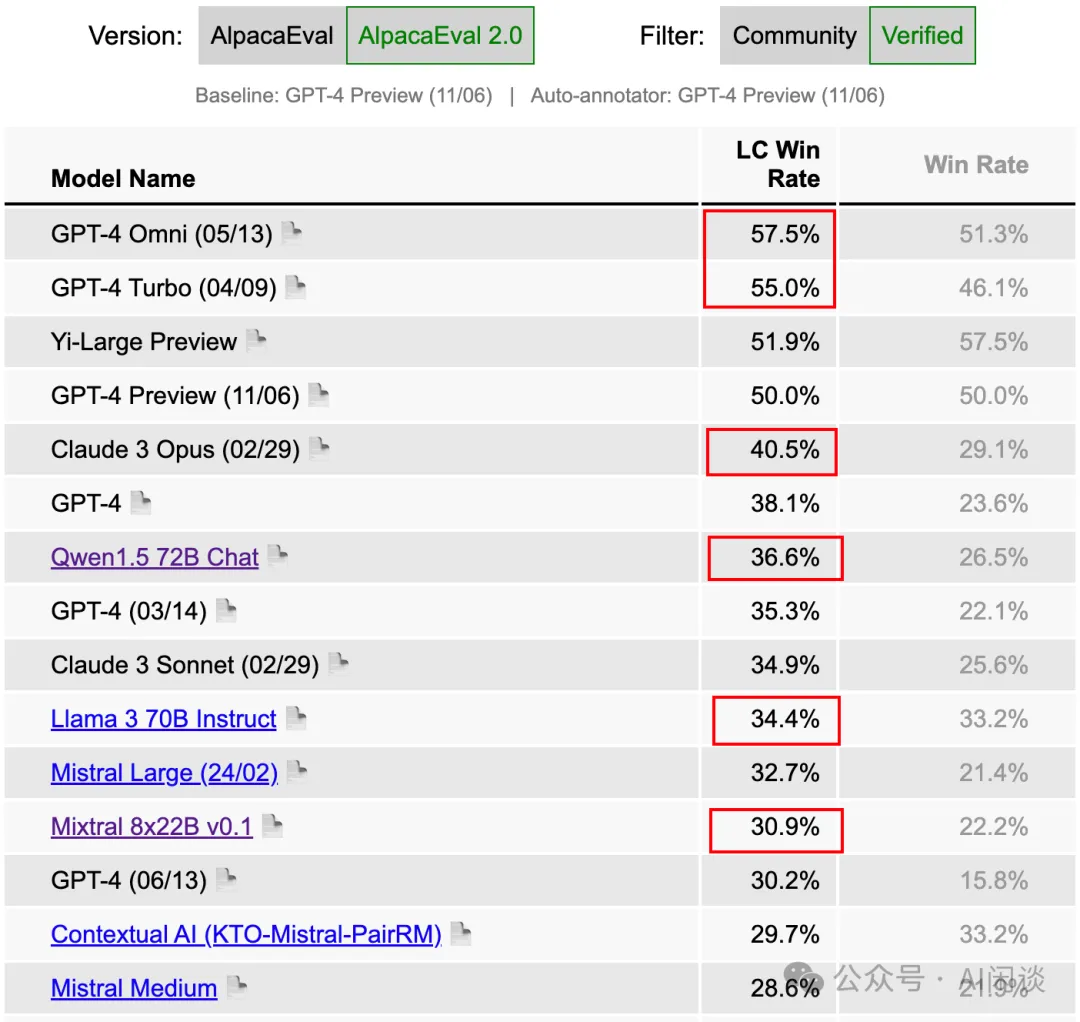

八、AlpacaEval 2.0

AlpacaEval 2.0 是一個指令遵循評估,它利用 LLM 來評估生成質量。在 AlpacaEval 中,會傾向于生成較長輸出的模型。因此,在 AlpacaEval 2.0 中,作者引入了長度控制(Length-Controlled AlpacaEval),來緩解這種偏好。對應的論文為:[2404.04475] Length-Controlled AlpacaEval: A Simple Way to Debias Automatic Evaluators。對應的 Leaderboard 為:AlpacaEval Leaderboard。

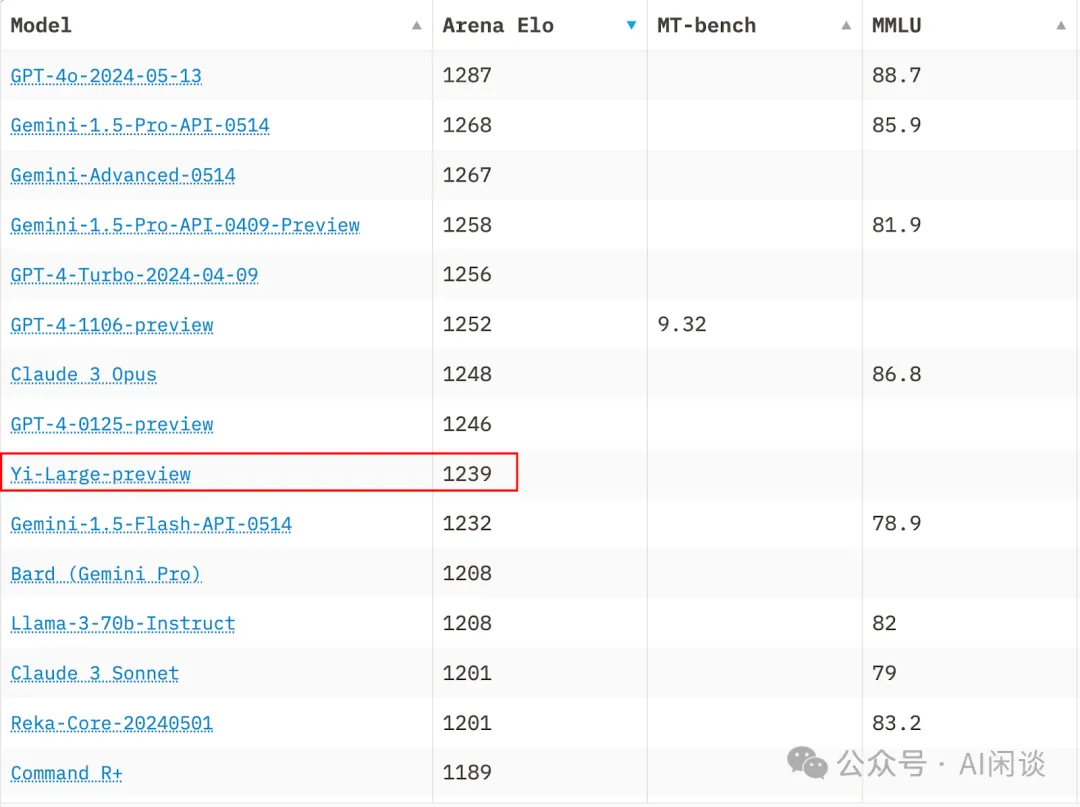

九、LMSYS Chatbot Arena

國外社區經常會使用 Chatbot Arena(LMSys Chatbot Arena Leaderboard - a Hugging Face Space by lmsys)來評估 LLM 的能力。其相當于大模型的競技場,都是通過真實用戶打分結果來評估人類對模型的偏好,其更接近真實用戶場景,也更加客觀。對應的論文為:[2403.04132] Chatbot Arena: An Open Platform for Evaluating LLMs by Human Preference。這也是“零一萬物 Yi-Large 在 LMSYS 中文榜單排名第一”的來源,如下圖所示為按照 Arena Elo 排序的結果(截止 2024-06-01):

在 Chatbot Arena 中也提供了 MT-bench 和 MMLU 的相關指標,如下圖所示為按照 MT-bench 排序的結果:

十、參考鏈接

- ??https://github.com/EleutherAI/lm-evaluation-harness??

- ??https://huggingface.co/spaces/HuggingFaceH4/open_llm_leaderboard??

- ??https://arxiv.org/abs/2211.09110??

- ??https://github.com/stanford-crfm/helm??

- ??https://github.com/openai/simple-evals??

- ??https://github.com/open-compass/OpenCompass/??

- ??https://rank.opencompass.org.cn/home??

- ??https://arxiv.org/abs/2205.11916??

- ??https://arxiv.org/abs/2201.11903??

- ??https://huggingface.co/meta-llama/Meta-Llama-3-70B??

- ??https://huggingface.co/spaces/lmsys/chatbot-arena-leaderboard??

- ??https://qwenlm.github.io/zh/blog/qwen1.5-110b/??

- ??https://arxiv.org/abs/2405.04434??

- ??https://arxiv.org/abs/2405.17976??

- ??https://crfm.stanford.edu/2024/05/01/helm-mmlu.html??

- ??https://arxiv.org/abs/2405.00332??

- ??https://arxiv.org/abs/2009.03300??

- ??https://www-cdn.anthropic.com/de8ba9b01c9ab7cbabf5c33b80b7bbc618857627/Model_Card_Claude_3.pdf??

- ??https://arxiv.org/abs/2403.05530??

- ??https://arxiv.org/abs/2303.08774??

- ??https://qwenlm.github.io/zh/blog/qwen1.5/??

- ??https://github.com/QwenLM/Qwen/blob/main/eval/gsm8k_prompt.txt??

- ??https://mistral.ai/news/mixtral-8x22b/??

- ??https://arxiv.org/abs/2403.04652??

- ??https://arxiv.org/abs/2311.12022??

- ??https://arxiv.org/abs/2404.04475??

- ??https://tatsu-lab.github.io/alpaca_eval/??

- ??https://arxiv.org/abs/2403.04132???

本文轉載自 ??AI閑談??,作者: AI閑談