手把手教你在本地部署 DeepSeek R1,并集成到 Dify 中,建議收藏! 原創

本教程將一步步指導你如何在本地環境中安裝 DeepSeek R1,并將其融合進 Dify 中,確保你的工作的效率得到實質性的提升!

1、DeepSeek R1 模型部署

本部分內容將重點闡述如何在本地環境下利用 Ollama 來部署 DeepSeek R1。后續章節將詳細講解如何將 DeepSeek R1 與 Dify 系統進行集成。

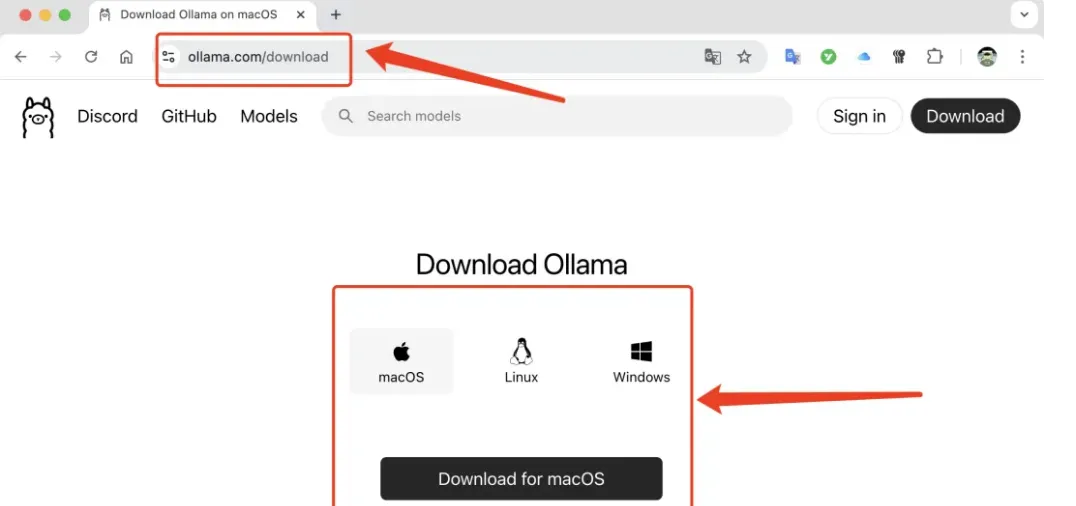

第一、安裝 Ollama

請訪問 Ollama 的官方網站,根據你的操作系統選擇合適的版本,下載 Ollama應用程序并進行安裝:

安裝完成后,打開命令行界面并輸入

ollama命令。如果屏幕上出現以下提示信息,那么恭喜你,Ollama 已經成功安裝。

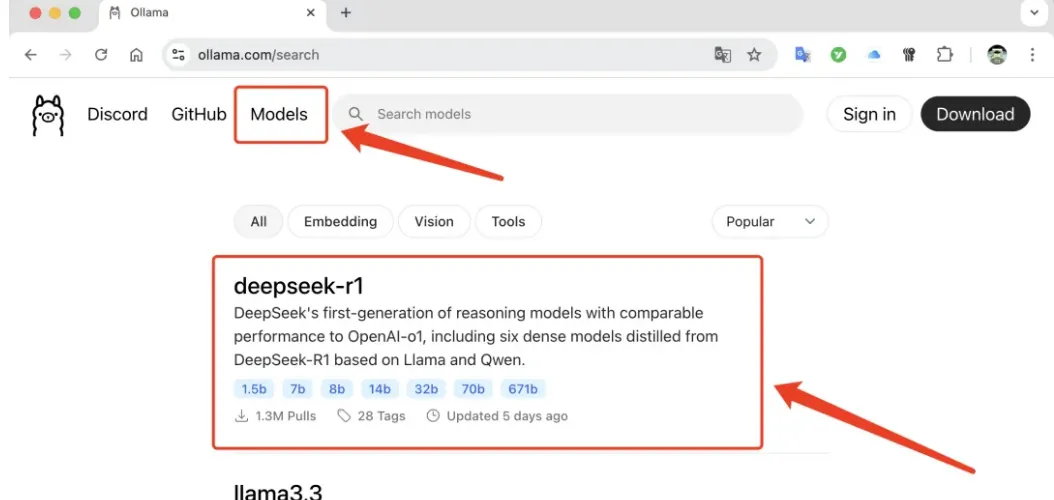

第二、部署 DeepSeek R1 模型

首先,訪問 Ollama 官網并點擊頁面頂部的「模型」(Models)選項,接著在列表中找到并點擊「DeepSeek R1」:

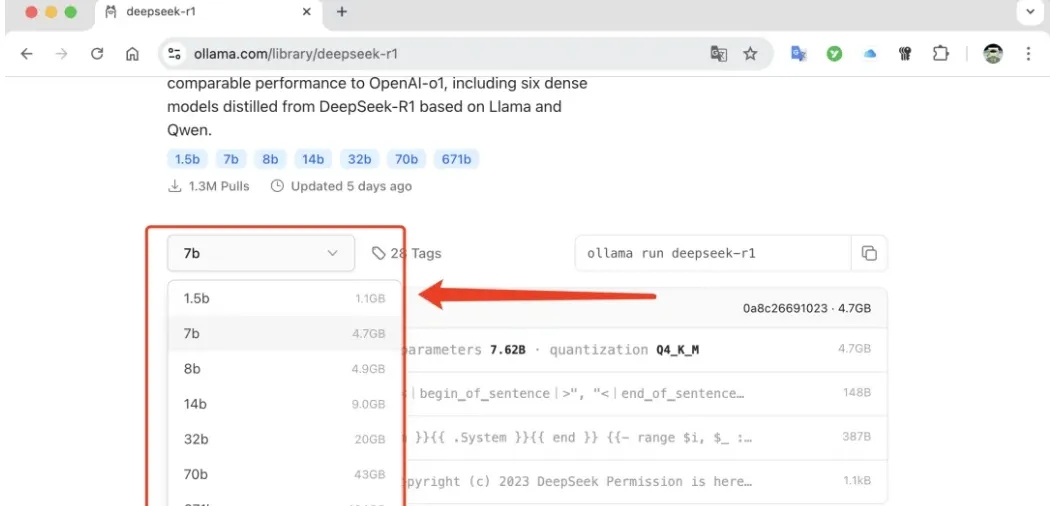

在模型詳情頁面,根據您的計算機顯存容量選擇合適的模型版本:

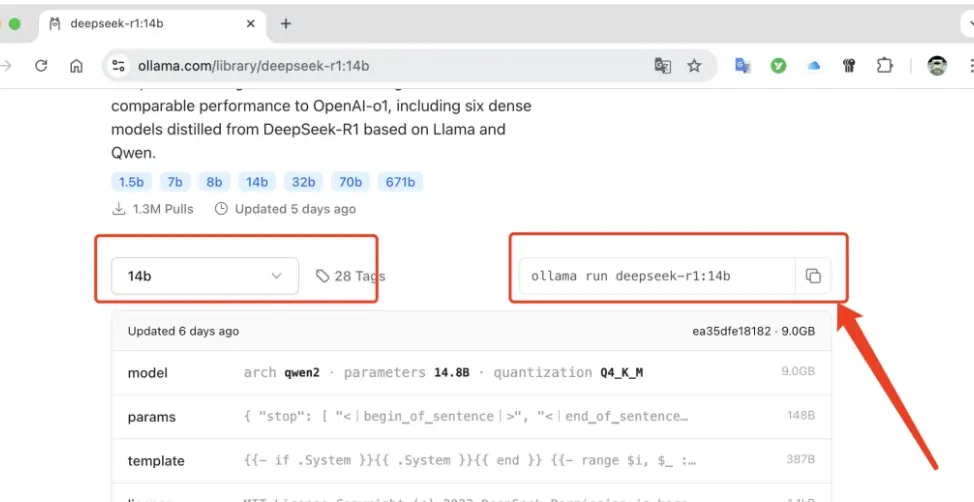

例如,我的電腦運行的是 MacOS 系統,擁有 32GB 的顯存,因此我選擇了14b 版本的模型。點擊 14b 版本,頁面右側將顯示下載指令:

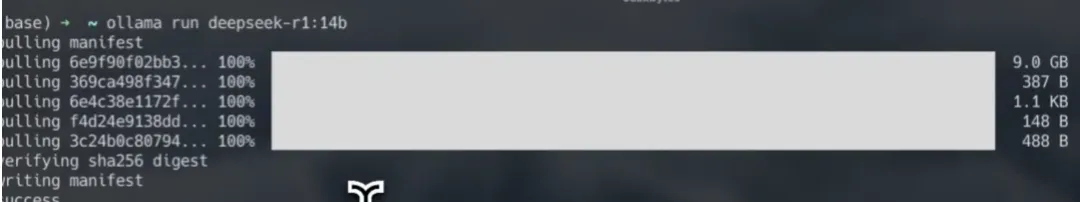

將此下載命令復制并粘貼到命令行中執行:

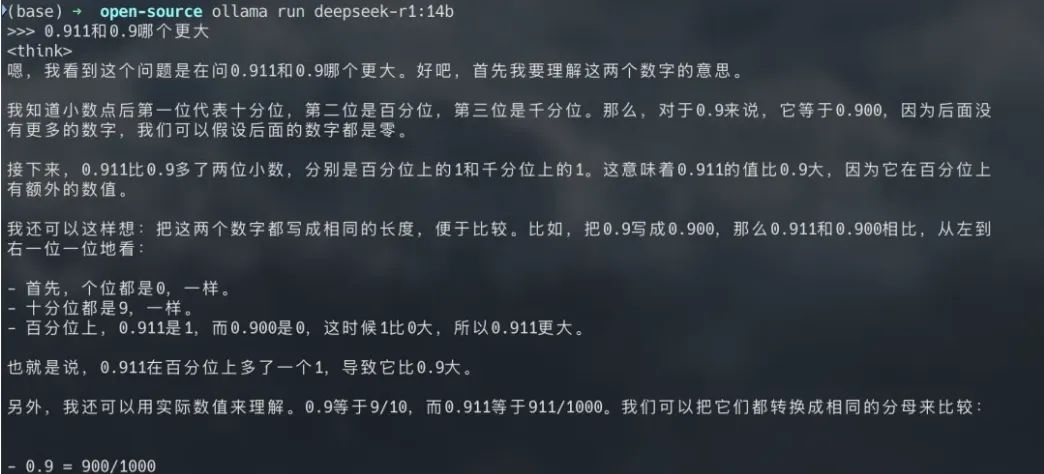

待命令執行完畢,您就可以通過命令行與大模型進行交互了:

然而,僅通過命令行與大模型交流可能不夠便捷。因此,接下來,我們將介紹如何將模型集成到 Dify 中,以便通過更直觀的圖形界面進行操作。

2、在 Dify 中配置 DeepSeek R1 模型

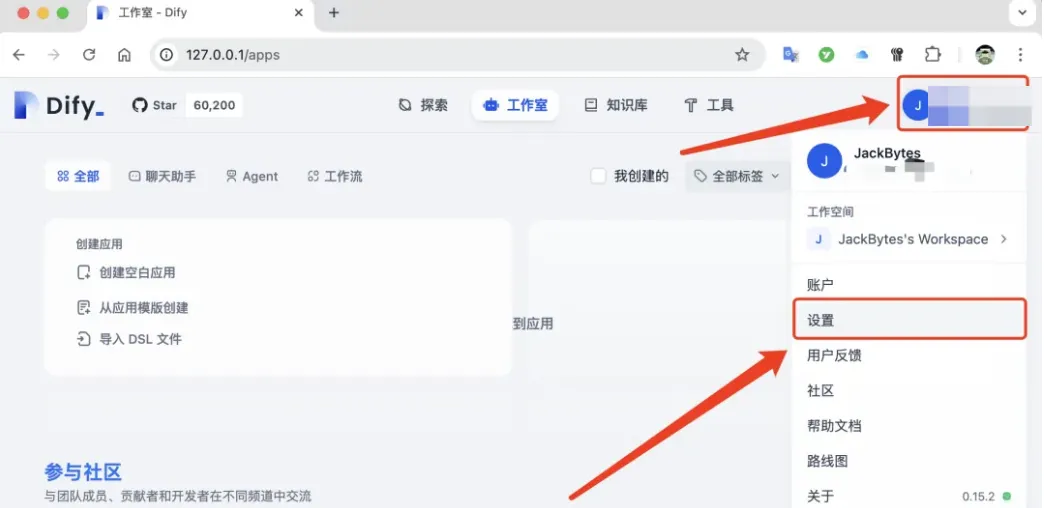

訪問已部署的 Dify 系統,點擊頁面右上角的個人頭像,隨后選擇「設置」選項:

在「模型供應商」配置頁面,選擇「Ollama」作為供應商:

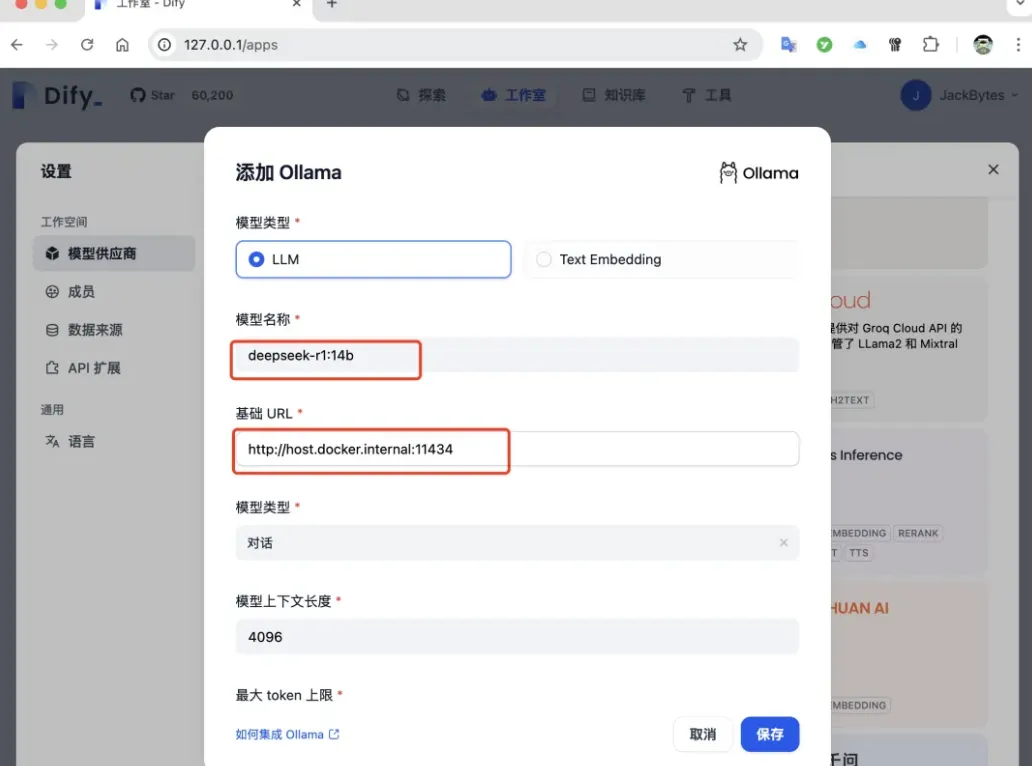

在「模型名稱」一欄輸入:deepseek-r1:14b。對于「基礎 URL」,如果 ollama 和 Dify 在同一臺機器上部署,并且 Dify 是通過 Docker 容器部署的,那么應填寫http://host.docker.internal:11434;若非此情況,請填寫http://ollama 的服務地址:11434。完成填寫后,點擊「保存」按鈕。

3、創建應用

接下來,我將指導你如何在 Dify 中創建一個應用,以便利用 DeepSeek R1 模型。

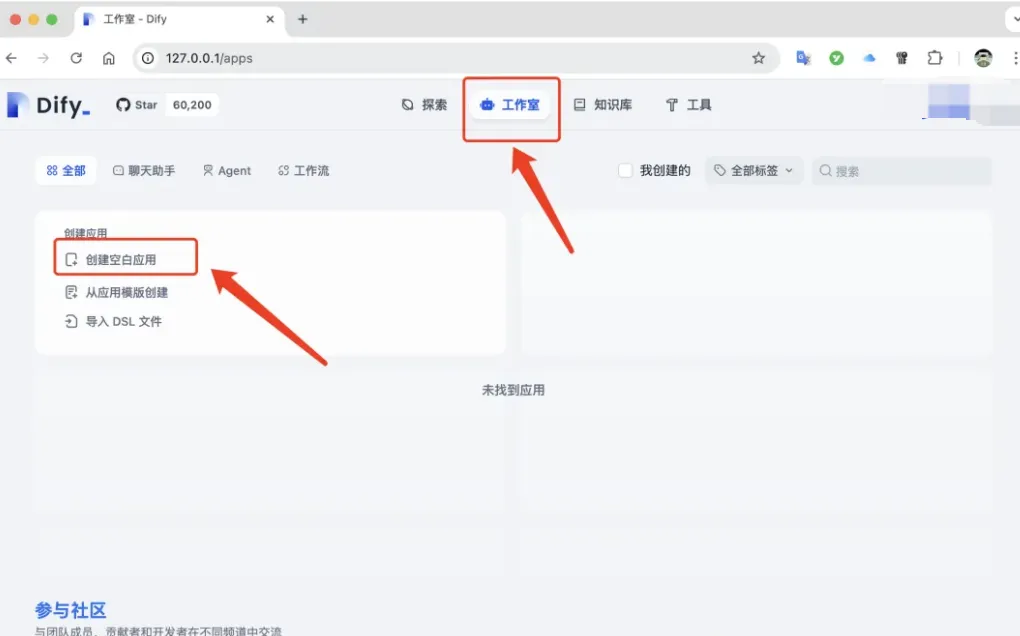

首先,在 Dify 的「工作室」頁面中,點擊「創建空白應用」的按鈕:

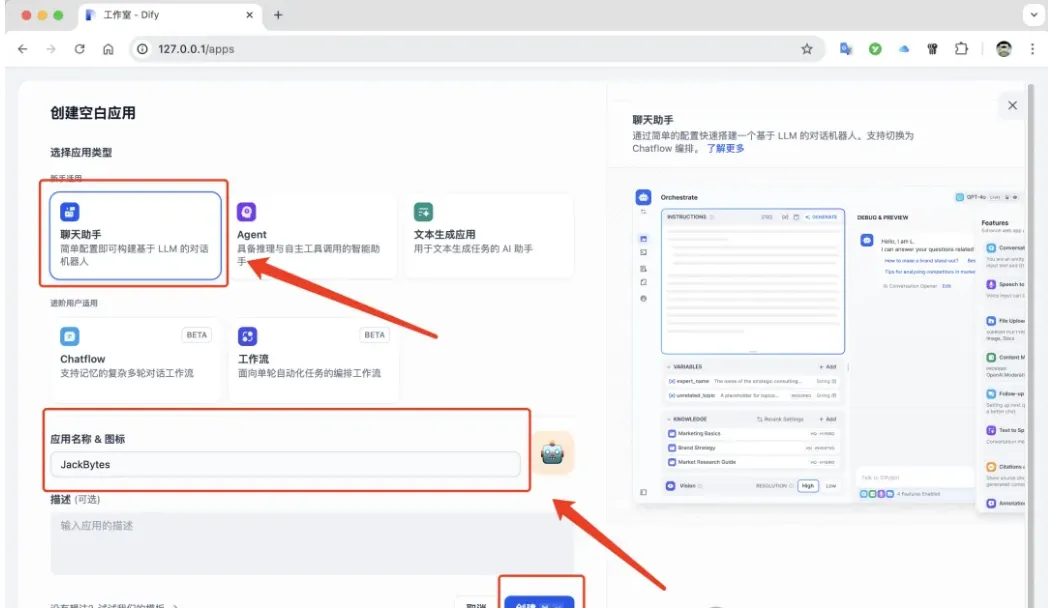

在出現的對話框中,選擇「聊天助手」類型,輸入「應用名稱」和「描述」,然后點擊「創建」:

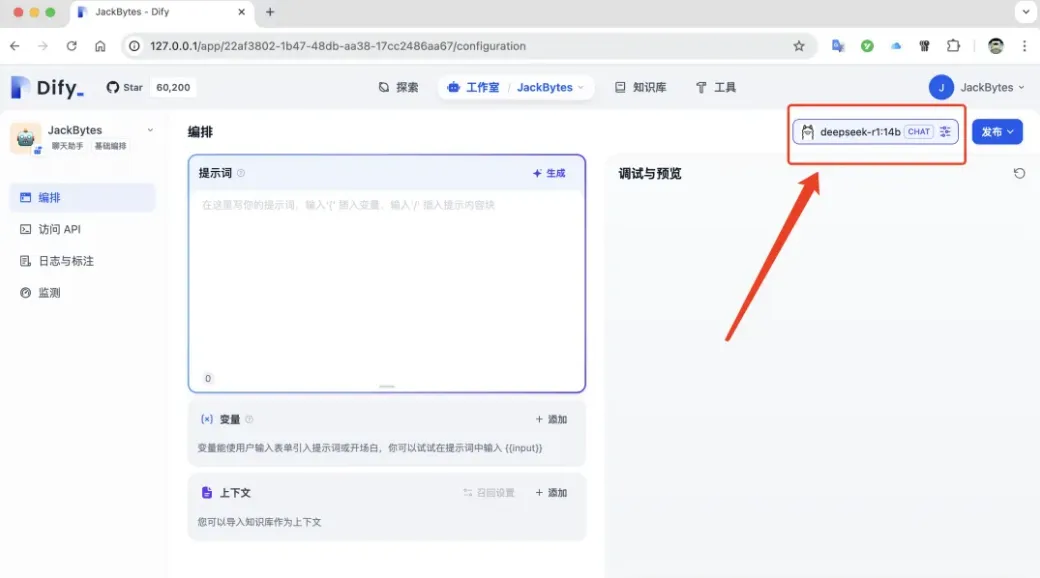

應用創建成功后,點擊頁面右上角,選擇您已經添加的 DeepSeek R1 模型:

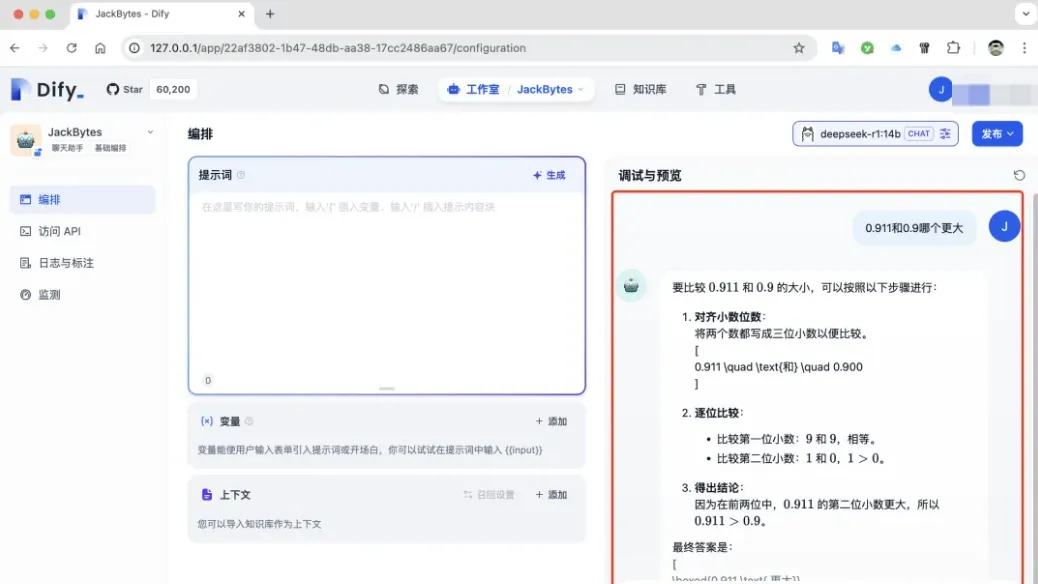

接下來,可以嘗試提出問題進行測試:

請注意,DeepSeek R1是一個推理模型,它不支持函數調用。這意味著它不能被集成到 Dify 的智能體中。不過,DeepSeek V3 模型則可以進行集成。

4、總結

本文向您展示了目前廣受關注的 DeepSeek R1 模型,并指導你如何在本地環境下進行部署,以及如何將其融合至 Dify 平臺。感興趣的朋友不妨親自嘗試一番。

本文轉載自公眾號玄姐聊AGI 作者:玄姐