不平衡場景下的多模態知識圖譜補全

一、引言

多模態知識圖譜補全(MMKGC)通過將實體的結構、視覺和文本信息納入知識圖譜的表示學習模型中,來預測多模態知識圖譜中缺失的三元組。在這個過程中,來自不同模態的信息將共同用于度量一個三元組的合理性。現有的MMKGC方法往往默認MMKG上的模態信息是完整的,或者采用簡單的方法完成缺失模態信息的補全,忽視了實體之間模態信息的不平衡問題,導致模態信息融合不充分以及原始模態信息的低效利用。模態信息的不平衡性主要體現在兩個方面,首先,在知識圖譜推理時,不同的模態信息發揮著獨特的作用,應該被自適應地考慮。然而,現有方法未能充分解決模態融合問題,因為模態信息通常被不靈活地統一地融入到結構信息的表示空間中。其次,在圖像和文本描述中,有效的特征通常是有限的且難以提取。在實際場景中,從多個異構數據源構建的知識圖譜甚至可能存在模態缺失,這進一步限制了MMKGC中模態信息的使用。為了實現更好的MMKGC性能,關鍵是有效利用基本信息以及獲取更高質量的多模態信息。這種需求可以總結為釋放不平衡模態信息的力量以用于MMKGC。為解決上述問題,我們提出了自適應多模態融合和模態對抗訓練(AdaMF-MAT)來釋放不平衡模態信息的力量以用于MMKGC。AdaMF-MAT通過自適應模態權重實現多模態融合,并通過模態對抗訓練進一步生成對抗樣本以增強不平衡模態信息。我們的方法是MMKGC模型和訓練策略的共同設計,可以優于19個最近的MMKGC方法,并在三個公共MMKGC基準測試上取得了新的最先進結果。

二、方法

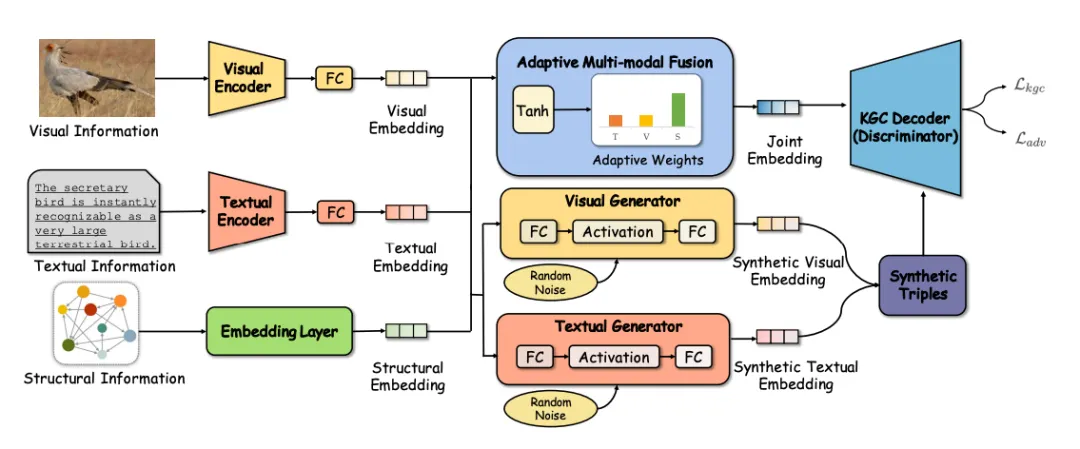

論文中提出的方法的總體框架如下圖所示。特征編碼器被設計用于分別編碼不同的模態特征(視覺/文本/結構)。每個FC代表一個全連接的投影層。自適應多模態融合模塊被設計用于自適應地獲取融合的聯合嵌入。模態對抗訓練模塊采用生成器生成合成的多模態嵌入以構建對抗樣本。KGC解碼器充當對抗訓練過程中的判別器,在訓練過程中將通過這些對抗樣本得到增強。

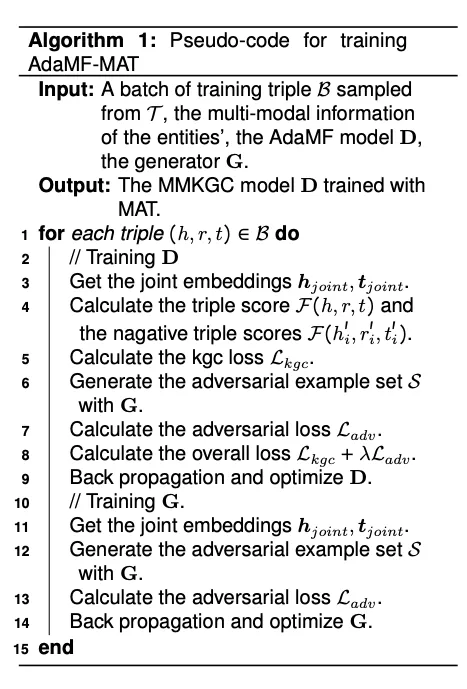

在模態對抗訓練的過程中,論文采用了一個兩層的MLP作為生成器,針對輸入的實體結構信息生成其視覺和文本的特征,并進一步講這些特征組合成一個個"人造實體",再進一步組合成"人造三元組",然后通過在這些人造三元組和真實的三元組之間進行對抗式的訓練,來達到增強實體的多模態信息,緩解其不平衡分布的問題。整個算法流程的偽代碼如下:

三、實驗與分析

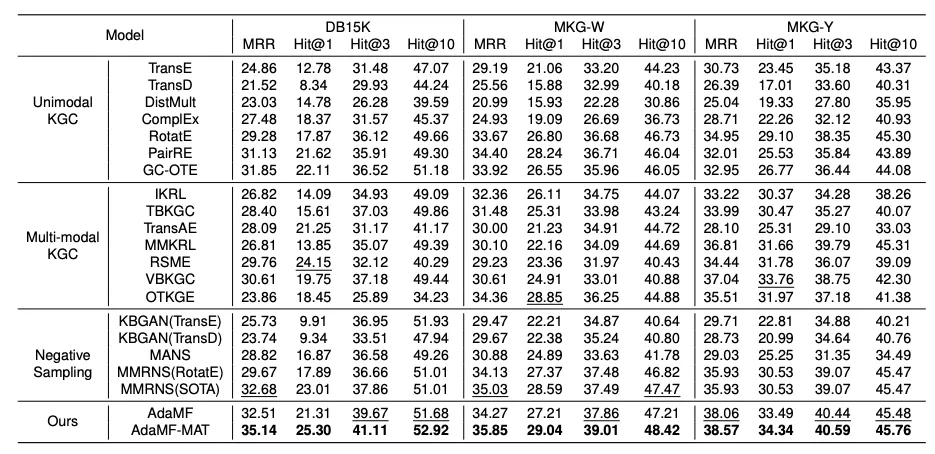

實驗部分,論文采用了三個MMKG基準數據集DB15K, MKG-W和MKG-Y來進行連接預測的實驗,同時選取了19個不同的知識圖譜補全方法(含單模態方法、多模態方法、負采樣方法等三類)。主要的實驗結果如下:

從實驗結果中可以看到本論文提出的方法相比于基線模型有非常大的提升,在MRR和Hit@1等指標上分別提升了6%和8%,同時實驗進行了更多的實驗來驗證了該方法在不同程度的模態缺失場景下的能力,結果表明相比于其他baseline模型,本文提出的模型有明顯的性能提升,同時,模態對抗訓練可以作為一個通用的模塊,在不同的MMKGC模型中都起到增強有限模態信息的作用。

四、總結

在這篇論文主要討論了在多模態知識圖譜補全(MMKGC)中利用模態信息的問題,并提出了一個名為AdaMF-MAT的新穎多模態知識圖譜補全框架,以解決現有方法的局限性。現有利用模態特征的方法相對粗糙,以一種通用的方式對待模態信息。論文中的方法AdaMF-MAT采用自適應模態融合來多樣化利用多模態信息,并通過模態對抗訓練來增強多模態嵌入。實驗表明,AdaMF-MAT能夠勝過所有現有的基線方法,并在MMKGC任務中達到最佳狀態(SOTA)結果。

本文轉載自:??ZJUKG??

作者:張溢弛