Google開源自家神經網絡編碼器,吊打Opus

Google 近日發布了一個端到端的神經音頻編解碼器 —— SoundStream。最重要的是,Google 表示這是世界上第一個由神經網絡驅動并支持語音、音樂和環境聲音等不同聲音類型的音頻編解碼器,可以在智能手機的處理器上實時處理上述各種音頻。

音頻編解碼器是壓縮音頻文件的基本工具,以使其體積更小,并在傳輸過程中盡可能節省時間。因此,音頻編解碼器對于流媒體、在線語音和視頻通話這類有音頻傳輸需求的服務而言至關重要。

雖然音頻編解碼器能夠壓縮音頻體積,加速音頻傳輸過程,但壓縮后的音頻也會損失音頻質量和細節,產生可以讓用戶察覺到的差異。而這就是 SoundStream 能夠彌補的地方。

今年 2 月的時候,Google 發布了一個用于低比特率語音的神經音頻編解碼器 Lyra,并在今年 4 月正式開源。SoundStream 是 Lyra 的一個擴展版本。SoundStream 不僅集成了 Lyra 在低比特率「語音」方面的能力,還具有對更多聲音類型的編碼支持,包括清晰的語音、嘈雜的語音、帶有回聲的語音、音樂和環境聲音等。

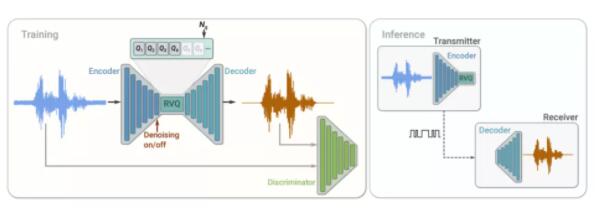

SoundStream 是圍繞一個由編碼器、解碼器和量化器組成的神經網絡系統而建立的。編碼器將音頻轉換為編碼信號,之后使用量化器進行壓縮,并使用解碼器轉換回音頻。因此,在經過訓練神經網絡模型后,編碼器和解碼器可以在不同的客戶端工作,有助于在各種環境下以不損失質量的前提傳輸音頻。

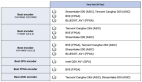

Google 已經在網站上發布了不同音頻壓縮樣本與原始音頻樣本的對比。通過對比測試,經過 SoundStream 處理過的 3 kbps 的音頻要優于 Opus 音頻編解碼器處理過的 12 kbps 音頻,效果與 ECS 編解碼器處理過的 9 kbps 十分接近。

目前 Google 自己的在線會議平臺 Google Meet 和視頻平臺 YouTube 仍在使用 Opus 音頻編解碼器。隨著 SoundStream 技術的不斷進步,可能很快就能看到 Google 將在自己的服務中使用自己的技術。

Google 表示,SoundStream 是將機器學習技術應用在音頻編解碼器中重要的一步,比目前最先進的編解碼器 Opus 和 EVS 效果更好。SoundStream 將被整合進 Lyra,并隨著 Lyra 下一版本的發布一同推出。開發人員可以利用現有的 Lyra API 和工具,來提供更好的音質。