用Python爬取某寶2008條棉襖商品數據,進行可視化分析,終于找到值得入手的棉襖

文末本文轉載自微信公眾號「志斌的python筆記」,作者 志斌 。轉載本文請聯系志斌的python筆記公眾號。

大家好,我是志斌~

轉眼就到11月份了,本以為能在大連過一個浪漫的秋天,但是沒想到今年的大連沒有秋天,直接到了寒風刺骨的冬天。。。

于是,志斌趕緊打開了Python,用它爬取并分析一波棉襖,找到一件最合適的棉襖給裹到身上。

一、數據采集

數據采集是數據可視化分析的第一步,也是最基礎的一步,數據采集的數量和質量越高,后面分析的準確的也就越高,我們來看一下淘寶網的數據該如何爬取。

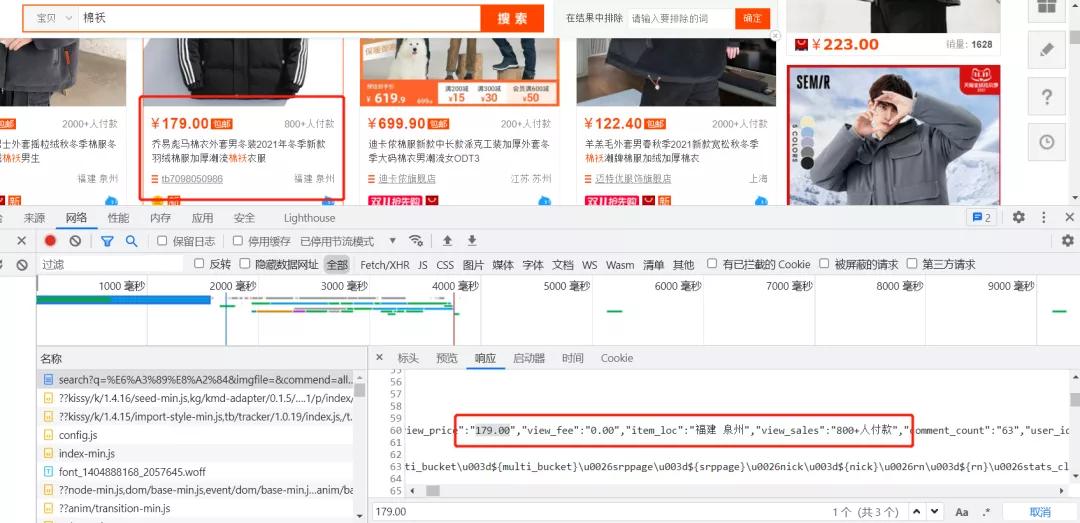

淘寶網站是一個動態加載的網站,我們之前可以采用解析接口或者用Selenium自動化測試工具來爬取數據,但是現在淘寶對接口進行了加密,使我們很難分析出來其中的規律,同時淘寶也對Selenium進行了反爬限制,所以我們要換種思路來進行數據獲取。

打開開發者模式,開始對網頁進行觀察后發現,淘寶商品的數據竟然在源網頁中存儲著。

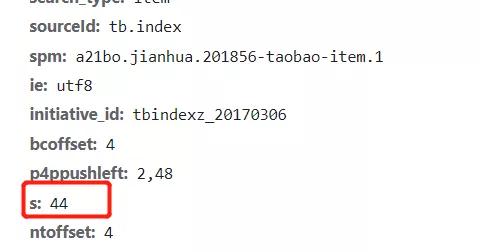

我翻了幾頁網頁之后發現,每翻一頁,網頁的params參數中的s參數就會增加44(初始值是0)。

經過以上分析,現在我們就可以開始構造爬蟲程序了。

1.導入爬蟲使用的庫

- import requests

- import re

- import time

- import random

- import openpyxl

2.發起請求

- for page in range(1,101):

- params = (

- ('q', '棉襖'),

- ('imgfile', ''),

- ('commend', 'all'),

- ('ssid', 's5-e'),

- ('search_type', 'item'),

- ('sourceId', 'tb.index'),

- ('spm', 'a21bo.jianhua.201856-taobao-item.2'),

- ('ie', 'utf8'),

- ('initiative_id', 'tbindexz_20170306'),

- ('hintq', '1'),

- ('s', str(page*44)),

- )

- response = requests.get(url, params=params)

3.數據存儲

- a = 0

- b = 0

- for i in range(44):

- try:

- sheet.append([dianpumingcheng[i],shangpinming[i],float(jiage[i]),fahuodi[i],fukuanrenshu[i]])

- except:

- a+=1

- if a>30:

- print(f"第{page}頁數據未爬取......")

- wb.save('棉襖.xlsx')

- # 把xxx改成你想要的存儲的名稱即可

- b = 1

- break

- if b == 1:

- break

- print(f"已爬取完第{page}頁數據......")

- time.sleep(random.randint(3,5))

- nt(f'共爬取{page}頁數據......')

二、數據清洗

數據采集后,要對其進行清洗,剔除臟數據,用以提高分析的準確性。

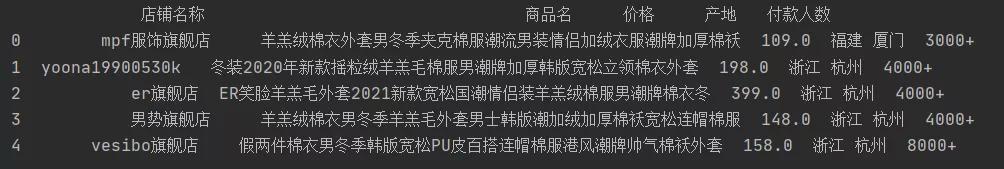

1.導入商品數據

用pandas讀取爬取后的商品數據并預覽。

- import pandas as pd

- df = pd.read_excel('棉襖.xlsx',names=['店鋪名稱','商品名','價格','產地','付款人數'])

- print(df.head())

2.刪除重復數據

- df.drop_duplicates()

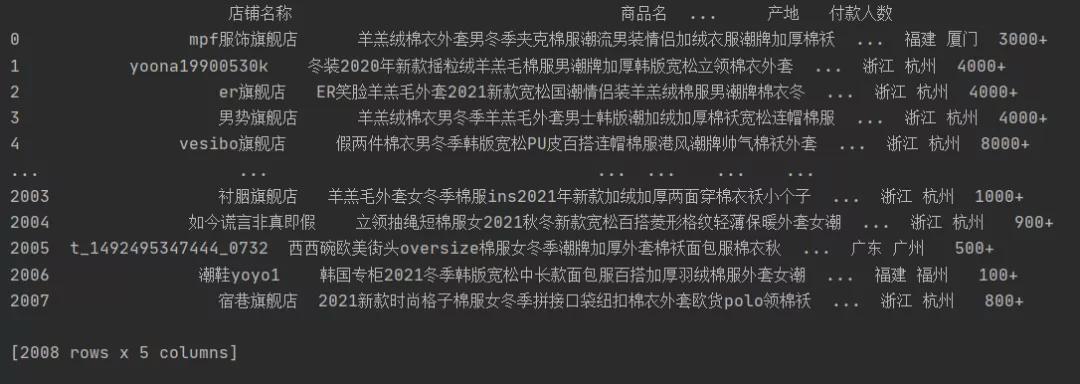

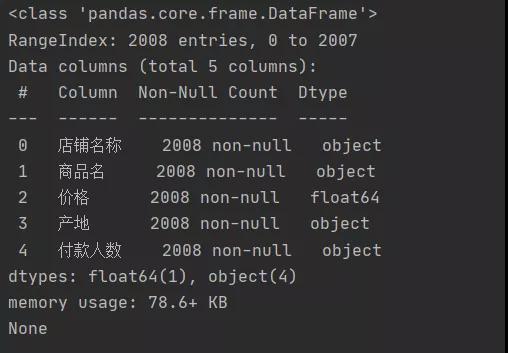

刪除重復數據后,還有2008條數據。

3.數據類型轉換

我們發現付款人數是字符串類型,我們需要將其轉換成整數類型。

- wb = openpyxl.load_workbook('棉襖.xlsx')

- int_list = []

- sheet = wb['Sheet']

- for i in range(2,2008):

- str = sheet[f'E{i}'].value

- if '萬+' in str:

- int_list.append(int(int(str[:-2])*random.uniform(1,2)*10000))

- elif '+' in str:

- int_list.append(int(int(str[:-1])+random.random()*1000))

- else:

- int_list.append(int(str))

- for i in range(2,2008):

- sheet.cell(i,5).value = int_list[i-2]

- wb.save('3.xlsx')

4.查看數據類型

查看字段類型和缺失值情況,符合分析需要,無需另做處理。

- df.info()

三、可視化分析

我們來對這2008家棉襖商品數據進行可視化分析。可視化圖是由Python、Tableau和Excel共同繪制而來。

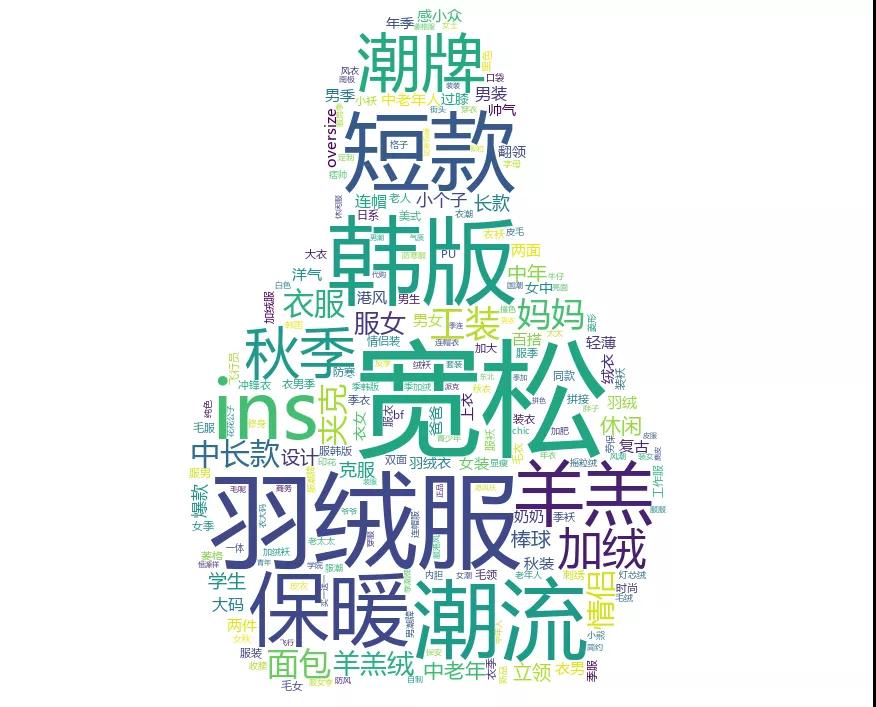

1.在售棉襖特點

通過對棉襖的商品名稱進行詞云圖繪制,我們發現,今年棉襖的樣式以寬松、潮流、韓版、短款類居多。

制作代碼如下:

- from imageio import imread

- import jieba

- from wordcloud import WordCloud, STOPWORDS

- with open("1.txt",'r',encoding='utf-8') as f:

- job_title_1 = f.read()

- contents_cut_job_title = jieba.cut(job_title_1)

- contents_list_job_title = " ".join(contents_cut_job_title)

- wc = WordCloud(stopwords=STOPWORDS.add("一個"), collocations=False,

- background_color="white",

- font_path=r"K:\msyh.ttc",

- width=400, height=300, random_state=42,

- mask=imread('棉襖.jpg', pilmode="RGB")

- )

- wc.generate(contents_list_job_title)

- wc.to_file("推薦語.png")

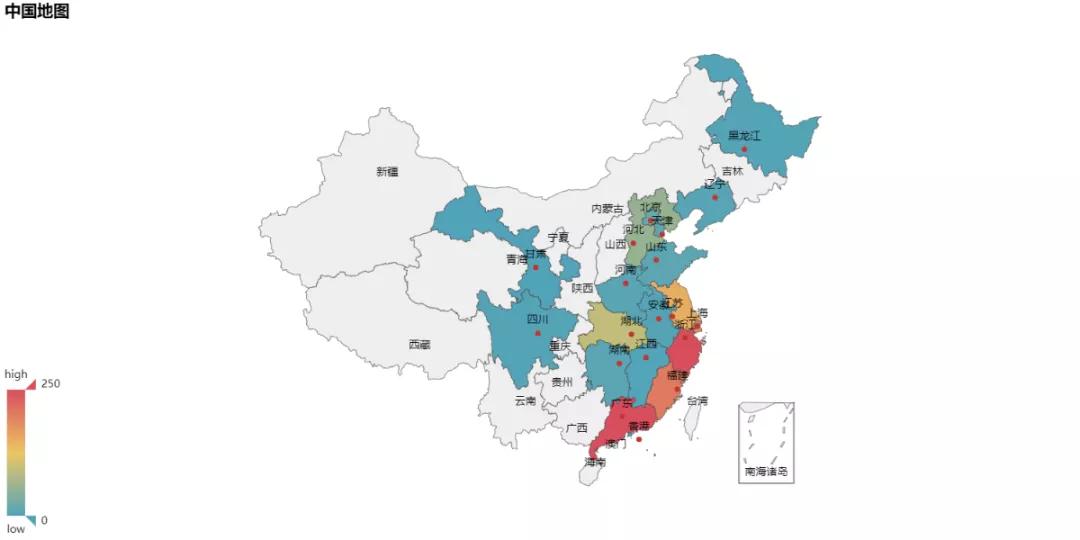

2.各省產量分布圖

通過對各商品的產地數據進行統計并繪制了全國地圖,我們發現浙江、廣東和福建這三個地方生產棉襖最多,分別是914家、261家和203家。

制作代碼如下:

- import openpyxl

- from collections import Counter

- from pyecharts import Map

- wb = openpyxl.load_workbook('棉襖.xlsx')

- sheet = wb['Sheet']

- a = []

- for i in range(2,1960):

- D = sheet[f'D{i}']

- a.append(D.value)

- province_distribution = dict(Counter(a))

- provice = list(province_distribution.keys())

- values = list(province_distribution.values())

- map = Map("中國地圖",width=1200, height=600)

- map.add("", provice, values, visual_range=[0, 50], maptype='china', is_visualmap=True,

- visual_text_color='#000',is_label_show=True)

- map.render(path="地圖.html")

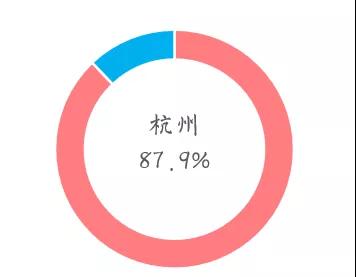

我們進一步對浙江省的產地數據進行分析發現,杭州的棉襖商家最多,占全省的40%。

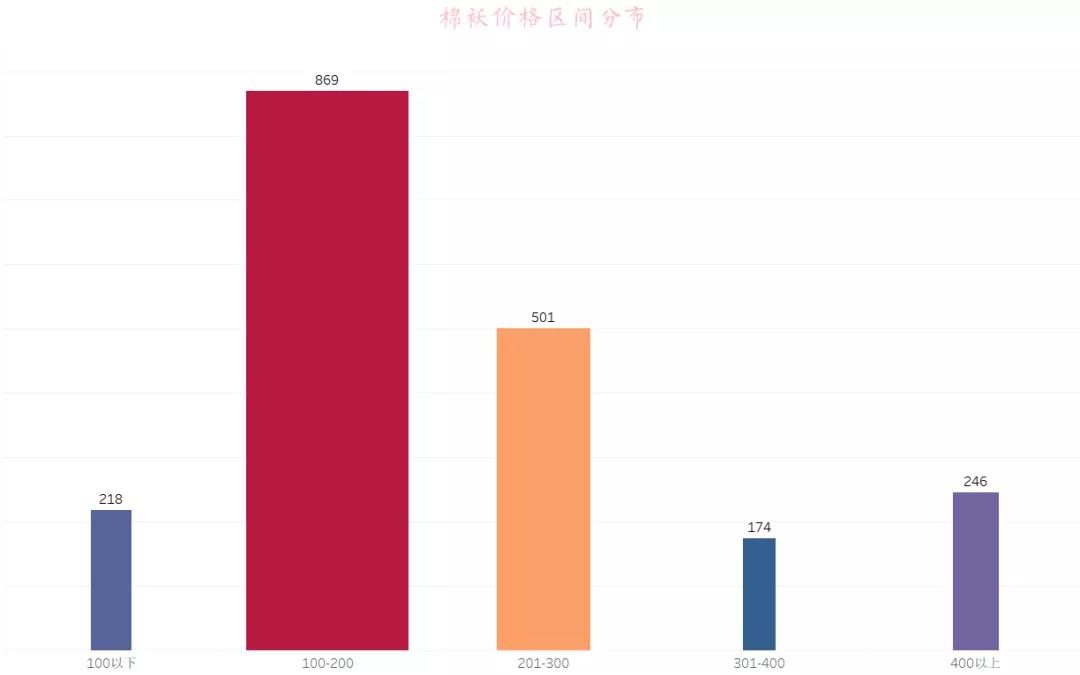

3.棉襖價格區間分布

我們對棉襖價格以100為分點,進行可視化后發現,價格在100-200的棉襖商品最多,有869家,其次是價格在201-300之間的,有501家。看來棉襖的價格還是相對便宜的~

4.棉襖月銷量top20商家

銷量最高的竟然不是旗艦店,是一個李廣森的自制時尚女裝店,志斌打開她們家的店鋪看了看,感覺還不錯,可以給對象入手一套~

四、小結

1. 本文僅供學習研究使用,提供的評論僅供參考。如有不妥之處請及時告知作者。