節能1000倍!仿人腦神經芯片跑AI模型竟然這么省電

作為如今最成功的人工智能算法,人工神經網絡,可以松散地模擬了人腦中真實神經網絡的復雜鏈接。 不過與人腦的高能效相比,實在是太費電了。

于是,神經擬態計算應運而生,這種技術更貼近模仿了人腦的運作機理與物理定律。 然而,由于器件失配難題,模擬神經元的質性會與設計略有不同,且電壓和電流水平在不同的神經元之間也有差異。 相比之下,AI算法的訓練則是在具有完全一致的數字神經元的計算機上完成的。

因此,實際在神經擬態芯片上運行時,經常會出現「水土不服」的問題。 2022年1月在美國國家科學院院刊上發布的一篇論文,揭示了繞過此難題的一種途徑。

論文鏈接:https://www.pnas.org/content/119/4/e2109194119

由瑞士弗雷德里希米歇爾生物醫療研究所的研究者弗里德曼·曾克,與德國海德堡大學的研究者約翰內斯·希密爾聯合組成的團隊,在脈沖神經網絡這一類型的AI算法上獲得新進展。 脈沖神經網絡使用模仿人腦中的特色脈沖交流訊號,可以在神經擬態芯片上運行,學會如何代償芯片中的器件失配。 此論文是AI邁向神經擬態運算的顯著一步。

模擬神經網絡

與現有AI運行設備不同,神經擬態計算并不將數據在長間隔距離的CPU與存儲卡之間搬運。 神經擬態芯片設計模仿果凍般人腦的基礎架構,將計算單元(神經元)置于存儲單元(連接神經元的突觸)旁邊。 為了讓設計更像人腦,研究者將神經擬態芯片結合模擬計算,如此能像真實神經元一樣處理持續不斷的信號。

這樣產出的芯片,與現下依賴處理0與1的二元基礎信號的數碼計算模式和架構,有顯著不同。 以人腦作為設計指南,神經擬態芯片承諾有朝一日終結AI等大數據量運算工作的高耗能。不幸的是,AI算法在神經擬態芯片的模擬版本上運行效果不佳。 這是因為器件失配的缺陷:在生產過程中,芯片里模擬神經元的微型組件大小出現不匹配。 由于單個芯片不足以運行最新的AI訓練過程,算法必須在傳統計算機上進行預訓練。 但之后將算法轉輸到芯片上時,一旦遇上模擬硬件不匹配的問題,算法就兩眼一抹黑了。

基于人腦設計的計算模式是模擬計算而非數碼計算,這點差別微妙而關鍵。 數碼計算只能有效呈現人腦脈沖信號的二元性方面:脈沖信號作為一道沖過神經元的電信號,狀態具有二元性,要么輸出了,要么沒輸出,這就是0與1的區別。

不過事實上因為人腦細胞中有電壓變化,當細胞內電壓超過比細胞外電壓高到一定程度的特定閾值,就會輸出脈沖。 如此一來,脈沖是在一定時段內持續不絕地輸出的,而且神經元決定輸出脈沖的狀態也是持續不絕的,這其實是一種模擬信號的狀態。 瑞士蘇黎世聯邦理工學院的神經擬態工程研究者夏洛特·弗倫克爾說:「模擬態體現了人腦運算模式的核心之美。成功效仿人腦的這一關鍵方面,將是神經擬態運算的主驅動因素之一。」 2011年,海德堡大學的一組研究人員開始開發一種既有模擬態又有數碼態的神經擬態芯片,為神經科學實驗模擬大腦。

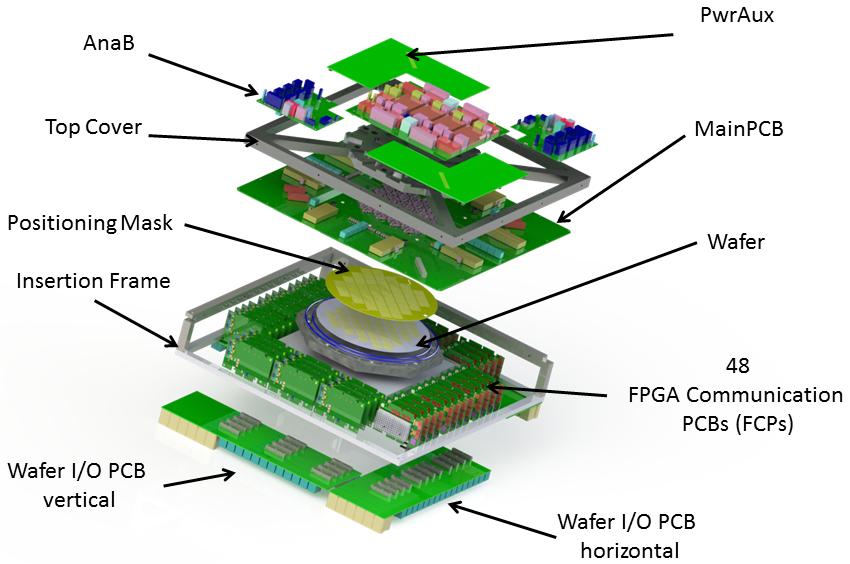

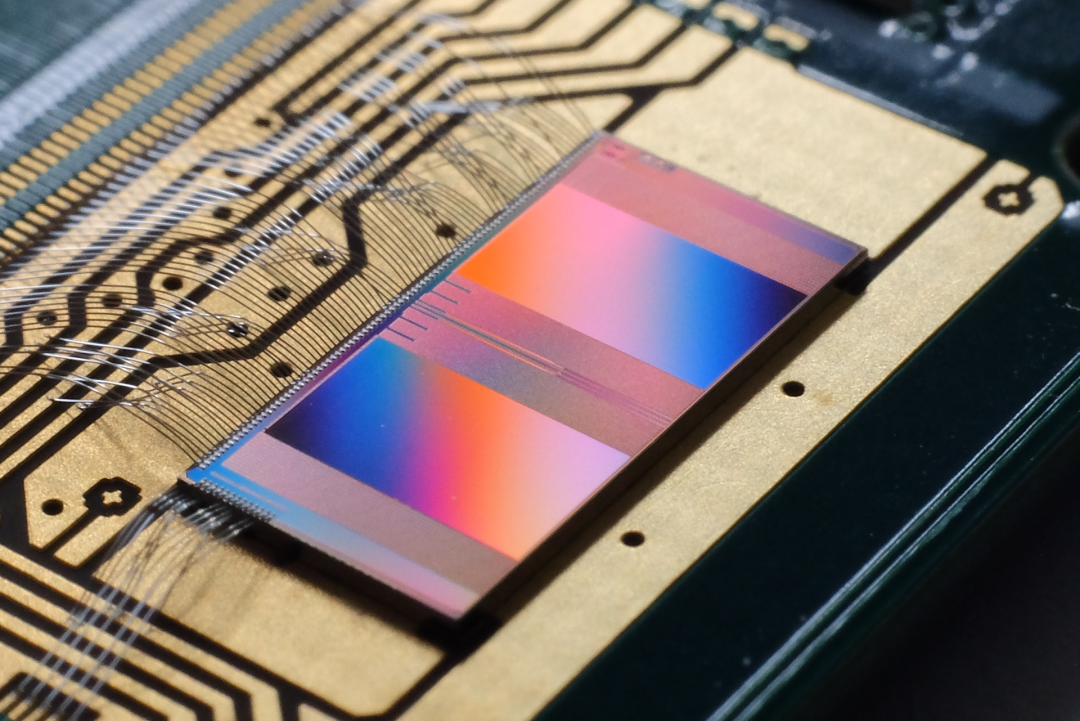

此后,團隊又發布了新一版的芯片「BrainScaleS-2」,其中每個模擬神經元都模擬了腦細胞的輸入-輸出電流和電壓變化。 不過,由于材質的導電質性不同于真人腦,芯片在速度上要比人腦快1000倍。

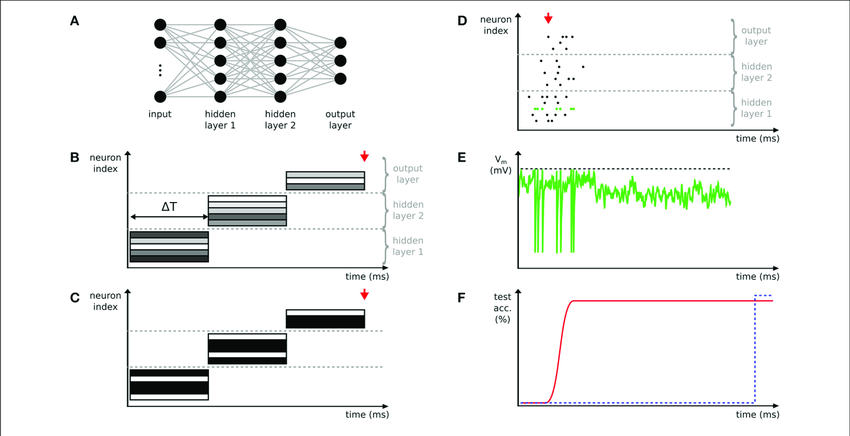

在這項新的工作中,通過將芯片納入算法的訓練過程,脈沖神經網絡可以學習如何糾正BrainScaleS-2芯片上的電壓差別。 為了處理器件失配的問題,團隊還專門為脈沖神經網絡開發了全新的方法,將芯片用梯度替代法這種學習方法與計算機交互。 梯度替代法通過持續改變神經元之間的連接,來盡量減少神經網絡在執行任務中的錯誤數量(類似于非脈沖神經網絡使用的反向傳播)。

梯度替代法能夠在計算機上的訓練過程中糾正芯片的不完善之處。 首先,讓脈沖神經網絡利用芯片上模擬神經元的不同電壓執行一項簡單的任務,并將電壓的記錄發回計算機。 然后,讓算法自動學習如何最好地改變其神經元之間的連接,以便仍能與模擬神經元很好地配合,在學習的同時持續更新芯片上的神經元。 最終,當訓練完成后,脈沖神經網絡就能在芯片上順利地執行任務了。

研究人員表示,他們的神經網絡在語音和視覺任務上,達到了與在計算機上執行任務的頂級脈沖神經網絡相同的準確性。 換句話說,該算法準確地了解到它需要做哪些改變來克服器件失配的問題。 蘇塞克斯大學的計算神經科學家托馬斯·諾沃特尼表示:「這個系統正如預期的那樣具有令人印象深刻的能效:運行所消耗的能量比標準處理器少1000倍左右。」 然而,弗倫克爾指出,神經擬態芯片仍然需要在為類似的語音和視覺識別任務而特別優化的硬件面前證明自己。 諾沃特尼也指出,這種方法可能難以擴展到大型的實際任務,因為它仍然需要在計算機和芯片之間來回搬運數據。 團隊的終極目標則是讓脈沖神經網絡可以自始至終地在神經擬態芯片上訓練和運行,而不需要借助傳統計算機。 不過,設計并生產所需的新一代芯片可能要數年的時間。

作者介紹

弗里德曼·曾克

瑞士蘇黎世弗雷德里希米歇爾生物醫療研究所的神經計算科學家。主研究方向為仿生的脈沖神經網絡的學習、記憶、信息處理過程,以及機器學習與神經計算科學的交匯。

約翰內斯·希密爾

德國海德堡大學物理學院專用集成電路實驗室主任、電子視覺研究組負責人。研究方向是混合態超大規模集成電路系統的信息處理應用,特別是仿生神經網絡模型的模擬應用方向。