Meta再放大招!VR新模型登CVPR Oral:像人一樣「讀」懂語音

一提到AR、VR體驗,聲音體驗都是最重要的一環。

無論是在元宇宙的party上狂歡,還是戴著增強現實 (AR) 眼鏡在客廳看家庭電影,聲效對用戶的沉浸式體驗都至關重要。

這不,Meta AI與Meta Reality Lab的音頻專家聯手,并與德克薩斯大學奧斯汀分校的研究人員合作,共同推出三個開源模型,用于對視頻中人聲和環境聲的同步解析。

「我們正嘗試建立這樣的MR與VR場景,我們相信人工智能將為每個沉浸式環境提供相匹配的音質」他們說。

人體所處的物理環境不同,人耳所感知的聲覺效果也不同。

例如,音樂會在大型場地和客廳的聲音有很大的不同。這是因為物理空間的幾何形狀、該區域的材料和表面,以及聲音來自何處的接近度,都影響了我們聽到音頻的方式。

因此,就需要AI模型來了解我們的環境信息,從而對聲覺與視覺信息進行匹配。

Meta的這項研究主要包括三個模型,分別是視覺聲覺匹配模型(Visual Acoustic Matching model)、基于視覺的去混響模型(Visually-Informed Dereverberation)、音視頻分離模型(Visual Voice)。

同時,這次研究成果還在CVPR 2022論壇上發表5分鐘演講,這也就是TOP5含金量的論文才有這待遇。

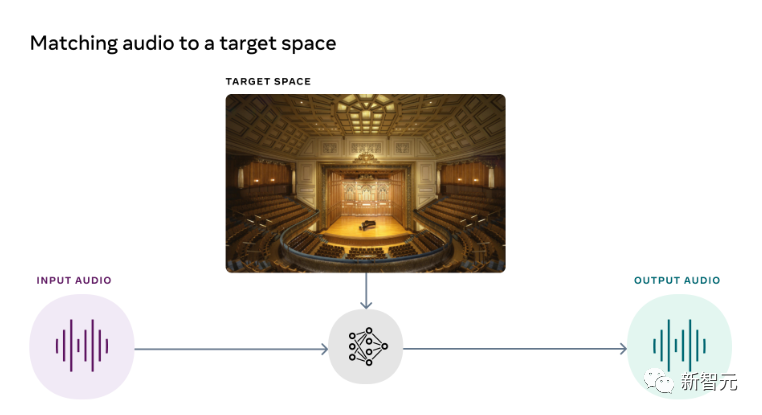

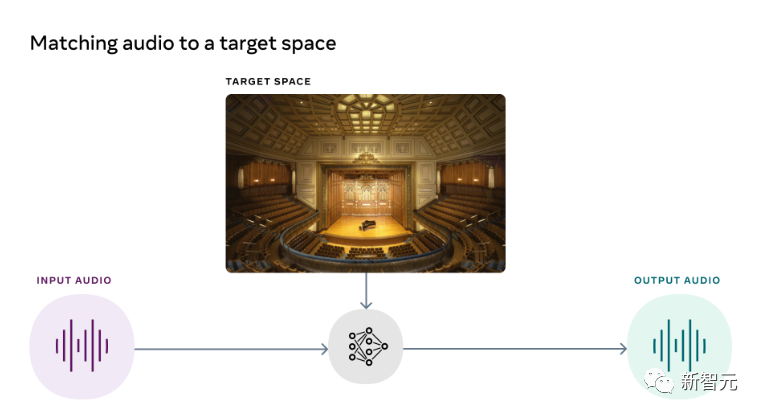

首先,視覺聲覺匹配模型可將視頻中的音頻轉換為目標環境中的聲覺效果,給定目標環境的圖像和源音頻的波形,模型就可以重新合成音頻以匹配目標房間的聲學。

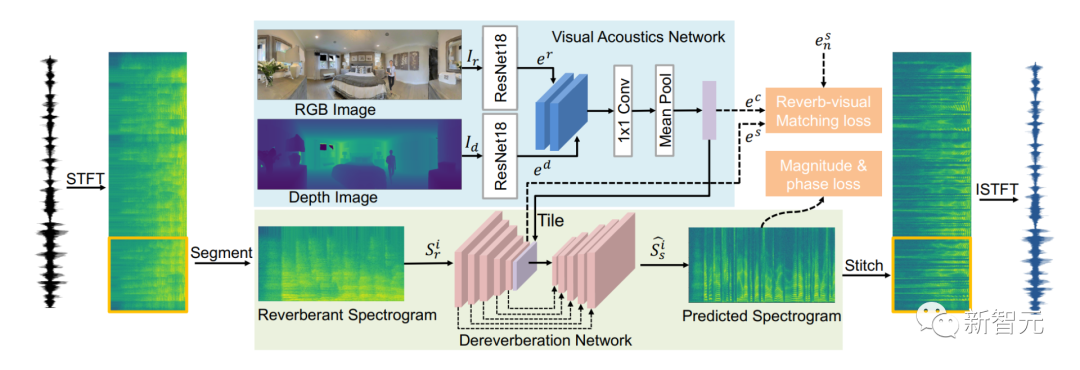

然后就是我們基于視覺的音頻去混響模型 (VIDA),它可根據觀察到的聲音和視覺場景來學習消除混響。

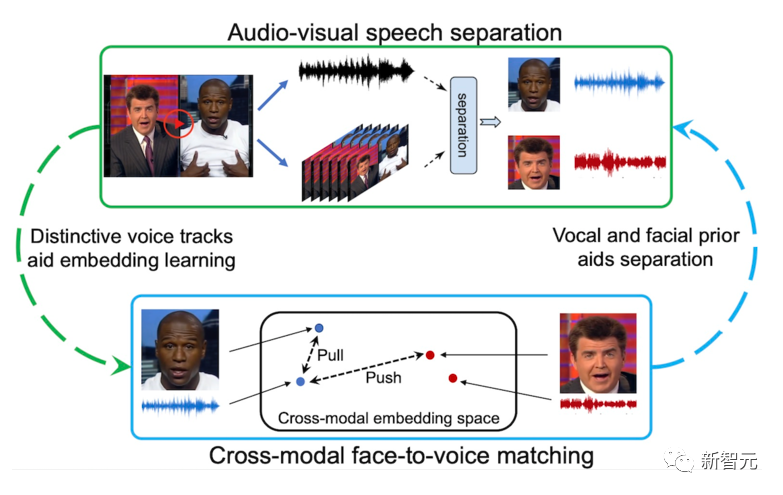

而Visual Voice模型則可跨模型將視頻中的音頻與視頻分離。

下面是這些模型的具體操作流程。

視覺和聲音的完美盛宴

眾所周知,音頻與場景不一致的視頻,會十分損傷我們的感知。

在過去,從不同的環境中獲取音頻和視頻,并進行匹配,一直是一個挑戰。

聲學仿真模型可用于生成房間脈沖響應,以重新創建房間的聲學效果,但這只有在幾何形狀(通常以 3D 網格的形式)和空間的材料屬性已知的情況下才能完成。不過,在大多數情況下,這些信息是無從獲取的。

當然,我們也可以僅根據在特定房間中捕獲的音頻來估計聲學特性,但通過這種方式,只能獲取十分有限的聲學信息,而且通常不會產生很好的結果。

為了解決這些挑戰,研究人員創建了一個自監督的視覺聲學匹配模型,稱為AViTAR。

它可以調整音頻,以匹配目標圖像的空間。研究人員使用了一個跨模態Transformer模型,其中輸入由圖像和音頻組成,允許Transformer執行跨模態推理,并生成與視覺輸入匹配的真實音頻輸出。

自監督訓練目標從外部網絡視頻中學習聲學匹配,盡管它們缺乏聲學不匹配的音頻和未標記的數據。

研究人員使用兩個數據集構建了這個任務。第一個數據集是建立在與SoundSpaces合作的基礎上,SoundSpaces是他們在2020年開放的AI視聽平臺。

建立在AI Habitat之上,SoundSpaces可以將來自「Replica」和「Matterport3D」數據集中的高保真、逼真的聲源模擬,插入到各種真實世界中。

第二個數據集由29萬段公開的英語視頻組成,這些視頻剪輯的內容是人們進行的3到10秒講話。

對于這兩個數據集,研究人員更專注室內環境下的語音。因為這些語音中的大部分可能與未來的很多場景用例相關,同時也因為人類對混響會如何影響語音有很強的先驗知識。

研究人員將「麥克風和攝像機需要放在一起,并且遠離聲源」作為篩選視頻的標準。因為根據聲源的位置以及人或麥克風所在的位置,聽到的聲音可能會有所不同。

對于網絡視頻,研究人員必須克服的一個挑戰是:他們只有與目標環境的聲學相匹配的音頻。

因此引入「失配」的概念,即首先消除混響。再將音頻與另一個環境的脈沖響應混合在一起以隨機化音效,并添加噪音以創建具有相同內容但不同音效的音頻。

研究人員在兩個數據集上驗證了這個模型,并根據三個標準測量了生成音頻的質量,包括它是否最接近真實音頻、房間聲學的正確性以及合成語音中保留的語音質量。

同時,他們也想看看人類是如何評價該模型的表現,評估的標準是「音響效果是否與參考圖像匹配」。

結果表明,該模型成功地將人類語音轉換為圖像中描繪的各種真實世界場景,而且優于傳統的純音頻聲學匹配。

對于視覺聲學匹配,研究者們感興趣的話題之一是重溫過去的記憶。想象一下,如果能夠戴上一副AR眼鏡,記憶中經歷過的場景就會悄然地浮現在眼前。

比如拿起一件芭蕾舞裙,就能看到孩子芭蕾舞演出的全息圖。音頻消除了混響,聽起來就像您在觀眾席的確切座位上所經歷的那樣。

真是妙不可言!

利用視覺信息,去除混響

下一個問題是,去混響。

盡管有些場景下,增加一些混響音效有助于讓聲音和視覺信息更加匹配,但在語音識別領域,更常見的做法是去混響。

混響會在環境中的表面和物體間反射,這種反射的后果反映在人的耳朵里,就是音質降低,而且會嚴重影響自動語音識別的精度。

通過去混響,可以盡量剝離環境影響,使語音更容易被識別和增強,比如,為有聽力障礙的人生成更準確的字幕,就需要對音源進行去混響處理。

過去的去混響方法往往根據音頻模式進行,這種方法并不能了解環境的完整聲學特征。更多靠的是人類語音的先驗知識,而沒有考慮到周圍的環境。

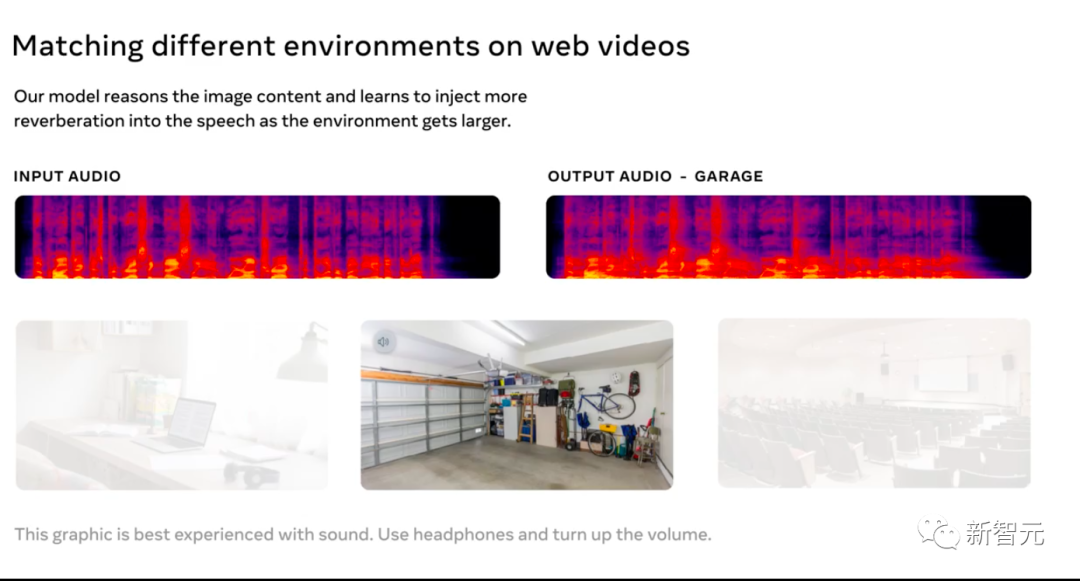

為了讓這一過程與周圍環境結合,需要融入更多的維度的信息,比如視覺信息。

結合了視覺信息的去混響模型稱為「VIDA」, 根據觀察到的聲音和視覺流來學習去混響,這些視覺信息包括房間的幾何形狀、材料和音源位置等,這些都會影響在音頻流中體現的混響效果。

有了這個思路,我們想從一個特定的地方獲取混響的音頻,并抽離房間的聲效。

研究人員開發了一個大規模的訓練數據集,使用真實的語音進行渲染。

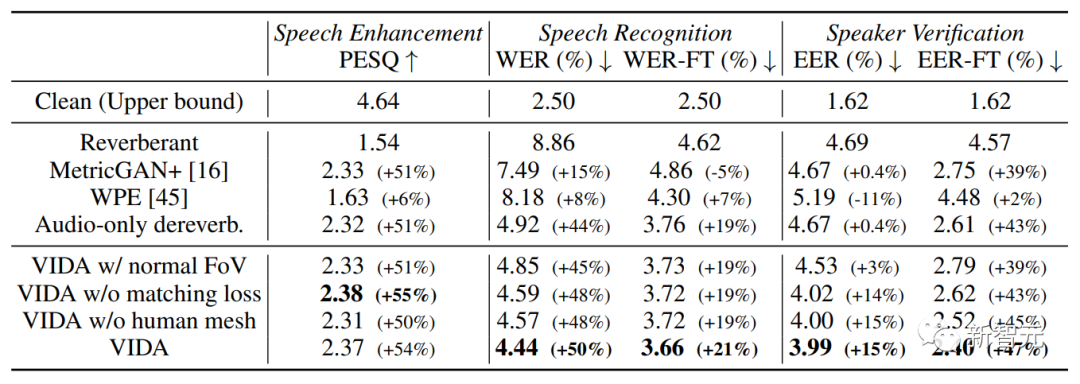

通過虛擬和真實的圖像上的演示表明,在語音增強、語音識別和說話人識別等任務上,VIDA實現了SOTA性能,比傳統的純音頻方法有了很大的提升。這對AR和VR應用中建立現實體驗是非常重要的。

VisualVoice:通過看和聽,理解語音

在復雜環境下,人類比AI更能理解語音的含義,因為我們不僅使用耳朵,還使用眼睛。

例如,我們看到某人的嘴在動,可能憑直覺就知道我們聽到的聲音一定是來自這個人。

Meta AI正在研究新的AI對話系統,就是要讓AI也學會這種本事,識別在對話中看到的和聽到的東西之間的細微關聯。

VisualVoice的學習方式類似于人類學習掌握新技能的方式,通過從未標記的視頻中學習視覺和聽覺線索,實現視聽語音分離。

對于機器來說,這創造了更好的感知,同時人類的感知力也會得到改善。

想象一下,能夠與來自世界各地的同事一起參加元宇宙中的小組會議,隨著他們在虛擬空間中的移動,加入更小的小組會議,期間,場景中的聲音混響和音色會根據環境做出相應調整。

的確,現在的AI 模型在視頻和圖像理解方面做得很好。

但要讓用戶有「很哇塞」聲如其境的體驗,我們需要「多模式的 AI 模型」。

也就是可同時獲取音頻、視頻和文本信息,并更具有豐富的環境理解的模型。

目前AViTAR 和 VIDA 目前僅支持單個圖像,離推向市場還存在距離。

「未來我們希望嘗試使用視頻和其他動態來捕捉空間的聲學特性。這將幫助我們更接近我們的目標,即創建了解現實世界環境以及人們如何體驗它們的多模式 AI」。

相關論文地址:

https://vision.cs.utexas.edu/projects/visual-acoustic-matching/

https://vision.cs.utexas.edu/projects/learning-audio-visual-dereverberation/

https://vision.cs.utexas.edu/projects/VisualVoice/

參考資料:

https://ai.facebook.com/blog/ai-driven-acoustic-synthesis-for-augmented-and-virtual-reality-experiences/

https://siliconangle.com/2022/06/24/meta-building-better-ai-driven-audio-virtual-reality/