清華大學周伯文:ChatGPT火爆揭示新一代協同與交互智能的高度重要性

以下為周伯文在機器之心 AI 科技年會上的演講內容,機器之心進行了不改變原意的編輯、整理:

謝謝機器之心的邀請,我是來自清華大學的周伯文。現在正是農歷年底,也是公歷年初,很高興有這樣一個邀請,與大家分享我們對過去一段時間人工智能發展趨勢的總結,以及對未來的一些思考。

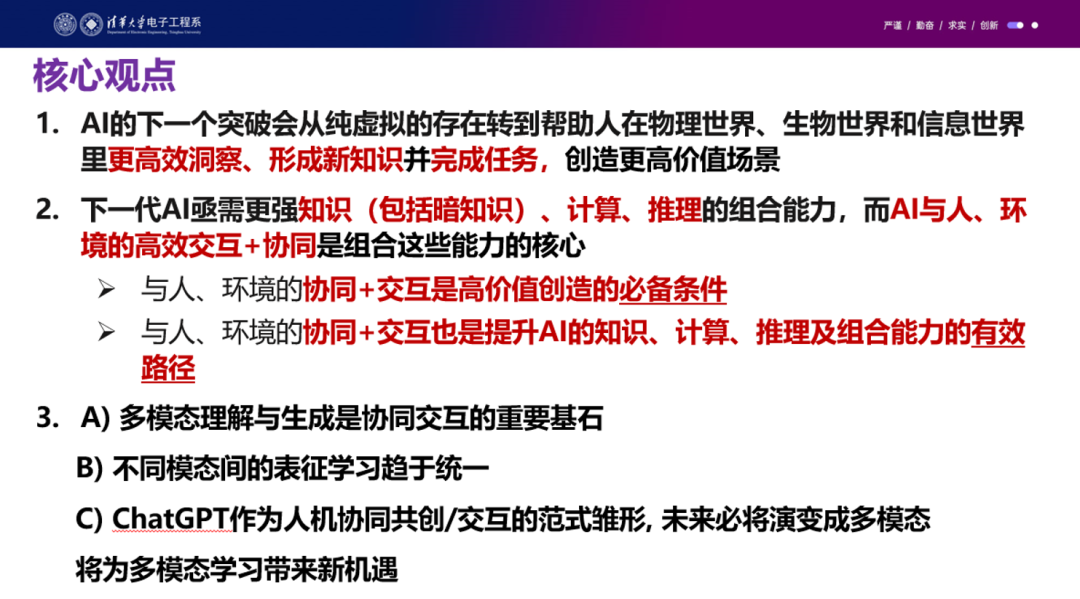

首先將核心想法分享出來,如果整個演講聽下來只能記住三點,請記住這三點:

第一,人工智能的下一個突破會從純虛擬的存在轉到幫助人在物理世界、生物世界和信息世界更高效洞察并形成新知識、完成任務,創造更高價值場景。

第二,下一代人工智能亟需加強知識(包括暗知識)、計算、推理的組合能力。這種組合能力非常重要,但我們認為人工智能與人、環境的高效交互+協同是組合這些能力的核心。

原因有二:一是因為與人和環境的協同和交互是高價值創造的必備條件,如果沒有 AI 和人的協同,AI 沒辦法獨立完成這些高價值場景;二是因為這種協同和交互也是提升 AI 在知識、計算、推理及組合能力的有效路徑。目前 AI 在計算方面進展很大,但在知識和推理及模塊的有效組合之間還存在很大的瓶頸。將人和環境的協同和交互加進來,能夠幫助去彌補 AI 在這些方面的一些瓶頸。

第三,關于多模態我們有三個判斷:一,多模態理解與生成是協同和交互的重要基石;二,過去兩年間,不同模態之間的表征學習趨于統一,這是一個非常好的基礎條件;三,最近大熱的 ChatGPT 作為人機協同共創和交互的未來范式雛形,未來必將演變成多模態,將為多模態學習帶來新機遇。盡管它還有很多很幼稚的地方,但這種這種范式的呈現給我們點明了未來的方向。

上述就是核心觀點。在今天的報告中,我會講一下協同交互智能與多模態學習,回顧最新的進展和機遇。

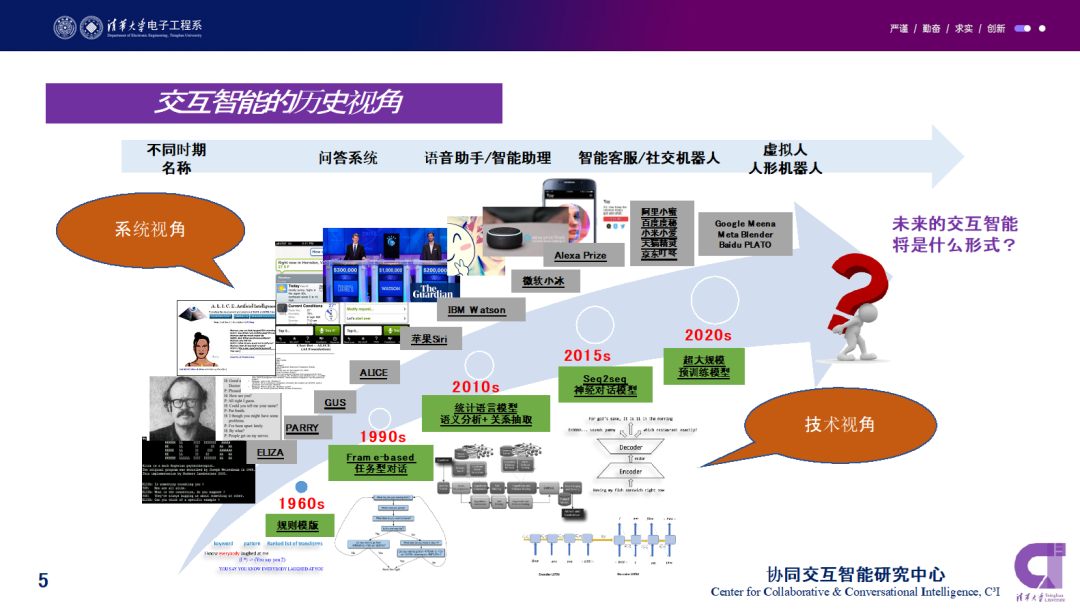

第一部分,從傳統上的交互智能來說,我們走了很長的路。首先想強調,今天講的協同和交互,跟原來的交互智能是截然不同的東西。歷史上的交互更多是給定一個訓練好的系統,把交互作為一個任務去完成,比如從 ELIZA 、IBM Watson、微軟小冰、Siri 到京東的智能客服。今天講的協同和交互,是把交互作為一個學習手段,把協同作為 AI 和人的分工,更好地完成人機協同融合,去洞察、形成新知識并完成任務。這是整個交互智能的歷史視角。可以觀察到,驅動進展的是技術視角的變化,包括從早期的規則模板到 Frame-based 任務型對話,再到統計語言模型、Seq2seq Model 、超大規模預訓練模型的產生。

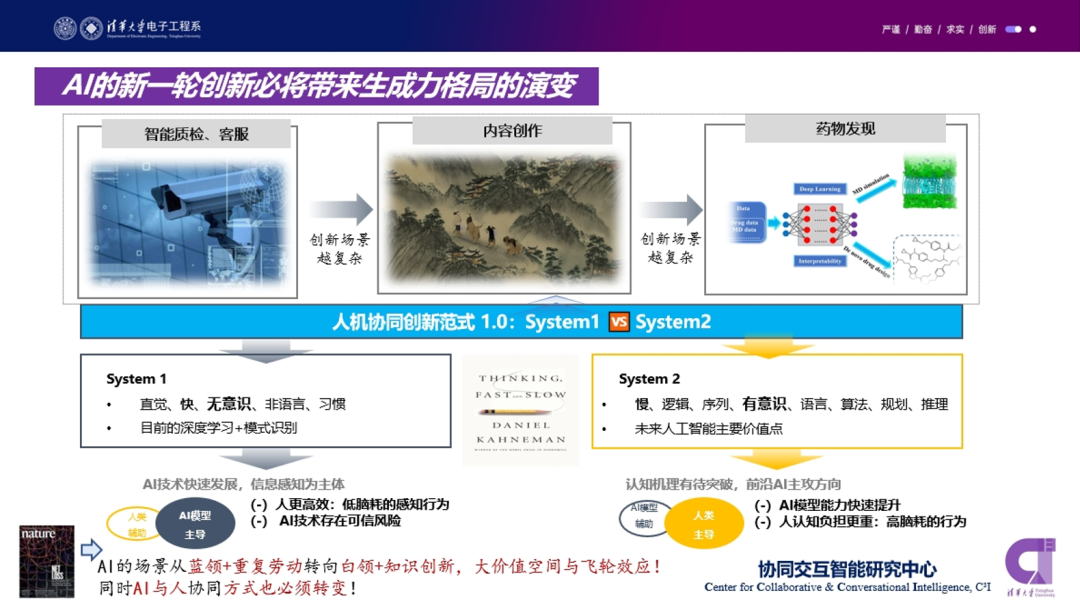

對于這些變化,我們有一個判斷是, AI 的新一輪創新必將帶來生產力格局的演變。幾年前,大家更多在講人工智能落地應用場景,聚焦在比如智能質檢、客服這些領域。但現在我們看到, AI 的創新場景越來越復雜,開始涉及藝術內容創造、藥物發現和新知識發現。2002 年諾貝經濟學獎得主丹尼爾·卡尼曼的一本暢銷書《Thinking Fast And Slow》(思考,快與慢)提出了人的思考方式有兩類:系統 1 的特點是直覺無意識,系統 2 有語言、算法、計算、邏輯在里邊。

過去幾年,人工智能更多用在系統 1 的場景里面,但未來包括現在正在發生的是,人工智能其實更善于且更適合從人機協同的角度去承擔更多的系統 2 的工作。因為系統1對人來說更高效,它是一個低腦耗、低認知負擔的一個任務,而系統 2 對人來說的認知負擔非常重。只不過以前人工智能的技術進展只能做系統 1,系統 2 做得不好,現在的趨勢是 AI 越來越向系統 2 靠攏。

從產業閉環的角度來講,AI 場景從過去藍領加重復勞動(質檢、客服等)變成了白領加知識創新的應用領域。毫無疑問,這將帶來更大的價值空間,同時帶來更多飛輪效應。什么叫飛輪效應?就是 AI 能夠幫助白領和知識工作者更好地去理解、洞察并形成新的知識。新的知識會幫助設計出更好的 AI ,更好的 AI 又能產生更多的新知識。

在這種趨勢下,我們必須清晰地認識到, AI 和人的協同方式必須轉變,因為 AI 不再是原來的系統 1 的 AI,而是變成系統 2 的 AI。在這種情況下,AI 應該怎樣協同和交互,是一個需要去思考的前沿問題。

為什么說 AI 需要具備知識、計算、推理的組合的能力?這里有一些多模態計算的例子,給大家參考:

比如左邊第一張圖,問穿紅色夾克的人在比賽結束時大概率會得第幾名,答案是第四名。要回答這樣的問題,除了圖像分割、語義分割要非常準確之外,還需要很多的常識推理和離散推理。這些東西是我們目前的 AI 系統非常非常缺乏的。

再比如第二個例子,是什么讓這些椅子能夠容易攜帶?答案是「foldable」(可折疊)。這里也有邏輯推理在里面。像這種系統 2 的挑戰,其實需要人工智能更多地迭代和演進。

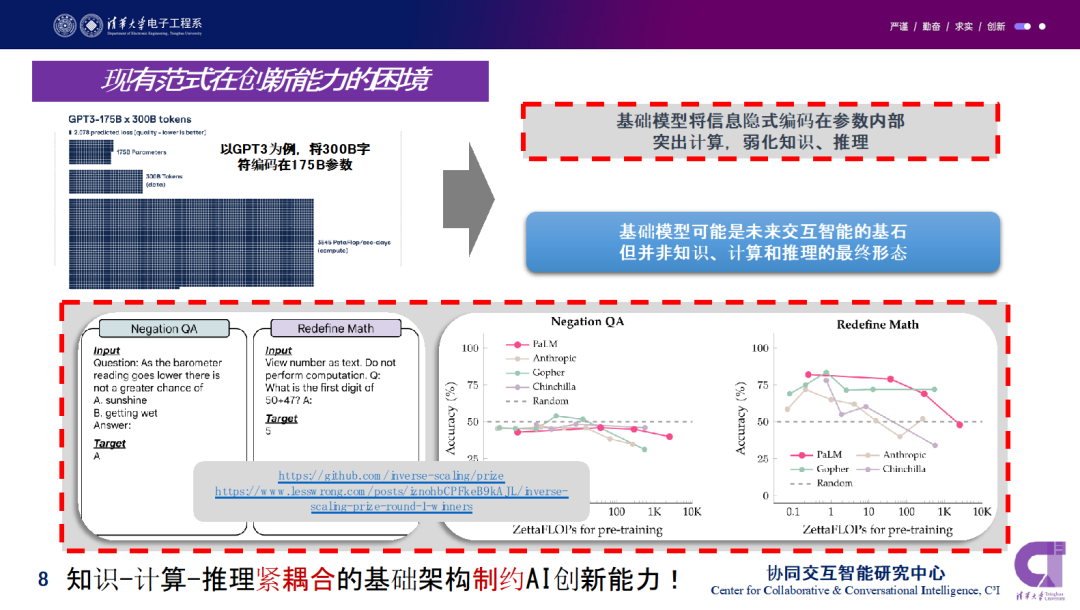

目前大家都知道的一個進展是大規模預訓練語言模型的突破。所以很自然的一個問題是,按照這種范式繼續往下走,能不能解決高價值應用場景和知識、計算與推理的有效融合?

以 GPT-3 為例,大家都知道它有 1750 億參數,它將信息編碼在參數內部和模型架構里面,突出計算,弱化知識和推理。一方面它在 “Scaling Law” 的支持下,數據越來越多,模型能力越來越強;另一方面, NYU 的幾位學者舉辦了一個叫做 “Inverse Scaling” 的挑戰賽,讓大家去尋找一些應用場景——模型越大、參數越大,性能表現越差。

上圖中有兩個例子:一個是叫 Negation QA,就是否定的否定,用雙重否定來測試預訓練模型的理解和推理能力。另外一個是 Redefine Math,該任務針對現有的數學計算問題,重新定義數學常數,以測試語言模型能否理解其含義并進行正確地計算。從右邊兩個圖大家能看出來,在這些 task 上面,模型參數越大,準確率反而越低。

這些例子其實都指出,基礎模型可能是未來交互智能的基石,我個人認為它是一個比「大模型」更重要的詞。很重要的一點在于,基礎模型并不是最終形態,要去解決碰到的這些問題,還需要更好地具象化。所以我提出,知識、計算和推理的有效組合是接下來非常需要去研究的方向。這種組合很重要的一點就是,人的協同和交互能夠推動這些基礎模型的升級。

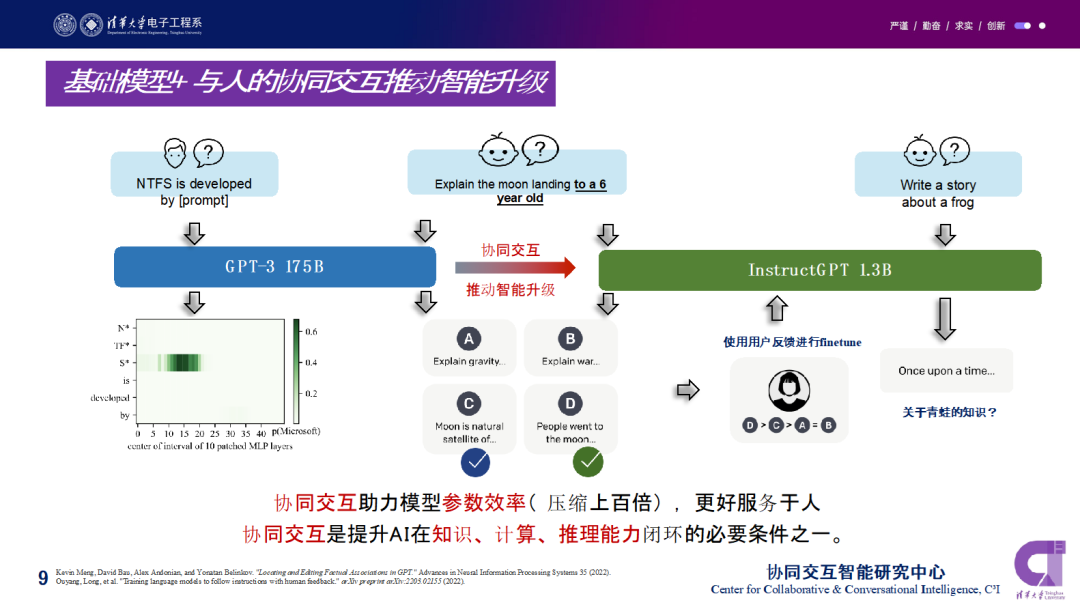

我們用另外一個基于 GPT3 模型「InstructGPT 」的例子來對比:

在某些問題上,GPT-3 可以根據 prompt 學習回答得非常好。但如果你要求給一個 6 歲的小孩解釋登月,從 GPT3 的基礎模型能力來講,它有各種角度去回答這個問題,因為它有大量的數值在后面。比如從重力的物理原理開始講,這是第一種;第二種是從歷史背景的角度去講,登月發生在美蘇冷戰期間,解釋冷戰是怎么發生的,如何導致了登月項目;第三種是從天文學的角度去講,月亮是地球的行星。第四種是從人類的角度開始講,比如人類一直想登月,中國的嫦娥有很多優美的傳說,西方也一樣。

但是目前的 GPT3 模型很難判斷哪種方式適合向 6 歲的小孩去講這么一個東西,它更多是基于 frequency 和語料的重要性,很大概率是基于一個 Wikipedia 的頁面去解釋什么是登月和登月工程,這顯然不能很好地服務 context。所以 InstructGPT 就在這個基礎上,讓用戶對 a、b、c、 d 這四類答案去進行選擇、打分。給出排序之后,這些反饋可以拿回來微調 GPT3 模型。這樣一來,如果接下來再有新的問題,比如「寫一個青蛙的故事」,這個模型的開頭就會變成 「once upon time」,一個非常適合小朋友聽故事的開頭方式。

這樣帶來的結果,第一點是模型毫無疑問更高效了,同時另外一點是它幫助減少了模型參數。InstructGPT 只有 13 億模型參數,相比于 GPT3 模型壓縮了上百倍,但是對特定場景能更好地服務于人。協同交互是提升 AI 在計算知識、計算、推理能力閉環的一個必要條件。

我們認為智能要包含知識、計算、推理三個基礎能力。我們看到計算目前進展非常快,當然計算也有算力的挑戰和數據的挑戰,但在知識和推理方面欠缺尤為明顯。

所以這里就提出問題:如何實現三者的閉環?加強 AI 和人、環境的主動協同交互能力,是不是能夠更好地幫助 AI 實現三者閉環?我們的學術觀點是需要引進 AI 和人、環境的協同與交互,一方面提升每個模塊的能力,另一方面將模塊進行組合起來去形成協同交互。

呼應一下我們開篇的觀點,下一個 AI 的突破會從虛擬的存在轉到幫助人在物理世界、生物世界和信息世界更高效洞察新知識并完成任務。

在清華的協同交互智能研究中心,我們主要提出并且在做這些學術問題的研究:

第一個是我們提出新的協同觀點,就是我們研究讓 AI 更多去負責系統 2,讓人更多負責系統1。這帶來的第一個挑戰就是 AI 本身要更往邏輯推理、高計算、高復合的這種任務上轉移,而不是僅僅去做系統 1 的模式識別及直覺的工作。而帶來的第二個挑戰是,在這種新的分工下,人和 AI 該如何協同。這是兩個研究方向。

第二個是在 AI 和人的協同中,要讓 AI 更好地去學習人在回路的強化學習。我們要去研究更好的 AI 持續學習,要在 AI 和環境、人的協同里面,做非常多的多模態表征增強的工作。多模態是協同的一個重要渠道,同時要加強對話式交互的增強機制。

還有一種非常重要的協同,就是 AI 和環境的協同。AI 需要適應不同的環境,這些環境適應總結成一句話是:云到邊的自適應,邊到云的自演化。云到邊的自適應大家很容易理解,在不同的算力和通信條件下,如何讓這些基礎模型更好地適配這些環境;邊到云的自演化,其實是讓邊緣端的智能反向幫助基礎模型更好地迭代。換句話講,這是小模型和大模型之間的一種協同和交互。但是我們不認為這種協同和交互是單向的,只能是大模型通過知識蒸餾、剪枝來獲取小模型。我們認為小模型的迭代和交互應該有更有效的路徑傳導到基礎模型上。

我們認為,以上這三個技術路徑非常重要。下面會有一個底層的支撐——或許我們現在的研究會帶來可信賴人工智能的一些基礎理論突破,因為知識、計算、推理進行更好的組合之后,能更好地去解決原來由知識、計算、推理融合成的黑箱的可解釋性、魯棒性、泛化性這些挑戰。我們希望通過可分拆又可組合的方式更好地獲得這種可信賴人工智能的進步。如果一個人不能透明地看到人工智能推理過程,其實很難相信人工智能的系統 2 的結果。

從另外一個角度來看這個問題。大家知道最近 ChatGPT 非常熱,所以我們做很多工作無法繞開 ChatGPT。當然也包括更早一段時間 Facebook 提出的用 AI 幫助寫科學論文的一個系統 Galactica。我們發現它們都是需要人和環境的協同來創造場景。這些價值場景原來其實也沒有,但現在開始變成了可能。只是這種可能一旦脫離人的協同和交互,我們馬上發現這些 AI 系統 fall short。

包括 Galactica ,它能寫出非常通暢的論文,但是很多基本事實和引用文獻都是錯誤的。比如作者名字是真的,但是 title 一部分真、一部分假,或者多篇論文被合到一起去了。我想強調的是,目前的 AI 是沒有能力去完成這種完整的知識、計算、推理的閉環,所以必須要需要去人 involve。

雖然 Galactica 是馬上就下線了,但它的目的不是讓大家用它去獨立完成論文和科研,而是更好地幫助人,所以人必須在閉環里面。這是另一角度強調了人的協同和交互是非常重要的一個基礎條件。

接下來講在協同交互背景下我如何看多模態學習的進展和新機遇。首先我覺得多模態在最近這段時間進展也非常快,開始帶來幾個明顯的趨勢。

首先,在建模和表征結構的維度上,多模態之間在趨同。比如,過去在圖像、視頻中,大家都是用 CNN,因為文本是 Sequence Model,大家更多是用 RNN 和 LSTM,但現在不管是什么模態,大家都可以把 token 化之后的輸入全部當成一個 Sequence 或者 Graph Model ,用自注意力加多頭機制來進行處理。最近幾年受歡迎的 Transformer 架構,讓基本上所有模型的結構都在趨同。

但一個深層的問題在于,為什么 Transformer 的這種架構對所有模態表征都具備優勢?我們也有一些思考,結論就是,Transformer 可以在更普適的幾何拓撲空間中對不同模態進行建模,進一步降低了多模態之間的建模壁壘。所以 Transformer 的這么一個優勢,正好構建了多模態方向上的這種架構趨同性的基礎。

其次,我們發現多模態的預訓練維度也在趨同。最早的 Bert 是在自然語言領域提出來的,用這種 Mask 的模式引爆了預訓練模型。最近的工作,包括何愷明老師的 MAE 工作,包括語音領域的工作都不斷地在用類似的 Idea。通過這種 Mask 的方式,在不同的模態之間形成了趨同的預訓練模型架構。現在模態間的預訓練壁壘也被打通了,預訓練模型的維度也進一步趨同了。像 MAE 把 BERT 的預訓練方式引入到了視覺、 圖像、語音等各個模態里面。所以 Mask 這種機制在多種模態中呈現了普適性。

第三個趨勢是預架構參數和預訓練目標的統一。目前用 Transformer 架構對文本、圖像、音頻進行建模,并在多個任務之間可以開始共享參數。

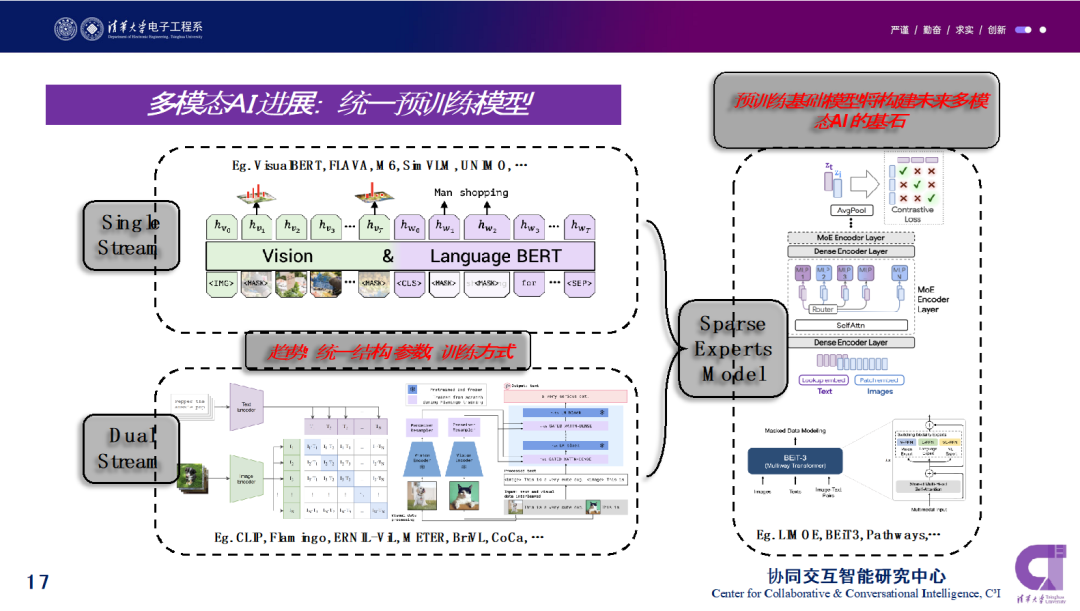

具體來講,目前的多模態預訓練模型主要還是分為單流和雙流模型。在單流架構中,我們假設兩種模型之間的潛在相關性和對齊性是比較簡單的。雙流架構假設需要分離模態內部的模態類的交互和跨模態之間的這種交互,來獲得更好的多模態表示,能夠對于不同的模態信息進行編碼融合。

問題在于有沒有更好的辦法來統一這些思路。目前的趨勢是,稀疏性和模塊性可能是更強大的多模態、多任務之間的兩個關鍵屬性。稀疏的專家模型可以被視為單流和雙流之間的一種平衡稀疏的專家模型系統,它能夠處理不同專家、不同模態和任務。

我們提的一個問題是,能不能用協同交互的模式,把谷歌 Pathway 模型在特定的這些任務上也進行百倍的壓縮,但保留這種稀疏和模塊化的結構?這類工作非常值得后續研究。

再回到對話協同交互方面,我認為 ChatGPT 是當前非常重要的一個工作,它的價值核心是在協同交互方向點亮了一個新的里程碑,它能用在學術寫作、代碼生成、百科問答、指令理解等等工作上。預訓練基礎模型能夠賦予交互智能問答、寫作、代碼生成等各項能力。ChatGPT 的核心能力提升,是在 GPT 3的基礎上加上了人在回路的強化學習,加上了人對不同答案的選擇和排序。

雖然目前在 ChatGPT 中的呈現形式是以自然語言為主要載體,但整個交互的模態一定會拓展到這種多模態。人的協同和交互在多模態的場景下,其實會更高效,也會帶來更多的信息量,也會帶來各種模態的知識的融合。

如果把這些人在回路的協同交互能力和 AI 生成能力融合在一起,還能做非常多的事情。比如協同交互 ChatGPT 模式和 Diffusion Model 融合進行產品創新和設計創新。在協同交互過程中, ChatGPT 這樣的模型不斷地去尋找當前設計的主流的趨勢和特定消費者的喜好,通過對消費者場景情感體驗的洞察,對設計趨勢、技術趨勢的判斷,再結合對大量圖片的分析,可以通過與設計師或專業的產品經理進行多輪協同交化的方式實現共創。

在一些非常細分的場景下,其實很多人是沒有先驗知識的,比如智能家居領域,但是人可以通過多輪人機協同交互來生成這些創意設計,再通過 Stable Diffusion Model,將這些人類創意的核心關鍵詞場景體驗轉化成高保真還原的設計原圖。協同交互能夠幫助人們進行更高效的產品創新、設計創新,這也是我們銜遠科技在做的事情。

多模態的工作越來越重要,因此我們中心牽頭發起“大規模多模態學習“ 的 TPAMI 2023特刊,目標是匯集來自多個學科(如:計算機視覺、自然語言處理、機器學習、深度學習、智慧醫療、生物信息學、認知科學)的觀點,提出重要的科學問題,并發現研究機會,以應對深度學習和大數據時代多模態學習領域的突出挑戰。