AI知道你腦子里在想什么,還幫你畫了出來,項目代碼已開源

在科幻小說《三體》中,企圖占領地球的三體人被賦予了一個很獨特的設定:通過腦電波共享信息,彼此之間思維透明、不善陰謀。在他們那里,想和說是同一個詞。而人類則利用自身思維不透明的特性想出了「面壁計劃」,最終成功騙過三體人,取得了階段性勝利。

那么問題來了,人類的思維真的是完全不透明的嗎?隨著一些技術手段的出現,這個問題的答案似乎沒有那么絕對了。很多研究者都在嘗試解碼人類思維的奧秘,將一些大腦中的信號解碼為文字、圖像等信息。

最近,兩個研究團隊同時在圖像解碼方向取得了重要進展,而且相關論文都被 CVPR 2023接收了。

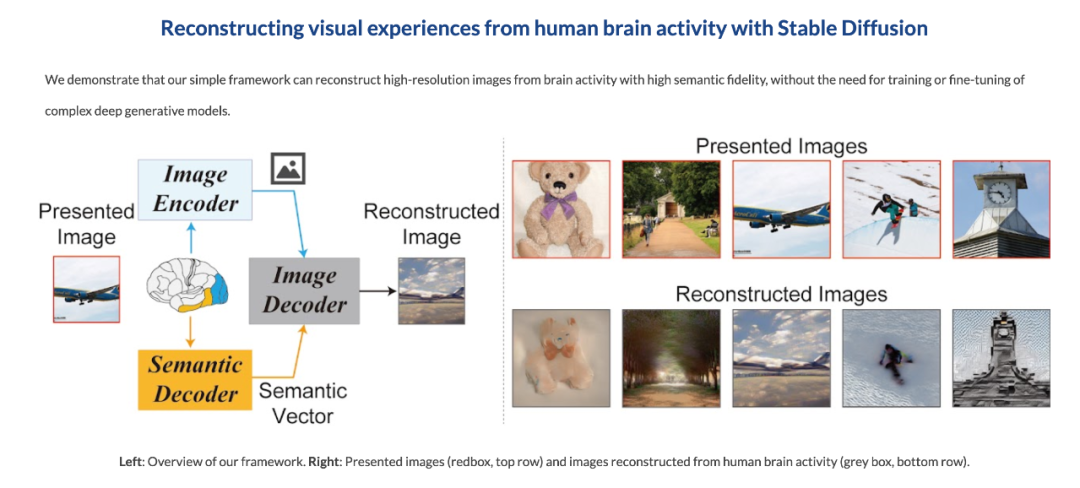

第一個團隊來自大阪大學,他們使用最近非常火的 Stable Diffusion,能從功能磁共振成像 (fMRI) 獲得的人腦活動圖像中重建大腦活動中的高分辨率、高精準圖像(參見《Stable Diffusion 讀你大腦信號就能重現圖像,研究還被 CVPR 接收了》)。

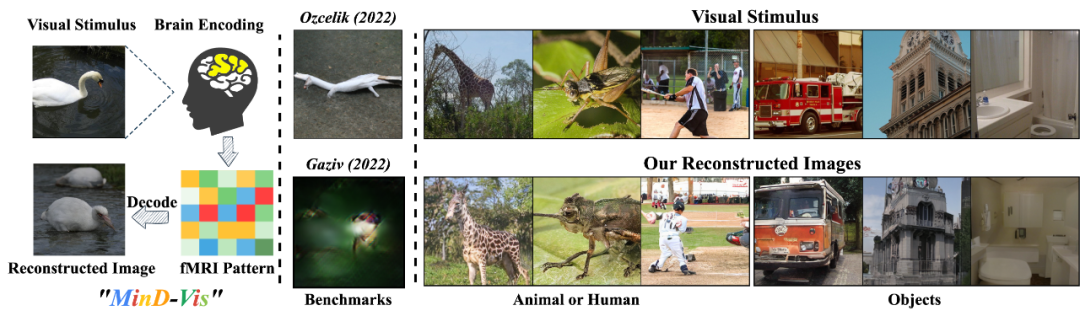

巧合的是,幾乎同一時間,來自新加坡國立大學、香港中文大學和斯坦福大學的華人團隊也做出了類似的成果。他們開發了一款名為「MinD-Vis」的人類視覺解碼器,通過預訓練的一個 mask modeling 和 latent diffusion model,能從 fMRI 數據中直接解碼出人類視覺刺激。它生成的這些圖像不僅有合理的細節,而且還準確地呈現了圖像的語義和特征(如紋理和形狀)。目前,這項研究的代碼已經開源。

論文題目:Seeing Beyond the Brain: Conditional Diffusion Model with Sparse Masked Modeling for Vision Decoding

- 論文鏈接:http://arxiv.org/abs/2211.06956

- 代碼鏈接:https://github.com/zjc062/mind-vis

- 項目鏈接:https://mind-vis.github.io/

接下來我們將詳細介紹這篇論文。

研究概覽

「所見即所思」。

人類的感知和先前知識在大腦中有著密切的關聯,我們對世界的感知不僅受到客觀刺激的影響,也受到我們的經驗影響,這些影響形成了復雜的大腦活動。理解這些大腦活動并解碼信息是認知神經科學的重要目標之一,其中解碼視覺信息是一個具有挑戰性的問題。

功能性磁共振成像 (fMRI) 是一種常用的非侵入性且有效的方法,可以用于恢復視覺信息,如圖像類別。

MinD-Vis 的目的是探索使用深度學習模型直接從 fMRI 數據中解碼視覺刺激的可能性。

以往的方法直接從 fMRI 數據中解碼復雜神經活動時,存在缺乏 {fMRI - 圖像} 配對和有效的生物學指導的問題,所以重建的圖像通常模糊且在語義上無意義。因此,有效地學習 fMRI 表征是一項重要的挑戰,這有助于建立大腦活動與視覺刺激之間的聯系。

此外,個體變異性使問題更加復雜,我們需要從大型數據集中學習表征,并且放寬從 fMRI 生成條件合成的限制。

因此,作者認為使用自監督學習 (Self-supervised learning with pre-text task) 加上大規模生成模型可以使模型在相對較小的數據集上微調后具有上下文知識和令人驚嘆的生成能力。

在上述分析的驅動下,MinD-Vis 提出了人類視覺解碼的掩碼信號建模與雙條件潛在擴散模型,具體貢獻如下:

- 提出了 Sparse Coded-Masked Brain Modeling(SC-MBM),作為受生物學指導的有效視覺解碼大腦特征預訓練學習器。

- 通過增加雙條件潛在擴散模型(DC-LDM),在相同語義下強化了解碼一致性,同時允許生成方差。

- 結合 SC-MBM 的表示能力和 DC-LDM 的生成能力,MinD-Vis 生成的圖像在保留語義信息的同時更加合理。

- 在多個數據集上進行了定量和定性測試。

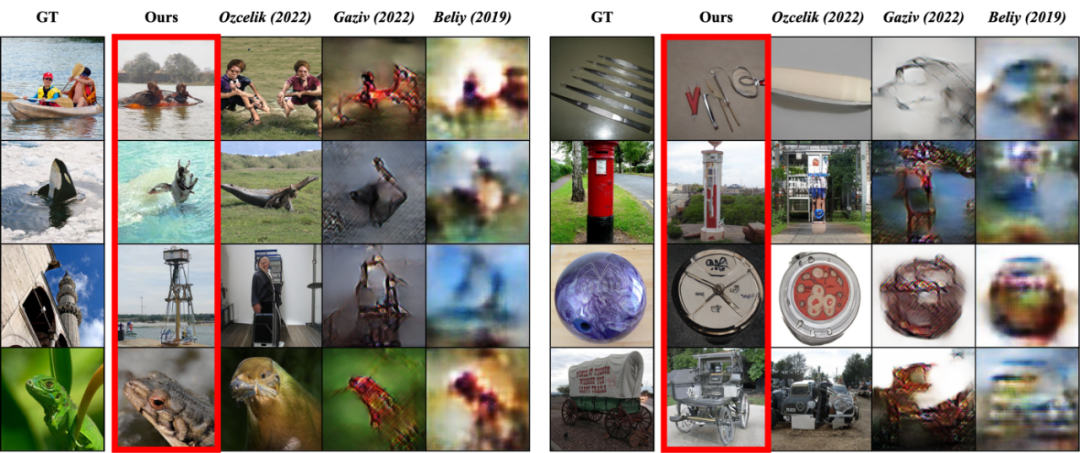

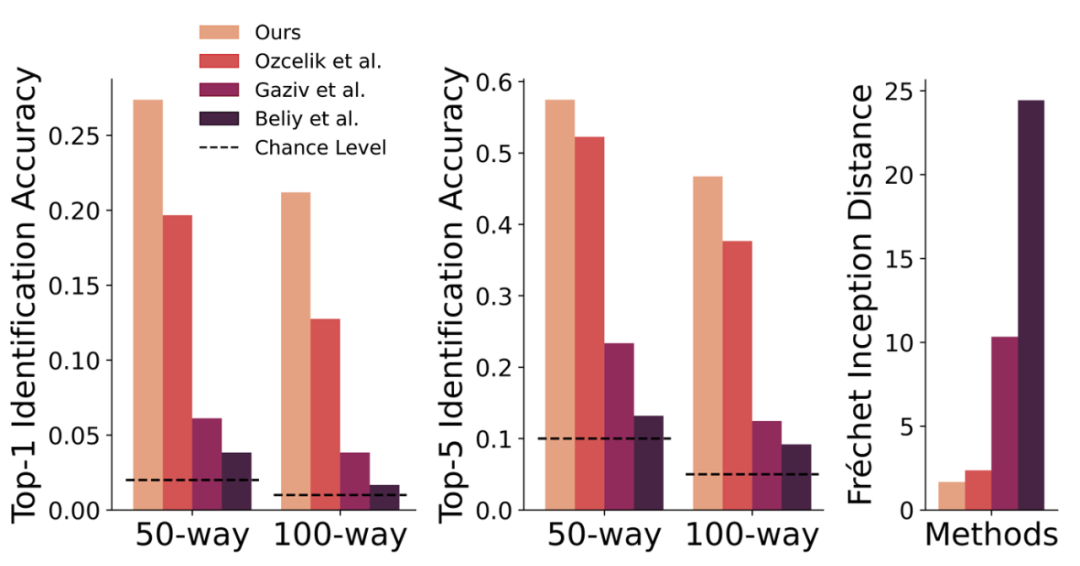

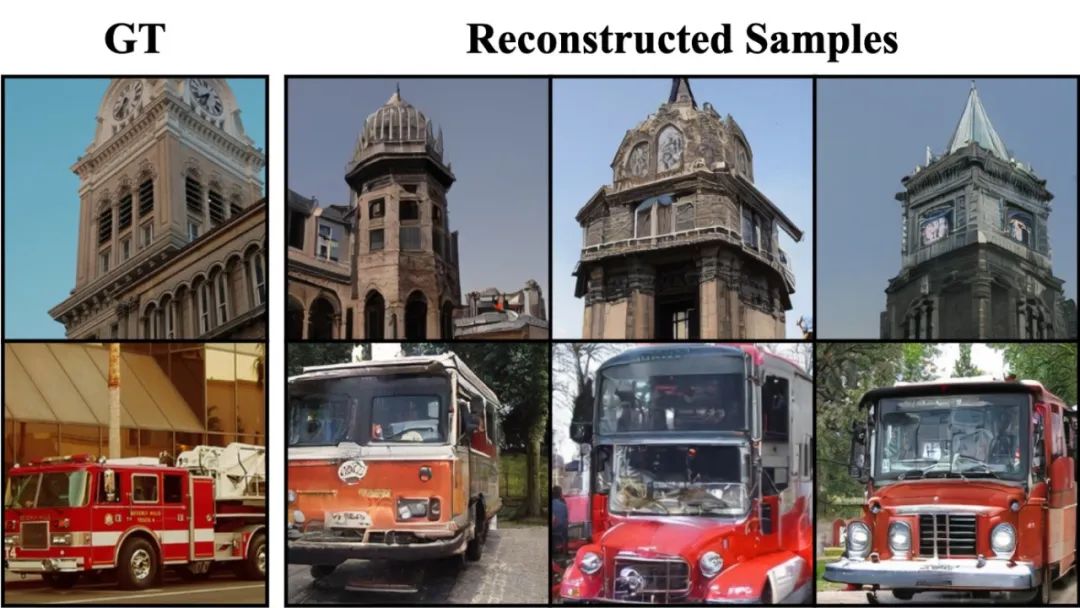

與過往的方法進行對比 – 生成質量

與過往的方法進行對比 – 評判指標的定量對比

自監督學習 + 大規模生成模型

由于收集 {fMRI - 圖像} 配對非常昂貴且耗時,這個任務一直存在缺乏數據標注的問題。另外,每個數據集、每個個體的數據都會存在一定的域偏移。

在這個任務中,研究人員的目標是建立大腦活動與視覺刺激之間的聯系,并由此生成相應的圖像信息。

為此,他們使用了自監督學習和大規模生成模型。他們認為這種方法可以使模型在相對較小的數據集上進行微調,并獲得上下文知識和令人驚嘆的生成能力。

MinD-Vis 框架

接下來將詳細介紹 MinD-Vis 框架,并介紹設計的理由和思路。

fMRI 數據有這些特點和問題:

- fMRI 用 3D 體素(voxel)來測量大腦血氧水平相關(BOLD)的變化,來觀測大腦活動變化。鄰近體素的幅度通常相似,表明 fMRI 數據中存在空間冗余。

- 在計算 fMRI 數據時,通常會提取 Region of Interest (ROI) 并把數據打成 1D vector。在這個任務里,只提取大腦 visual cortex 的信號,因此,體素的數量(約為 4000)遠比圖像里像素點的數量(256*256*3)少,這樣的數據在緯度方面和通常處理圖像數據的方式存在相當的差距。

- 由于個體差異,實驗設計的差異,腦信號的復雜程度,每個數據集、每個個體的數據都會存在一定的域偏移。

- 對于一個固定的視覺刺激,研究者希望模型還原的圖像在語義上一致;但由于個體差異,每個人看到這個視覺刺激的反應不同,研究者又希望模型有一定的方差和靈活性。

為了解決這些問題, MinD-Vis 包含兩個階段:

- 利用大規模的 fMRI 數據集來訓練 Masked Autoencoder,來學習 fMRI representation。

- 將預訓練好的 fMRI encoder 與 LDM 通過 cross-attention conditioning 和 time-step conditioning 相集成進行 double conditioning,以進行條件合成。然后,通過使用配對的 {fMRI, Image} 來共同 finetune LDM 中的 cross attention head。

下面將在這里詳細介紹這兩步。

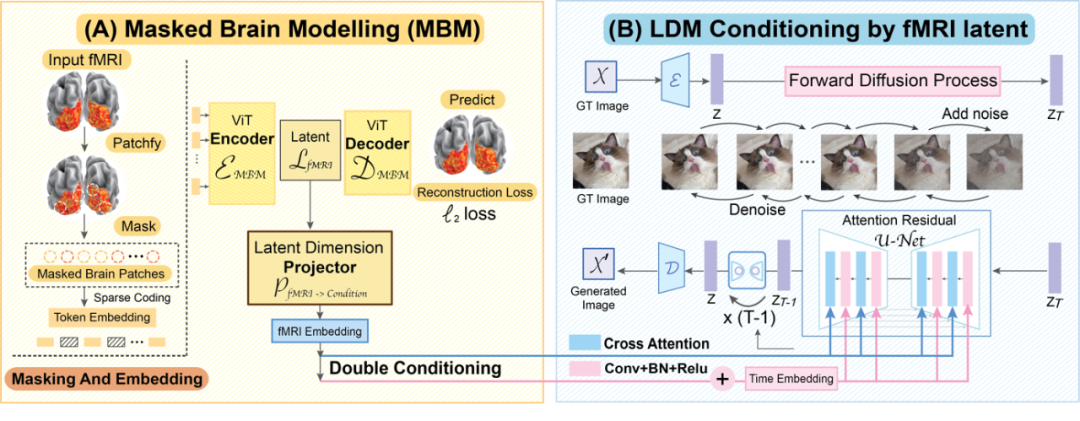

MinD-Vis Overview?

(A)Sparse-Coded Masked Brain Modeling (SC-MBM) (MinD-Vis Overview 左)

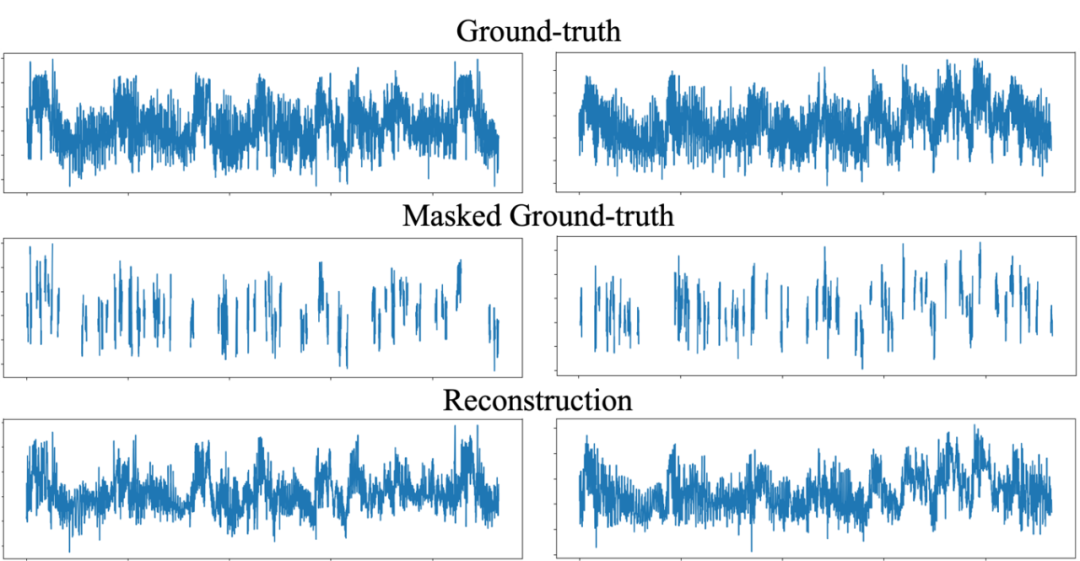

由于 fMRI 空間信息冗余,即使大部分被遮蓋,fMRI 數據仍然可以恢復。因此,在 MinD-Vis 的第一階段,為了節省計算時間,大部分 fMRI 數據被遮蓋了。這里,作者使用了類似于 Masked Autoencoder 的做法:

- 將 fMRI voxels 劃分成 patches

- 使用有等于 patches 大小的步長的 1D 卷積層轉換成 embedding

- 把剩余的 fMRI patch 加入 positional embedding 后作為 vision transformer 的輸入

- 解碼得到重建的數據

- 計算重建的數據與原數據的 loss

- 通過反向傳播優化模型,使得重建的數據盡可能地與原數據相似

- 重復 2-6 的步驟,訓練出最終模型

SC-MBM 能有效還原被掩蓋的 fMRI 信息

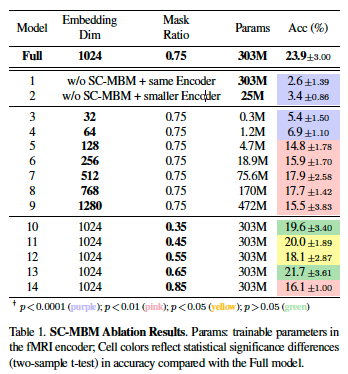

這個設計和 Masked Autoencoder 有什么區別?

- 當 mask modelling 應用于自然圖像時,模型一般使用等于或略大于 1 的 embedding-to-patch-size ratio。

- 在這個任務中,作者使用了比較大的 embedding-to-patch-size ratio,這能顯著提高信息容量,為 fMRI 創建了大的表征空間,這種設計也對應于大腦中信息的稀疏編碼*。

SC-MBM 的消融實驗

(B)Double-Conditioned LDM (DC-LDM) (MinD-Vis Overview 右)

在 Stage A 中進行了 large-scale context learning 之后,fMRI encoder 可以將 fMRI 數據轉換為具有局部性約束的 sparse representation。在這里,作者將解碼任務表述為條件生成問題,并使用預訓練的 LDM 來解決此問題。

- LDM 在圖像的潛在空間上操作,fMRI 數據 z 作為條件信息,目標是學習通過反向擴散過程形成圖像。

- 在圖像生成任務中,多樣性和一致性是相反的目標,fMRI 到圖像更依賴于生成一致性。

- 為了確保生成一致性,作者將 cross attention conditioning 和 time step conditioning 相結合,并在 UNet 的中間層使用帶有 time embedding 的條件機制。

- 他們進一步把優化目標式重新表述為雙重調節交替式。

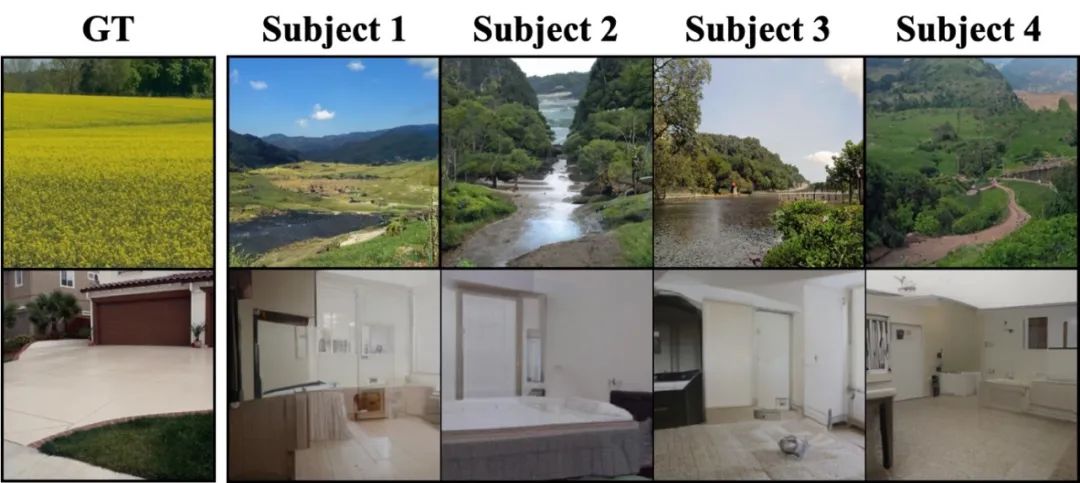

我們通過多次解碼不同隨機狀態的圖像證明了我們方法的穩定性。

微調

在 fMRI encoder 通過 SC-MBM 預訓練后,它與預先訓練的 LDM 通過 double conditioning 整合在一起。在這里,作者:

- 將 encoder 的輸出使用卷積層合并到 latent dimension 中;

- 聯合優化 fMRI encoder、cross attention heads 和 projection heads,其他部分固定;

- 微調 cross attention heads 是連接 pre-trained conditioning space 和 fMRI latent space 的關鍵;

- 在通過 fMRI 圖像對端到端進行微調的過程中,通過 large-capacity fMRI representations 將學到 fMRI 和圖像特征之間更清晰的聯系。

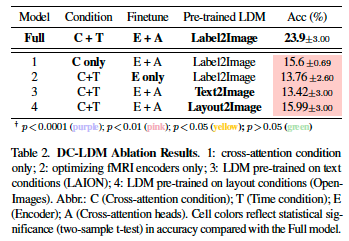

DC-LDM 的消融實驗?

額外細節

意外的是,MinD-Vis 可以解碼出一些在 ground truth 圖像里并不實際存在,但與圖片內容十分相關的細節。比如說,當圖片是自然風景時,MinD-Vis 解碼出了河流和藍天;在提供房屋時,MinD-Vis 解碼出了相似的室內裝飾。這既有好處又有壞處。好處在于,這說明我們能夠解碼出想象到的內容;壞處在于,這可能會影響對解碼結果的評估。

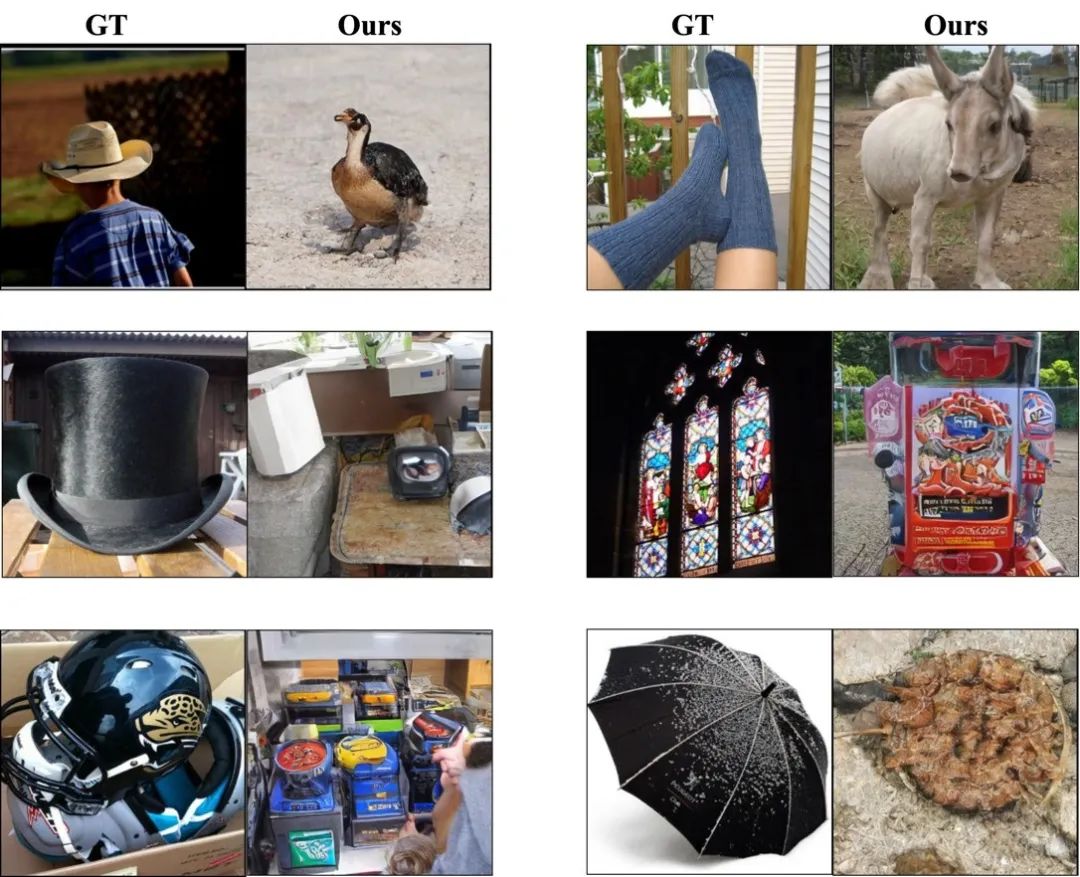

喜聞樂見的翻車集錦

作者認為,在訓練樣本數量較少的情況下,刺激的解碼難度會有所不同。例如,GOD 數據集包含的動物訓練樣本比服裝多。這意味著一個語義上類似于 “毛茸茸” 的詞更可能被解碼為動物而不是服裝,如上圖所示,其中一只襪子被解碼為一只羊。

實驗設置

數據集

在這里,作者用了三個公開數據集。

- 第一階段的預訓練:用了 Human Connectome Project,它提供 136,000 個 fMRI 數據片段,沒有圖像,只有 fMRI。

- 微調 Encoder 和第二階段的生成模型:用了 Generic Object Decoding Dataset (GOD) 和 Brain, Object, Landscape Dataset (BOLD5000) 數據集。這兩個數據集分別提供了 1250 張和 5254 張 {fMRI, Image} 配對,其中,分別取了 50 張和 113 張作為測試集。

模型結構

本文模型結構的設計(ViT 和擴散模型)主要是參照過去的文獻。模型參數細節請參照正文。同樣地,他們也采用了一種不對稱的體系結構:編碼器旨在學習有意義的 fMRI 表示,而解碼器試圖預測被遮蓋的塊。因此,我們遵循以前的設計,使解碼器更小,預訓練后我們將其舍棄。

評判指標

跟過往的文獻一樣,作者也使用了 n-way top-1 和 top-5 分類準確率來評估結果的語義正確性。這是一種在多次試驗中,通過計算 n-1 個隨機選擇的類別和正確類別的 top-1 和 top-5 分類準確率來評估結果的方法。與先前的方法不同,他們在這里采用了更直接、可復制的評估方法,即使用預訓練的 ImageNet1K 分類器來判斷生成圖像的語義正確性,而不是使用 handcrafted features。此外,他們還使用了 Fréchet inception distance(FID)作為參考來評估生成圖像的質量。但是,由于數據集中圖像數量有限,因此 FID 可能無法完美地評估圖像分布。

效果

這篇文章的實驗是在個體水平上進行的,即模型在同一個個體上進行訓練和測試。為了與之前的文獻進行比較,在這里報告了 GOD 數據集第三位被試的結果,并在附錄中列出了其他被試的結果。

寫在最后

通過這個項目,作者展示了通過 fMRI 還原人腦視覺信息的可行性。然而,這個領域有很多問題需要解決,例如如何更好地處理個體之間的差異性,如何減少噪聲和干擾對解碼的影響,如何將 fMRI 解碼與其他神經科學技術結合起來,以更全面地理解人類大腦的機制和功能。同時,我們也需要更好地了解和尊重人類大腦和個體隱私方面的倫理和法律問題。

此外,我們還需要探索更廣泛的應用場景,例如醫學和人機交互等領域,以便將這項技術轉化為實際應用。在醫學領域,fMRI 解碼技術未來可能可以被用來幫助視覺障礙人士、聽覺障礙人士、甚至全身癱瘓患者等特殊群體來解碼出他們的想法。這些人由于身體上的障礙,無法通過傳統的交流方式來表達自己的思想和意愿。通過使用 fMRI 技術,科學家們可以解碼他們的大腦活動,從而獲取他們的想法和意愿,進而與他們進行更加自然和高效的交流。在人機交互領域,fMRI 解碼技術可以被用來開發更加智能和自適應的人機界面和控制系統,例如通過解碼用戶的大腦活動來實現更加自然和高效的人機交互體驗。

我們相信,在大規模數據集 + 大模型 + 算力的加持下,fMRI 解碼將會有更加廣泛和深遠的影響,推動認知神經科學和人工智能領域的發展。

注:*使用稀疏編碼在腦中學習視覺刺激表示的生物學基礎:稀疏編碼曾被提出來作為感覺信息表征的一種策略。研究表明,視覺刺激在視覺皮層中被稀疏編碼,這樣可以增加信息傳輸效率并減少腦中的冗余。使用 fMRI 可以從視覺皮層收集的少量數據中重建自然場景的視覺內容。稀疏編碼可能是計算機視覺中編碼的有效方式。文章中提到了 SC-MBM 方法,它將 fMRI 數據分成小塊來引入局部性約束,然后將每個小塊稀疏編碼成高維向量空間,這樣可以作為生物學上有效且高效的腦特征學習器,用來進行視覺編碼解碼。