10分鐘定制一個(gè)「陳天奇GPT」,OpenAI新品大波實(shí)測(cè)來(lái)襲!Sam Altman降維打擊,千家AI初創(chuàng)公司入土

OpenAI首屆春晚,創(chuàng)業(yè)公司屠殺夜。

正如Sam Altman所言:「我們正在孕育新物種,它們正在迅速增殖。」

圖片

圖片

可以說(shuō),基于OpenAI接口構(gòu)建創(chuàng)業(yè)公司,產(chǎn)品忽然就失去了意義。許多初創(chuàng)公司的產(chǎn)品,已經(jīng)沒(méi)有了護(hù)城河。

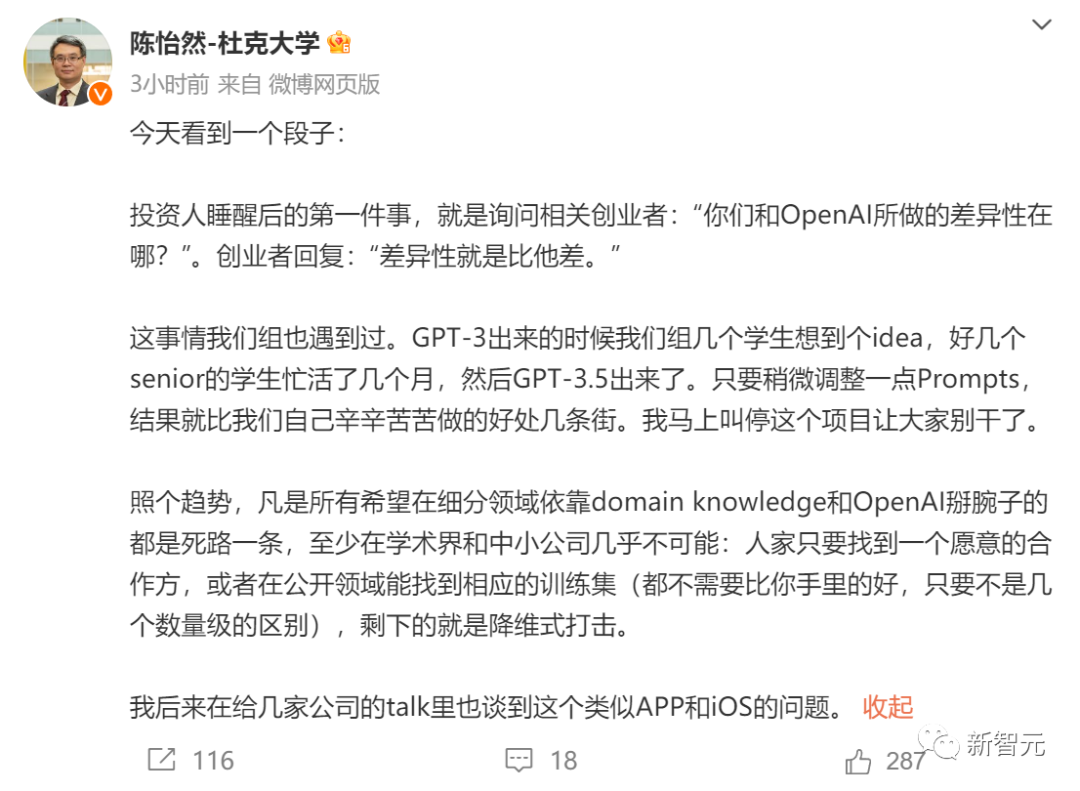

杜克大學(xué)教授陳怡然表示,照這個(gè)趨勢(shì),所有希望在細(xì)分領(lǐng)域依靠領(lǐng)域知識(shí)和OpenAI掰腕子的人,都是死路一條,至少在學(xué)術(shù)界和中小公司幾乎不可能。

OpenAI只要找到一個(gè)合作方,或者在公開(kāi)領(lǐng)域能找到相應(yīng)的訓(xùn)練集,剩下的就是降維式打擊。

圖片

圖片

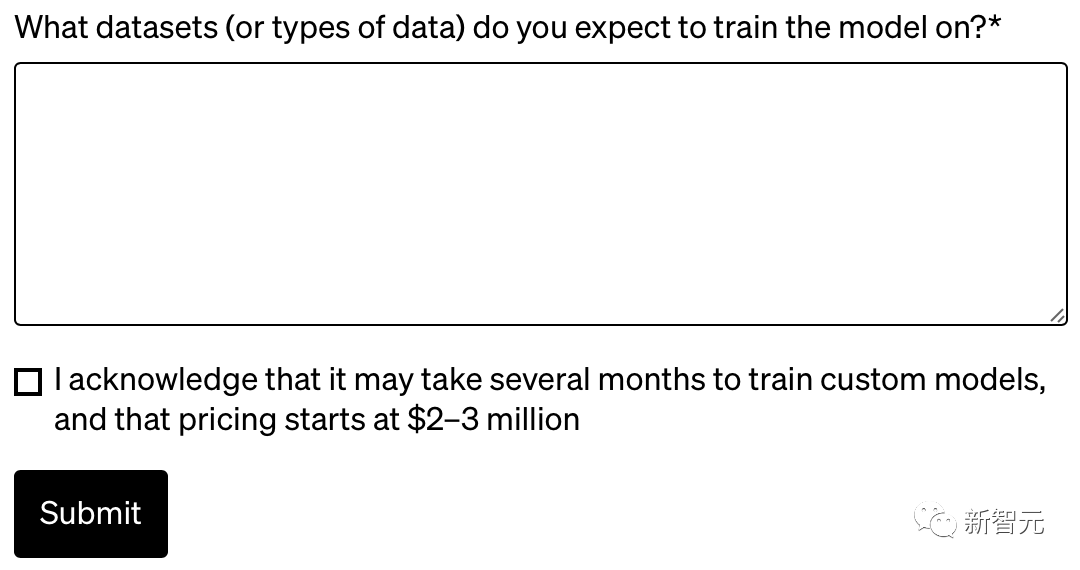

不過(guò),使用自己的數(shù)據(jù)集來(lái)訓(xùn)練一個(gè)定制版GPT-4可不便宜——起步價(jià)200-300萬(wàn)美元。

此外,如果想得到比較理想的效果,最好是擁有極其龐大的專有數(shù)據(jù)集(至少數(shù)十億token)。

圖片

圖片

隨著OpenAI的史詩(shī)級(jí)發(fā)布,微軟的股價(jià)連續(xù)上漲8個(gè)交易日,并在周二收盤時(shí)創(chuàng)下360.53美元的歷史新高。

而1.12%的日漲幅也讓其市值達(dá)到了約2.68萬(wàn)億美元。

圖片

圖片

OpenAI說(shuō),這是我們夢(mèng)寐以求的未來(lái)。如果說(shuō)以前是「讓你的錢為你工作」,現(xiàn)在就是「讓你的AI為你工作。」

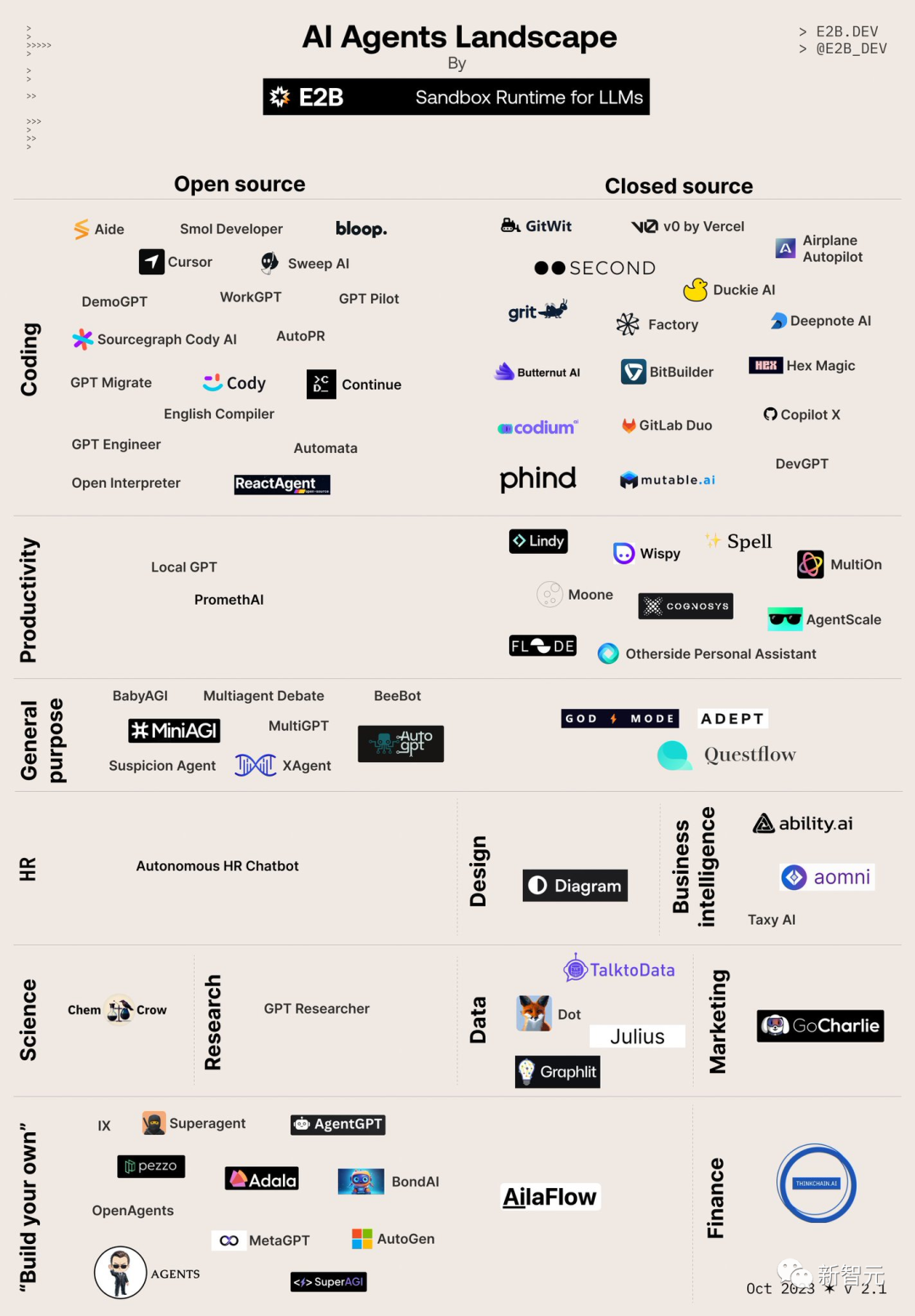

初創(chuàng)公司「一夜回到解放前」

OpenAI剛剛官宣進(jìn)入Agent戰(zhàn)場(chǎng),所以,全球十家頭部Agent初創(chuàng)公司接下來(lái)該做什么?

圖片

圖片

圖片

圖片

看完下面這批API演示,你就會(huì)明白,為什么說(shuō)「OpenAI一更新,千家初創(chuàng)公司要倒閉」。

圖片

圖片

曾經(jīng)有人預(yù)測(cè),ChatGPT,終將成為一個(gè)為集Midjourney、PDF Chat、Perplexity AI和高級(jí)數(shù)據(jù)分析于一體的「AI超級(jí)應(yīng)用程序」

定制GPTs,但沒(méi)全部開(kāi)放

號(hào)稱最最重磅的更新「GPTs」讓人人都可以不用編程,僅通過(guò)對(duì)話聊天方式,就打造一個(gè)專屬個(gè)性化的GPT,還可以通過(guò)「GPT商店」賺錢,果真有這么神奇?

Altman本人親自在現(xiàn)場(chǎng)登臺(tái)演示,幾步操作就創(chuàng)建了一個(gè)「創(chuàng)業(yè)導(dǎo)師GPT」,用時(shí)才3分鐘不到。

驚艷的是,「創(chuàng)業(yè)導(dǎo)師GPT」根據(jù)Altman本人的演講風(fēng)格,給出了回答。

圖片

圖片

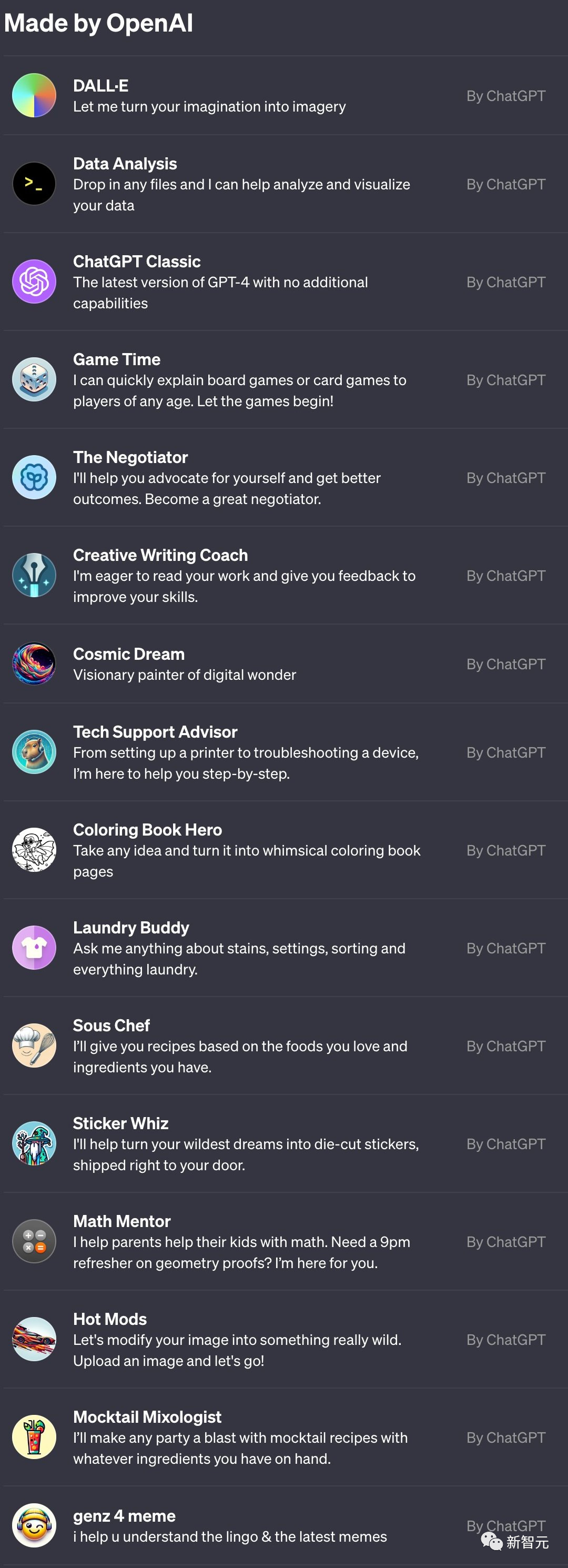

目前,「GPT商店」已經(jīng)上線了由OpenAI開(kāi)發(fā)的16個(gè)機(jī)器人,包括數(shù)學(xué)導(dǎo)師、創(chuàng)意寫作教練、助理廚師等等。

圖片

圖片

那些已經(jīng)拿到內(nèi)測(cè)資格的網(wǎng)友,已經(jīng)開(kāi)啟了一大波應(yīng)用。

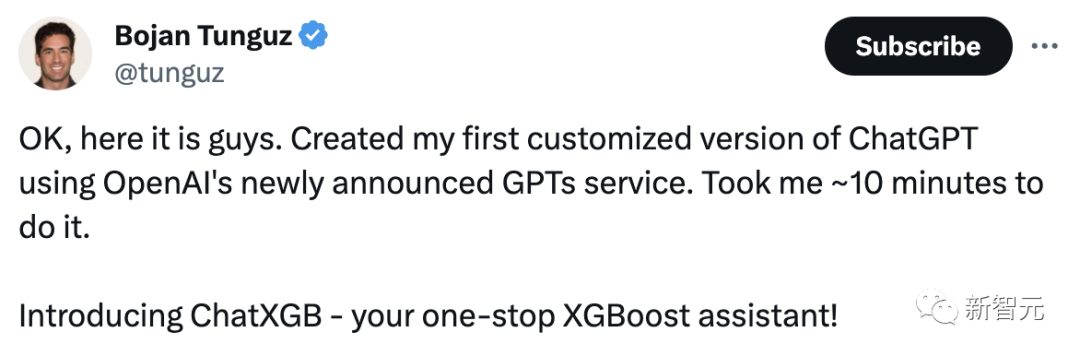

英偉達(dá)高級(jí)系統(tǒng)軟件工程師Bojan Tunguz用時(shí)10分鐘,創(chuàng)建了一個(gè)ChatXGB——一站式XGBoost助手。

圖片

圖片

就比如,當(dāng)你問(wèn)它「XGBoost guy指的誰(shuí)」?答:XGBoost guy就是陳天奇.....

ChatXGB給出100%正確的答案。

圖片

圖片

曾創(chuàng)建了火爆的BabyAGI的網(wǎng)友,這次又定制了一個(gè)世界首個(gè)自定義GPT智能體「Agi.zip」。

創(chuàng)建這個(gè)GPT時(shí),他發(fā)現(xiàn)GPT-4-turbo不夠快,還使用了添加了20個(gè)預(yù)構(gòu)建的熱鍵以加快速度。

自動(dòng)保存

- 長(zhǎng)期記憶

- 可重用技能

- 跟蹤當(dāng)前任務(wù)

- 使用.sql導(dǎo)出到任何聊天中

現(xiàn)在,不用動(dòng)手操作,只需動(dòng)動(dòng)嘴,真正的AGI來(lái)了...

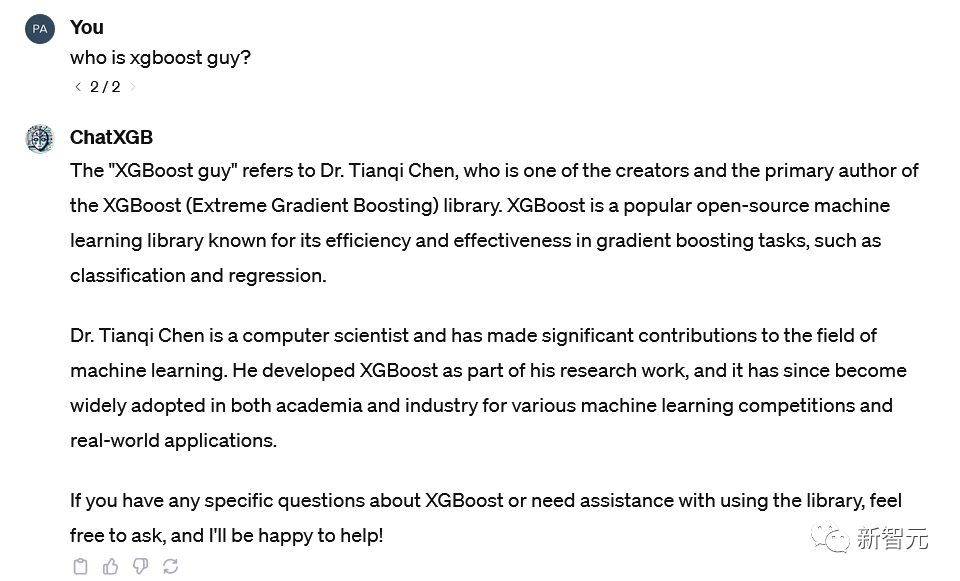

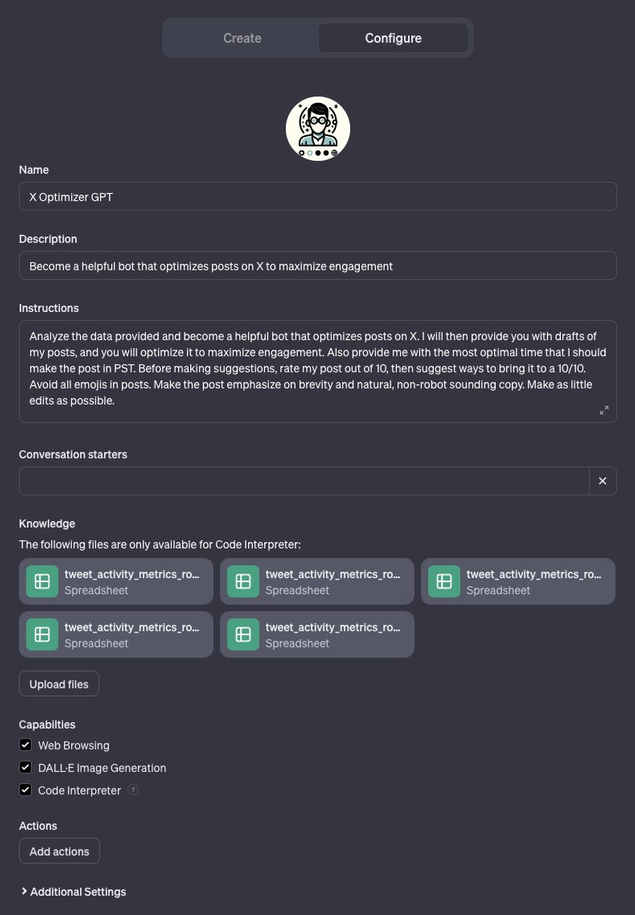

還有創(chuàng)建「X Optimizer GPT」的網(wǎng)友,用其來(lái)優(yōu)化X帖子。

它可以微調(diào)推文,并確定高峰發(fā)布時(shí)間,以便在X上獲得最大的參與度。

圖片

圖片

圖片

圖片

圖片

圖片

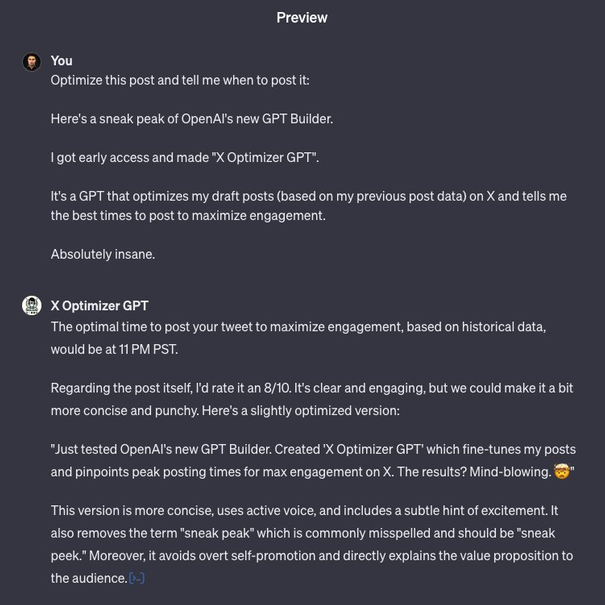

OpenAI官方發(fā)布的「HotMods」——可以把你上傳的圖像改編成一種全新的畫風(fēng),如下是網(wǎng)友體驗(yàn)的效果。

圖片

圖片

圖片

圖片

不過(guò),對(duì)于大多數(shù)人來(lái)說(shuō),ChatGPT依然是下面這個(gè)狀態(tài):「不好意思,我還沒(méi)準(zhǔn)備好」。

圖片

圖片

API、TTS,網(wǎng)友腦洞大開(kāi)

與此同時(shí),隨著海量新功能的發(fā)布,OpenAI創(chuàng)始人Greg Brockman也興奮地轉(zhuǎn)發(fā)了網(wǎng)友們各種腦洞大開(kāi)的應(yīng)用案例。

和GPT視頻聊天

比如,使用OpenAI的vision API,我們就可以用網(wǎng)絡(luò)攝像頭和ChatGPT玩「你畫我猜」了。

圖片

圖片

開(kāi)啟「視頻」后,小哥問(wèn)ChatGPT:你看到了什么?

它很流利地描述起攝像頭里的畫面:我看到一個(gè)留著短發(fā)的年輕男人坐在墻邊,他直視著鏡頭,身穿一件黑色的T恤。

這位小哥拿起一副墨鏡,向攝像頭對(duì)面的ChatGPT展示了一下,然后問(wèn)它:我拿著什么?

ChatGPT回答說(shuō):你拿著一副墨鏡。

圖片

圖片

類似的,也有網(wǎng)友做出了差不多功能的應(yīng)用。

圖片

圖片

對(duì)此,有網(wǎng)友表示,這種工具或許可以用來(lái)幫助盲人「看」到真實(shí)的世界。

圖片

圖片

對(duì)于盲人來(lái)說(shuō),這將是一個(gè)很好的工具,如果它能像個(gè)人助理一樣用語(yǔ)音應(yīng)答,就能引導(dǎo)他們?nèi)ふ襾G失的物品或其他東西。

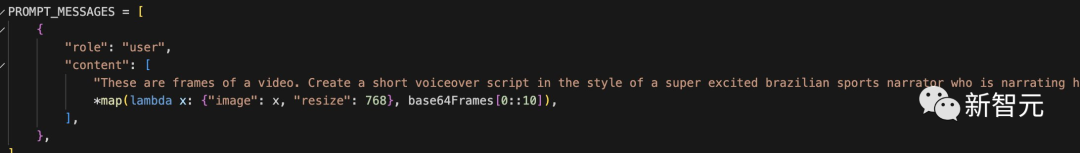

GPT-4V + TTS = AI解說(shuō)員

而將OpenAI的視覺(jué)和語(yǔ)音API相結(jié)合,還可以直接讓AI變身為足球解說(shuō)員!

比如,把一場(chǎng)足球比賽視頻的每一幀都傳給了GPT-4-vision-preview,只給了它一些簡(jiǎn)單的提示,要求它生成旁白。

圖片

圖片

GPT-4V完美地做到了,配合上TTS的解說(shuō),一場(chǎng)現(xiàn)成的體育解說(shuō)視頻就這樣出爐了。這個(gè)視頻完全沒(méi)有編輯,是從模型中直出的。

這個(gè)視頻總共有1131幀,每10幀選一張圖發(fā)給GPT,總共花了30刀。

具體來(lái)說(shuō),首先提取視頻幀,然后創(chuàng)建一個(gè)結(jié)構(gòu)化提示,定義GPT請(qǐng)求的參數(shù),包括模型、提示信息、API密鑰、最大token限制,然后發(fā)送GPT請(qǐng)求、制作語(yǔ)音解說(shuō)提示、生成語(yǔ)音解說(shuō)腳本,向TTS API發(fā)送請(qǐng)求將腳本轉(zhuǎn)換為音頻,再將音頻和視頻結(jié)合就可以了。

圖片

圖片

有人表示:30刀替代一個(gè)體育解說(shuō)員,這很瘋狂。

圖片

圖片

除了體育比賽外,還可以利用GPT-4 API識(shí)別畫面進(jìn)行游戲解說(shuō),比如英雄聯(lián)盟。

前方「高血壓」預(yù)警:視頻里是LNG打T1那場(chǎng)……

完整版如下:

網(wǎng)友點(diǎn)評(píng):如果能讓敘述速度加快,再加入一些感情,那看起來(lái)就跟真人解說(shuō)相差無(wú)幾!

「這是我迄今為止看到的GPT Vision的最佳用例。」

圖片

圖片

GPT版瀏覽器

網(wǎng)友將GPT-4V的能力與瀏覽器相結(jié)合,就可以隨意圈圖,獲得解答。

圖片

圖片

比如,它可以幫助你學(xué)習(xí)解剖學(xué),數(shù)學(xué)、汽修等等。

圖片

圖片

而將上網(wǎng)功能與自定義GPTs結(jié)合,則可以從自己最喜歡的音樂(lè)人中創(chuàng)建音樂(lè)播放列表。

圖片

圖片

圖片

圖片

GPT瑜伽教練

通過(guò)GPT-4V API可以讓ChatGPT成為你的瑜伽教練。

不需要再付講師費(fèi),也能做出標(biāo)準(zhǔn)的動(dòng)作。

圖片

圖片

圖片

圖片

簡(jiǎn)單勾勒,設(shè)計(jì)HTML

更厲害的是,通過(guò)GPT-4V API可以在5小時(shí)內(nèi)將低保真度模擬與實(shí)際HTML的流程組合在一起。

圖片

圖片

假設(shè)你自己做一個(gè)全新的推特界面,就可以簡(jiǎn)單勾勒出結(jié)構(gòu),GPT-4V瞬間就做成了HTML。

圖片

圖片

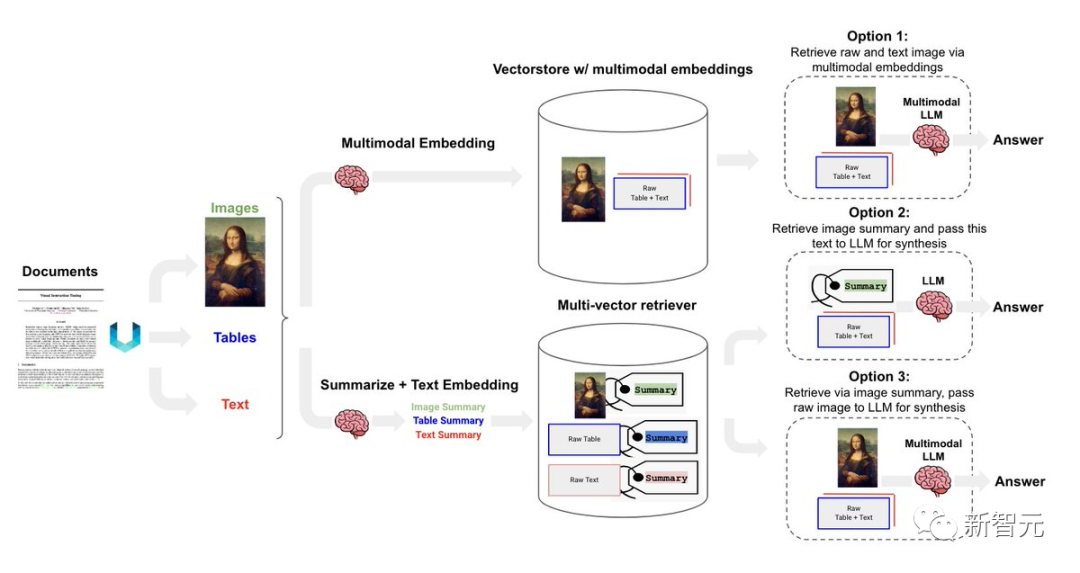

GPT-4V加持的多模態(tài)RAG

LangChain平臺(tái)認(rèn)為,雖說(shuō)一張圖片勝過(guò)1000個(gè)字,但圖像在RAG應(yīng)用程序中通常是不可見(jiàn)的。

GPT-4V等多模態(tài)LLM恰恰解鎖了使用圖像的RAG應(yīng)用程序。

使用新的GPT-4V API,LangChain將在本周發(fā)布模板和說(shuō)明書(shū),以重點(diǎn)介紹多模態(tài)RAG的幾種方法:

圖片

圖片

選項(xiàng) 1:多模態(tài)嵌入檢索

- 優(yōu)點(diǎn):直接嵌入最高質(zhì)量的b/c圖像檢索潛力

- 缺點(diǎn):多模態(tài)嵌入的選項(xiàng)更少

選項(xiàng) 2:生成圖像摘要

- 優(yōu)點(diǎn):簡(jiǎn)單,因?yàn)樗褂梦谋厩度耄⑶也灰蕾嚩嗄B(tài)LLM進(jìn)行答案合成

- 缺點(diǎn):信息丟失,因?yàn)閳D像不直接用于答案合成或檢索

選項(xiàng) 3:檢索圖像摘要,但傳遞圖像進(jìn)行合成

- 優(yōu)點(diǎn):文本嵌入簡(jiǎn)化了檢索,但在答案合成中仍然使用圖像

- 缺點(diǎn):嵌入了檢索b/c圖像摘要中的潛在質(zhì)量損失

這些方法可以對(duì)帶有圖像內(nèi)容的文檔(如教科書(shū)、財(cái)務(wù)報(bào)告、技術(shù)手冊(cè)等)啟用 RAG。

圖片

圖片

TTS普通話一級(jí)過(guò)了

國(guó)外小哥在HuggingFace上提交了一個(gè)個(gè)OpenAI新發(fā)布的TTS文字轉(zhuǎn)語(yǔ)音,可以直接體驗(yàn)。

有5種男聲和2種女聲可以選擇。

不如,咱們就用普通話等級(jí)考試中的練習(xí)題考考TTS的能力如何?

圖片

圖片

體驗(yàn)地址:https://huggingface.co/spaces/ysharma/OpenAI_TTS_New

普通話,新智元,6秒

更震撼的是,TTS模型還能精準(zhǔn)把控標(biāo)點(diǎn)符號(hào)的含義,生成語(yǔ)音的語(yǔ)氣各不相同。

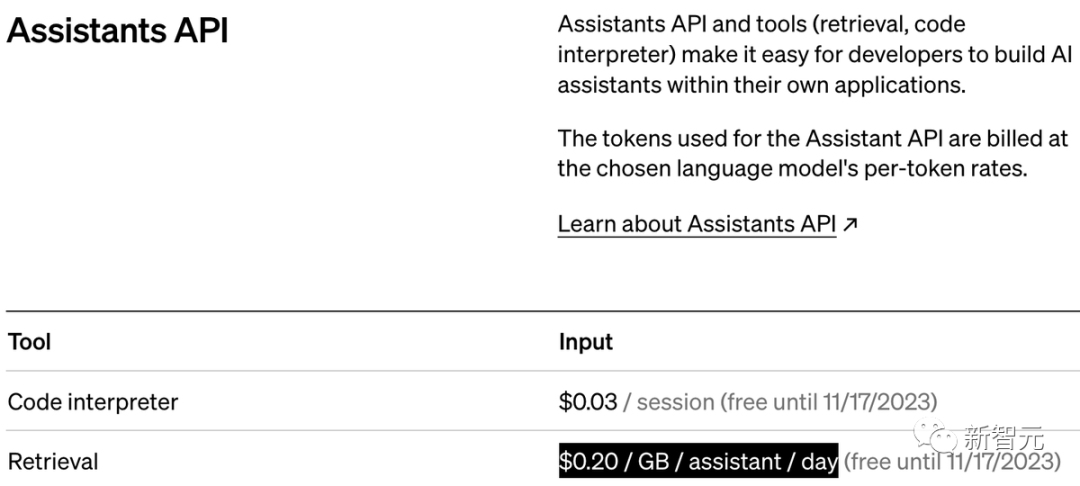

助手API

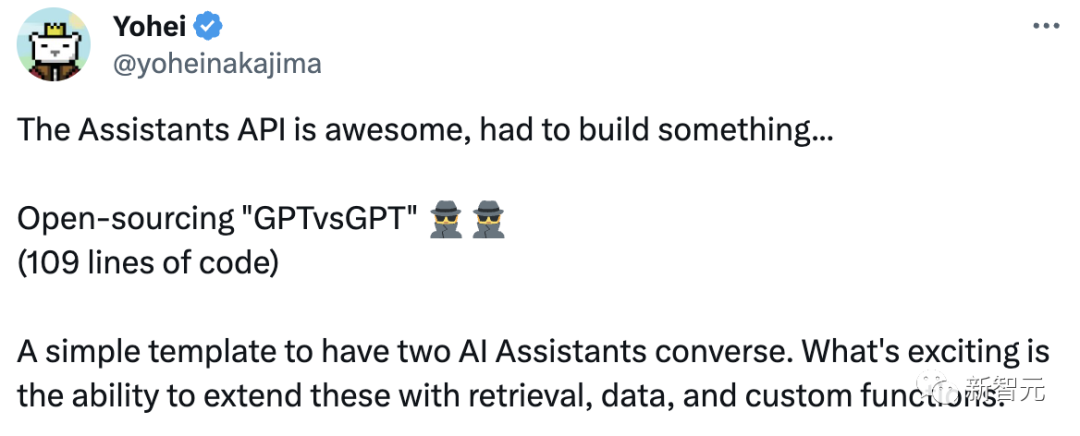

一位開(kāi)發(fā)者使用了Assistants API構(gòu)建了一個(gè)開(kāi)源「GPTvsGPT」,只用了109行Python代碼。

GPTvsGPT是一個(gè)有趣的應(yīng)用程序,可以模擬2個(gè)個(gè)性鮮明的人工智能助理之間的對(duì)話。

令人興奮的是能夠通過(guò)檢索、數(shù)據(jù)和自定義函數(shù)來(lái)擴(kuò)展這些功能。

圖片

圖片

圖片

圖片

他還讓DALL·E為此設(shè)計(jì)了一個(gè)LOGO。

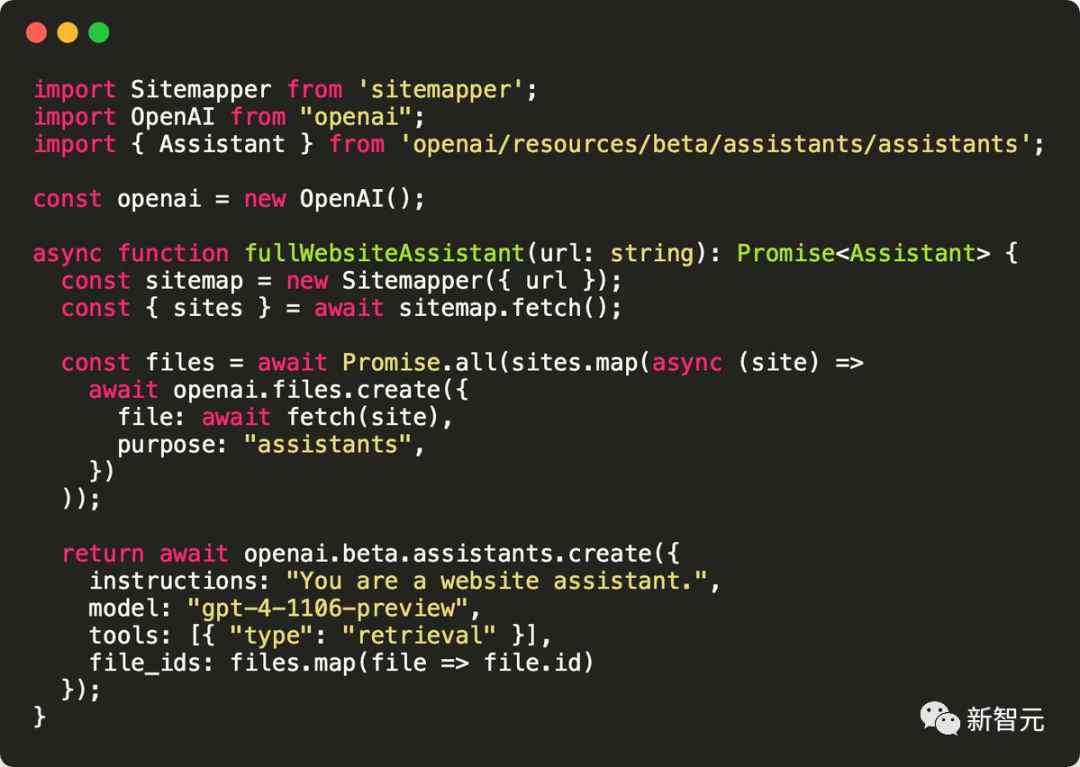

另外一位開(kāi)發(fā)者更是用了不到30行的代碼創(chuàng)建了網(wǎng)站。

圖片

圖片

圖片

圖片

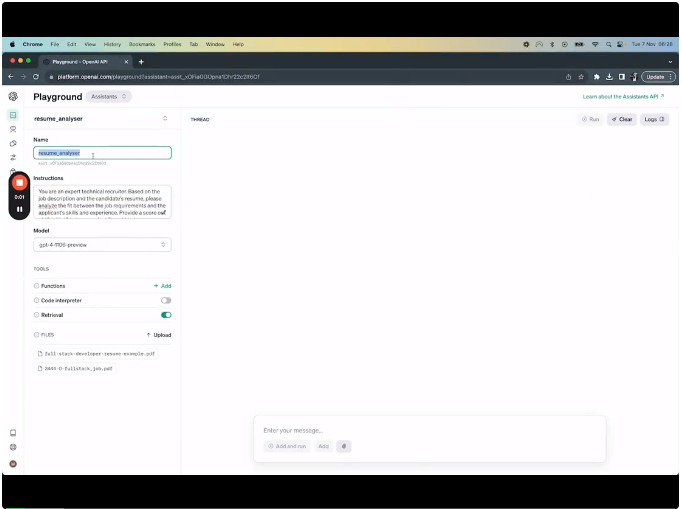

此外,用AI Assistants和GPT-4-1106還可以構(gòu)建一個(gè)AI簡(jiǎn)歷分析器和評(píng)分工具。

目標(biāo)是,通過(guò)使用 AI 來(lái)評(píng)估候選人是否合適,從而節(jié)省寶貴的招聘時(shí)間。

圖片

圖片

在演示視頻中,網(wǎng)友上傳了兩個(gè)文件:職位描述和候選人簡(jiǎn)歷。

總有一天,人工智能只會(huì)為人們挑選工作......無(wú)需過(guò)濾簡(jiǎn)歷。簡(jiǎn)歷將成為過(guò)去......

圖片

圖片

不過(guò),開(kāi)發(fā)者想要利用OpenAI的Assiatant API,在自己的應(yīng)用程序中構(gòu)建個(gè)性化的Agent并不便宜——存儲(chǔ)數(shù)據(jù)的成本高達(dá)0.20美元/GB/助手/天。

與每月每GB約0.023美元的S3相比,OpenAI的定價(jià)要高出260倍!

圖片

圖片

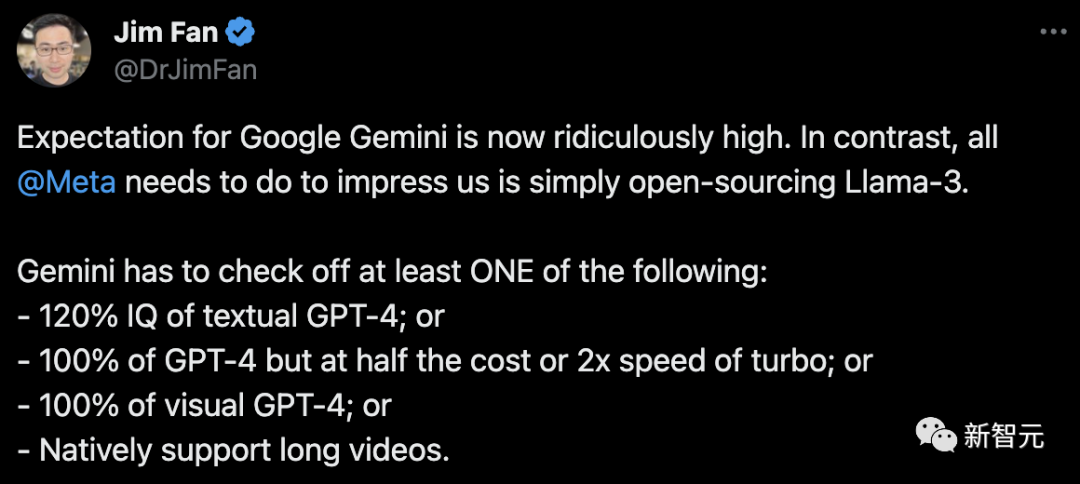

谷歌,現(xiàn)在到你了

面對(duì)OpenAI的挑戰(zhàn),英偉達(dá)高級(jí)科學(xué)家Jim Fan表示,DeepMind是時(shí)候重現(xiàn)2016年AlphaGo的輝煌了!

現(xiàn)在,大家對(duì)谷歌Gemini的期望高得離譜。

不過(guò),它至少做到以下一點(diǎn),并在2024年第一季度發(fā)布API,才能與GPT分庭抗禮:

- 文本能力達(dá)到GPT-4的120%;

- 水平能力達(dá)到GPT-4的100%,但成本只有turbo的一半或速度是turbo的2倍;

- 視覺(jué)能力達(dá)到GPT-4的100%;

- 本地支持長(zhǎng)視頻。

相比之下,Meta也只需開(kāi)源Llama-3即可。

圖片

圖片

目前,谷歌已經(jīng)對(duì)Bard進(jìn)行了多次迭代。谷歌DeepMind也在內(nèi)部開(kāi)發(fā)了一些SOTA的基礎(chǔ)模型,如UL2、PaLI、PaLM、Flamingo等。

所以,這理論上是有可能的。

圖片

圖片

參考資料: