北大全新「機械手」算法:輔助花式抓杯子,GTX 1650實現150fps推斷

手是人類與世界交互的重要部分,手的缺失(如上肢殘障)會大大影響人類的正常生活。

北京大學董豪團隊通過將擴散模型和強化學習結合,使機械手能根據人手腕部的移動軌跡,自適應的抓取物體的不同部位,滿足人類多樣化的抓取需求,目前該工作已被NeurIPS 2023接收。

論文地址:https://arxiv.org/abs/2309.06038

項目主頁:https://sites.google.com/view/graspgf

有了這個機械手,只要動動手腕,機械手就能按照人類想要的方式抓起物體,比如抓取杯身和杯壁。

由于人類行為的復雜與多變性和真實世界物體的多樣性,僅僅根據人手腕部的移動軌跡來不斷預測人類想法是一件非常困難的事情。

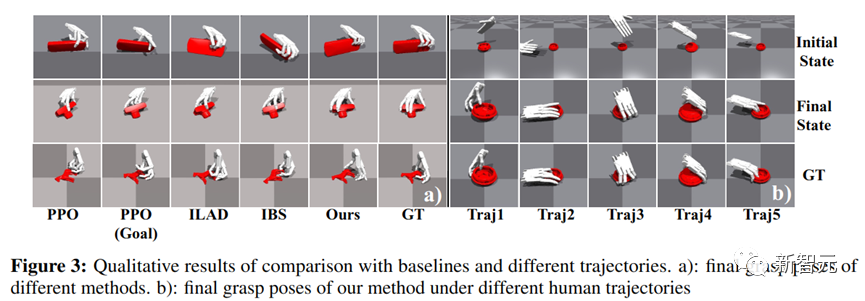

新方法真正實現了靈巧的抓取,能在真實世界中對于不同的物體,不同的抓取姿態,不同的抓取軌跡進行泛化。

機械手如何明白人類的想法?

北大董豪團隊提出將人類的想法分解成兩個部分:

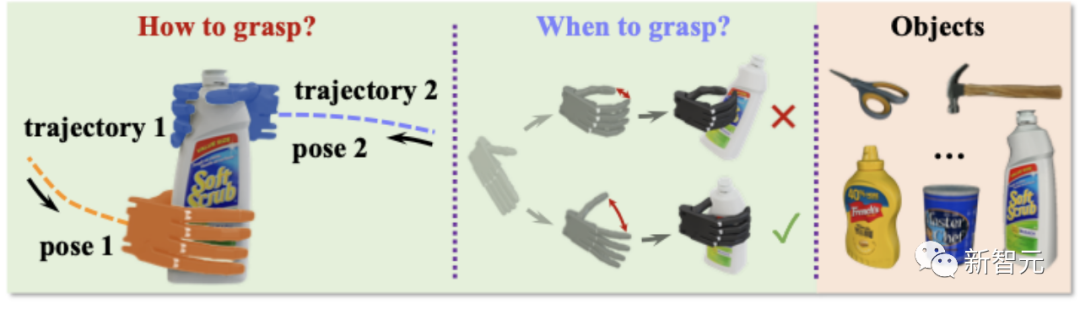

1. 如何抓: 考慮到人類和物體當前的相對姿勢,機械手應該如何抓取物體?

2. 何時抓: 機械手應該根據用戶歷史運動軌在何時、以什么速度執行抓取動作?

如何抓?

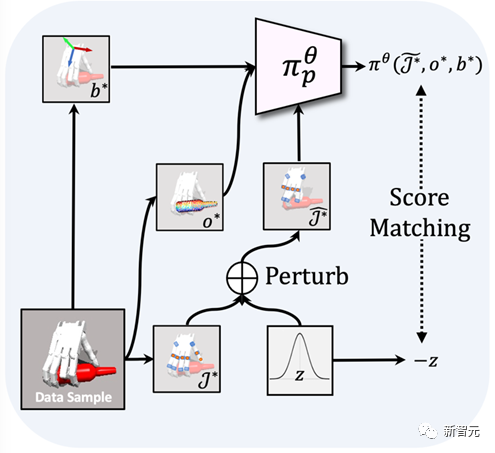

首先,如上圖所示,新方法將學習人類想要「如何抓取物體」,定義為從一個包含各種抓取姿態的數據集中,學習抓取梯度場Grasping Gradient Field(GraspGF)。

基于當前人手腕部和物體的相對關系,GraspGF會輸出一個梯度,這個梯度代表最快提高「抓取可能性」的方向。這個梯度可以轉化為對每個手指關節的原始控制,使手指能夠通過不斷迭代達到適當的抓取姿態。

這樣的梯度場可以隨著人手腕部和物體的關系的變化,而不斷的輸出新的梯度指示當前人類的抓取意圖,即意向抓取的物體區域及抓取姿態。

GraspGF隨著手腕的旋轉,不斷調整抓取姿態

何時抓?

GraspGF的動作會導致提前合攏

然而,只知道「如何抓」并不夠完備,如果不知道要「何時抓」(如上圖所示),雖然最終的抓取姿態是合理的,但是在達到抓取姿態的過程中會和物體發生碰撞。

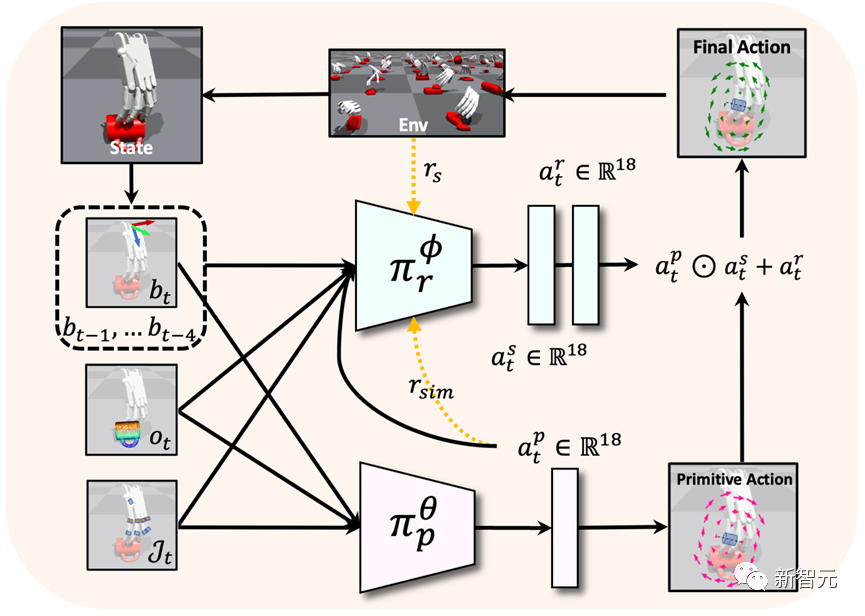

如上所示,為了解決「何時抓取」的問題,新方法還訓練了一個基于強化學習的殘差策略,它首先會輸出一個「縮放動作」,根據手腕軌跡的歷史,決定手指關節應該以多快的速度沿著原始動作的方向移動。

此外,因為原始策略是基于最終抓取姿態數據集離線訓練得到的,原始策略并不了解環境的物理約束 ,殘差策略還會輸出一個「殘差動作」來進一步校正原始動作。

通過結合殘差策略,模型能夠通過殘差策略學習到的「何時抓」更好地實現原始策略學習到的「如何抓」。

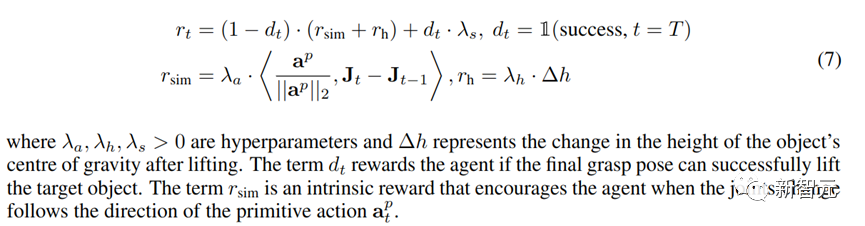

簡單的獎勵函數

該方法在獎勵函數的設置上不需要過多的human design,因為原始動作已經提供了一個比較好的「如何抓」的引導,在訓練強化學習模型時,除了給定成功抓取和抓取后的高度變化獎勵,僅僅只需要一個獎勵函數去鼓勵機械手跟隨原始動作即可。

該方法的優勢

- 該方法僅需要成功抓取的抓取姿態數據集用于訓練,與需要專家演示的方法相比,不需要大量的人工標注或者工程工作。

- GraspGF借助了擴散模型強大的條件生成建模能力,這使它能夠根據新穎的用戶意圖輸出有效的原始動作。

- 殘差學習的設計改善了強化學習探索效率低下的問題,提升了強化學習模型在未見過物體和軌跡上的泛化能力。

結果

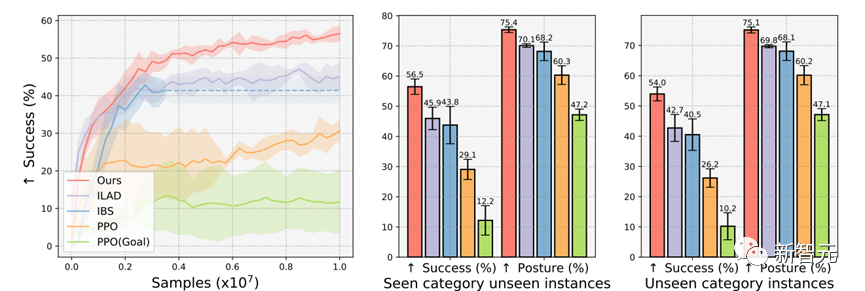

最終在4900多個物體,200條不同的人類移動軌跡上,新方法都優于基準。

該方法的最終的抓取姿態相比于基線更符合人類的抓取意圖。

此外,該方法在抓取過程中對物體造成的擾動要小于其他基準。

經過測試,該模型在GTX1650的顯卡上,能達到150fps的推斷速度,能做到與人類的實時交互,也許未來能真正用于輔助手部缺失的人更好地進行日常生活。

本次研究的通訊作者董豪是北京大學的助理教授、博導、博雅青年學者、智源學者,其創立并領導北大超平面實驗室(Hyperplane Lab)。

董老師在NeurIPS、ICLR、CVPR、ICCV、ECCV、ICRA、IROS等國際頂尖會議/期刊上發表論文40余篇,Google Scholar引用4700余次,多次擔任國際頂尖會議如NeurIPS、CVPR、AAAI、ICRA的領域主席和副編委。

其領導了多個開源項目,例如TensorLayer和OpenMLsys,出版書籍獲得15萬次下載,開源軟件獲得上萬Github Star,獲ACM Multimedia 最佳開源軟件獎、OpenI杰出項目獎。

論文一作吳天昊,現為北京大學博士生,導師為董豪老師,研究方向為靈巧手操縱算法。