谷歌10秒視頻生成模型破世界記錄!LLM終結擴散模型,效果碾壓頂流Gen-2

AI視頻生成,或許就是2024年下一個最前沿(juan)的領域。

回看過去幾個月,RunWay的Gen-2、Pika Lab的Pika 1.0,國內大廠等大波視頻生成模型紛紛涌現,不斷迭代升級。

這不,RunWay一大早就宣布Gen-2支持文本轉語音的功能了,可以為視頻創建畫外音。

圖片

圖片

當然,谷歌在視頻生成上也不甘落后,先是與斯坦福李飛飛團隊共同發布了W.A.L.T,用Transformer生成的逼真視頻引來大波關注。

圖片

圖片

今天,谷歌團隊又發布了一個全新的視頻生成模型VideoPoet,而且無需特定數據便可生成視頻。

圖片

圖片

論文地址:https://blog.research.google/2023/12/videopoet-large-language-model-for-zero.html

最令人驚嘆的是,VideoPoet一次能夠生成10秒超長,且連貫大動作視頻,完全碾壓Gen-2僅有小幅動作的視頻生成。

另外,與領先模型不同的是,VideoPoet并非基于擴散模型,而是多模態大模型,便可擁有T2V、V2A等能力,或將成為未來視頻生成的主流。

圖片

圖片

網友看后紛紛「震驚」刷屏。

圖片

圖片

圖片

圖片

不如,接下來可以先看一波體驗。

文字轉視頻

在文本到視頻的轉換中,生成的視頻長度是可變的,并且能夠根據文本內容展現出多種動作和風格。

比如,熊貓打牌:

圖片

圖片

Two pandas playing cards

南瓜爆炸:

圖片

圖片

A pumpkin exploding, slow motion

宇航員策馬奔馳:

圖片

圖片

An astronaut riding a galloping horse

圖像轉視頻

VideoPoet還可以根據給定的提示,將輸入的圖像轉換成動畫。

圖片

圖片

左:一艘船在波濤洶涌的海面上航行,周圍是雷電交加的景象,以動態油畫風格呈現

中:飛過充滿閃爍星星的星云

右:一位拄著手杖的旅行者站在懸崖邊,凝視著風中翻騰的海霧

視頻風格化

對于視頻風格化,VideoPoet先預測光流和深度信息,然后再將額外的文本輸入到模型。

圖片

圖片

左:袋熊戴著墨鏡,在陽光明媚的海灘上拿著沙灘球

中:泰迪熊在清澈的冰面上滑冰

右:一只金屬獅子在熔爐的光芒下咆哮

圖片

圖片

從左到右:逼真,數字藝術,鉛筆藝術,水墨,雙重曝光,360度全景

視頻轉音頻

VideoPoet還能生成音頻。

如下,首先從模型中生成2秒鐘的動畫片段,然后在沒有任何文本引導的情況下嘗試預測音頻。這樣就能從一個模型中生成視頻和音頻。

通常情況下,VideoPoet以縱向的方式生成視頻,以便與短片視頻的輸出相一致。

谷歌還專門做了一部由VideoPoet生成的許多短片組成的簡短電影。

具體文本比編排上,研究人員要求Bard先寫一個關于一只旅行浣熊的短篇故事,并附帶場景分解和提示列表。然后,為每個提示生成視頻片段,并將所有生成的片段拼接在一起,制作出下面的最終視頻。

,時長01:00

視頻講故事

通過隨時間變化的提示,可以創造視覺上的故事敘述。

圖片

圖片

輸入:一個由水構成的行走的人

擴展:一個由水構成的行走的人。背景中有閃電,同時從這個人身上散發出紫色的煙霧

圖片

圖片

輸入:兩只浣熊騎著摩托車在松樹環繞的山路上行駛,8k

擴展:兩只浣熊騎著摩托車。流星雨從浣熊身后墜落,撞擊地面并引發爆炸

LLM秒變視頻生成器

當前,Gen-2、Pika 1.0視屏生成的表現足以驚人,但是遺憾的是,無法在連貫大幅動作的視頻生成上表現驚艷。

通常,它們在產生較大動作時,視頻會出現明顯的偽影。

對此,谷歌研究人員提出了VideoPoet,能夠執行包括文本到視頻、圖像到視頻、視頻風格化、視頻修復/擴展和視頻到音頻等多樣的視頻生成任務。

相比起其他模型,谷歌的方法是將多種視頻生成功能無縫集成到單一的大語言模型中,而不依賴針對各個任務分別訓練的專用組件。

圖片

圖片

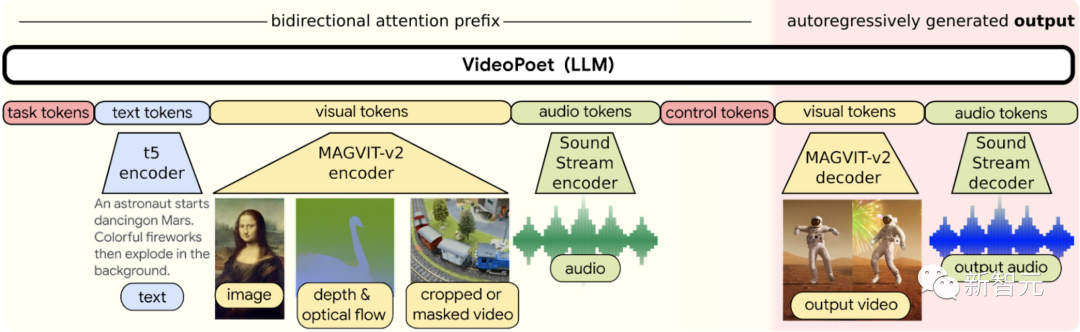

具體來說,VideoPoet主要包含以下幾個組件:

- 預訓練的MAGVIT V2視頻tokenizer和SoundStream音頻tokenizer,能將不同長度的圖像、視頻和音頻剪輯轉換成統一詞匯表中的離散代碼序列。這些代碼與文本型語言模型兼容,便于與文本等其他模態進行結合。

- 自回歸語言模型可在視頻、圖像、音頻和文本之間進行跨模態學習,并以自回歸方式預測序列中下一個視頻或音頻token。

- 在大語言模型訓練框架中引入了多種多模態生成學習目標,包括文本到視頻、文本到圖像、圖像到視頻、視頻幀延續、視頻修復/擴展、視頻風格化和視頻到音頻等。此外,這些任務可以相互結合,實現額外的零樣本功能(例如,文本到音頻)。

圖片

圖片

VideoPoet能夠在各種以視頻為中心的輸入和輸出上進行多任務處理。其中,LLM可選擇將文本作為輸入,來指導文本到視頻、圖像到視頻、視頻到音頻、風格化和擴圖任務的生成

使用LLM進行訓練的一個關鍵優勢是,可以重用現有LLM訓練基礎設施中引入的許多可擴展的效率改進。

不過,LLM是在離散token上運行的,這可能會給視頻生成帶來挑戰。

幸運的是,視頻和音頻tokenizer,可以將視頻和音頻剪輯編碼為離散token序列(即整數索引),并可以將其轉換回原始表示。

VideoPoet訓練一個自回歸語言模型,通過使用多個tokenizer(用于視頻和圖像的MAGVIT V2,用于音頻的SoundStream)來跨視頻、圖像、音頻和文本模態進行學習。

一旦模型根據上下文生成了token,就可以使用tokenizer解碼器將這些token轉換回可查看的表示形式。

圖片

圖片

VideoPoet任務設計:不同模態通過tokenizer編碼器和解碼器與token相互轉換。每個模態周圍都有邊界token,任務token表示要執行的任務類型

三大優勢

概括來說,VideoPoet比起Gen-2等視頻生成模型,具備以下三大優勢。

更長的視頻

VideoPoet通過對視頻的最后1秒進行調節,并預測接下來的1秒,就可以生成更長的視頻。

通過反復循環,VideoPoet通不僅可以很好地擴展視頻,而且即使在多次迭代中,也能忠實地保留所有對象的外觀。

如下是VideoPoet從文本輸入生成長視頻的兩個示例:

圖片

圖片

左:宇航員在火星上跳舞,背景是五彩繽紛的煙花

右:無人機拍攝的叢林中一座非常尖銳的精靈石城,城中有一條湛藍的河流、瀑布和陡峭的垂直懸崖

相比于其他只能生成3-4秒視頻的模型,VideoPoet一次就可以生成長達10秒的視頻。

圖片

圖片

無人機拍攝的古堡秋景

精準的控制

視頻生成應用一個非常重要的能力在于,對于生成的動態效果,用戶有多大的控制能力。

這將很大程度上決定了模型能否被用來制作復雜連貫的長視頻。

VideoPoet不但可以為輸入的圖像通過文字描述來添加動態效果,并通過文本提示來調整內容,來達到預期的效果。

圖片

圖片

左:轉身看鏡頭;右:打哈欠

除了支持輸入圖像的視頻編輯,視頻輸入也可以通過文字進行精確控制。

針對最左邊的小浣熊跳舞視頻,用戶可以通過文字描述不同的舞姿來讓它跳不同的舞蹈。

圖片

圖片

生成「左」:跳機器人舞

生成「中」:跳Griddy舞

生成「右」:來一段Freestyle

同樣,還可以對VideoPoet生成的現有視頻片段,進行交互式編輯。

如果我們提供一個輸入視頻,就可以改變對象的運動來執行不同的動作。對物體的操作可以以第一幀或中間幀為中心,從而實現高度的編輯控制。

比如,可以從輸入視頻中隨機生成一些片段,然后選擇所需的下一個片段。

如圖中最左邊的視頻被用作條件反射,在初始提示下生成四個視頻:

「一個可愛的銹跡斑斑的破舊蒸汽朋克機器人的特寫,機器人身上長滿了青苔和新芽,周圍是高高的草叢」。

對于前3個輸出,沒有提示動作的自主預測生成。最后一個視頻,是在提示中添加了「啟動,背景為煙霧」以引導動作生成。

圖片

圖片

運鏡的手法

VideoPoet還可以通過在文本提示中,附加所需的運鏡方式,來精確控制畫面的變化。

例如,研究人員通過模型生成了一幅圖像,提示為「冒險游戲概念圖,雪山日出,清澈河流」。下面的示例將給定的文本后綴添加到所需的動作中。

圖片

圖片

從左到右:拉遠、滑動變焦、向左平移、弧型運動鏡頭、搖臂拍攝、無人機航拍

評估結果

最后,VideoPoet在具體的實驗評測中的表現又如何呢?

為了確保評估的客觀性,谷歌研究人員在在各種提示上運行所有模型,并讓人們對其偏好進行評分。

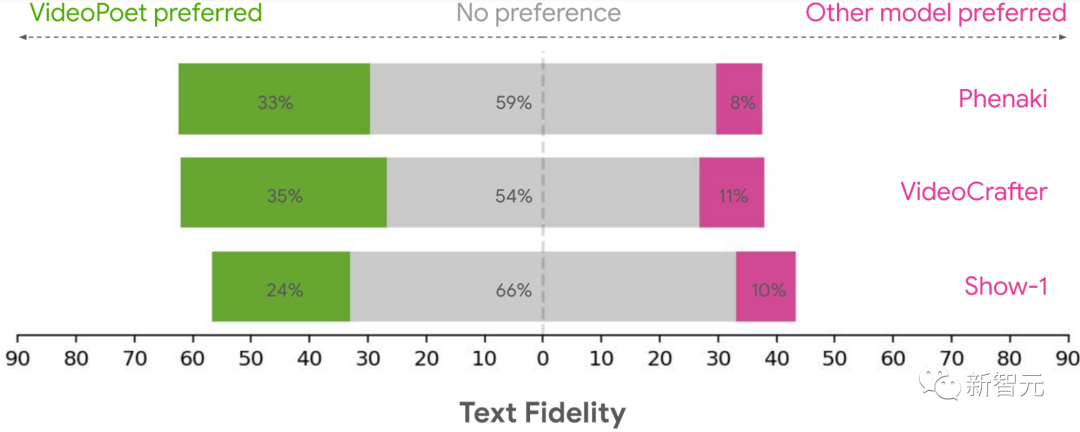

下圖顯示了在以下問題中,VideoPoet被選為綠色首選項的百分比。

文本保真度:

圖片

圖片

文本保真度的用戶偏好評級,即在準確遵循提示方面首選視頻的百分比

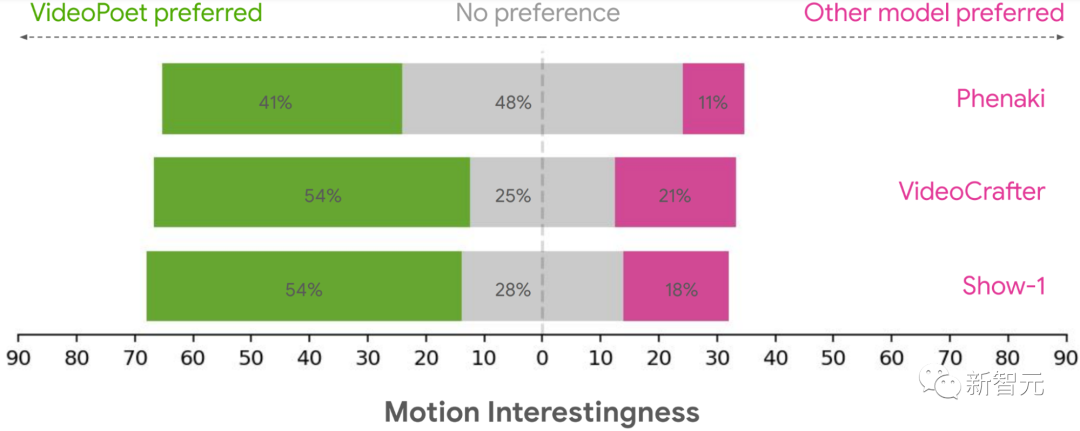

動作趣味性:

圖片

圖片

用戶對動作趣味性的偏好評級,即在產生有趣的動作方面,首選視頻的百分比

綜上可見,平均有24-35%的人認為VideoPoet生成的示例比其他模型更加遵循提示,而其他模型的這一比例僅為8-11%。

此外,41%-54%的評估者認為VideoPoet中的示例動作更有趣,而其他模型只有11%-21%。

對于未來的研究方向,谷歌研究人員表示,VideoPoet框架將會實現「any-to-any」的生成,比如擴展文本到音頻、音頻到視頻,以及視頻字幕等等。

網友不禁發問,Runway和Pika能否抵擋住谷歌和OpenAI即將推出的文本到視頻創新技術?

圖片

圖片

參考資料:

https://sites.research.google/videopoet/

https://blog.research.google/2023/12/videopoet-large-language-model-for-zero.html