擊敗擴散模型,清華朱軍團隊基于薛定諤橋的新語音合成系統來了

近日,由清華大學計算機系朱軍教授課題組發布的基于薛定諤橋的語音合成系統 [1],憑借其 「數據到數據」的生成范式,在樣本質量和采樣速度兩方面,均擊敗了擴散模型的 「噪聲到數據」范式。

論文鏈接:https://arxiv.org/abs/2312.03491

項目網站:https://bridge-tts.github.io/

代碼實現:https://github.com/thu-ml/Bridge-TTS

問題背景

自 2021 年起,擴散模型(diffusion models)開始成為文本到語音合成(text-to-speech, TTS)領域的核心生成方法之一,如華為諾亞方舟實驗室提出的 Grad-TTS [2]、浙江大學提出的 DiffSinger [3] 等方法均實現了較高的生成質量。此后,又有眾多研究工作有效提升了擴散模型的采樣速度,如通過先驗優化 [2,3,4]、模型蒸餾 [5,6]、殘差預測 [7] 等方法。然而,如此項研究所示,由于擴散模型受限于「噪聲到數據」的生成范式,其先驗分布對生成目標提供的信息始終較為有限,對條件信息無法利用充分。

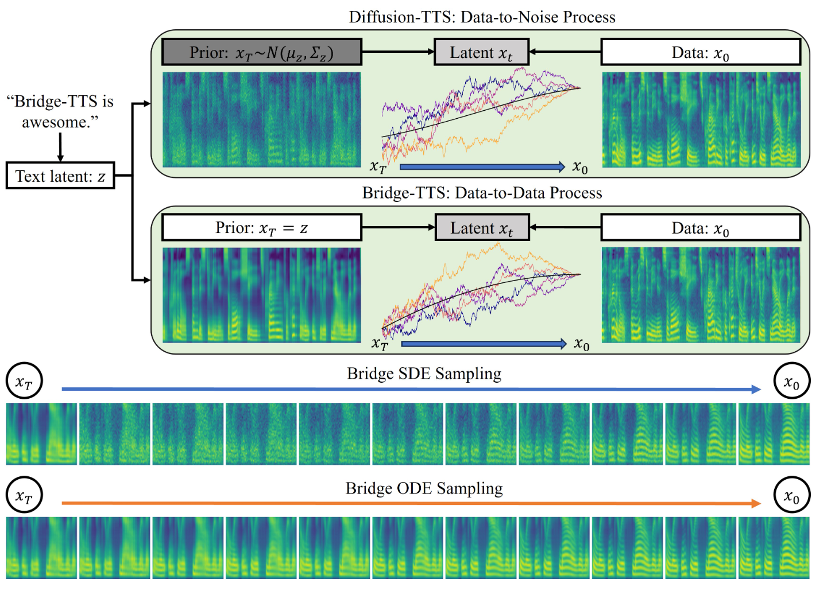

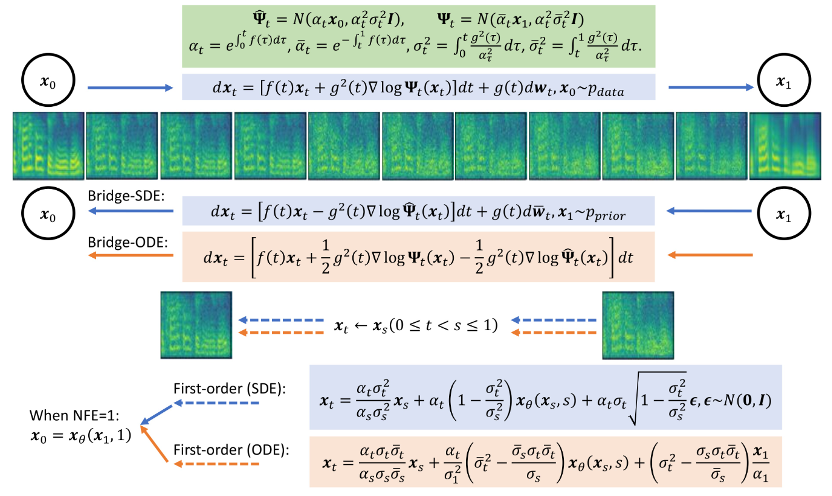

本次語音合成領域的最新研究工作,Bridge-TTS,憑借其基于薛定諤橋的生成框架,實現了「數據到數據」的生成過程,首次將語音合成的先驗信息由噪聲修改為干凈數據,由分布修改為確定性表征。

該方法的主要架構如上圖所示,輸入文本首先經由文本編碼器提取出生成目標(mel-spectrogram, 梅爾譜)的隱空間表征。此后,與擴散模型將此信息并入噪聲分布或用作條件信息不同,Bridge-TTS 的方法支持直接將其作為先驗信息,并支持通過隨機或確定性采樣的方式,高質量、快速地生成目標。

工作成果

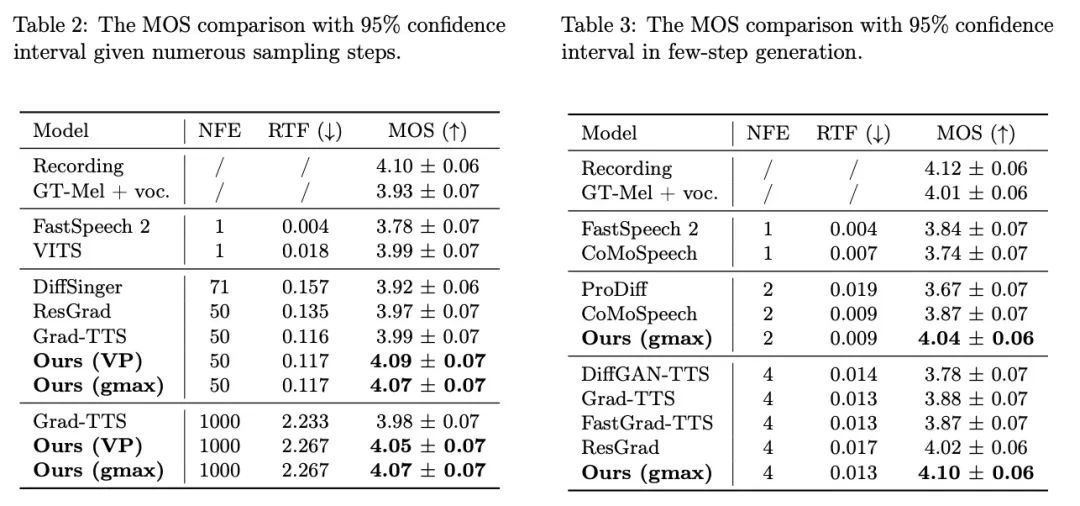

在驗證語音合成質量的標準數據集 LJ-Speech 上,研究團隊將 Bridge-TTS 與 9 項高質量的語音合成系統和擴散模型的加速采樣方法進行了對比。如下所示,該方法在樣本質量上(1000 步、50 步采樣)擊敗了基于擴散模型的高質量 TTS 系統 [2,3,7],并在采樣速度上,在無需任何后處理如額外模型蒸餾的條件下,超過了眾多加速方法,如殘差預測、漸進式蒸餾、以及最新的一致性蒸餾等工作 [5,6,7]。

以下是 Bridge-TTS 與基于擴散模型方法的生成效果示例,更多生成樣本對比可訪問項目網站:https://bridge-tts.github.io/

- 1000 步合成效果對比

輸入文本:「Printing, then, for our purpose, may be considered as the art of making books by means of movable types.」

真實樣本,機器之心,7秒

Bridge-TTS-1000,機器之心,6秒

Grad-TTS-1000,機器之心,6秒

- 4 步合成效果對比

輸入文本:「The first books were printed in black letter, i.e. the letter which was a Gothic development of the ancient Roman character,」

真實樣本,機器之心,7秒

Bridge-TTS-4,機器之心,7秒

Fast Grad-TTS-4,機器之心,7秒

ResGrad-4,機器之心,6秒

- 2 步合成效果對比

輸入文本:「The prison population fluctuated a great deal,」

真實樣本-2,機器之心,2秒

Bridge-TTS-2,機器之心,2秒

CoMoSpeech-2,機器之心,3秒

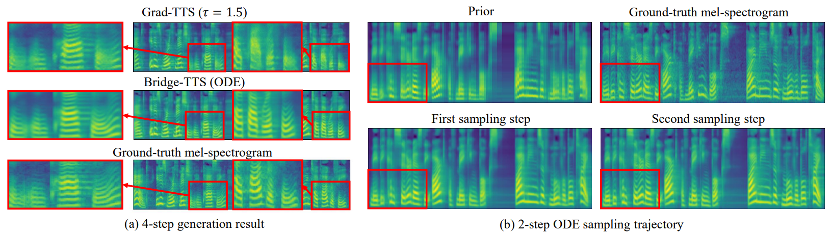

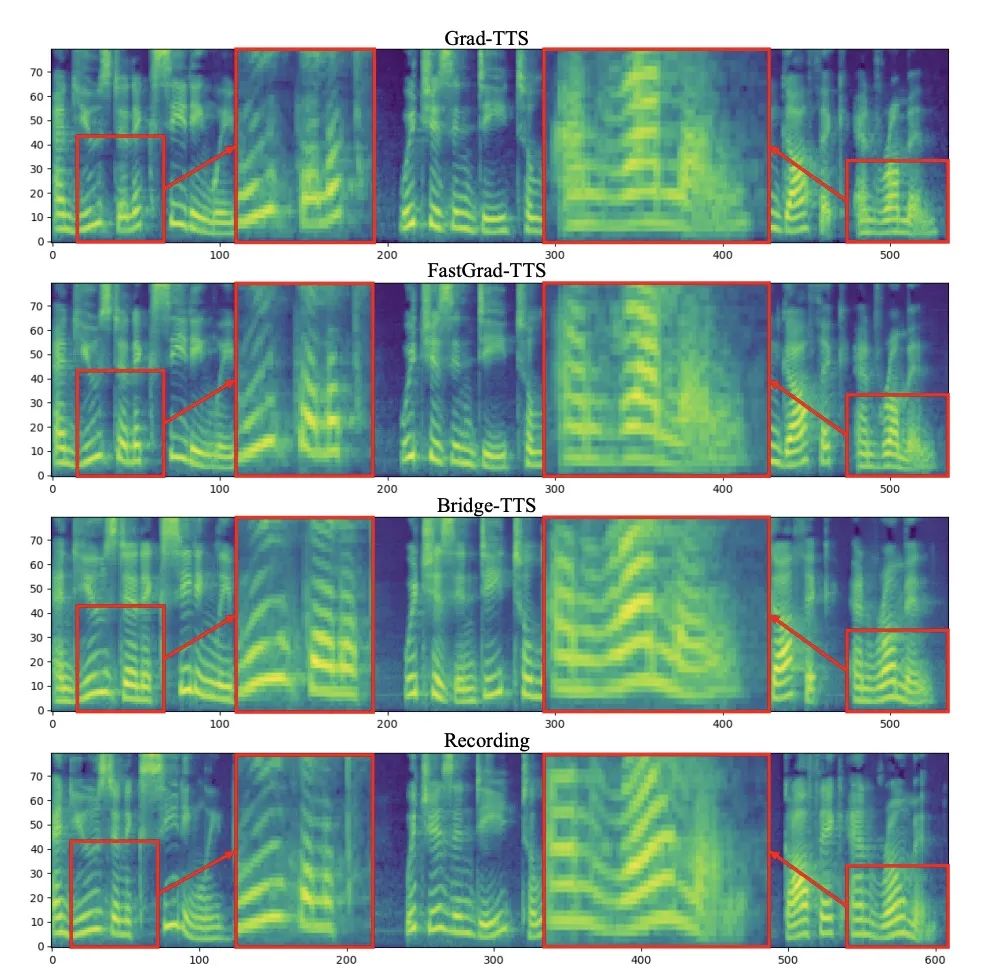

下面展示了 Bridge-TTS 一個在 2 步和 4 步的一個確定性合成(ODE sampling)案例。在 4 步合成中,該方法相較于擴散模型顯著合成了更多樣本細節,并沒有噪聲殘留的問題。在 2 步合成中,該方法展示出了完全純凈的采樣軌跡,并在每一步采樣完善了更多的生成細節。

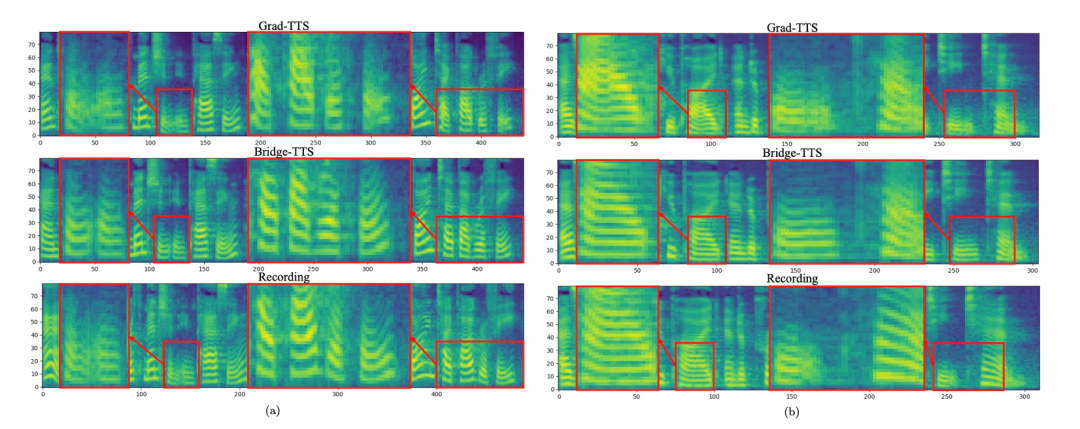

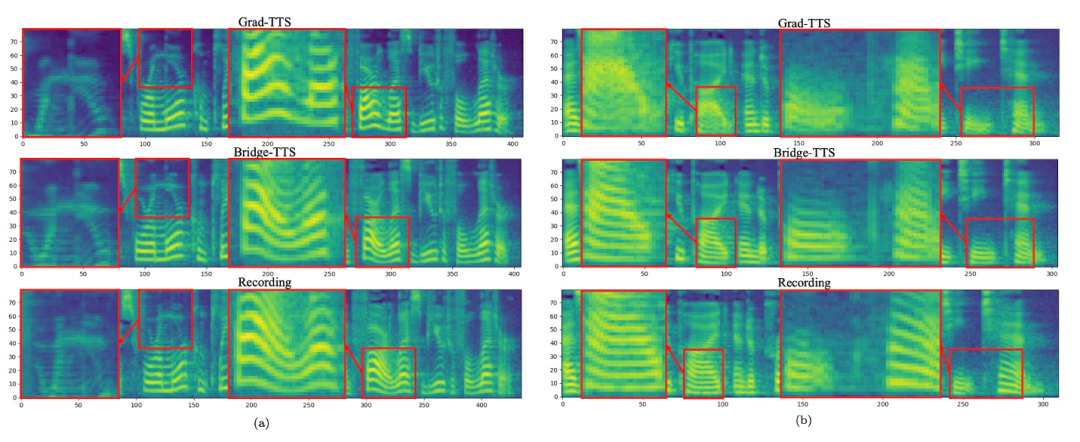

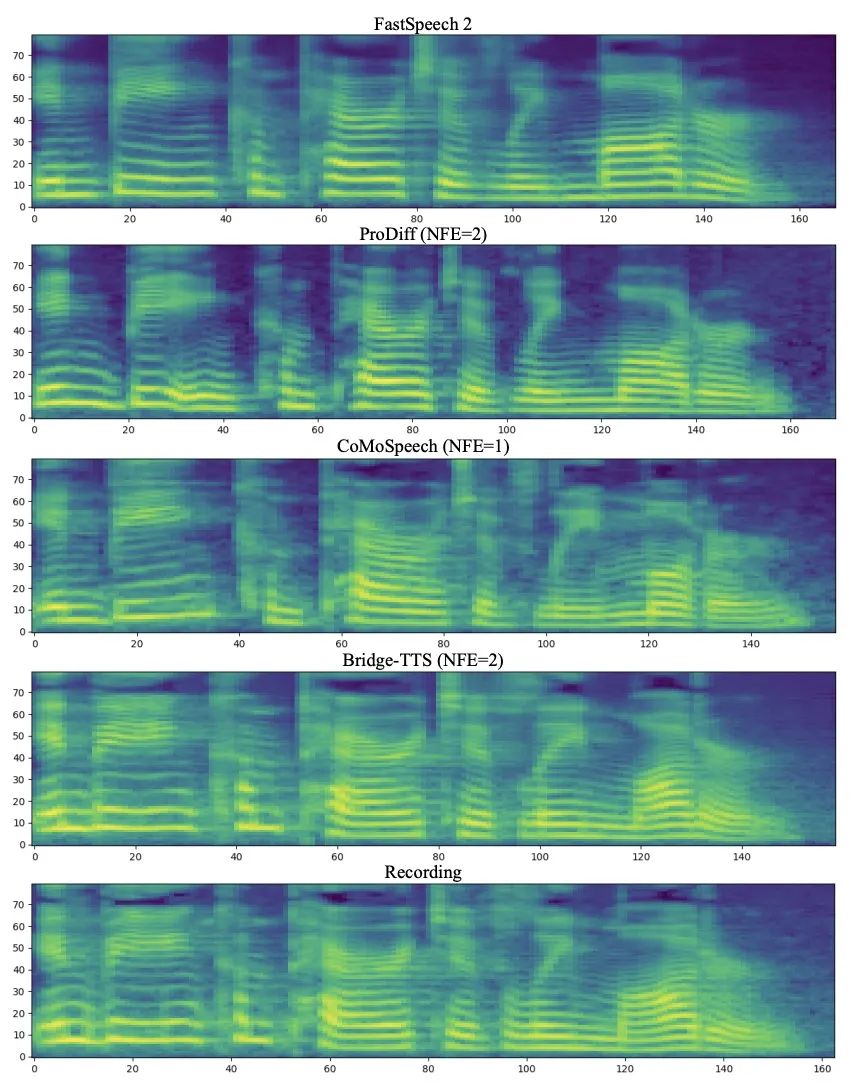

在頻域中,更多的生成樣本如下所示,在 1000 步合成中,該方法相較于擴散模型生成了更高質量的梅爾譜,當采樣步數降到 50 步時,擴散模型已經犧牲了部分采樣細節,而基于薛定諤橋的該方法仍然保持著高質量的生成效果。在 4 步和 2 步合成中,該方法不需蒸餾、多階段訓練、和對抗損失函數,仍然實現了高質量的生成效果。

在 1000 步合成中,Bridge-TTS與基于擴散模型的方法的梅爾譜對比

在 50 步合成中,Bridge-TTS與基于擴散模型的方法的梅爾譜對比

在 4 步合成中,Bridge-TTS與基于擴散模型的方法的梅爾譜對比

在 2 步合成中,Bridge-TTS與基于擴散模型的方法的梅爾譜對比

Bridge-TTS一經發布,憑借其在語音合成上新穎的設計與高質量的合成效果,在 Twitter 上引起了熱烈關注,獲得了百余次轉發和數百次點贊,入選了 Huggingface 在 12.7 的 Daily Paper 并在當日獲得了支持率第一名,同時在 LinkedIn、微博、知乎、小紅書等多個國內外平臺被關注與轉發報道。

多個外文網站也進行了報道和討論:

方法介紹

薛定諤橋(Schrodinger Bridge)是一類繼擴散模型之后,近期新興的深度生成模型,在圖像生成、圖像翻譯等領域都有了初步應用 [8,9]。不同于擴散模型在數據和高斯噪聲之間建立變換過程,薛定諤橋支持任意兩個邊界分布之間的轉換。在 Bridge-TTS 的研究中,作者們提出了基于成對數據間薛定諤橋的語音合成框架,靈活支持著多種前向過程、預測目標、及采樣過程。其方法概覽如下圖所示:

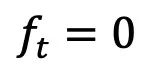

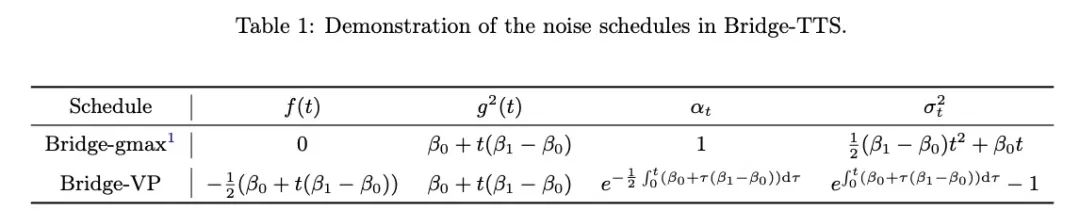

- 前向過程:此研究在強信息先驗和生成目標之間搭建了一種完全可解的薛定諤橋,支持靈活的前向過程選擇,如對稱式噪聲策略:

、常數

、常數 ,和非對稱噪聲策略:

,和非對稱噪聲策略:  、線性

、線性 ,以及直接與擴散模型相對應的方差保持(VP)噪聲策略。該方法發現在語音合成任務中非對稱噪聲策略:即線性

,以及直接與擴散模型相對應的方差保持(VP)噪聲策略。該方法發現在語音合成任務中非對稱噪聲策略:即線性 (gmax)和 VP 過程,相較于對稱式噪聲策略有更好的生成效果。

(gmax)和 VP 過程,相較于對稱式噪聲策略有更好的生成效果。

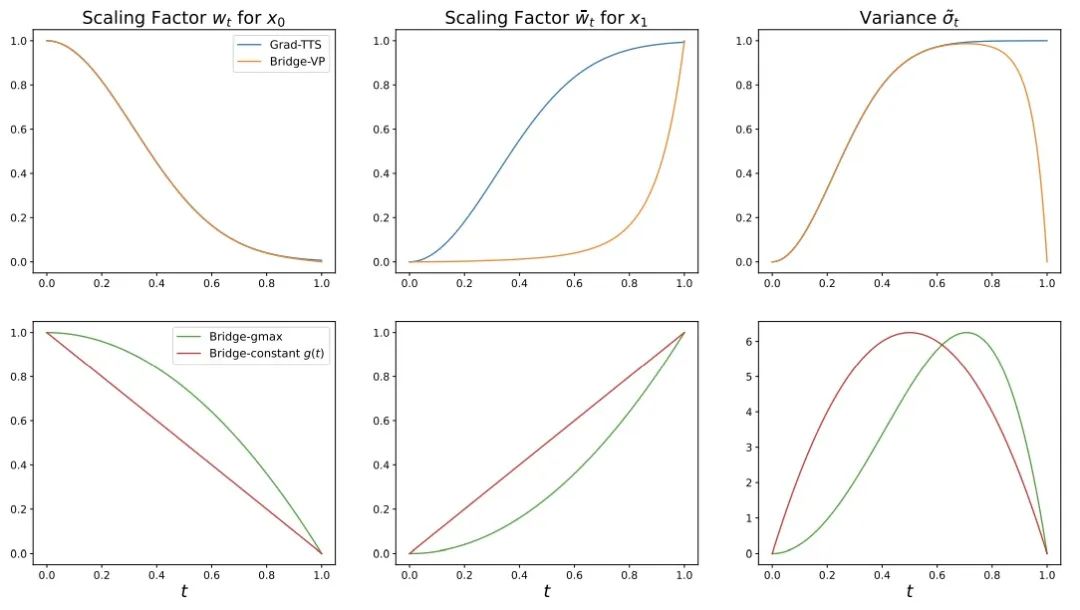

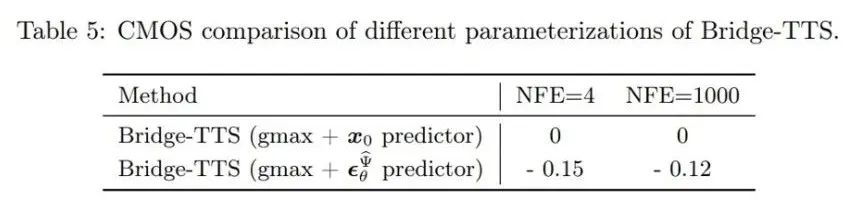

- 模型訓練:該方法保持了擴散模型訓練過程的多個優點,如單階段、單模型、和單損失函數等。并且其對比了多種模型參數化(Model parameterization)的方式,即網絡訓練目標的選擇,包括噪聲預測(Noise)、生成目標預測(Data)、和對應于擴散模型中流匹配技術 [10,11] 的速度預測(Velocity)等。文章發現以生成目標,即梅爾譜為網絡預測目標時,可以取得相對更佳的生成效果。

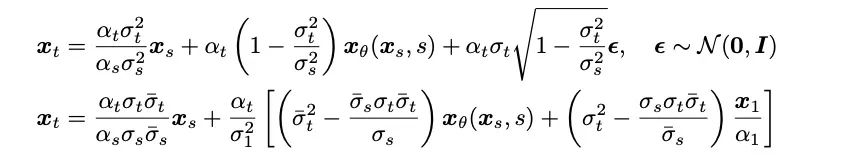

- 采樣過程:得益于該研究中薛定諤橋完全可解的形式,對薛定諤橋對應的前 - 后向 SDE 系統進行變換,作者們得到了 Bridge SDE 和 Bridge ODE 用于推斷。同時,由于直接模擬 Bridge SDE/ODE 推斷速度較慢,為加快采樣,該研究借助了擴散模型中常用的指數積分器 [12,13],給出了薛定諤橋的一階 SDE 與 ODE 采樣形式:

在 1 步采樣時,其一階 SDE 與 ODE 的采樣形式共同退化為網絡的單步預測。同時,它們與后驗采樣 / 擴散模型 DDIM 采樣有著密切聯系,文章在附錄中給出了詳細分析。文章也同時給出了薛定諤橋的二階采樣 SDE 與 ODE 采樣算法。作者發現,在語音合成中,其生成質量與一階采樣過程類似。

在其他任務如語音增強、語音分離、語音編輯等先驗信息同樣較強的任務中,作者們期待此研究也會帶來較大的應用價值。

作者簡介

此項研究有三位共同第一作者:陳澤華,何冠德,鄭凱文,均屬于清華大學計算機系朱軍課題組,文章通訊作者為朱軍教授,微軟亞洲研究院首席研究經理譚旭為項目合作者。

朱軍教授

微軟亞洲研究院首席研究經理譚旭

陳澤華是清華大學計算機系水木學者博士后,主要研究方向為概率生成模型,及其在語音、音效、生物電信號合成等方面的應用。曾在微軟、京東、TikTok 等多家公司實習,在語音和機器學習領域重要國際會議 ICML/NeurIPS/ICASSP 等發表多篇論文。

何冠德是清華大學在讀的三年級碩士生,主要研究方向是不確定性估計與生成模型,此前在 ICLR 等會議以第一作者身份發表論文。

鄭凱文是清華大學在讀的二年級碩士生,主要研究方向是深度生成模型的理論與算法,及其在圖像、音頻和 3D 生成中的應用。此前在 ICML/NeurIPS/CVPR 等頂級會議發表多篇論文,涉及了擴散模型中的流匹配和指數積分器等技術。