清華特獎焦劍濤大模型創業:突破GPT-4工具使用能力,搞開源種子輪融資七千萬

兩位清華校友打造,在GPT-4核心優勢之一使用工具上實現超越。

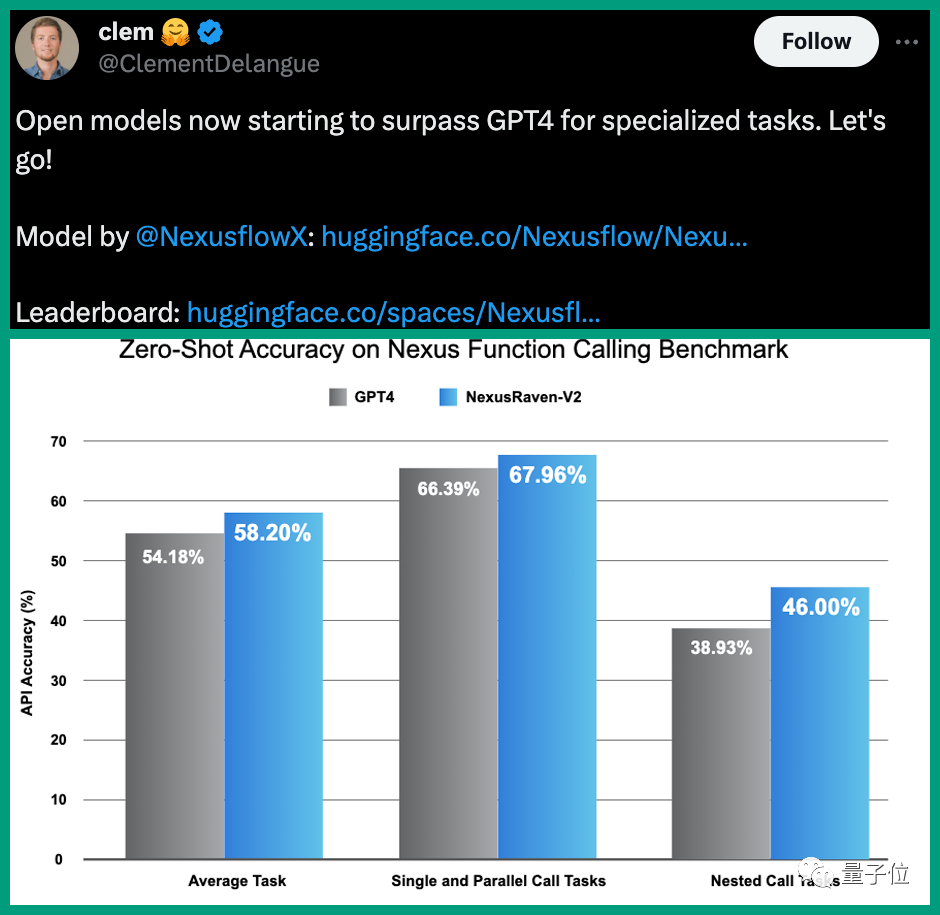

連HuggingFace CEO都來幫它造勢:

它的名字叫“NexusRaven”,參數只有130億。

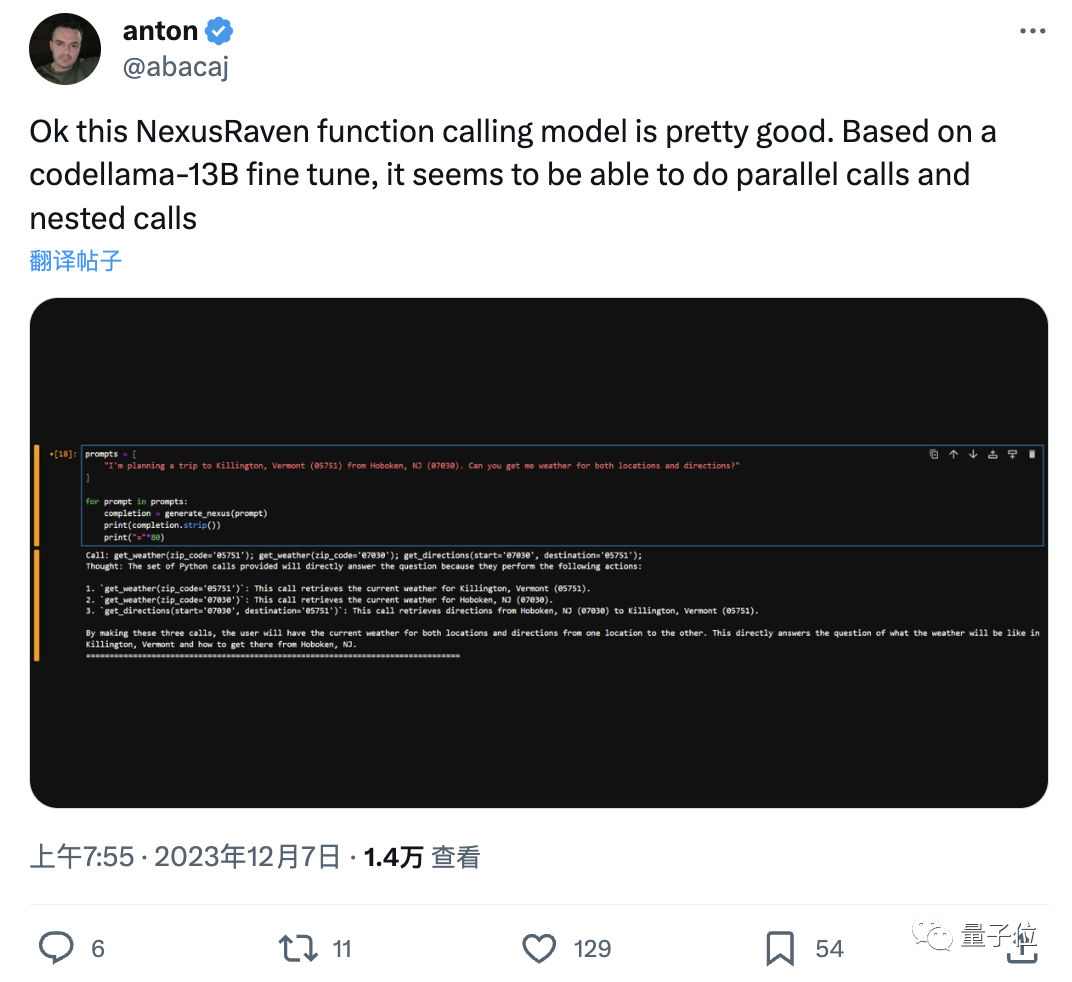

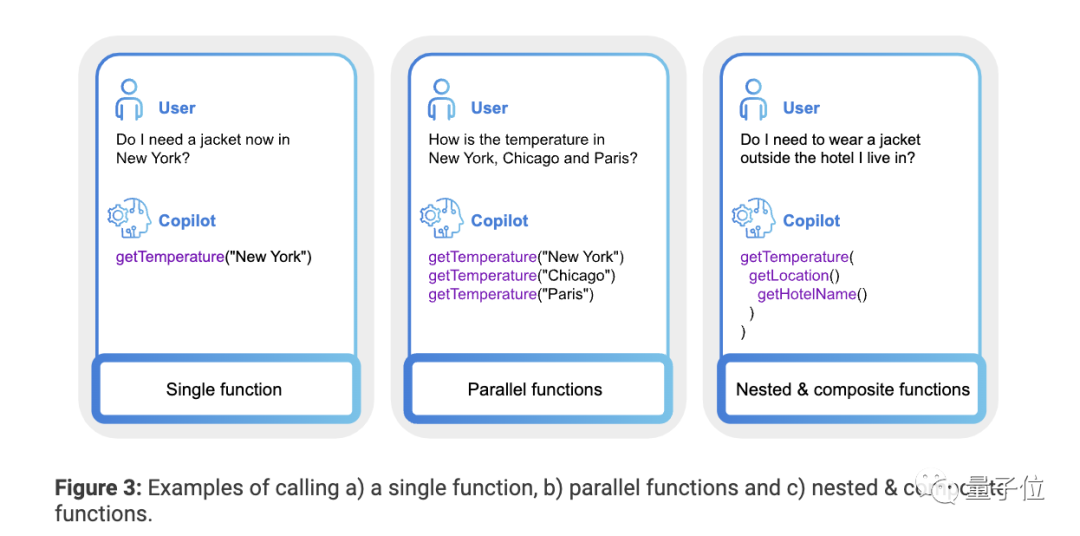

出色的函數調用能力連網友都忍不住稱贊,既可以并行也可以嵌套。

背后團隊則更令人矚目:

一共三位創始人,除了兩位清華校友(其中一位拿過清華特獎),還有一位在工業界干了15年的AI大牛。

他們創辦的公司(也就是該模型所屬的公司),在種子輪就已經融資1060萬美元(約合人民幣7600萬)。

如此大有來頭的模型和團隊,我們忍不住扒了扒。

清華特獎得主聯合創辦

這家公司名叫Nexusflow,今年9月剛剛亮相,并當即宣布千萬美元級種子輪融資。

它在短短不到3個月的時間就發布了2代大模型NexusRaven,其中第二代直接單點突破GPT-4,引起開源社區大量關注。

NexusRaven的開源和商用,是完全不用擔心侵權的那種,因為它的訓練不涉及任何由專有LLM(如GPT-4) 生成的數據。

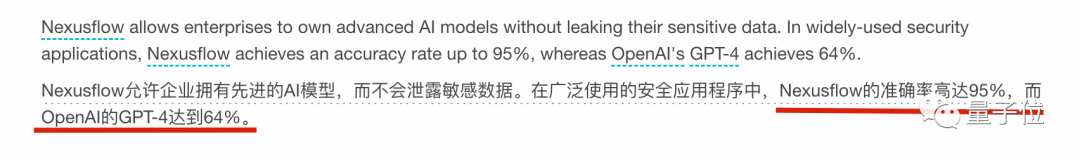

當然,隱私數據就更不用擔心了,NexusRaven稱自己的安全性比GPT-4要高了21個百分點。

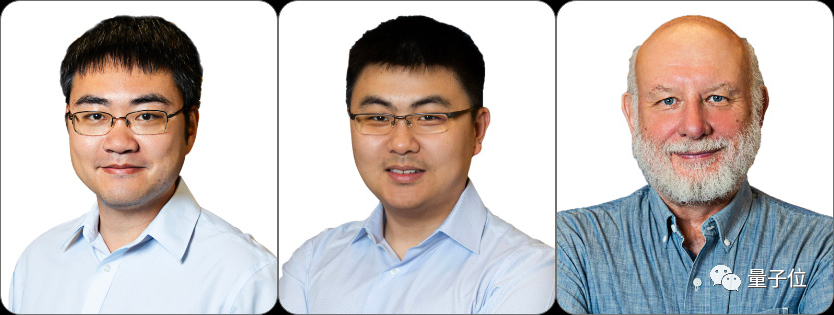

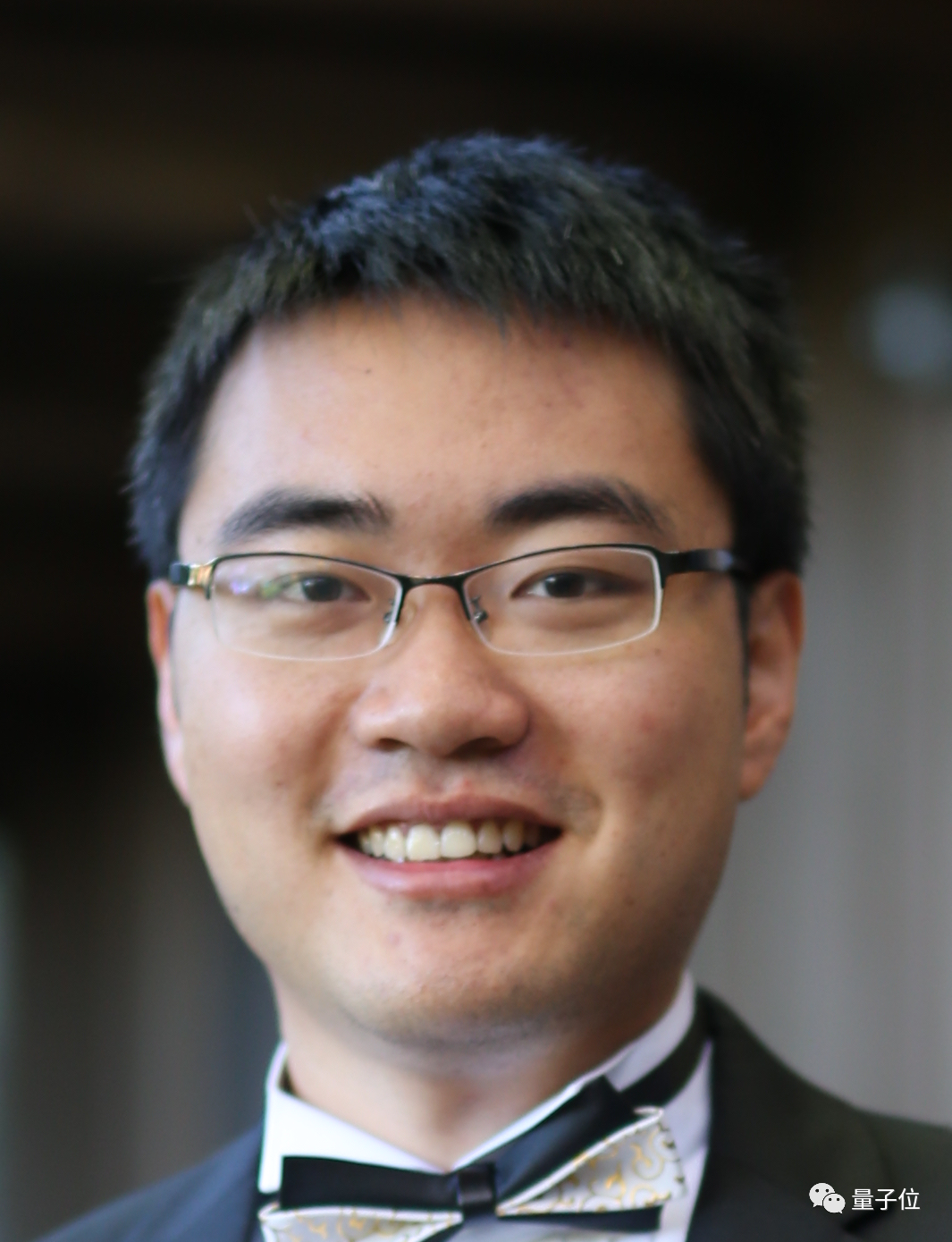

三位創始人中,CEO為焦劍濤。

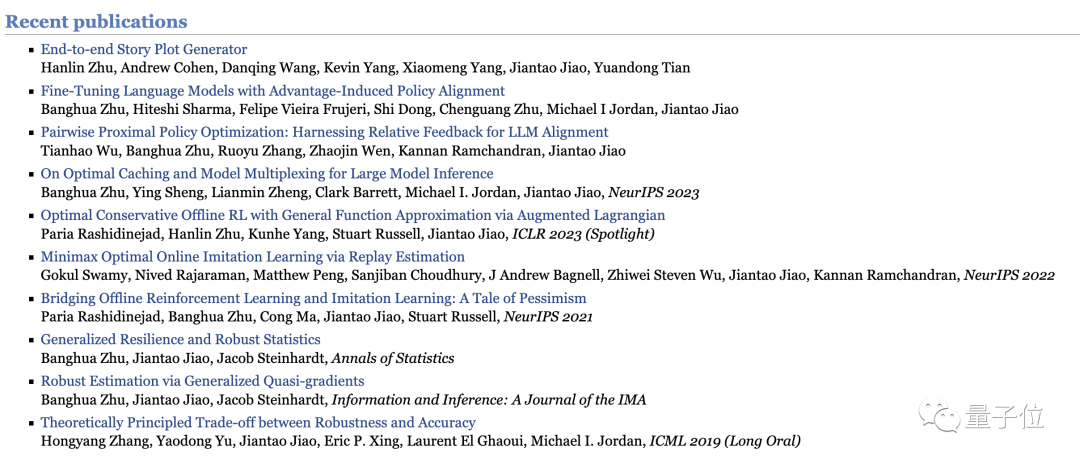

他本科畢業于清華大學電子工程系,2018年從斯坦福博士畢業,進入加州大學伯克利分校擔任助理教授。

在伯克利,作為BAIR的一員,焦劍濤與Michael Jordan、姚班校友朱晨光等均有合作。

值得一提的是,焦劍濤是2011年清華特獎得主,還與有“清華學神”之稱的學弟韓衍雋有過一段“傳承”故事:

韓衍雋曾表示,自己在美國交流期間,受到過焦劍濤很大的影響。

Nexusflow并非焦劍濤的第一次創業。在他攻讀博士期間,就曾與另一位清華電子系校友張文鑄聯合創立了“AI+教育”的清帆科技。

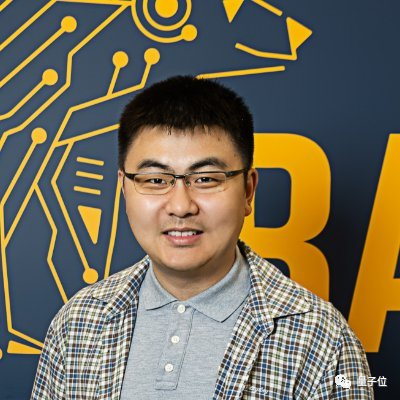

CTO Jian Zhang,同樣是清華電子系校友,2020年畢業于斯坦福大學計算機科學專業。

加入Nexusflow創業團隊之前,Jian Zhang曾任SambaNova Systems機器學習總監,該公司是一家人工智能芯片初創公司,估值超50億美元。

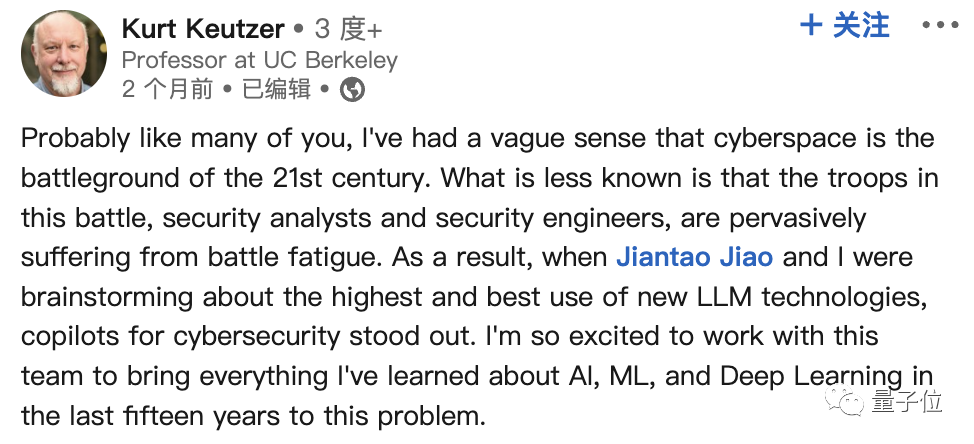

最后一位創始人Kurt Keutzert是加州大學伯克利分校教授,h指數為100,論文總引用量超5萬,研究重點包括用并行和分布式計算加速深度神經網絡訓練、計算機視覺等AI方向。

他曾是貝爾實驗室的一員,后于1991-1998年任EDA公司新思科技CTO和高級副總裁。1997年,他拿到了加州大學伯克利分校的教職,進入學術界工作。

有意思的是,Keutzert事實上并未離開工業界——他一直以來還兼任著天使投資人和顧問的角色。

而他和博士生Forrest Iandola共同創立的DeepScale——一家研究自動駕駛汽車感知系統技術的公司,還在2019年被特斯拉收購了。

三位背景過硬的大佬,創辦的公司Nexusflow所瞄準的方向,則是大模型在網絡安全中的應用。

用官方的話說,是要“利用生成式AI徹底改變網絡安全”,包括:

用統一對話界面簡化軟件配置、集成和使用,提供解決方案簡化網絡安全運營中檢測、調查、響應和修復的各個環節,以及在大模型時代保護用戶不受提示注入、數據泄露等新的安全問題的影響等等。

簡而言之,就是在流程上解放網絡安全從業人員。

公開兩個月,即發布NexusRaven-V2,也正是焦劍濤、Kurt Keutzer和Jian Zhang這三位創始人目標的初步體現:

用一個更經濟高效的模型,實現更強大的“工具”調用能力。

那么,它旗下的“明星出品”:NexusRaven-V2,究竟什么樣?

模型更小,函數調用能力更強

據介紹,NexusRaven-V2完全基于開放數據集打造,并在CodeLlama-13B-instruct上進行了指令微調。

它的主要功能就是將人類給出的自然語言指令轉換為可執行代碼,然后利用代碼來自動使用工具完成任務。

聽起來和之前很火的AutoGPT很類似。

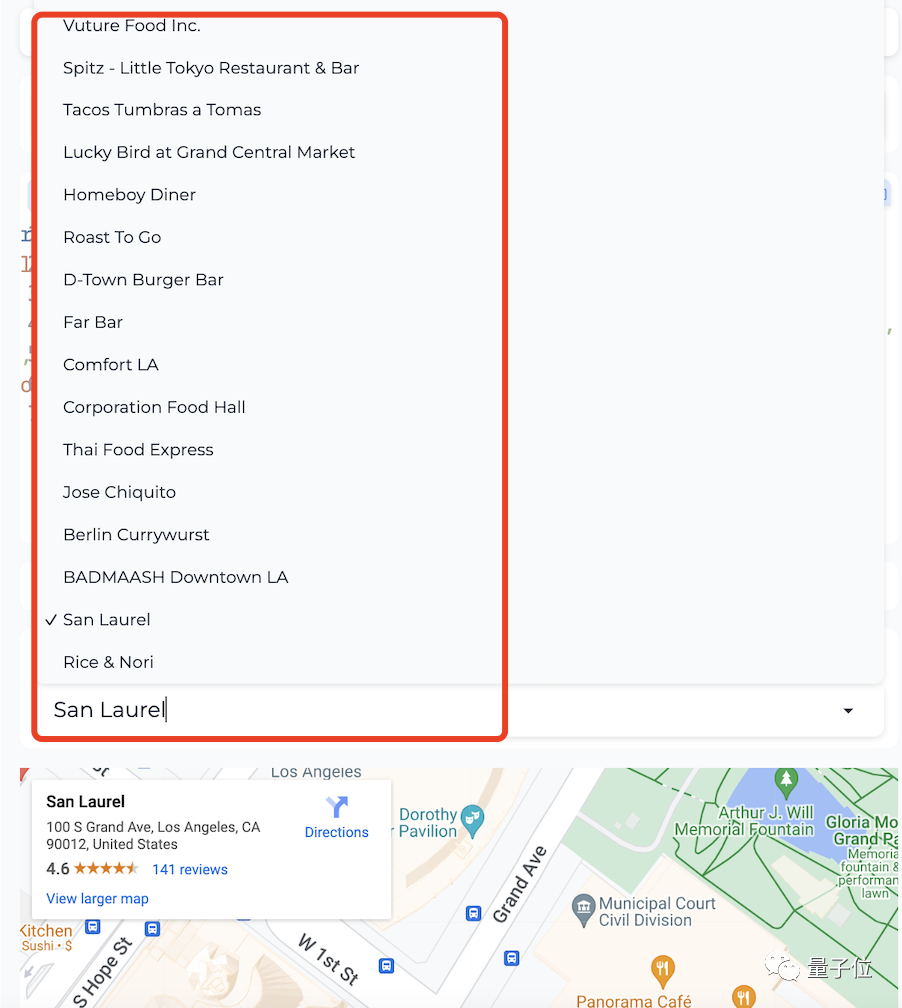

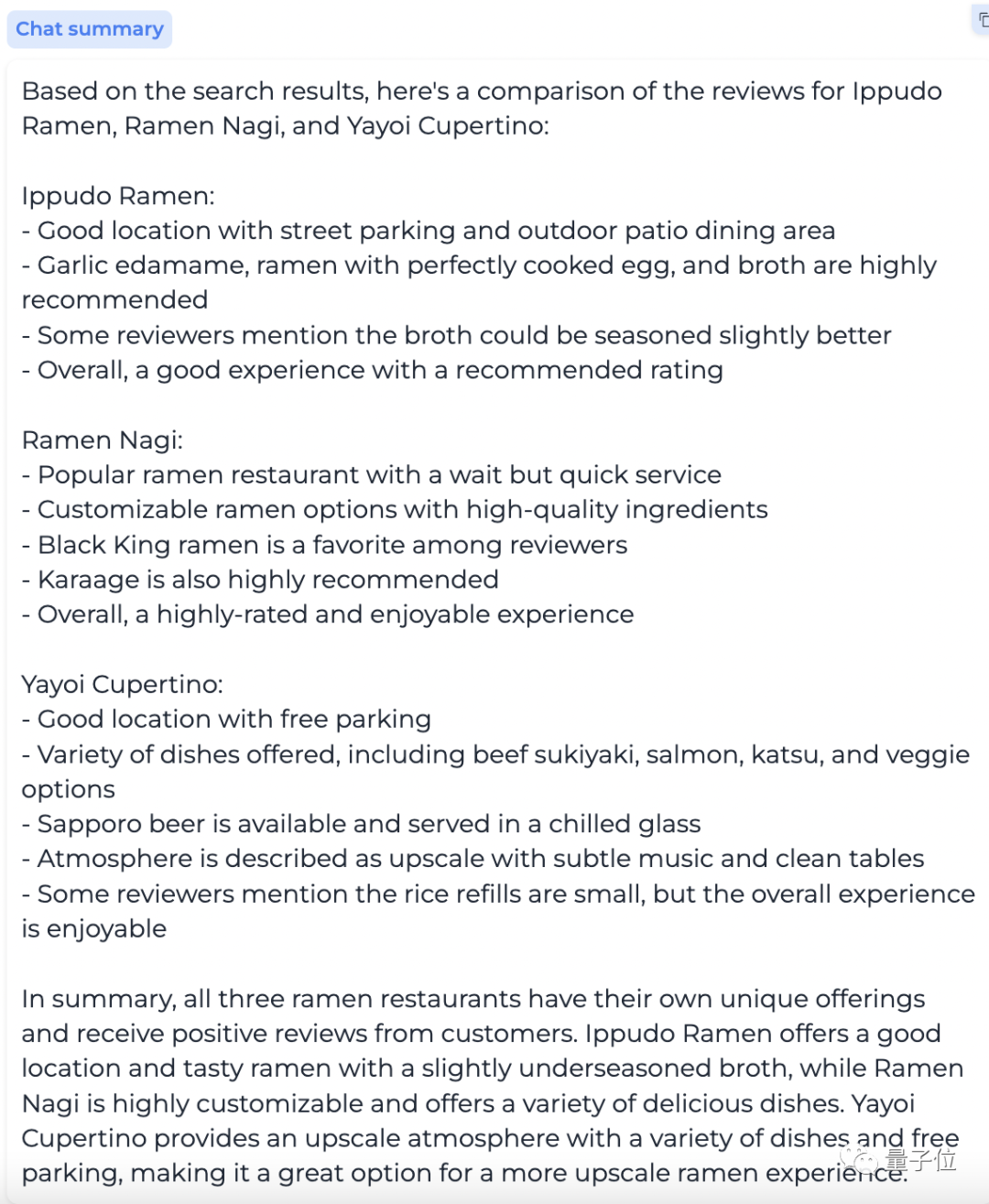

從官方給出的demo來看,它可以進行最簡單的“附近美食”查找:

只需問它“Get me good food nearby?”,它就能立刻編寫出幾行代碼,然后開始定位你的城市、將城市坐標轉換為經緯度、領取目標任務(20個飯店建議)以及按距離從遠到近排序。

最終給出每一個飯店的谷歌地圖,還能點擊進行查看詳細評分等信息。

以及最最后還有一個文字版的總結。

稍微復雜一些的任務也行,比如找出舊金山市政廳20英里以內、每晚價格200美元以上的酒店。

同樣的流程:代碼、執行任務、出結果,包含地圖和最終列表總結。

當然,還可以進行深度對比,讓它評價幾家飯店各自的優勢。

總的來說,不管什么任務,都是靠它寫出來的代碼將人類指令轉化為精確的軟件工具操作來完成,整個過程也相當快,1分鐘左右。

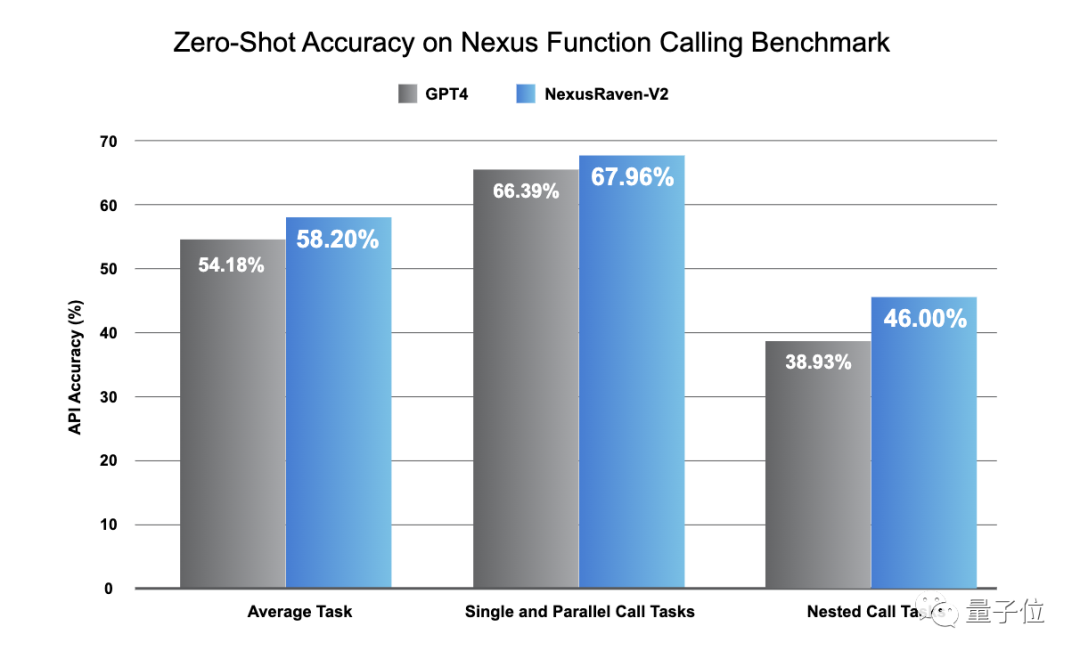

事實證明,在人工生成的9項基準測試中,只有130億參數的NexusRaven-V2做到了58.2%的平均調用成功率,比GPT-4高出4個百分點(在零樣本情況下)。

其中,兩者在單個或并行函數調用這種簡單任務上的表現差不多。

但如果再單看復雜的嵌套函數調用任務,NexusRaven-V2的成績比GPT-4表現得要更好,直接高出了7個百分點。

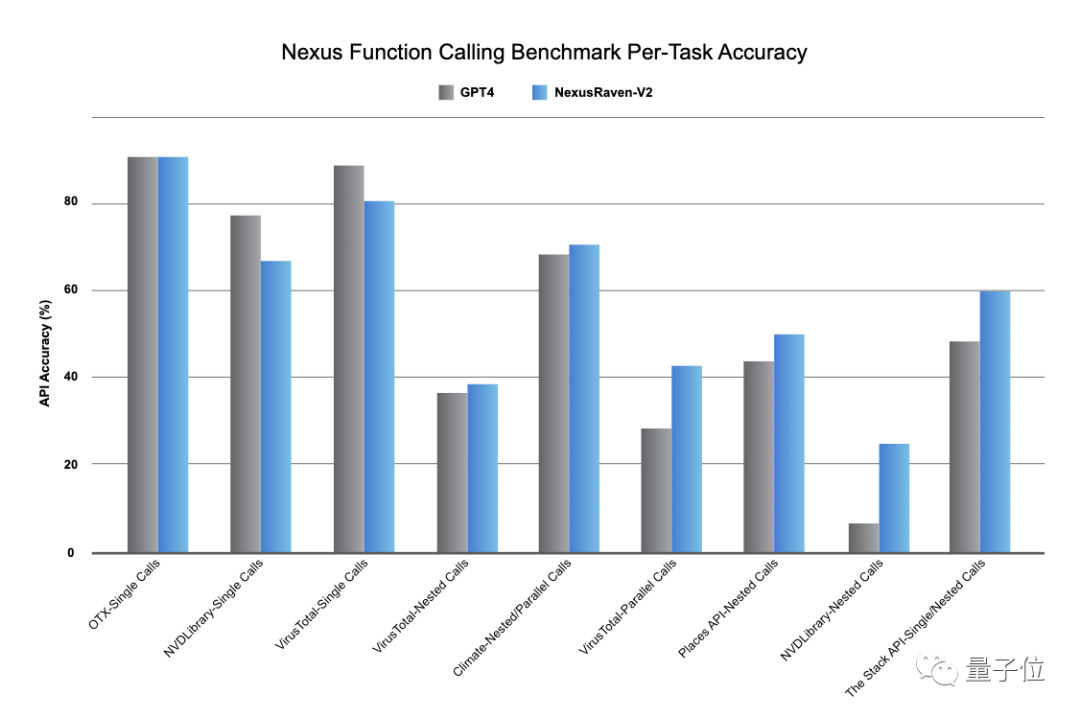

此外,能力測試還納入了9項操作現實世界軟件的任務,結果是有6項NexusRaven-V2也都超過GPT-4。

除此之外,團隊還介紹,函數的變量在發生改變時,NexusRaven-V2還表現出比GPT-4更強的魯棒性。

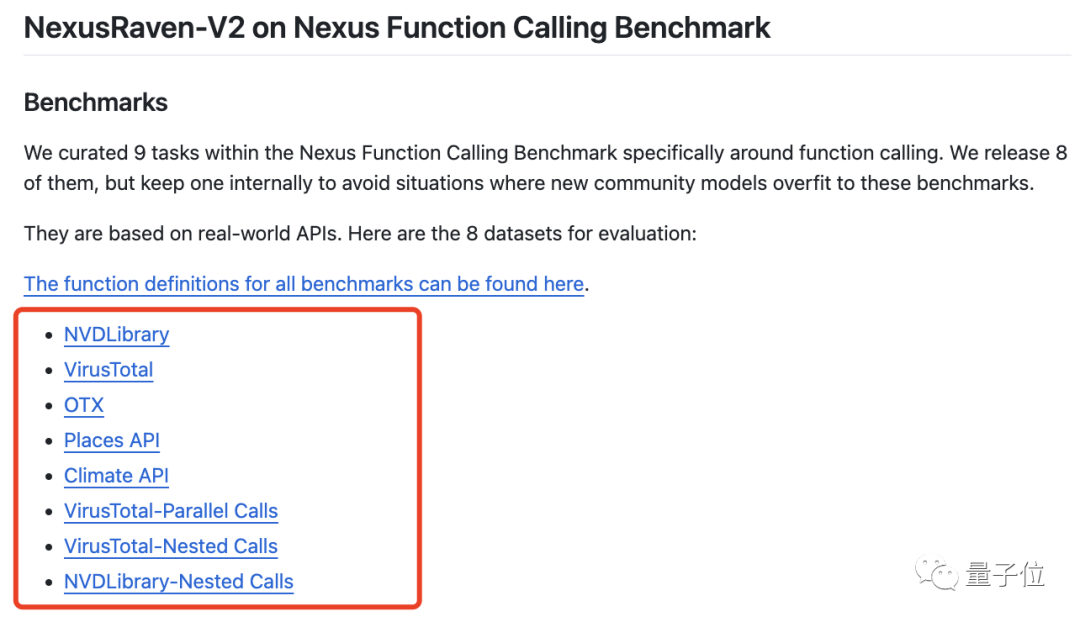

值得一提的是,為了確保結果可重復以及標準化函數調用評估指標,以上測試基準現在也一并公開發布。

以下是三種函數類型示例,有單個的、并行的,也有需要嵌套操作的。

大家可在Huggingface上獲取(具體入口可從NexusRaven-V2的GitHub界面獲得)。

如果你對NexusRaven-V2模型本身感興趣,團隊也已經發布了專門的Python包“nexusraven”,使用它就可以將模型與你已有的copilot或agent工具進行無縫集成(Colab上有教程)。

One More Thing

最后,不得不說,自Llama之后,開源大模型賽道越來越有群星匯聚之勢。

這邊130億參數模型跟GPT-4掰上了手腕,在歐洲,“歐版OpenAI”Mistral AI最新估值已經沖破20億美元,在短短六個月中增長了7倍多。

而就在最近,Mistral AI還靠一個磁力鏈接轟動了整個大模型社區:開源首個MoE大模型,也就是坊間傳聞中GPT-4采用的方案。

這不禁讓人好奇:開源模型,要崛起了嗎?