吉他搖滾、電子音樂都能搞定,Meta開源音頻生成新模型MAGNeT,非自回歸7倍提速

在文本生成音頻(或音樂)這個 AIGC 賽道,Meta 最近又有了新研究成果,而且開源了。

前幾日,在論文《Masked Audio Generation using a Single Non-Autoregressive Transformer》中,Meta FAIR 團隊、Kyutai 和希伯來大學推出了 MAGNeT,一種在掩碼生成序列建模方法,可以直接在多個音頻 tokens 流上直接運行。與以往工作最大的不同是,MAGNeT 是由單階段、非自回歸 transformer 生成音頻。

- 論文地址:https://arxiv.org/pdf/2401.04577.pdf

- GitHub 地址:https://github.com/facebookresearch/audiocraft/blob/main/docs/MAGNET.md

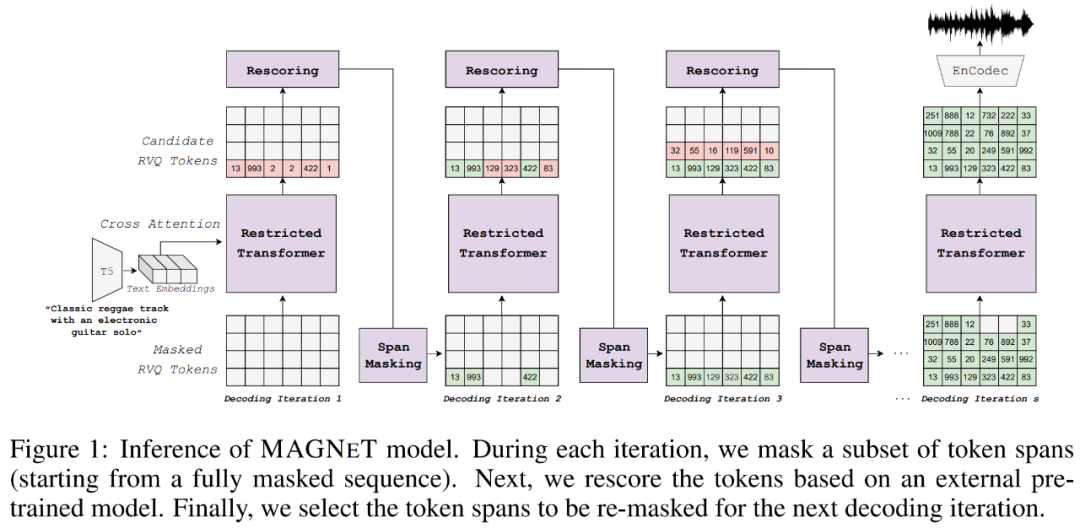

具體來講,在訓練期間,研究者預測從掩碼調度器獲得的掩碼 token 的范圍;在模型推理階段, 則通過幾個解碼步驟逐漸構建輸出序列。為了進一步增強生成音頻質量,他們提出一種新穎的重評分方法,利用外部預訓練模型對來自 MAGNET 的預測進行重評分和排名,然后用于后續的解碼步驟。

此外,研究者還探索了 MAGNET 的混合版本,融合自回歸和非自回歸模型,以自回歸的方式生成前幾秒,同時對剩余序列進行并行解碼。

從生成結果來看,MAGNET 在文本到音頻和文本到音樂任務上取得了非常不錯的效果,質量媲美 SOTA 自回歸基線模型的同時速度是它們的 7 倍。

大家可以聽一下生成的音樂效果。

MAGNeT 方法概覽

下圖 1 為 MAGNeT 原理圖,作為一個非自回歸的音頻生成掩碼語言模型,它以條件語義表示為條件,在從 EnCodec 中獲得的幾個離散音頻 token 流上運行。在建模策略上,研究者進行了包括掩碼策略、受限上下文、采樣機制和模型重評分等幾個方面的核心建模修改。

首先來看掩碼策略,研究者評估了 20ms 到 200ms 之間的各種跨度長度,并發現 60ms 跨度長度可以提供最佳的整體性能。他們從調度器中采樣了掩碼率 γ(i),并相應地計算了進行掩碼的平均跨度量。此外從計算效率方面考慮,研究者還使用了非重疊跨度。

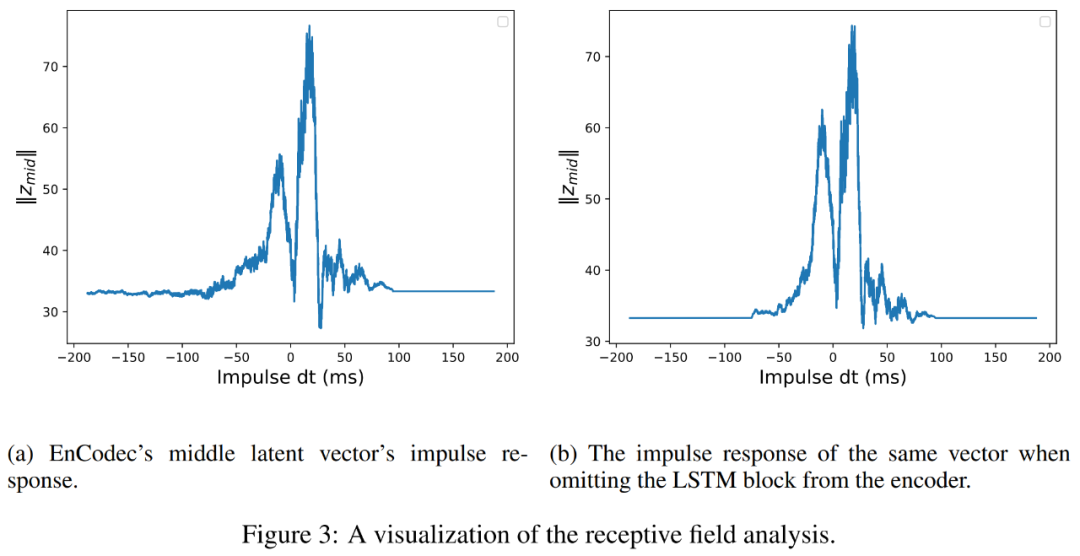

接著是受限上下文。研究者使用到了 EnCodec 并相應地限制了碼本的上下文。具體來講,音頻編碼器由多層卷積網絡和最終的 LSTM 塊組成。EnCodec 感受野的分析結果表明,卷積網絡的感受野約為 160ms,而包含 LSTM 塊的有效感受野約為 180ms。研究者使用隨時間推移的平移脈沖函數并測量了序列中間編碼向量的幅度,進而對模型的感受野進行了實證評估。

下圖 3 為過程展示,不過 LSTM 盡管在理論上具有無限記憶,但實際觀察來看是有限的。

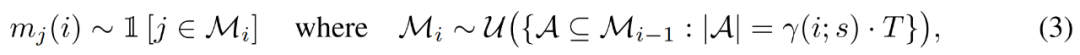

最后是模態推理,包含采樣和無分類器指導退火。采樣如下公式(3)所示,使用均勻采樣從先前一組掩碼跨度中選擇跨度。在實踐中,研究者使用第 i 次迭代時的模型置信度作為評分函數,來對所有可能的跨度進行排序,并相應地選擇最不可能進行掩碼的跨度。

對于 token 預測,研究者選擇使用無分類器指導來完成。在訓練期間,他們有條件和無條件地對模型進行優化;在推理期間,他們從獲得自條件和無條件概率的線性組合的一個分布中進行采樣。

實驗及結果

在實驗環節,研究者在文本到音樂生成和文本到音頻生成任務上對 MAGNeT 進行評估。他們使用了與 Copet et al. (2023) 所用完全相同的音樂生成訓練數據,與 Kreuk et al. (2022a) 所用完全相同的音頻生成訓練數據。

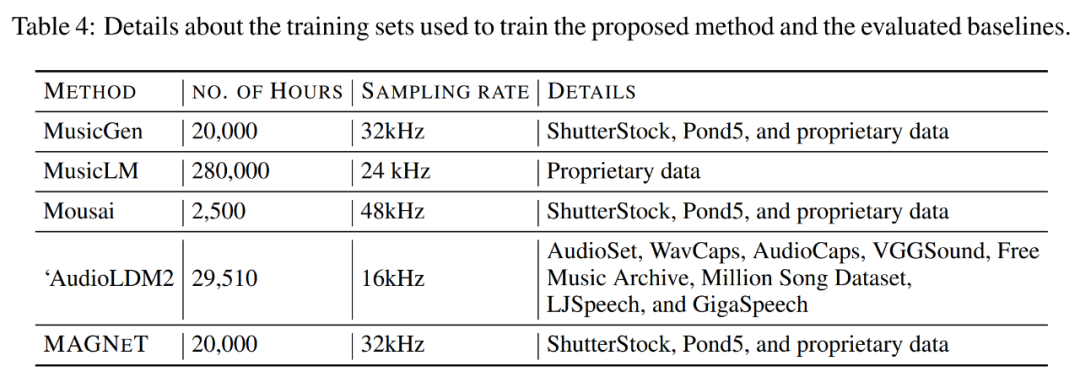

下表 4 展示了用于訓練 MAGNeT 以及其他基線方法(包括 MusicGen、MusicLM 和 AudioLDM2)的訓練集細節。

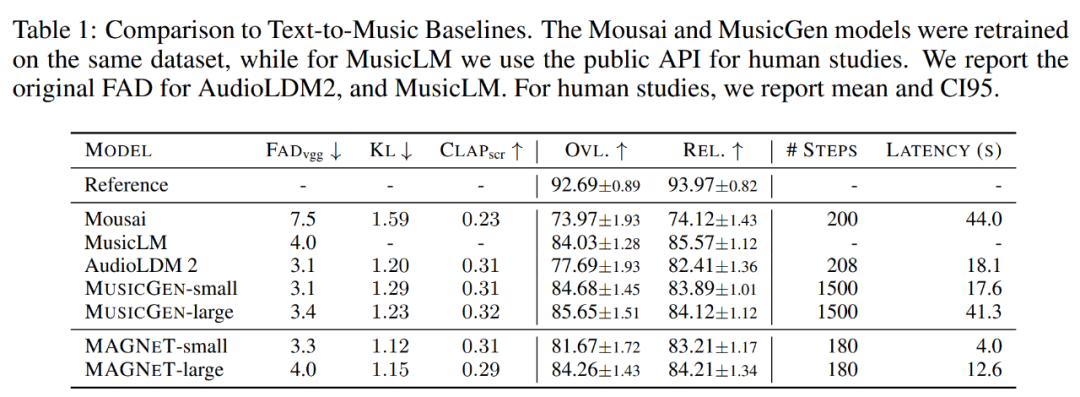

下表 1 為 MAGNeT 在文本到音樂生成任務上與其他基線方法的比較結果,使用的評估數據集為 MusicCaps。我們可以看到,MAGNeT 的性能與使用自回歸建模方法的 MusicGen 相當,但在生成速度(延遲)和解碼兩方面比后者快得多。

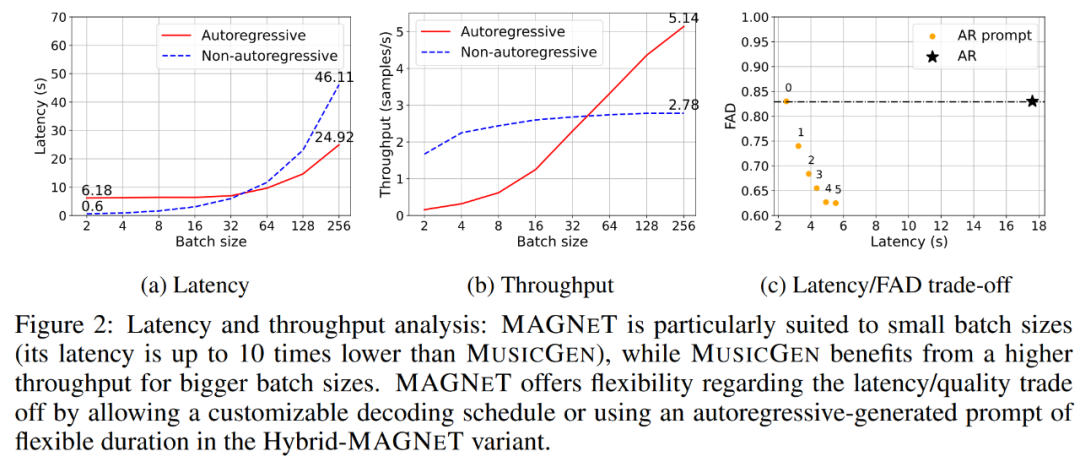

下圖 2a 表明,與自回歸基線模型(紅色曲線)相比,非自回歸模型(藍色虛線)得益于并行解碼在小批大小時表現尤為出色,單個生成樣本的延遲低至 600ms,是自回歸基線模型的 1/10。可以預見,MAGNeT 在需要低延遲預處理的交互式應用程序中應用潛力很大。此外在批大小達到 64 之前,非自回歸模型生成速度都要比基線模型快。

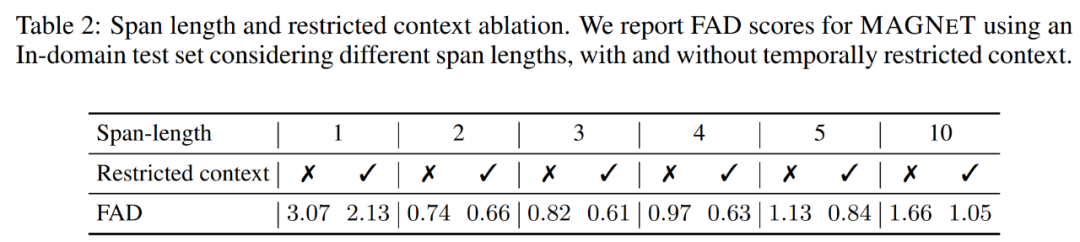

下表 2 展示了跨度長度和受限上下文的消融實驗。研究者報告了使用域內測試集時,MAGNeT 在不同跨度長度、有無時間受限上下文情況下的 FAD(Fréchet Audio Distance)分數。

更多技術細節和實驗結果請參閱原論文。