Sora不懂物理世界,翻車神圖全網爆笑!LeCun馬斯克DeepMind大佬激辯世界模型

大火的Sora,讓許多動畫、影視行業的人大為恐慌。

不過,今天網上廣為流傳的這張圖,讓大家倒是放心了不少。

可以看到,在這個視頻中,玻璃杯碎裂的方式十分詭異——

它被抬到半空中時,桌子上就忽然出現了一灘平整的紅色玻璃,隨后玻璃杯被摔到桌子上,和這灘玻璃融為一體。

為什么Sora做出的視頻是這樣的呢?

很顯然,Sora混淆了玻璃破碎和液體溢出的順序,也并不能推理時間和因果關系。

而這也說明,Sora目前還無法理解物理世界!

再比如,Sora團隊Aditya Ramesh自豪地放出的這個視頻,「螞蟻巢穴內爬行的POV鏡頭」,粗看似乎很驚艷,仔細一看,卻令人啼笑皆非——

螞蟻怎么只有四條腿?!

Sora這「人工智障」的表現,也讓大家著實松了一口氣。

雖說確實生成一些足夠驚艷的視頻,但Sora離「扔進一部小說,生成一部電影」,應該還差得遠呢。

跑步方向完全相反

椅子未被建模為剛性物體,居然能飄浮

「一只大鴨子走過波士頓的街道」,在第9秒,鴨子把人踩沒了

Sora不懂人類的物理世界?AI專家混戰

LeCun和馬庫斯這對「宿敵」,這次卻站在了統一戰線上,齊噴Sora所謂的「物理引擎」。

LeCun留言表示:嗨,Aditya,螞蟻有6條腿,不是嗎?

馬庫斯也表示,Sora會造成可怕的后果——

「我們即將有整整一代兒童接受虛假視頻的教育,這些視頻對于天真的觀眾是完全合理的,然而在生物學上卻錯誤百出。」

今天它弄錯的可能是一只螞蟻,明天就是月球的軌道。詐騙犯會做出許多虛假視頻,普通用戶會被蒙蔽,再也不知道什么是真實,什么是虛假。

對于玻璃杯錯誤摔碎的視頻,馬庫斯表示這是一個絕妙的例子。

我們需要認識到,并非Sora生成的所有視頻都來自其訓練集。Sora也并不總是遵循物理學、生物學和文化的規律。

我最近討論的7*7棋盤、4條腿的螞蟻,和碎裂的杯子一樣,都證明了Sora是一個魯莽的野獸,而非迭代的、基于定律的物理引擎。

OpenAI所引以為傲的對象的一致性,在這些demo中都沒有成功。因為模型在訓練數據中從未見過,從未被物理引擎產生過。

其實,Sora只是泛化了像素的模式,而并非世界上物體的模式。

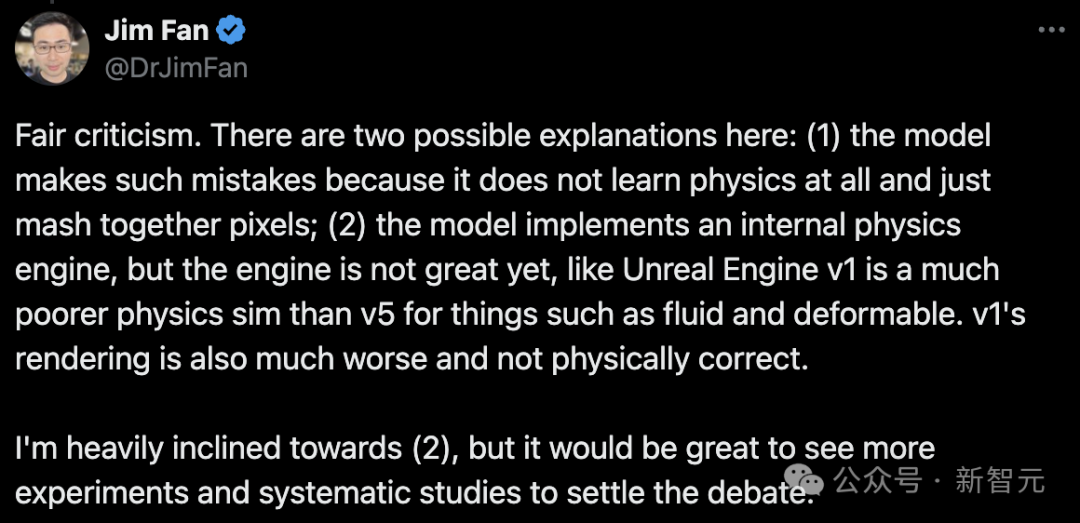

對此,英偉達高級研究科學家Jim Fan表示,我們可以從兩個角度來解釋這個問題:

(1)可能是因為這個模型根本沒有掌握物理知識,它僅僅是在無序地拼湊圖像像素;

(2)模型確實嘗試構建了一個內部的物理引擎,但這個引擎的表現還不盡人意。就像是第一代虛幻引擎在處理流體動力學和物體變形等問題上,與V5相比有著明顯的不足。同樣地,V1的渲染效果也遠不如V5,并且缺乏物理上的準確性。

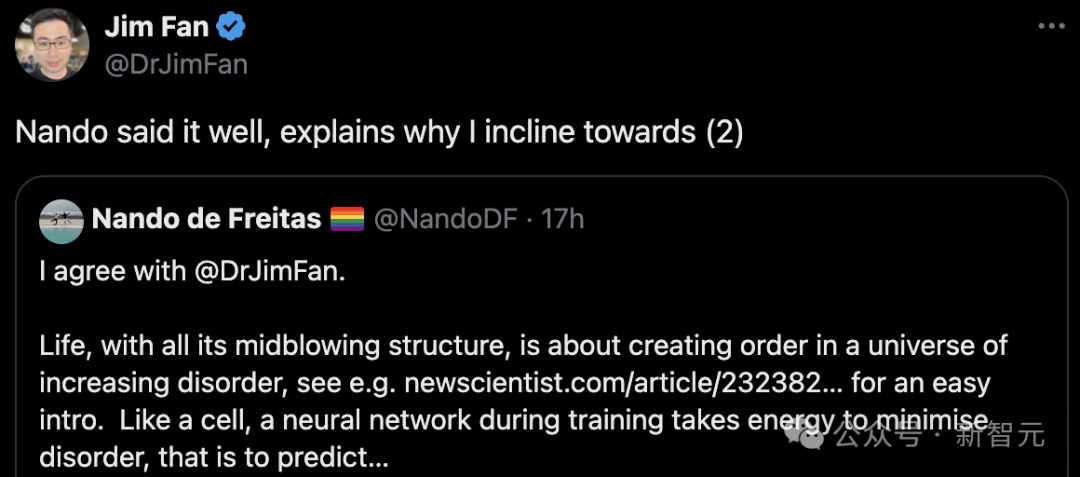

至于為什么更傾向于是第二種解釋,來自谷歌DeepMind的Nando de Freitas給出了更詳細的說明。

生命,以其驚人的復雜結構為例,其實質是在日益增加的宇宙混沌中創造出秩序。類似地,在訓練過程中,神經網絡通過消耗能量來減少混亂,從而更有效地進行預測和泛化。我們甚至將這種能量損失稱為「負熵」。

就像生命一樣,網絡也是更廣闊環境的一部分,這個環境為它提供數據和反饋。同時,這一過程也會為宇宙帶來更多的混亂(例如TPU和GPU產生的熱量)。總的來說,我們已經具備了智能(生命的一種衍生屬性)的所有要素,包括對物理學的理解。

一個規模有限的神經網絡能夠預測任何情況發生的唯一方式,是通過學習能夠促進這種預測的內部模型,包括對物理定律的直觀理解。

基于這種直覺,我找不到任何反對Jim Fan觀點的理由。

隨著我們獲得更多高質量的數據、電力、反饋(也就是微調和基礎化),以及能夠高效吸收數據以降低熵的并行神經網絡模型,我們很可能會擁有比人類更擅長推理物理的機器,并且希望它們能教會我們新知。

順帶一提,我們也構成了神經網絡的環境,通過消耗能量來創造秩序(比如提升神經網絡訓練數據集的質量)。

關于生命和「熵」:https://newscientist.com/article/2323820-is-life-the-result-of-the-laws-of-entropy/

Sora「世界模型雛形」陷入重重爭議

其實,Sora初一面世,OpenAI聲稱「擴展視頻生成模型是構建物理世界通用模擬器的一條可行之路」的說法,就得到了諸多專家的質疑。

前谷歌、Facebook技術主管Hongcheng表示——

「模型不大可能通過被動看訓練數據視頻,就能掌握物理定律。」

再聰明的智能體,也不大可能通過看太陽東升西落的視頻,就能悟出地球圍著太陽轉。人類看了幾千年蘋果掉到地上,也是直到牛頓的時代才發現了引力。

多位業內人士表示,說Sora是數據驅動的物理引擎的說法很愚蠢。

它的荒謬性,就好比我們收集了行星運動的數據,輸入到模型中,模型預測出行星位置,就說這個模型在內部復現了廣義相對論一樣。

像Sora這樣的Diffusion Transformer,底層是基于機器學習的隨機梯度下降加上反向傳播。

這就意味著:Sora并沒有邏輯推理能力!

本質上,它只是在將訓練的數據壓縮成模型的權重罷了。只是按照某種規則更新參數,以達到最小誤差的配置,并不進行邏輯推理。

梯度下降加上反向傳播,往往會找到似乎有效但實際上脆弱的解決方案,因此它很容易崩潰。

就像蒼蠅尋找氣味源頭一樣,它總是朝著氣味最濃的方向去尋找,就像梯度下降算法根據梯度的方向更新參數,以逐步接近損失函數的最小值。

基于這種模式,是無法學會物理規律的。

而對于Sora「沒有在學習物理,只是在二維空間中處理像素」的說法,英偉達高級科學家Jim Fan表示自己不能茍同。

這種觀點,就好像說「GPT-4不學習編碼,只是采樣字符串」一樣。要是這么說的話,我們還可以說「Transformer所做的只是處理一系列整數(token ID)」,「神經網絡所做的只是對浮點數進行處理」。

Sora的軟物理模擬,是大規模擴展文本到視頻訓練時的一項「涌現特性」。

- 為了能夠生成可執行的Python代碼,GPT-4必須掌握特定形式的語法、語義和數據結構。不過,GPT-4并不直接保存Python語法樹。

- 同樣地,Sora需要掌握將文字描述轉化為3D圖像、進行3D轉換、光線追蹤渲染以及應用物理規律的技巧,從而盡可能準確地對視頻像素建模。它需要像學習游戲引擎開發那樣,掌握這些技能。

- 如果我們暫時不考慮交互性,那么UE5可以被看作是一個復雜的視頻像素生成過程。Sora也是用于生成視頻像素的,但它是基于端到端處理的Transformer技術。它們在概念上是處于同一層面的。

- 不同之處在于,UE5是通過人工精心設計且精確的,而Sora則完全依靠數據學習得到,更加依賴直觀的理解。

谷歌深度學習專家、Keras創始人Fran?ois Chollet表示,這個話題其實是老生常談了。

從2016年以來,關于視頻生成模型和神經輻射場是否融入了對物理規律的理解,就有不少討論。

的確,這些系統具備根據給定物理場景預測未來發展的能力,它們實際上是基于一套物理模型工作的。

問題在于,這套模型的準確度如何?能否應用于未曾訓練的新情境中?

這些問題,標著著兩個世界的分水嶺,這兩個世界之間,有著截然不同的可能性。

在一個世界里,生成的圖像僅用于媒體制作,看上去似乎真實,實際上卻并非真實世界的反映。

而在另一個世界中,這些圖像能作為現實世界的模擬,幫我們對未來作出可靠預測,這對科學研究意義重大。

不過,當前模型存在一些基本限制,無法捕捉到物體恒存性這樣的視覺現實基本原理,這個概念即使兩歲孩童也能理解。

當然,人類研究者是有辦法對之改進的。

如果能通過增加模型訓練數據的采樣密度,在更廣泛、更深入的數據上進行訓練,就能提高模型性能。

到那一天,我們就能來預測天氣、創建風洞模擬器、預測太陽活動了!

但如果我們想將模型應用于游戲引擎和視頻上,是想構建廣泛泛化的現實世界模型,就行不通了,模型不是這么用的。

Sora的技術并不新

此外,還有很多大佬表示,Sora的技術其實并不新。

LeCun轉發了華人學者謝賽寧的推文,認為Sora基本上是基于謝賽寧等人在去年被ICCV 2023收錄的論文提出的框架設計而成的。

而和謝賽寧一起合著這篇論文的William Peebles之后也加入了OpenAI,領導了開發Sora的技術團隊。

時空patch,是Sora創新的核心。

它建立在Google DeepMind早期對NaViT和ViT(視覺Transformer)的研究之上。而這項研究,又是基于一篇2021年的論文「An Image is Worth 16x16 Words」。

這其中Sora所做的,就是把Diffusion和Transformer架構結合在一起,創建了diffusion transformer模型。

馬毅教授也表示,Sora與之前不同的地方,就是用Transformer實現了diffusion和denosing。

而這其實就是馬毅團隊去年在NeurIPS White-box Transformer論文所預示和證明了的——

假設數據分布是mixed Gaussians,那Transformer blocks就是在實現diffusion/擴散和denoising/壓縮 。

不過,當時團隊苦于沒有足夠的數據和算力,無法在diffusion model上驗證,只能在Masked VAE,DINO,BERT,以及GPT-2上做了驗證。

而這次Sora的發布更加證明了,在相同條件下,白盒的Transformer CRATE構架在性能上已經能超越傳統的Transformer,而且完全可解釋和更加可控,因此會提升視頻和文本的生成技術。

有趣的是,連馬斯克也跳出來說,特斯拉早在一年前就掌握了類似OpenAI的視頻生成技術,它的真實世界模擬和視頻生成是是全世界最好的。

并且,特斯拉視頻生成超越OpenAI的地方就在于,他預測了極其精確的物理場景,這對自動駕駛至關重要。

那么,特斯拉怎么讓OpenAI搶了先呢?

馬斯克表示,自己早就想用特斯拉做視頻游戲了,但不幸的是,他們必須在發布無監督的FSD后才能制作游戲。

動畫師:Sora距離替代人類,還早呢

無獨有偶,一位動畫師也表示,自己完全沒有對Sora感到害怕。

他的理由是,因為動畫制作需要反復修改,尤其是面對客戶的需求時。

面對反復的修改要求,人類動畫師是能輕松應對的,而AI則很可能選擇重新出一幅作品。

哪位客戶會喜歡這種方式呢?

因此,目前AI無法給客戶又完整又高質量的作品。

可能很多人覺得,過于關注細節是吹毛求疵,但客戶要的就是吹毛求疵。

對于他們珍愛的IP或作品,他們可不希望每次修改都伴隨著角色、設計、構圖、背景的大改動。

所以,目前Sora還端不了誰的飯碗,除了展現一下AI的潛能外,實際的應用價值并不大。