7B模型超越GPT4-V!港科大等發(fā)布「圖推理問答」數(shù)據(jù)集GITQA:視覺圖可提升推理能力

圖神經(jīng)網(wǎng)絡(luò)(GNNs)擅長利用圖的結(jié)構(gòu)信息進行推理,但它們通常需要特定于領(lǐng)域的調(diào)優(yōu)才能達到峰值性能,這阻礙了它們在不同任務(wù)之間的泛化性。

相比之下,基于大型語言模型(LLM)的圖推理具有更強的跨任務(wù)和泛化能力,但它們在特定任務(wù)上的性能往往遜色于專用的圖神經(jīng)網(wǎng)絡(luò)模型。

無論是以圖神經(jīng)網(wǎng)絡(luò)為代表的傳統(tǒng)圖推理還是新興的基于大型語言模型的圖推理,目前圖推理相關(guān)工作都忽視了視覺模態(tài)的圖信息。

然而,人類會通過視覺特征高效和準確地完成圖任務(wù),例如判斷圖中是否存在環(huán)。

因此,探究視覺形態(tài)的圖信息在圖推理中的作用具有重要意義。

更具體地,將圖(Graph)繪制為圖片(Image),是否能賦予模型特殊的推理能力呢?這些圖片(稱為視覺圖 Visual Graph)是否能增強現(xiàn)有的基于其他模態(tài)的圖推理模型呢?

為了回答這些問題,來自香港科技大學(xué)和南方科技大學(xué)的研究團隊構(gòu)建了首個包含視覺圖的推理問答數(shù)據(jù)集GITQA,并在GPT-4 turbo,GPT-4V等開源模型和Vicuna,LLaVA等閉源模型上進行了廣泛的實驗,證實了Visual Graph在圖推理中的作用,以及其可以和文本模態(tài)相互增強。

圖片

圖片

論文地址:https://arxiv.org/abs/2402.02130

項目主頁:https://v-graph.github.io/

在GITQA測試基準中,以LLaVA-7B/13B為基礎(chǔ)微調(diào)出的多模態(tài)模型GITA-7B/13B,展示出了超越GPT-4V的圖推理性能。

GITQA 多模態(tài)圖推理問答數(shù)據(jù)集

研究團隊通過將圖結(jié)構(gòu)繪制為不同風(fēng)格的視覺圖像,建立了GITQA數(shù)據(jù)集及其相應(yīng)的測試基準,GITQA數(shù)據(jù)集包含超過423K個問答實例,每個實例包含相互對應(yīng)的圖結(jié)構(gòu)-文本-視覺信息及其相應(yīng)的問答對。

GITQA數(shù)據(jù)集包含兩個版本:GITQA-Base和GITQA-Aug,其中GITQA-Base只包含單一風(fēng)格的視覺圖。

GITQA-Aug則更加豐富,它對視覺圖進行了多種數(shù)據(jù)增強處理,包括改變布局、點的形狀、邊的寬度和點的風(fēng)格等,從而提供了更多樣化的視覺圖表現(xiàn)。

圖片

圖片

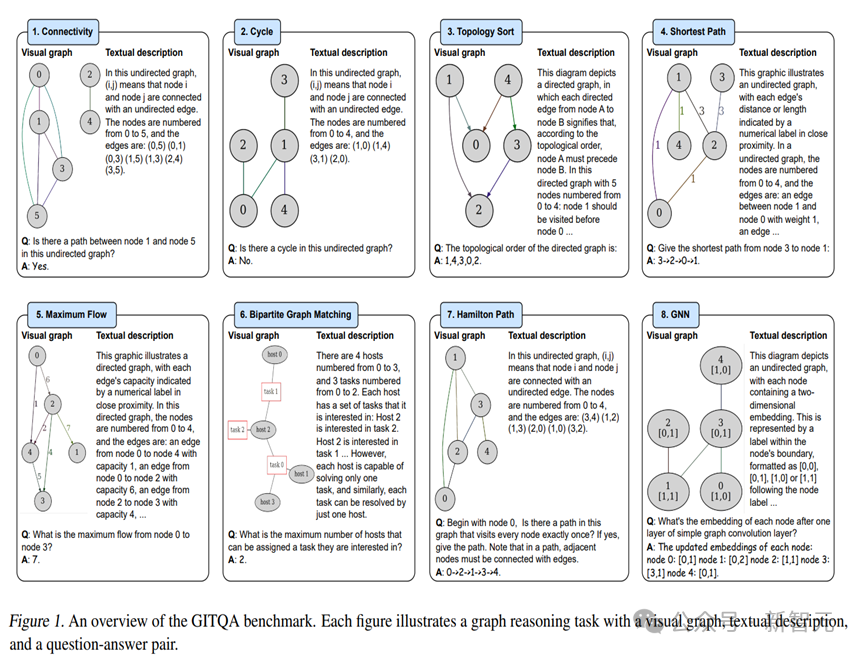

如圖1,GITQA測試基準包含8個具有代表性的圖推理任務(wù):Connectivity(判斷圖中兩點是否聯(lián)通)、Cycle(判斷圖中是否有環(huán))、TS(尋找圖的拓撲序)、 SP(尋找圖中兩點間的最短路徑)、 MaxFlow(計算圖中兩點間的最大流)、 BGM(計算二分圖的最大匹配)、 HP(尋找圖中的哈密頓路徑)和GNN(模擬GNN的消息傳遞)。

圖片

圖片

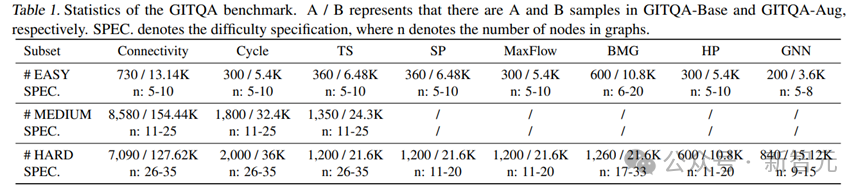

每個任務(wù)所對應(yīng)的數(shù)據(jù)集都被按照圖結(jié)構(gòu)的復(fù)雜程度被劃分為不同難度等級的子集(相關(guān)統(tǒng)計如表1)。

實驗及結(jié)果

實驗一: 基于不同模態(tài)圖信息的模型的圖推理能力對比

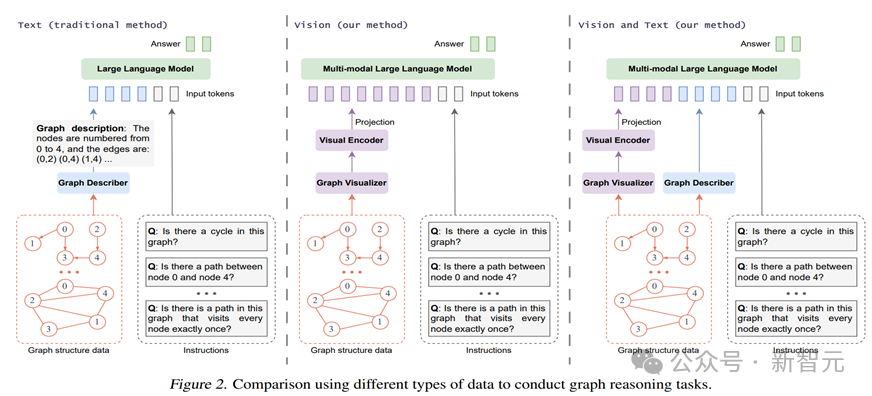

研究團隊在GITQA-Base數(shù)據(jù)集上,根據(jù)不同的模態(tài)圖輸入類型(包括僅文本(T-Only)、僅視覺(V-Only)、以及文本加視覺(V+T)),評估了流行的閉源和開源大型語言模型(如GPT-4 turbo和Vicuna-7B/13B)以及大型多模態(tài)語言模型(如GPT-4V和LLaVA-7B/13B)的表現(xiàn)。如圖2所示。

圖片

圖片

具體來說,閉源模型GPT-4和GPT-4V執(zhí)行零樣本推理,而對于開源模型Vicuna和LLaVA,則通過保持主干模型參數(shù)不變,僅訓(xùn)練Projector和LoRA部分進行了微調(diào)(特別地,視覺+文本雙模態(tài)微調(diào)后的LLaVA模型被研究者命名為GITA)。

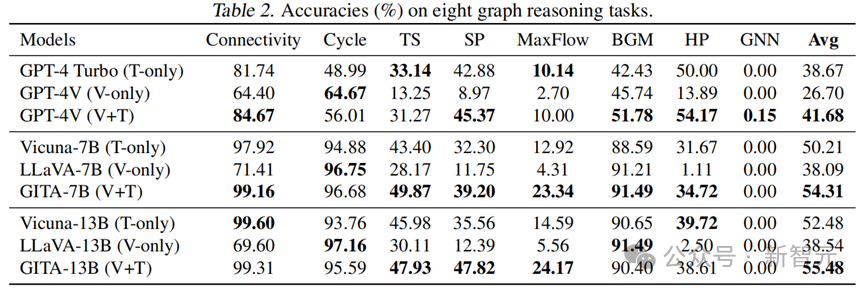

表2總結(jié)了所有八項圖推理任務(wù)的測試結(jié)果。

圖片

圖片

視覺模態(tài) V.S. 文本模態(tài)

從表2中可以看到,在Cycle和BGM任務(wù)上,視覺模態(tài)的表現(xiàn)優(yōu)于文本模態(tài),而在其他五個任務(wù)上則不如文本模態(tài)。這揭示了視覺和文本在處理特定類型的圖推理任務(wù)上各具優(yōu)勢。視覺和文本模態(tài)的相互增強

對于閉源模型,GPT-4V(V+T)在八個任務(wù)的平均準確率上遠高于GPT-4 Turbo(T-only)和GPT-4V(V-only)。

對于開源模型(7B,13B),同樣地,使用雙模態(tài)數(shù)據(jù)訓(xùn)練出的GITA模型平均表現(xiàn)最佳。這些觀察結(jié)果驗證了同時使用視覺和文本信息能夠增強模型的圖推理能力,相比單模態(tài)模型可以實現(xiàn)更好的性能。

更具體地說,GITA-7B(V+T)在幾乎所有任務(wù)中表現(xiàn)優(yōu)于LLaVA-7B(V-only)和Vicuna-7B(T-only)。而對于閉源模型,使用雙模態(tài)在八個任務(wù)中的五個上達到了最高準確率。微調(diào)后的LLaVA模型可超越GPT-4V

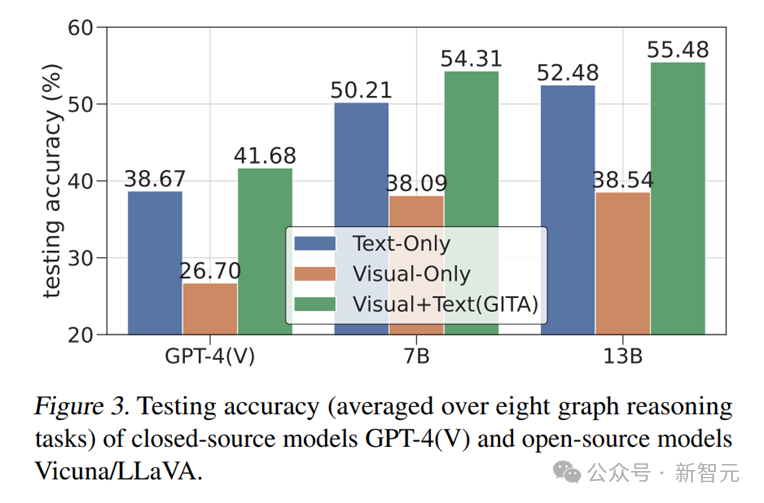

如表2和圖3所示,GITA-7B和GITA-13B模型,即經(jīng)過雙模態(tài)微調(diào)的LLaVA-7B/13B模型,顯示出相較于GPT-4V超過13%的顯著性能提升。這一巨大的進步幅度表明,微調(diào)后的GITA模型能夠有效地從GITQA數(shù)據(jù)集中學(xué)習(xí)到出色的圖推理能力。

圖片

圖片

實驗二:難度等級對圖任務(wù)的影響

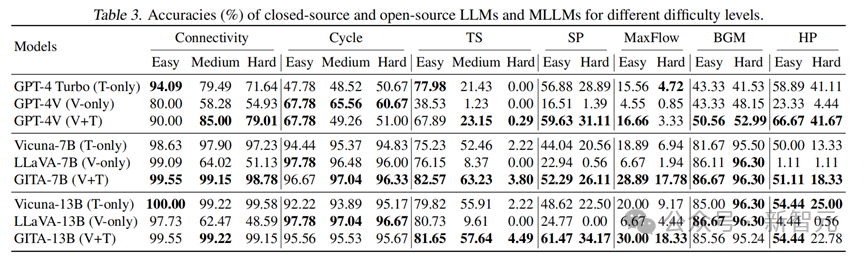

表3進一步給出了模型在不同難度級別上的測試精度,GNN任務(wù)由于對所有模型都太具挑戰(zhàn)被省略)。

在所有難度級別的Cycle和BGM任務(wù)中,單獨使用視覺模態(tài)的表現(xiàn)優(yōu)于文本模態(tài),并且與使用兩種模態(tài)的表現(xiàn)相當(dāng)。

然而,對于其他任務(wù),當(dāng)難度從簡單增加到中等或困難時,只使用視覺模態(tài)的模型的性能顯著下降。

圖片

圖片

同樣,當(dāng)難度增加時,只使用文本模態(tài)和使用視覺+文本模態(tài)的模型在這些任務(wù)上也會出現(xiàn)大幅度的性能下降。

對于Connectivity任務(wù),GITA-7B(視覺+文本)和GITA-13B(視覺+文本)在所有三個挑戰(zhàn)級別上都表現(xiàn)出相當(dāng)?shù)男阅堋?/span>

然而,這種一致的模式在GPT-4V(視覺+文本)中并未觀察到,因為其性能隨著難度級別的增加而下降。

實驗三: 視覺圖的增強策略和風(fēng)格偏好

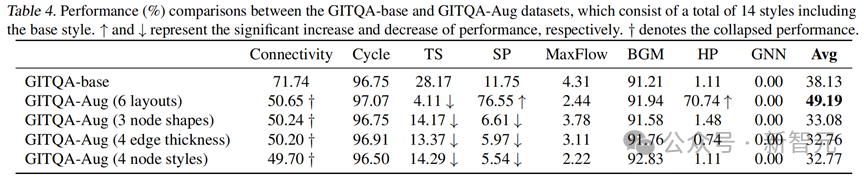

研究團隊還探究了特別的數(shù)據(jù)增強策略在微調(diào)模型時的效果。

基于不同的增強策略,研究者將GITQA-Aug數(shù)據(jù)集劃分為四個增強子集: 布局增強數(shù)據(jù)集,節(jié)點形狀增強數(shù)據(jù)集,邊的寬度增強數(shù)據(jù)集,節(jié)點風(fēng)格增強數(shù)據(jù)集。

圖片

圖片

研究者在僅使用視覺圖信息的LLaVA-7B模型上對全部四個增強子集進行了單獨的微調(diào),其推理性能與數(shù)據(jù)增強前的比較如表4所示。

可以明顯看出,模型在布局增強數(shù)據(jù)集上對于挑戰(zhàn)性任務(wù)的推理能力急劇提升(SP 上升64.8%,HP上升69.63%)。

而其他三種數(shù)據(jù)增強策略反而導(dǎo)致性能下降。

具體來說,模型在布局增強集上取得了優(yōu)異的結(jié)果,比GITQA-Base集高出11%以上。相比之下,其他增廣集中八個任務(wù)的平均結(jié)果比基本集低約5%

圖片

圖片

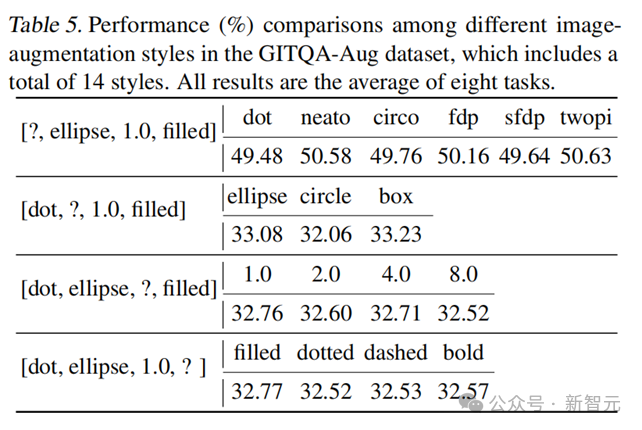

這些發(fā)現(xiàn)表明基于布局的數(shù)據(jù)增強為圖推理提供了更有效的視覺視角。進一步,研究者還測試了各個增強策略下,在同組內(nèi)基于每種風(fēng)格的Visual Graph推理的性能,如表5所示,展示出模型沒有明顯的風(fēng)格偏好。