蘋(píng)果智能背后模型公布:3B模型優(yōu)于Gemma-7B,服務(wù)器模型媲美GPT-3.5-Turbo

在剛剛結(jié)束的全球開(kāi)發(fā)者大會(huì)上,蘋(píng)果宣布了 Apple intelligence, 這是一款深度集成于 iOS 18、iPadOS 18 和 macOS Sequoia 的全新個(gè)性化智能系統(tǒng)。

Apple Intelligence 由多種高度智能的生成模型組成,這些模型專(zhuān)為用戶(hù)的日常任務(wù)設(shè)計(jì)。在蘋(píng)果剛剛更新的博客中,他們?cè)敿?xì)介紹了其中兩款模型:

- 一個(gè)擁有約 30 億參數(shù)的設(shè)備端語(yǔ)言模型;

- 一個(gè)更大的基于服務(wù)器的語(yǔ)言模型,該模型通過(guò)私有云計(jì)算在蘋(píng)果服務(wù)器上運(yùn)行。

這兩個(gè)基礎(chǔ)模型是蘋(píng)果生成模型家族的一部分,蘋(píng)果表示,他們會(huì)在不久的將來(lái)分享更多關(guān)于這一模型家族的信息。

在這篇博客中,蘋(píng)果用大量篇幅介紹了他們是如何開(kāi)發(fā)高性能、快速且節(jié)能的模型;如何進(jìn)行這些模型的訓(xùn)練;如何為特定用戶(hù)需求微調(diào)適配器;以及如何評(píng)估模型在提供幫助和避免意外傷害方面的表現(xiàn)。

蘋(píng)果基礎(chǔ)模型的建模概覽

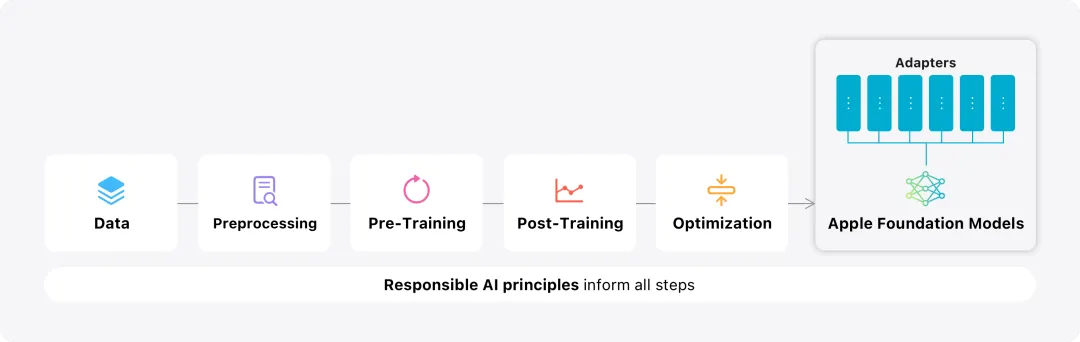

預(yù)訓(xùn)練

基礎(chǔ)模型是在 AXLearn 框架上訓(xùn)練而成的,這是蘋(píng)果在 2023 年發(fā)布的一個(gè)開(kāi)源項(xiàng)目。該框架建立在 JAX 和 XLA 之上,使得用戶(hù)能夠在各種硬件和云平臺(tái)上高效且可擴(kuò)展地訓(xùn)練模型,包括 TPU 以及云端和本地的 GPU。此外,蘋(píng)果使用數(shù)據(jù)并行、張量并行、序列并行和 FSDP 等技術(shù),沿著多個(gè)維度(如數(shù)據(jù)、模型和序列長(zhǎng)度)擴(kuò)展訓(xùn)練。

蘋(píng)果在訓(xùn)練其基礎(chǔ)模型時(shí),使用了經(jīng)過(guò)授權(quán)的數(shù)據(jù),這些數(shù)據(jù)包括為了增強(qiáng)某些特定功能而特別選擇的數(shù)據(jù),以及由蘋(píng)果的網(wǎng)頁(yè)爬蟲(chóng) AppleBot 從公開(kāi)的網(wǎng)絡(luò)上收集的數(shù)據(jù)。網(wǎng)頁(yè)內(nèi)容的發(fā)布者可以通過(guò)設(shè)置數(shù)據(jù)使用控制,選擇不讓他們的網(wǎng)頁(yè)內(nèi)容被用來(lái)訓(xùn)練 Apple Intelligence。

蘋(píng)果在訓(xùn)練其基礎(chǔ)模型時(shí),從不使用用戶(hù)的私人數(shù)據(jù)。為了保護(hù)隱私,他們會(huì)使用過(guò)濾器去除公開(kāi)在互聯(lián)網(wǎng)上的個(gè)人可識(shí)別信息,比如信用卡號(hào)碼。此外,他們還會(huì)過(guò)濾掉粗俗語(yǔ)言和其他低質(zhì)量的內(nèi)容,以防這些內(nèi)容進(jìn)入訓(xùn)練數(shù)據(jù)集。除了這些過(guò)濾措施之外,Apple 還會(huì)進(jìn)行數(shù)據(jù)提取和去重,并使用基于模型的分類(lèi)器來(lái)識(shí)別并選擇高質(zhì)量的文檔用于訓(xùn)練。

后訓(xùn)練

蘋(píng)果發(fā)現(xiàn)數(shù)據(jù)質(zhì)量對(duì)模型至關(guān)重要,因此在訓(xùn)練流程中采用了混合數(shù)據(jù)策略,即人工標(biāo)注數(shù)據(jù)和合成數(shù)據(jù),并進(jìn)行全面的數(shù)據(jù)管理和過(guò)濾程序。蘋(píng)果在后訓(xùn)練階段開(kāi)發(fā)了兩種新算法:(1) 帶有「teacher committee」的拒絕采樣微調(diào)算法,(2) 使用帶有鏡像下降策略?xún)?yōu)化以及留一優(yōu)勢(shì)估計(jì)器的從人類(lèi)反饋中進(jìn)行強(qiáng)化學(xué)習(xí)(RLHF)算法。這兩種算法顯著提高了模型的指令跟隨質(zhì)量。

優(yōu)化

除了保證生成模型本身的高性能,Apple 還采用了多種創(chuàng)新技術(shù),在設(shè)備端和私有云上對(duì)模型進(jìn)行優(yōu)化,以提升速度和效率。特別是,他們對(duì)模型在生成第一個(gè) token(單個(gè)字符或詞語(yǔ)的基本單位)和后續(xù) token 的推理過(guò)程都進(jìn)行了大量?jī)?yōu)化,以確保模型的快速響應(yīng)和高效運(yùn)行。

蘋(píng)果在設(shè)備端模型和服務(wù)器模型中都采用了分組查詢(xún)注意力機(jī)制,以提高效率。為了減少內(nèi)存需求和推理成本,他們使用了共享的輸入和輸出詞匯嵌入表,這些表在映射時(shí)沒(méi)有重復(fù)。設(shè)備端模型的詞匯量為 49,000,而服務(wù)器模型的詞匯量為 100,000。

對(duì)于設(shè)備端推理,蘋(píng)果使用了低位 palletization,這是一個(gè)關(guān)鍵的優(yōu)化技術(shù),能夠滿(mǎn)足必要的內(nèi)存、功耗和性能要求。為了保持模型質(zhì)量,蘋(píng)果還開(kāi)發(fā)了一個(gè)新的框架,使用 LoRA 適配器,結(jié)合了混合的 2 位和 4 位配置策略 —— 平均每個(gè)權(quán)重 3.5 位 —— 以實(shí)現(xiàn)與未壓縮模型相同的準(zhǔn)確率。

此外,蘋(píng)果還使用交互式模型延遲和功耗分析工具 Talaria,以及激活量化和嵌入量化,并開(kāi)發(fā)了一種在神經(jīng)引擎上實(shí)現(xiàn)高效鍵值 (KV) 緩存更新的方法。

通過(guò)這一系列優(yōu)化,在 iPhone 15 Pro 上, 當(dāng)模型接收到一個(gè)提示詞時(shí),從接收到這個(gè)提示詞到生成第一個(gè) token 所需的時(shí)間約為 0.6 毫秒,這個(gè)延遲時(shí)間非常短,表明模型在生成響應(yīng)時(shí)非常快速生成速率為每秒 30 個(gè) token。

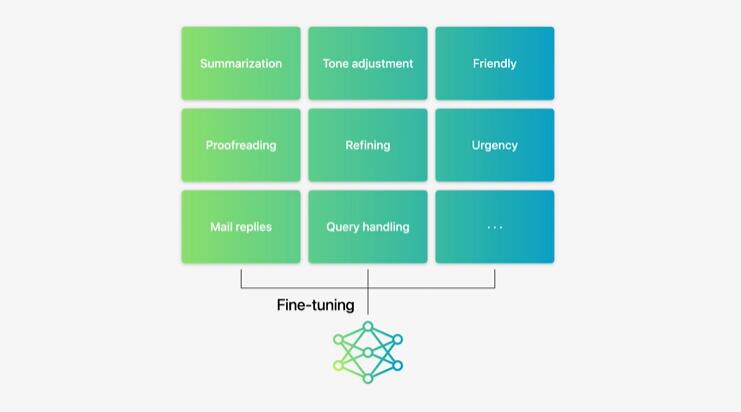

模型適配

蘋(píng)果將基礎(chǔ)模型針對(duì)用戶(hù)的日常活動(dòng)進(jìn)行了微調(diào),并且可以動(dòng)態(tài)地專(zhuān)門(mén)針對(duì)當(dāng)前的任務(wù)。

研究團(tuán)隊(duì)利用適配器(可以插入預(yù)訓(xùn)練模型各個(gè)層的小型神經(jīng)網(wǎng)絡(luò)模塊)來(lái)針對(duì)特定任務(wù)微調(diào)模型。具體來(lái)說(shuō),研究團(tuán)隊(duì)調(diào)整了注意力矩陣、注意力投影矩陣和逐點(diǎn)(point-wise)前饋網(wǎng)絡(luò)中的全連接層。

通過(guò)僅微調(diào)適配器層,預(yù)訓(xùn)練基礎(chǔ)模型的原始參數(shù)保持不變,保留模型的一般知識(shí),同時(shí)定制適配器層以支持特定任務(wù)。

圖 2:適配器是覆蓋在公共基礎(chǔ)模型上的模型權(quán)重的小型集合。它們可以動(dòng)態(tài)加載和交換 —— 使基礎(chǔ)模型能夠動(dòng)態(tài)地專(zhuān)門(mén)處理當(dāng)前的任務(wù)。Apple Intelligence 包括一組廣泛的適配器,每個(gè)適配器都針對(duì)特定功能進(jìn)行了微調(diào)。這是擴(kuò)展其基礎(chǔ)模型功能的有效方法。

研究團(tuán)隊(duì)使用 16 bit 表征適配器參數(shù)的值,對(duì)于約 30 億參數(shù)的設(shè)備模型,16 適配器的參數(shù)通常需要 10 兆字節(jié)。適配器模型可以動(dòng)態(tài)加載、臨時(shí)緩存在內(nèi)存中以及交換。這使基礎(chǔ)模型能夠動(dòng)態(tài)地專(zhuān)門(mén)處理當(dāng)前的任務(wù),同時(shí)有效地管理內(nèi)存并保證操作系統(tǒng)的響應(yīng)能力。

為了促進(jìn)適配器的訓(xùn)練,蘋(píng)果創(chuàng)建了一個(gè)高效的基礎(chǔ)設(shè)施,以在基本模型或訓(xùn)練數(shù)據(jù)更新時(shí)快速重新訓(xùn)練、測(cè)試和部署適配器。

性能評(píng)估

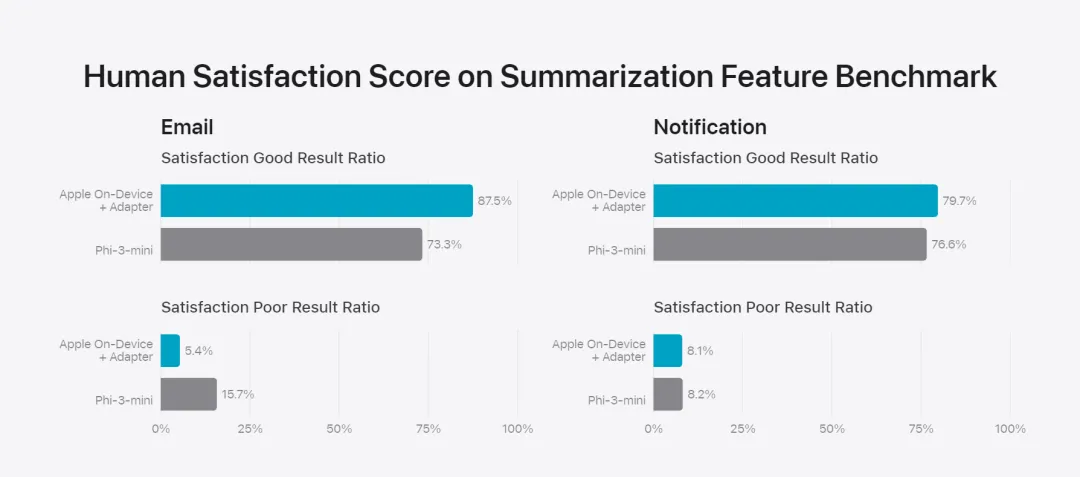

蘋(píng)果在對(duì)模型進(jìn)行基準(zhǔn)測(cè)試時(shí),專(zhuān)注于人類(lèi)評(píng)估,因?yàn)槿祟?lèi)評(píng)估的結(jié)果與產(chǎn)品的用戶(hù)體驗(yàn)高度相關(guān)。

為了評(píng)估特定于產(chǎn)品的摘要功能,研究團(tuán)隊(duì)使用了針對(duì)每個(gè)用例仔細(xì)采樣的一組 750 個(gè)響應(yīng)。評(píng)估數(shù)據(jù)集強(qiáng)調(diào)產(chǎn)品功能在生產(chǎn)中可能面臨的各種輸入,并包括不同內(nèi)容類(lèi)型和長(zhǎng)度的單個(gè)文檔和堆疊文檔的分層混合。實(shí)驗(yàn)結(jié)果發(fā)現(xiàn)帶有適配器的模型能夠比類(lèi)似模型生成更好的摘要。

作為負(fù)責(zé)任開(kāi)發(fā)的一部分,蘋(píng)果識(shí)別并評(píng)估了摘要固有的特定風(fēng)險(xiǎn)。例如,摘要有時(shí)會(huì)刪除重要的細(xì)微差別或其他細(xì)節(jié)。然而,研究團(tuán)隊(duì)發(fā)現(xiàn)摘要適配器沒(méi)有放大超過(guò) 99% 的目標(biāo)對(duì)抗樣本中的敏感內(nèi)容。

圖 3:摘要用例的「好」和「差」響應(yīng)占比。

除了評(píng)估基礎(chǔ)模型和適配器支持的特定功能之外,研究團(tuán)隊(duì)還評(píng)估了設(shè)備上模型和基于服務(wù)器的模型的一般功能。具體來(lái)說(shuō),研究團(tuán)隊(duì)采用一組全面的現(xiàn)實(shí)世界 prompt 來(lái)測(cè)試模型功能,涵蓋了頭腦風(fēng)暴、分類(lèi)、封閉式問(wèn)答、編碼、提取、數(shù)學(xué)推理、開(kāi)放式問(wèn)答、重寫(xiě)、安全、總結(jié)和寫(xiě)作等任務(wù)。

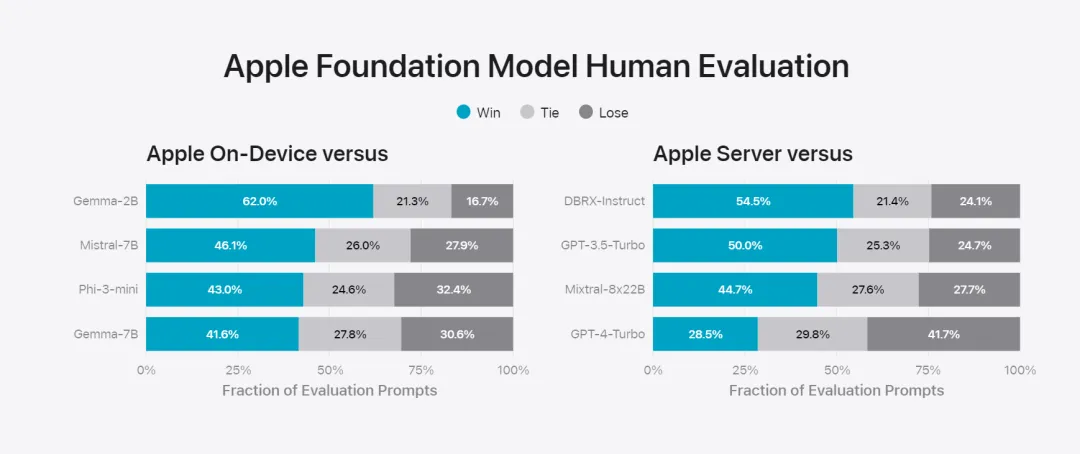

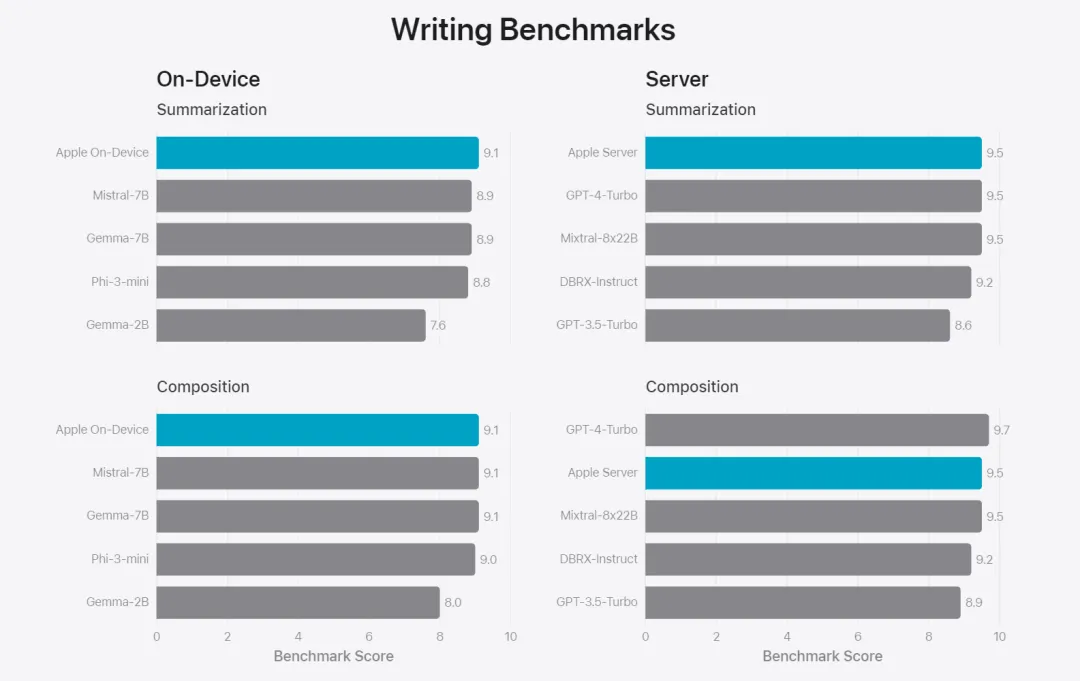

研究團(tuán)隊(duì)將模型與開(kāi)源模型(Phi-3、Gemma、Mistral、DBRX)和規(guī)模相當(dāng)?shù)纳虡I(yè)模型(GPT-3.5-Turbo、GPT-4-Turbo)進(jìn)行比較。結(jié)果發(fā)現(xiàn),與大多數(shù)同類(lèi)競(jìng)爭(zhēng)模型相比,蘋(píng)果的模型更受人類(lèi)評(píng)估者青睞。例如,蘋(píng)果的設(shè)備上模型具有約 3B 參數(shù),其性能優(yōu)于較大的模型,包括 Phi-3-mini、Mistral-7B 和 Gemma-7B;服務(wù)器模型與 DBRX-Instruct、Mixtral-8x22B 和 GPT-3.5-Turbo 相比毫不遜色,同時(shí)效率很高。

圖 4:蘋(píng)果基礎(chǔ)模型與可比較模型的評(píng)估中首選響應(yīng)比例。

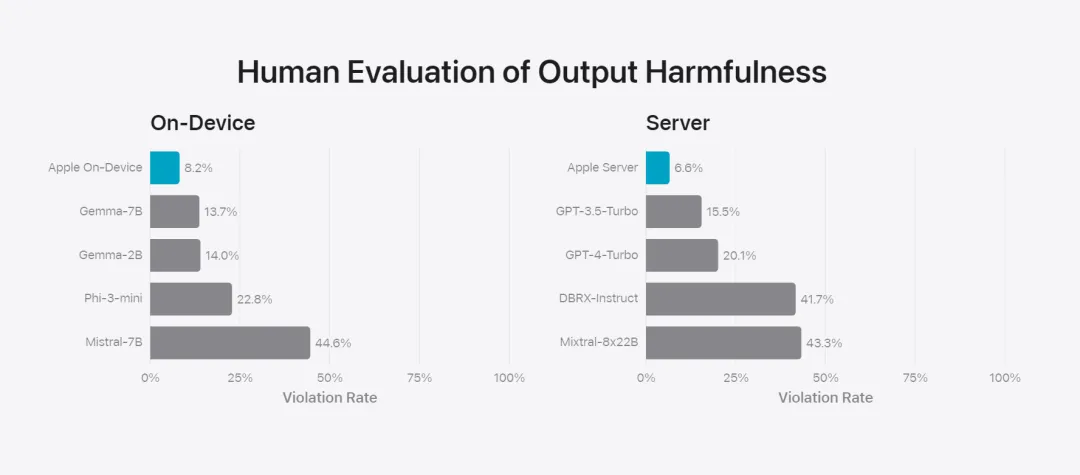

研究團(tuán)隊(duì)還使用一組不同的對(duì)抗性 prompt 來(lái)測(cè)試模型在有害內(nèi)容、敏感主題和事實(shí)方面的性能,測(cè)量了人類(lèi)評(píng)估者評(píng)估的模型違規(guī)率,數(shù)字越低越好。面對(duì)對(duì)抗性 prompt,設(shè)備上模型和服務(wù)器模型都很強(qiáng)大,其違規(guī)率低于開(kāi)源和商業(yè)模型。

圖 5:有害內(nèi)容、敏感主題和事實(shí)性的違規(guī)響應(yīng)比例(越低越好)。當(dāng)面對(duì)對(duì)抗性 prompt 時(shí),蘋(píng)果的模型非常穩(wěn)健。

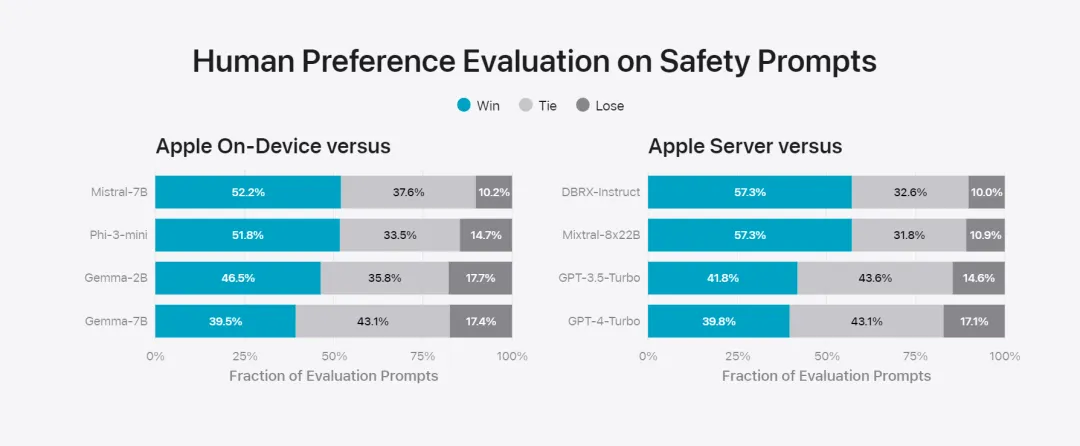

考慮到大型語(yǔ)言模型的廣泛功能,蘋(píng)果正在積極與內(nèi)部和外部團(tuán)隊(duì)進(jìn)行手動(dòng)和自動(dòng)紅隊(duì)合作,以進(jìn)一步評(píng)估模型的安全性。

圖 6:在安全 prompt 方面,蘋(píng)果基礎(chǔ)模型與同類(lèi)模型的并行評(píng)估中首選響應(yīng)的比例。人類(lèi)評(píng)估者發(fā)現(xiàn)蘋(píng)果基礎(chǔ)模型的響應(yīng)更安全、更有幫助。

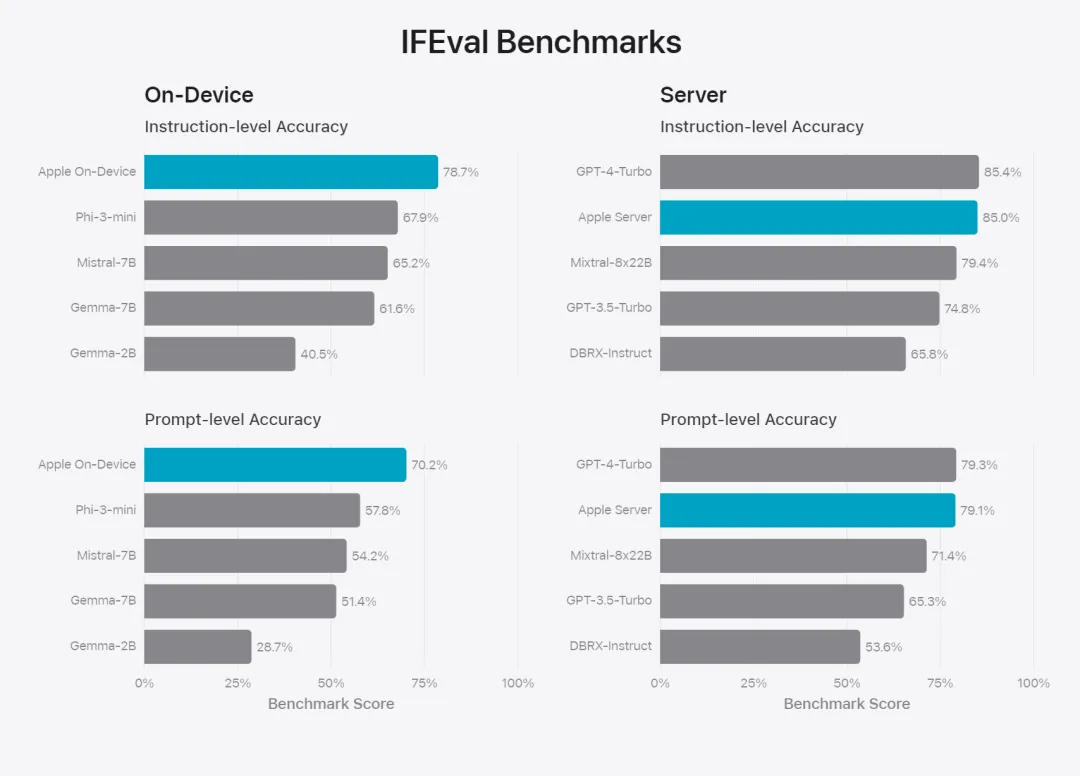

為了進(jìn)一步評(píng)估模型,研究團(tuán)隊(duì)使用指令跟蹤評(píng)估 (IFEval) 基準(zhǔn)來(lái)將其指令跟蹤能力與同等大小的模型進(jìn)行比較。結(jié)果表明,設(shè)備上模型和服務(wù)器模型都比同等規(guī)模的開(kāi)源模型和商業(yè)模型更好地遵循詳細(xì)指令。

圖 7:蘋(píng)果基礎(chǔ)模型和類(lèi)似規(guī)模模型的指令跟蹤能力(使用 IFEval 基準(zhǔn))。

蘋(píng)果還評(píng)估了模型的寫(xiě)作能力,涉及各種寫(xiě)作指令。

圖 8:寫(xiě)作能力(越高越好)。

最后,我們看一下蘋(píng)果對(duì)于 Apple Intelligence 背后技術(shù)的介紹視頻。