OpenAI五級AGI戰(zhàn)略遭吐槽,命名不清、邏輯混亂,本質(zhì)只是空洞營銷?

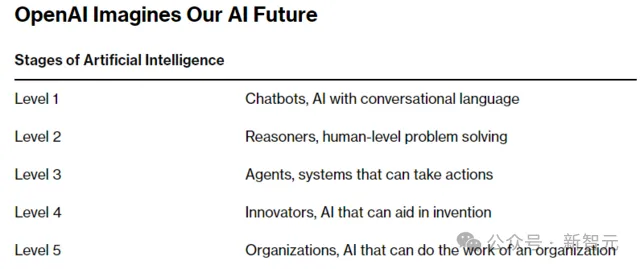

根據(jù)彭博社上周報道,OpenAI全新的AGI路線圖釋出。公司內(nèi)部將AI能力劃分為5個等級,并認為當前AI正處于其中的L1階段。

簡而言之,這個5級路線圖的大致內(nèi)容是:

第一級:聊天機器人,具有對話語言的人工智能;

第二級:推理者,人類水平的問題解決;

第三級:代理者,可以采取行動的系統(tǒng);

第四級:創(chuàng)新者,可協(xié)助發(fā)明的人工智能;

第五級:組織者,可以完成組織工作的人工智能。

OpenAI引入結構化量表來繪制AGI的進展情況,這的確是人工智能領域向前邁出的重要一步。

把通往AGI之路分為五個不同的級別,為衡量AI進步和設定基準提供了清晰的框架。

這5個里程碑,不僅能夠讓OpenAI跟蹤自身進展,還能夠樹立通用標準,供其他開發(fā)人員借鑒參考。

OpenAI稱,這種劃定方法是面向未來的,為人工智能系統(tǒng)的透明化發(fā)展奠定了基礎,同時確保邁向AGI的每一步都是可衡量和負責任的。

質(zhì)疑聲迭起

乍一聽,這個「五步走戰(zhàn)略」把AGI的未來勾畫的清清楚楚,但這份戰(zhàn)略報告卻引起了許多質(zhì)疑。

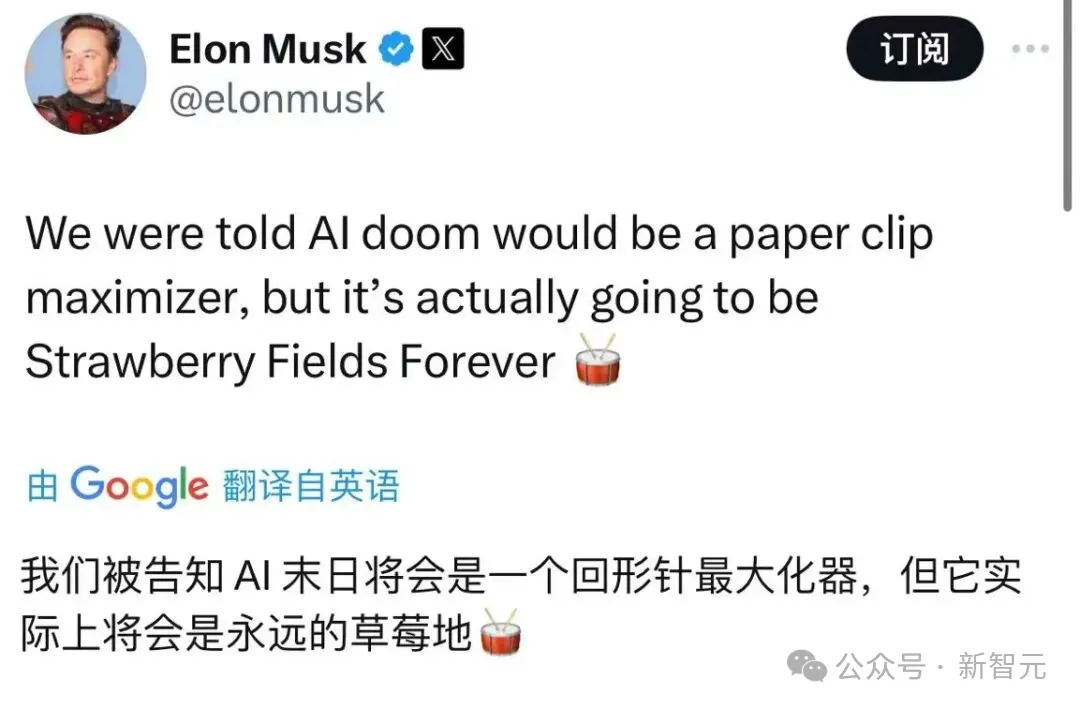

為了從L1邁向L2,OpenAI正在進行一個一個代號為「草莓」(Strawberry)的項目中,主要目的是使模型能夠提供高級推理能力。

老對家馬斯克也是密切關注,第一時間趕來嘲諷。

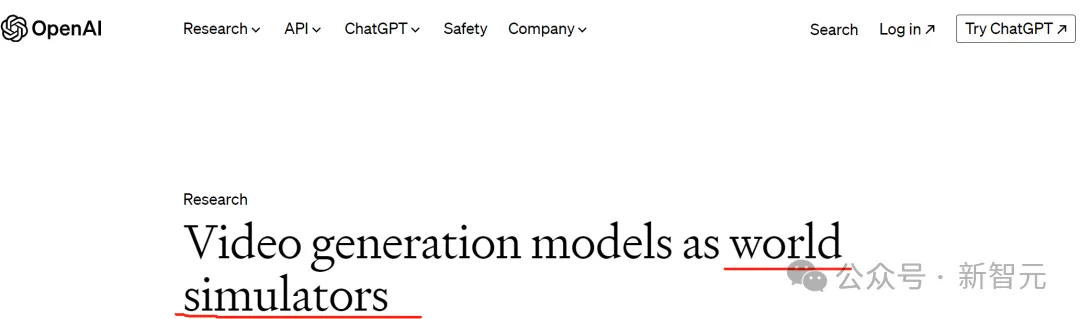

其實,早在OpenAI發(fā)布Sora時,官方的技術博客將Sora描述為「世界模擬器」,就引起了許多人的吐槽和互噴。

目前幾乎所有的LLM仍是「大力出奇跡」的產(chǎn)物,燒錢堆算力,很大程度上都是知其然而不知其所以然。

Facebook首席人工智能科學家Yann LeCun就認為LLM不具備像人類一樣的推理能力。

他的經(jīng)典名言是「人工智能可能還不如你家的貓聰明」。他預測,當前的人工智能系統(tǒng)距離達到某種人類的感知能力還需要幾十年的時間。

而且,人工智能神經(jīng)網(wǎng)絡的設計初衷就是想要模擬人類神經(jīng)網(wǎng)絡,但人腦結構和功能的探索尚且處于初級階段,這難道不是在黑匣子里開盲盒?

也有網(wǎng)友表示,這可能是OpenAI給投資商畫的餅,我們離AGI就差4步哦,聽上去的確讓人心潮澎湃。

超級智能的命名錯誤?

還有一些批評的聲音集中在OpenAI對超級人工智能的定義上。

超級人工智能(ASI)的概念本身就存在爭議,因為它沒有明確的、被廣泛接受的定義。

簡單地將某個等級定義為超級人工智能可能引發(fā)誤解,使人們對AI的能力和潛在影響產(chǎn)生不切實際的期望或擔憂。

有網(wǎng)友指出,5級路線圖的定義和分類就并不準確,甚至具有誤導性。

首先,考慮到OpenAI一直標榜自己的目標是「超越人類」的ASI,那就至少應該在更高級別上討論「智能」,而不是僅僅是停留在「人類級別」這種描述。

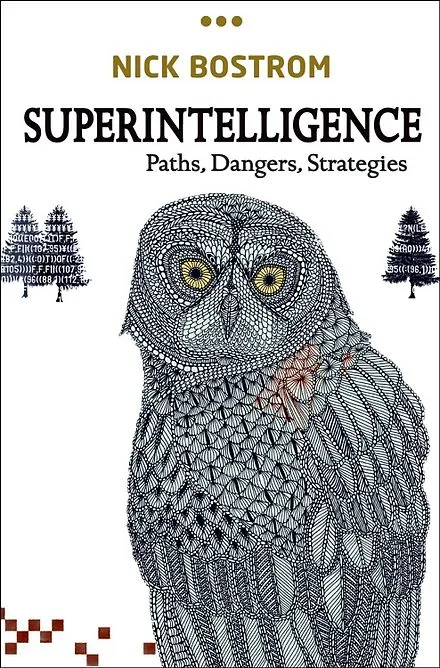

根據(jù)Nick Bostrom公認的定義(雖然并不完美),超級智能是「在許多非常普遍的認知領域,遠遠優(yōu)于當前人類最優(yōu)秀思維的智能」,包括科學創(chuàng)造力、一般智慧和社交技能。

哲學家Nick Bostrom撰寫的《超級智能:路徑、危險、策略》,出版于2014年

在速度方面,Bostrom對超級智能的定義是「一種與人類思維相似但速度更快的智能」。

這大致對應路線圖中的L2等級,也就是OpenAI宣稱他們「即將實現(xiàn)」的水平。

想想看,「有基本的問題解決技能且接受過博士級別教育」的AI系統(tǒng),即使不借助外界工具,思維速度也肯定可以超過人類平均水平。

更何況,L2所描述的是一個有超人類記憶能力和多領域?qū)I(yè)知識的AI,推理速度達到「超人類」就更不在話下。

Reddit上也有網(wǎng)友表達了類似的觀點。

要知道,發(fā)達國家中擁有博士學位的人不到2%,所以GPT-5很可能具有比95%的人類更強的推理能力。我猜這可以用來替代相當數(shù)量的人類勞動。

L3對許多人來說就是通用人工智能(AGI),L5則是超級人工智能(ASI)了

此外,關于L4的定義:「具有創(chuàng)新能力的AI,可以提出人類沒有的創(chuàng)意」,聽起來已經(jīng)是一種高質(zhì)量的超級智能。

L5則被稱為「組織」,可能是指用多部件的、由AI控制的系統(tǒng)來取代整個人類組織,也就是Bostrom所說的「通過聚合大量較小的智能來實現(xiàn)卓越性能的系統(tǒng)」。

這又回到了「取代人類」而非「超越人類」的層面。他們僅僅是把「超級智能」定義為與人類或人類組織有同等能力的系統(tǒng),而不是遠遠超過。

因此,5個級別不僅命名錯誤,而且從根本上混淆了「超級智能」的概念。

這些不能稱之為通往AGI的5大級別,它們在概念上僅僅是可行的AI應用、技術路徑或結果。

5個級別的順序是否合理?

說完了概念和定義上的混淆,我們再來看看,這樣安排5個等級的順序是否合理?

根據(jù)OpenAI自己的表述,這5種「級別」或「階段」可以用于跟蹤AGI的進展。

這不僅表明,OpenAI清楚地了解每個不同階段的要求,而且還指明路線圖,各個級別的AI將按從L1到L5的指定順序?qū)崿F(xiàn)。

這兩個方面似乎都令人難以置信。至少,按照人類能力的發(fā)展程度,這種順序就是不合理的。

例如,肯定存在一些人類「Agent」無法執(zhí)行第L2級任務,也就是博士級個人能夠獨立完成的任務。

但L4級任務:協(xié)助人類創(chuàng)新,同樣是很多人做不到,但博士水平可以完成的。

那么,為什么一定要把L4放在L2之后?

類似的,根據(jù)L5的要求,AI需要發(fā)展出協(xié)調(diào)與合作的能力,才能替代組織。

但這種能力并不是于高智力人才的專利,即使所有成員都沒有博士學歷,也仍然可以經(jīng)營雜貨店、工廠或出租車公司等各種組織。

而大量的例子也表明,有些高學歷的人不具備生活自理能力,更不用說組織管理能力。這就又讓L5降到L2之下了。

最明顯的漏洞還是關于L3 agent的定義,因為一些獨立運作的Agent已經(jīng)在沒有特定監(jiān)督的情況下執(zhí)行人類工作了。

目前看來,這些系統(tǒng)運行失敗部分是因為底層系統(tǒng)的限制,部分是因為這些系統(tǒng)需要更好的結構,但應該不是受限于AI的智能水平。

因此,現(xiàn)實情況是,OpenAI宣稱正在努力實現(xiàn)L2的同時,L3已然存在了。

我們也不清楚人工智能在成功獨立工作(L3)之前或之后是否能夠有效創(chuàng)新(L4)。

仔細想想,L3、L4和L5之間,其實并沒有很清晰嚴明的次序關系。

因此,我們也不知道GPT-5在發(fā)布時,會不會是一個有L5但沒有L4的系統(tǒng),即「無法創(chuàng)新的組織」。

或者是,達到第L3但沒有L2的推理能力,即沒有博士學位的agent?

還是會有L4但沒有L3,即一個無法持續(xù)獨立工作的創(chuàng)意者?

當然,所有這些反對意見都有可能被OpenAI預判了。

但正如網(wǎng)友所說,他們所談論的級別似乎更有可能是一種營銷技巧,旨在推銷他們的系統(tǒng)將是可預測的。

畢竟,資本最喜歡穩(wěn)定性和可控性。