人物交互圖像,現在更懂你的提示詞了,北大推出基于語義感知的人物交互圖像生成框架

該論文的第一作者和通訊作者均來自北京大學王選計算機研究所的 MIPL實驗室,第一作者為博士生徐鑄,通訊作者為博士生導師劉洋。MIPL 實驗室近年來在 IJCV、CVPR、AAAI、ICCV、ICML、ECCV 等頂會上有多項代表性成果發表,多次榮獲國內外 CV 領域重量級競賽的冠軍獎項,和國內外知名高校、科研機構廣泛開展合作。

人物交互圖像生成指生成滿足文本描述需求,內容為人與物體交互的圖像,并要求圖像盡可能真實且符合語義。近年來,文本生成圖像模型在生成真實圖像方面取得出了顯著的進展,但這些模型在生成以人物交互為主體內容的高保真圖像生成方面仍然面臨挑戰。其困難主要源于兩個方面:一是人體姿勢的復雜性和多樣性給合理的人物生成帶來挑戰;二是交互邊界區域(交互語義豐富區域)不可靠的生成可能導致人物交互語義表達的不足。

針對上述問題,來自北京大學的研究團隊提出了一種姿勢和交互感知的人物交互圖像生成框架(SA-HOI), 利用人體姿勢的生成質量和交互邊界區域信息作為去噪過程的指導,生成了更合理,更真實的人物交互圖像。為了全面測評生成圖像的質量,他們還提出了一個全面的人物交互圖像生成基準。

- 論文鏈接:https://proceedings.mlr.press/v235/xu24e.html

- 項目主頁:https://sites.google.com/view/sa-hoi/

- 源代碼鏈接:https://github.com/XZPKU/SA-HOI

- 實驗室主頁:http://www.wict.pku.edu.cn/mipl

SA-HOI 是一種語義感知的人物交互圖像生成方法,從人體姿態和交互語義兩方面提升人物交互圖像生成的整體質量并減少存在的生成問題。通過結合圖像反演的方法,生成了迭代式反演和圖像修正流程,可以使生成圖像逐步自我修正,提升質量。

研究團隊在論文中還提出了第一個涵蓋人 - 物體、人 - 動物和人 - 人交互的人物交互圖像生成基準,并為人物交互圖像生成設計了針對性的評估指標。大量實驗表明,該方法在針對人物交互圖像生成的評估指標和常規圖像生成的評估指標下均優于現有的基于擴散的圖像生成方法。

方法介紹

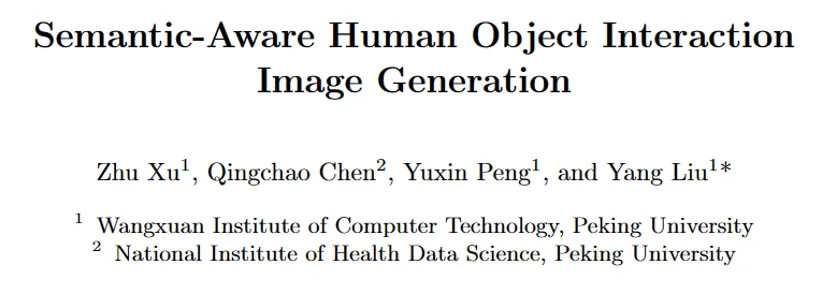

圖 1:語義感知的人物交互圖像生成方法框架圖

論文中提出的方法如圖 1 所示,主要由兩個設計組成:姿態和交互指導(Pose and Interaction Guidance, PIG)和迭代反演和修正流程(Iterative Inversion and Refinement Pipeline, IIR)。

在 PIG 中,對于給定的人物交互文本描述 和噪聲

和噪聲 ,首先使用穩定擴散模型(Stable Diffusion [2])生成

,首先使用穩定擴散模型(Stable Diffusion [2])生成 作為初始圖像,并使用姿態檢測器 [3] 獲取人類體關節位置

作為初始圖像,并使用姿態檢測器 [3] 獲取人類體關節位置 和相應的置信分數

和相應的置信分數  , 構建姿態掩碼

, 構建姿態掩碼  高亮低質量姿態區域。

高亮低質量姿態區域。

對于交互指導,利用分割模型定位交互邊界區域,得到關鍵點 和相應的置信分數

和相應的置信分數 , 并在交互掩碼

, 并在交互掩碼 中高亮交互區域,以增強交互邊界的語義表達。對于每個去噪步驟,

中高亮交互區域,以增強交互邊界的語義表達。對于每個去噪步驟, 和

和  作為約束來對這些高亮的區域進行修正,從而減少這些區域中存在的生成問題。此外, IIR 結合圖像反演模型 N,從需要進一步修正的圖像中提取噪聲 n 和文本描述的嵌入 t,然后使用 PIG 對該圖像進行下一次修正,利用質量評估器 Q 對修正后的圖像質量進行評估,以 < 反饋、評估、修正 > 的操作來逐步提高圖像質量。

作為約束來對這些高亮的區域進行修正,從而減少這些區域中存在的生成問題。此外, IIR 結合圖像反演模型 N,從需要進一步修正的圖像中提取噪聲 n 和文本描述的嵌入 t,然后使用 PIG 對該圖像進行下一次修正,利用質量評估器 Q 對修正后的圖像質量進行評估,以 < 反饋、評估、修正 > 的操作來逐步提高圖像質量。

姿態和交互指導

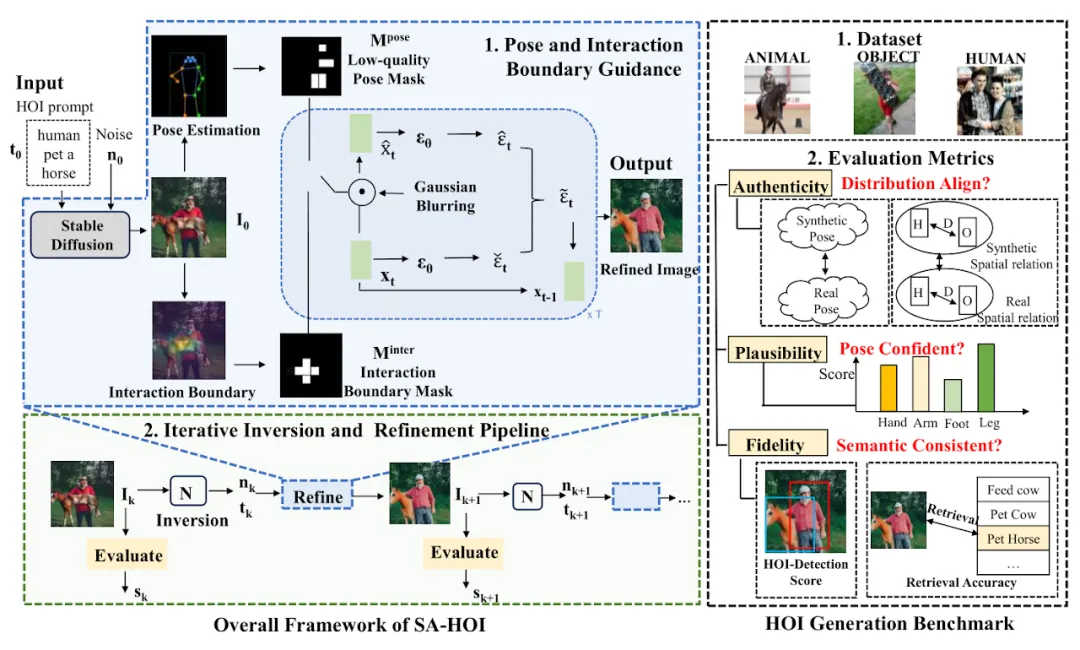

圖 2:姿勢和交互指導采樣偽代碼

姿勢和交互引導采樣的偽代碼如圖 2 所示,在每個去噪步驟中,我們首先按照穩定擴散模型(Stable Diffusion)中的設計獲取預測的噪聲 ?t 和中間重構 。然后我們在 上應用高斯模糊 G 來獲得退化的潛在特征 和 ,隨后將對應潛在特征中的信息引入去噪過程中。

和

和  被用于生成

被用于生成  和

和 ,并在

,并在  和

和  中突出低姿勢質量區域,指導模型減少這些區域的畸變生成。為了指導模型改進低質量區域,將通過如下公式來高亮低姿勢得分區域:

中突出低姿勢質量區域,指導模型減少這些區域的畸變生成。為了指導模型改進低質量區域,將通過如下公式來高亮低姿勢得分區域:

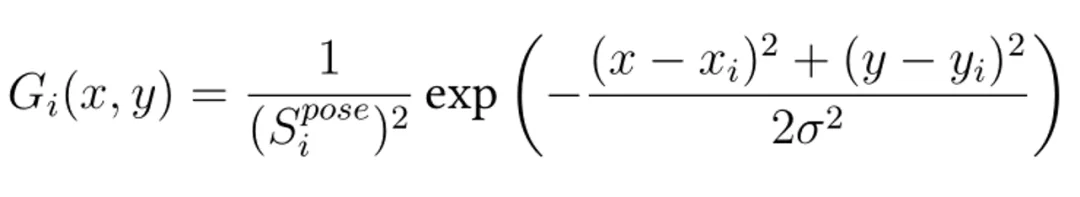

其中  ,x、y 是圖像的逐像素坐標,H,W 是圖像大小,σ 是高斯分布的方差。

,x、y 是圖像的逐像素坐標,H,W 是圖像大小,σ 是高斯分布的方差。 表示以第 i 個關節為中心的注意力,通過結合所有關節的注意力,我們可以形成最終的注意力圖

表示以第 i 個關節為中心的注意力,通過結合所有關節的注意力,我們可以形成最終的注意力圖 ,并使用閾值將

,并使用閾值將  轉換為一個掩碼

轉換為一個掩碼  。

。

其中 ?t 是在時間步 t 生成掩碼的閾值。類似地,對于交互指導,論文作者利用分割模型得到物體的外輪廓點 O 以及人體關節點 C,計算人與物體之間的距離矩陣 D,從中采樣得到交互邊界的關鍵點  ,利用和姿勢指導相同的方法生成交互注意力

,利用和姿勢指導相同的方法生成交互注意力  與掩碼

與掩碼  ,并應用于計算最終的預測噪聲。

,并應用于計算最終的預測噪聲。

迭代式反演和圖像修正流程

為了實時獲取生成圖像的質量評估,論文作者引入質量評估器 Q,用于作為迭代式 < 評估 + 修正 > 操作的指導。對于第 k 輪的圖像 ,采用評估器 Q 獲取其質量分數

,采用評估器 Q 獲取其質量分數 ,然后基于

,然后基于  生成

生成 。為了在優化后保留

。為了在優化后保留 的主要內容,需要相應的噪聲作為去噪的初始值。

的主要內容,需要相應的噪聲作為去噪的初始值。

然而,這樣的噪聲不是現成可得的,為此引入圖像反演方法 來獲取其噪聲潛在特征

來獲取其噪聲潛在特征 和文本嵌入

和文本嵌入 ,作為 PIG 的輸入,生成優化后的結果

,作為 PIG 的輸入,生成優化后的結果 。

。

通過比較前后迭代輪次中的質量分數,可以判斷是否要繼續進行優化:當 和

和  之間沒有顯著差異,即低于閾值 θ,可以認為該流程可能已經對圖像做出了充足的修正,因此結束優化并輸出質量分數最高的圖像。

之間沒有顯著差異,即低于閾值 θ,可以認為該流程可能已經對圖像做出了充足的修正,因此結束優化并輸出質量分數最高的圖像。

人物交互圖像生成基準

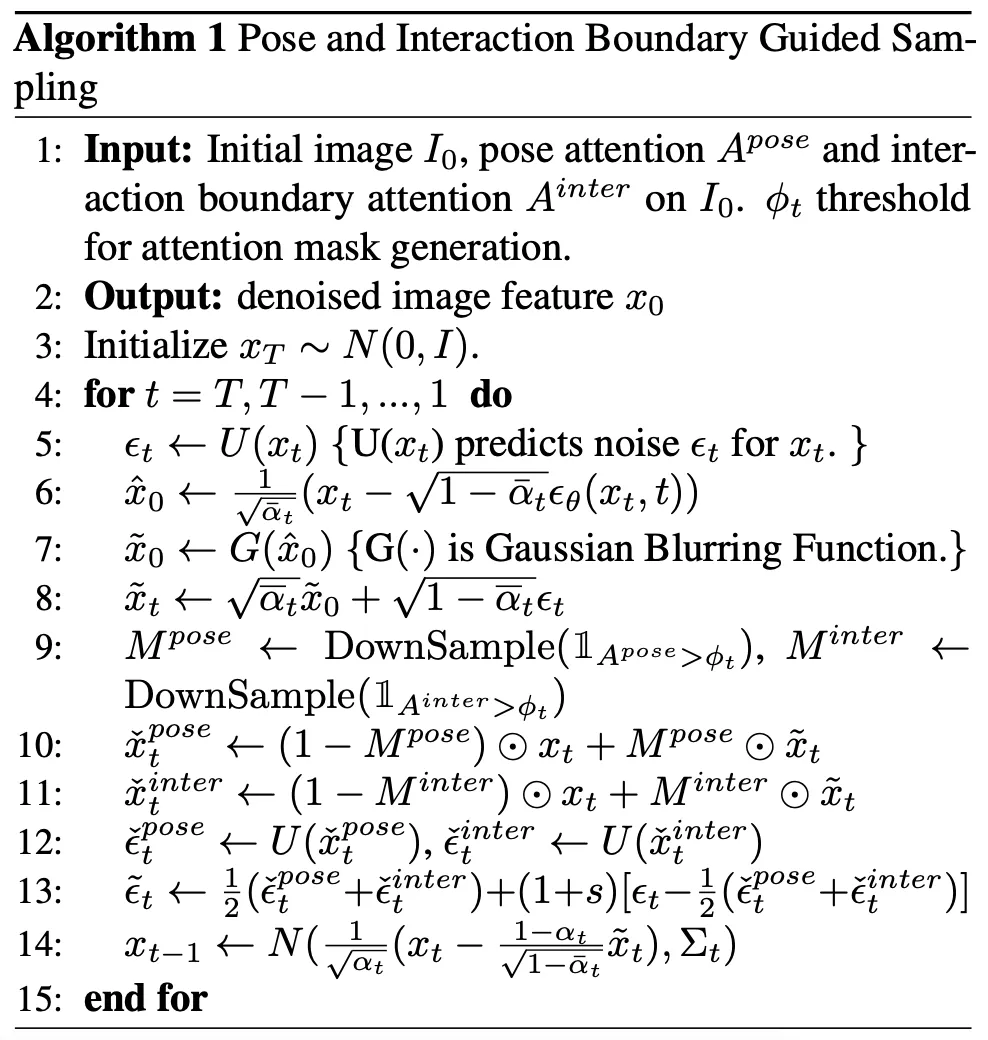

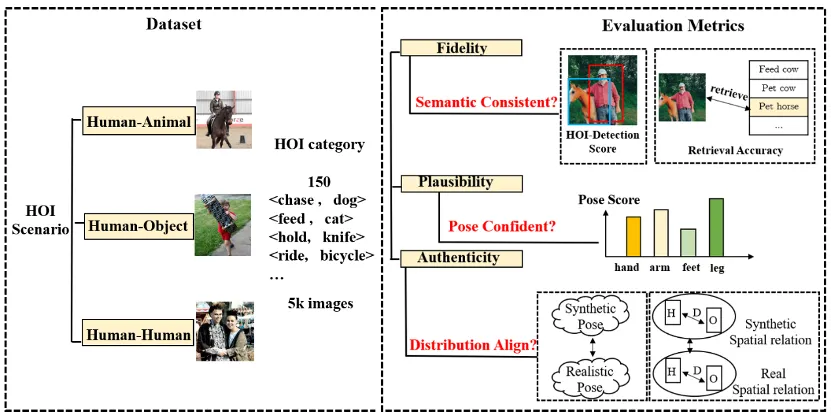

圖 3:人物交互圖像生成基準(數據集 + 測評指標)

考慮到沒有針對人物交互圖像生成任務設計的現有模型和基準,論文作者收集并整合了一個人物交互圖像生成基準,包括一個含有 150 個人物交互類別的真實人物交互圖像數據集,以及若干為人物交互圖像生成定制的測評指標。

該數據集從開源人物交互檢測數據集 HICO-DET [5] 中篩選得到 150 個人物交互類別,涵蓋了人 - 物體、人 - 動物和人 - 人三種不同交互場景。共計收集了 5k 人物交互真實圖像作為該論文的參考數據集,用于評估生成人物交互圖像的質量。

為了更好地評估生成的人物交互圖像質量,論文作者為人物交互生成量身定制了幾個測評標準,從可靠性 (Authenticity)、可行性 (Plausibility) 和保真度 (Fidelity) 的角度全面評估生成圖像。可靠性上,論文作者引入姿勢分布距離和人 - 物體距離分布,評估生成結果和真實圖像是否接近:生成結果在分布意義上越接近真實圖像,就說明質量越好。可行性上,采用計算姿勢置信度分數來衡量生成人體關節的可信度和合理性。保真度上,采用人物交互檢測任務,以及圖文檢索任務評估生成圖像與輸入文本之間的語義一致性。

實驗結果

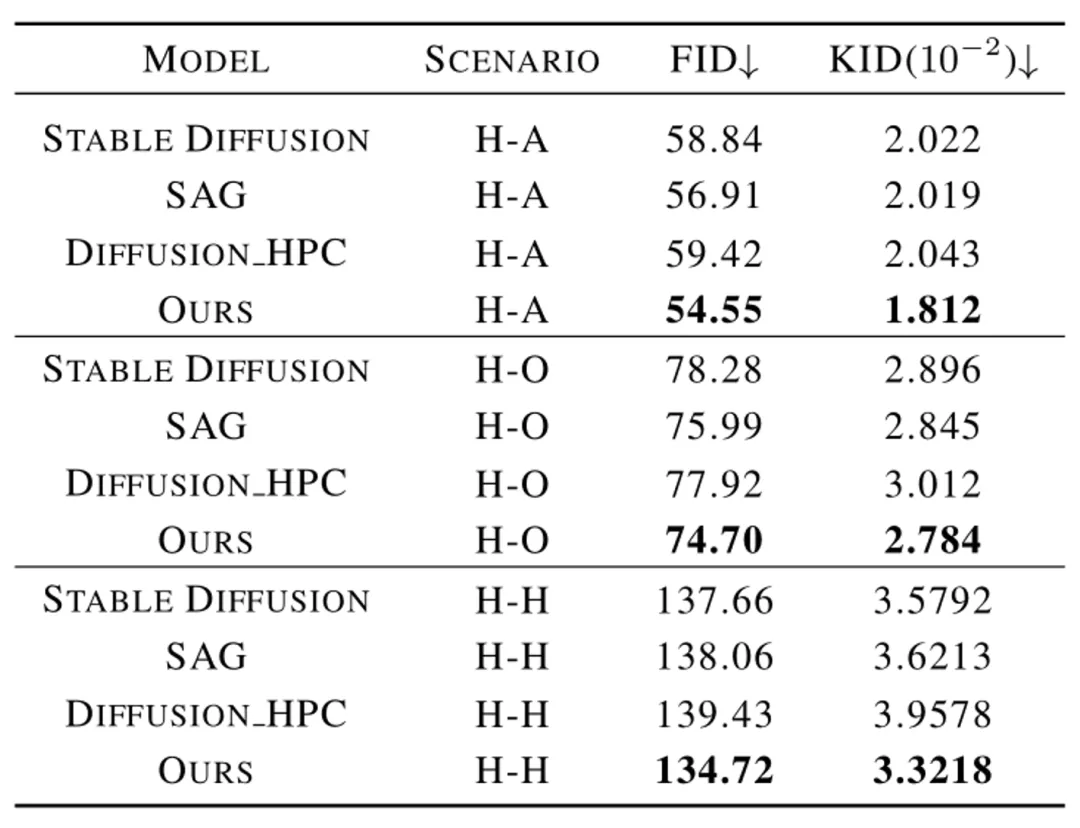

與現有方法的對比實驗結果如表 1 和表 2 所示,分別對比了人物交互圖像生成指標和常規圖像生成指標上的性能。

表 1:與現有方法在人物交互圖像生成指標的對比實驗結果

表 2:與現有方法在常規圖像生成指標的對比實驗結果

實驗結果表明,該論文中的方法在人體生成質量,交互語義表達,人物交互距離,人體姿態分布,整體圖像質量等多個維度的測評上都優于現有模型。

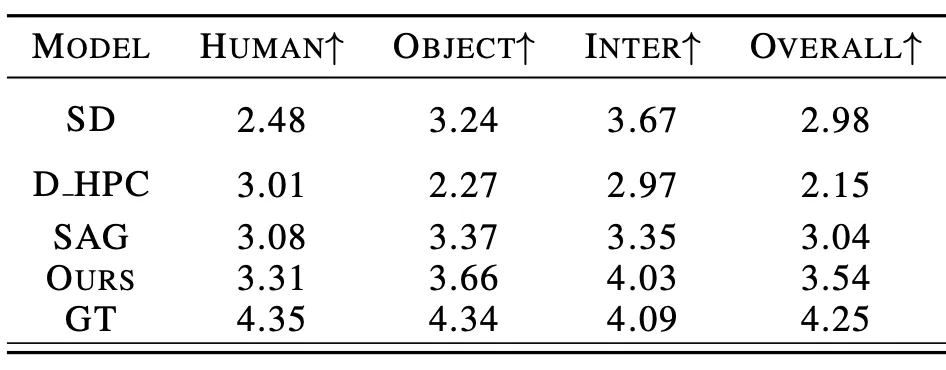

此外,論文作者還進行了主觀評測,邀請眾多用戶從人體質量,物體外觀,交互語義和整體質量等多個角度進行評分,實驗結果證明 SA-HOI 的方法在各個角度都更符合人類審美。

表 3:與現有方法的主觀評測結果

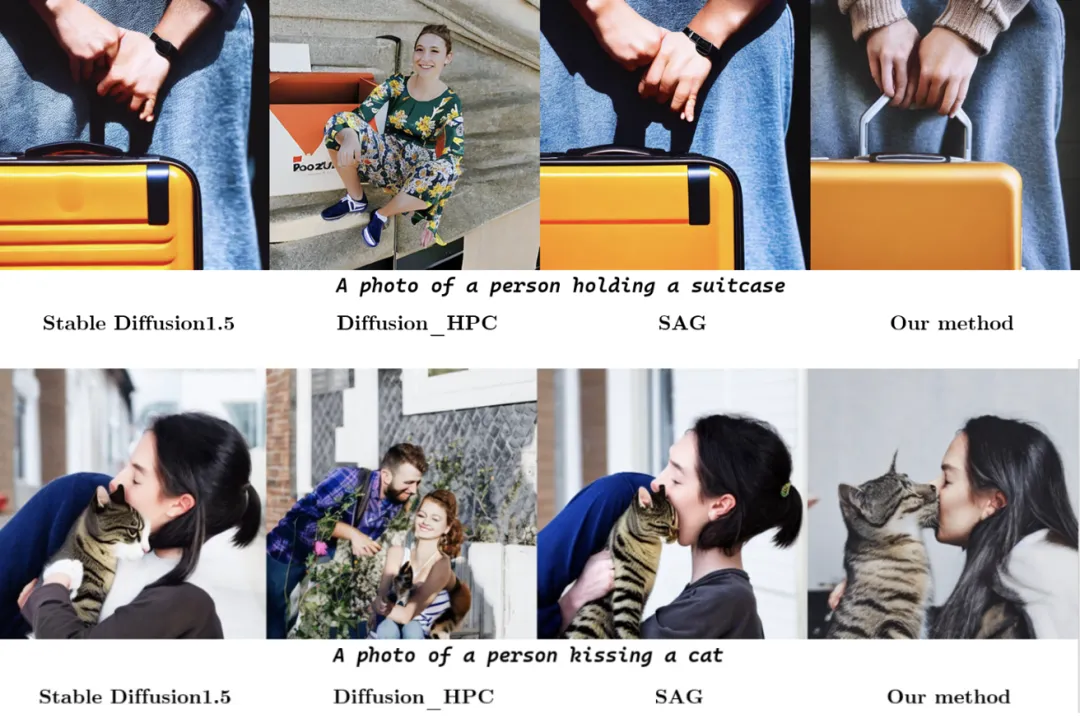

定性實驗上,下圖展示了不同方法對同一個人物交互類別描述生成結果的對比。在上方的組圖中,采用了新方法的模型準確表達了 “親吻” 的語義,并且生成的人體姿勢也更合理。在下方的組圖中,論文中的方法也成功緩解了其他方法中存在的人體扭曲和畸變,并且通過在手與手提箱交互的區域生成手提箱的拉桿來增強 “拿手提箱” 這個交互的語義表達,從而得到在人體姿態和交互語義兩方面都優于其他方法的結果。

圖 4:人物交互圖像生成結果可視化

更多研究細節,可參考原論文。