給視頻模型安上快慢兩只眼睛,蘋果免訓練新方法秒了一切SOTA

自從 Sora 發(fā)布以來,AI 視頻生成領域變得更加「熱鬧」了起來。過去幾個月,我們見證了即夢、Runway Gen-3、Luma AI、快手可靈輪番炸場。

和以往一眼就能識破是 AI 生成的模型不太一樣,這批視頻大模型可能是我們所見過的「最好的一屆」。

然而,視頻大語言模型(LLM)驚艷表現(xiàn)的背后離不開龐大且經過精細標注的視頻數(shù)據(jù)集,這需要花費相當高的成本。近期研究領域也涌現(xiàn)了一批無需額外訓練的創(chuàng)新方法:采用訓練好的圖像大語言模型,直接用于視頻任務的處理,這樣就繞開了「昂貴」的訓練過程。

此外,現(xiàn)有大多視頻 LLM 存在兩個主要缺點:(1)它們只能處理有限幀數(shù)的視頻輸入,這使得模型難以捕捉視頻中細微的空間和時間內容;(2)它們缺少時間建模設計,而是簡單地將視頻特征輸入到 LLM 中,完全依賴于 LLM 對運動的建模能力。

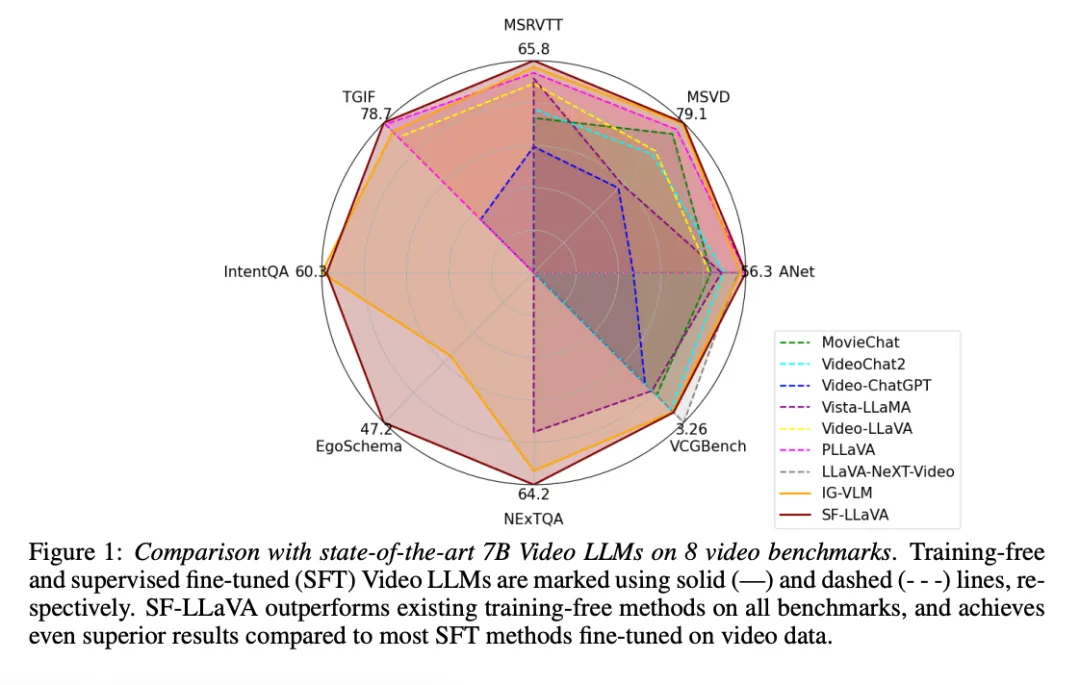

針對以上問題,蘋果研究人員提出了 SlowFast-LLaVA(簡稱 SF-LLaVA)。這一模型基于字節(jié)團隊開發(fā)的 LLaVA-NeXT 架構,無需額外微調,開箱即用。研究團隊受在動作識別領域大獲成功的雙流網絡的啟發(fā),為視頻 LLM 設計了一套新穎的 SlowFast 輸入機制。

簡單來說,SF-LLaVA 將通過兩種不同的觀察速度(Slow 和 Fast)來理解視頻中的細節(jié)和運動。

- 慢速路徑:低幀率提取特征,同時盡可能多地保留空間細節(jié)(例如每 8 幀保留 24×24 個 token)

- 快速路徑:高幀率運行,但用較大的空間池化步長降低視頻的分辨率,以模擬更大的時間上下文,更專注于理解動作的連貫性

這相當于模型擁有兩只「眼睛」:一只慢慢看,注意看細節(jié);另一只快速看,注意看動作。這樣就解決了大多現(xiàn)有的視頻 LLM 的痛點,既能捕捉到詳細的空間語義,又能捕捉到更長的時間上下文。

論文鏈接:https://arxiv.org/pdf/2407.15841

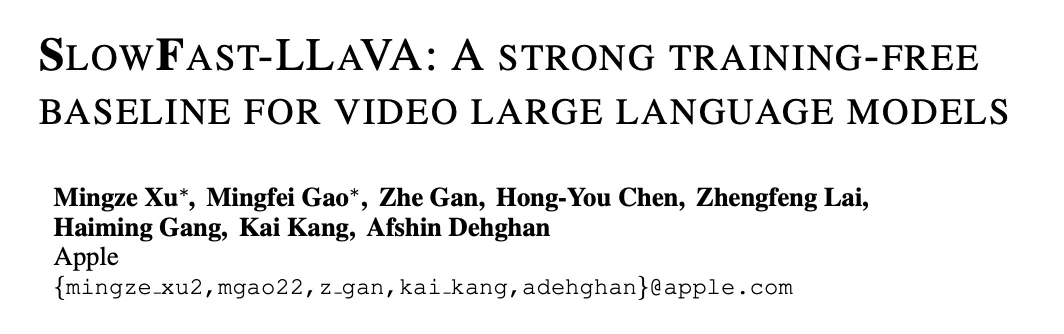

實驗結果顯示,SF-LLaVA 在所有基準測試中均以顯著的優(yōu)勢超越了現(xiàn)有免訓練方法。與精心微調的 SFT 模型相比,SF-LLaVA 能達到相同性能,甚至更好。

模型架構

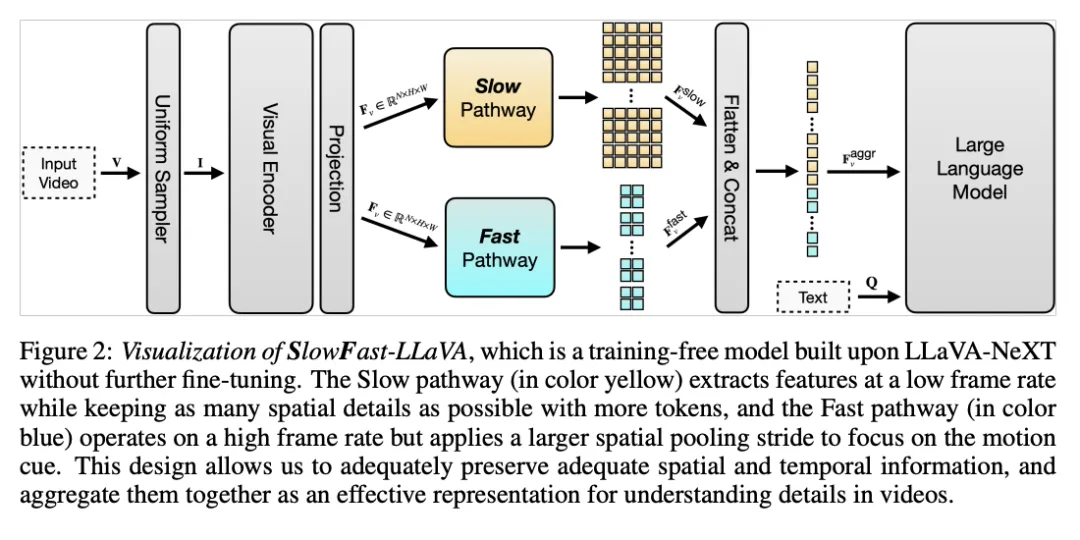

如下圖所示,SF-LLaVA 遵循標準的免訓練視頻 LLM 流程。它以視頻 V 和問題 Q 作為輸入,輸出對應的答案 A。

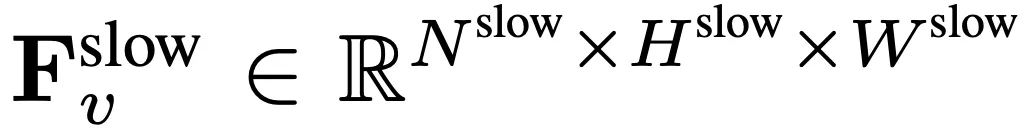

對于輸入,要從每個視頻任意大小和長度中均勻采樣 N 幀,I = {I_1, I_2, ..., I_N},不需要對選取的視頻幀進行特別的組合或排列。以幀為單位視獨立提取頻特征為 F_v ∈ R^N×H×W,其中 H 和 W 分別是幀特征的高度和寬度。

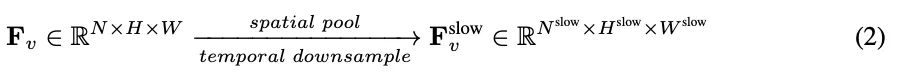

下一步需要在慢速和快速兩個路徑中進一步處理 F_v,并將它們結合起來作為有效的視頻表示。慢速路徑從 F_v 中均勻采樣 的幀特征,其中

的幀特征,其中 。

。

此前有研究發(fā)現(xiàn),在空間維度上適當池化可以提高視頻生成的效率和魯棒性。因此,研究團隊在 F_v 上應用步長為 σ_h×σ_w 的池化過程,得到最終特征: ,其中

,其中 ,

, 。慢速路徑的整個過程如公式 2 所示。

。慢速路徑的整個過程如公式 2 所示。

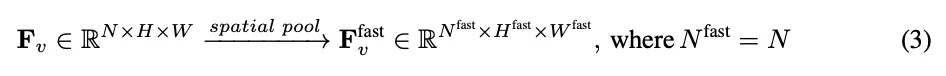

快速路徑保留 F_v 中的所有幀特征,以盡可能多地捕捉視頻的長程時間上下文。具體來說,研究團隊使用空間池化步長 對 F_v 進行激進的下采樣,得到最終特征

對 F_v 進行激進的下采樣,得到最終特征 。研究團隊設置

。研究團隊設置 、

、 ,使得快速路徑能專注于模擬時間上下文和運動線索。慢速路徑的整個過程如公式 3 所示。

,使得快速路徑能專注于模擬時間上下文和運動線索。慢速路徑的整個過程如公式 3 所示。

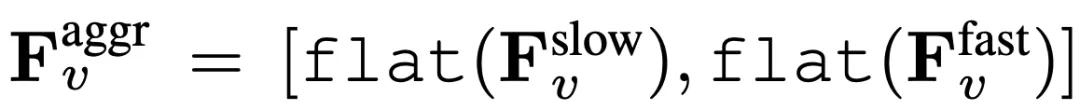

最后,獲得聚合的視頻特征: ,其中 flat 和 [, ] 分別表示展平和連接操作。如表達式所示,

,其中 flat 和 [, ] 分別表示展平和連接操作。如表達式所示, 不需要任何特殊的 token 來分隔慢速和快速路徑。SF-LLaVA 總共使用

不需要任何特殊的 token 來分隔慢速和快速路徑。SF-LLaVA 總共使用 個視頻 token。視頻的視覺特征

個視頻 token。視頻的視覺特征 將和文本信息(比如用戶提出的問題)將被組合在一起,作為輸入數(shù)據(jù)送入大型語言模型(LLM)進行處理。

將和文本信息(比如用戶提出的問題)將被組合在一起,作為輸入數(shù)據(jù)送入大型語言模型(LLM)進行處理。

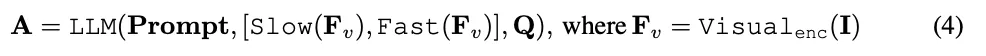

SlowFast 流程如公式 4 所示。

實驗結果

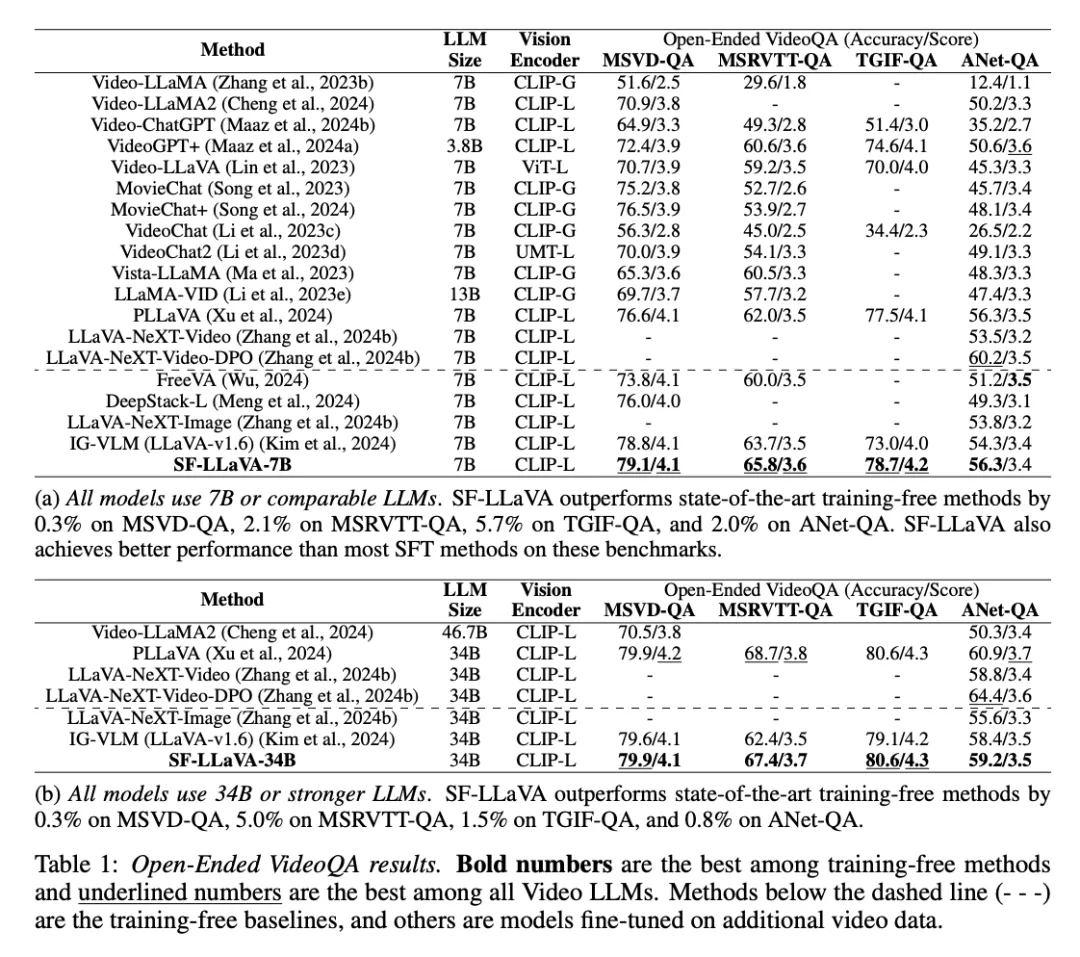

研究團隊對 SF-LLaVA 進行了全面的性能評估,將其與當前 SOTA 免訓練模型(如 IG-VLM 和 LLoVi)在多個視頻問答任務中進行了對比。此外,他們還將其與經過視頻數(shù)據(jù)集監(jiān)督微調(SFT)的視頻 LLM,例如 VideoLLaVA 和 PLLaVA 進行了比較。

開放式視頻問答

如下表所示,在開放式視頻問答任務中,SF-LLaVA 在所有基準測試中都比現(xiàn)有的免訓練方法表現(xiàn)得更好。具體來說,當分別搭載 7B 和 34B 參數(shù)規(guī)模的 LLM 時,SF-LLaVA 分別在 MSRVTT-QA 上比 IGVLM 高出 2.1% 和 5.0%,在 TGIF-QA 上高出 5.7% 和 1.5%,在 ActivityNet-QA 上高出 2.0% 和 0.8%。

即使與經過微調的 SFT 方法相比,SF-LLaVA 在大多數(shù)基準測試中也展現(xiàn)了可比的性能,只有在 ActivityNet-QA 這一基準上,PLLaVA 和 LLaVA-NeXT-VideoDPO 略勝一籌。

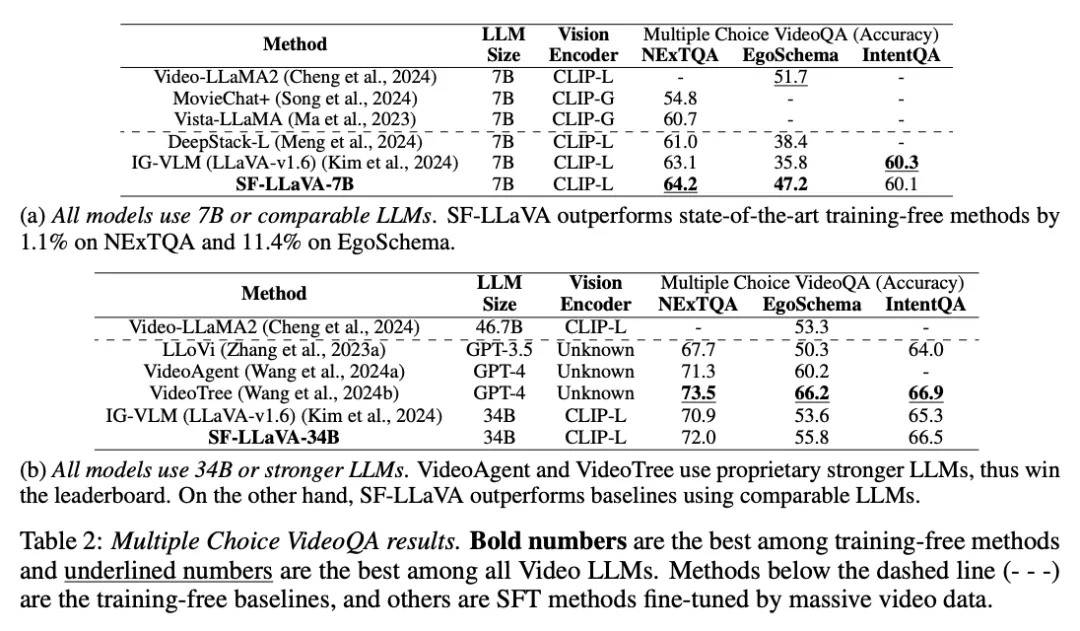

多項選擇視頻問答

從下表中可見,在所有基準測試中,SF-LLaVA 在多項選擇視頻問答的表現(xiàn)都優(yōu)于其他免訓練方法。在要求復雜長時序推理的 EgoSchema 數(shù)據(jù)集中,SF-LLaVA7B 和 34B 的版本相較 IG-VLM 模型的得分分別高出 11.4% 和 2.2%。

雖然 VideoTree 在基準測試中領先,因為它是基于 GPT-4 的專有模型,因而性能遠高于開源 LLM。與 SFT 方法相比,SF-LLaVA 34B 模型在 EgoSchema 上也取得了更好的結果,這證實了 SlowFast 設計處理長視頻方面的強大能力。

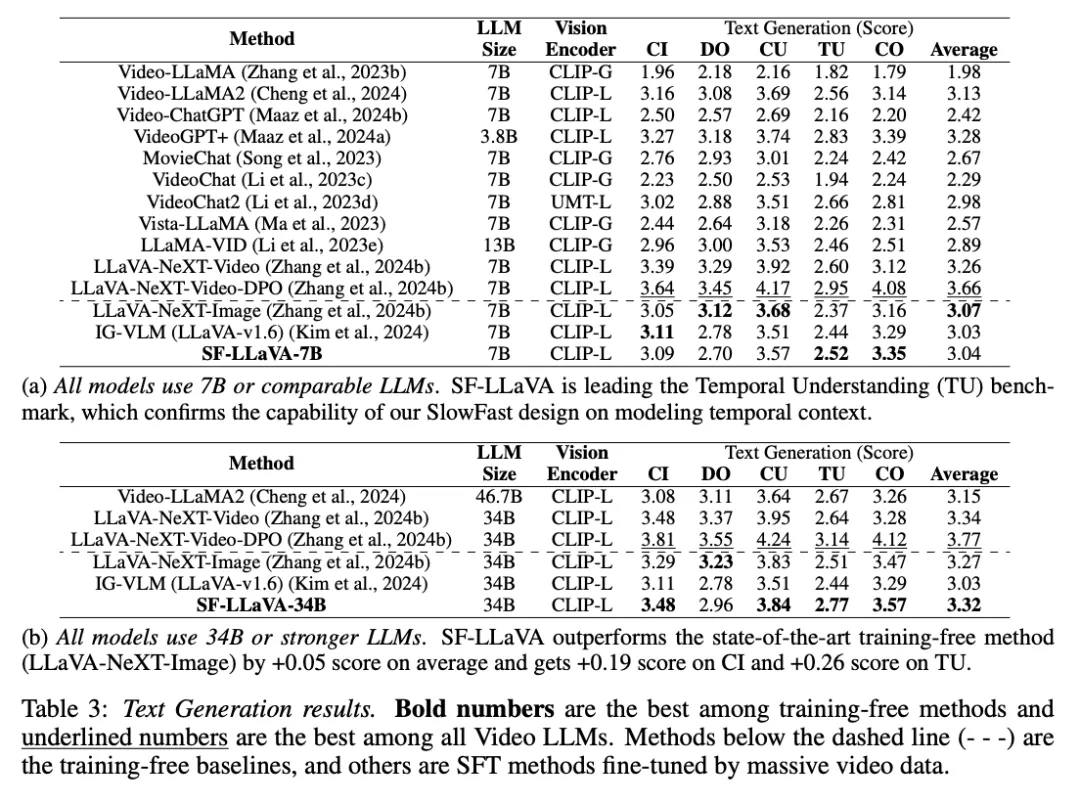

Text Generation

文生視頻

如表 3 所示,對于文本生成視頻的任務,SF-LLaVA 也顯示出了一些優(yōu)勢。SF-LLaVA-34B 在整體表現(xiàn)上超越了所有免訓練的基準。盡管在細節(jié)取向方面,SF-LLaVA 略遜于 LLaVA-NeXT-Image。基于 SlowFast 設計,SF-LLaVA 可以用更少的視覺 token 覆蓋更長的時間上下文,因此在時間理解任務中表現(xiàn)得格外出色。

此外,在文生視頻的表現(xiàn)上,SF-LLaVA-34B 也優(yōu)于大多數(shù) SFT 方法。

更多細節(jié),請參考原論文。