幻覺(jué)不一定有害,新框架用AI的「幻覺(jué)」優(yōu)化圖像分割技術(shù)

作者胡健,是倫敦大學(xué)瑪麗女王學(xué)院的博士生,導(dǎo)師是龔少剛教授,這篇文章是在龔少剛教授和嚴(yán)駿馳教授的指導(dǎo)下完成的。

在人工智能領(lǐng)域,大型預(yù)訓(xùn)練模型(如 GPT 和 LLaVA)的 “幻覺(jué)” 現(xiàn)象常被視為一個(gè)難以克服的挑戰(zhàn),尤其是在執(zhí)行精確任務(wù)如圖像分割時(shí)。然而,最新發(fā)表于 NeurIPS 2024 的研究《Leveraging Hallucinations to Reduce Manual Prompt Dependency in Promptable Segmentation》提出了一個(gè)有趣的觀點(diǎn):這些幻覺(jué)實(shí)際上可以被轉(zhuǎn)化為有用的信息源,從而減少對(duì)手動(dòng)提示的依賴。

- 文章鏈接:https://arxiv.org/abs/2408.15205

- 代碼鏈接:https://github.com/lwpyh/ProMaC_code

- 項(xiàng)目網(wǎng)址:https://lwpyh.github.io/ProMaC/

這項(xiàng)研究由來(lái)自倫敦大學(xué)瑪麗女王學(xué)院和上海交通大學(xué)的研究團(tuán)隊(duì)進(jìn)行的,他們開(kāi)發(fā)了名為 ProMaC 的框架,該框架創(chuàng)新性地利用了大模型在預(yù)訓(xùn)練過(guò)程中產(chǎn)生的幻覺(jué)。不僅能夠準(zhǔn)確識(shí)別圖像中的目標(biāo)對(duì)象,還能判斷這些對(duì)象的具體位置和形狀,這在偽裝動(dòng)物檢測(cè)或醫(yī)學(xué)圖像分割等復(fù)雜任務(wù)中表現(xiàn)尤為出色。

研究動(dòng)機(jī)

該研究專注于一種具有挑戰(zhàn)性的任務(wù):通用提示分割任務(wù)(task-generic promptable segmentation setting)。在這個(gè)框架下,該研究只提供一個(gè)任務(wù)內(nèi)的通用提示來(lái)描述整個(gè)任務(wù),而不會(huì)具體指明每張圖片中需要分割的具體物體。例如,在偽裝動(dòng)物分割任務(wù)中,該研究?jī)H提供 “camouflaged animal” 這樣的任務(wù)描述,而不會(huì)告知不同圖片中具體的動(dòng)物名稱。模型需要完成兩項(xiàng)主要任務(wù):首先,根據(jù)圖片內(nèi)容有效推理出具體需要分割的目標(biāo)物體;其次,準(zhǔn)確確定目標(biāo)物體的具體位置和分割的形狀。

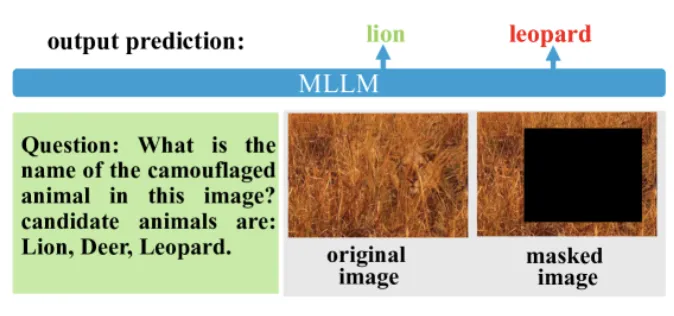

盡管如 SAM 這類大型分割模型的存在,能夠在提供較為精確的位置描述時(shí)有效地進(jìn)行物體分割,但在偽裝樣本分割或醫(yī)學(xué)圖像分割等復(fù)雜任務(wù)中,獲取這種精確描述并不容易。以往的研究,如 GenSAM [1],提出利用 LLaVA/BLIP2 這類多模態(tài)大模型(MLLMs)來(lái)推理出特定樣本的分割提示,以指導(dǎo)分割過(guò)程。然而,這種方法在處理像偽裝樣本分割這樣的場(chǎng)景時(shí),往往因?yàn)槟繕?biāo)共現(xiàn)偏差(object co-occasion bias)存在而導(dǎo)致問(wèn)題。例如,在一個(gè)只有草原的圖像中,如果訓(xùn)練數(shù)據(jù)中獅子通常與草原共現(xiàn),LLaVA 可能會(huì)偏向于預(yù)測(cè)草原中存在偽裝的獅子,即使圖中實(shí)際上沒(méi)有獅子。這種假設(shè)的偏好在偽裝動(dòng)物分割任務(wù)中尤其問(wèn)題嚴(yán)重,因?yàn)樗赡軐?dǎo)致模型錯(cuò)誤地識(shí)別出不存在的偽裝動(dòng)物。

圖 1. co-occurrence prior 導(dǎo)致的 hallucination

但是這樣的現(xiàn)象就一定是壞事嗎?其實(shí)并不盡然。考慮到獵豹確實(shí)常出沒(méi)于此類草原,盡管在特定圖片中它們可能并未出現(xiàn)。這種所謂的 “幻覺(jué)”,其實(shí)是模型根據(jù)大規(guī)模數(shù)據(jù)訓(xùn)練得出的經(jīng)驗(yàn)性常識(shí)。雖然這種推斷與當(dāng)前的例子不符,但它確實(shí)反映了現(xiàn)實(shí)世界中的常態(tài)。更進(jìn)一步地說(shuō),這種由幻覺(jué)帶來(lái)的常識(shí)可能有助于更深入地分析圖片內(nèi)容,發(fā)現(xiàn)與圖片相關(guān)但不顯而易見(jiàn)的信息。如果這些信息得到驗(yàn)證,它們可能有助于更有效地執(zhí)行下游任務(wù)。

圖 2. ProMaC 整體架構(gòu)

實(shí)現(xiàn)方法

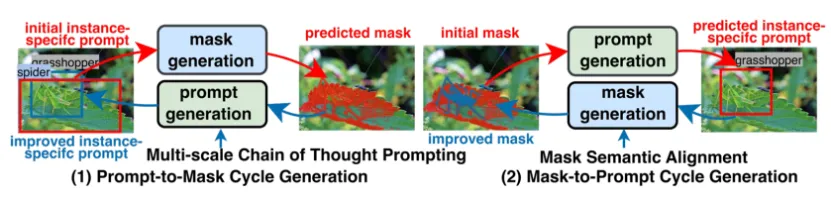

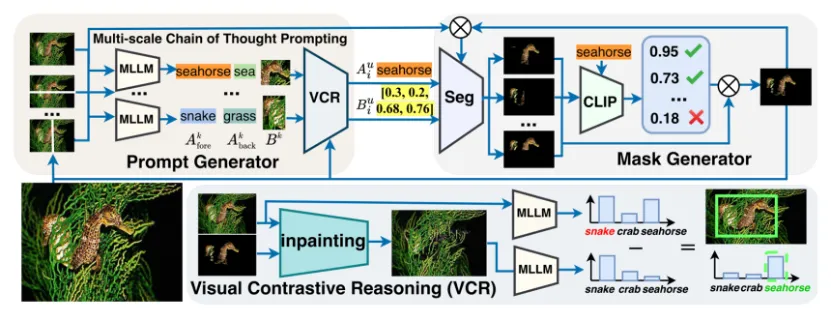

如圖 2 所示,該研究提出了一個(gè)循環(huán)優(yōu)化的 ProMaC 框架,它包括兩部分:利用幻覺(jué)來(lái)從任務(wù)通用提示中推理出樣本特有提示的 multi-scale chain of thought prompting 模塊和將生成的掩碼與任務(wù)語(yǔ)義相對(duì)齊的 mask semantic alignment 模塊。前者推斷出較為準(zhǔn)確的樣本特有提示來(lái)引導(dǎo) SAM 進(jìn)行分割,后者則將生成的掩碼與任務(wù)語(yǔ)義進(jìn)行對(duì)齊,對(duì)齊后的掩碼又可以作為提示反向作用于第一個(gè)模塊來(lái)驗(yàn)證利用幻覺(jué)得到的信息。通過(guò)循環(huán)優(yōu)化來(lái)逐漸獲得準(zhǔn)確的掩碼。

具體地,ProMaC 框架如圖 3 所示:

圖 3. ProMaC 流程圖

多尺度思維鏈提示

它主要完成兩個(gè)任務(wù):收集盡可能多的任務(wù)相關(guān)候選知識(shí),并生成準(zhǔn)確的樣本特有提示。為此,該研究將輸入圖像切割成不同尺度的圖像塊,每個(gè)圖像塊中任務(wù)相關(guān)對(duì)象的不同可見(jiàn)性水平激發(fā)了 MLLM 的幻覺(jué)。這促使模型在各個(gè)圖像塊中通過(guò)先驗(yàn)知識(shí)探索圖像數(shù)據(jù)與相關(guān)任務(wù)之間的聯(lián)系,進(jìn)而預(yù)測(cè)潛在的邊界框和目標(biāo)物體 和背景

和背景 名稱:

名稱:

但其中只有正確的信息才值得保留。為此,該研究引入了視覺(jué)對(duì)比推理(Visual Contrastive Reasoning)模塊。該模塊首先使用圖像編輯技術(shù)創(chuàng)建對(duì)比圖像,這些對(duì)比圖像通過(guò)去除上一次迭代中識(shí)別到的掩碼部分,生成只包含與任務(wù)無(wú)關(guān)背景的圖片。接著,通過(guò)將原圖的輸出預(yù)測(cè)值與背景圖片的輸出預(yù)測(cè)值相減,可以消除由物體共存偏差帶來(lái)的負(fù)面影響,從而確認(rèn)真正有效的樣本特有提示。具體表達(dá)式如下:

掩碼語(yǔ)義對(duì)齊

獲得的樣本特有提示將被送入掩碼生成器來(lái)產(chǎn)生準(zhǔn)確的掩碼。首先,樣本特有提示被輸入到分割模塊(SAM)以生成一個(gè)掩碼。然而,SAM 缺乏語(yǔ)義理解能力,它主要依據(jù)給定的提示及其周?chē)募y理來(lái)識(shí)別可能要分割的物體。因此,該研究采用了 CLIP 來(lái)評(píng)估相同提示在不同圖像塊上生成的各個(gè)掩碼與目標(biāo)物體之間的語(yǔ)義相似性。這種方法有助于確保分割結(jié)果的準(zhǔn)確性和相關(guān)性:

歸一化后的相似度用作權(quán)重,以加權(quán)合成最終的掩碼。這個(gè)掩碼在下一次迭代中有助于生成更優(yōu)質(zhì)的背景圖片,進(jìn)而引導(dǎo)更有效的提示生成。這能充分利用幻覺(jué)來(lái)提取圖片中與任務(wù)相關(guān)的信息,驗(yàn)證后生成更準(zhǔn)確的提示。這樣,更好的提示又能改善掩碼的質(zhì)量,形成一個(gè)互相促進(jìn)的提升過(guò)程。

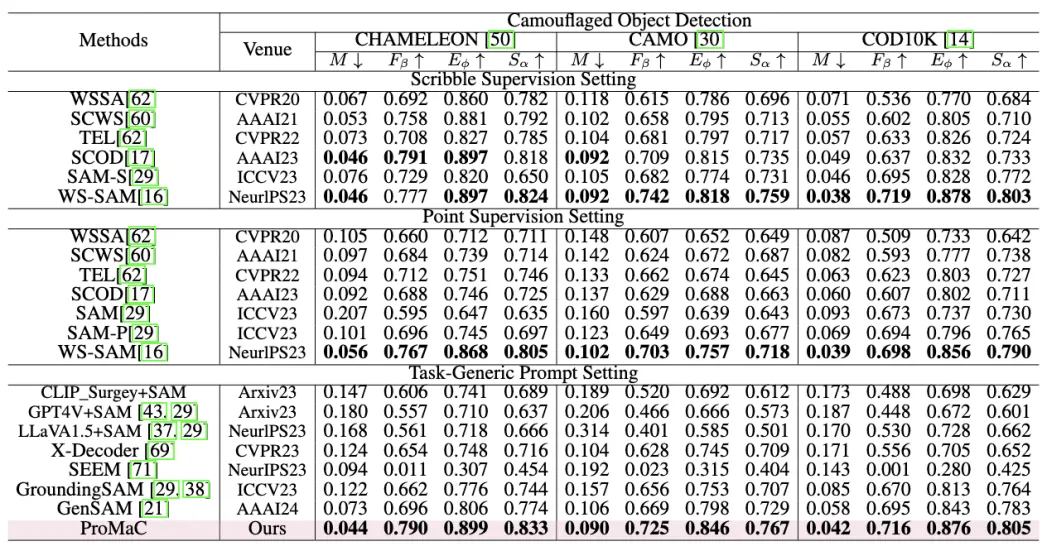

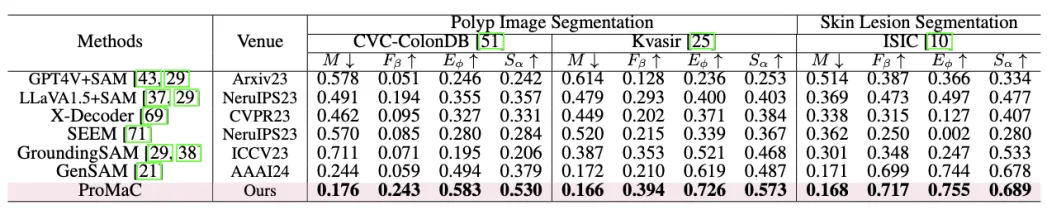

該研究在具有挑戰(zhàn)性的任務(wù) (e.g., 偽裝動(dòng)物檢測(cè),醫(yī)學(xué)圖像檢測(cè)) 上進(jìn)行了實(shí)驗(yàn):

圖 4. 偽裝樣本檢測(cè)實(shí)驗(yàn)結(jié)果

圖 5. 醫(yī)學(xué)圖像實(shí)驗(yàn)結(jié)果

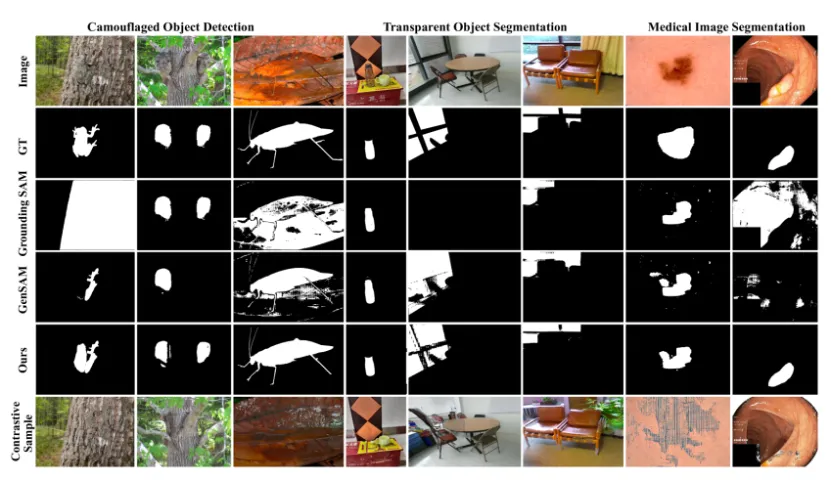

圖 6. 可視化案例

PromaC 提供了一個(gè)新視角,即幻覺(jué)不一定就是有害的,如果能加以利用,也是能為下游任務(wù)提供幫助。