斯坦福吳佳俊擴散自蒸餾來了!突破文生圖身份保留挑戰

近年來,文本到圖像擴散模型為圖像合成樹立了新標準,現在模型可根據文本提示生成高質量、多樣化的圖像。然而,盡管這些模型從文本生成圖像的效果令人印象深刻,但它們往往無法提供精確的控制、可編輯性和一致性 —— 而這些特性對于實際應用至關重要。

單靠文本輸入可能不足以傳達圖像細節,中間出現的變化很多情況下與用戶的意圖不完全一致。

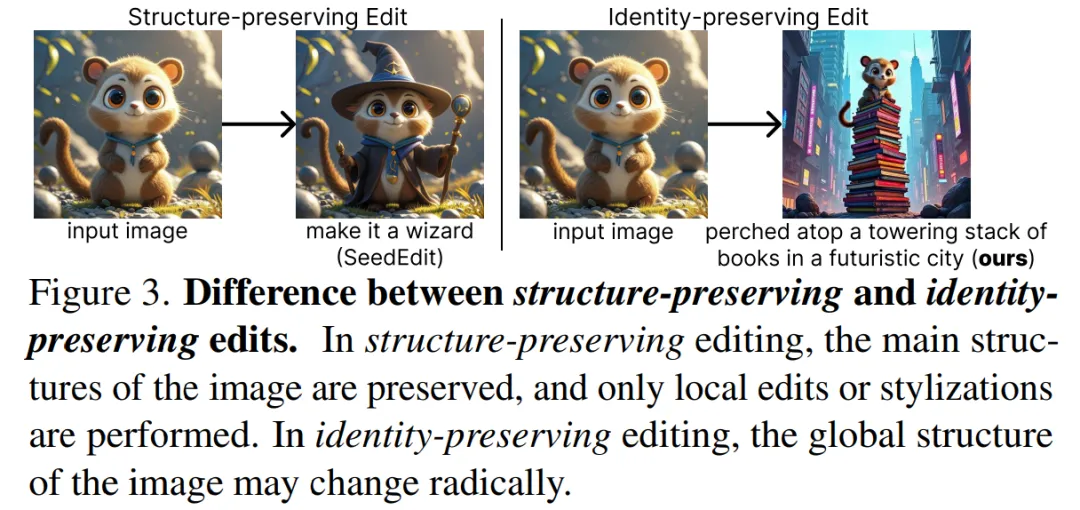

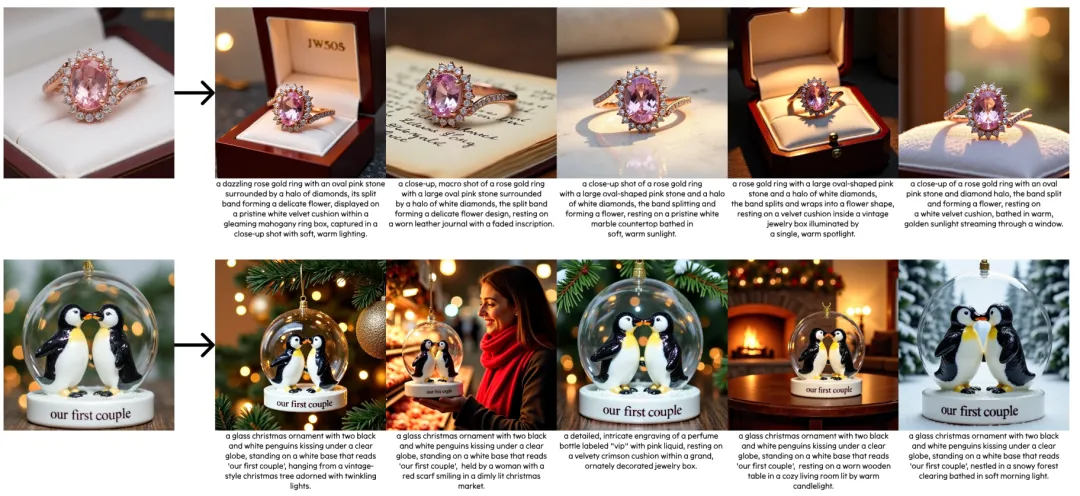

然而,保持主體身份的一致性面臨很大的挑戰。如下圖所示,在「結構 - 保留編輯」中,目標和源圖像共享總體布局,但可能在風格、紋理或其他局部特征上有所不同;在「身份 - 保留編輯」中,圖像結構可能發生大規模變化,但資產在目標和源圖像之間可識別為相同。

對于結構 - 保留編輯,添加層(如 ControlNet )可引入空間條件控制,但僅限于結構指導,無法解決跨不同上下文的一致身份適應問題。對于身份保留編輯,DreamBooth 和 LoRA 等微調方法可以使用一些參考樣本來提高一致性,但耗時且計算密集,需要對每個參考進行訓練。零樣本替代(如 IP-Adapter 和 InstantID )提供了更快的解決方案,無需重新訓練,但無法提供所需的一致性和定制水平;IP-Adapter 缺乏完全的定制功能,而 InstantID 僅限于面部身份。

在新鮮出爐的一項研究中,斯坦福大學的吳佳俊等研究者提出了一種名為擴散自蒸餾(Diffusion Self-Distillation,DSD)的新方法,該方法使用預訓練的文本到圖像模型來生成它自己的數據集,并用于文本條件的圖像到圖像任務。

- 論文標題:Diffusion Self-Distillation for Zero-Shot Customized Image Generation

- 論文鏈接:https://arxiv.org/pdf/2411.18616

- 項目主頁:https://primecai.github.io/dsd/

首先利用文本到圖像擴散模型的上下文生成能力來創建圖像網格,并在視覺語言模型的幫助下策劃一個大型配對數據集。然后,使用精選的配對數據集將文本到圖像模型微調為文本 + 圖像到圖像模型。該研究證明了擴散自蒸餾法優于現有的零樣本方法,并且在廣泛的身份保留生成任務上與每個實例的微調技術具有競爭力,而無需測試時間優化。

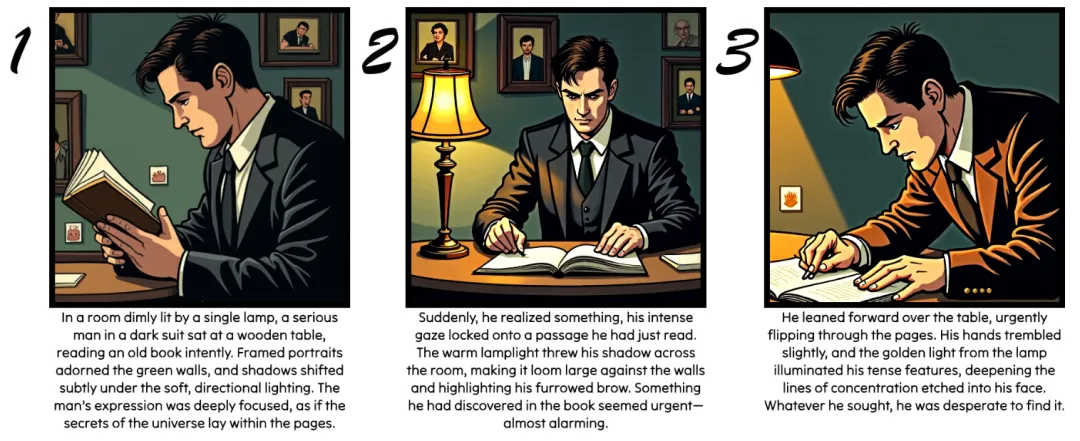

論文作者之一、斯坦福大學計算機科學博士生蔡盛曲表示:DSD 重新定義了使用 FLUX 進行零樣本自定義圖像生成,DSD 類似于 DreamBooth,是零樣本、無需訓練的。它適用于任何輸入主題和所需的上下文角色一致性,項目、資產適應,場景重照明等等。它甚至可以創建漫畫,而無需任何微調或訓練個性化模型!

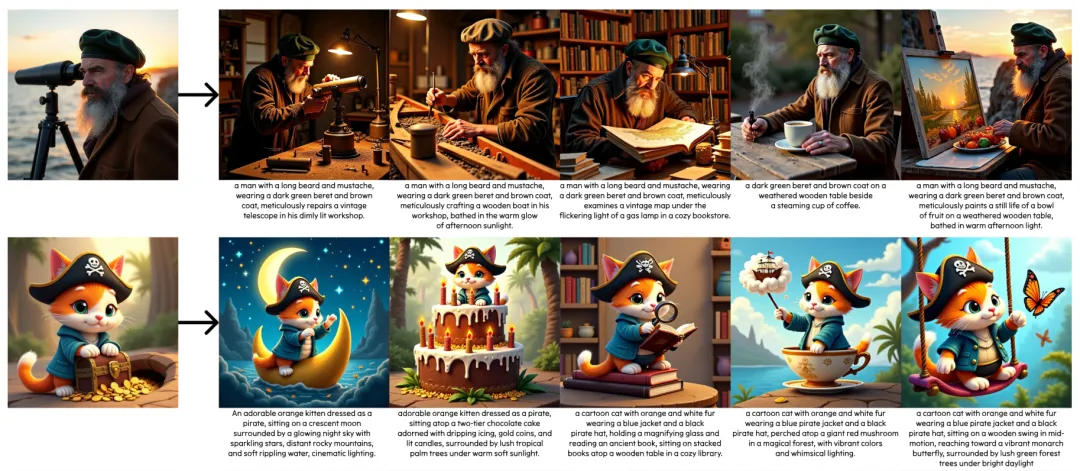

以下是一些示例展示:

角色保留:

實物保留:

創建漫畫:

擴散自蒸餾

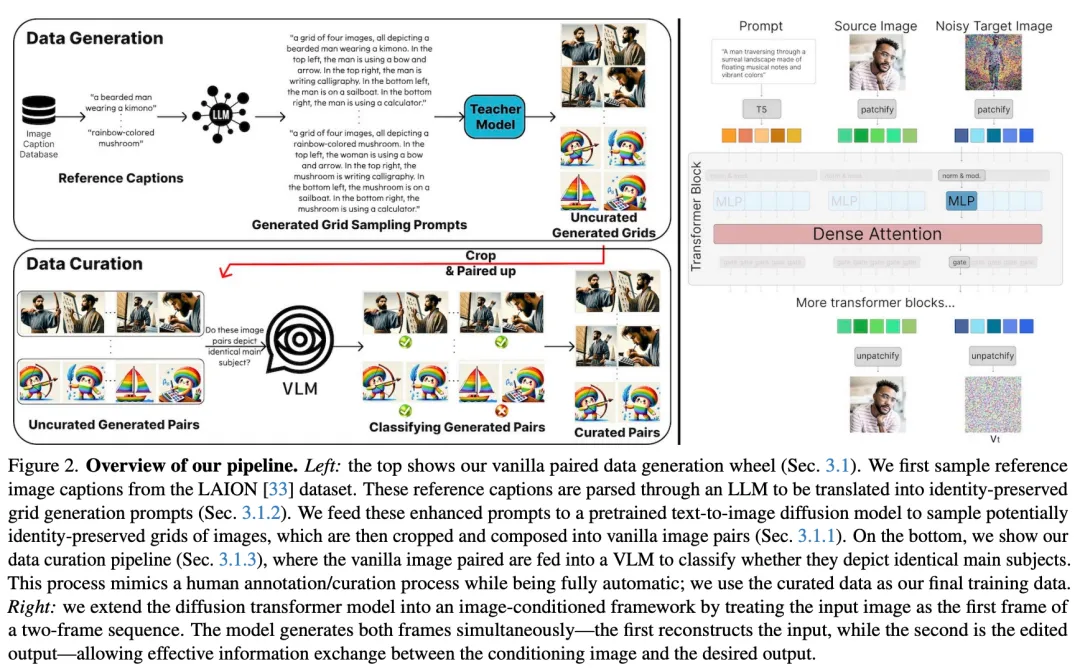

最近的文本到圖像生成模型具有令人驚訝的能力,可以生成上下文一致的圖像網格(見圖 2 左)。受此啟發,研究者開發了一種零樣本適應網絡,它能快速、多樣、高質量地生成圖像,并能保留身份,即以參考圖像為條件生成一致的圖像。

為此,研究者首先使用預訓練的文本到圖像擴散模型、大語言模型 (LLM) 和視覺語言模型 (VLM) 生成并整理出具有所需一致性的圖像集(3.1 節)。

然后,研究者利用這些一致的圖像集對相同的預訓練擴散模型進行微調,并采用新提出的并行處理架構(3.2 節)來創建條件模型。

通過這種方法,擴散自蒸餾以監督的方式將預訓練好的文本到圖像擴散模型微調為零樣本定制圖像生成器。

生成成對數據集

為了創建用于監督擴散自蒸餾訓練的成對數據集,研究者利用預訓練文本到圖像擴散模型的新興多圖像生成功能,生成由 LLM 生成的提示(第 3.1.2 節)所創建的潛在一致的普通圖像(第 3.1.1 節)。然后,研究者使用 VLM 對這些普通圖像樣本進行整理,獲得具有所需身份一致性的干凈圖像集(第 3.1.3 節)。數據生成和整理流程如圖 2 左所示。

并行處理架構

研究者希望有一個適用于通用圖像到圖像任務的條件架構,包括保留結構的轉換以及保留概念 / 特征但不保留圖像結構的轉換。這是一個具有挑戰性的問題,因為它可能需要在不保證空間一致性的情況下傳輸精細細節。

雖然 ControlNet 架構在結構保留編輯(如深度 - 圖像或分割圖 - 圖像)方面表現出色,但在更復雜的身份保留編輯(源圖像和目標圖像不是像素對齊的)中,它卻難以保留細節。

另一方面,IP-Adapter 可以從輸入圖像中提取某些概念,比如風格。但它仍然嚴重依賴于特定任務的圖像編碼器,往往無法保留更復雜的概念和特征。

研究者從多視角和視頻擴散模型的成功經驗中汲取靈感,提出了一種簡單而有效的方法,將普通擴散 transformer 模型擴展為圖像條件擴散模型。

具體來說,他們將輸入圖像視為視頻的第一幀,并生成雙幀視頻作為輸出。最終損失是通過雙幀視頻計算得出的,為第一幀建立了一個身份映射,為第二幀建立了一個條件編輯目標。

如圖 2 右所示,本文的架構設計可實現兩幀之間的有效信息交換,使模型能夠捕捉復雜的語義并執行復雜的編輯,因此可用于通用的圖像到圖像轉換任務。

實驗

在實驗中,研究者使用了 FLUX1.0 DEV 作為教師模型和學生模型,實現了自蒸餾。生成提示使用的是 GPT-4o,數據集整理和字幕制作使用 Gemini-1.5。他們在 8 個英偉達 H100 80GB GPU 上訓練所有模型,有效批大小為 160,迭代次數為 100k,使用 AdamW 優化器,學習率為 10^-4。這里的并行處理架構在基礎模型上使用了秩為 512 的 LoRA。

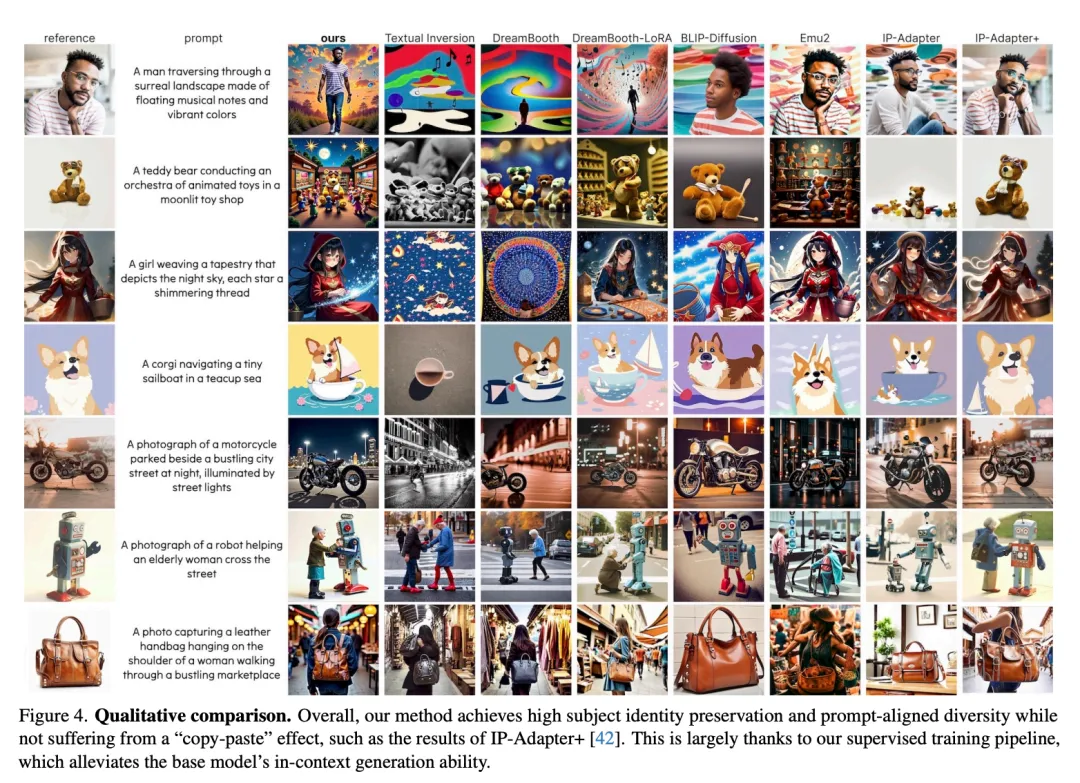

定性評估

下圖 4 展示了定性對比結果,表明本文的模型在主體適應性和概念一致性方面明顯優于所有基線模型,同時在輸出結果中表現出出色的提示對齊性和多樣性。文本反轉法作為一種早期的概念提取方法,只能從輸入圖像中捕捉到模糊的語義,因此不適合需要精確主體適應的零樣本定制任務。

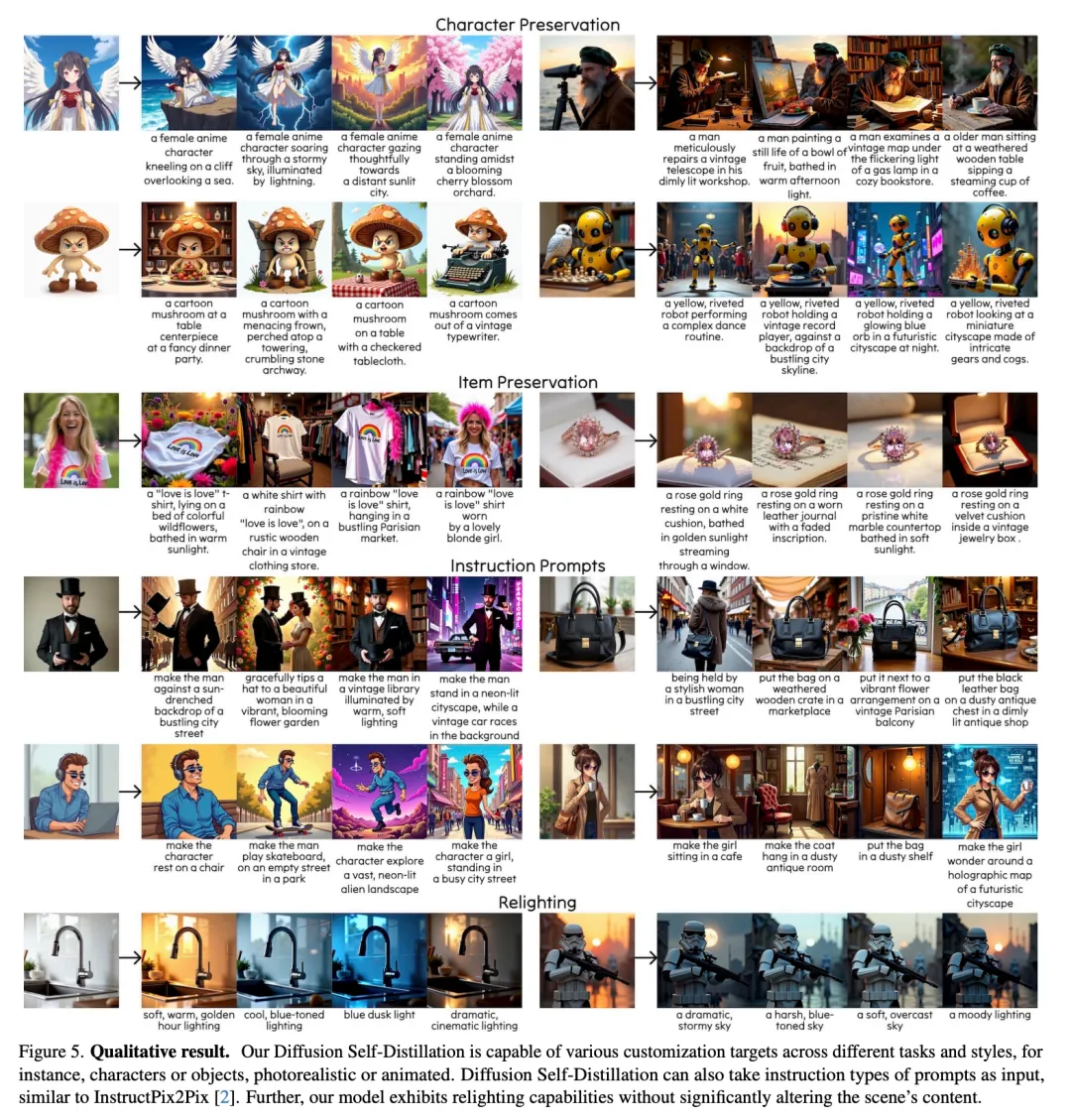

值得注意的是,IP-Adapter+ 使用了更強的輸入圖像編碼器,加劇了這一問題,導致輸出的多樣性和適應性降低。相比之下,本文的方法既能有效地保留主體的核心身份,又能進行多樣化的、與上下文相適應的轉換。如圖 5 所示, 「擴散自蒸餾」技術具有顯著的多功能性,能熟練處理不同目標(人物、物體等)和風格(逼真、動畫等)的各種定制目標。此外,還能很好地概括各種提示,包括類似于 InstructPix2Pix 的指令,凸顯了其在各種定制任務中的魯棒性和適應性。

定量評估

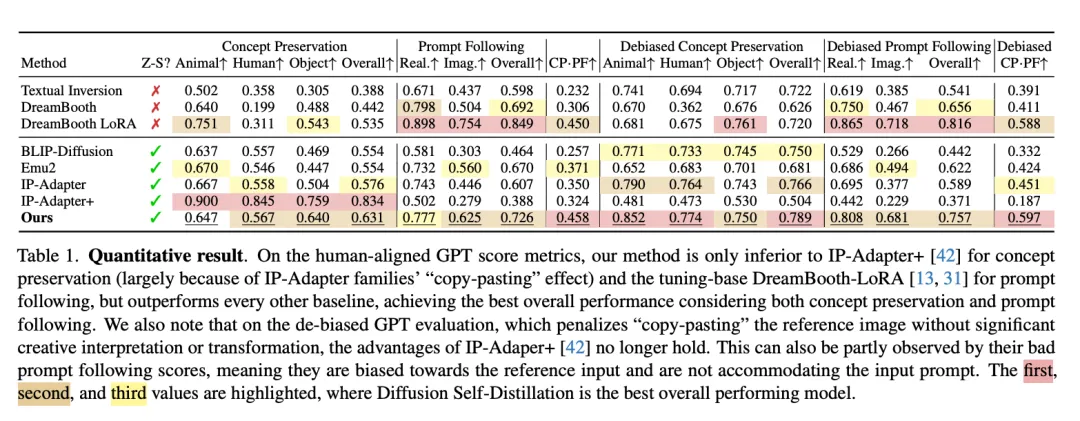

表 1 展示了與基線的定量對比。本文的方法在概念保留和提示跟隨方面都取得了最佳的整體性能,而在前者方面僅遜于 IP-Adapter+ (主要是因為「復制粘貼」效應),在后者方面則遜于按實例調整的 DreamBooth-LoRA。我們注意到,DreamBench++ 的概念保留評估仍然偏向于「復制粘貼」效應,尤其是在更具挑戰性和多樣性的提示上。例如,IP-Adapter 系列之所以在概念保留方面表現出色,主要是因為它們具有很強的「復制粘貼」效果,即在復制輸入圖像時不考慮提示中的相關基本變化。

這在一定程度上也可以從它們表現不佳的提示跟隨得分中看出來,它們偏向于參考輸入,而不考慮輸入提示。因此,研究者也提出了「去偏見」版 GPT 分數,它就像告訴 GPT 如果生成的圖像類似于參考圖像的直接拷貝就進行懲罰一樣簡單。可以注意到,IP-Adaper+ 的優勢已不復存在。總體來說,擴散自蒸餾是其中表現最好的模型。

消融實驗

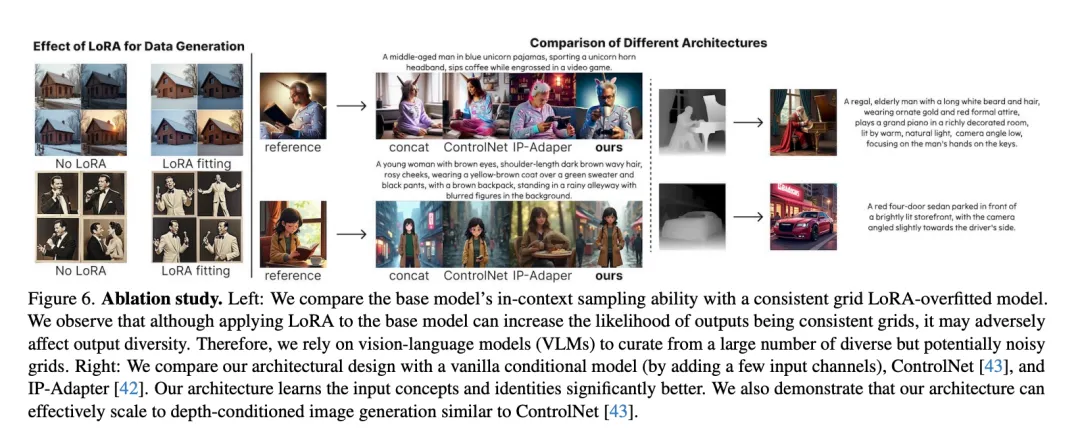

左圖是基礎模型的上下文采樣能力與 LoRA 過擬合模型進行了比較。研究者觀察到,雖然將 LoRA 應用于基礎模型可以增加輸出為一致網格的可能性,但它可能會對輸出多樣性產生不利影響。右圖將本文提出的架構設計與原始條件模型(通過添加一些輸入通道)、ControlNet 和 IP-Adapter 進行了比較,表明本文架構可以更好地學習輸入概念和身份。實驗還證明了本文架構可以有效地擴展到類似于 ControlNet 的深度條件圖像生成。

更多研究細節,可參考原論文。