譯者 | 李睿

審校 | 重樓

隨著人工智能持續推動各行業變革,其在關鍵應用中的作用正在呈指數級增長。然而,隨著這些創新的不斷涌現,人們越來越擔心這一問題——如何保證人工智能系統的安全?與傳統應用程序不同,人工智能處理的是高度敏感的數據、復雜的模型和龐大的網絡,這些數據和網絡并不完全符合傳統安全措施的要求。

傳統的安全模型建立在定義的網絡邊界內的信任假設之上,但在保護人工智能工作流的高度分散性、動態性和敏感性方面顯得力不從心。在人工智能技術的廣泛應用中,敏感數據、復雜模型與分布式系統緊密交織、相互融合。零信任提供了一種主動和全面的安全方法。

本文探討了對人工智能零信任的必要性,指導其應用的基本原則,以及從設計之初就能有效保護人工智能系統的具體策略與實踐方法。

為什么人工智能需要零信任

人工智能系統帶來了獨特的安全挑戰:

- 數據敏感性:人工智能模型在龐大的數據集上進行訓練,這些數據集通常包括敏感信息或專有信息。一旦泄露,可能導致數據外泄或知識產權被盜。

- 模型漏洞:人工智能模型可能容易受到各種風險的影響,例如對抗性攻擊、模型中毒和推理攻擊。

- 分布式生態系統:人工智能工作流通常跨越云計算環境、邊緣計算設備和API,從而增加了攻擊面。

- 動態性:人工智能模型和依賴關系的不斷演變需要自適應的安全措施。

鑒于這些挑戰,實施零信任原則可以確保采取積極主動的方法來保護人工智能系統。

人工智能系統的獨特安全需求

雖然“永不信任,始終驗證”的零信任原則廣泛適用于各種類型的應用程序,但與微服務等更傳統的應用程序相比,為人工智能系統實施零信任帶來了獨特的挑戰和要求。這些差異是由于人工智能工作流、數據敏感性和運營動態的不同性質造成的。以下是主要區別:

- 數據敏感性和生命周期:人工智能系統主要依賴敏感數據集進行訓練和推理。人工智能中的數據生命周期包括攝取、存儲、訓練和部署,每個環節都需要精心保護。

- 模型漏洞:人工智能模型容易受到模型中毒、對抗性輸入和推理攻擊等網絡攻擊。保護這些資產需要關注模型完整性和對抗性防御。

- 分布式生態系統:人工智能工作流跨越云計算、邊緣計算和內部部署環境,使得難以執行一致的零信任策略。

- 動態工作流程:人工智能系統是高度動態的,模型經常被重新訓練、更新和重新部署。這創造了一個不斷變化的攻擊面。

- 可審計性:人工智能的監管合規性涉及跟蹤數據沿襲、模型決策和訓練來源,為零信任增加了另一層安全性和透明度要求。

- 攻擊向量:人工智引入了獨特的攻擊向量,例如在訓練期間毒害數據集,操縱輸入管道和竊取模型知識產權。

人工智能應用零信任的核心原則

人工智能應用程序的零信任建立在以下五個方面上:

1.在每個接入點驗證身份

- 為訪問人工智能資源的用戶和機器實施多因素身份驗證(MFA)。

- 使用基于角色的訪問控制(RBAC)或基于屬性的訪問控制(ABAC)來限制對敏感數據集和模型的訪問。

2.最低訪問權限

- 確保用戶、應用程序和設備具有執行其功能所需的最低訪問權限。

- 根據時間、地點、異常行為等場景動態調整權限。

3.持續監控和驗證

- 對數據流、API使用情況和模型交互進行實時監控。

- 使用行為分析來檢測異常活動,例如模型泄漏嘗試。

4.確保整個生命周期的安全

- 在人工智能管道中對靜止、傳輸和處理過程中的數據進行加密。

- 在集成前驗證和保護第三方數據集和預訓練模型。

5.微分段

隔離人工智能系統的組件(例如訓練環境、推理引擎),以在發生泄露時限制橫向移動。

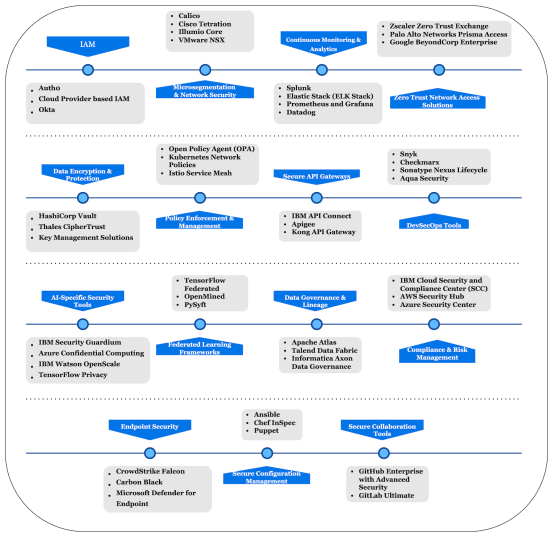

人工智能應用零信任的關鍵組件

1.身份訪問管理(IAM)

- 角色:確保只有經過身份驗證和授權的用戶、設備和服務才能訪問人工智能資源。

- 主要特性:

A.多因素身份驗證(MFA)。

B.使用基于角色的訪問控制(RBAC)或基于屬性的訪問控制來限制對敏感數據集和模型的訪問。

C.針對特定人工智能任務(如訓練、推理或監控)定制的細粒度權限。

2.數據安全和加密

- 角色:保護訓練和推理中使用的敏感數據免受未經授權的訪問和篡改。

- 主要特性:

A.對靜態、傳輸和處理中的數據進行加密(例如,計算的同態加密)。

B.對敏感數據集進行安全數據屏蔽和匿名化處理。

C.用于數據沿襲跟蹤和來源的安全存儲解決方案。

3.模型保護

- 角色:保護人工智能模型免受盜竊、操縱和對抗性攻擊。

- 主要特性:

A.模擬加密和數字簽名以驗證完整性。

B.對抗性訓練,使模型能夠抵御精心設計的輸入。

C.對模型端點進行訪問控制,以防止未經授權的使用。

4.端點和API安全性

?角色:確保人工智能系統與其消費者或依賴關系之間的安全通信。

?主要特性:

A.API認證(例如OAuth 2.0、JWT)和授權。

B.API速率限制和節流以防止濫用。

C.使用TLS加密API通信。

5.零信任網絡架構(ZTNA)

- 角色:實現微分段和嚴格的網絡訪問控制,最大限度地減少攻擊面。

- 主要特性:

A.隔離人工智能環境(例如訓練、開發、推理)以防止橫向移動。

B.持續監察網絡通訊的異常情況。

C.用于混合云或多云設置的網絡加密和安全隧道。

6.持續監測和分析

- 角色:實時檢測和響應潛在威脅或異常行為。

- 主要特性:

A.人工智能驅動的威脅檢測系統,用于分析行為模式。

B.記錄和審計所有訪問和活動,以供取證分析。

C.異常檢測,以識別異常數據流或模型交互。

7.自動化和編排

- 角色:簡化安全執行和事件響應。

- 主要特性:

A.針對檢測到威脅的自動修復工作流程。

B.根據變化的場景(例如時間、地點或行為)動態調整政策。

C.與安全編排、自動化和響應(SOAR)平臺集成。

8.治理和合規

- 角色:確保遵守法規要求和組織政策。

- 主要特性:

A.對數據使用、模型訓練和推理過程進行詳細的審計跟蹤。

B.對GDPR、CCPA或人工智能道德準則等人工智能特定法規的合規性檢查。

C.驗證人工智能決策的透明度機制(例如,可解釋性工具)。

9. DevSecOps集成

- 角色:將安全性嵌入人工智能開發和部署生命周期。

- 主要特性:

A.為人工智能工作流提供安全的持續集成(CI)/持續交付(CD)管道,確保及早發現漏洞。

B.對第三方數據集、預訓練模型和人工智能庫進行漏洞掃描。

C.在部署期間對人工智能模型及其API進行安全測試。

10.邊緣和物聯網安全(如果適用)

- 角色:保護部署在邊緣設備或物聯網系統上的人工智能模型。

- 主要特性:

A.設備身份驗證和安全配置。

B.邊緣設備與中央系統之間的端到端加密。

C.資源受限邊緣環境的輕量級異常檢測。

零信任人工智能的工具和框架

人工智能應用程序的動態性、分布式和敏感性帶來了獨特的安全挑戰。專門為人工智能零信任設計的工具和框架至關重要的原因如下:

- 保護敏感數據:人工智能應用程序處理大量敏感數據,包括個人和專有信息。用于加密和訪問控制的工具有助于保護數據免受破壞和濫用。

- 保護模型免受威脅:人工智能模型容易受到對抗性攻擊、模型盜竊和數據中毒等威脅。專門的工具可以檢測漏洞、強化模型,并在訓練和推理期間確保它們的完整性。

- 管理復雜的生態系統:人工智能工作流跨越云計算、邊緣計算和混合環境,涉及多個利益相關者和系統。用于身份和訪問管理、網絡分段和監控的框架確保了跨分布式生態系統的安全交互。

- 合規性和透明度:由于對人工智能有嚴格的監管要求(例如GDPR、CCPA),這些工具通過在人工智能系統中實施審計跟蹤、加密和可解釋性來幫助確保合規性。

- 增強彈性:通過自動化威脅檢測、持續監控和事件響應,這些工具使人工智能系統對復雜的攻擊更具彈性。

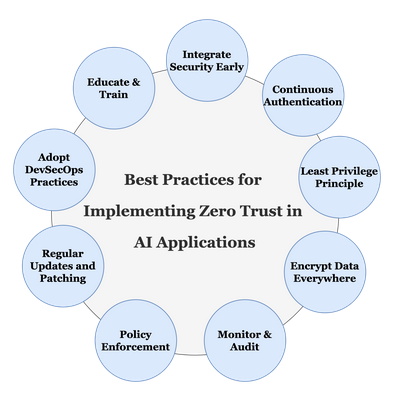

零信任人工智能的最佳實踐

為人工智能應用程序實現零信任需要一種主動和全面的方法來保護人工智能生命周期的每個階段。

以下是基于關鍵安全原則的最佳實踐:

盡早整合安全

- 從開發階段到部署和維護,嵌入安全措施。

- 使用威脅建模和安全優先的設計原則來識別人工智能工作流程中的潛在風險。

持續身份驗證

對訪問人工智能系統的用戶和服務實施多因素身份驗證(MFA)。

使用自適應身份驗證方法,根據場景(例如設備、位置或行為)調整安全性。

采用最小特權原則

將訪問限制在用戶和服務執行其任務所需的最低級別。

定期檢查和更新訪問控制,以限制潛在的攻擊面。

全面加密數據

- 確保在靜止、傳輸和處理過程中對數據進行加密,以保護敏感的人工智能訓練和推理數據。

- 使用同態加密和安全飛地等先進技術進行敏感計算。

監控和審計

- 部署高級監控工具來跟蹤人工智能模型行為和數據訪問模式中的異常情況。

- 維護對數據使用、模型交互和API活動的全面審計跟蹤,以檢測和響應可疑活動。

執行安全策略

- 使用開放策略代理(OPA)等策略引擎,跨微服務、數據管道和人工智能組件執行一致的安全策略。

- 定義和自動執行策略,以確保跨環境的合規性。

定期更新和打補丁

- 持續更新和修補所有軟件組件,包括人工智能庫、模型和依賴項,以減輕漏洞的影響。

- 在CI/CD管道中自動化補丁管理,以簡化流程。

采用DevSecOps實踐

- 將靜態應用程序安全測試(SAST)和動態應用程序安全性測試(DAST)等安全測試集成到CI/CD管道中。

- 使用自動漏洞掃描工具在開發過程的早期識別和解決問題。

教育和培訓團隊

- 定期對開發人員、數據科學家和運營團隊進行零信任原則和人工智能系統安全重要性的培訓。

- 在整個組織中培養一種共同承擔安全責任的文化。

通過遵循這些實踐,組織可以建立一個強大的零信任框架,能夠有效保障人工智能應用免受復雜多變的威脅侵擾,降低風險,并確保遵守監管標準。

結論

隨著人工智能繼續重塑世界,為關鍵應用程序提供動力并推動創新,它也帶來了不容忽視的獨特安全挑戰。敏感數據、分布式工作流以及保護模型完整性的需求需要一種主動和全面的方法——這就是零信任發揮作用的地方。零信任通過專注于持續身份驗證、最小權限訪問和實時監控等原則,為保護人工智能系統提供了堅實的基礎。當與加密管道和模型保護等工具、最佳實踐和組件相結合時,它可以幫助組織更加有效防范威脅。

原文標題:Zero Trust for AI: Building Security from the Ground Up,作者:Josephine Eskaline Joyce,Deepika Kothamasu