解放雙手!OSCAR讓操作系統交互實現自然語言「自由」

本文作者王曉強,加拿大蒙特利爾大學(Université de Montréal)和 Mila 人工智能研究所博士生,師從劉邦教授。博士期間的主要研究方向為自然語言處理,重點關注大語言模型的能力評估及其在智能體中的應用。目前已在自然語言處理領域的頂級會議 ACL、EMNLP 等發表多篇論文。

在人工智能的宏大發展藍圖里,通用人工智能(AGI)堪稱研究者們夢寐以求的 「圣杯」,其終極目標是打造出像人類一樣擁有廣泛且靈活智能的系統,能夠理解、學習并勝任幾乎所有任務。在邁向這個目標的征程中,實現人工智能與數字世界的高效交互至關重要,而桌面任務 UI 自動化更是其中的關鍵賽道。

想象一下,未來我們只需輕松說出指令,電腦就能自動完成各種復雜操作,繁瑣的手動操作成為歷史,工作效率大幅提升,這樣的場景是不是很令人期待?

去年,Anthropic 發布的 Computer use 為 AI 在桌面操作領域帶來了新突破。它允許開發者通過 API,讓 Claude 像人類一樣操作計算機,極大拓展了 AI 在桌面操作領域的應用場景。

今年一月份,OpenAI 重磅推出的 Computer Using Agent(CUA)也備受矚目,其賦能的 Operator 憑借 GPT-4o 的視覺能力,能夠 「看懂」網站并與之交互,還可在 ChatGPT 界面自動執行多種常規瀏覽器任務。

與它們采用商用 API 不同,今天要給大家介紹一個來自加拿大蒙特利爾大學和 Mila 研究所的研究團隊的開源解決方案 ——OSCAR(Operating System Control via state-Aware reasoning and Re-planning)。

OSCAR 不僅實現了桌面任務 UI 自動化,還在多個操作系統環境(桌面 Windows、Ubuntu 和智能手機 Android)完成了泛化與驗證。目前,該研究已被 AI 領域頂級會議 ICLR 錄用。下面,就讓我們深入了解一下它的創新之處。

- 論文題目:OSCAR: Operating System Control via State-Aware Reasoning and Re-Planning

- 論文鏈接:https://arxiv.org/abs/2410.18963

操作系統 UI 交互自動化面臨的挑戰:動態自適應難題

基于多模態大型語言模型(MLLM)的智能體(Agent)在復雜任務自動化領域表現出色,廣泛應用于網絡瀏覽、游戲、軟件開發等場景,但不同應用的觀察和動作空間差異極大,導致智能體通用性差,難以適應復雜工作流。

此外,以往的 UI 交互智能體多在靜態離線的環境中開發,靠視覺問答和預設動作路徑操作,缺乏操作系統實時反饋,任務失敗時無法動態自適應。在現實應用中,實時反饋和自適應調整對適應新的 UI 環境至關重要,比如 「打開某文件并打印」 有多種操作路徑,可通過開始菜單搜索,也能直接導航路徑,但傳統智能體難以應對這種多樣性。

具體構建通用 UI 交互智能體面臨以下挑戰:

- 統一控制接口難題:智能體需熟練運用鼠標、鍵盤等標準輸入方式,精準理解視覺信息并轉化為指令,在不同應用中穩定高效操作。

- UI 定位困境:智能體要能解讀屏幕信息,精準識別各類元素,如網頁搜索時準確找到搜索框并正確交互,對其理解和定位能力要求高。

- 新 UI 探索與重規劃挑戰:智能體需像人類面對陌生軟件一樣,具備動態探索和調整計劃的能力,能處理軟件崩潰等意外,依據反饋優化策略。

OSCAR 的獨特設計:靈活狀態機與動態重規劃的巧妙結合

為解決上述難題,研究團隊推出 OSCAR。它以代碼為核心控制方式,與動態操作系統環境自主交互,創新點如下:

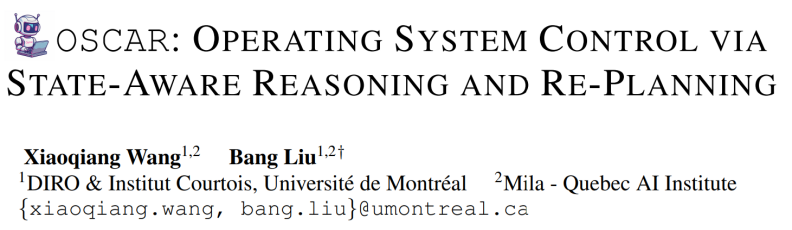

- 狀態機架構:OSCAR 采用狀態機模式,通過 [Init](初始化)、[Observe](觀察)、[Plan](規劃)、[Execute](執行)、[Verify](驗證)等狀態循環,處理任務各環節。遇到問題時利用實時反饋重新規劃,比傳統方式效率更高、適應性更強。

OSCAR 狀態機

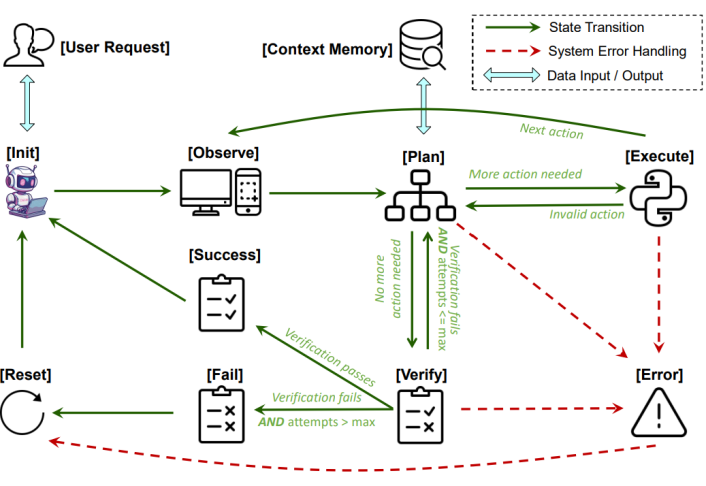

- 視覺和語義雙重 UI 定位:OSCAR 利用 Set-of-Mark(SoM)提示技術和可訪問性(A11Y)樹生成視覺提示,精準定位 UI 元素;同時添加描述性標簽進行語義定位,便于把握 UI 布局,靈活操作元素。

OSCAR 視覺和語義雙重 UI 定位

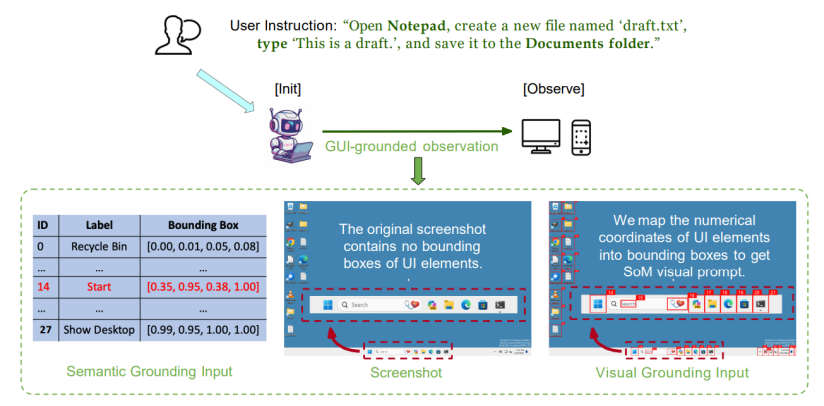

- 任務驅動重新規劃:受計劃 - 解決提示(plan-and-solve)啟發,OSCAR 將用戶指令分解為子任務并逐步生成動作。收到負面反饋時,針對特定子任務重新規劃,避免整體重規劃,提高效率并防止錯誤傳播。

- 基于代碼的動作:OSCAR 借助生成的語義定位信息,利用元素 ID 或坐標引用交互元素,通過 PyAutoGUI 庫生成控制代碼,精確控制操作系統。

OSCAR 任務分解與重規劃

OSCAR 實驗驗證:UI 理解、定位和動態導航能力的實力認證

研究人員在 GAIA、OSWorld、AndroidWorld 等多個真實世界工作流自動化基準測評數據集中對 OSCAR 進行了評估,這些基準涵蓋了不同難度和類型的任務,包括簡單操作、復雜多步驟任務以及跨多種應用的任務。

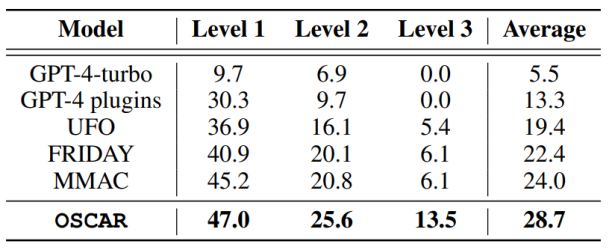

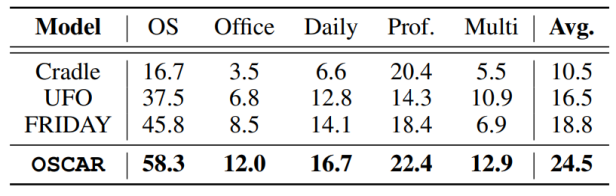

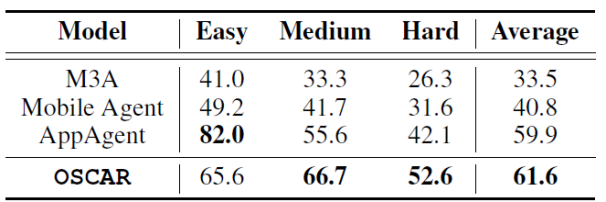

1. 基準測評成績突出:在 GAIA 基準測試中,OSCAR 在所有工作流復雜程度級別上都表現最佳。尤其是在最復雜的 Level 3 任務上,成功率達到 13.5%,幾乎是之前最先進方法的兩倍。在 OSWorld 和 AndroidWorld 基準測評中,OSCAR 同樣超越其他智能體,展現出強大的適應性。

6a. GAIA 基準測評

6b. OSWorld 基準測評

6c. AndroidWorld 基準測評

OSCAR 在基準測評 GAIA, OSWorld 和 AndroidWorld 中取得最好水平

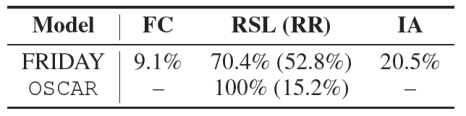

2. 規劃效率優勢顯著:

在成功案例中,OSCAR 成功案例所需重新規劃次數更少,而且每次重新規劃的步驟更高效

在失敗案例中,OSCAR 在錯誤完成(FC)、達到步驟限制(RSL)和無效動作(IA)這些情況中的重新規劃冗余度(RR)明顯低于其他智能體系統

結語:開啟操作系統交互新時代

OSCAR 作為通用智能體,憑借靈活的狀態機和動態的重新規劃能力,在桌面和智能手機操作系統任務中展現出強大的適應性和有效性。它為自動化工作流提供了高效通用的解決方案,有望成為提升動態操作系統環境生產力的有力工具,讓操作系統交互變得更加便捷、高效、易訪問。而且,憑借其開源特性,未來 OSCAR 還將在眾多開發者的共同努力下不斷進化,持續助力通用人工智能與數字世界實現完美交互。