「讓通用機器人成為現實」,谷歌RT-2、PaLM-E作者離職創業,已獲英偉達投資

又一位 DeepMind 高級研究科學家離開了谷歌,創建了自己的初創公司。

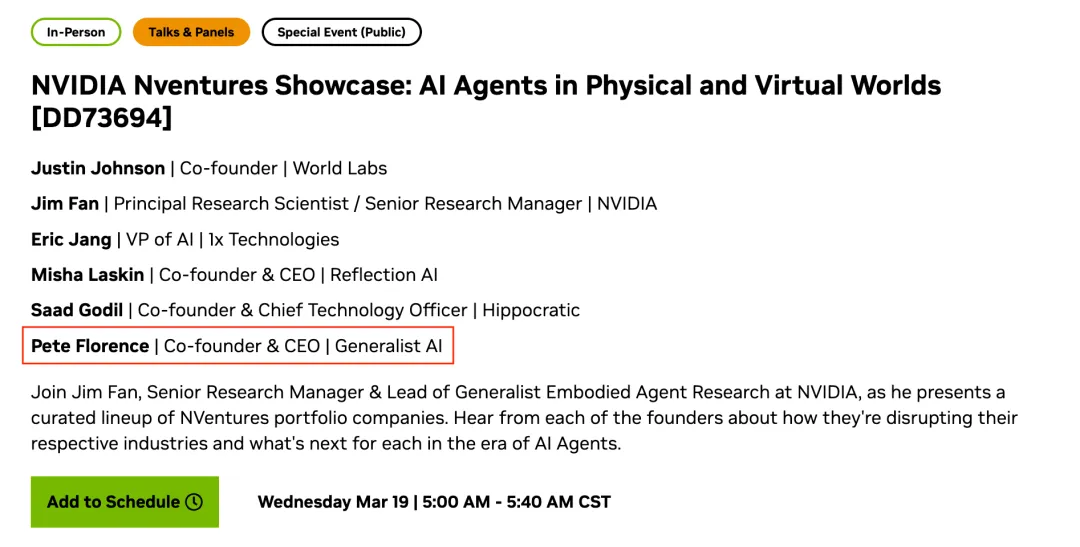

在近日召開的英偉達 GTC 的一個小組討論會上,谷歌 DeepMind 高級研究科學家、RT-2 作者 Pete Florence 以 Generalist AI 聯合創始人兼首席執行官的身份出席。

人工智能浪潮的來臨讓英偉達這家公司獲得了巨大的財務成功,與此同時,NVentures 也成為一家格外活躍的風險投資公司。但目前我們無從得知 Pete Florence 的公司獲得了多少來自英偉達的投資。

「我們基本上仍處于隱秘狀態,」Pete Florence 在 GTC 討論會上表示,暫時無法具體說明自己的初創公司在做什么。但答案也很明顯了,公司將專注于機器人技術。

因為他在回答「如果他的初創公司獲得巨大成功,世界會變成什么樣子」問題時,是這么說的:

「我們的目標是制造能做任何事情的機器人。想象一下,在這個世界上,體力勞動的邊際成本將趨于 0。」

「讓通用機器人成為現實」

Florence 表示,自己創辦這家公司的使命是「讓通用機器人成為現實」。

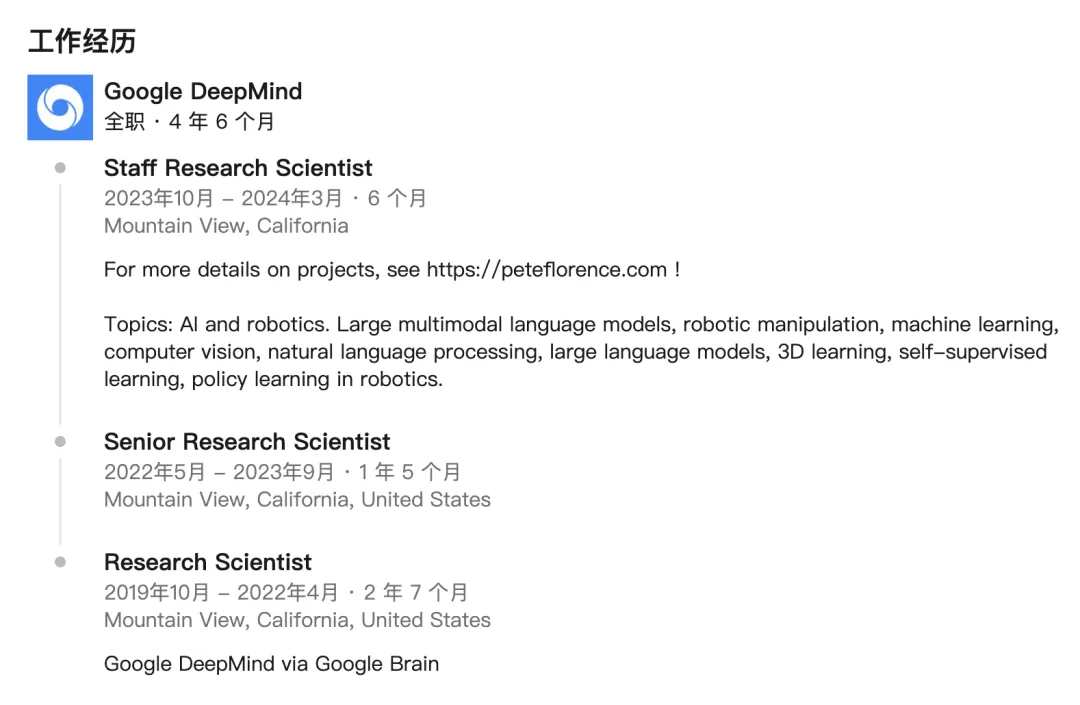

根據其領英個人資料,Florence 一年前離開了 DeepMind。他加入了 DeepMind 前同事的行列 —— 選擇一條喜歡的賽道,創辦自己的公司。

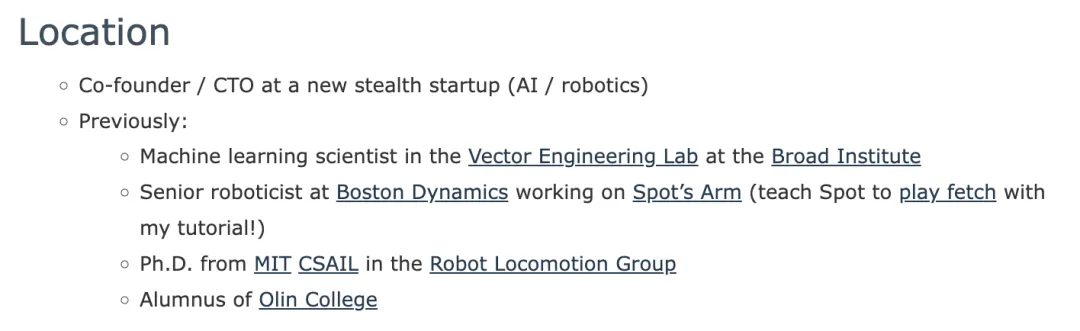

在加入谷歌之前,他在麻省理工學院獲得了計算機科學博士學位,師從 Russ Tedrake。Tedrake 教授在機器人學領域有著顯著的成就和廣泛的影響力,研究領域包括機器人動力學分析、控制器設計和仿真等。

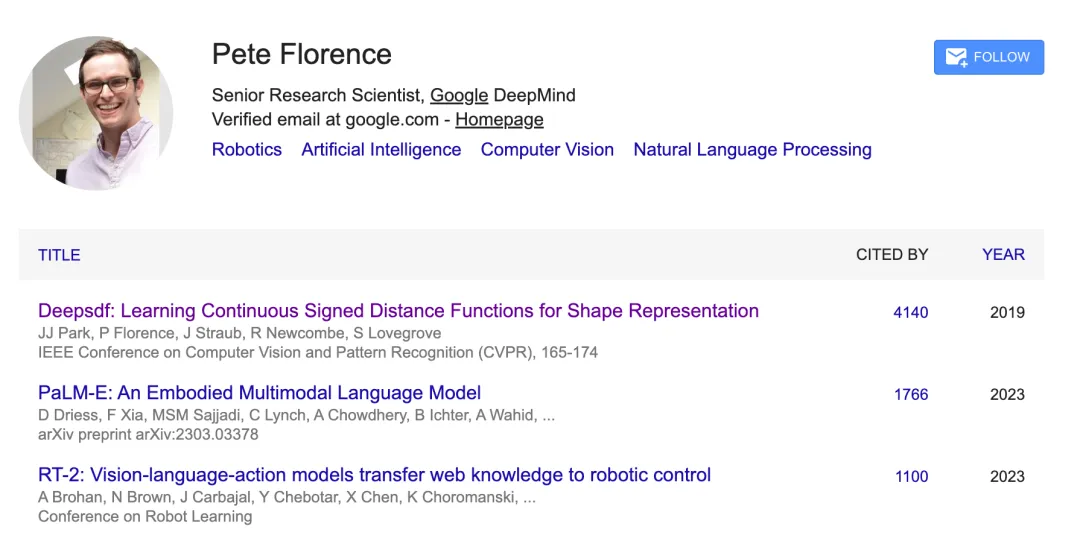

4 年多的谷歌 DeepMind 生涯中,Pete Florence 參與了很多項具備里程碑意義的機器人和大模型研究,其中最具代表性的有 PaLM-E、RT-2。

隨著 GPT-4 等大型語言模型與機器人研究的結合愈發緊密,人工智能正在越來越多地走向現實世界,因此具身智能相關的研究也正受到越來越多的關注。在這一領域,谷歌始終處于比較前沿的位置。

PaLM-E 是一種多模態具身視覺語言模型(VLM),2023 年 3 月發布。該模型集成了參數量 540B 的 PaLM 和參數量 22B 的視覺 Transformer(ViT),使用文本和來自機器人傳感器的多模態數據(比如圖像、機器人狀態、場景環境信息等)作為輸入,輸出以文本形式表示的機器人運動指令,進行端到端的訓練。PaLM-E 實現了對具身任務的決策方案預測,不涉及機器人動作的實際控制,需要依賴低級別的現成策略或規劃器來將決策方案「翻譯」為機器人動作。

RT-2 是全球第一個控制機器人的視覺 - 語言 - 動作(VLA)模型。這個模型讓機器人不僅能解讀人類的復雜指令,還能看懂眼前的物體(即使這個物體之前從未見過),并按照指令采取動作。比如,你讓機器人拿起桌上「已滅絕的動物」。它會抓起眼前的恐龍玩偶。RT-2 被認為是機器人制造和編程方式的重大飛躍。

只需要像對話一樣下達命令,它就能在一堆圖片中辨認出霉霉,并送給她一罐可樂。

這些研究讓谷歌 DeepMind 機器人團隊始終保持著技術領先性,本月,團隊有發布了用于控制機器人的新模型,這些模型的論文中還 4 次引用了 Florence 的成果。

核心團隊來自 OpenAI、波士頓動力、DeepMind

在 Pete Florence 之外,這家公司的其他核心成員都來自知名科技公司。

同為谷歌 DeepMind 機器人團隊前成員的 Kamyar Ghasemipour,也加入了 Generalist AI 成為創始成員。

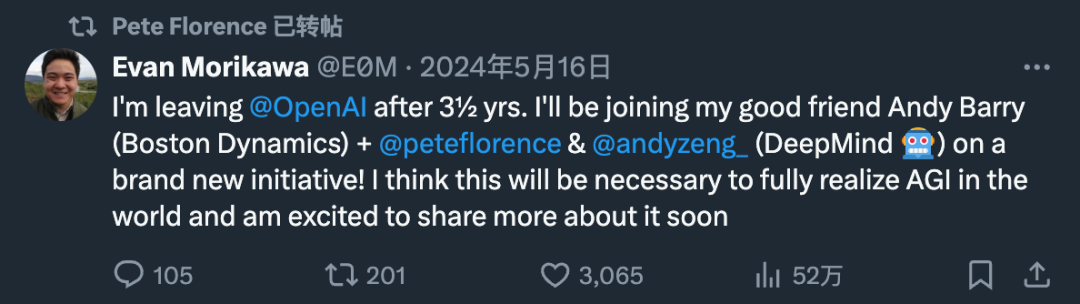

OpenAI 前工程負責人 Evan Morikawa,曾領導過 ChatGPT、GPT-4、DALL?E 和 API 上線,從 OpenAI 離職后加入了這家初創公司。

團隊成員還有前波士頓動力高級機器人科學家 Andrew Barry 和 Deep Mind 研究科學家 Andy Zeng。Andrew Barry 的個人主頁顯示,他擔任的職位是聯合創始人和 CTO。Andy Zeng 的社交媒體則沒有透露更多信息。