突破通用領(lǐng)域推理的瓶頸!清華NLP實驗室強化學習新研究RLPR

余天予,清華大學計算機系一年級博士生,導師為清華大學自然語言處理實驗室劉知遠副教授。研究興趣主要包括高效多模態(tài)大模型、多模態(tài)大模型對齊和強化學習,在 CVPR、AAAI等人工智能領(lǐng)域的著名國際會議和期刊發(fā)表多篇學術(shù)論文,谷歌學術(shù)引用1000余次。

Deepseek 的 R1、OpenAI 的 o1/o3 等推理模型的出色表現(xiàn)充分展現(xiàn)了 RLVR(Reinforcement Learning with Verifiable Reward,基于可驗證獎勵的強化學習)的巨大潛力。

然而,現(xiàn)有方法的應用范圍局限于數(shù)學和代碼等少數(shù)領(lǐng)域。面對自然語言固有的豐富多樣性,依賴規(guī)則驗證器的方法難以拓展到通用領(lǐng)域上。

針對這一關(guān)鍵挑戰(zhàn),清華大學自然語言處理實驗室提出了一項關(guān)鍵性技術(shù) —— 基于參考概率獎勵的強化學習(Reinforcement Learning with Reference Probability Reward,RLPR)。

- 論文標題:RLPR: Extrapolating RLVR to General Domains without Verifiers

- 論文地址:https://github.com/OpenBMB/RLPR/blob/main/RLPR_paper.pdf

- GitHub 倉庫:https://github.com/OpenBMB/RLPR

這項技術(shù)通過 Prob-to-Reward 方法顯著提高了概率獎勵(Probability-based Reward, PR)的質(zhì)量,相比基于似然度的基線方法取得了明顯更佳的性能優(yōu)勢和訓練穩(wěn)定性。

同時,RLPR 提出基于獎勵標準差的動態(tài)過濾機制,進一步提升強化學習的穩(wěn)定性和性能提升。目前 RLPR 相關(guān)代碼、模型、數(shù)據(jù)、論文均已開源。

PR 為何有效?挖掘模型的內(nèi)在評估

研究團隊觀察到,大語言模型(LLM)在推理過程中對于參考答案的生成概率直接反映了模型對于本次推理的質(zhì)量評估。也就是說,模型的推理越正確,其生成參考答案的概率通常就越高。

在論文中,研究團隊給出了一個具體示例:當模型在輸出 o2 中錯誤地把選項 A 排在了第二位時,可以觀察到參考答案在第二個正確選項位置上的生成概率出現(xiàn)了顯著下降。這一現(xiàn)象清晰地表明,PR 能夠精準捕捉模型對于自身推理質(zhì)量的判斷,并且與模型推理的正確性表現(xiàn)出高度相關(guān)性。

PR 示例,更深的顏色代表更大的輸出概率

RLPR 核心特點

領(lǐng)域無關(guān)的高效獎勵生成

現(xiàn)有 RLVR 方法通常需要投入大量的人力和工程資源,為每個領(lǐng)域編寫特定的驗證規(guī)則,相比之下,RLPR 僅需要簡單的一次前向傳播(forward pass)就可以生成獎勵分數(shù)。通過使用參考答案的生成概率均值作為獎勵。這種方法能夠有效地應對自然語言固有的復雜多樣性。

如下圖所示(右側(cè)示例),基于規(guī)則匹配的方式無法識別出 y2 和 y3 和參考答案語義等價,而 RLPR 的 PR 機制準確地給予了這兩個答案更高的分數(shù)。

RLPR 與現(xiàn)有 RLVR 范式的對比

獎勵糾偏和動態(tài)過濾

基礎(chǔ)的 PR 已經(jīng)呈現(xiàn)出和回答質(zhì)量很高的相關(guān)性,但是仍然受到問題和參考答案風格等無關(guān)因素的干擾(即存在偏差)。為此,研究團隊提出構(gòu)建一個不包含思維鏈過程(z)的對照獎勵,并通過做差的方式去除無關(guān)因素對于分數(shù)的影響,實現(xiàn)獎勵糾偏。

傳統(tǒng)基于準確率(Accuracy Filtering)的樣本過濾方法難以適用于連續(xù)的 PR 值。RLPR 提出基于獎勵標準差的動態(tài)過濾機制,保留那些取得較高獎勵標準差的樣本用于訓練,有效提升了訓練的穩(wěn)定性和效果。考慮到訓練過程中獎勵的標準差會持續(xù)變化,RLPR 進一步采用指數(shù)移動平均(EMA)的方式持續(xù)動態(tài)更新過濾閾值。

可靠的獎勵質(zhì)量和框架魯棒性

研究團隊通過 ROC-AUC 指標定量評估了不同來源獎勵的質(zhì)量。結(jié)果表明,PR 在 0.5B 規(guī)模即取得了顯著優(yōu)于規(guī)則獎勵和驗證器模型獎勵的質(zhì)量。同時,通用領(lǐng)域獎勵質(zhì)量隨著模型能力的增強可以進一步提高到 0.91 水平。

PR 獎勵質(zhì)量優(yōu)于規(guī)則獎勵和驗證器模型獎勵

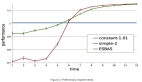

為了驗證框架的魯棒性,研究團隊使用多種不同的訓練模板結(jié)合 RLPR 訓練 Qwen2.5 3B 模型,并觀察到 RLPR 在不同訓練模板上都可以取得穩(wěn)定的性能提升。

RLPR 對不同訓練模板的魯棒性

研究團隊還進一步在 Gemma、Llama 等更多系列的基座模型上進行實驗,驗證 RLPR 框架對于不同基座模型均可以穩(wěn)定提升模型的推理能力,并超過了使用規(guī)則獎勵的 RLVR 基線。

RLPR 在 Gemma、Llama、Qwen 等不同基座模型上均穩(wěn)定提升推理能力

總結(jié)

RLPR 提出了創(chuàng)新的 Prob-to-Reward 獎勵機制,解決了現(xiàn)有 RLVR 范式的領(lǐng)域依賴問題。通過在 Gemma、Llama、Qwen 等主流模型系列上的廣泛驗證,RLPR 不僅證明了其卓越的有效性和相對于傳統(tǒng)規(guī)則獎勵的顯著優(yōu)勢,更在推動強化學習(RL)向更大規(guī)模(scaling)發(fā)展的道路上,邁出了堅實而有力的一步。

更多研究細節(jié),可參考原論文。