揭秘神秘的種子:Adobe聯合賓夕法尼亞大學發布文本到圖像擴散模型大規模種子分析 精華

文章鏈接:?https://arxiv.org/pdf/2405.14828??

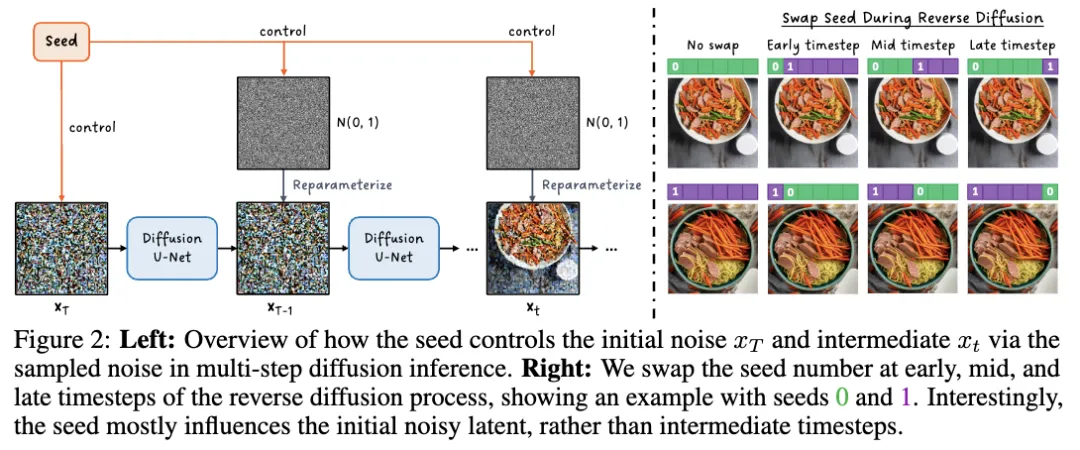

最近對文本到圖像(T2I)擴散模型的進展促進了創造性和逼真的圖像合成。通過變化隨機種子,可以為固定的文本提示生成各種圖像。在技術上,種子控制著初始噪聲,并且在多步擴散推理中,在反向擴散過程的中間時間步驟中用于重參數化的噪聲。然而,隨機種子對生成的圖像的具體影響仍然相對未知。

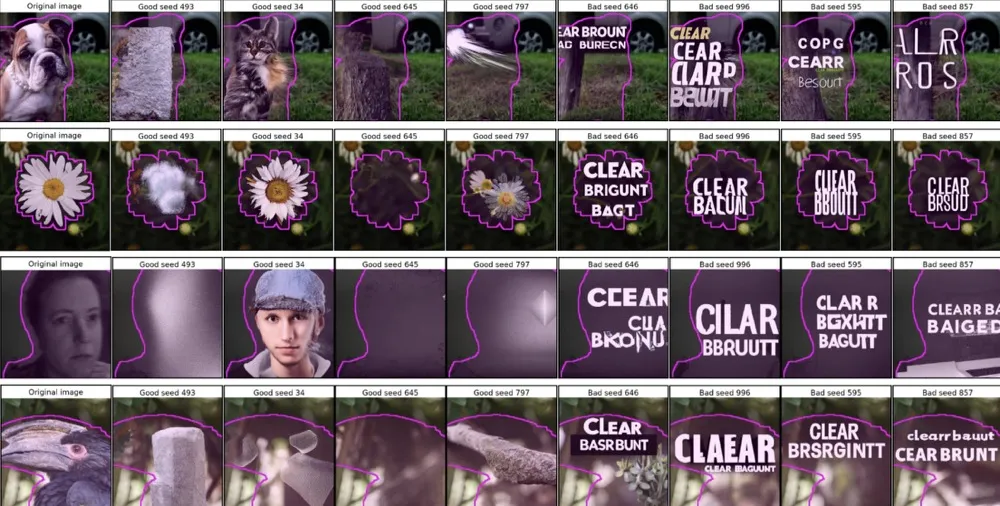

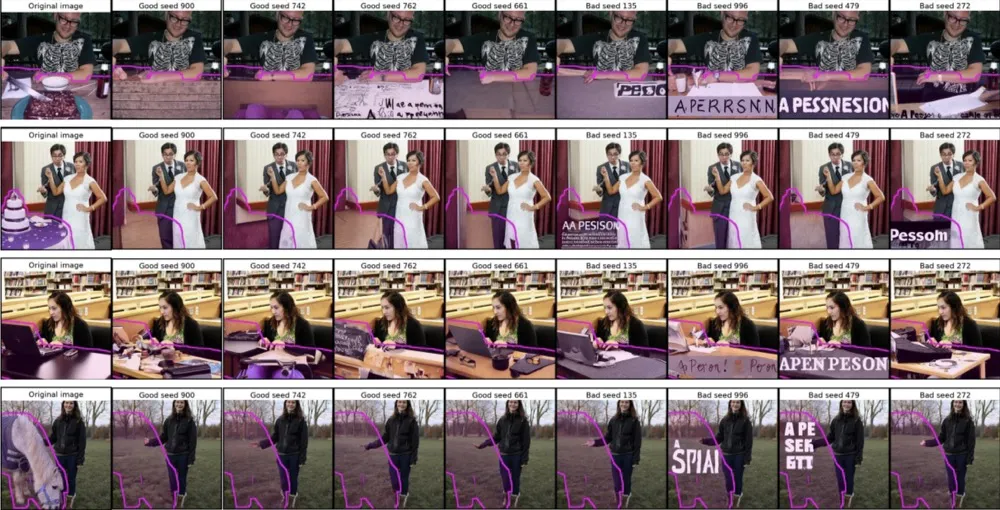

在這項工作中,進行了大規模的科學研究,探討了擴散推理過程中隨機種子的影響。值得注意的是,研究者發現最佳的“黃金”種子的FID達到了令人印象深刻的21.60,而最差的“劣質”種子的FID為31.97。此外,分類器可以在幾個時代內以超過99.9%的準確度預測用于生成圖像的種子編號,表明基于生成圖像,種子是高度可區分的。受到這些發現的鼓舞,本文研究了種子對可解釋的視覺維度的影響,發現某些種子會一致地生成灰度圖像、突出的天空區域或圖像邊界。種子還會影響圖像的構成,包括對象的位置、大小和深度。此外,通過利用這些“黃金”種子,展示了改進的圖像生成,如高保真推理和多樣化的采樣。本文的調查還涉及修補任務,發現一些種子傾向于插入不需要的文本偽影。總的來說,廣泛分析凸顯了選擇良好種子的重要性,并為圖像生成提供了實用的實用性。

好壞種子的對比

介紹

文本到圖像(T2I)擴散模型已經顯著推動了圖像合成,使得可以創建逼真的、高分辨率的圖像。然而,它們的訓練需要大量的計算資源,限制了這種研究只能在一些設備齊全的實驗室進行。盡管存在這些限制,許多研究通過特征重新加權、基于梯度的引導或與多模式LLMs的集成等方法增強了推理過程中的圖像生成。

這項工作提出了一種推理技術,通過探索逆擴散過程中的“秘密種子”來增強圖像生成。受到Torch.manual_seed(3407)等研究的啟發,該研究揭示了精心選擇的神經網絡初始化種子在圖像分類中可以優于選擇不當的種子,調查了在T2I擴散推理中是否“黃金”或“劣質”種子同樣會影響圖像質量。令人驚訝的是,使用預訓練的流行T2I模型 Stable Diffusion (SD) 2.0,在1,024個種子上進行實驗,發現最佳的“黃金”種子的FID達到了21.60,而最差的“劣質”種子只達到了31.97 ——這在社區中是一個顯著的差異。這一發現引發了我們對幾個科學問題的好奇:種子在T2I擴散推理中控制什么?為什么隨機種子如此重要?種子可以通過生成的圖像進行區分嗎?它們是否控制可解釋的圖像維度,如果是,如何利用這一點來增強圖像生成?

為了回答這些研究問題,首先研究了隨機種子如何控制初始的噪聲潛變量以及逆潛變量擴散過程中每個中間時間步的高斯噪聲。研究者們還使用兩個T2I擴散模型(傳統的多步 SD 2.0 和蒸餾的單步 SDXL Turbo)構建了一個數據集。這個數據集包括超過22,000個多樣化的文本提示,并且對于每種模型和提示的組合,使用1,024個唯一的固定種子,結果大約有4600萬張圖像。

最初的目標是確定每個隨機種子是否在生成的圖像中編碼了可識別的獨特特征。為了測試這一點,研究者們訓練了一個1,024路分類器,從不同的提示中生成的圖像中預測擴散推理時使用的種子編號。值得注意的是,這個分類器在只經過六個時代的情況下就達到了超過99.9%的驗證準確率,這與大約0.01%的隨機猜測概率形成了鮮明對比,表明基于生成的圖像種子是高度可區分的。

在確認了種子的可區分性后,本文的目標是了解是否存在任何可解釋的感知維度,使得這種區分成為可能。下一步是設計一個流水線來提取風格和布局表示,對可見聚類應用降維技術,然后識別出不同種子之間的一致模式,而不考慮輸入提示。例如,某些種子一致地生成“灰度”圖像,其他種子在頂部生成具有突出的白色“天空”區域的圖像,而某些種子則創建圖像邊框或在修補模式下插入“文本”。就圖像布局而言,各種種子一致地影響主要對象的規模、位置和深度。有關這些發現的詳細信息。

基于從種子分析中的這些發現,提出了幾種下游應用來增強圖像生成。首先,通過識別各種提示中的“黃金”種子,可以將采樣限制為前K個種子,以進行高保真推理。與默認實現中的隨機采樣相比,這種方法表現出更好的定量性能,如FID和HPS v2的測量結果。其次,發現表明,某些種子捕獲了不同的風格或布局組合。通過利用這一知識,可以基于風格或布局實施多樣化的采樣,為用戶提供不同的結果。最后,在圖像修補方面的研究表明,某些種子一致地生成“文本偽影”,而不是完成像素,這表明可以通過使用最小化這些偽影的種子來改善基于文本的修補模型的修補質量。請注意,對于所有這些應用,只需要針對每個模型執行一次種子分析,本文的方法可以輕松集成到推理過程中,而不需要增加任何計算開銷,這與大多數基于優化的方法不同。

本文的貢獻如下:

- 首次對文本到圖像擴散模型進行了大規模種子分析,并構建了一個包含超過4600萬張圖像的數據集,這些圖像來自兩種T2I擴散模型,跨越了各種不同的文本提示。

- 發現種子編碼了高度可區分的信息,使得一個分類器能夠輕松地從1,024個可能的種子中預測出用于擴散推理的種子編號,驗證準確率達到了超過99.9%。

- 發現種子在圖像質量、風格、布局組合以及文本修補模型的“文本偽影”生成等方面具有顯著影響。

基于從種子分析中得到的見解,提出了幾種下游應用,可以增強文本到圖像模型的高保真推理或多樣化推理,以及通過避免“文本偽影”來提高圖像生成質量的修補模型。

這些結果對于深入理解T2I擴散模型的工作原理以及改進圖像生成的實用性都具有重要意義。

相關工作

深度學習模型中的隨機性。先前的研究主要探討了由隨機初始化權重、隨機數據排序和隨機優化引起的神經網絡訓練中的隨機性。值得注意的是,Picard等人在CIFAR-10數據集上發現了最佳和最差種子之間1.82%的測試準確率差異,突顯了種子對模型性能的重大影響。受到這些發現的啟發,我們探索了T2I擴散模型中反向擴散過程中的隨機性。

擴散模型輸入的影響。預訓練的文本到圖像擴散模型產生的圖像的主要變化源于文本提示和控制初始噪聲的隨機種子。因此,精心選擇這些模型輸入可以在推理過程中增強圖像生成和編輯,而無需進行額外的模型訓練或微調。一些研究專注于理解文本嵌入對生成的圖像的影響,或者利用這些文本嵌入進行無調優的圖像生成。例如,Yu等人發現,T2I擴散模型中常用的CLIP文本嵌入包含多樣化的語義方向,有助于可控的圖像編輯。

此外,最近的研究表明,初始噪聲可能導致某些圖像生成傾向。特別是,Po-Yuan等人證明,對初始噪聲進行輕微擾動可以大幅改變擴散模型生成的樣本。然而,初始噪聲對輸出圖像的各種視覺維度的影響程度尚不清楚。因此,對隨機種子對生成圖像質量、人類偏好對齊、風格、構圖以及“文本偽影”插入的影響進行了廣泛的分析。

擴散模型中初始噪聲的優化。鑒于種子對T2I擴散模型生成的圖像產生的重大影響,先前的研究旨在優化初始噪聲,以產生與文本提示更符合、減少視覺偽影或實現期望布局的圖像。例如,Mao等人發現,初始噪聲的某些區域更有可能噪聲消除成特定概念,使他們能夠通過簡單地替換初始噪聲的區域而接近圖像編輯,而無需進行微調或干擾反向擴散過程。雖然他們的工作集中在對初始噪聲的局部分析,但我們的研究提供了對控制初始噪聲的隨機種子在各種文本提示下的大規模研究。

了解擴散種子

種子在逆擴散過程中控制什么?

在深度學習中,隨機種子根據上下文扮演不同的角色。在深度網絡訓練過程中,它們通常影響神經網絡權重的初始化、數據調度、數據增強策略以及隨機正則化技術,如dropout。本工作旨在了解種子在逆擴散過程中和擴散推理過程中控制什么。

我們專注于由Rombach等人描述的潛在擴散模型,盡管相同的原理也適用于像素擴散模型。理論上,在傳統的多步逆擴散過程中,每個時間步長的初始噪聲潛變量和重新參數化時使用的噪聲都是從高斯分布中采樣得到的,引入了隨機性。下圖2的左側可視化了這個過程。在實現層面上,我們確認隨機種子被用作計算這些變量的輸入。

在蒸餾的單步擴散模型(如SDXL Turbo)中,隨機種子僅確定了初始噪聲潛變量,因為沒有中間去噪步驟。在多步擴散推理中,種子確定了每個時間步長的初始潛變量和重參數化噪聲。為了理解初始潛在配置和重參數化步驟對生成的圖像的分離影響,我們進行了一個簡單的“種子交換”研究,使用了40個推理步驟的DDIM調度器。在我們的研究中,我們首先將種子設置為i并開始逆擴散過程。然后,在一個中間時間步長,我們將種子更改為j并完成圖像生成過程。我們探索使用種子0和1作為i和j,以及在逆擴散過程的早期、中期和晚期交換種子。盡管存在這些變化,但我們發現初始噪聲潛變量顯著控制著生成的內容,而在中間的重新參數化步驟引入的隨機噪聲對生成的圖像沒有明顯影響,如上圖2的右側所示。

數據生成

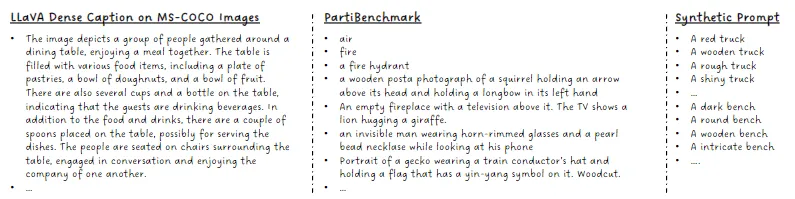

為了進行大規模的種子分析,研究者們使用了三種類型的文本提示進行文本到圖像(T2I)生成,如下圖3所示。

首先,為了捕獲廣泛的自然視覺內容,從常用的MS-COCO 2017訓練集中采樣了20,000張圖像,并使用LLaVA 1.5生成了密集的標題。其次,利用PartiPrompts基準測試中的1,632個提示,其中包括短和長的通用用戶提示。最后,為了進行更加受控的科學研究,通過將40個對象類別與22個修飾詞組合,生成了880個唯一組合的合成提示。

針對數據集中的每個提示,采樣了1,024個種子,并使用兩種T2I模型,SD 2.0和SDXL Turbo,進行大規模種子分析的圖像生成。這導致了總數為22,512個提示×1,024個種子×2個模型=46,104,576張圖像。

除了文本到圖像的應用之外,還為擴散修補模型策劃了500對圖像和mask,其中mask通常覆蓋原始圖像中的一個對象。對于文本提示,我們使用“清晰背景”來模擬對象移除的用例,并使用原始對象類別來模擬對象完成的用例。

種子根據生成的圖像有多具有辨別力?

作為一個初步實驗,檢查種子是否可以通過它們生成的圖像來區分。研究者們訓練了一個1,024路的分類器,以預測生成給定圖像所使用的種子編號,每個種子采用9,000張訓練圖像、1,000張驗證圖像和1,000張測試圖像。

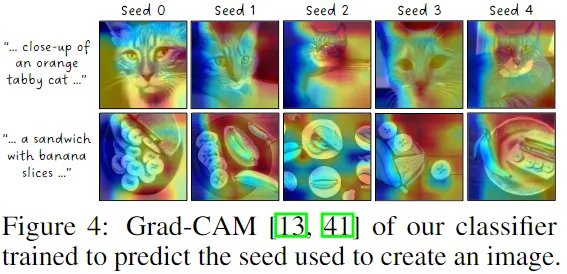

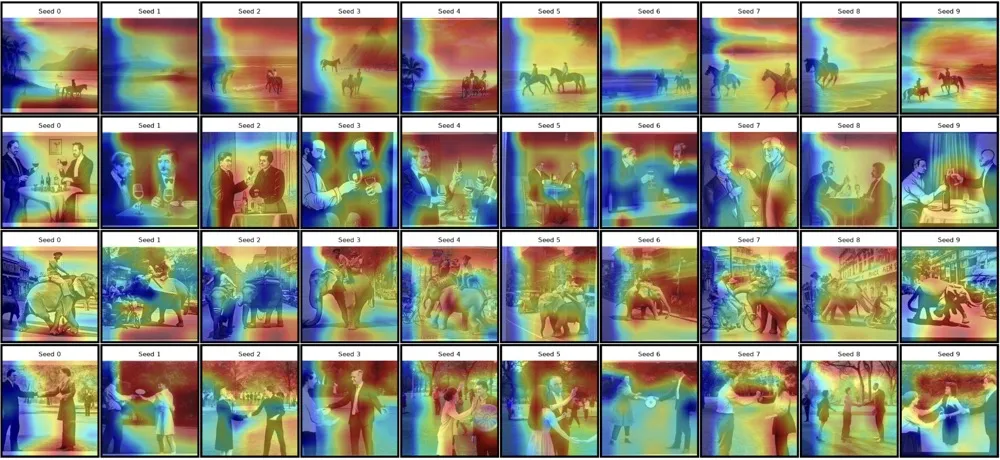

值得注意的是,種子根據它們的圖像是高度可區分的。僅經過六個epoch,在SD 2.0上訓練的分類器的測試準確率達到了99.994%,而在SDXL Turbo上訓練的分類器的測試準確率達到了99.956%。然而,目前尚不清楚是什么使得種子容易被區分,因為下圖4中的Grad-CAM可視化并不容易解釋。這些發現表明,種子可能編碼了獨特的視覺特征,促使我們探索它們在幾個可解釋的維度上的影響。

種子對可解釋視覺維度的影響

我們觀察到一個經過訓練以預測生成圖像所使用的種子的分類器,在訓練幾個時期后就能達到超過99.9%的準確率。然而,目前尚不清楚生成圖像的哪些方面使得這些種子能夠被高度區分。因此,展示了一項關于種子編號對可解釋視覺維度影響的廣泛實證研究。

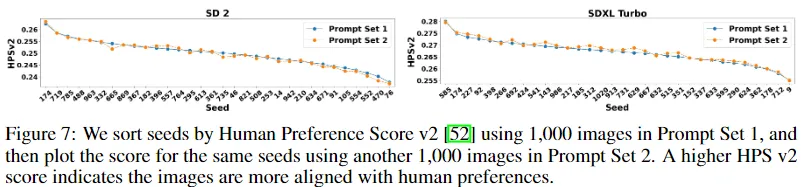

圖像質量和人類偏好一致性。研究者們使用了來自MS-COCO密集標題的20,000個提示。對于每個提示,使用1,024個種子生成圖像。為了評估與每個種子相關的圖像質量,選擇了10,000個提示及其相應的生成圖像,然后計算了與10,000個真實MS-COCO圖像的FID分數。

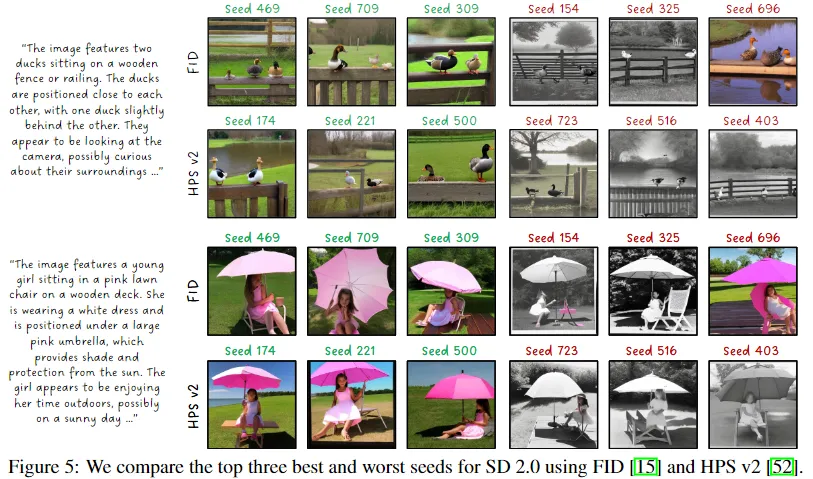

令人驚訝的是,觀察到了最佳和最差種子之間在FID分數上的顯著差異。例如,對于SD 2.0來說,“黃金”種子469取得了低至21.60的FID,而“劣質”種子696得分為31.97——這在社區內被認為是顯著的差異。此外,研究這門使用了HPS v2來評估種子,這是一種在大規模人類偏好對中訓練的新指標,用于量化人類對由AI生成的圖像的偏好程度。對于每個種子,采樣了1,000個提示及其相應的圖像來計算HPS v2。正如下圖5所示,根據FID和HPS v2排名的前三和后三名種子確實顯示出,評分最高的種子生成的圖像更具視覺吸引力,并且與人類偏好更為一致。

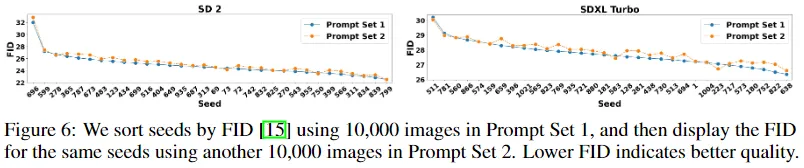

接下來,確定這些種子排名是否可以推廣到另一組10,000個提示的FID和1,000個提示的HPS v2。在下圖6和圖7中,繪制了使用來自SD 2.0和SDXL Turbo的圖像的FID和HPS v2排名的種子。

比較了來自第一組提示(藍色中的“提示集1”)的得分與來自另一組提示(橙色中的“提示集2”)的得分。研究者們揭示了在質量和人類偏好方面的種子模式的高度重疊性,表明它們確實適用于提示集合之間。

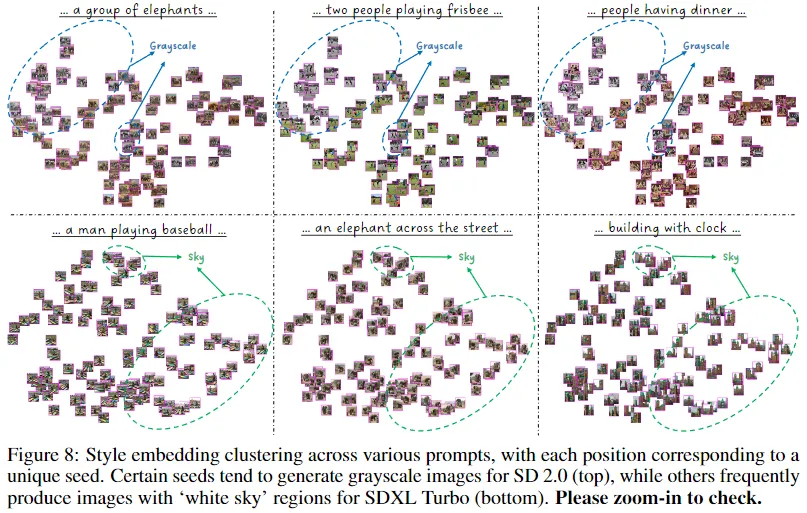

圖像風格。鑒于使用不同種子生成的圖像存在視覺變化,調查是否特定的種子在各種提示下始終產生獨特的風格模式。借鑒圖像紋理和風格轉移中已建立的方法,通過從預訓練的深度網絡中提取格拉姆矩陣(衡量通道間成對余弦相似度)來計算風格表示,涵蓋多個層次。接下來,我們將格拉姆矩陣重塑為每個圖像的單列向量,并使用PCA和t-SNE將其降維到二維。

現在,對于每個圖像,有一個緊湊的二維向量來捕獲其風格。對于N = 1024個種子和P個提示,這導致了一個特征維度為N×(2×P),將每個種子的生成圖像的風格表示合并在一起。我們進一步將每個種子的聚合風格表示從N×(2×P)降維到N×2。最后,下圖8中顯示了一部分種子在2D中的可視化,提供了種子級別的風格聚類的清晰可視化表示。

在圖8中,embedding空間內的位置對應于各個子圖中的相同種子。如第一行所示,某些種子組始終生成灰度圖像,而不受使用的提示的影響。同樣,第二行顯示了一些種子傾向于生成具有突出天空區域的圖像,而其他種子則不會。

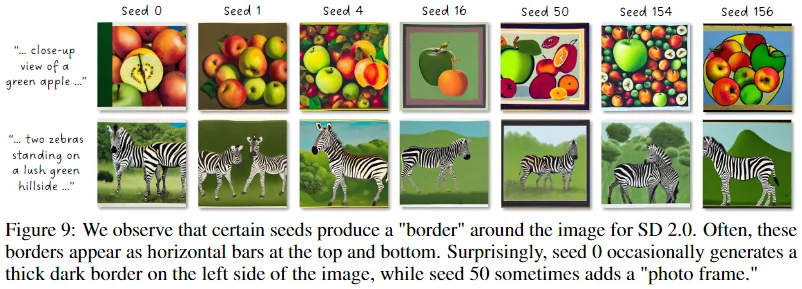

此外,在下圖9中,觀察到一組特定的種子始終在邊緣附近生成具有“邊框”效果的圖像,而不受文本提示的影響。總的來說,這些發現表明,不同的種子在生成風格時表現出不同的傾向,而這種差異在不同的提示下仍然存在。

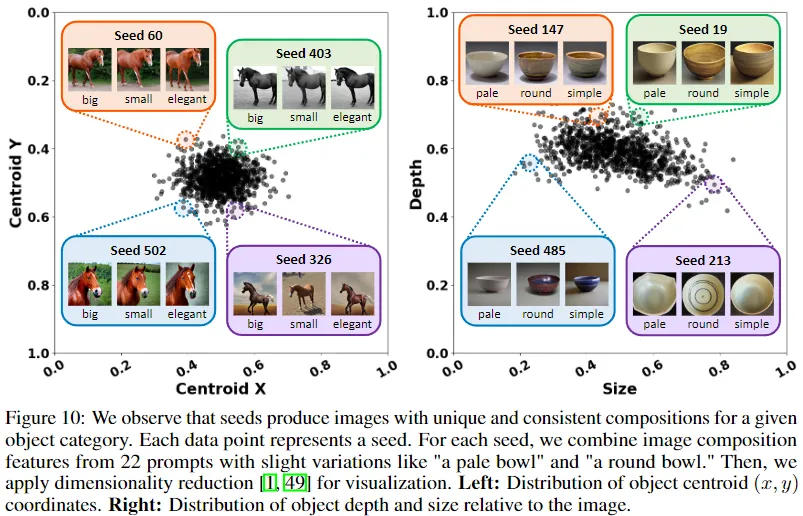

圖像構圖。超越風格,研究種子是否創建了獨特的圖像構圖,例如一致的對象位置和大小。這里使用了880個合成提示生成圖像,其中包括40個對象類別和22個修飾語,其中包括形容詞和空字符串。對于每個圖像,分割對象并計算圖像構圖特征向量,其中包含對象的質心(x,y)坐標,大小和相對于圖像的深度。

在下圖10的左側,可視化了類別“馬”的對象mask的質心分布。值得注意的是,盡管提示略有變化,但對象的位置相對穩定。在圖10的右側,觀察到了類別“碗”的對象大小和深度的類似模式。總體而言,觀察到生成的對象的位置,大小和深度在很大程度上取決于所使用的特定種子,無論是相同的對象類別還是提示中的文本修飾符。

實際應用

高保真推理

觀察到“黃金”種子傾向于生成質量更好且與人類偏好更加一致的圖像。這啟發思考——相對于隨機生成,能夠通過簡單利用這些“黃金”種子來提高多少圖像質量?

具體而言,確定了k個在圖像質量和人類偏好對齊方面表現出色的“黃金”種子。隨后,通過使用另一組10,000個提示來生成這k個“黃金”種子的圖像,以評估它們相對于隨機種子的性能。確定了SD 2.0的k = 65個“黃金”種子和SDXL Turbo的k = 67個“黃金”種子,其中k是通過選擇在FID和HPS v2中排名前256位的種子來確定的。

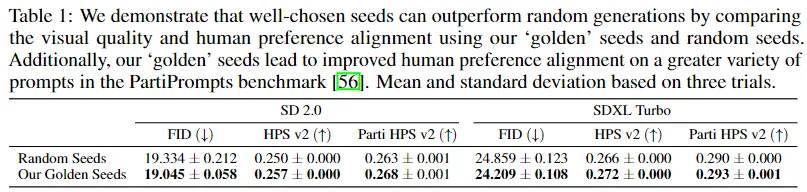

建議在實際應用中,為單個提示選擇60+個“黃金”種子的采樣池是足夠大的。如下表1所示,利用這些精心選擇的種子顯著提高了SD 2.0和SDXL Turbo在MS-COCO和PartiPrompts基準測試中的FID和HPS v2得分。

風格和構圖中的可控多樣性

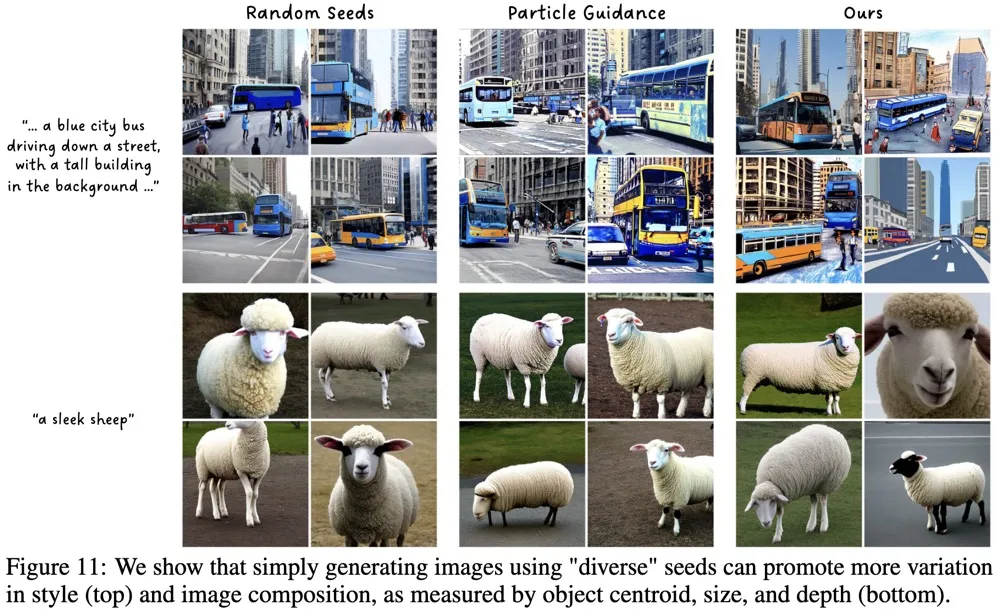

典型的圖像生成界面為用戶每個提示提供四個樣本。此外,先前的方法旨在通過主要使用基于梯度的方法(例如Particle Guidance)來促進生成圖像的多樣性。結果突顯了種子選擇對生成圖像中的風格和空間屬性具有很強的影響。因此,探索是否可以通過簡單地對“多樣”種子進行采樣來獲得風格或構圖方面更多樣化的圖像。

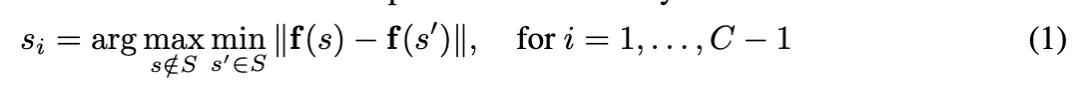

為了每個提示選擇四個不同的種子,使用討論中的方法,將每個種子表示為捕捉其風格或構圖的特征向量。然后,使用這些特征進行最遠點采樣。具體來說,隨機選擇第一個種子,然后迭代地選擇下一個三個種子,以最大化在特征空間中與已選擇種子的距離。

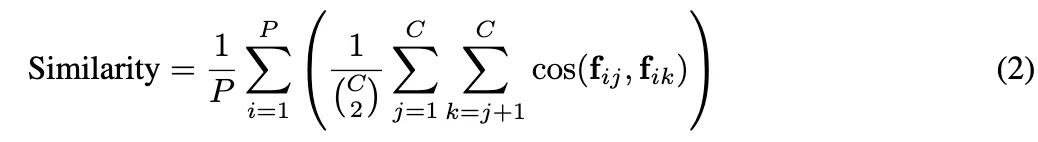

其中S是多樣種子集。為了評估精心選擇的種子是否比隨機種子和Particle Guidance 改進了多樣性,研究者們計算了從不同集合的P個提示生成的圖像的相似性,其中P = 500 LLaVA 密集標題用于圖像風格,P = 440合成提示用于圖像構圖。具體來說,測量圖像特征的成對余弦相似度,并在各個提示上對相似性得分進行平均。直觀地說,較低的成對相似性得分意味著更高的多樣性。在數學上,度量分數表示為:

這里有P個提示,f表示代表圖像風格或構圖的特征向量。通常每個提示使用C = 4個圖像,但重要的是要注意,如果在圖像中未檢測到任何對象,則不使用該圖像來計算相似性。

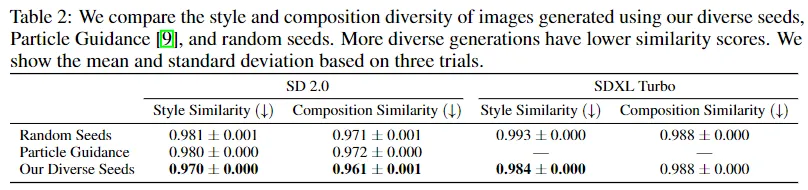

在下表2中,觀察到多樣種子在為SD 2.0生成具有不同風格和構圖的圖像方面優于隨機種子和Particle Guidance。

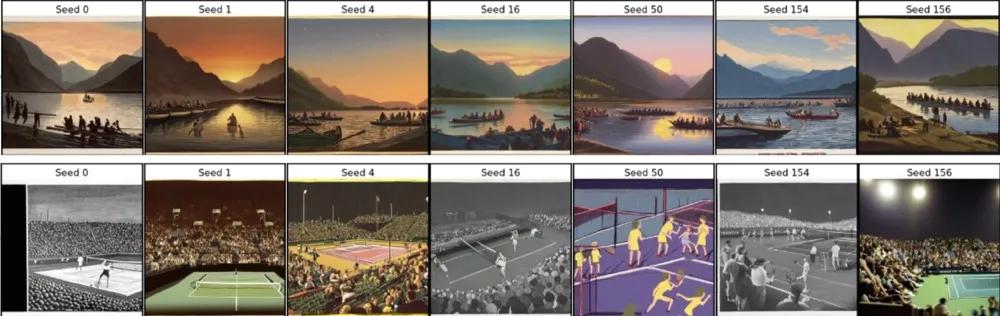

有趣的是,精心選擇的種子有助于為SD 2.0使圖像構圖多樣化,但對于SDXL Turbo則不然。在下圖11中展示了視覺比較。

改進的基于文本的修復

已經展示了精心選擇種子提供了一種簡單、無需訓練的方法,可以增強文本到圖像擴散模型生成的圖像的視覺質量、人類偏好和多樣性。但是,圖像生成的潛力不僅限于文本到圖像應用。這提出了一個有趣的問題——我們是否也可以為基于文本的圖像修復任務發現“黃金”種子,例如對象去除和對象完成?

研究者們收集了500對圖像和修復mask,用于對象去除和對象完成應用。使用文本提示“清除背景”來進行去除操作,對于完成情況,使用與原始對象類別對應的提示。然后,使用基于文本的擴散修復模型生成圖像。

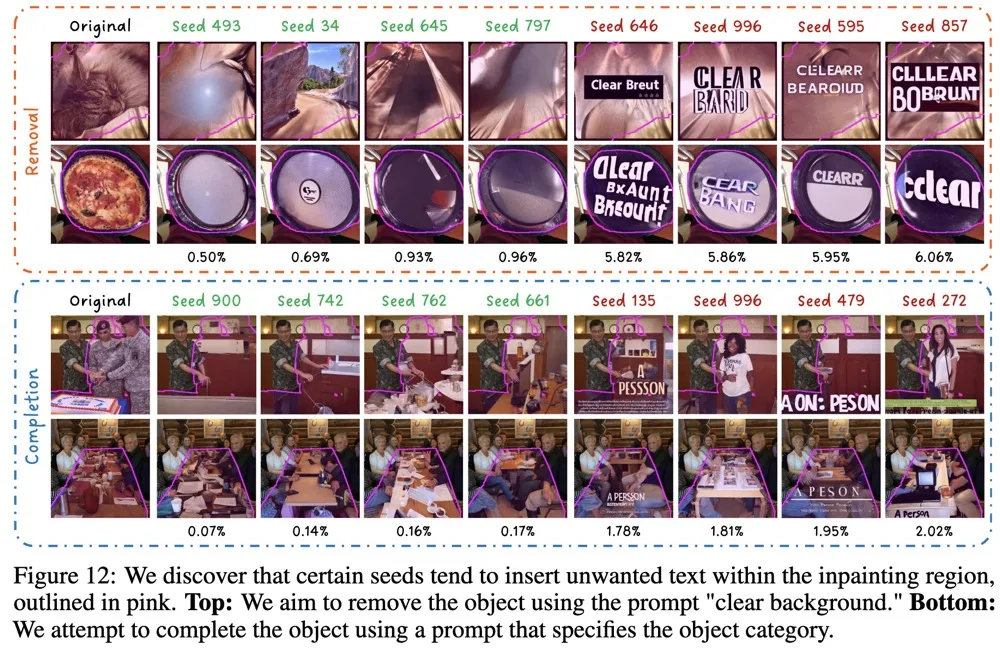

觀察到一些圖像在修復區域包含了不希望的文本,通常模仿提示。為了量化文本的存在,應用了光學字符識別(OCR),并計算了每個種子生成的所有圖像中修復mask內文本的平均比例。如下圖12所示,某些種子傾向于在去除和完成情景下插入文本。

結論、限制和更廣泛的影響

在本研究中,研究了“隨機”種子在逆擴散過程中的作用,探索了它們基于生成的圖像的可區分性以及對可解釋的視覺維度的影響。值得注意的是,1,024路分類器訓練以預測生成圖像的種子號,在短短幾個epoch內就達到了超過99.9%的測試準確率。

受到這一發現的鼓舞,進行了廣泛的分析,并確定了一些一致產生視覺質量更好和與人類偏好更一致的圖像的“黃金”種子。

還發現某些種子會創建“灰度”圖像,在修復期間添加邊框或插入文本。研究還表明,種子影響圖像的構成,影響對象的位置、大小和深度。利用這些見解,提出了下游應用,例如通過僅對這些特殊種子進行采樣來進行文本到圖像擴散模型的高保真推理和多樣化生成。分析為在推理過程中增強圖像合成提供了新的視角,而無需顯著的計算開銷。

此外,值得注意的是,本研究使用的是在大規模、未篩選的網絡數據上預訓練的文本到圖像擴散模型,這可能包含偏見和錯誤,而文本提示包括MS-COCO圖像的密集標題,可能產生人類想象。另外,由于預算限制,主要研究了1024個種子中的影響,而不是所有可能的種子值。

本文轉自 AI生成未來 ,作者:Lingzhi Zhang等