Meta 開源最強大模型Llama 3.1,參數多達 405B,超16000塊H100訓練,燃燒數億經費!小扎:堅定開源不動搖! 原創

出品 | 51CTO技術棧(微信號:blog51cto)

GPT-4o mini 剛剛將人們的目光吸引到小模型的浪潮上。

而新王Meta直接開大,開源了自己4050億參數大模型,也是超越GPT-4o的最強模型。

與幾個月前推出的小型Llama 3模型相比,Llama 3.1復雜得多。4050億參數作為其最大的版本,使用超過16,000個Nvidia的高價H100 GPU進行訓練。Meta沒有透露開發Llama 3.1的成本,但僅從Nvidia芯片的成本來看,可以推測其費用達到數億美元。

不僅如此,小扎還在Meta官網上發表了《開源是AI前進道路》的長文,他預測“從明年開始,我們預計未來的Llama模型將成為行業中最先進的模型”。

如果這個預言成真,我們就會迎來OpenAI追著Meta跑的新時代。

圖片

圖片

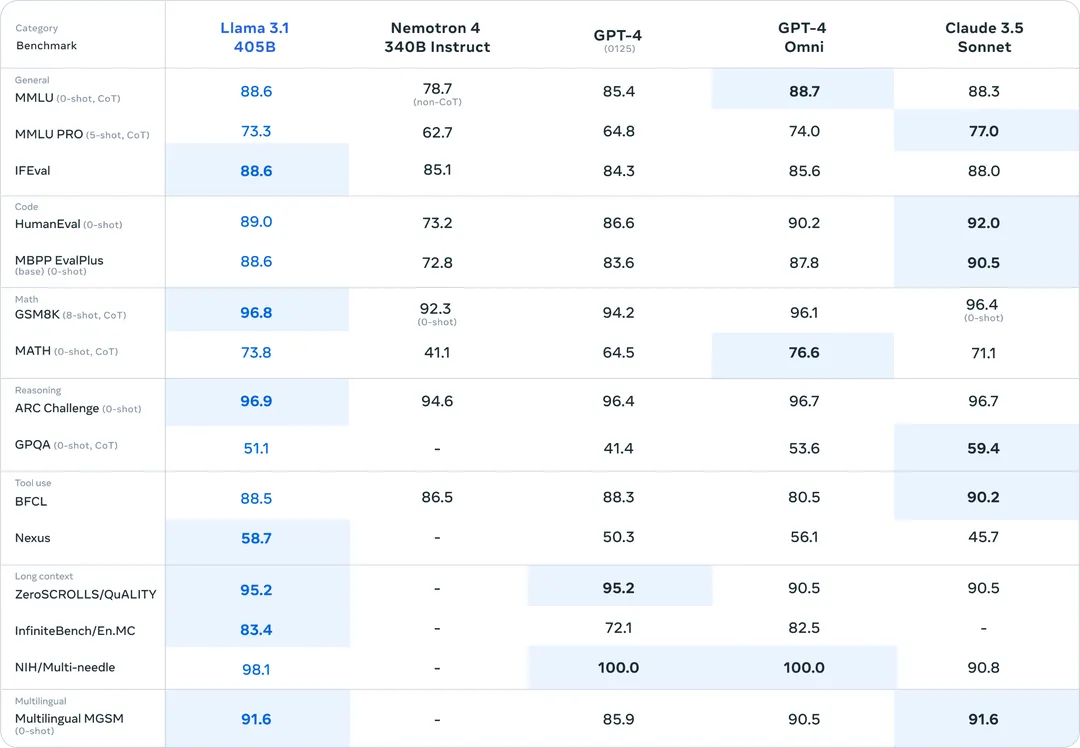

作為Meta向開源標桿邁進的重要一步,Llama 3.1 405B是名副其實的強大,在一眾閉源前沿模型中完全不虛,拿到了多個任務的SOTA。

圖片

圖片

Github地址:

??https://github.com/meta-llama/llama-models??

huggingface地址:

??https://huggingface.co/meta-llama/Meta-Llama-3.1-8B/tree/main??

一、合成數據的勝利

Meta將Llama 3.1的4050億參數版本用于蒸餾較小的70億和8億參數版本,并表示訓練中使用了大量的合成數據,即由模型而非人類生成的數據。

405B 模型采用了3種合成數據方法來提升自身的代碼能力,包括代碼執行反饋、編程語言翻譯和文檔反向翻譯。

當媒體采訪Meta是否同意業界關于訓練模型的高質量數據即將耗盡的共識時,Meta生成AI副總裁艾哈邁德·阿爾-達勒暗示確實有一個上限,盡管可能比一些人想象的要遠。“我們認為我們還有幾個訓練的機會,”他說,“但很難確定。”

二、Llama生態進一步擴張

Meta更新了許可證,首次允許開發人員使用包括405B參數規模的Llama模型的輸出來改進其他模型。

在Meta公司博客上發布的一封信中,扎克伯格稱,開源AI模型將超越——并且已經比——專有模型發展得更快,類似于Linux如何成為今天大多數手機、服務器和小工具的開源操作系統。

扎克伯格將Meta對開源AI的投資比作其早期的開放計算項目,他說該項目通過讓像惠普這樣的外部公司幫助改進和標準化Meta的數據中心設計,為公司節省了“數十億美元”。

展望未來,他預計同樣的動態將出現在AI領域,他寫道:“我相信Llama 3.1的發布將成為行業的一個轉折點,大多數開發者將開始主要使用開源。”

為了幫助推廣Llama 3.1,Meta正在與包括微軟、亞馬遜、谷歌、Nvidia和Databricks在內的兩打公司合作,幫助開發者部署自己的版本。Meta聲稱,Llama 3.1在生產中的運行成本約為OpenAI的GPT-4o的一半。它發布了模型權重,供公司使用定制數據進行訓練和調優。

三、Meta自己還在蹚產品的路

走開源路的Meta把壁壘瞄準了產品,Llama的實現被規劃為AI助手。

小扎預測,到今年年底,Meta AI將成為使用最廣泛的助手,超過ChatGPT。

Llama 3.1將會賦能給一系列Meta系應用,從本周開始,Llama 3.1將在美國首先通過WhatsApp和Meta AI網站提供。在接下來的幾周內,Instagram和Facebook上也將上線這些能力。模型還將支持新的語言,包括法語、德語、印地語、意大利語和西班牙語。

盡管Llama 3.1最先進的4050億參數模型可免費用于Meta AI,但在一周內超過指定數量的提示后,助手將切換到更縮減的70億參數模型。這表明4050億參數模型在大規模運行中對Meta來說過于昂貴。

四、開源到底:三方共贏的AI之路

每次Meta發布新模型時,小扎都會再次重申自己的開源信仰。

這次,在自己的長文中,扎克伯格描述了一個開發者、Meta以及世界三方共贏的開源之路,詳盡描述了他為何會走開源之路。以下節選了文中的重要觀點:

1.開源AI對開發者有利

當我與全球的開發者、CEO和政府官員交談時,通常會聽到幾個主題:

我們需要訓練、微調和蒸餾我們自己的模型。每個組織有不同的需求,這些需求最好由使用其特定數據訓練或微調的不同規模的模型來滿足。設備上的任務和分類任務需要小模型,而更復雜的任務需要大模型。現在,你可以使用最先進的Llama模型,繼續用自己的數據訓練它們,然后將其蒸餾成最適合你的模型規模——而無需我們或其他任何人看到你的數據。

我們需要控制自己的命運,而不是被鎖定在一個閉源供應商中。許多組織不希望依賴他們無法運行和控制的模型。他們不希望閉源模型提供商能夠改變他們的模型、修改使用條款,甚至完全停止服務他們。他們也不希望被鎖定在擁有模型專有權的單一云上。開源使得你可以輕松地在兼容的工具鏈公司之間移動。

我們需要保護我們的數據。許多組織處理敏感數據,需要確保這些數據的安全,不能通過云API發送到閉源模型。其他組織則根本不信任閉源模型提供商。開源解決了這些問題,因為你可以在任何你想要的地方運行模型。眾所周知,開源軟件通常更安全,因為它是以更透明的方式開發的。

我們需要一個高效且經濟實惠的模型。開發者可以在自己的基礎設施上運行Llama 3.1 405B進行推理,其成本大約是使用閉源模型(如GPT-4o)的50%,無論是用戶界面還是離線推理任務。

我們希望投資于長期標準的生態系統。很多人看到開源的進展速度比閉源模型更快,他們希望在能給他們帶來長期優勢的架構上構建系統。

2.開源AI對Meta有利

人們經常問我是否擔心通過開源Llama放棄技術優勢,但我認為從幾個方面來看這忽略了大局:

首先,為了確保我們可以訪問最好的技術,并且不會在長期內被鎖定在閉源生態系統中,Llama需要發展成一個完整的生態系統,包括工具、高效改進、硅優化和其他集成。如果只有我們一家公司使用Llama,這個生態系統就不會發展,我們也不會比閉源Unix的變體更好。

其次,我預計AI開發將繼續非常具有競爭性,這意味著開源任何給定的模型并不會在某一時間點上給予下一個最好的模型一個巨大的優勢。Llama成為行業標準的路徑是通過一代又一代地始終保持競爭力、高效和開放。

第三,Meta和閉源模型提供商之間的一個關鍵區別是,出售AI模型訪問權不是我們的商業模式。這意味著公開發布Llama不會像閉源提供商那樣削弱我們的收入、可持續性或研究投資能力。(這也是為什么一些閉源提供商一直在游說政府反對開源的原因之一。)

最后,Meta有著長久的開源項目和成功歷史。通過發布我們的服務器、網絡和數據中心設計到Open Compute Project并讓供應鏈標準化我們的設計,我們節省了數十億美元。通過開源領先的工具(如PyTorch、React以及許多其他工具),我們也從生態系統的創新中受益。這種方法在我們長期堅持時一直對我們有效。

4.開源AI對世界有利

我相信開源是一個積極AI未來的必要條件。AI比任何其他現代技術都更有潛力提高人類生產力、創造力和生活質量——并在加速經濟增長的同時推動醫學和科學研究的進步。開源將確保世界上更多的人能夠獲得AI的好處和機會,權力不會集中在少數幾家公司手中,并且技術可以更均勻和安全地部署在整個社會中。

關于開源AI模型的安全性存在持續的辯論,而我的觀點是開源AI將比替代方案更安全。我認為政府會得出這樣的結論,即支持開源符合他們的利益,因為這將使世界更加繁榮和安全。

參考鏈接:1.https://www.theverge.com/2024/7/23/24204055/meta-ai-llama-3-1-open-source-assistant-openai-chatgpt

本文轉載自??51CTO技術棧??