開源模型首勝GPT-4!競技場最新戰(zhàn)報(bào)引熱議,Karpathy:這是我唯二信任的榜單

能打得過GPT-4的開源模型出現(xiàn)了!

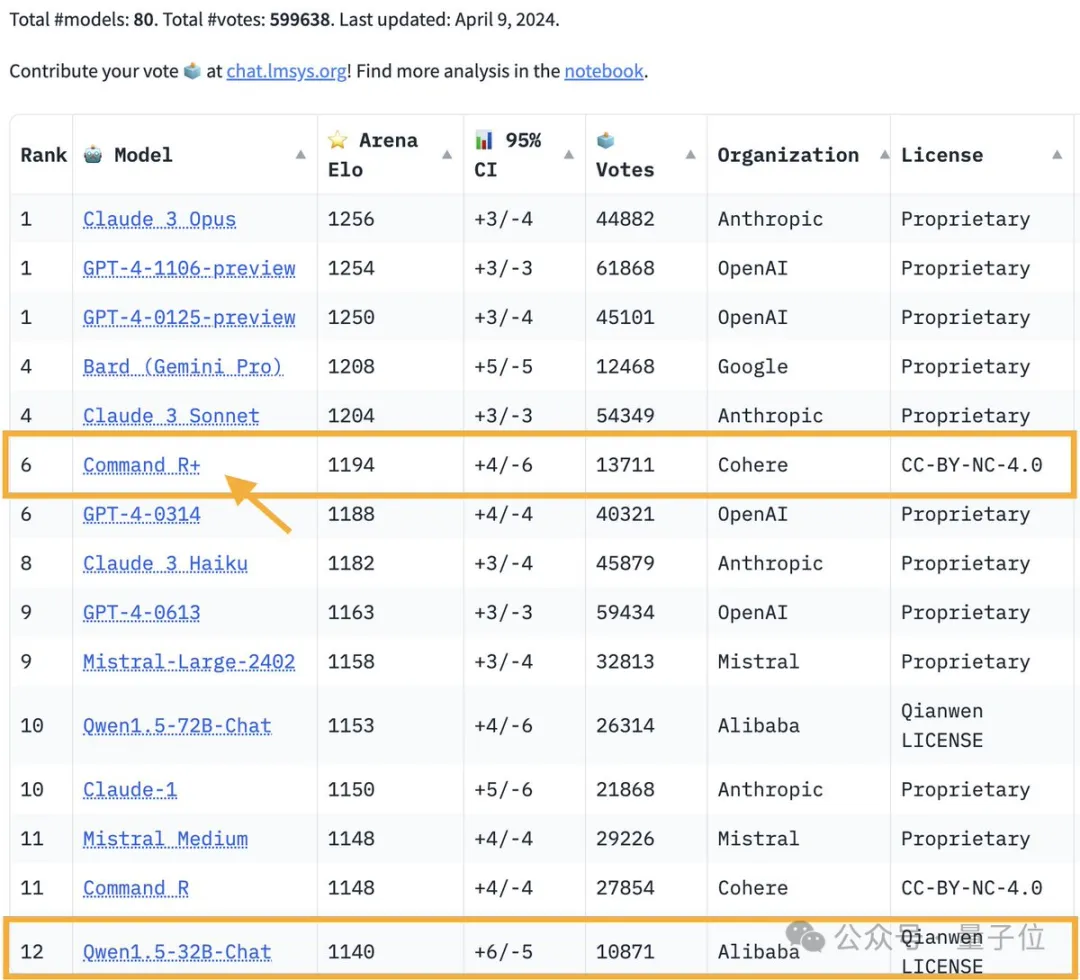

大模型競技場最新戰(zhàn)報(bào):

1040億參數(shù)開源模型Command R+攀升至第6位,與GPT-4-0314打成平手,超過了GPT-4-0613。

這也是第一個(gè)在大模型競技場上擊敗GPT-4的開放權(quán)重模型。

?

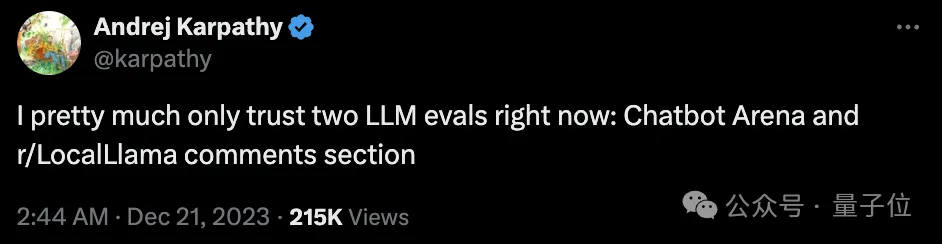

大模型競技場,可是大神Karpathy口中唯二信任的測試基準(zhǔn)之一。

Command R+來自AI獨(dú)角獸Cohere。這家大模型創(chuàng)業(yè)公司的聯(lián)合創(chuàng)始人兼CEO,正是Transformer最年輕作者Aidan Gomez(簡稱割麥子)。

這份戰(zhàn)報(bào)一出,又掀起了一波大模型社區(qū)的熱烈討論。

大家伙兒興奮的理由很簡單:基礎(chǔ)大模型卷了一整年,沒想到在2024年格局還在不斷地發(fā)展變化。

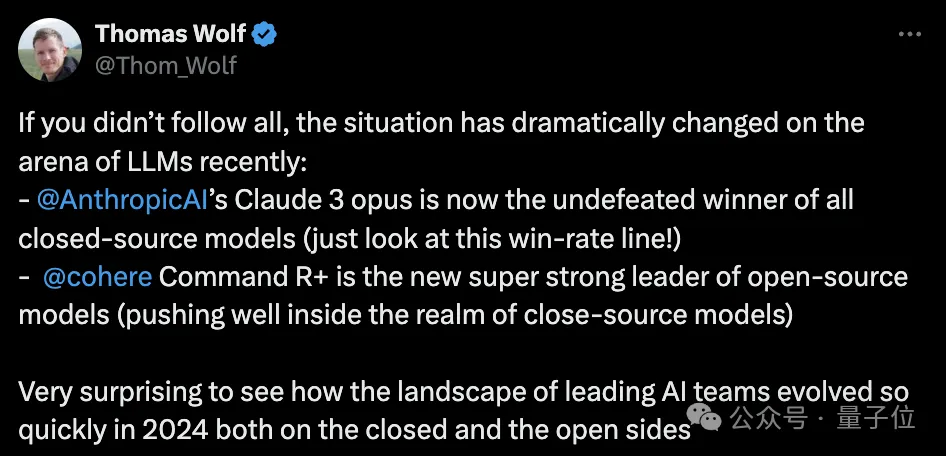

HuggingFace聯(lián)合創(chuàng)始人Thomas Wolf就說:

最近大模型競技場上的情況發(fā)生了巨大的變化:

Anthropic的Claude 3 opus在閉源模型中獨(dú)占鰲頭。

Cohere的Command R+則成為了開源模型中的最強(qiáng)者。

沒想到,2024年在開源和閉源兩條路線上,人工智能團(tuán)隊(duì)的發(fā)展都如此之快。

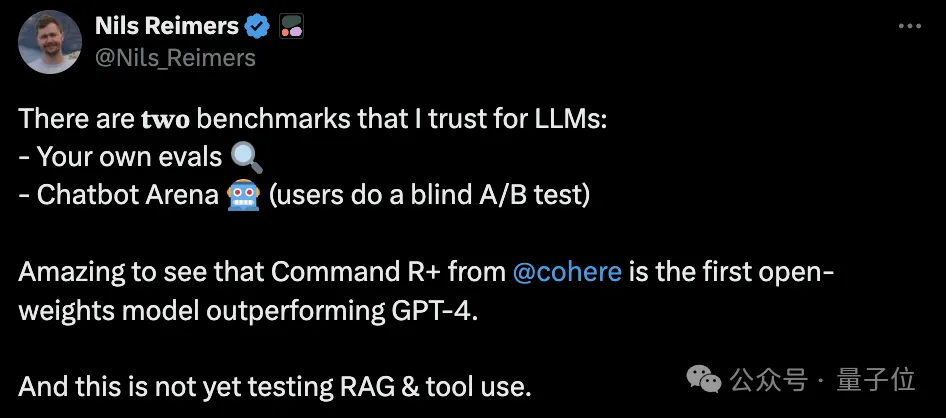

另外,Cohere機(jī)器學(xué)習(xí)總監(jiān)Nils Reimers還指出了值得關(guān)注的一點(diǎn):

Command R+最大的特色是對內(nèi)置RAG(檢索增強(qiáng)生成)進(jìn)行了全面優(yōu)化,而在大模型競技場中,RAG這樣的外掛能力并未納入測試。

RAG優(yōu)化模型登上開源王座

在Cohere官方定位中,Command R+是一個(gè)“RAG優(yōu)化模型”。

就是說,這個(gè)1040億參數(shù)的大模型主要針對檢索增強(qiáng)生成技術(shù)進(jìn)行了深度優(yōu)化,以減少幻覺的產(chǎn)生,更適配于企業(yè)級工作負(fù)載。

和此前推出的Command R一樣,Command R+的上下文窗口長度是128k。

此外,Command R+還具備以下特點(diǎn):

- 覆蓋10+種語言,包括英語、中文、法語、德語等;

- 能使用工具完成復(fù)雜業(yè)務(wù)流程的自動化

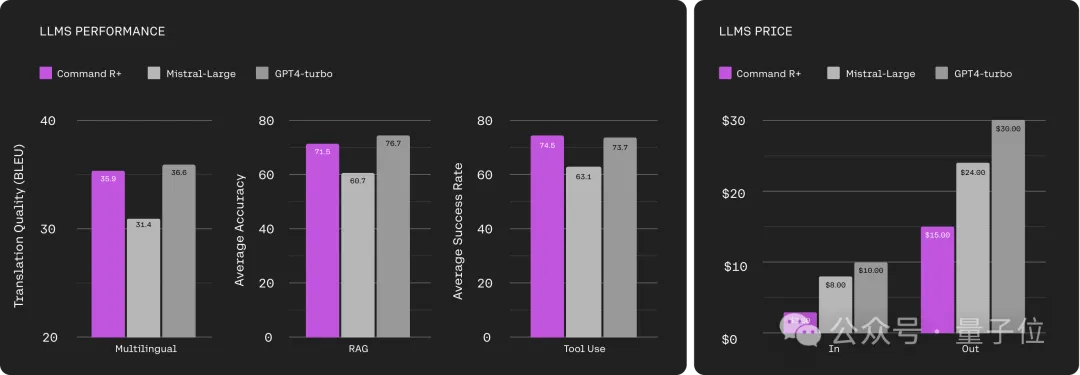

從測試結(jié)果來看,在多語種、RAG和工具使用這三個(gè)維度上,Command R+都達(dá)到了GPT-4 turbo的水平。

但在輸入成本方面,Command R+的價(jià)格僅為GPT-4 turbo的1/3。

輸出成本方面,Command R+則是GPT-4 turbo的1/2。

正是這點(diǎn)引發(fā)了不少網(wǎng)友的關(guān)注:

不過,盡管在大模型競技場這種人類主觀評測上表現(xiàn)搶眼,還是有網(wǎng)友甩出了一些不同觀點(diǎn)。

在HumanEval上,Command R+的代碼能力就連GPT-3.5都沒打過,在兩組測試中分別排在32位和33位。

最新版GPT-4 turbo則沒有懸念地拿下了第一。

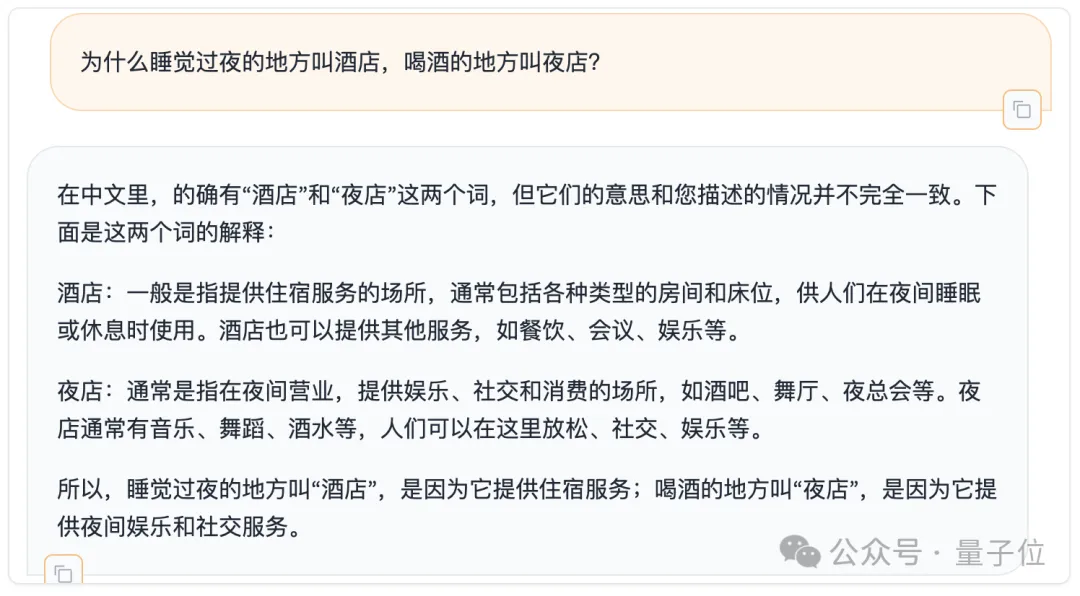

另外,我們也在最近剛登上正經(jīng)論文的弱智吧benchmark上簡單測試了一下Command R+的中文能力。

你給打個(gè)分?

需要說明的是,Command R+的開源只面向?qū)W術(shù)研究,并不能免費(fèi)商用。

One More Thing

最后的最后,還是多聊一嘴割麥子小哥。

Aidan Gomez,Transformer圓桌騎士中最年輕的一位,加入研究團(tuán)隊(duì)時(shí)只是個(gè)本科生——

不過,是在多倫多大學(xué)讀大三時(shí)就加入了Hinton實(shí)驗(yàn)室的那種。

2018年,割麥子被牛津大學(xué)錄取,開始像他的論文搭子們那樣攻讀CS博士學(xué)位。

但在2019年,隨著Cohere的創(chuàng)立,他最終選擇退學(xué)加入AI創(chuàng)業(yè)的浪潮。

Cohere主要是為企業(yè)提供大模型解決方案,目前估值達(dá)到了22億美元。

本文轉(zhuǎn)自 量子位 ,作者:量子位