InternLM-XComposer2.5-OmniLive:用于長期流媒體視頻和音頻交互的綜合多模態人工智能系統 原創

01、概述

隨著人工智能的發展,構建能夠實時感知環境、進行復雜推理并記憶的系統,已成為研究者們追求的目標。這不僅要求 AI 系統能處理音頻、視頻和文本等多模態數據,還需在動態環境中模擬人類感知、推理與記憶的協同能力。然而,現有多模態大語言模型(MLLMs)在這方面仍存在諸多限制,尤其是在同時處理任務時的效率和可擴展性。

為解決這些問題,來自上海人工智能實驗室、中國香港中文大學、復旦大學、中國科技大學、清華大學、北京航空航天大學和商湯集團的研究團隊推出了一款創新框架——InternLM-XComposer2.5-OmniLive (IXC2.5-OL)。通過模塊化設計,該系統將感知、記憶與推理功能解耦,實現了高效的實時多模態交互,為模擬人類認知提供了全新范式。

02、現有系統的局限性

1)感知與推理的割裂

大部分主流模型采用序列到序列的架構,這種設計導致系統在處理多模態數據時,需要在感知和推理間頻繁切換。例如,模型在分析視頻流時可能會停頓以處理文本任務,類似于“人在觀察時無法思考”的狀態。

2)數據存儲的低效

當前模型依賴擴展上下文窗口存儲歷史數據,但多模態數據(如視頻流和音頻流)會在短時間內生成海量信息,這種方法難以支撐長時間的數據積累。例如,一個小時的視頻可能轉化為數百萬個標記,這對存儲和檢索都是巨大的挑戰。

3)模型架構的單一性

現有方法如 Mini-Omni 和 VideoLLM-Online,雖然嘗試填補文本與視頻理解之間的鴻溝,但因過度依賴順序處理和有限的記憶整合能力,難以達到人類級別的認知效果。

03、InternLM-XComposer2.5-OmniLive 的創新設計

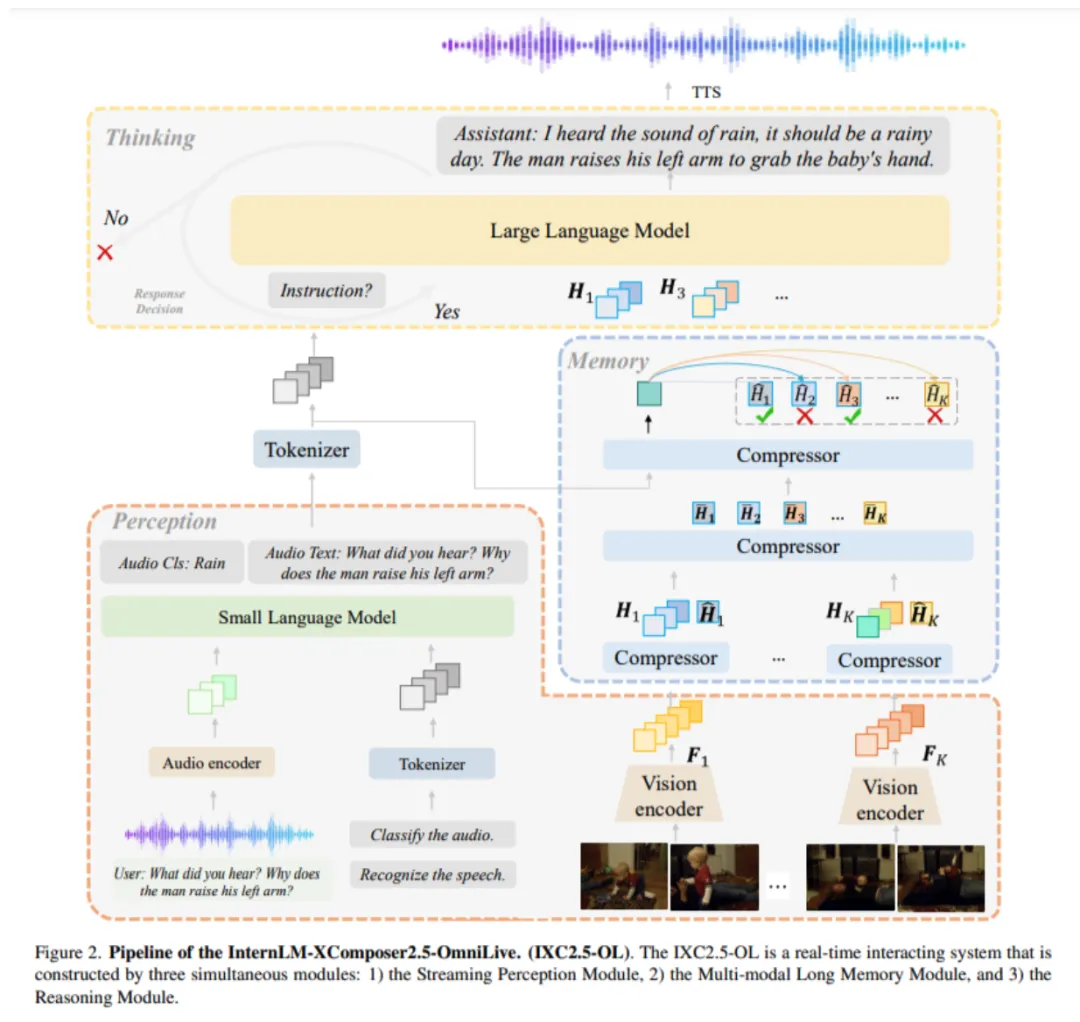

IXC2.5-OL 通過模塊化架構模擬人腦,將感知、記憶和推理分解為三個獨立但協同工作的模塊:

- 流式感知模塊(Streaming Perception Module)

- 多模態長時記憶模塊(Multimodal Long Memory Module)

- 推理模塊(Reasoning Module)

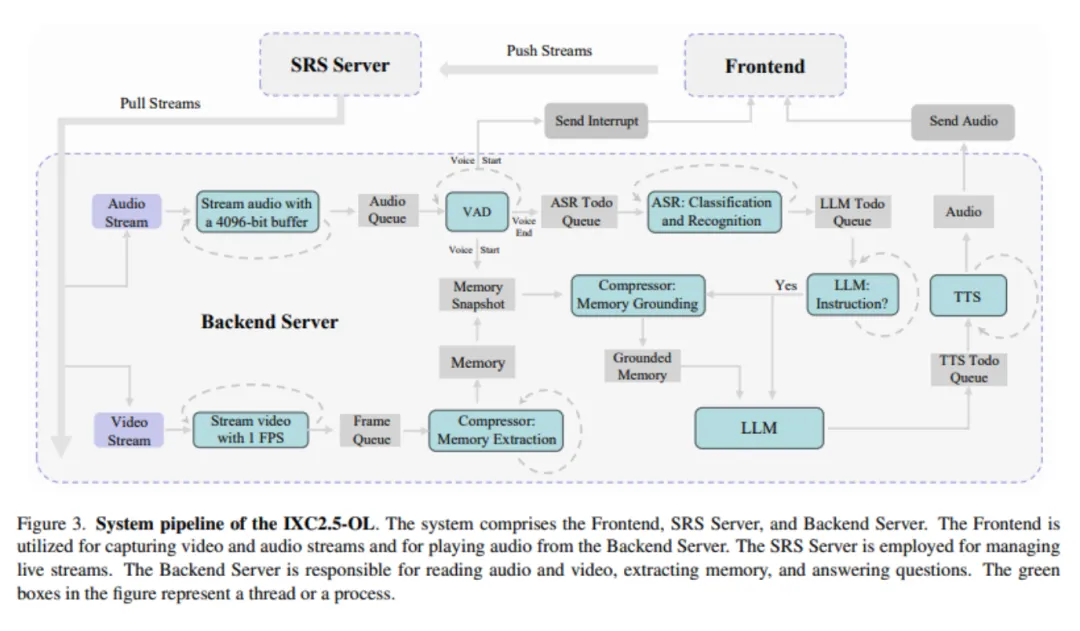

1)流式感知模塊:實時數據捕獲與編碼

該模塊處理實時音頻和視頻流,使用先進模型如 Whisper(音頻編碼)和 OpenAI CLIP-L/14(視頻感知)提取高維特征。

- 任務:捕獲并編碼關鍵信息,如語音內容、環境音等,直接存入記憶模塊。

- 應用:音視頻會議的實時字幕生成、智能監控中異常事件識別。

2)多模態長時記憶模塊:高效存儲與檢索

此模塊的核心功能是將短期記憶壓縮為高效的長期表示。

- 方法:通過算法優化,能夠將數百萬幀視頻濃縮成緊湊的記憶單元,有效減少存儲成本并提升檢索準確性。

- 優勢:大幅降低計算資源的占用,為實時交互提供支持。

3)推理模塊:信息檢索與復雜任務執行

推理模塊通過檢索記憶模塊中的相關信息,快速完成復雜任務,如回答用戶問題或執行指令。

- ?特點:實現感知、推理與記憶的同步協作,避免傳統系統中各模塊割裂運行的效率低下問題。

- 應用:智能問答系統、實時決策支持。?

04、性能測試與研究成果

1)卓越的基準測試成績

IXC2.5-OL 在多項國際權威測試中表現出色:

- 音頻處理

a. 在 Wenetspeech 中文測試集上,語音識別的詞錯誤率(WER)為 7.8%,遠超 VITA 和 Mini-Omni。

b. 在 LibriSpeech 英文基準上,“清晰”環境下的 WER 為 2.5%,而在噪聲環境中也達到了 9.2% 的優秀成績。

- 視頻處理

- 在 MLVU 和 StreamingBench 的視頻推理與異常識別測試中,分別取得了 66.2% 和 73.79% 的評分,創下行業新高。

2)高效的多模態處理能力

流式感知模塊通過壓縮和記憶機制,實現了對多模態數據的實時處理。

系統能夠同時處理數百萬標記,檢索速度快且數據損失率低,適合需要長期交互的動態環境。

3)開放性與易用性

研究團隊已將全部代碼、模型及推理框架公開,開發者可以快速集成并根據實際需求進行優化。

05、實際應用場景

1)智能監控與異常檢測

IXC2.5-OL 的實時視頻處理能力,適用于智能監控系統中異常事件的自動識別,如公共場所的行為異常分析。

2)智能會議助手

通過實時感知音頻與視頻流,該框架可為企業提供智能會議助手服務,包括實時記錄、摘要生成以及任務提醒。

3)教育與學習

在在線教育中,IXC2.5-OL 可作為虛擬導師,實時分析學習者的行為反饋并調整教學策略,同時記錄學習數據以優化課程內容。

4)醫療輔助診斷

長時記憶模塊能夠存儲并快速檢索患者的歷史病歷數據,結合實時感知與推理功能,輔助醫生做出準確診斷。

06、結語

IXC2.5-OL 的模塊化設計從本質上解決了傳統系統的諸多局限:

- 感知、記憶與推理的分工協作:模擬人腦的處理方式,確保了系統的高效性與可擴展性。

- 實時多模態交互:實現了音頻、視頻和文本的同步處理,為動態環境中的復雜應用提供了解決方案。

- 高效存儲與檢索:通過記憶壓縮機制,將長期多模態交互的計算與存儲成本降至最低。

隨著 AI 技術的進一步發展,IXC2.5-OL 不僅將繼續推動人機交互的革新,還為構建更接近人類認知的 AI 系統提供了重要參考。

參考:

- ??https://github.com/InternLM/InternLM-XComposer/tree/main/InternLM-XComposer-2.5-OmniLive??

- ??https://huggingface.co/internlm/internlm-xcomposer2d5-ol-7b??

- ??https://github.com/InternLM/InternLM-XComposer/blob/main/InternLM-XComposer-2.5-OmniLive/IXC2.5-OL.pdf??

本文轉載自公眾號Halo咯咯 作者:基咯咯