從文字模型到世界模型!Meta新研究讓AI Agent理解物理世界

LLM已經可以理解文本和圖片了,也能夠根據它們的歷史知識回答各種問題,但它們或許對周圍世界當前發生的事情一無所知。

現在LLMs也開始逐步學習理解3D物理空間,通過增強LLMs的「看到」世界的能力,人們可以開發新的應用,在更多場景去獲取LLMs的幫助。

AI Agent,比如機器人或是智能眼鏡,它們可以通過感知和理解環境來回答一些開放性問題,比如「我把鑰匙放哪里了?」

這樣的AI Agent需要利用視覺等感知模式來理解其周圍環境,并能夠用清晰的日常語言有效地與人交流。

這類似于構建一個「世界模型」,即AI Agent可以對外部世界產生它自己的內部理解方法,并能夠讓人類通過語言查詢。

這是一個長期的愿景和一個有挑戰的領域,也是實現人工通用智能的重要一步。

Meta的新研究OpenEQA(Embodied Question Answering)框架,即開放詞匯體驗問答框架,為我們探索這個領域提供了新的可能。

EQA是什么?

EQA(Embodied Question Answering)是一種工具,用于檢查AI Agent是否真正理解周圍世界發生的事情。

畢竟,當我們想要確定一個人對概念的理解程度時,我們會問他們問題,并根據他們的答案形成評估。我們也可以對實體AI Agent做同樣的事情。

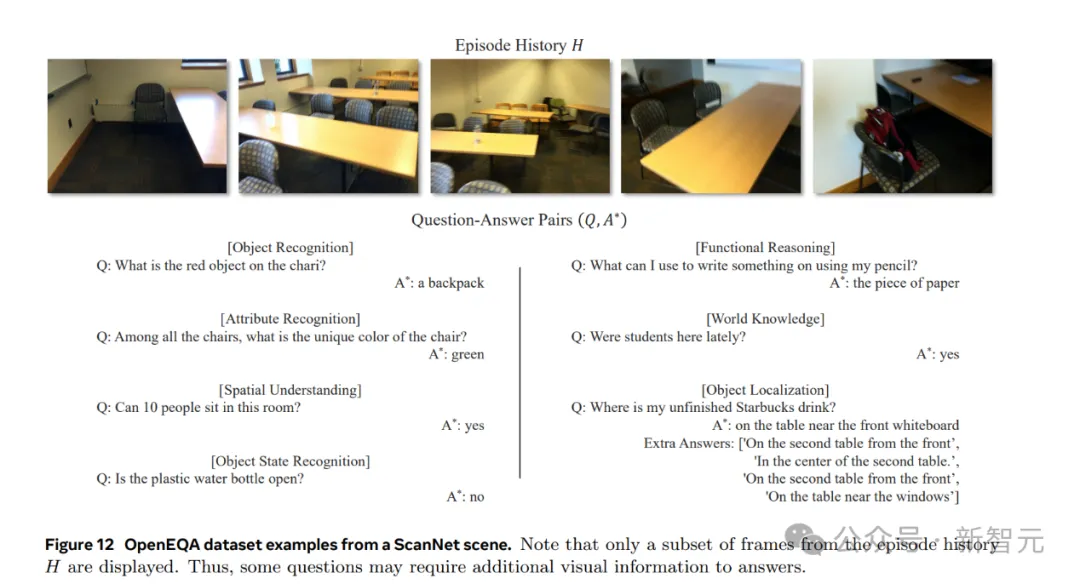

比如下圖的一些問題實例:

[物體識別]

問:椅子上的紅色物體是什么?

答:一個背包

?

[屬性識別]

問:在所有的椅子中,這把椅子的獨特顏色是什么?

答:綠色

?

[空間理解]

問:這個房間可以容納10個人嗎?

答:可以

?

[物體狀態識別]

問:塑料水瓶是開著的嗎?

答:不是

?

[功能推理]

問:我可以用鉛筆在什么東西上寫?

答:紙

?

[世界知識]

問:最近有學生在這里嗎?

答:有

?

[物體定位]

問:我的未喝完的星巴克飲料在哪里?

答:在靠前的白板旁邊的桌子上

除此之外,EQA也更加有直接的應用。

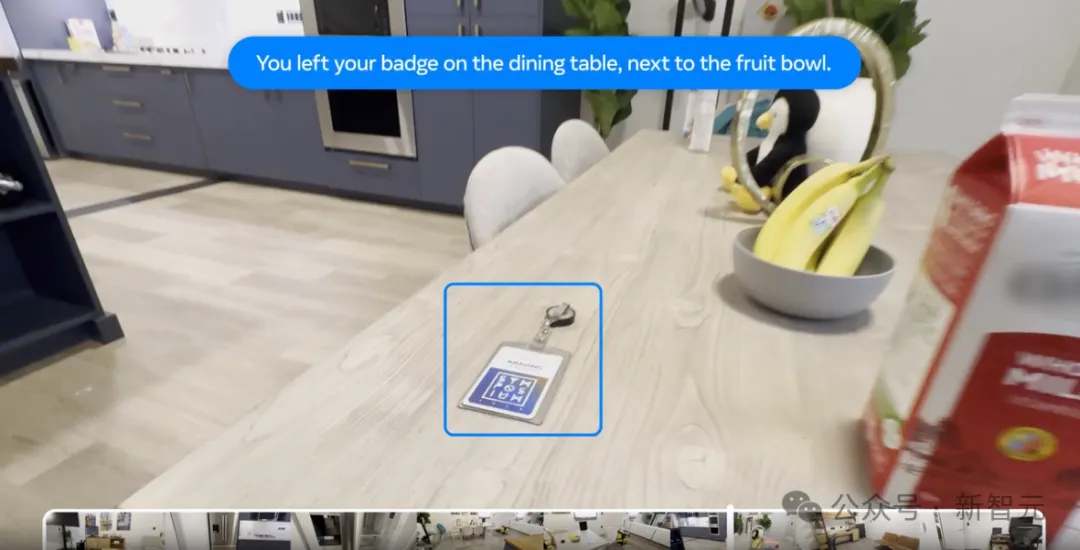

比如,當你準備出門卻找不到工卡時,就就可以問智能眼鏡它在哪里。而AI Agent則會通過利用其情節記憶回答說徽章在餐桌上。

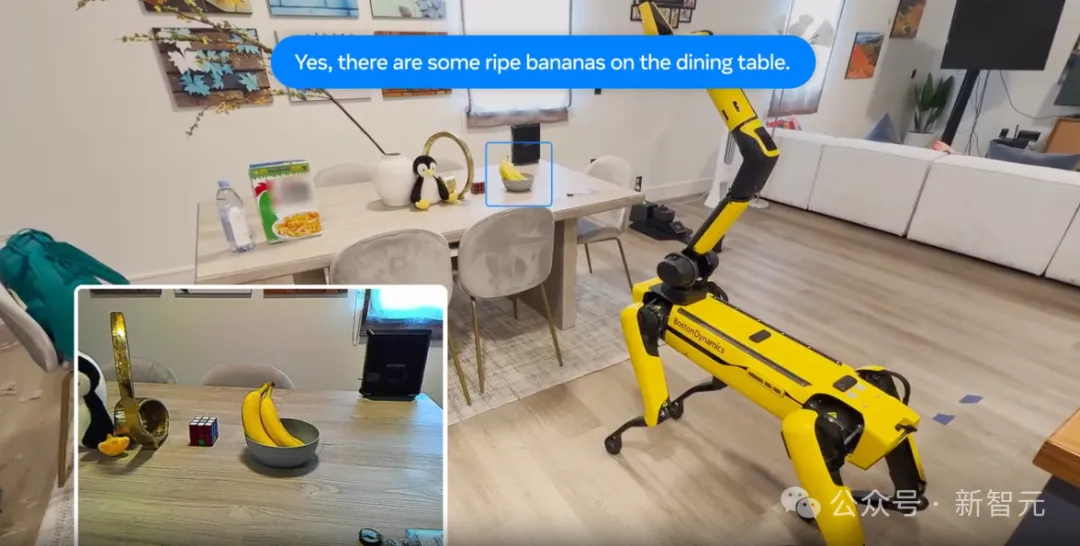

或者如果你在回家的路上餓了,就可以問家庭機器人是否還剩下水果。根據其對環境的主動探索,它可能會回答說水果籃里有成熟的香蕉。

這些行為看上去很簡單,畢竟LLMs在許多人認為具有挑戰性的任務中表現出色,比如通過SAT或律師考試。

但現實是,即使是今天最先進的模型,在EQA方面也很難達到人類的表現水平。

這也是為什么Meta同時發布了OpenEQA基準測試,讓研究人員可以測試他們自己的模型,并了解它們與人類的表現相比如何。

OpenEQA:面向AI Agent的全新基準

開放詞匯體驗問答(OpenEQA)框架是一個新的基準測試,通過向AI Agent提出開放詞匯問題來衡量其對環境的理解。

該基準包含超過1600個非模板化的問題和答案對,這些問題和答案來自人類注釋者,代表了真實世界的使用情況,并提供了180多個物理環境的視頻和掃描指針。

OpenEQA包含兩個任務:

(1)情節記憶EQA,在這個任務中,一個實體的AI Agent根據其對過去經歷的回憶回答問題。

(2)主動EQA,在這個任務中,AI Agent必須在環境中采取行動來收集必要的信息并回答問題。

OpenEQA還配備了LLM-Match,這是一種用于評分開放詞匯答案的自動評估指標。

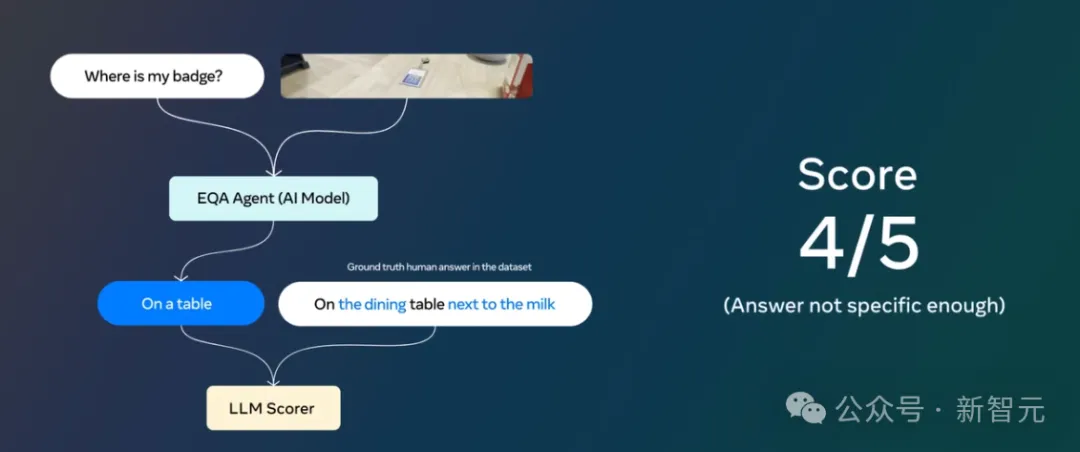

下方是LLM-Match打分的流程,通過問題和場景的輸入,AI大模型會給出回答,該回答會去和人類的回答作對比,然后得到相應的分數。

現階段VLM的表現

一般來說,AI Agent的視覺能力是借助于視覺+語言基礎模型(VLM)。

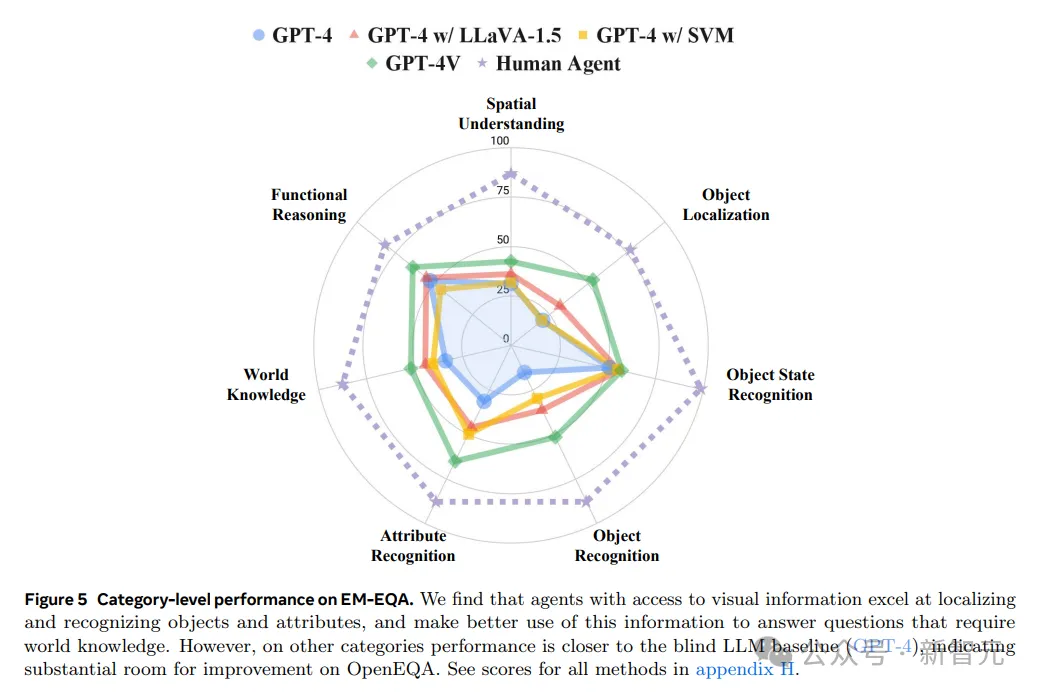

研究員使用OpenEQA來評估了幾種最先進的VLM,發現即使是性能最好的模型(如GPT-4V達到48.5%),與人類的表現(85.9%)之間也存在著顯著差距。

值得注意的是,對于需要空間理解的問題,即使是最好的VLM也幾乎是「盲目」的,即它們的表現幾乎不比僅文本模型更好。

例如,對于「我坐在客廳的沙發上看電視。我的身后是哪個房間?」這個問題,模型基本上是隨機猜測不同的房間,沒有從視覺情景記憶中獲得對空間的理解。

這說明VLM其實是回歸到文本中去捕捉關于世界的先驗知識,以此來回答視覺問題。視覺信息并沒有給它們帶來實質性的好處。

這也說明,AI Agent在目前這個階段,還達不到能完全理解物理世界的能力。

但氣餒還為時過早,OpenEQA僅僅是第一個開放詞匯的EQA基準。

通過OpenEQA將具有挑戰性的開放詞匯問題與以自然語言回答的能力結合起來,可以激發更多的研究,幫助AI理解并交流關于它所看到的世界的信息,也有助于研究人員跟蹤多模態學習和場景理解的未來進展。

也不是沒有可能,突然哪天AI Agent又給我們帶來一個大驚喜呢?

本文轉自 新智元 ,作者:新智元