用硅模擬人腦,進度條走到了1/80

貓頭鷹的大腦約有11.5億個神經元、1280億個突觸。

全部塞進一個微波爐大小的機箱——就成了世界上最大的神經擬態系統,英特爾Hala Point。

不過別擔心,期間沒有任何貓頭鷹受到傷害,是用的硅芯片模擬生物神經元。

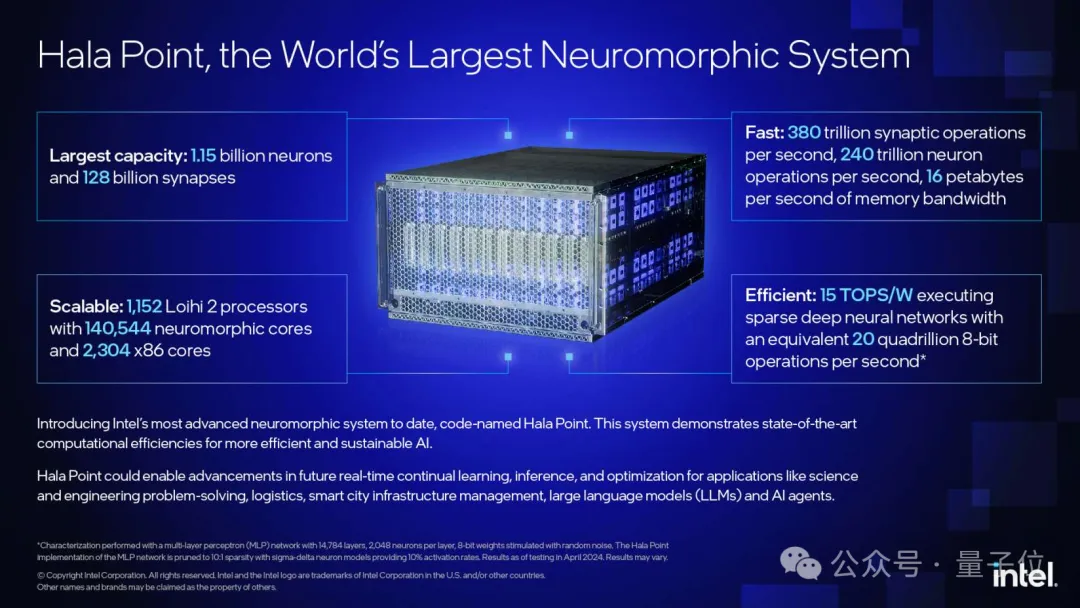

這種芯片效果如何?一系列數據說話:

- 執行AI推理負載和處理優化問題時,速度比常規CPU和GPU架構快50倍,同時能耗降低了100倍。

- 運行傳統深度神經網絡時,INT8精度運算的能效比達到了15 TOPS/W。

(英偉達尚未發貨的最新GB200 NVL72在INT8精度只有6 TOPS/W,當前的DGX H100系統約為3.1 TOPS/W) - 用于仿生脈沖神經網絡模型時,能夠以比人腦快20倍的實時速度運行其全部11.5億個神經元。

- 在運行神經元數量較低的情況下,速度可比人腦快200倍。

……

總之,這不是傳統意義上拼峰值算力的那種AI芯片,能效比高才是Hala Point系統最大的優勢。

據統計,僅訓練GPT-3就耗電10GWh,相當于歐洲6000人一年的用電量,而隨著AI應用的普及,推理能耗更是難以估量。

反觀人腦,憑借860億個神經元,每秒能完成上萬億次運算,功耗卻不到20W。

那么,如何讓芯片模擬生物大腦的運作方式,正是神經擬態計算的核心理念。

來自英特爾實驗室的Hala Point規模已接近人腦的1/80,讓這一構想離現實更近了一步。

那么究竟什么是神經擬態芯片,如何做到高能效比,最終又能用于哪些應用?

存算一體、異步稀疏計算

先來看Hala Point系統具體配置:

由1152個Loihi 2處理器組成,封裝在一個六機架的數據中心機箱中。

整個系統支持分布在140544個神經形態處理內核上的多達11.5億個神經元和1280億個突觸,最大功耗為2600瓦。

Hala Point還包括2300多個嵌入式x86處理器,用于輔助計算。

Loihi 2芯片采用Intel 4工藝制造,每個芯片有128個核心。每個芯片包含多達100萬個數字神經元和1.2億個突觸,采用存算一體設計,打破了馮諾依曼架構的瓶頸。

Loihi 2還應用了眾多類腦計算原理,如異步(asynchronous)、基于事件的脈沖神經網絡(SNNs),以及不斷變化的稀疏連接,以實現能效比和性能的數量級提升。

對于這些獨特的技術,我們聯系到英特爾研究院副總裁、英特爾中國研究院院長宋繼強,詢問了更多細節。

異步,是一種摒棄了傳統芯片的全局時鐘,采用事件驅動的架構。

宋繼強借用人類大腦分區來解釋,相當于一個人的嗅覺、視覺、觸覺等可以同時工作,但并不需要同步。

如此一來Hala Point系統工作時是稀疏計算,又有點像現在主流大模型都會用的MoE專家混合架構。

所以Hala Point系統追求的不是極致性能,它更大的價值在于,以一種前所未有的規模,驗證了神經擬態計算的可行性和優勢。

在算法和應用層面,Hala Point不是專門為當前主流的深度學習模型設計的(但經過修改也能跑)。它更適合去探索一些全新的,受生物學啟發的學習范式。

比如基于時序脈沖編碼的SNN脈沖神經網絡,就是一個很有前景的方向。SNN能更好地捕捉時空信息的動態變化,有望在語音、視覺等時序數據的處理上取得突破。

此外,神經擬態系統天然適合進行持續學習和片上學習,這也是當前深度學習系統的一大短板。

宋繼強還介紹了英特爾的神經擬態研究社區INRC,已有包括全球學校、企業和研究機構的200多成員加入。

社區中大約一半的應用探索是用于機器人、無人機。而且這類應用并不需要Hala Point這么大的系統,只需要幾塊芯片就能搞定了。

那么Hala Point這樣的大殺器又是應用在哪呢?

一個潛在的應用場景是組合優化。宋繼強透露,他們發現用神經擬態計算去求解一些大規模規劃等特定問題時,相比傳統方案,能耗可以降低約3000倍。

這得益于其稀疏計算的特性,避免了大量的無效能耗。從這個角度看,神經擬態系統或許能在物流、智慧交通等領域”另辟蹊徑”。

One More Thing

在Loihi芯片和Hala Point系統的介紹中,很少出現其他芯片強調的“頻率”、“主頻”這樣的參數。

宋繼強解釋,神經擬態系統確實不會追求高頻率,還開了一個小玩笑:

人腦就不會以很高的頻率工作,不然會發熱冒煙。

本文轉自 量子位,作者:量子位