下一代人工智能的發(fā)展方向 (下)

盡管人工智能的誕生已經(jīng)超過半個(gè)世紀(jì),但近十年來人工智能領(lǐng)域發(fā)展非常迅速。自2012年ImageNet競(jìng)賽開始深度學(xué)習(xí)的現(xiàn)代時(shí)代以來,只有8年的時(shí)間。自那時(shí)以來,人工智能領(lǐng)域的進(jìn)步令人震驚,現(xiàn)在人工智能已經(jīng)深入我們?nèi)粘9ぷ魃畹姆椒矫婷妗?/p>

有專家表示,這個(gè)驚人的步伐只會(huì)越來越快。從現(xiàn)在開始的五年后,人工智能領(lǐng)域?qū)⑴c今天大不相同。當(dāng)前被認(rèn)為是最先進(jìn)的方法將已經(jīng)過時(shí);今天剛剛出現(xiàn)或處于邊緣的方法將成為主流。

下一代人工智能將是什么樣子?哪種新穎的AI方法將釋放當(dāng)前在技術(shù)和業(yè)務(wù)方面難以想象的可能性?之前的文章《下一代人工智能的發(fā)展方向 (上)》涵蓋了AI內(nèi)的三個(gè)新興領(lǐng)域,(無監(jiān)督學(xué)習(xí)、聯(lián)合學(xué)習(xí)和Transformer)這些領(lǐng)域?qū)⒃谖磥韼啄曛匦露x人工智能領(lǐng)域和社會(huì)。

本文將再介紹另外三個(gè):

4、神經(jīng)網(wǎng)絡(luò)壓縮

人工智能正在走向邊緣。

能夠直接在邊緣設(shè)備(例如電話、智能揚(yáng)聲器、攝像頭、車輛)上運(yùn)行AI算法具有巨大優(yōu)勢(shì),而無需從云端來回發(fā)送數(shù)據(jù)。

也許最重要的是,邊緣AI增強(qiáng)了數(shù)據(jù)隱私性,因?yàn)椴恍枰獙?shù)據(jù)從其源頭移動(dòng)到遠(yuǎn)程服務(wù)器。由于所有處理均在本地進(jìn)行,因此Edge AI的延遲也較低。對(duì)于諸如自動(dòng)駕駛汽車或語音助手之類的時(shí)間敏感型應(yīng)用程,這至關(guān)重要。它具有更高的能源效率和成本效益,成為機(jī)器學(xué)習(xí)擴(kuò)大的計(jì)算和經(jīng)濟(jì)成本日益重要的考慮因素。而且,它使AI算法無需互聯(lián)網(wǎng)連接即可自主運(yùn)行。

Nvidia首席執(zhí)行官黃仁勛(Jensen Huang)是AI商業(yè)世界的巨頭之一,他認(rèn)為邊緣AI是計(jì)算的未來:“ AI正在從云移動(dòng)到邊緣,連接到AI計(jì)算機(jī)的智能傳感器可以加快許多應(yīng)用的速度,并節(jié)省能源。隨著時(shí)間的流逝,將有數(shù)以萬億計(jì)的這種由人工智能驅(qū)動(dòng)的小型自主計(jì)算機(jī)。”

但是,要使邊緣智能無處不在的崇高愿景成為現(xiàn)實(shí),就需要一項(xiàng)關(guān)鍵的技術(shù)突破:人工智能模型需要變得更小,而且比目前的小得多。因此,在不損害神經(jīng)網(wǎng)絡(luò)性能的情況下開發(fā)和商業(yè)化壓縮神經(jīng)網(wǎng)絡(luò)的技術(shù)已成為AI領(lǐng)域最重要的追求之一。

如今,典型的深度學(xué)習(xí)模型非常龐大,需要大量的計(jì)算和存儲(chǔ)資源才能運(yùn)行。 OpenAI的新語言模型GPT-3于今年夏天成為頭條新聞,其模型參數(shù)高達(dá)1750億個(gè),僅存儲(chǔ)模型就需要超過350 GB的空間。即使是大小不接近GPT-3的模型也仍然需要大量計(jì)算:ResNet-50是幾年前開發(fā)的一種廣泛使用的計(jì)算機(jī)視覺模型,每秒使用38億個(gè)浮點(diǎn)運(yùn)算來處理圖像。

這些模型不能在邊緣運(yùn)行。邊緣設(shè)備中的硬件處理器(例如手機(jī)、Fitbit或Roomba中的芯片)功能不足以支持它們。

因此,開發(fā)使深度學(xué)習(xí)模型更輕量級(jí)的方法成了關(guān)鍵:它將釋放圍繞分散式人工智能構(gòu)建的一系列產(chǎn)品和商業(yè)機(jī)會(huì)。

這樣的模型壓縮將如何工作?

近年來,研究人員和企業(yè)家在該領(lǐng)域取得了長(zhǎng)足進(jìn)步,開發(fā)了一系列使神經(jīng)網(wǎng)絡(luò)小型化的技術(shù)。這些技術(shù)可以分為五個(gè)主要類別:精簡(jiǎn)、量化、低秩分解、緊湊型卷積濾波器和知識(shí)蒸餾。

精簡(jiǎn)需要識(shí)別并消除神經(jīng)網(wǎng)絡(luò)中的冗余或不重要連接,以使其精簡(jiǎn)。量化通過使用較少的比特表示值來壓縮模型。在低秩分解中,模型的張量將被分解,以構(gòu)造近似于原始張量的稀疏版本。緊湊型卷積濾波器是經(jīng)過特殊設(shè)計(jì)的濾波器,可減少執(zhí)行卷積所需的參數(shù)數(shù)量。最后,知識(shí)蒸餾涉及使用模型的完整版本來“教”一個(gè)較小的模型以模仿其輸出。

這些技術(shù)大多彼此獨(dú)立,這意味著它們可以串聯(lián)部署以提高結(jié)果。實(shí)際上,其中一些(精簡(jiǎn)、量化)可以應(yīng)用于已經(jīng)存在的模型,而其他一些(緊湊的過濾器、知識(shí)蒸餾)則需要從頭開始開發(fā)模型。

少數(shù)新興公司已經(jīng)出現(xiàn),將神經(jīng)網(wǎng)絡(luò)壓縮技術(shù)從研究領(lǐng)域推向市場(chǎng)。更有前途的有Pilot AI、Latent AI、 Edge Impulse 和Deeplite。舉一個(gè)例子,Deeplite聲稱其技術(shù)可以使神經(jīng)網(wǎng)絡(luò)縮小100倍,加快10倍,將電源效率提高20倍,而不會(huì)犧牲性能。

“在過去的十年中,世界上具有一定計(jì)算能力的設(shè)備數(shù)量激增,” Pilot AI首席執(zhí)行官Jon Su解釋說。 “Pilot AI的核心IP極大地減少了用于對(duì)象檢測(cè)和跟蹤等任務(wù)的AI模型的大小,從而使AI / ML工作負(fù)載可以直接在邊緣IoT設(shè)備上運(yùn)行。這將使設(shè)備制造商能夠?qū)⒚磕晔鄢龅臄?shù)十億個(gè)傳感器(如按鈕門鈴、恒溫器或車庫門開啟器)轉(zhuǎn)換為可為下一代IoT應(yīng)用提供支持的豐富工具。”

大型技術(shù)公司正在積極收購這一類別的初創(chuàng)公司,突顯了該技術(shù)的長(zhǎng)期戰(zhàn)略重要性。今年早些時(shí)候,蘋果以2億美元的價(jià)格收購了總部位于西雅圖的Xnor.ai。Xnor的技術(shù)將幫助蘋果在其iPhone和其他設(shè)備上部署邊緣AI功能。特斯拉在2019年收購了該領(lǐng)域的早期先驅(qū)者之一DeepScale,以支持對(duì)其車輛的推斷。

多年來,最重要的技術(shù)交易之一-英偉達(dá)上個(gè)月宣布的以400億美元收購Arm的交易-很大程度上是由于AI走向邊緣而加速向高效計(jì)算的轉(zhuǎn)變。

英偉達(dá)首席執(zhí)行官黃仁勛在談到這一交易時(shí)強(qiáng)調(diào)了這一點(diǎn):“能源效率是未來計(jì)算領(lǐng)域中最重要的一件事……英偉達(dá)和Arm將共同打造這個(gè)人工智能時(shí)代世界一流的計(jì)算公司。”

在未來的幾年中,人工智能將變得不受束縛、分散化和環(huán)境化,并在邊緣的數(shù)萬億種設(shè)備上運(yùn)行。模型壓縮是一項(xiàng)必不可少的促成技術(shù),它將幫助實(shí)現(xiàn)這一愿景。

5、生成人工智能

當(dāng)今的機(jī)器學(xué)習(xí)模型主要對(duì)現(xiàn)有數(shù)據(jù)進(jìn)行交織和分類:例如,識(shí)別人臉或識(shí)別欺詐。生成式AI是一個(gè)快速發(fā)展的新領(lǐng)域,它專注于構(gòu)建可生成自己新穎內(nèi)容的AI。簡(jiǎn)而言之,生成型人工智能將人工智能超越了感知到創(chuàng)造。

生成AI的核心是兩項(xiàng)關(guān)鍵技術(shù):生成對(duì)抗網(wǎng)絡(luò)(GAN)和變分自編碼器(VAE)。

兩種方法吸引人的是,GAN是Ian Goodfellow在AI先驅(qū)Yoshua Bengio在蒙特利爾大學(xué)攻讀博士學(xué)位時(shí)于2014年發(fā)明的。

Goodfellow在概念上的突破是使用兩個(gè)獨(dú)立的神經(jīng)網(wǎng)絡(luò)構(gòu)造GAN,然后將它們相互對(duì)抗。

從給定的數(shù)據(jù)集(例如,一張人臉照片的集合)開始,第一個(gè)神經(jīng)網(wǎng)絡(luò)(稱為“生成器”)開始生成新圖像,這些圖像在像素方面在數(shù)學(xué)上類似于現(xiàn)有圖像。同時(shí),第二個(gè)神經(jīng)網(wǎng)絡(luò)(“鑒別器”)被喂入照片而沒有被告知它們是來自原始數(shù)據(jù)集還是來自發(fā)生器的輸出。它的任務(wù)是識(shí)別合成的照片。

當(dāng)這兩個(gè)網(wǎng)絡(luò)不斷地互相作用時(shí)(生成器試圖欺騙鑒別器,鑒別器試圖暫緩生成器的創(chuàng)造物),它們彼此磨煉了能力。最終,判別器的分類成功率下降到50%,沒有比隨機(jī)猜測(cè)更好,這意味著合成生成的照片已經(jīng)與原始照片變得難以區(qū)分。

2016年,AI大神Yann LeCun稱GAN為“過去十年中機(jī)器學(xué)習(xí)中最有趣的想法”。

與GAN差不多同時(shí)推出的VAE是一種概念上相似的技術(shù),可以用作GAN的替代方法。

與GAN一樣,VAE由兩個(gè)神經(jīng)網(wǎng)絡(luò)組成,這兩個(gè)神經(jīng)網(wǎng)絡(luò)協(xié)同工作以產(chǎn)生輸出。第一個(gè)網(wǎng)絡(luò)(“編碼器”)獲取一條輸入數(shù)據(jù)并將其壓縮為較低維的表示形式。第二個(gè)網(wǎng)絡(luò)(“解碼器”)采用這種壓縮表示形式,并基于原始數(shù)據(jù)屬性的概率分布和隨機(jī)性函數(shù),生成新穎的輸出,將“riff”輸入到原始輸入。

通常,GAN的輸出質(zhì)量比VAE更高,但構(gòu)建起來更加困難且成本更高。

與更廣泛的人工智能類似,生成型AI激發(fā)了廣泛受益的和可怕的現(xiàn)實(shí)世界應(yīng)用。只有時(shí)間能說明哪個(gè)將占主導(dǎo)地位。

從積極的方面來看,生成AI的最有希望的用例之一是合成數(shù)據(jù)。合成數(shù)據(jù)是一種潛在的改變游戲規(guī)則的技術(shù),它使從業(yè)人員能夠數(shù)字化地構(gòu)建他們訓(xùn)練AI模型所需的確切數(shù)據(jù)集。

如今,訪問正確的數(shù)據(jù)既是AI的最重要也是最具挑戰(zhàn)性的部分。通常,為了訓(xùn)練深度學(xué)習(xí)模型,研究人員必須從現(xiàn)實(shí)世界中收集成千上萬個(gè)數(shù)據(jù)點(diǎn)。然后,他們必須在每個(gè)數(shù)據(jù)點(diǎn)上貼上標(biāo)簽,然后模型才能從數(shù)據(jù)中學(xué)習(xí)。這充其量是一個(gè)昂貴且耗時(shí)的過程。最糟糕的是,根本無法獲得所需的數(shù)據(jù)。

合成數(shù)據(jù)使從業(yè)人員能夠根據(jù)需要人為地創(chuàng)建高保真數(shù)據(jù)集,以適應(yīng)他們的精確需求,從而顛覆了這種范式。例如,使用合成數(shù)據(jù)方法,自動(dòng)駕駛汽車公司可以生成數(shù)十億個(gè)不同的駕駛場(chǎng)景供其車輛學(xué)習(xí),而無需在現(xiàn)實(shí)世界的街道上實(shí)際遇到這些場(chǎng)景中的每一個(gè)。

隨著合成數(shù)據(jù)準(zhǔn)確地逼近現(xiàn)實(shí)世界數(shù)據(jù),它將使AI民主化,削弱專有數(shù)據(jù)資產(chǎn)的競(jìng)爭(zhēng)優(yōu)勢(shì)。在可以按需廉價(jià)地生成數(shù)據(jù)的世界中,跨行業(yè)的競(jìng)爭(zhēng)動(dòng)態(tài)將被顛覆。

涌現(xiàn)出了一批有前途的初創(chuàng)公司來追逐這一機(jī)會(huì),包括Applied Intuition、Parallel Domain、AI.Reverie、Synthesis AI和Unlearn.AI。大型技術(shù)公司(包括Nvidia、Google和Amazon)也在大力投資于合成數(shù)據(jù)。合成數(shù)據(jù)的第一個(gè)主要商業(yè)用例是自動(dòng)駕駛汽車,但該技術(shù)正在迅速遍及各個(gè)行業(yè),從醫(yī)療保健到零售以及其他領(lǐng)域。

抵消合成數(shù)據(jù)的巨大積極潛力,另一種生成型AI應(yīng)用有可能對(duì)社會(huì)產(chǎn)生廣泛的破壞性影響:DeepFakes。

本質(zhì)上,DeepFakes技術(shù)使擁有計(jì)算機(jī)和互聯(lián)網(wǎng)連接的任何人都可以創(chuàng)建看起來真實(shí)逼真的照片和視頻,這些人所說的和做的事情實(shí)際上并沒有說或做,只是換了張別人的臉而已。

Deepfake技術(shù)已被廣泛應(yīng)用的第一個(gè)用例是成人內(nèi)容。根據(jù)初創(chuàng)公司Sensity在2019年7月的一份報(bào)告,在線上的Deepfake視頻中有96%是有關(guān)成人內(nèi)容的。 Deepfake幾乎總是在未經(jīng)同意的情況下進(jìn)行的,涉及人工合成具有著名名人或私人聯(lián)系人的露骨視頻。

從互聯(lián)網(wǎng)上的這些黑暗角落,DeepFakes的使用已開始蔓延到政治領(lǐng)域,在政治領(lǐng)域,危害更大。最近在加蓬、馬來西亞和巴西與DeepFakes相關(guān)的政治事件可能是即將發(fā)生的事的早期例子。

布魯金斯學(xué)會(huì)(Brookings Institution)在最近的一份報(bào)告中嚴(yán)厲地總結(jié)了DeepFakes帶來的一系列政治和社會(huì)危險(xiǎn):“扭曲民主言論;操縱選舉;削弱對(duì)機(jī)構(gòu)的信任;削弱新聞業(yè);加劇社會(huì)分化;破壞公共安全;并造成難以修復(fù)的著名人士,包括民選官員和公職候選人的名譽(yù)受到損害。”

合成數(shù)據(jù)和Deepfake的核心技術(shù)是相同的。然而,用例和潛在的現(xiàn)實(shí)世界影響卻截然相反。

技術(shù)上的一個(gè)大真理是,任何給定的創(chuàng)新都可能給人類帶來巨大的利益,也可能給社會(huì)帶來嚴(yán)重的傷害,這取決于人類選擇使用它的方式。核能確實(shí)如此;互聯(lián)網(wǎng)確實(shí)如此。人工智能同樣如此。生成式人工智能就是一個(gè)有力的例證。

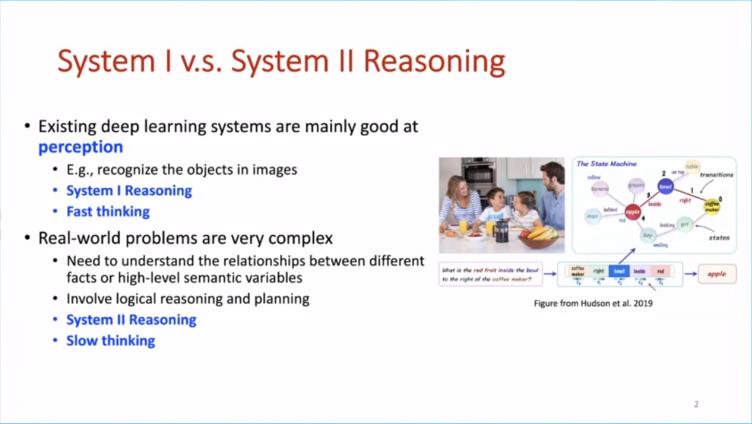

6、“syetem2”推理

諾貝爾獎(jiǎng)獲得者心理學(xué)家丹尼爾·卡尼曼(Daniel Kahneman)在其具有里程碑意義的著作《思考,快與慢》中普及了“系統(tǒng)1”思維和“系統(tǒng)2”思維的概念。

- system1是直覺系統(tǒng),主要負(fù)責(zé)快速、無意識(shí)、非語言的認(rèn)知,這是目前深度學(xué)習(xí)主要做的事情;

- system2是邏輯分析系統(tǒng),是有意識(shí)的、帶邏輯、規(guī)劃、推理以及可以語言表達(dá)的系統(tǒng)。這是未來深度學(xué)習(xí)需要著重考慮的。

system1的思維是直觀、快速、輕松而自動(dòng)的。system1的活動(dòng)示例包括識(shí)別朋友的臉,閱讀路過的廣告牌上的文字或填寫“戰(zhàn)爭(zhēng)與_______”一詞。system1幾乎不需要有意識(shí)的處理。

系統(tǒng)2的思考速度較慢,更具分析性和審議性。當(dāng)需要費(fèi)力的推理來解決抽象問題或處理新穎情況時(shí),人們會(huì)使用System 2思維。system1活動(dòng)的示例包括解決復(fù)雜的腦筋急轉(zhuǎn)彎或確定社交環(huán)境中特定行為的適當(dāng)性。

盡管system11 /system12框架是為分析人類認(rèn)知而開發(fā)的,但它可以很好地映射到當(dāng)今的人工智能世界。簡(jiǎn)而言之,當(dāng)今最先進(jìn)的AI系統(tǒng)在System 1任務(wù)上表現(xiàn)出色,但在System 2任務(wù)上卻舉步維艱。

AI領(lǐng)導(dǎo)者Andrew Ng對(duì)此進(jìn)行了很好的總結(jié):“如果一個(gè)典型的人可以花不到一秒鐘的時(shí)間完成一項(xiàng)心理任務(wù),那么我們現(xiàn)在或不久的將來都可以使用AI將其自動(dòng)化。”

Yoshua Bengio在NeurIPS的2019年主題演講中探索了這個(gè)確切的主題。 Bengio在演講中呼吁AI尋求新方法,使AI系統(tǒng)能夠從System 1任務(wù)擴(kuò)展到System 2功能,例如計(jì)劃、抽象推理、因果理解和開放式概括。

Bengio說:“我們希望擁有能夠理解世界的機(jī)器,能夠建立良好的世界模型,能夠理解因果關(guān)系,并且能夠在世界上采取行動(dòng)來獲取知識(shí)。”

有許多不同的方法來組織AI學(xué)科的議程、軌跡和抱負(fù)。但是,也許最強(qiáng)大、最緊湊的方式是這樣的:為了進(jìn)步,人工智能需要在system2思維上變得更好。

尚無人確切知道向System 2 AI邁進(jìn)的最佳方法。近年來,有關(guān)如何執(zhí)行此操作的爭(zhēng)論經(jīng)常引起爭(zhēng)議。這場(chǎng)辯論引發(fā)了關(guān)于智力概念的基本哲學(xué)問題。

Bengio堅(jiān)信,盡管可以對(duì)當(dāng)今的神經(jīng)網(wǎng)絡(luò)進(jìn)行進(jìn)一步的創(chuàng)新,但System 2推理可以在當(dāng)前的深度學(xué)習(xí)范例中實(shí)現(xiàn)。

Bengio在NeurIPS的主題演講中說:“有人認(rèn)為我們需要發(fā)明全新的東西來應(yīng)對(duì)這些挑戰(zhàn),也許可以回到經(jīng)典的AI來處理諸如高級(jí)認(rèn)知之類的問題。” “但是,我們現(xiàn)在有一條路,擴(kuò)展了深度學(xué)習(xí)的能力,可以解決認(rèn)知系統(tǒng)2的這類高級(jí)問題。”

Bengio指出,注意力機(jī)制,持續(xù)學(xué)習(xí)和元學(xué)習(xí)是深度學(xué)習(xí)中的現(xiàn)有技術(shù),它們對(duì)追求System 2 AI具有特別的希望。

但是,其他人則認(rèn)為,人工智能領(lǐng)域需要更根本的重置。

教授兼企業(yè)家Gary Marcus一直特別提倡非深度學(xué)習(xí)方法來研究System 2智能。 Marcus呼吁將神經(jīng)網(wǎng)絡(luò)與符號(hào)方法結(jié)合起來的混合解決方案,這種方法在AI研究的最初幾年中很流行,但最近卻不受歡迎。

“深度學(xué)習(xí)只是構(gòu)建智能機(jī)器的更大挑戰(zhàn)的一部分,” Marcus在現(xiàn)代深度學(xué)習(xí)時(shí)代來臨之際于2012年在《紐約客》上寫道。 “這類技術(shù)缺乏表達(dá)因果關(guān)系的方法,并且在獲取抽象思想時(shí)可能會(huì)面臨挑戰(zhàn)……。它們沒有明顯的邏輯推理方法,距離集成抽象知識(shí)(例如關(guān)于什么是對(duì)象,它們的用途以及通常的使用方式。”

Marcus與他人共同創(chuàng)立了機(jī)器人初創(chuàng)公司Robust.AI,以尋求通往可以推理的AI替代途徑。就在最近,Robust宣布完成了1500萬美元的A輪融資。

計(jì)算機(jī)科學(xué)家Judea Pearl是另一位主要思想家,他認(rèn)為通向System 2推理的道路不只是深度學(xué)習(xí)。 Pearl多年來一直倡導(dǎo)因果推理(理解因果關(guān)系的能力,而不僅僅是統(tǒng)計(jì)關(guān)聯(lián))是構(gòu)建真正智能機(jī)器的關(guān)鍵。正如Pearl最近所說:“深度學(xué)習(xí)的所有令人印象深刻的成就都等于曲線擬合。”

在本系列文章探討的六個(gè)AI領(lǐng)域中,最后一個(gè)目標(biāo)是最開放和抽象的。通往System 2 AI的途徑很多。前方的道路仍然迷霧重重。這可能是一個(gè)曲折的旅程,但是在我們有生之年,它將改變經(jīng)濟(jì)和世界。