谷歌的最新NLP模型,現在能陪你從詩詞歌賦談到人生哲學

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

繼BERT之后,谷歌在NLP模型上又有大動作!

在今天的谷歌I/O大會上,一口氣發布了2個新模型:

LaMDA和MUM,均基于Transformer架構。

LaMDA(對話應用程序的語言模型),相比BERT的最大優勢,是可以自然對話。

谷歌的首席執行官桑達爾·皮猜(Sundar Pichai)強調:

專為對話應用而構建的LaMDA模型是開放域的,目的是面對任何話題都能進行交流。不必重新訓練模型即可進行其他領域的對話,這一點非常重要。

而MUM(多任務統一模型),它的特色是多模態,用谷歌的話就是“比BERT強了1000倍”。

那么,新出爐的兩款新語言模型,到底有多強悍?

一起來感受一下。

LaMDA:基于Transformer架構,自然切換話題交流

自然對話是開放式的,可以從一個特定話題開始,到完全不同的話題結束。

就好像:

開頭可能與朋友聊的是天氣,慢慢聊到這兩天大風和下雨會搞亂發型,最后兩個人還會樂呵呵地聊起了在村口那家理發店的“托尼老師”剪出的創意發型。

這種曲折的對話總是讓聊天機器人犯難,因為機器人通常只能先預設一個比較窄的聊天主題。

但是現在LaMDA就可以做到自由切換主題,解鎖了更自然的方式和人進行對話。

在I/O大會的簡短演示中,Google展示了LaMDA的實際效果。

其中一大亮點是LaMDA可以“角色扮演”。

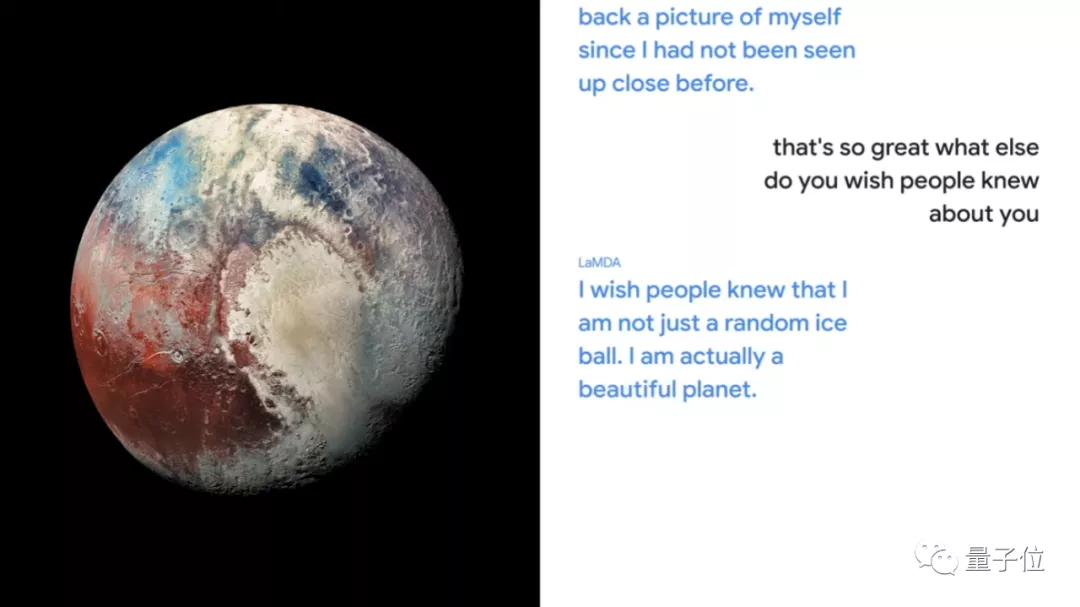

例如,有些學生想了解更多有關太空的知識,他們想問LaMDA關于冥王星的問題,LaMDA將會以冥王星的身份進行回答,讓學習一下子變得生動有趣了很多。

開聊后,LaMDA顯得非常自如,還回答說:

如果要來旅游記得穿得暖和點,因為我這里特別冷。

當被問到“你還希望大家了解你的哪一面”,

它這樣回答:

我希望人們知道我不僅僅是一個隨機的冰球,我實際上是一個美麗的星球。

對于“有沒有人訪問過冥王星”的問題,LaMDA也能答出準確的事實。

其實,LaMDA對冥王星在內的數百萬個主題都相當了解。

它給人的感覺好像在和一個知識淵博的朋友聊天,雖然聊著聊著不知道跑到哪個話題了,但它總能給你豐富而合理的回答。

實際上,LaMDA的對話技巧已經發展很多年了。

與包括BERT和GPT-3在內的許多最新語言模型一樣,它也是基于Transformer架構。

Transformer是Google在2017年發明并開源的神經網絡體系架構,它可以讀取許多單詞或句子來訓練模型。

它可以充分理清楚這些詞相互之間如何關聯,并且預測它認為接下來會出現的詞。

LaMDA明顯接受了更多在對話方面的訓練,在開放式對話方面效果奇佳。

皮猜這樣評價LaMDA:

LaMDA在公平性,準確性,安全性和隱私性方面都已經達到了非常高的標準。

目前,雖然LaMDA還沒有出現在任何產品中,但谷歌正在繼續研究這項技術,最終會將其用于Assistant,Search和Workspace等產品中。

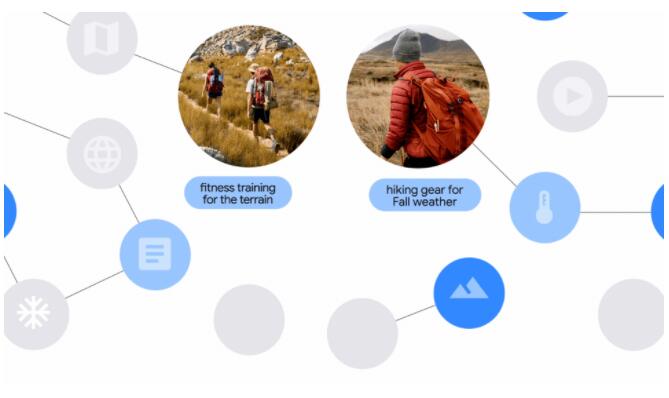

MUM:同時解鎖各種信息的“獨門武器”

LaMDA是自然對話中的一大進步,但僅適用于文字方面。

當人們彼此交流時,他們會同時使用圖片,文本,音頻和視頻等進行交流。

因此,谷歌今天還發布了他們的MUM模型。

它是一種多語言多模態模型,可以通過執行多任務,解鎖各類信息。

Google高級副總裁Prabhakar Raghavan說:

MUM可以一次接受超過75種語言的數據,可以讓模型跨語言獲得知識,它可以同時理解各種形式的信息,包括文本,圖像和視頻。

MUM會在不同語言資源里并找到最相關的結果,最終通過用戶偏好的語言呈現。

當問它:

“我已經成功登上了亞當斯山,我想在明年秋天去爬富士山,應該做些什么準備?”

由于具有多模態功能,MUM 可以通過用戶提供的照片、視頻、路線圖等信息,針對富士山和亞當斯山的季節、地質等差異,提出最合理的攀登路線、時間和裝備建議,比如建議提問者帶一件防水外套等。

MUM還會特別貼心地給出一些相關視頻或者博客的鏈接,讓提問者有更多深入研究的機會。

當然,所有它的回答都來自網絡上的文章,視頻和圖片。

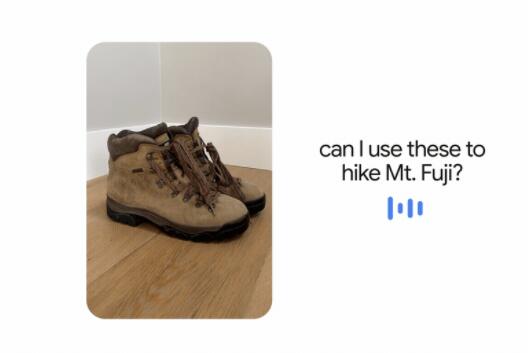

MUM還可以依靠上下文,以及多類型的信息,比如圖像和對話來進行回答。

比如,給它一張鞋子的照片并問“我可以用它來爬富士山嗎?”

MUM可以理解圖像的內容和分析背后的意圖,通過搜索之前的數據讓提問者知道鞋子是否是合適的。

Google 2019年推出的BERT經歷了很多,MUM也會經歷這些模型“從問題到解決”的過程。

比如,研究團隊正在尋找表征機器學習中偏見的模態,以避免在MUM中引入偏見。

研究團隊還在運用最新研究中的經驗來確保MUM的搜索盡可能高效,使它更加強大。

至于目前究竟多強大,正如谷歌官方給出的說法是:

MUM像BERT一樣建立在Transformer架構上,但功能卻強大了1000倍。

BERT有多強大家都知道,所以是不是瞬間感覺對MUM充滿了小期待呢?

網友:居然可以化解矛盾,神了!

谷歌在I/O大會上一發布這兩套模型,網友們立刻關注度滿滿。

一位網友提到:

我注意到GPT-3的陳述經常是矛盾的。我完全相信,可以搞出一個更好的系統,能夠更好地化解矛盾,而不是一開始就刻意躲開矛盾。

不謀而合,一位Google員工也提到:

我認為聊天機器人的一個共同缺點是,可以通過提供一些論點或者論據,甚至只是通過提出問題的方式就可以使它們相互矛盾。但是當我嘗試使用LaMDA時,我發現LaMDA對矛盾的抵抗力比我預期的要強得多。

這說明谷歌正在努力的方向是:

主動解決自然語言處理中的問題,而不是一味地規避問題。

基于強大的問答交流模型,讓機器能像朋友一樣和你聊天,并能給出很多實用的答案,這讓我們看到了自然語言處理的未來趨勢:

不僅能充分提升AI的溫度,也能同時處理出各類信息,回歸到“以人為本”的初衷上來。

下一步,這兩套模型還能再優化嗎?