單機訓練200億參數大模型:Cerebras打破新紀錄

本周,芯片創業公司 Cerebras 宣布了一個里程碑式的新進展:在單個計算設備中訓練了超過百億參數的 NLP(自然語言處理)人工智能模型。

由 Cerebras 訓練的 AI 模型體量達到了前所未有的 200 億參數,所有這些都無需橫跨多個加速器擴展工作負載。這項工作足以滿足目前網絡上最火的文本到圖像 AI 生成模型——OpenAI 的 120 億參數大模型 DALL-E。

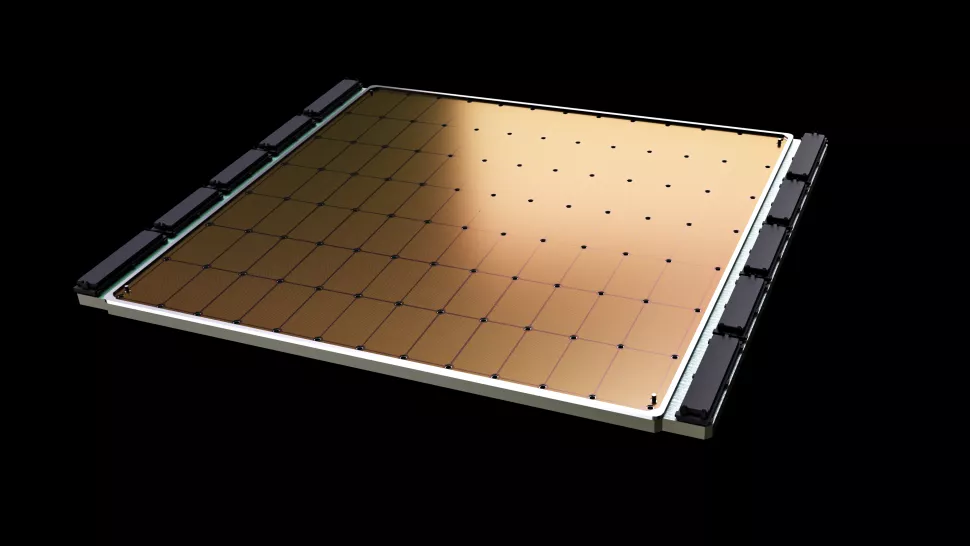

Cerebras 新工作中最重要的一點是對基礎設施和軟件復雜性的要求降低了。這家公司提供的芯片 Wafer Scale Engine-2(WSE2)顧名思義,蝕刻在單個臺積電 7 nm 制程的整塊晶圓上,該面積通常足以容納數百個主流芯片——具有驚人的 2.6 萬億個晶體管、85 萬個 AI 計算內核和 40 GB 集成緩存,封裝后功耗高達 15kW。

接近晶圓大小的 Wafer Scale Engine-2,面積比一個 iPad 還大。

雖然 Cerebras 的單機在體量上已經類似于超算了,但在單塊芯片中保留多達 200 億個參數的 NLP 模型仍然顯著降低了數千個 GPU 的訓練成本,以及相關的硬件和擴展要求,同時消除了在它們之間分割模型的技術困難。Cerebras 表示,后者是「NLP 工作負載中最痛苦的方面之一」,有時「需要幾個月才能完成」。

這是一個定制化的問題,不僅對每個正在處理的神經網絡,對于每個 GPU 的規格以及將它們聯系在一起的網絡都是獨一無二的——這些元素必須在第一次訓練開始之前提前設置好,而且也不能跨系統移植。

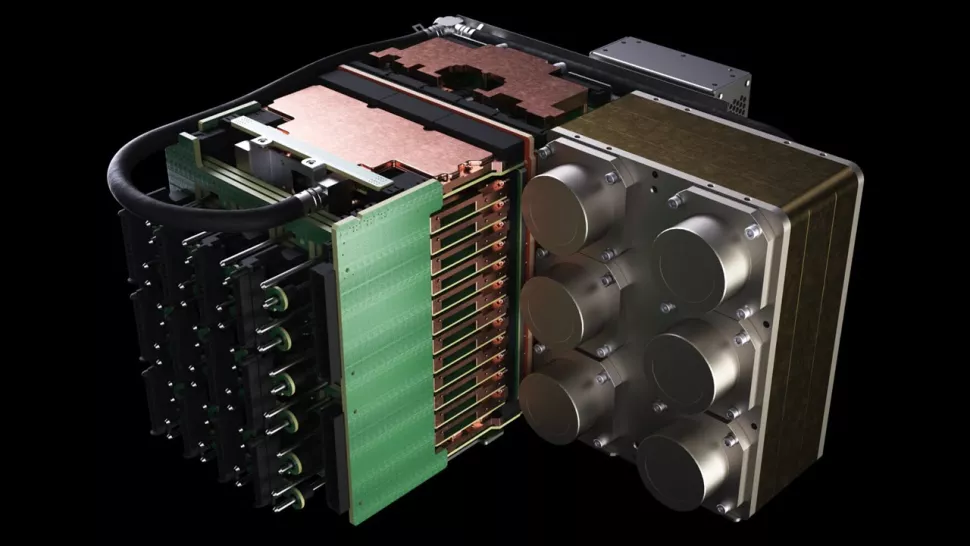

Cerebras 的 CS-2 是一個獨立的超級計算集群,其中包括 Wafer Scale Engine-2 芯片,所有相關的電源、內存和存儲子系統。

200 億的參數量大概是個什么水平?在人工智能領域里,大規模預訓練模型是最近各家科技公司和機構正在努力發展的方向,OpenAI 的 GPT-3 是一種 NLP 模型,它可以寫出足以欺騙人類讀者的整篇文章、做數學運算和翻譯,其具有驚人的 1750 億個參數。DeepMind 的 Gopher 于去年年底推出,將參數量的紀錄提高到 2800 億。

最近一段時間,谷歌大腦甚至宣布訓練了一個超過萬億參數的模型 Switch Transformer。

「在 NLP 領域中,體量更大的模型被證明效果更好。但傳統上,只有極少數公司擁有足夠的資源和專業知識來完成分解這些大型模型,將其分散到數百或數千個圖形處理單元的艱苦工作,」Cerebras 首席執行官、聯合創始人 Andrew Feldman 說道。「因此也只有極少數公司可以訓練大型 NLP 模型——這對于行業的其他人來說太昂貴、太耗時且無法使用。」

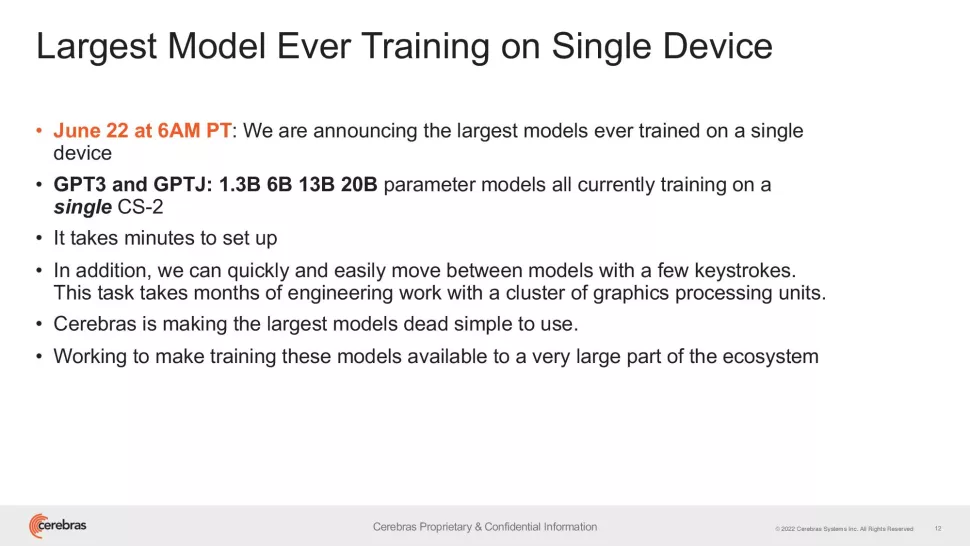

現在,Cerebras 的方法能夠降低 GPT-3XL 1.3B、GPT-J 6B、GPT-3 13B 和 GPT-NeoX 20B 模型的應用門檻,使整個 AI 生態系統能夠在幾分鐘內建立大型模型,并在單個 CS-2 系統上訓練它們 。

然而,就像旗艦級 CPU 的時鐘速度一樣,參數量只是大模型性能的其中一項指標。最近,一些研究在減少參數的前提下已經取得了更好的結果,例如 DeepMind 今年 4 月提出的 Chinchilla,只用 700 億個參數就在常規情況下超過了 GPT-3 和 Gopher。

這類研究的目標當然是更智能的工作,而不是更努力地工作。因此 Cerebras 的成就比人們第一眼看到的更為重要——該研究讓我們相信現有的芯片制程水平能夠適應日益復雜的模型,該公司表示,以特殊芯片為核心的系統具備了支撐「數千億甚至數萬億參數」模型的能力。

在單芯片上可訓練參數量的爆炸式增長需要依賴 Cerebras 的 Weight Streaming 技術。該技術可以將計算和內存占用分離,根據 AI 工作負載中快速增長的參數量,允許內存進行任意量級的擴展。這使得設置時間從幾個月減少到幾分鐘,并且可以在 GPT-J 和 GPT-Neo 等型號之間切換。正如研究者所說:「只需要敲幾次鍵盤。」

「Cerebras 以低成本、便捷的方式向人們提供了運行大型語言模型的能力,開啟了人工智能令人興奮的新時代。它為那些不能花費數千萬美元的組織提供了一個簡單而廉價的,參與到大模型競爭之中的方式,」Intersect360 研究公司的首席研究官 Dan Olds 說道。「當 CS-2 客戶在大量數據集上訓練 GPT-3 和 GPT-J 級模型時,我們非常期待 CS-2 客戶的新應用和新發現。」