谷歌、MIT「迭代共同認證」視頻問答模型:SOTA性能,算力少用80%

視頻是一種無處不在的媒體內容源,涉及到人們日常生活的許多方面。越來越多的現實世界的視頻應用,如視頻字幕、內容分析和視頻問答(VideoQA),都依賴于能夠將視頻內容與文本或自然語言聯系起來的模型。

其中,視頻問答模型尤其具有挑戰性,因為它需要同時掌握語義信息,比如場景中的目標,以及時間信息,比如事物如何移動和互動。這兩種信息都必須在擁有特定意圖的自然語言問題的背景下進行。 此外,由于視頻有許多幀,處理全部的幀來學習時空信息,可能在計算上成本過高。

論文鏈接:https://arxiv.org/pdf/2208.00934.pdf 為了解決這個問題,在「Video Question Answering with Iterative Video-Text Co-Tokenization」一文中,谷歌和MIT的研究人員介紹了一種視頻-文本學習的新方法,稱為「迭代共同標記」,能夠有效地融合空間、時間和語言信息,用于視頻問答的信息處理。

這種方法是多流的,用獨立的骨干模型處理不同規模的視頻,產生捕捉不同特征的視頻表示,例如高空間分辨率或長時間的視頻。 模型應用「共同認證」模塊,從視頻流與文本的融合中學習有效表示。模型計算效率很高,只需67GFLOPs,比以前的方法至少低了50%,同時比其他SOTA的模型有更好的性能。

視頻-文本迭代

該模型的主要目標是從視頻和文本(即用戶問題)中產生特征,共同允許它們的相應輸入進行互動。第二個目標是以有效的方式做到這一點,這對視頻來說非常重要,因為它們包含幾十到幾百幀的輸入。

? 該模型學會了將視頻-語言的聯合輸入標記為較小的標記集,以聯合和有效地代表兩種模式。在標記化時,研究人員使用兩種模式來產生一個聯合的緊湊表示,該表示被送入一個轉換層以產生下一級的表示。

這里的一個挑戰,也是跨模態學習中的典型問題,就是視頻幀往往并不直接對應于相關的文本。研究人員通過增加兩個可學習的線性層來解決這個問題,在標記化之前,統一視覺和文本特征維度。這樣一來,研究人員就可以讓視頻和文本都能制約視頻標記的學習方式。

此外,單一的標記化步驟不允許兩種模式之間的進一步互動。為此,研究人員使用這個新的特征表示與視頻輸入特征互動,并產生另一組標記化的特征,然后將其送入下一個轉化器層。 這個迭代過程中會創建新的特征或標記,表示對兩種模式的聯合表示的不斷完善。最后,這些特征被輸入到生成文本輸出的解碼器中。

按照視頻質量評估的慣例,在對個別視頻質量評估數據集進行微調之前,研究人員對模型進行預訓練。 在這項工作中,研究人員使用基于語音識別的文本自動注釋的視頻,使用HowTo100M數據集,而不是在大型VideoQA數據集上預訓練。這種較弱的預訓練數據仍然使研究人員的模型能夠學習視頻-文本特征。

高效視頻問答的實現

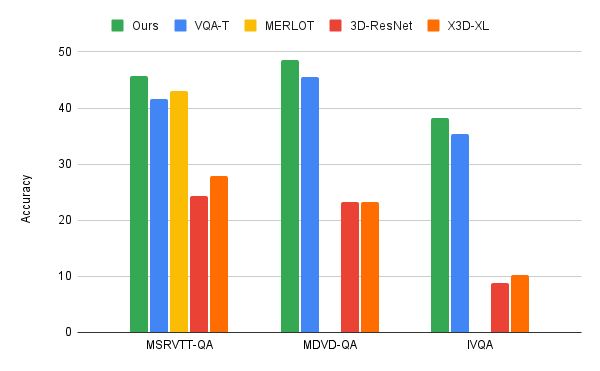

研究人員將視頻語言迭代共同認證算法應用于三個主要的VideoQA基準,MSRVTT-QA、MSVD-QA和IVQA,并證明這種方法比其他最先進的模型取得了更好的結果,同時模型不至于過大。另外,迭代式共同標記學習在視頻-文本學習任務上對算力的需求也更低。

該模型只用67GFLOPS算力,是3D-ResNet視頻模型和文本時所需算力(360GFLOP)的六分之一,是X3D模型效率的兩倍多。并且生成了高度準確的結果,精度超過了最先進的方法。

多流視頻輸入

對于VideoQA或其他一些涉及視頻輸入的任務,研究人員發現,多流輸入對于更準確地回答有關空間和時間關系的問題很重要。

研究人員利用三個不同分辨率和幀率的視頻流:一個低分辨率、高幀率的輸入視頻流(每秒32幀,空間分辨率64x64,記作32x64x64);一個高分辨率、低幀率的視頻(8x224x224);以及一個介于兩者之間的(16x112x112)。

盡管有三個數據流需要處理的信息顯然更多,但由于采用了迭代共同標記方法,獲得了非常高效的模型。同時,這些額外的數據流允許提取最相關的信息。

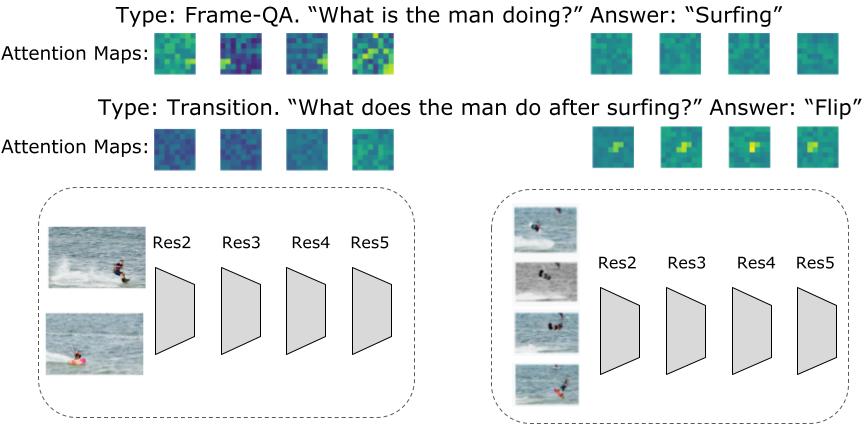

例如,如下圖所示,與特定活動相關的問題在分辨率較低但幀率較高的視頻輸入中會產生較高的激活,而與一般活動相關的問題可以從幀數很少的高分辨率輸入中得到答案。

這種算法的另一個好處是,標記化會根據所問問題的不同而改變。

結論

研究人員提出了一種新的視頻語言學習方法,它側重于跨視頻-文本模式的聯合學習。研究人員解決了視頻問題回答這一重要而具有挑戰性的任務。研究人員的方法既高效又準確,盡管效率更高,但卻優于目前最先進的模型。

谷歌研究人員的方法模型規模適度,可以通過更大的模型和數據獲得進一步的性能改進。研究人員希望,這項工作能引發視覺語言學習方面的更多研究,以實現與基于視覺的媒體的更多無縫互動。