一次性分割一切,比SAM更強,華人團隊的通用分割模型SEEM來了

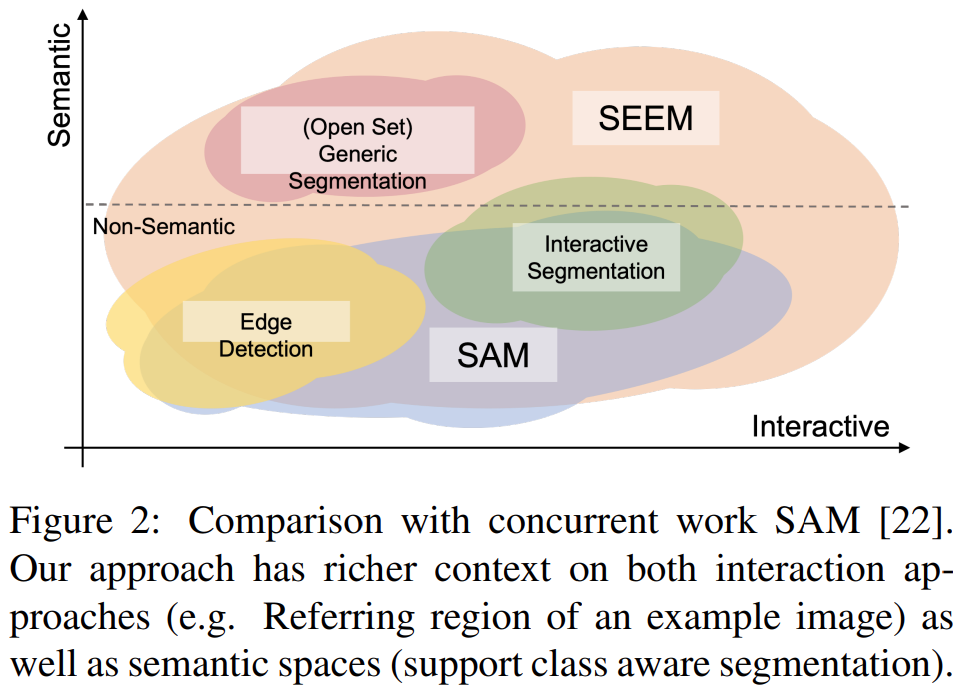

本月初,Meta 發布「分割一切」AI 模型 ——Segment Anything Model(SAM)。SAM 被認為是一個通用的圖像分割基礎模型,它學會了關于物體的一般概念,可以為任何圖像或視頻中的任何物體生成 mask,包括在訓練過程中沒有遇到過的物體和圖像類型。這種「零樣本遷移」的能力令人驚嘆,甚至有人稱 CV 領域迎來了「GPT-3 時刻」。

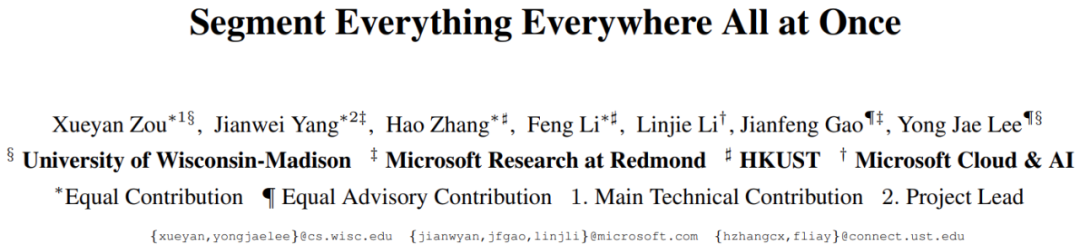

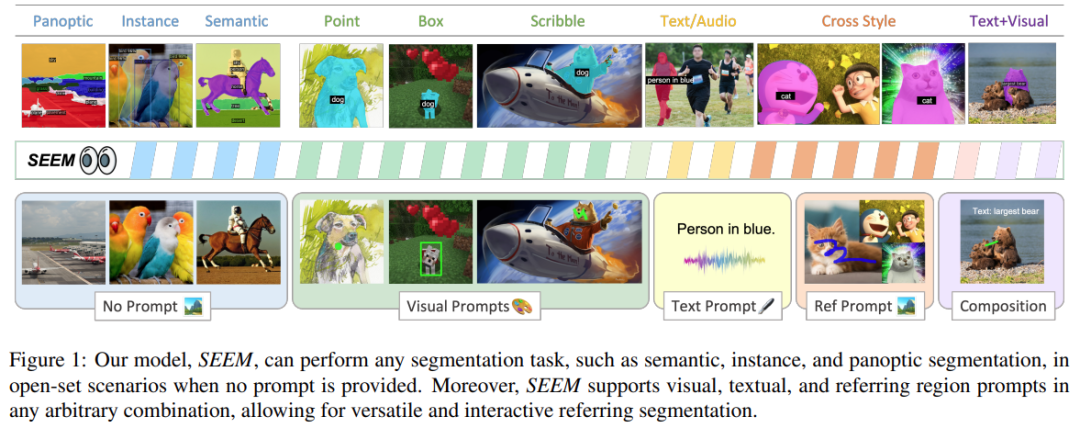

最近,一篇「一次性分割一切」的新論文《Segment Everything Everywhere All at Once》再次引起關注。在該論文中,來自威斯康星大學麥迪遜分校、微軟、香港科技大學的幾位華人研究者提出了一種基于 prompt 的新型交互模型 SEEM。SEEM 能夠根據用戶給出的各種模態的輸入(包括文本、圖像、涂鴉等等),一次性分割圖像或視頻中的所有內容,并識別出物體類別。該項目已經開源,并提供了試玩地址供大家體驗。

論文鏈接:https://arxiv.org/pdf/2304.06718.pdf

項目鏈接:https://github.com/UX-Decoder/Segment-Everything-Everywhere-All-At-Once

試玩地址:https://huggingface.co/spaces/xdecoder/SEEM

該研究通過全面的實驗驗證了 SEEM 在各種分割任務上的有效性。即使 SEEM 不具有了解用戶意圖的能力,但它表現出強大的泛化能力,因為它學會了在統一的表征空間中編寫不同類型的 prompt。此外,SEEM 可以通過輕量級的 prompt 解碼器有效地處理多輪交互。

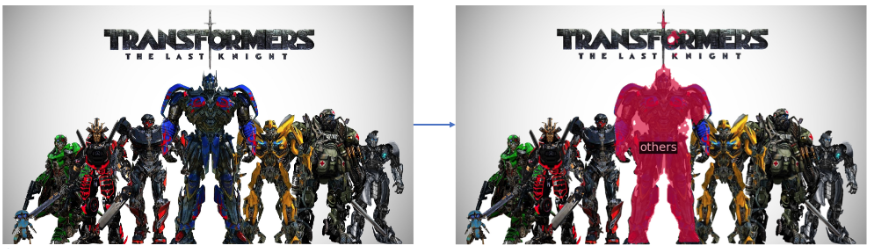

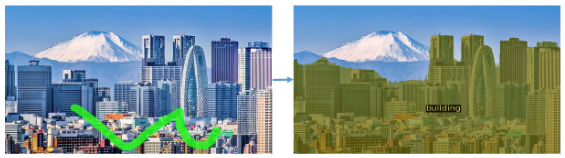

先來看一下分割效果:

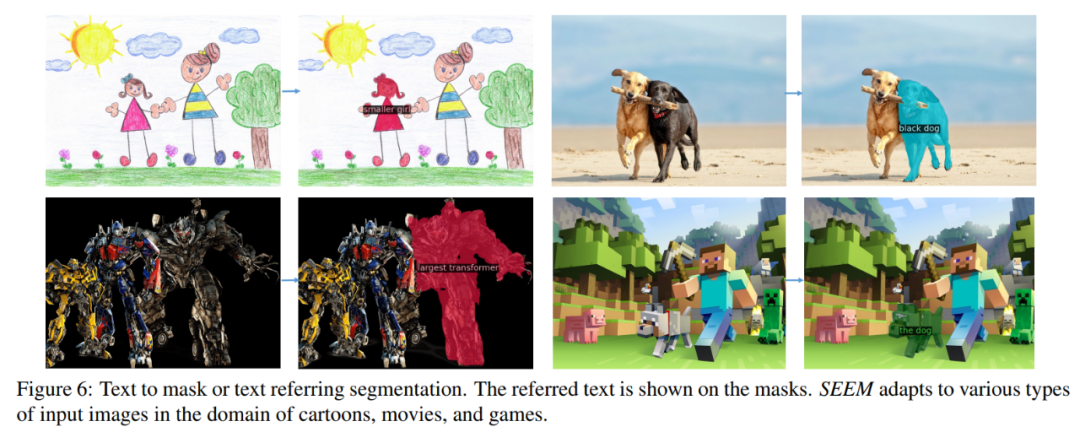

在變形金剛的合影中把「擎天柱」分割出來:

還能對一類物體做分割,比如在一張景觀圖片中分割出所有建筑物:

SEEM 也能輕松分割出視頻中移動的物體:

這個分割效果可以說是非常絲滑了。我們來看一下該研究提出的方法。

方法概述

該研究旨在提出一個通用接口,以借助多模態 prompt 進行圖像分割。為了實現這一目標,他們提出了一種包含 4 個屬性的新方案,包括多功能性(versatility)、組合性(compositionality)、交互性(interactivity)和語義感知能力(semantic-awareness),具體包括

1)多功能性該研究提出將點、掩碼、文本、檢測框(box)甚至是另一個圖像的參考區域(referred region)這些異構的元素,編碼成同一個聯合視覺語義空間中的 prompt。

2)組合性通過學習視覺和文本 prompt 的聯合視覺語義空間來即時編寫查詢以進行推理。SEEM 可以處理輸入 prompt 的任意組合。

3)交互性:該研究引入了通過結合可學習的記憶(memory) prompt,并通過掩碼指導的交叉注意力保留對話歷史信息。

4)語義感知能力:使用文本編碼器對文本查詢和掩碼標簽進行編碼,從而為所有輸出分割結果提供了開放集語義。

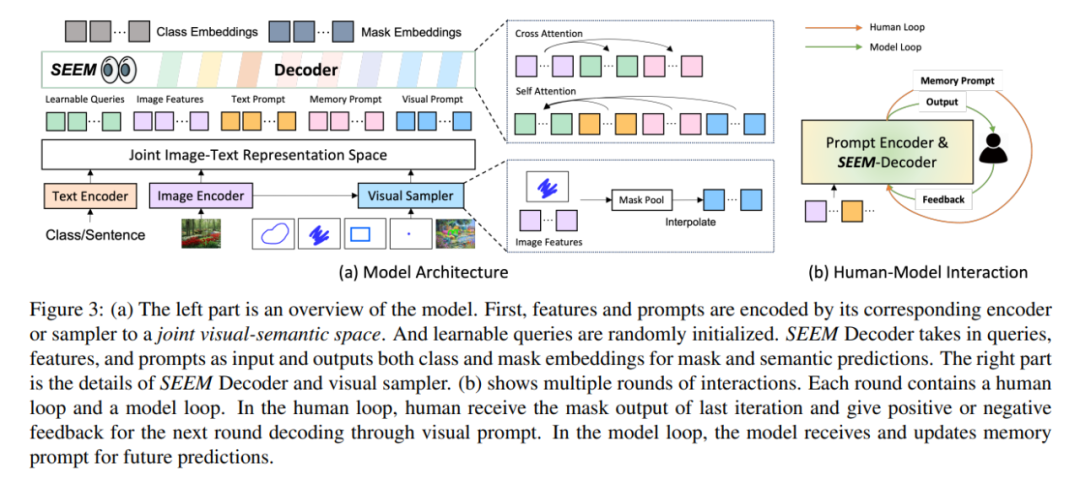

架構方面,SEEM 遵循一個簡單的 Transformer 編碼器 - 解碼器架構,并額外添加了一個文本編碼器。在 SEEM 中,解碼過程類似于生成式 LLM,但具有多模態輸入和多模態輸出。所有查詢都作為 prompt 反饋到解碼器,圖像和文本編碼器用作 prompt 編碼器來編碼所有類型的查詢。

具體來說,該研究將所有查詢(如點、框和掩碼)編碼為視覺 prompt,同時使用文本編碼器將文本查詢轉換為文本 prompt,這樣視覺和文本 prompt 就能保持對齊。5 種不同類型的 prompt 都能都映射到聯合視覺語義空間中,通過零樣本適應來處理未見過的用戶 prompt。通過對不同的分割任務進行訓練,模型具有處理各種 prompt 的能力。此外,不同類型的 prompt 可以借助交叉注意力互相輔助。最終,SEEM 模型可以使用各種 prompt 來獲得卓越的分割結果。

除了強大的泛化能力,SEEM 在運行方面也很高效。研究人員將 prompt 作為解碼器的輸入,因此在與人類進行多輪交互時,SEEM 只需要在最開始運行一次特征提取器。在每次迭代中,只需要使用新的 prompt 再次運行一個輕量級的解碼器。因此,在部署模型時,參數量大運行負擔重的特征提取器可以在服務器上運行,而在用戶的機器上僅運行相對輕量級的解碼器,以緩解多次遠程調用中的網絡延遲問題。

如上圖 3(b)所示,在多輪交互中,每次交互包含一個人工循環和一個模型循環。在人工循環中,人接收上一次迭代的掩碼輸出,并通過視覺 prompt 給出下一輪解碼的正反饋或負反饋。在模型循環中,模型接收并更新記憶 prompt 供未來的預測。

實驗結果

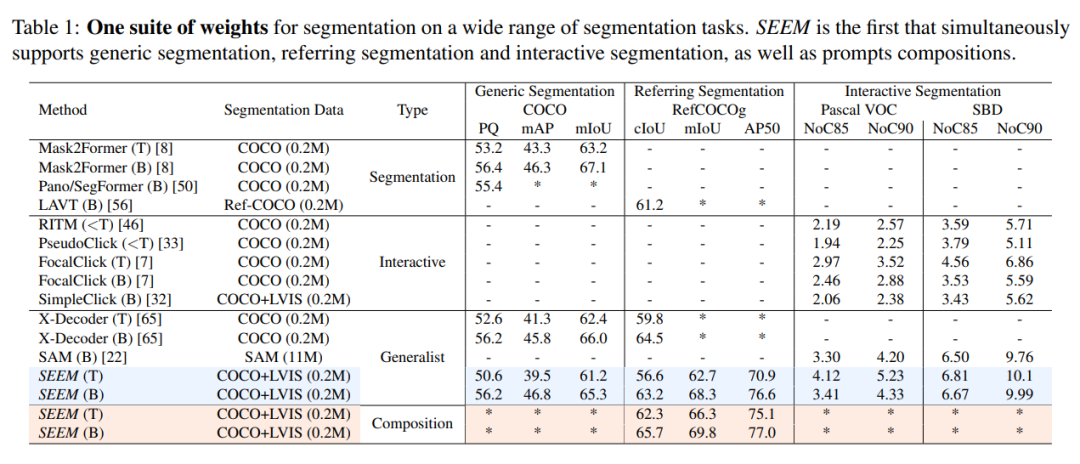

該研究將 SEEM 模型與 SOTA 交互式分割模型進行了實驗比較,結果如下表 1 所示。

作為一個通用模型,SEEM 實現了與 RITM,SimpleClick 等模型相當的性能,并且與 SAM 的性能非常接近,而 SAM 用于訓練的分割數據是 SEEM 的 50 倍之多。

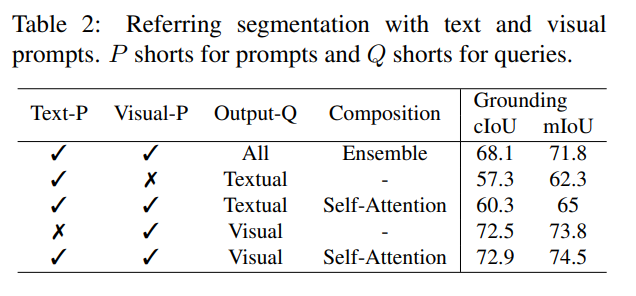

與現有的交互式模型不同,SEEM 是第一個不僅支持經典分割任務,還支持各種用戶輸入類型的通用接口,包括文本、點、涂鴉、框和圖像,提供強大的組合功能。如下表 2 所示,通過添加可組合的 prompt,SEEM 在 cIoU,mIoU 等指標上有了顯著的分割性能提升。

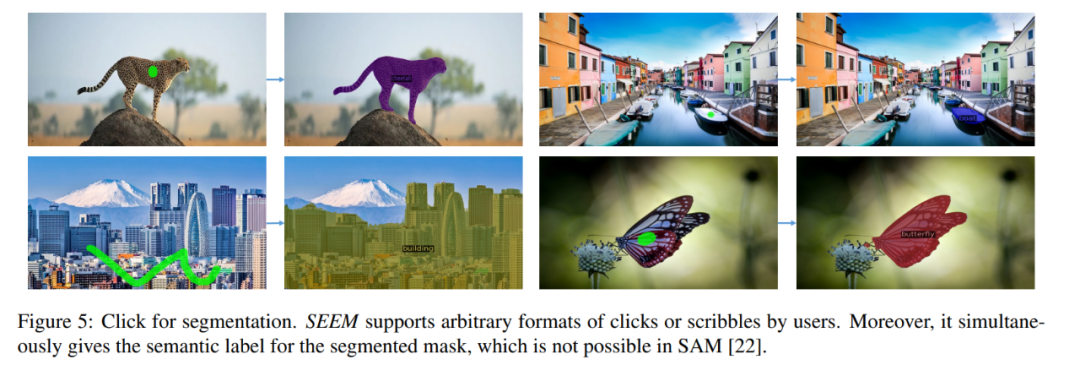

我們再來看一下交互式圖像分割的可視化結果。用戶只需要畫出一個點或簡單涂鴉,SEEM 就能提供非常好的分割結果

也可以輸入文本,讓 SEEM 進行圖像分割

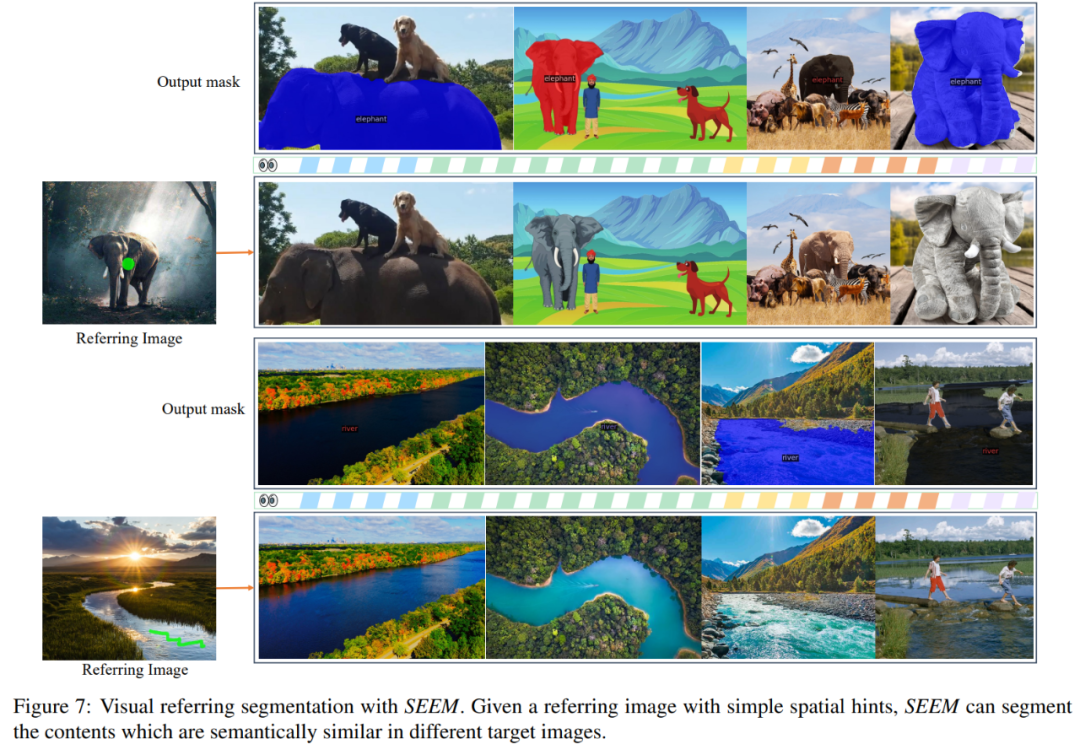

還能直接輸入參考圖像并指出參考區域,對其他圖像進行分割,找出與參考區域一致的物體:

該項目已經可以線上試玩,感興趣的讀者快去試試吧。