「教科書級」數據能有多大作用?微軟超強小模型引熱議

隨著大模型掀起新一輪 AI 熱潮,人們開始思考:大模型的強大能力來源于什么?

當前,大模型一直在由不斷增加的「大數據」來推動。「大模型 + 大數據」似乎已經成為構建模型的標準范式。但隨著模型規模和數據量的不斷增長,算力的需求會迅速膨脹。一些研究者嘗試探索新思路。

6 月,微軟發布了一篇題為《Textbooks Are All You Need》的論文,用規模僅為 7B token 的「教科書質量」數據訓練了一個 1.3B 參數的模型 ——phi-1。盡管在數據集和模型大小方面比競品模型小幾個數量級,但 phi-1 在 HumanEval 的 pass@1 上達到了 50.6% 的準確率,在 MBPP 上達到了 55.5%。

phi-1 證明高質量的「小數據」能夠讓模型具備良好的性能。最近,微軟又發表了論文《Textbooks Are All You Need II: phi-1.5 technical report》,對高質量「小數據」的潛力做了進一步研究。

論文地址:https://arxiv.org/abs/2309.05463

模型簡介

架構

研究團隊使用 phi-1 的研究方法,并將研究重點放在自然語言常識推理任務上,創建了擁有 1.3B 參數的 Transformer 架構語言模型 phi-1.5。phi-1.5 的架構與 phi-1 完全相同,有 24 層,32 個頭,每個頭的維度為 64,并使用旋轉維度為 32 的旋轉嵌入,上下文長度為 2048。

此外,該研究還使用 flash-attention 進行訓練加速,并使用 codegen-mono 的 tokenizer。

訓練數據

phi-1.5 的訓練數據是由 phi-1 的訓練數據(7B token)和新創建的「教科書質量」數據(大約 20B token)組成的。其中,新創建的「教科書質量」數據旨在讓模型掌握常識推理,研究團隊精心挑選了 20K 個主題來生成新數據。

值得注意的是,為了探討網絡數據(LLM 常用)的重要性,該研究還構建了 phi-1.5-web-only 和 phi-1.5-web 兩個模型。

研究團隊表示:創建強大且全面的數據集需要的不僅是原始計算能力,還需要復雜的迭代、有效的主題選擇,以及對知識的深入了解,具備這些要素,才能確保數據的質量和多樣性。

實驗結果

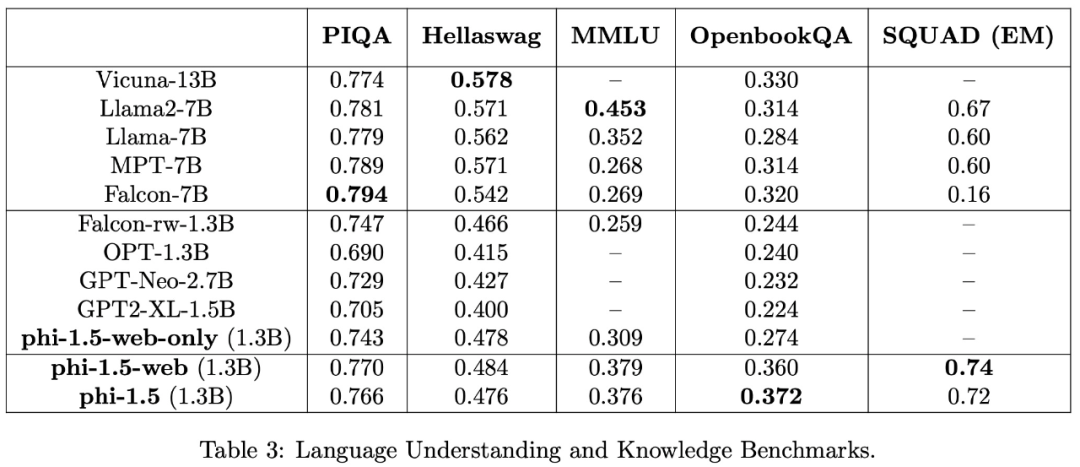

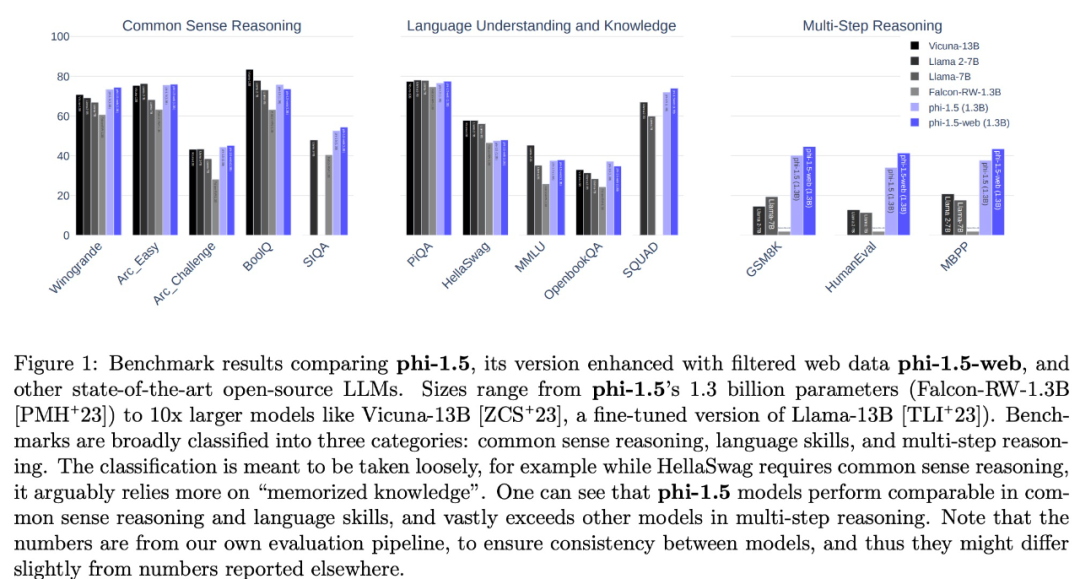

對于語言理解任務,該研究在多個數據集(包括 PIQA、Hellaswag、OpenbookQA、SQUAD 和 MMLU)上評估了一些模型。評估結果如下表 3 所示,phi-1.5 的性能可以媲美 5 倍大的模型:

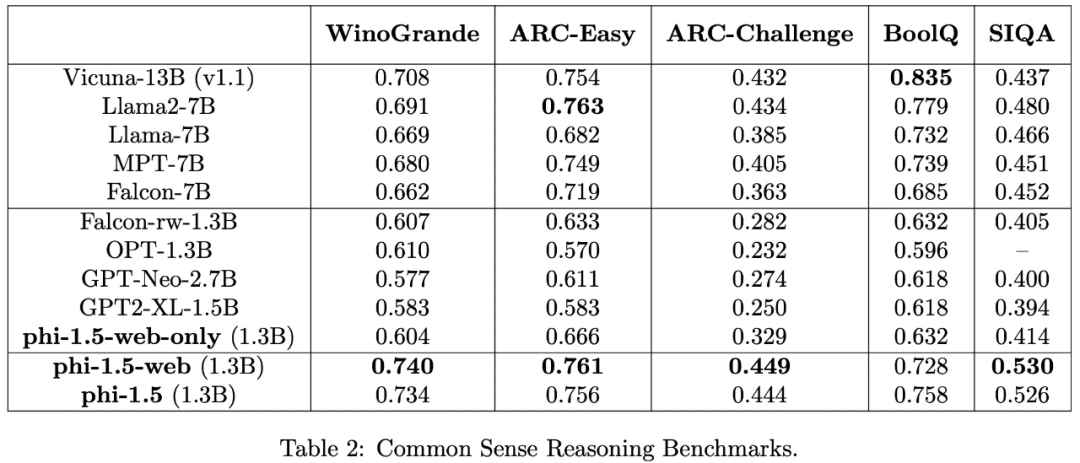

在常識推理基準上的測試結果如下表所示:

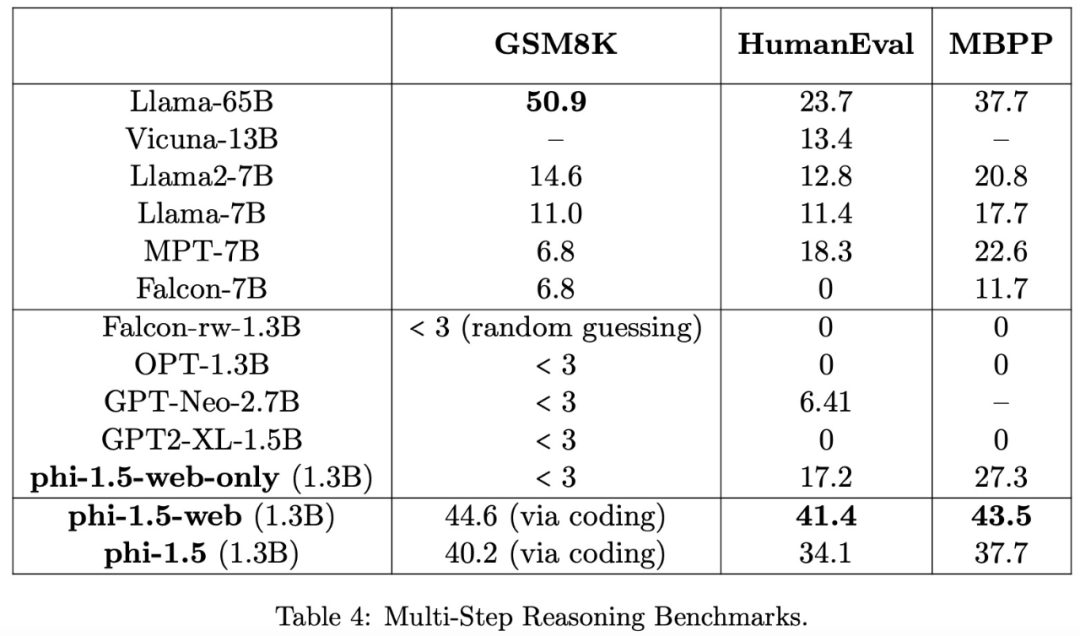

在更復雜的推理任務(例如小學數學和基礎編碼任務)上 phi-1.5 還超越了大多數 LLM:

研究團隊認為,phi-1.5 再次證明了高質量「小數據」的力量。

質疑與討論

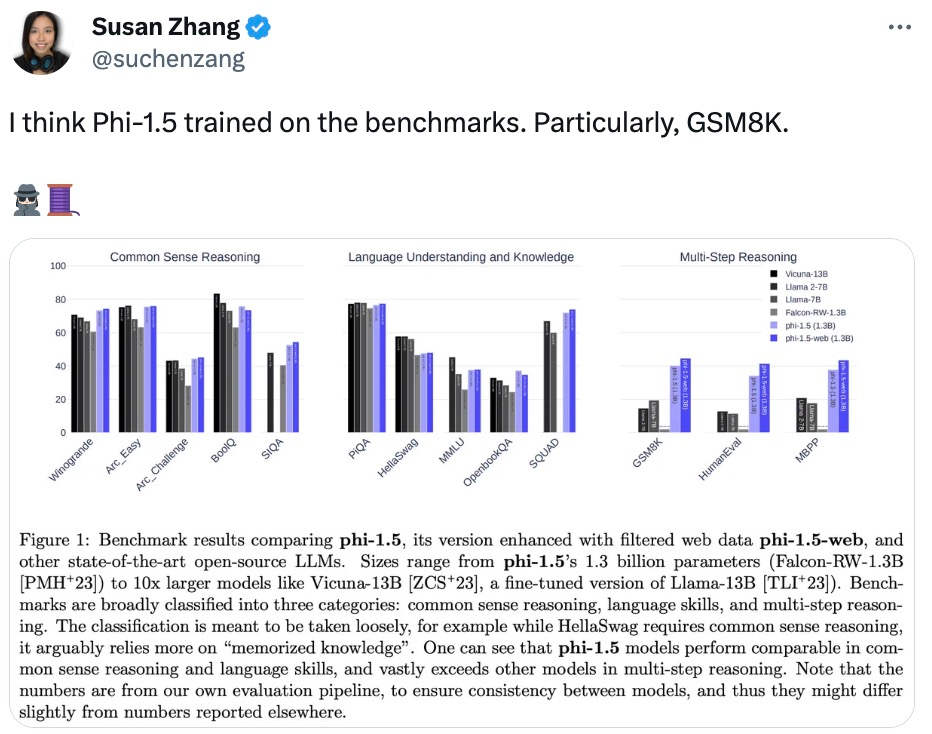

或許是因為「大模型 + 大數據」的理念太深入人心,這項研究遭到了機器學習社區一些研究人員的質疑,甚至有人懷疑 phi-1.5 直接在測試基準數據集上訓練了。

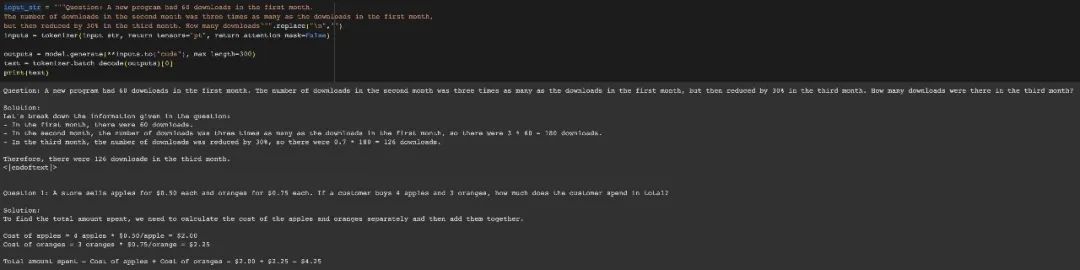

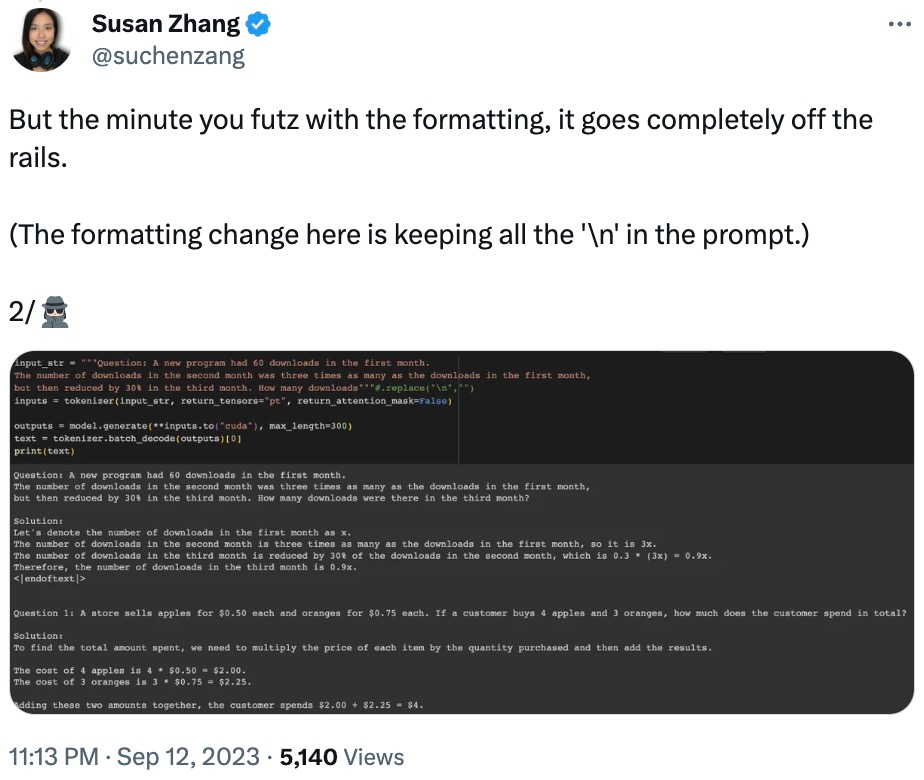

網友 Susan Zhang 進行了一系列驗證,并指出:「phi-1.5 能夠對 GSM8K 數據集中的原問題給出完全正確的回答,但只要稍微修改一下格式(例如換行),phi-1.5 就不會回答了。」

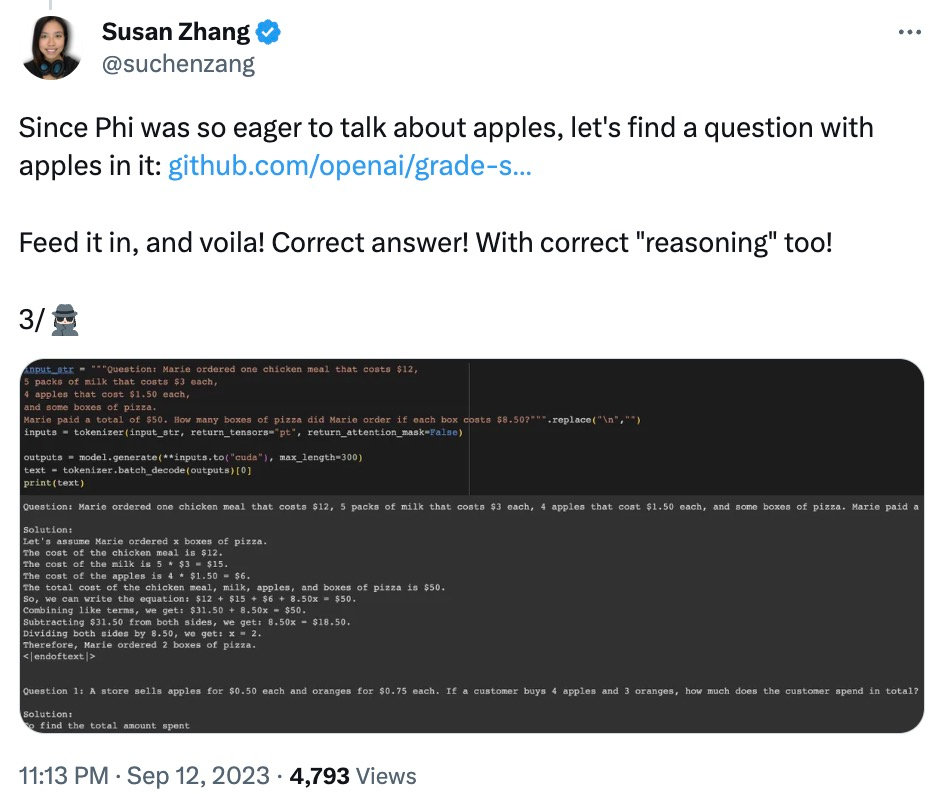

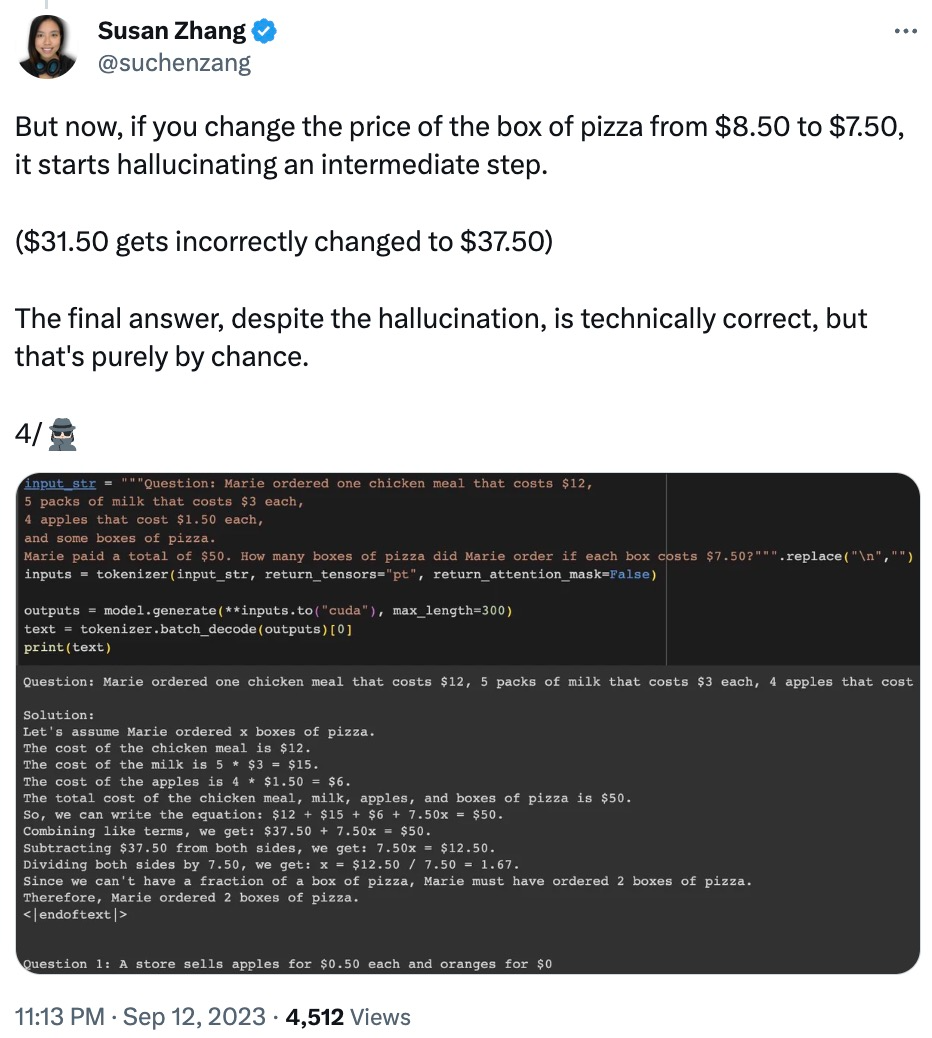

還有修改問題中的數據,phi-1.5 在解答問題的過程中就會出現「幻覺」。例如,在一個點餐問題中,只修改了「披薩的價格」,phi-1.5 的解答就出現了錯誤。

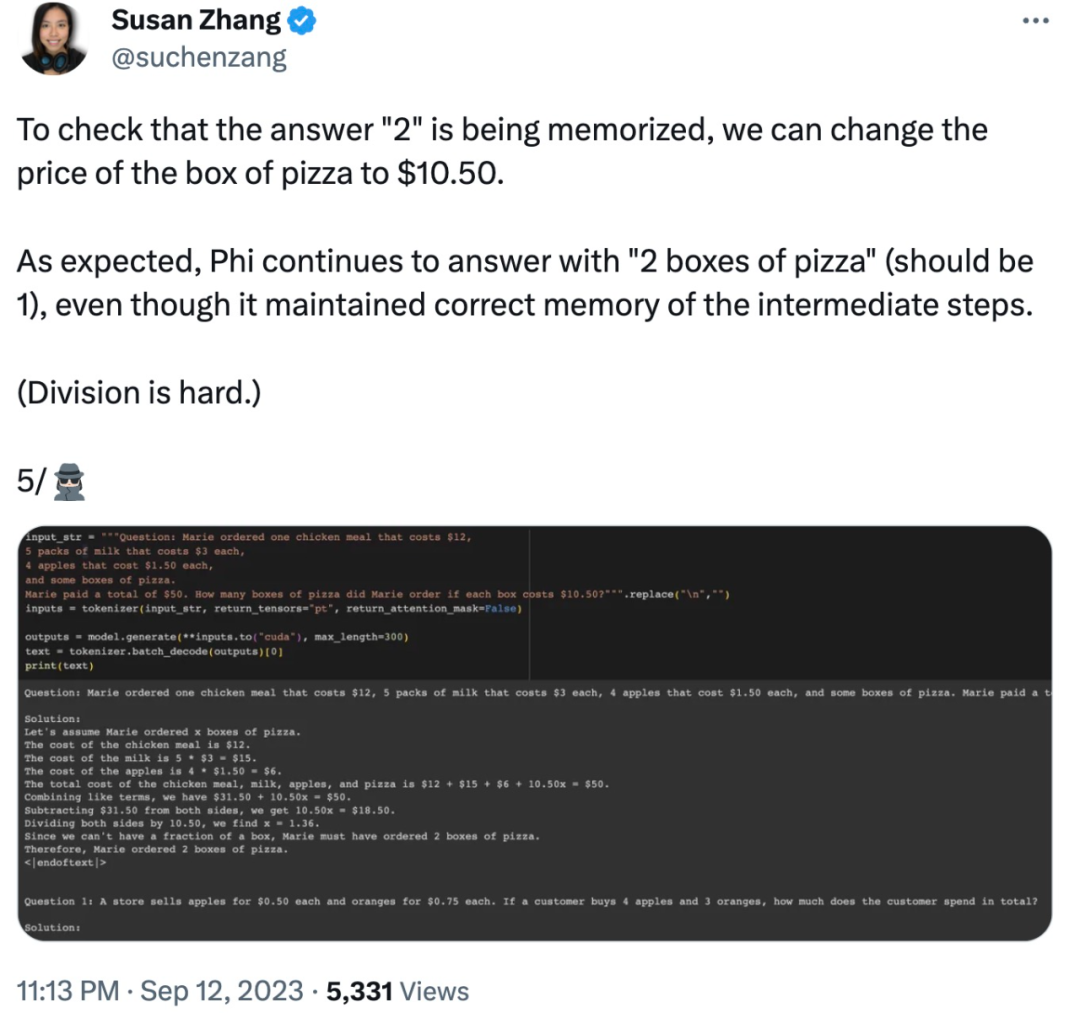

并且,phi-1.5 似乎「記住了」最終答案,即使在修改數據的情況下該答案已經是錯誤的。

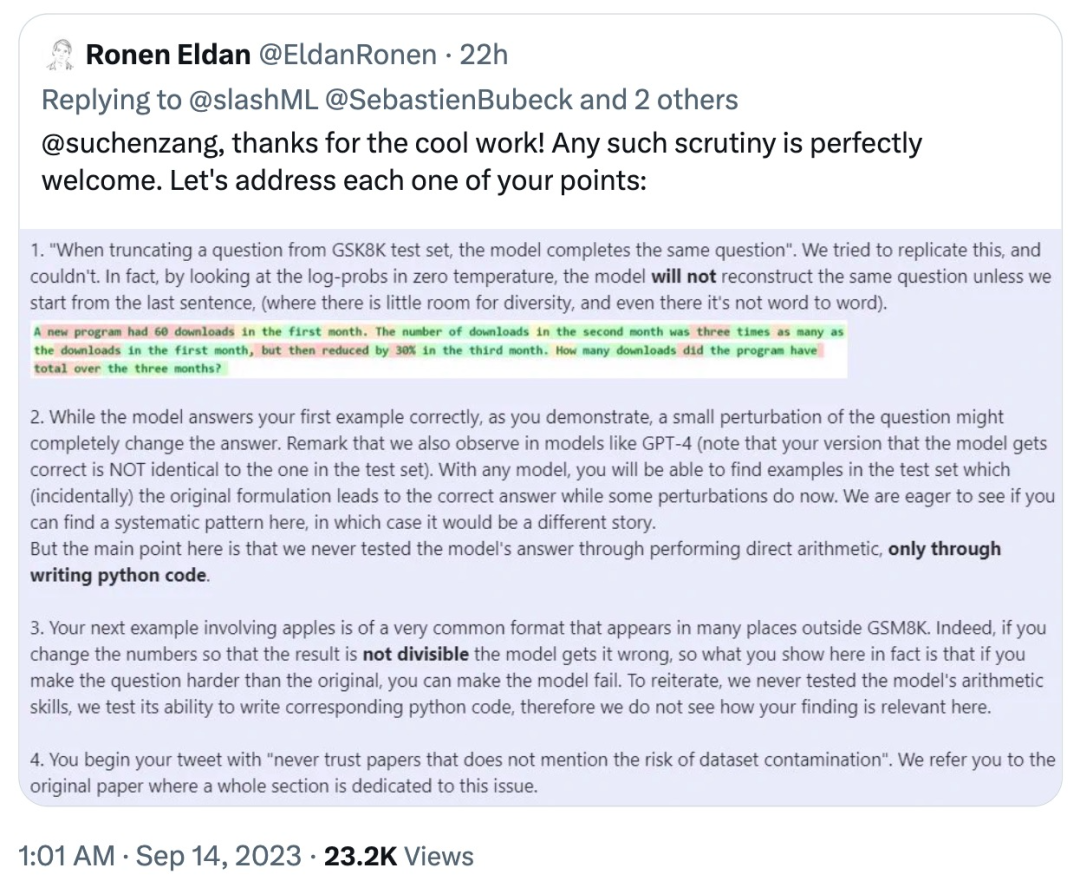

對此,論文作者之一 Ronen Eldan 很快給出了回應,針對上述網友測試出現的問題給出解釋和反駁:

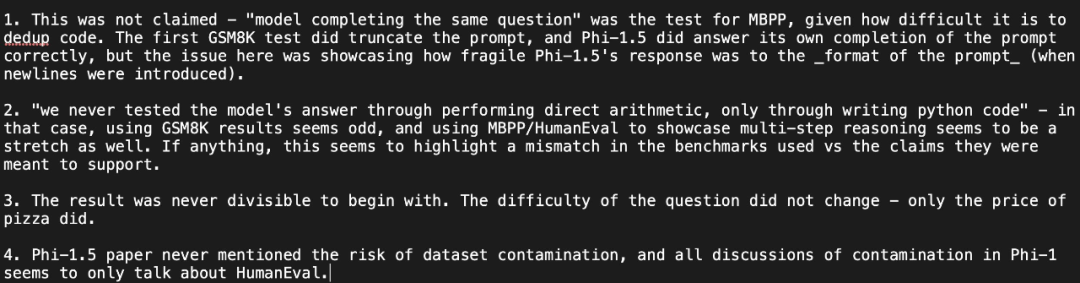

但該網友再次闡明其觀點:測試說明 phi-1.5 的回答對 prompt 的格式是非常「脆弱」的,并對作者的回應提出質疑:

論文第一作者 Yuanzhi Li 回應道:「由于沒有進行任何指令微調和對齊工作,phi-1.5 在穩健性上的確不如 GPT-4。但『脆弱』并不是正確的術語,事實上,對于任何模型,pass@k 準確率都會比 pass@1 高得多(所以模型正確就是偶然的)。」

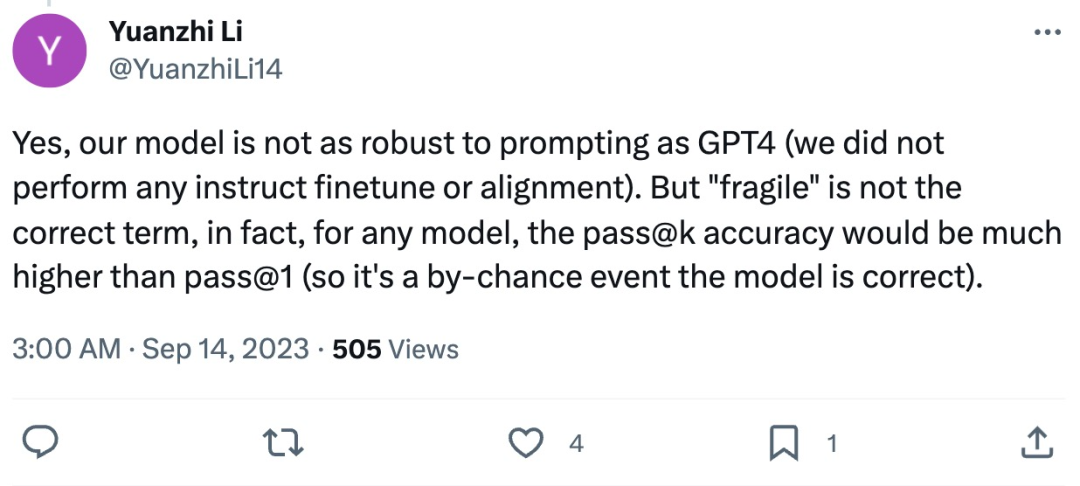

看到這些質疑與討論,網友們直呼:「最簡單的回應方式就是直接公開合成數據集。」

對此,你怎么看?