吳恩達加入圖靈三巨頭混戰,炮轟Sam Altman:AI監管「不會管不如不管」,LeCun轉贊

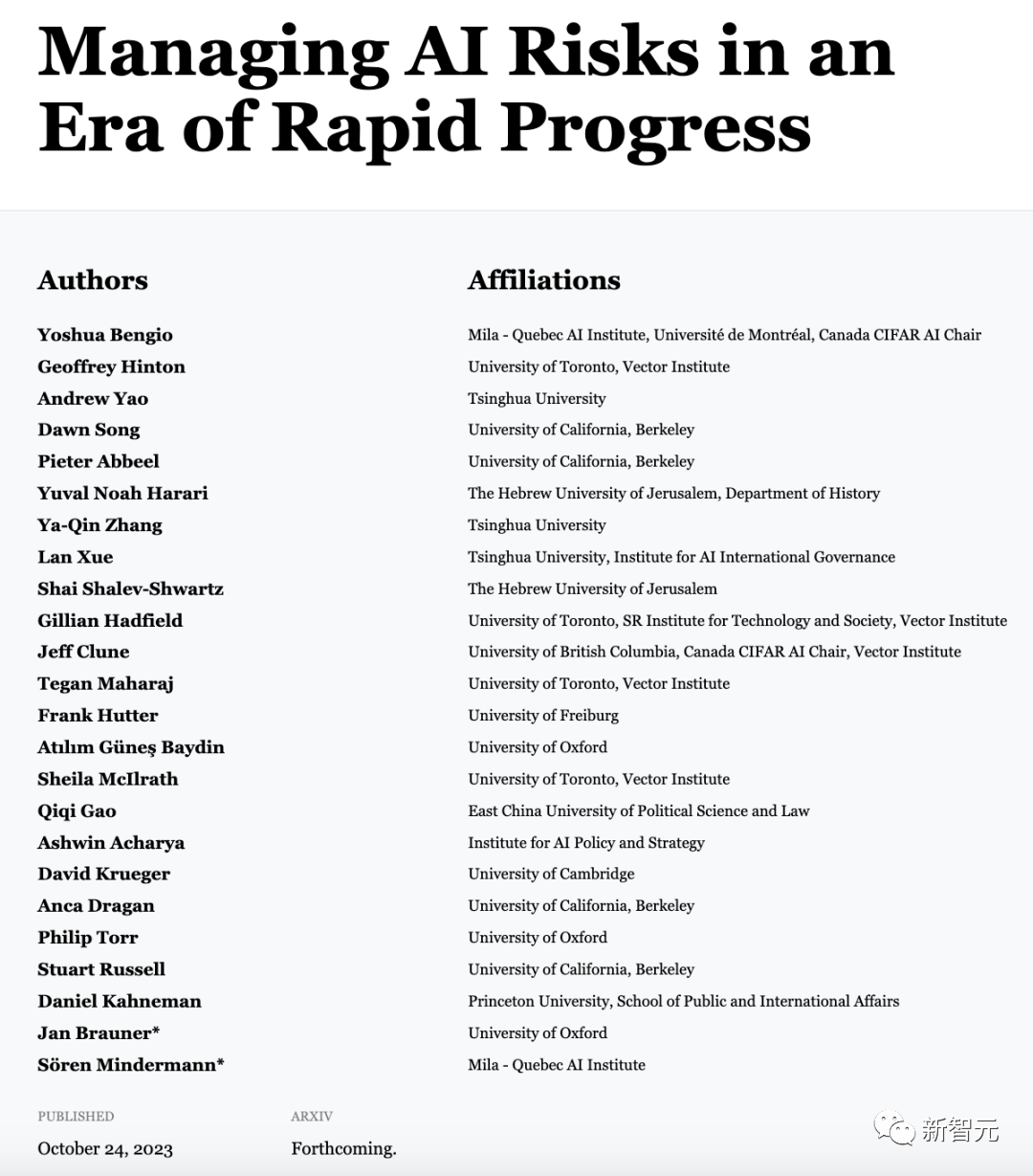

就在前幾天,Benjio等一批大佬針對人工智能可能危及人類命運的議題,又一次公開簽署了一封聯名信。

Hinton,Benjio在信中繼續呼吁加強對于AI技術發展的監管。

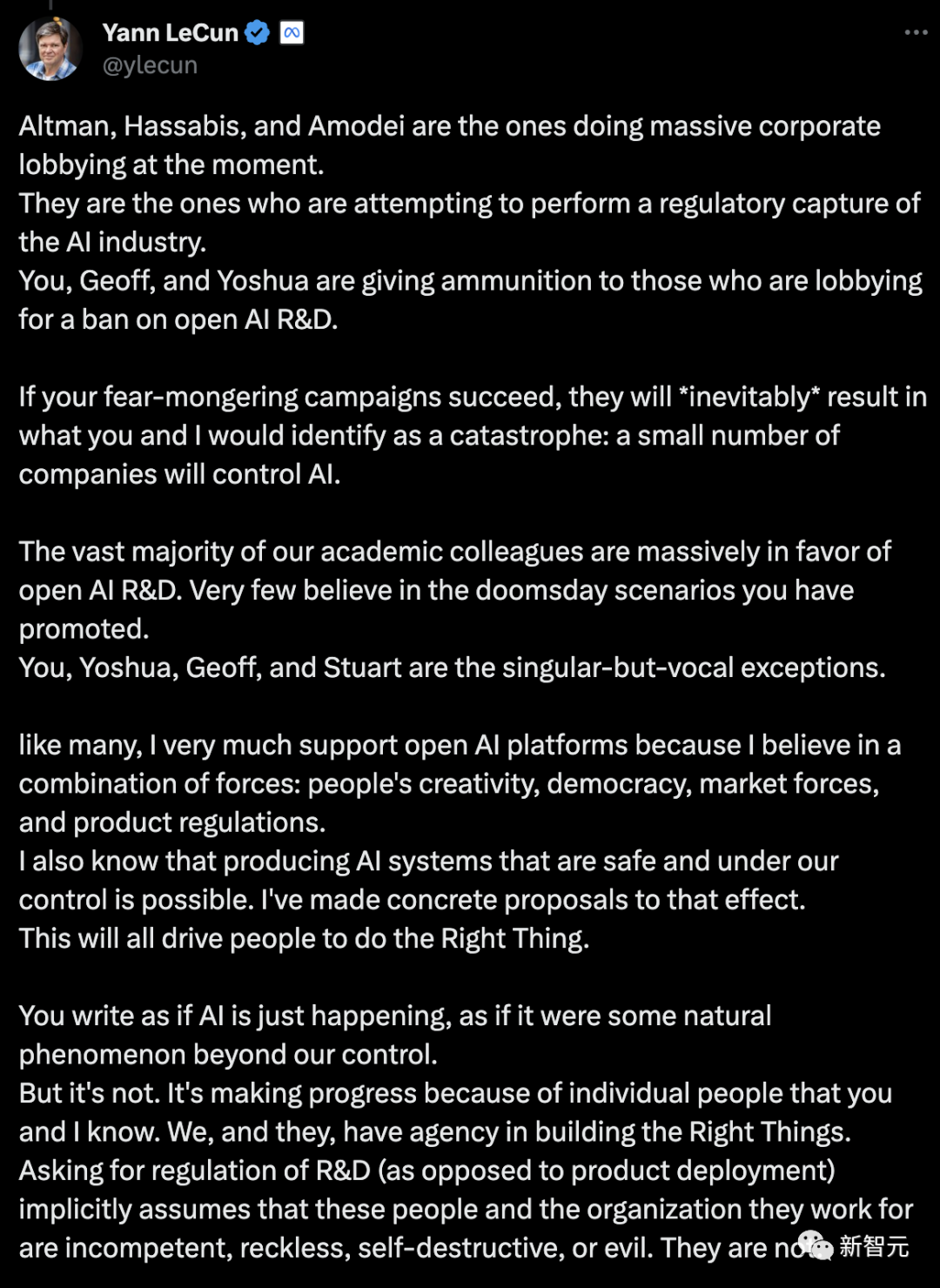

然而,以LeCun為首的「LLM成不了氣候」派公開表態,AI監管弊大于利!

他們認為,相比于去擔心「AI將引發世界末日」這種虛無縹緲風險,AI強監管所帶來的「巨頭壟斷」,才是需要從業人員和政策制定者關心的緊迫問題。

LeCun直接在推上點名了Sam Altman和DeepMind的Hassabis等人,認為他們試圖通過游說監管來鞏固自己的行業地位,阻礙AI開源的推進。

而且最近外媒爆出,吳恩達雖然在「LLM潛力」問題上,與LeCun有所分歧,但同樣認為,不應該對AI技術的發展進行全面的嚴格監管。

「當你把這兩個糟糕的想法放在一起時,你會得到一個非常非常愚蠢的想法——試圖要求人工智能獲得許可的政策提案,」吳恩達在接受「Financial Review」采訪時表示。

而除了不斷有業界大佬下場開撕之外,各國的政策制定者也已經開始行動。

美國政府已經出臺行政命令,要求所有「前沿大模型」公司在訓練模型時必須要通知政府。

而且還要求企業評估AI產品對于勞動力市場的影響情況。

吳恩達站隊LeCun:AI技術必須開放

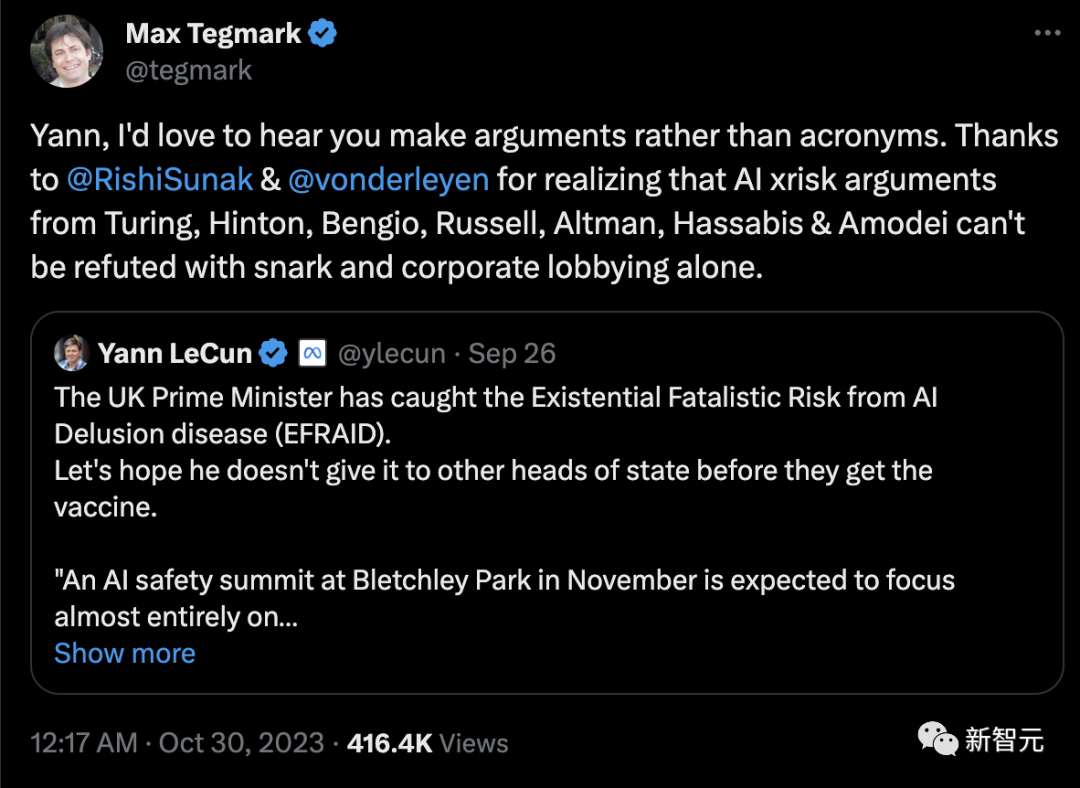

LeCun是在與MIT教授,知名物理學家,AI學者Tegmark的討論中集中表達了自己對于最近聯名信的看法的。

他認為「Sam Altman(OpenAI)、Hassabis(DeepMind)和Amodei(Anthropic)目前正在進行大規模的企業游說活動。他們是那些試圖對人工智能行業進行監管的人。

Tegmark、Hinton和Benjio正在為那些游說禁止開放人工智能研發的人提供彈藥。」

而吳恩達在最近接受媒體采訪時表示,對AI技術發展進行強監管是一個「陰謀」。

「當你把這兩個糟糕的想法放在一起時,你會得到一個非常非常愚蠢的想法,即試圖要求人工智能獲得許可的政策提案,」他在接受采訪表示。

「這會摧毀創新,」吳恩達強調。「肯定有一些大型科技公司不愿意與開源AI競爭,因此他們正在制造對AI導致人類滅絕的恐懼。」

「這一直是游說者尋求的立法武器,而這對開源社區來說是非常有害的,」他說。

「我不認為沒有監管是正確的答案,但隨著許多國家監管的發展方向,我認為沒有監管會比現在的情況更好」

而對于Sam Altman,吳恩達也表示了不同的看法,「Sam是我在斯坦福大學的學生之一。他和我一起實習。我不想專門談論他,因為我讀不懂他的想法,但是……我覺得有很多大公司會發現不必與開源LLM競爭會少很多麻煩。」

而很多網友擔心大佬們的關系會不會受到論戰的影響,不過LeCun前段時間發的一條推特很好地回應了這個問題。

「君子和而不同」,觀點的差異不影響他們亦師亦友的親密關系。

監管已經開始層層加碼

前不久白宮公布了拜登總統期待已久的人工智能技術行政命令,以期最大限度地減少人工智能系統給公眾帶來的一些風險。

對于美國來說,人工智能已迅速深入從搜索引擎到華爾街等各個領域。專家們對這場人工智能軍備競賽,包括隨之而來的失業、金融崩潰,以及深度造假等問題提出了嚴重擔憂。

然而,該行政命令幾乎沒有為因人工智能系統而面臨失業或收入減少的工人提供具體保護。

到目前為止,人工智能帶來的罷工問題仍然使好萊塢等娛樂業陷入停滯,原因就在于AI的應用減少了好萊塢作家和演員們的工作機會。

再往前一點,今年三月,英國政府公布了一份白皮書來保護AI領域的創新,卻在短短兩個月后就開始討論對AI的發展進行監管和限制。

自去年OpenAI的ChatGPT問世以來,它所表現出的驚艷的能力使得眾多領域的目光都聚焦在它上面。

隨著人工智能在各行各業的應用越來越廣泛、越來越深入,有關AI的安全性問題也同樣引起人們的思考,甚至于有一股「末世論」甚囂塵上。

「面對全球威脅,人類表現出了非凡的團結,核不擴散方面的國際合作就證明了這一點。我們認為,人工智能系統帶來的風險至少需要同樣的謹慎和協調。」