單點端到端文本檢測識別框架速度提升19倍!華科、華南理工等聯合發布SPTS v2

近年來,場景文本閱讀(Text Spotting)有了顯著進步,能同時定位和識別文本,廣泛應用于智慧辦公、金融、交通等領域。

然而,與目標檢測相比,文字除了定位還需要精確識別內容;同時,由于字體和排版的不同,文本實例可能以任意形狀呈現,這就需要使用包含更多坐標的邊界框來標注,例如SCUT-CTW1500最多使用了28個坐標進行標注,標注成本十分高昂。

圖片

圖片

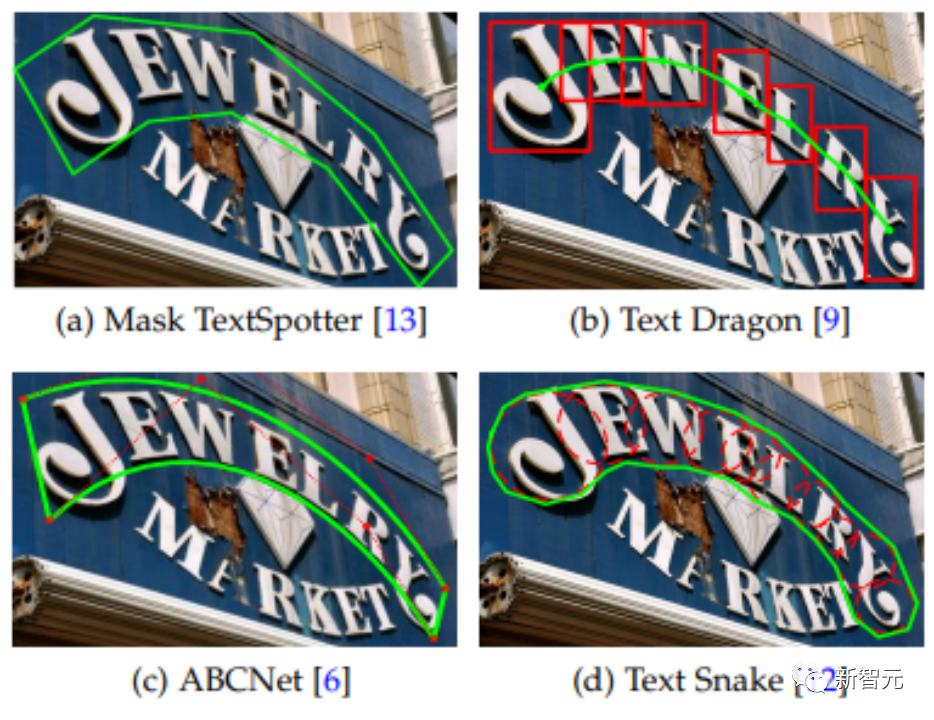

近幾年,以多邊形及貝塞爾曲線表征為基準的任意形狀文字表征成為了主流研究方向。然而多邊形的標注成本十分昂貴。 在此背景下,SPTS系列論文首次證明了不需要任何標注框,僅用單點標注即可取得最好的識別結果,極大地降低了標注成本,同時單點顯著地降低了表示文本的序列長度。然而,由于文本內容(transcript)通常很長(如默認最少25),將所有文本放在一個自回歸序列中串行解碼依然會導致推理時間非常長。

圖片

圖片

論文鏈接:https://arxiv.org/abs/2301.01635

代碼地址:https://github.com/Yuliang-Liu/SPTSv2

今年9月,華中科技大學白翔團隊劉禹良研究員聯合華南理工大學、浙江大學、香港中文大學、字節跳動等機構的研究人員于TPAMI在線發表了SPTS v2的相關工作,針對端到端場景文本檢測識別任務,提出基于單點標注的SPTS v2方法。

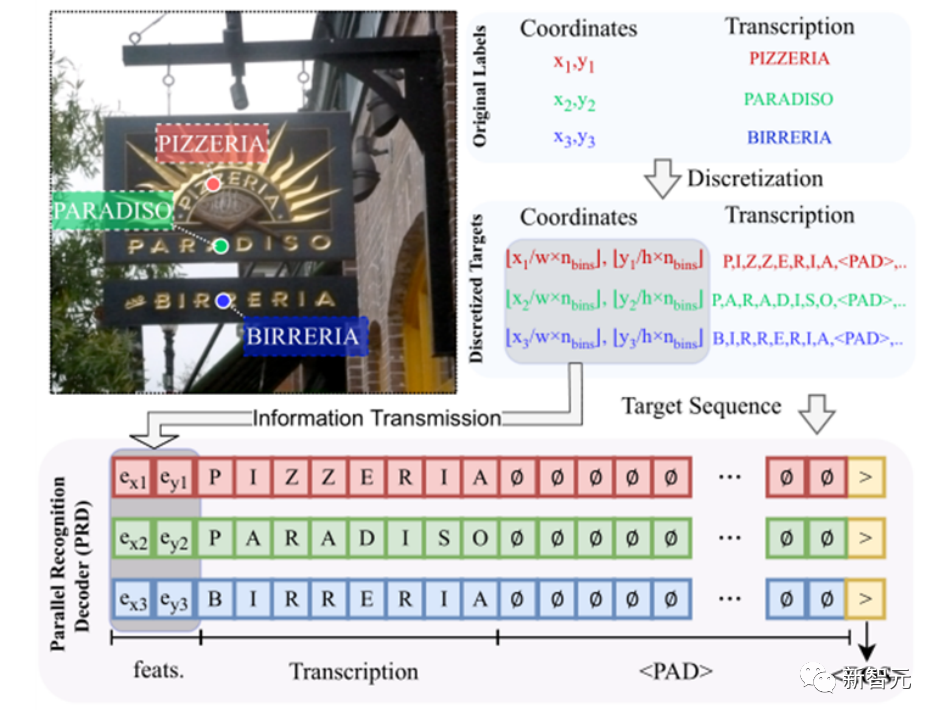

該方法采用了單點來指示文本位置,采用語言序列統一表征圖片、坐標及文本等不同模態,使得檢測及識別任務的融合更加緊密,也免除了先驗知識的介入和復雜的后處理操作。針對其自回歸推理速度較慢的問題,通過將檢測識別解耦為自回歸的單點序列預測及基于每個單點的并行文本識別進行推理加速。

此外,該方法同樣采用了單點來指示文本位置,極大地降低了標注成本,并且使用序列預測的方式完成端到端場景文本檢測識別任務,使得兩個任務的融合更加緊密,也免除了先驗知識的介入和復雜的后處理操作。

實驗證明該方法在多個場景文本端到端檢測識別數據集上優于現有方法,同時相對于SPTS v1達到了19倍的推理加速。

大白話SPTSv2

1. 怎么用點實現Text Spotting?

以前的Text Spotting方法通常依賴于先檢測后采樣再識別的端到端模式,強依賴于核心對齊模塊,如Mask TextSpotter[2]的Hard ROIMasking、TextDragon[3]的ROISlide及ABCNet[4]的BezierAlign等。

圖片

圖片

SPTSv2通過序列來統一表征文本實例位置和內容,將Text Spotting簡化為離散空間的連續描述。這種檢測識別同時預測的方式解耦了識別對檢測結果的強依賴,鑒于此,該方法進一步將邊界框簡化為位于一個點標注。

2. 為什么SPTSv2能顯著降低推理時間?

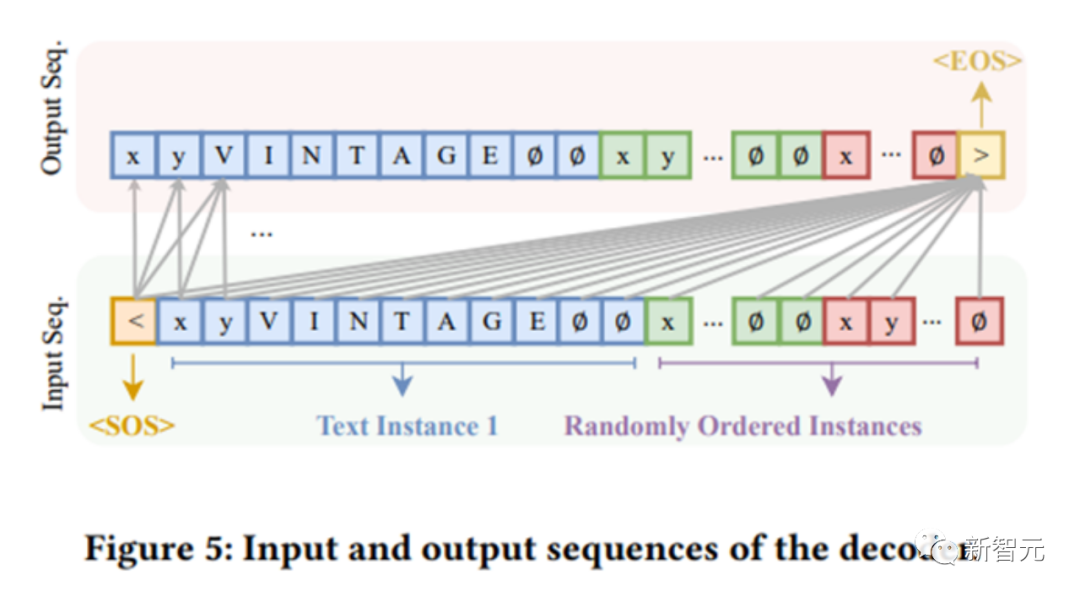

自回歸方法的推理時間,在很大程度由串行循環次數決定。假設一張圖片最多包含N個文本實例,每個實例最多包含K個字符,每個實例的位置表征個數為T(單點為2,包括橫縱坐標,14點的多邊形就是28)。

對于原始的自回歸來說,將所有坐標和文本都放在一個序列里面實現,那么預測這張圖片需要(T + K) * N + 1個串行循環次數;最后的+1代表終止符號。

圖片

圖片

舉個例子,假設設置最長有100個文本實例,最大長度取最小默認值25。

那么,對于單點來說,串行循環次數是2701次。對于多邊形來說就是5301次。

而SPTS v2提出了實例分配解碼器(IAD)和并行識別解碼器(PRD),串行自回歸只需要單點坐標參與,識別解碼是由每個單點并行自回歸得到的,總共只需T * N + K + 1個串循環次數,減少了K * (N - 1)。

那么在上述例子中,SPTSv2只需要226次,循環數量減少了91.6%(226/2701),對于文本行來說,K通常取100,此時循環數量甚至減少了97.0%!

同時,在實際上可能串行循環次數還能進一步減少,因為在SPTSv2的識別預測上,如果所有實例都遇到序列結束符,SPTS v2也可以提前結束。

圖片

圖片

因此,通過這種并行預測,推理速度可以顯著提高。

3. 點的表征有什么性質及優點?

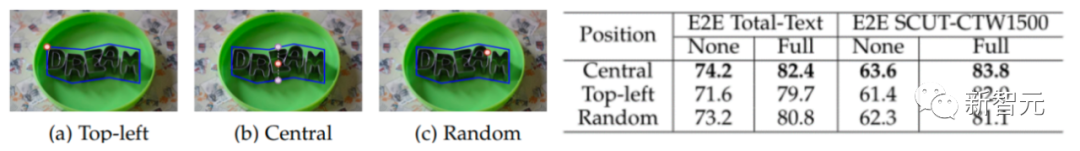

① 點的標注可以很隨意。

實驗表明,點即使是隨機的一個點,效果依然是和全部選取中心點相差不大的,甚至比全部取左上角點還要高。這意味著標注人員僅需對著文本隨意點一個點即可標注文本。

圖片

圖片

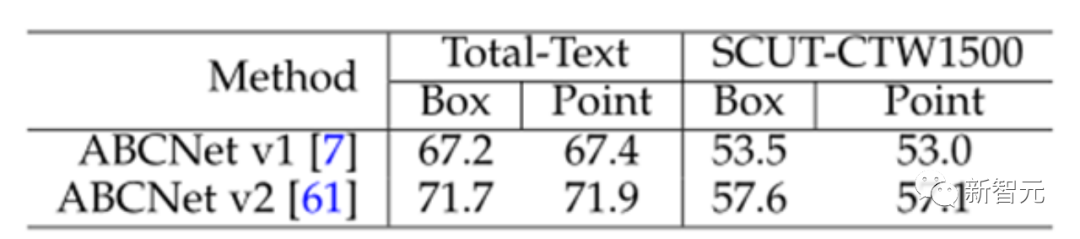

② 點的性能很高。

文中點的性能取得了最好的Text Spotting結果。同時為了消除是否是因為點和框不同評估標準的影響,實驗驗證了點的評估和框的評估性能差異不大。

圖片

圖片

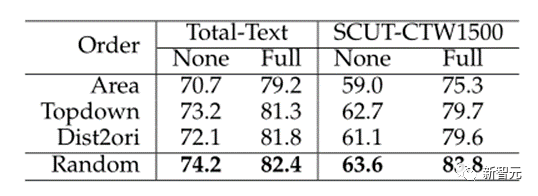

③ 隨機文本排序最好。

由于自回歸的有序性,第一階段預測哪個文本點的順序可能會對結果產生影響。實驗表明隨機點排序達到了最佳性能,因為它可能會在以后捕獲那些丟失的對象。由于在不同迭代中為同一圖像構建的不同序列,這使模型更加魯棒。這一結論也與Pix2seq[5]一致。

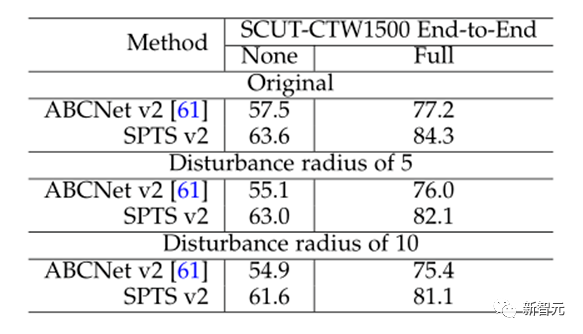

④對噪聲更加魯棒。

在SCUT-CTW1500上對框或者點的坐標加上隨機擾動,實驗結果表明SPTSV2相比于基于框的方法能夠更好地應對標注噪聲。

⑤甚至很長的文本行也可以僅用一個點標注。

如SCUT-CTW1500就是文本行數據,SPTSv2效果不僅是最好的,還大幅好于基于框的方法。

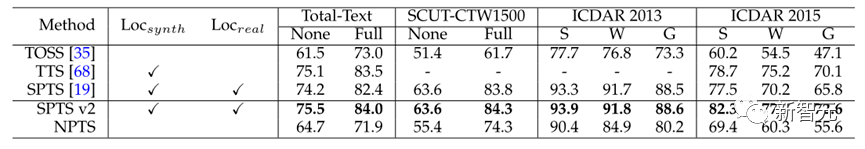

4. 既然檢測識別解耦,是不是該方法不需要點也能識別結果?

回答是肯定的。文中進一步嘗試了No-Point Text Spotting(NPTS),在僅僅使用文本轉錄訓練的情況下,NPTS取得了較好的性能。但是,相比起有單點標注的結果,性能差距十分明顯,平均10%以上的差距,這證明點的標注對最終性能還是至關重要的。

圖片

圖片

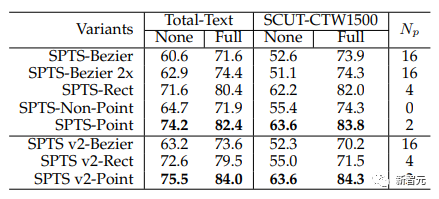

此外,值得一提的是,文中還有一個有趣的發現。僅僅只是在SPTS的框架內驗證,如果不預測點,而是預測水平矩形框和多邊形,效果不如點。針對這一現象,文中做了一些分析:

圖片

圖片

① SPTS-Rect和SPTS-Bezier的結果是根據與SPTS-Point相同的訓練時長獲得的,三者除了點的數量以外其他嚴格一致。實驗顯示,訓練了2倍周期的SPTS-Bezier與1倍周期的比沒有顯著超越。此外,采用較長的時間甚至會導致其在SCUT-CTW1500的None指標上的表現降低,這表明訓練時長可能不是主要問題。② 過去Text Spotting方法經常可以觀察到,有時即使檢測結果不準確,識別結果仍然可以準確。這是因為文本識別的對齊是基于特征空間的,其中裁剪的特征對于文本內容有足夠的接受字段,這表明方法對于框的位置標注要求并不是非常敏感。由于SPTSv2的方法中圖像是利用Transformer進行全局編碼的,近似的位置可能足以讓模型捕獲附近的所需特征。當然這一結論僅僅只是在SPTSv2的框架內做了驗證。

圖片

圖片

總結

本文的方法能夠在任意形狀的文本上獲得更好的準確性的原因可能是:所提出的方法丟棄了基于先驗知識設計的特定任務模塊(例如RoI模塊)。因此,識別精度與檢測結果解耦,即使檢測標注點在文本區域內隨機,本文的方法也能獲得魯棒的識別結果。實驗證明SPTS v2在多個場景文本端到端檢測識別數據集中均有出色的表現,且推理速度可達到SPTS的19倍。SPTS v2將多模態數據統一表征的訓練方法使其特別適合多模態、多任務場景,且整個方法僅需一個交叉熵損失函數,框架十分簡潔。另一方面,它能大大減少所需的自回歸序列長度(如減少91%)。事實上,這也引發了思考,大模型ChatGPT本質上也是一個自回歸Transformer。假如,當其能夠在第一階段串行輸出關鍵點,建模不同點之間的關系,那么第二階段是否也可以根據不同關鍵點并行輸出所有文本內容,這種「分點作答」的方式,或許也可以大幅度提升大模型輸出的速度。

參考資料:

[1] Yuliang Liu, et al. “SPTS v2: Single-Point Scene Text Spotting.” IEEE Transactions on Pattern Analysis and Machine Intelligence. 2023.

[2] Minghui Liao, et al. "Mask textspotter v3: Segmentation proposal network for robust scene text spotting." Computer Vision–ECCV 2020: 16th European Conference, Glasgow, UK, August 23–28, 2020, Proceedings, Part XI 16. Springer International Publishing, 2020.

[3] Feng Wei, et al. "Textdragon: An end-to-end framework for arbitrary shaped text spotting." Proceedings of the IEEE/CVF international conference on computer vision. 2019.

[4] Yuliang Liu, et al. "Abcnet v2: Adaptive bezier-curve network for real-time end-to-end text spotting." IEEE Transactions on Pattern Analysis and Machine Intelligence 44.11 (2021): 8048-8064.

[5] Chen Ting, et al. "Pix2seq: A language modeling framework for object detection." arXiv preprint arXiv:2109.10852 (2021).