一條磁力鏈接席卷AI圈,87GB種子直接開源8x7B MoE模型

「高端」的開源,往往采用最樸素的發(fā)布方式。

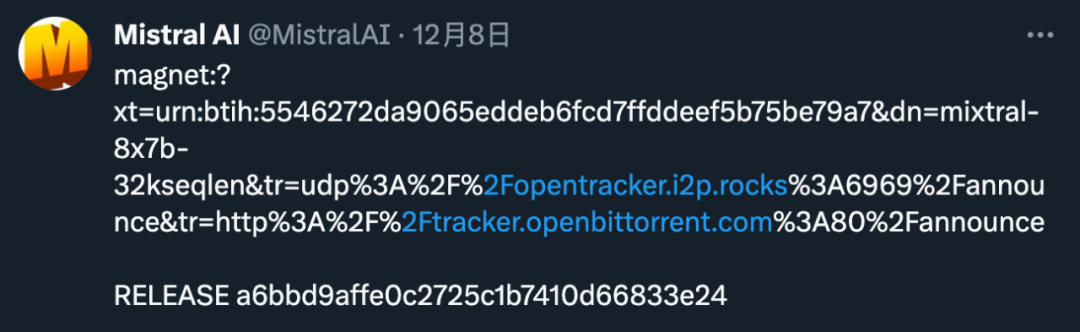

昨天,Mistral AI 在 X 平臺(tái)甩出一條磁力鏈接,宣布了新的開源動(dòng)作。

沒有長(zhǎng)篇官方博客,沒有刻意加速的 Demo,這家公司算是當(dāng)下大模型領(lǐng)域的「一股清流」。

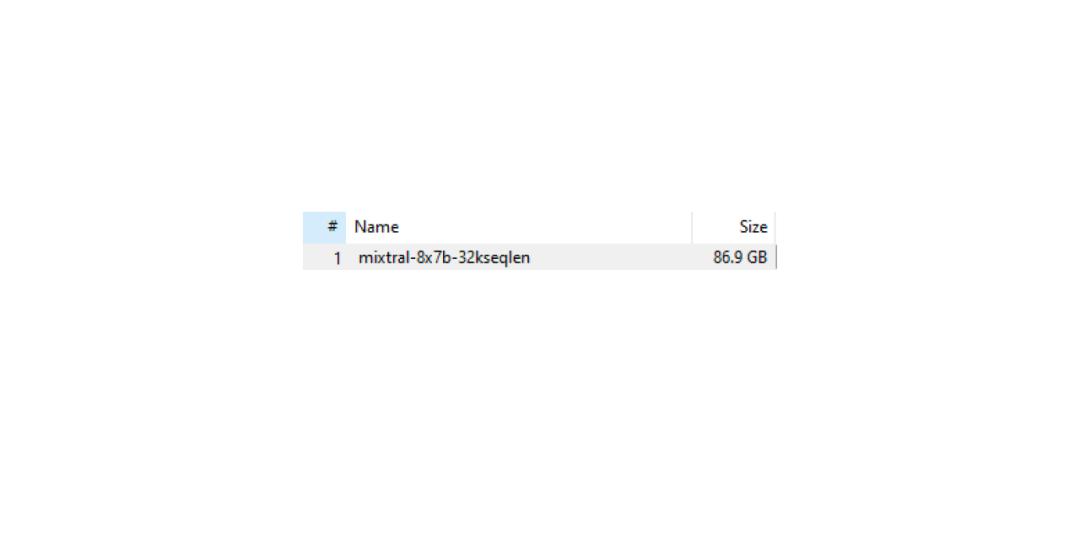

打開一看,發(fā)現(xiàn)是接近 87 GB 的種子:

參數(shù)配置什么樣?很多人放棄了周末,第一時(shí)間下載運(yùn)行起來。

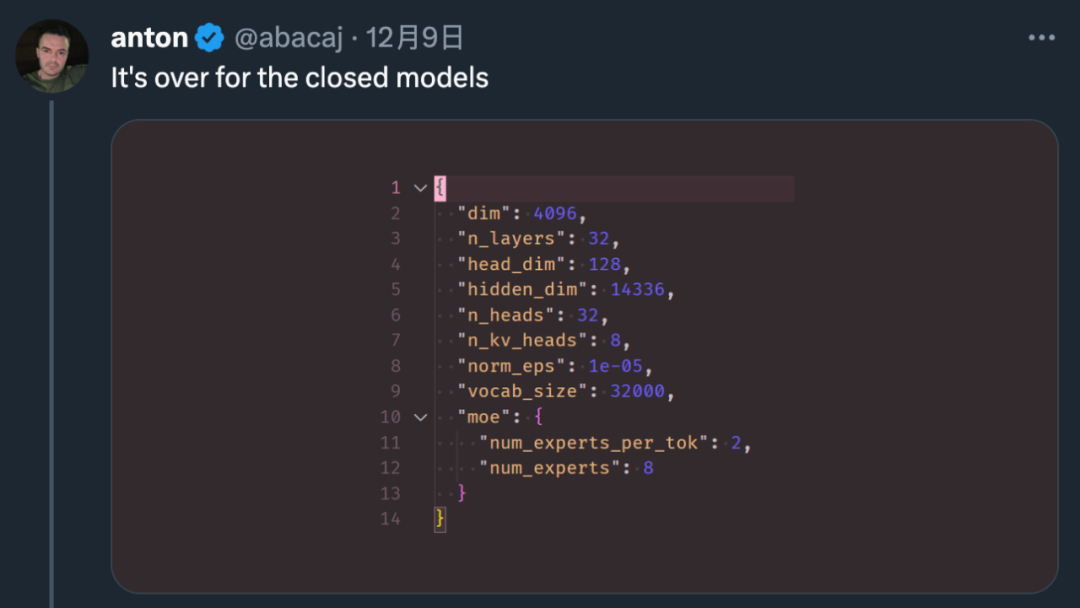

看上去,Mistral 8x7B 使用了與 GPT-4 非常相似的架構(gòu),但是「縮小版」:

- 8 個(gè)專家總數(shù),而不是 16 名(減少一半)

- 每個(gè)專家為 7B 參數(shù),而不是 166B(減少 24 倍)

- 42B 總參數(shù)(估計(jì))而不是 1.8T(減少 42 倍)

- 與原始 GPT-4 相同的 32K 上下文

在發(fā)布后 24 小時(shí)內(nèi),已經(jīng)有開發(fā)者做出了在線體驗(yàn)網(wǎng)站:https://replicate.com/nateraw/mixtral-8x7b-32kseqlen

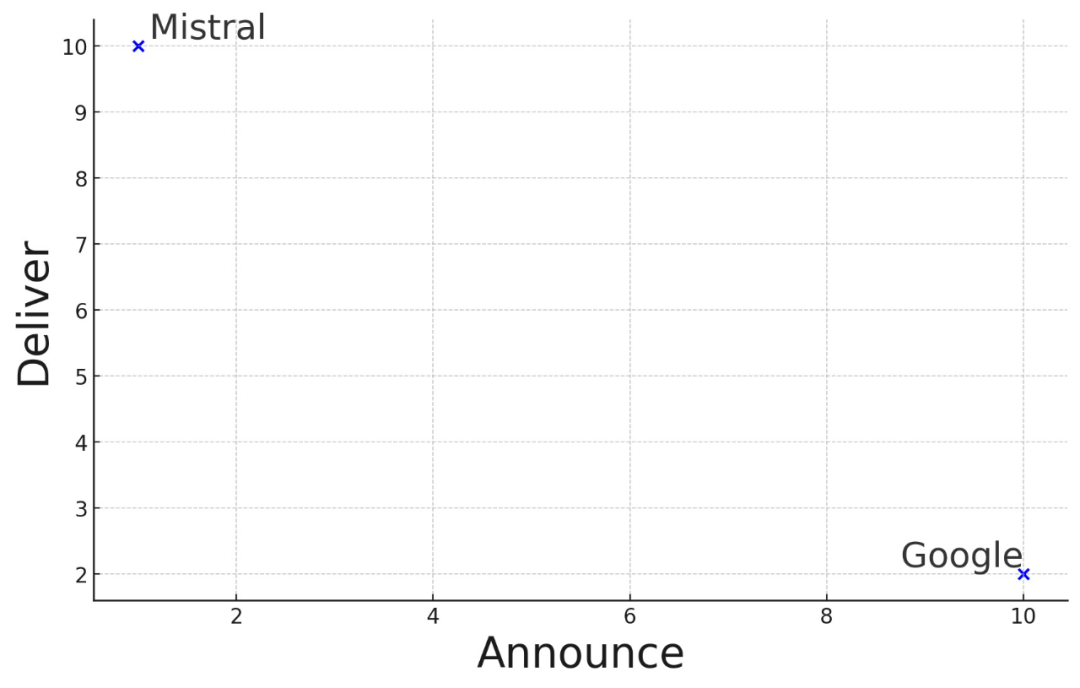

有研究者稱:「閉源大模型走到結(jié)局了。」

這周已經(jīng)引發(fā)群嘲的谷歌,也再次被 Cue 到:

專家混合 (MoE) 是 LLM 中常用的一種技術(shù),旨在提高其效率和準(zhǔn)確性。這種方法的工作原理是將復(fù)雜的任務(wù)劃分為更小、更易于管理的子任務(wù),每個(gè)子任務(wù)都由專門的迷你模型或「專家」處理。

具體來說,「專家層」是較小的神經(jīng)網(wǎng)絡(luò),經(jīng)過訓(xùn)練在特定領(lǐng)域具有高技能,每個(gè)專家處理相同的輸入,但處理方式與其特定的專業(yè)相一致;「門控網(wǎng)絡(luò)」是 MoE 架構(gòu)的決策者,能評(píng)估哪位專家最適合給定的輸入數(shù)據(jù)。網(wǎng)絡(luò)計(jì)算輸入與每個(gè)專家之間的兼容性分?jǐn)?shù),然后使用這些分?jǐn)?shù)來確定每個(gè)專家在任務(wù)中的參與程度。

我們都知道,OpenAI 團(tuán)隊(duì)一直對(duì) GPT-4 的參數(shù)量和訓(xùn)練細(xì)節(jié)守口如瓶。早些時(shí)候,有人爆料 GPT-4 是采用了由 8 個(gè)專家模型組成的集成系統(tǒng)。后來又有傳聞稱,ChatGPT 也只是百億參數(shù)級(jí)的模型(大概在 200 億左右)。

傳聞無從證明,但 Mistral 8x7B 可能提供了一種「非常接近 GPT-4」的開源選項(xiàng)。從模型元數(shù)據(jù)中可以看出,對(duì)于每個(gè) token 的推理,Mistral 8x7B 僅使用 2 個(gè)專家。

更讓人感覺有趣的是,這是該公司官方賬號(hào)自開通以來發(fā)布的第三條內(nèi)容,兩次重要發(fā)布均無文字說明,配圖什么的更是不存在:

9 月底的那條鏈接發(fā)布的是 Mistral 7B,該模型至今仍被稱為「最好的 7B 模型」,在每個(gè)基準(zhǔn)測(cè)試中都優(yōu)于 Llama-2 13B,并且在代碼、數(shù)學(xué)和推理方面優(yōu)于 LLaMA-1 34B。

Mistral AI 成立于 2023 年 5 月,是一家法國(guó)人工智能初創(chuàng)公司,也是為數(shù)不多來自歐洲的大模型開源領(lǐng)域的明星團(tuán)隊(duì)。

Mistral AI 曾在 6 月獲得了創(chuàng)紀(jì)錄的 1.18 億美元種子輪融資,還是在僅有 7 頁 PPT 的情況下,據(jù)說這是歐洲歷史上最大的種子輪融資。

Mistral AI 團(tuán)隊(duì)成員。

公司創(chuàng)始人之一 Arthur Mensch 曾在 10 月份向《金融時(shí)報(bào)》表示,Mistral AI 的技術(shù)比美國(guó)的一些強(qiáng)大競(jìng)爭(zhēng)對(duì)手開發(fā)的技術(shù)更高效、成本更低。

技術(shù)實(shí)力的優(yōu)越,也為這家公司帶來了投資者的持續(xù)關(guān)注。

近日,《金融時(shí)報(bào)》報(bào)道了 Mistral AI 新一輪融資的動(dòng)態(tài):新一輪融資約 4 億歐元,主要由股權(quán)組成,可能在下周官宣。目前,公司的最新估值在 20 億歐元左右。

知情人士透露,新一輪融資由硅谷著名風(fēng)投 Andreessen Horowitz 牽頭,其他參與者還包括英偉達(dá)、Salesforce、General Catalyst、法國(guó)巴黎銀行等。

Mistral AI 的其他投資者還包括谷歌前 CEO 埃里克?施密特 (Eric Schmidt)、法國(guó)電信億萬富翁澤維爾?尼爾 (Xavier Niel) 和法國(guó)國(guó)家支持的投資銀行 Bpifrance。

這篇報(bào)道還提到,Arthur Mensch 表示「雖然公司尚未賺到任何錢,但預(yù)計(jì)這種情況將在年底前發(fā)生改變,因?yàn)樵摴緶?zhǔn)備了一個(gè)新平臺(tái),供客戶訪問其人工智能模型。」

參考鏈接:https://www.ft.com/content/ea29ddf8-91cb-45e8-86a0-f501ab7ad9bb